- Milyen okostelefont vegyek?

- Samsung Galaxy S26 Ultra - fontossági sorrend

- Xiaomi 17 Ultra - jó az optikája

- Friss információk és képek a OnePlus új órájáról

- Samsung Galaxy A56 - megbízható középszerűség

- iPhone topik

- Fotók, videók mobillal

- Itt a Galaxy S26 széria: az Ultra fejlődött, a másik kettő alig

- Android alkalmazások - szoftver kibeszélő topik

- Olcsón ad sokat, de a minősége... Kukirin G2 Ultra teszt

Új hozzászólás Aktív témák

-

paprobert

őstag

Egyetértek, szubjektíven a 3-5% tempóelőny engem nem "vesz meg", a driverek miatti instabilitás viszont tényező egyelőre. Ráadásul a 2060 húzva egy hajszállal, de gyorsabb mint a szintén húzott 5600XT.

Durva belegondolni, de ha a Navi kb. 3 éves életciklusát nézem, akkor ez idáig az élettartama 1/6-át labilis driverek kíséretében töltötte, és hol van még a vége...

-

válasz

Raggie

#40592

üzenetére

Raggie

#40592

üzenetére

Mondjuk azt nem értem miért is jár jobban. Kb a két kártya között van 20 dollár eltérés és 2 % teljesítménykülönbség játéktesztektől függően. cserébe az Nvida driveresen kiforrottabb, van RT, fejlettebb stream támogatás.

Plusz hozzátenném hogy az RTx 2060 nem véletlenül maradt meg egyedüli sku nak a régi szériából. hónapokkal ezelőtt, biztos vagyok benne hogy tudatos döntés volt és az 5600 XT nek szánták.

A harmadik hogy másfél éve a 2060 kijövetelkor a 350 dolláros 2060 miatt kellett AMD nek lecsökkentenie a 439 dolláros Vega 64 és a 379 dolláros Vega 56 árát. Ez az örök körfogás jelenti a fejlődést.

reméljük ősszel vagy télen az Nvidia miatt 200 dolláros lesz az 5600 XT

-

válasz

Raggie

#40592

üzenetére

Raggie

#40592

üzenetére

Egészen addig az is marad amíg az nVidia ki nem ad valami újat, vagy jelentősen le nem csökkenti a 2060S árát(nem fogja).

Ebben egyetértünk, de az RX5600XT ellenfele a sima RTX2060, nem az RTX2060Super.

Arra nem számítok, hogy 2020Q2-ben ebben az árrégióban kijöhet az nVidia új kártyája, de tippre őszre már így lesz.Addig az RTX2060 és az RX5600XT fog versengeni...

A nanométerek semelyik vevőt nem érdeklik! Még minket("enthousiast") vevőket sem! A teljesítmény igen.

Áttételesen pedig érdekelhet. A 12nm-es GPU-t olcsóbb gyártani, mint a 7nm-est. Szvsz az nVidia még így is bőven nyereségesebb az RTX2060-ba kerülő selejtes TU104 és TU106 GPU-k eladása terén, mint az AMD az RX5600XT-be kerülő selejtes Navi10-esk terén...Szvsz az nVidia csak azért nem 279$-re vitte le az RTX2060 árát, mert az "old bios"-os RX5600XT teljesítményt várta. Ilyen téren ezt az kört az AMD nyerte.

A másik oldalról viszont elég kínos, hogy az AMD csak azt a teljesítmény/fogyasztás szintet tudja kihozni a 7nm-ből, amit az nVidia a 12nm-ből hoz ki. Az nVidia a 7nm-re váltásnál várhatóan kényelmesen tudni fogja adott fogyasztási szinten a 30%-os fogyasztáscsökkentést. Vagyis az nVidia kártyák kevesebbet fognak fogyasztani, kisebb és olcsó hűtő elegendő lesz a lehűtésükre és olcsóbb VRM-el is beérik. Ezek mind olyan tényezők, amik az árakat befolyásolják.

Mert az nVidia sem csökkentette volna le a 2060 árát akkor ha nem jön az 5600XT!

Ezt nem is vitatom. A baj csak annyi, hogy ennek az árversenynek 4-5 hónapja nagyobb hatása lehetett volna az AMD-re. Az nVidia ebből a helyzetből összességében jobban jött ki, a karácsonyi vásárlásoknál feltehetően hülyére kereste magát, most meg már csak követi az eseményeket, és előkészíti a piacot az Arcturus számára...Nyilván jobb volna ha erre fél/egy éve lett volna képes az AMD, de azért így is jó és nem pedig rossz.

Ahhoz, hogy az nVidia szintjére eljusson az AMD, ahhoz bevétel és nyereség kell, az nVidia most már két éve folyamatosan több nyereséget termel a dVGA üzletágon, mint az AMD forgalmat ugyanitt.

Akármi miatt is csúszott az RX5500 és RX5600 széria, a vége az lett, hogy az AMD meglehetősen sok pénztől esett el, így legalábbis egyenlőre, kevesebb pénz jut a fejlesztésekre és arra, hogy beérjék és egyenrangú felek legyenek az nVidiával. -

Raggie

őstag

Ha valaki most akar venni 300 dodó alatt kártyát, akkor ezzel jobban jár, mint a 2060-al. Pont.

Ezért adta ki az AMD. Egy évvel ezelőtt még nem tudta. Most tudja. Mostantól ebben az érzékeny ársávban ez a legjobb választás. Ennyi.

Egészen addig az is marad amíg az nVidia ki nem ad valami újat, vagy jelentősen le nem csökkenti a 2060S árát(nem fogja).A nanométerek semelyik vevőt nem érdeklik! Még minket("enthousiast") vevőket sem! A teljesítmény igen.

szerk: és ez a teljesítmény eddig nem volt elérhető 300 dollár alatt. Tehát még arra is van esély, hogy olyan valaki vesz majd most ilyet, aki eddig kivárt, mert nem kapott számára elég teljesítményt a pénzéért ahhoz hogy vásároljon. Mert az nVidia sem csökkentette volna le a 2060 árát akkor ha nem jön az 5600XT! Tehát azért előnye származott az egészből a vásárlóknak, aminek meg inkább örülni kéne szerintem. Nyilván jobb volna ha erre fél/egy éve lett volna képes az AMD, de azért így is jó és nem pedig rossz. -

RTX2060-al is lehet 60 FPS körüli teljesítmény bizonyos Ray-Trace effektekkel együtt, bizonyos beállításokkal (egyes játékokban akár High-on is), de szigorúan FHD felbontáson. Ha innen nézzük, akkor van értelme az RTX2060-nak és az RT-nek az RX5600XT ellenében.

Ha viszont valaki a nagyobb FPS-t tartja fontosnak, és amúgy sem a max.-ra húzott grafika a lényeg nála, akkor az RX5600XT feltehetően jobb választás számára.

-

"Ha ez tavaly szeptember-október magasságában kijött volna..."

Akkor pl. most lehet nem egy RTX2060 kártyám lenne... bár ezt használtan szereztem be, de akkor más, kedvezőbb árak is lettek volna gondolom.Olvastam a tesztben ugyan az erre vonatkozó sorokat, de úgy egyébként mi a vélemény a ray tracingről ebben a kategóriában? Hiányzó lenne vagy az 5600XT az egyértelműen jobb választás jelenleg?

-

-

Kijöttek az első RX5600XT tesztek.

Hát... furi. Egyfelől az új BIOS jelentősen (10-20%-al) nagyobb teljesítményt nyújt, ami azt jelenti, hogy az RTX2060-at sokszor lelépi, olykor még az RTX2060 Supert is (pl. Battlefield V). Viszont ennek ára az, hogy teljesítményben alig, mindössze 6-8%-al van lemaradva az RX5700-tól. Ezzel együtt driveres gondokról, több-monitoros felhasználásnál magas fogyasztásról, illetve kissé kiforratlan hűtés-finomhangolásról írnak még.

Ami még nagyon durva, hogy teljesítmény per fogyasztás terén a legjobb kártya az eredeti BIOS-al. Az újjal az RTX2060 körül mozog már csak.

Ez egyfelől jelzi, hogy talán ez lehetett a NAVI eredetileg tervezett szintje (mármint az eredeti BIOS), ahol nagyon jó fogyasztási értékeket tudtak volna mutatni. Csak úgy nem voltak versenyképesek a Super kártyákkal és árakkal.

Összességében jó kártya lehetne, de a kapkodva kiadott BIOS frissítésnek megvan az ára - sok esetben az AIB partnerek belőtték 150W körülre a fogyasztást, és egyben ehhez a hűtést. Na ez most ugrott egyet, a hűtés viszont nem mindenhol lett "utánaállítva".

-

-

GodGamer5

addikt

CSAK NEEEM?! Last Of Us 2 Pc-re??? [link]

-

GodGamer5

addikt

Gyorsulnak az új radeonok is.

[link]

[link] -

GeryFlash

veterán

-

Petykemano

veterán

Mindfactory W3 GPU shares

(DIY piac) -

Devid_81

félisten

válasz

TeeBee73

#40573

üzenetére

TeeBee73

#40573

üzenetére

Mennye' ma' most nezem premiumos vagy meg minden...

![;]](//cdn.rios.hu/dl/s/v1.gif)

Lehet be kell mar nezzek a kecsoi topikba, mert nagyon elkanaszodtatok![;]](//cdn.rios.hu/dl/s/v1.gif)

Szerk(#40572) b., nekem is van egy ilyen tippem, valoszinuleg majd a GigaRay-eket toljak meg azzal a bizonyos 50%-al amit mostanaban emlegetett par oldal.

Viszont valamit javulniuk kell, mert ezzel a semmitero RT-vel mar az eletben nem adjak el a next gen-t, hiaba lesz a fogyasztas is kisebb a 7nm miatt.

Nalam marad a mostani kartya az is biztos, majd ha mininum 60-75% nyerserovel lesz jobb az uj, es az ara is ertelmes lesz, akkor talan ujra gondolom ezt, addig nem erdekel tobb akom-bakom meg nem letezo RT es DLSS

-

Devid_81

félisten

Az 5700 eladasokat ezzel megoltek...

En csak azt sajnalom, hogy ez a 'verseny' itt az alsohazban ennyi ideig aludt.

Meg mindig draga, de mar egyre jobb vetel a 2060/5600XT legalabb azoknak akik most akarnak majd fejleszteni.

Sott mar inkabb az AMD akkor, talan tobb esely van ra, hogy lesz jovoje, nVidia mar lassan keszen van a next gen-el, onnan a Turing hirtelen mar nem fog sehova sem gyorsulni tovabb, csak csendben lemarad az ujak mellett

-

-

Devid_81

félisten

AMD Allegedly Bolstering Radeon RX 5600 XT in Response to RTX 2060 Price Cut

According to the report, AMD has increased clock-speeds of the RX 5600 XT to 1615 MHz gaming and 1750 MHz boost, versus 1375 MHz gaming and 1560 MHz on AMD's CES press-event slides detailing the card.

Ez igen, most mar ertem mit takar a Scalability a Navinal...koszi AMD

![;]](//cdn.rios.hu/dl/s/v1.gif)

Persze mindezt par nappal a hivatalos tesztek elott, biztos orulnek most egy paran akik mar kozel keszen voltak a tesztekkel

Szerk: amugy ez a kartya egyre jobb, nehogy majd elkuldjem nyugdijba a masodgep RX570-eset egy ilyenert

-

Ez azt jelenti hogy lesz 2060 280 $körül, mint ahogy volt 350 dolláros 2060 eddig is 320 környékén.

Nvidia által kikozolt MSRP tartalmaz már bizonyos százaléknyi kisker hasznot is, amit a hivatalos partnerek kijatszhatnak. Ha Evga képes 299 $ért adni a kártyát, akkor a Giga, Inno, 279 körül fog lenni hamarosan. Ez 90 ezer körüli bolti ár. Az 1660 TI-t Így le kell vinnie. -

Az nVidia formálisan is 299$-ra csökkentette az RTX 2060 árát, tehát az EVGA féle 279$ csak marketing volt, de a mostani 299$ már "valós" és minden gyártóra vonatkozó ajánlott ár.

Így az RX5600XT árához idomul valamelyest az RTX 2060, de nem annyira, ahogy az EVGA bejelentésekor először tűnt...

-

imi123

őstag

-

GeryFlash

veterán

válasz

Raymond

#40563

üzenetére

Raymond

#40563

üzenetére

Úgy értem végleges termékbe. Nézd meg hány 1070/2070-es laptop van, és hány 1080/2080. Nem azt mondom hogy nincs, de jóval ritkább, gyakran a high-end gmer notik is megállnak 2070nél.

Szerk.: Hmm, roszul tudom, msot megnéztem Iponon, kb ugyanannyi 2070-es gép van mitn 2080. Mea culpa

-

GeryFlash

veterán

Hát ha valóban 3070 lenne (ami abból a szempontból elképzelhető, hogy laptopokba x80-as számú kártya nem gyakran szokott jönni) akkor az állati komoly.Ezek alapján a 3060 valahol félúton lenen a 2080 és 2080TI között. Ez kb 60%+ előrelépés lenne, igazából tényleg nem lenne elképzelhetetlen, egy normális cég csak 7nm-re való ugrással tud hozni egy 25-30%-ot, és akkor még ott van az architektúrában lévő tartalék. Arról nem beszélve, hogy még mindig nem tudjuk biztosra min jön az Ampere, ha Samsungon akkor bizony ott van szabad kapacitás EUV nodera is. És talán még az árak sincsenek elszállva, lévén a Samu elég nagyokat szenved hogy bérbe tudja adni a gyártástechnológiáját, mindenki a TSMC-re viszi. Kérdés hogy a Samu EUV 7nm-je milyen.

Yutani: Szerintem nincs hova. Ampere leghamarabb nyárra jön ki, addigra már sokan keményen next-gen konzol generáció lázban égnek. Azt tudom elképzelni hogy esetleg az induló ár magas lesz, de kijönnek a konzolok és körberöhögik a 2xxx széria árait. Ergo a 2xxx szériát iszonyat módon le kell árazni hogy készlet kisöprés meglegyen, viszont ez fogja magával húzni a 3xxx árait is. Bízok benne hogy akkora lesz a konzol boom hogy az Nvidiának ahhoz kelljen árazni. Árszint emelkedést szerintem nem engedhet(ne) meg magának, hiába 50-60%-os ugrás. Aztán persze bármi lehetséges, hogy a jól fejhető PC gamerek most is kifizetik az évről évre magasabb felárat

-

-

Devid_81

félisten

NVIDIA Will Be Annnouncing 7nm Ampere GPUs At GTC 2020 In March

Lesz megint 30% teljesitmeny 50%-os plusz aron?

-

válasz

GeryFlash

#40547

üzenetére

GeryFlash

#40547

üzenetére

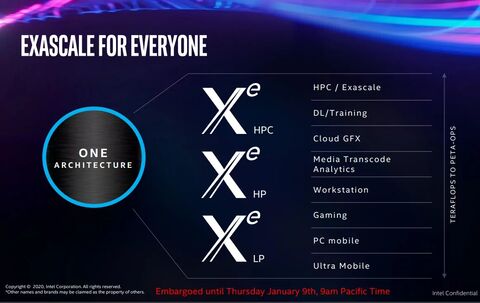

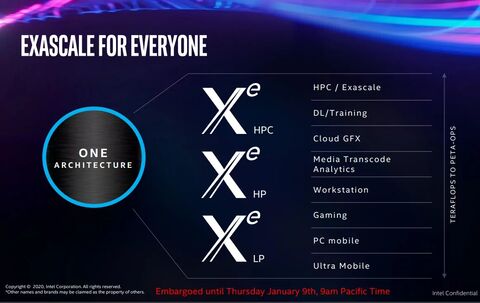

Mert nem egyetlen kártyáról van szó hanem egy komplett termékcsaládról teljesen új architektúrával ráadásul egy olyan gyártótól aki jelenleg a legnagyobb X86 gyártó és ezzel a rendszerrel teljesen össze kell dolgoznia az új terméknek mert nekik az az érdekük, hogy Intel mellé helyezd be ezt a GPU-t. Minden szegmensbe kell hozzá való drivert írni. professzionális és HPC szegmensben nem nagyon lehet hibázni driveres téren, ott nem annyiról szól, hogy kifagy a COD.

jelenleg ezek a várható kártyacsaládok szegmensenként amik között lesz átfedés.

Az első igazán játékra szánt kártyák az Xe LP .

iDG1LPDEV = “Intel(R) UHD Graphics, Gen12 LP DG1” “gfx-driver-ci-master-2624”

iDG2HP512 = “Intel(R) UHD Graphics, Gen12 HP DG2” “gfx-driver-ci-master-2624”

iDG2HP256 = “Intel(R) UHD Graphics, Gen12 HP DG2” “gfx-driver-ci-master-2624”

iDG2HP128 = “Intel(R) UHD Graphics, Gen12 HP DG2” “gfx-driver-ci-master-2624”Ennek értelmében a DG2-es megoldások 128, 256, illetve 512 stream egységet használnak majd. ( Ipon)

-

paprobert

őstag

válasz

GeryFlash

#40547

üzenetére

GeryFlash

#40547

üzenetére

1. Sok játék direkten nem támogat Intel hardvert, és elég sok játék grafikai hibákat produkál Intel iGPU-val. Néha külön szűrnek hardver vendor-ra, és ha Intel GPU-t észlel a rendszer, kiírja a játék, hogy bocs, de nem indulok el.

Mivel ezentúl várható, hogy lesz értékelhető teljesítmény is, kiküldik ezeket a stúdióknak, hogy lesztek szívesek kompatibilissé tenni az engine-t. Erre jó ez a kártya.

-

GeryFlash

veterán

Igen ezt a szoftverfejlesztőknek meg tesztelésre készült maszlagot több helyen leírták az Intel védően.

2 dolog ezzel kapcsolatban:

1.) Specifikáld mit jelent ez hogy szoftver fejlesztőknek készült VGA. Ez pontosan mit takar? Értem, nem játékokban erős hanem...? Mi a f*szhoz kéne egy c++/java/python fejlesztőnek dVGA? Ha meg más szoftverfejlesztőkről van itt szó akkor miért csak egy AMD APU IGP szintjét hozó dedikált kártya kell? Mi az amit ez tud ezen a fronton de a másik gyártó hasonló árazású és TDP keretű kártyái nem?

2.) Ha nem játékra készült (hanem sZoFtVeRfEjLeSzTőKnEk) akkor miért játékokkal demózták? -

válasz

GeryFlash

#40543

üzenetére

GeryFlash

#40543

üzenetére

" DG1-es típusjelzéssel ellátott termék, ami most bemutatkozott, igazából nem egy végleges videokártya, sokkal inkább egy fejlesztőknek és rendszerintegrátoroknak készített prototípus, amelynek segítségével fel lehet készíteni a szoftvereket és rendszereket az Xe architektúra köré épülő termékekre...

kifejezetten szoftverfejlesztőknek szánt prototípusról van szó, ami egészen biztosan különbözik valamelyest a végleges termékektől mind teljesítmény, mind pedig dizájn tekintetében."( Ipon)

-

Kolbi_30

őstag

válasz

GeryFlash

#40543

üzenetére

GeryFlash

#40543

üzenetére

Én nem ismerlek, nem tudom, hogy van tapasztalatod és mi területén. De az világos hogy kutatás fejlesztésben 0 alatt vagy.. 2 év az kB semmi. Egy rendes fejlesztés nulláról több mint 2 év. Nem védem az Intelt, de már meglevő architecturat is tovább csiszolni kB annyi mint amit ezzel a szarral töltöttek.

Ezeknel sokkal egyszerűbb eszközöket is több idő rendesen kidolgozni legyartani validalni... -

válasz

GeryFlash

#40543

üzenetére

GeryFlash

#40543

üzenetére

Szerintem túl sok és messzemenő következtetést vontál le egy tesztkártyáról. Egyértelműen kísérleti céllal adták ki, gondolom jön hozzá majd gaming szoftver meg frissítés. A kijövő IGP-s CPukkal való összedolgozást is tesztelik. Ha csak világszinten elmegy belőle 20.000 darab már nekik egyfajta képet ad különböző hardverekkel és operációs rendszerekkel összerakva a kártyáról, amiből majd levonják maguknak a következtetést. Nem tartom kizártnak, hogy majd bedobják csomagba pár kisebb energiatakarékosabb CPU mellé szinte ingyen.

-

GeryFlash

veterán

,,Azért nem teljesen fair az összehasonlítás, az nVidia évek óta sokkal jobb teljesítmény/fogyasztás mutató terén, mint a sokkal régebb óta talpon álló AMD. Ugye ma ott tartunk, hogy a 7nm-es Navi áll pariban ilyen téren a 12nm-en gyártott Turinggal. Te meg rögtön azt várod, hogy az újra biciklire pattanó Intel élből hozza azt, amit az AMD sem tud."

Rendben nézzük az AMD-t: Rx 560 75 watt TDP (van belőle [45 wattos változat] is). Rommá veri ezt 2017ből. Kérdés: melyik a jobb: Global Foundries 14nm-e vagy az Intel 10nm-e? Ha esetleg szerinted előbbi akkor miért nem 14+++++-on jött ami egyértelműen jobb,,Rajtad kívül szerintem senki sem várta, hogy az Intel DG1 rögtön versenyezni fog az nVidia és AMD belépő szintű kártyáival teljesítmény terén."

Nem értem, akkor minek? Az tiszta sor hogy 2 év alatt nem tudták közép-felsőközép-highend karit csinálni. De baszki hogy még alsó szegmensbe se hozza a 2016-os szintet? Nekem voltak irreális elvárásaim hogy jobb gyártástechnológián tele pénzzel+Rajaval esetleg hozzák azt amit az AMD/Nvidia hozott 2 éve alsó kategóriában? Ha igen akkor hogy vársz bármi féle versenyt, szerinted meddig fogja az Intel a pénzt önteni a diszkrét VGA-kba ha a következő 3-4 évekig nem tudnak ugyanabban az árkategóriában hasonló teljesítményt hozni mint a többi? Vagy majd a piachoz áraznak és akkor ez 50-60 dollárért, veszteségesen lesz árulva?

Kizártnak tartom hogy az Intel a mostani piacvesztései és következő pár szűkös években 5+ évig kitartson, a befektetők lázadozni fognak stb. Arról nem beszélve hogy most ezt a szégyenteljes teljesítményt gyártástechnológiai előnnyel hozták, mi lesz akkor amikor idén kijön az Nvidia paletta 7nanon? Tudod mikor fog az Intel 7nm-re lépni? Legkorábban 2022-ben szerver fronton, VGA részlegen a 2023 amire lőhetnek. Addigra a másik két cég 5nm-en lesz. Ez volt az utolsó lehetőségük hogy legalább gyártás technológiában ne legyen lemaradásuk hamár know-howban sehol nincsenek. Esetleg ha bérgyártatnák ők is akkor legalább egy szinten lesznek.

-

válasz

GeryFlash

#40540

üzenetére

GeryFlash

#40540

üzenetére

Pont erről írt mindenki.

Az Intel már jó ideje mondta, hogy ők először nem a csúcsot fogják megcélozni. Hovatovább a Techspot tavaly augusztusban már megpróbálta előre jelezni a várható teljesítményszinteket, ez a pesszimistább 1,2GHz-es sebességű változat:

Ez pedig az 1,7Ghz-es sebességre becsült teljesítmény:

Ugye a 128-as az LP, a 256-os a HP, az 512 pedig a HPC.

A fentiek alapján azt tippelem, hogy a 128-as jelenleg az alacsonyabb, 1.2Ghz-re becsült sebességgel mehet, ez alapján az Intel 10nm-es gyártástechnológiája ennyire nincs kiforrva továbbra sem.

"Ha 75 wattból annyit se tudnak kihozni mint az Nvidia megcsinált 2016-ban 16 nanon akkor szerintem nincs különösebb okuk az aggodalomra."

Azért nem teljesen fair az összehasonlítás, az nVidia évek óta sokkal jobb teljesítmény/fogyasztás mutató terén, mint a sokkal régebb óta talpon álló AMD. Ugye ma ott tartunk, hogy a 7nm-es Navi áll pariban ilyen téren a 12nm-en gyártott Turinggal. Te meg rögtön azt várod, hogy az újra biciklire pattanó Intel élből hozza azt, amit az AMD sem tud.

"Persze ettől még lehet a későbbiekben meghatározó szereplő az Intel, csak szerintem ez nem mostanában fog eljönni"

Rajtad kívül szerintem senki sem várta, hogy az Intel DG1 rögtön versenyezni fog az nVidia és AMD belépő szintű kártyáival teljesítmény terén. Viszont annak szerintem mindenki örül, hogy lesz egy harmadik versenyző, és végre történik valami a dVGA piacon, mert az elmúlt pár év egy kabaré volt sajnos...

-

-FreaK-

veterán

válasz

GeryFlash

#40540

üzenetére

GeryFlash

#40540

üzenetére

Ez egy Notebookba szánt diszkrét GPU megoldás (de külön kártyaként, mert szoftver teszteléshez lesz ugye) , aminek a teljesítményéről is csak következtetés van, és semmi konkrétat nem tudunk róla. Pl. Azt sem, hogy mennyi lesz a fogyasztása. Csak példaként: Ha az általad említett 60-90%-os gaint nyújtja teljesítményben, de a fogyasztása ugyan annyi, esetleg még kevesebb, akkor az nem olyan rossz.

Viszont ebből messzemenő következtetéseket levonni, főleg asztali gépekbe szánt grafikus kártyákra vonatkozóan jelenleg nem lehet.

Csodát nyilván nem művelt a demó kártya, de azt nem is várhatjuk el szerintem. -

GeryFlash

veterán

,,Mégis mit vártál, hogy majd 2 év alatt kihozzák az LP változatot egy 2080Ti szintű hardverként 75W-ból?

"

"Kérdésedre válaszolva: A saját processzorukhoz rakott IGP-jükhöz képest 60-90%-os gaint. Jelenleg ez az ipari hulladék alig erősebb mint a házon belüli Iris G7.

,,Tudjuk, hogy jön a HP és HPC változat. Minket inkább az érdekel, nem az LP..."

Meglátjuk mit fog tudni, nincs előttem ahogy az Nvidia de főleg az AMD reszketne. Ha 75 wattból annyit se tudnak kihozni mint az Nvidia megcsinált 2016-ban 16 nanon akkor szerintem nincs különösebb okuk az aggodalomra. Persze ettől még lehet a későbbiekben meghatározó szereplő az Intel, csak szerintem ez nem mostanában fog eljönni -

válasz

GeryFlash

#40535

üzenetére

GeryFlash

#40535

üzenetére

2 év alatt egy vadonatúj SKU-t kidolgozni igencsak szép teljesítmény.

Mégis mit vártál, hogy majd 2 év alatt kihozzák az LP változatot egy 2080Ti szintű hardverként 75W-ból?

Azt eddig is tudni lehetett, hogy az első hardver egy alacsony fogyasztású, relatíve kis teljesítményű kártya lesz, direkt az Xe fejlesztői háttér biztosítására, és nem egy ultranagy teljesítményű kártya nagy fogyasztással.

Tudjuk, hogy jön a HP és HPC változat. Minket inkább az érdekel, nem az LP...

-

GeryFlash

veterán

-

Devid_81

félisten

AMD Radeon(TM) Graphics” faster than GeForce RTX 2080 Ti

The bigger question appears when we are trying to figure out what the GPU in this test really is. It could be an unreleased graphics in an external GPU enclosure, a Radeon running in CrossFire, or the Big Navi.

Azonos felbontason nezzetek a tablazatot, mert az RTX2070 kicsit zavaro az elejen, de ott a felbontas kisebb, azert van elol.

-

Devid_81

félisten

-

GeryFlash

veterán

válasz

GodGamer5

#40524

üzenetére

GodGamer5

#40524

üzenetére

Nevetséges. Tényleg ez még kiindulási alapnak is állati kevés, be is lengették már pár helyen Raja távozását, nem tudni ennek mennyi alapja van. Külföldi fórumokon megy az a poén hogy gyakorlatilag az Intel a legerősebb IGP-jét ráragasztotta egy nyákra. Annyira nem is túlzó ez az állítás.

-

GodGamer5

addikt

Intel Xe DG1 prototípus. Kb az 1050 ti ellenfele.

[link] -

GeryFlash

veterán

Az RX5700XT teljesítménye 32biten pedig 9,7 TFLOPS. --> Tiszta szerencse hogy én 5700M-ről beszéltem.

,, Tud az RX5700XT 4K@60FPS-t natív felbontásban a mai játékokban? Hátőőő..." Cifu te most szórakozol velem. Előbb az iróniát nem veszed, utána jössz egy ilyen, majd bedobod azt hogy mire elég PC-n egy adott TFLOPS-ú hardver, és levonod a konzekvenciát hogy ha ott nem tudja akkor konzolon sem. Ezt így hogy? A PS4 Radeon 7770-7850 közötti GPU-ja mire elég? Custom API mint olyan? Adott hardverre való fejlesztés? Mint mondtam konzolt konzollal hasonlítsunk össze, nézd meg mit tud a XB1X és arányosíts az új konzolokkal. Nyilván nem pöccre pontosan lesz reprezentatív, de kiindulási alapnak jó.

,,Akkor miért nem azt mondod, hogy egy 65W-os 8C/16T CPU mag mellé (ami a Ryzen 7 3700) vagy 35-54W-os 8C/16T CPU-t (ami a Ryzen 7 4800H), raknak be egy RX5700M-et?

"

"Ez jogos, nem tartottam fontosnak most azon rugózni hogy melyik TDP keretes mobil ryzen 4xxx-t veszem alapul, azt hittem az egész 4xxx mobil generációt Renoirnak hívják. Ezt benéztem, valóban jobb lett volna úgy fogalmaznom hogy 4. generációs mobil Ryzen.

-

válasz

Kolbi_30

#40519

üzenetére

Kolbi_30

#40519

üzenetére

Pontosan ezt mondom, hogy az adott játék grafikai jellemzőitől és beállításaitól függ, hogy mire képes egy hardver. Ha valaki benyőgi a 4K@60FPS-t, akkor azt is specifikálni kellene, hogy milyen játékban, milyen beállításokkal.

Az egész onnan kezdődött, hogy GeryFlash szerint az RTX 2080 Ti nem tudja 4K@60FPS-el a Ray-Tracinget, míg az új konzolok igen.

-

-

Pont ez az, hogy még TFLOPS-ban sem lesznek annyira elszállva a desktop gépekhez képest. A PS5 kb. az RX5700 / RTX 2070 Super körül lesz, az Xbox pedig az RTX 2080 Ti alatt. A mihez tartás végett ugye a Control még RTX 2080 Ti mellett, DLSS-el sem tudta 4K@60FPS-el biztosítani az RT High beállításokat, max. mediumon. A Control pedig egy 2019-es játék.

Hangsúlyoznám, hogy különféle trükkökkel el lehet érni a 4K@60FPS-t, mint a RIS és a felskálázás, Checkerbox rendering és a többi. De innentől ez nem natív 4K@60FPS, szóval ilyen téren vessük össze a PC hardver képességekkel.

-

X2N

őstag

válasz

GeryFlash

#40514

üzenetére

GeryFlash

#40514

üzenetére

Hát attól hogy 2x annyi TFLOPS még nem lesz 2x annyi fps, kb itt bukik meg az egész elméleted. Ezen kívül a memória konfiguráció is beleszól ebbe, lehet hogy lassabb memóriával még a beharangozott teljesítményt se fogja tudni, persze ezen gyorsíthatnak csak akkor tranzisztort kell pazarolni erre. HBM memóriával meg lehet elszálna még jobban a fogyasztás amit nem akarnak annyira. Jó lesz az új konzol, de ne várjunk már világmegváltást.

RT-re gyenge lesz. Nem csak a hardver miatt. Szoftveresen is fel kéne nőni ehhez.

RT-re gyenge lesz. Nem csak a hardver miatt. Szoftveresen is fel kéne nőni ehhez. -

válasz

GeryFlash

#40514

üzenetére

GeryFlash

#40514

üzenetére

Tudjuk mennyi TFLOPS-ot fog tudni a PS5 és az Xbox is,

Jah, 9,2 TFLOPS a PS5, 12 TFLOPS a Box (e szerint legalábbis).

Az RX5700XT teljesítménye 32biten pedig 9,7 TFLOPS. Szóval erősebb, mint a PS5 kiszivárgott teljesítménye. Tud az RX5700XT 4K@60FPS-t natív felbontásban a mai játékokban? Hátőőő...

Rohadt nagy különbség hogy az egyik dolgot 2 cég hivatalosan elismerte, a másikat meg most hasraütésre kitaláltad.

Nem, nem ismerte el, hiszen akkor prezentálták volna, hogy na, ez a hardver mondjuk a PC-s RDR2-őt maxon viszi natív felbontásban 4K@60FPS-en...

A 4K@60FPS natív felbontásban egy adott grafikai szinten természetesen megoldható - de megoldható akár egy RX580-on is. Csak nem lesz olyan hú, de szép.

Én arról beszélek, hogy a Renoir mellé beraknak egy NAVI alapú 5700-at, és lám ott van kb a PS5,

Akkor miért nem azt mondod, hogy egy 65W-os 8C/16T CPU mag mellé (ami a Ryzen 7 3700) vagy 35-54W-os 8C/16T CPU-t (ami a Ryzen 7 4800H), raknak be egy RX5700M-et?

A Renoir nem ez, az egy APU lesz, integrált Vegával, ezért nem értem, miért hoztad fel...

Egy gamer laptopba szerinted elég lesz az a nyúzott VEGA20

Egy gamer laptopba, ha full AMD-t akarsz, akkor Ryzen 7 4800H-t vagy 4600H-t raksz be és egy RX5700M-et vagy RX5500M-et. Nem Renoirt. A Renoir legfeljebb a belépő szintű gamernek csúfolt laptopokba kerülhet az iGP-jével.

-

GeryFlash

veterán

Uramisten

Najó, kezdjünk neki.

,,8 magos Zen2 Renoir? Az egy APU lesz, VEGA és nem NAVI integrált VGA modullal, maximum 65W-os fogyasztással, ez ugye CPU és IGP együtt."

Fuhh ne mondd

Én arról beszélek, hogy a Renoir mellé beraknak egy NAVI alapú 5700-at, és lám ott van kb a PS5.

Én arról beszélek, hogy a Renoir mellé beraknak egy NAVI alapú 5700-at, és lám ott van kb a PS5.,,250W-ról beszélünk és nem 450-500W-ról" --> Az megvan hogy az egész komment IRÓNIA volt? Nagyon reggel lehet. Remélem a felskálázott 720p-t és az SSHD-t nem vetted komolyan.

,,Plusz nem értem hogy sikerült a Renoir-t idekeverni, hiszen az egy APU, a mellé nem kell(ene) dVGA."

Mi az hogy nem kell?

Egy gamer laptopba szerinted elég lesz az a nyúzott VEGA20? Hoztam fel nektek egy példát egy hardverre, mai kb megegyezik a PS5 hardverével. EZ fogyaszt kb 250-300wattot. Erre jöttök itt ezzel hogy fuhh mennyit fogyasztana egy 4k 60 FPS-t tudó konzol... Ha lenne ZEN2-es mobil processzor ami nem APU akkor azt hoztam volna fel példának, a lényeg hogy hoztam egy hasonlatot 8 TFLOPS+Zen2 kombóra 300 wattig bezárólag.

Egy gamer laptopba szerinted elég lesz az a nyúzott VEGA20? Hoztam fel nektek egy példát egy hardverre, mai kb megegyezik a PS5 hardverével. EZ fogyaszt kb 250-300wattot. Erre jöttök itt ezzel hogy fuhh mennyit fogyasztana egy 4k 60 FPS-t tudó konzol... Ha lenne ZEN2-es mobil processzor ami nem APU akkor azt hoztam volna fel példának, a lényeg hogy hoztam egy hasonlatot 8 TFLOPS+Zen2 kombóra 300 wattig bezárólag. -

GeryFlash

veterán

,,Pontosan ugyan annyi az alapja fentinek, mint a te állításodnak..."

Ezt te sem gondolod komolyan. Egy tonna leak egybehangzó leak jött, aminek a 90%-át azóta a cégek hivatalosan elismerték. Tudjuk mennyi TFLOPS-ot fog tudni a PS5 és az Xbox is, tudjuk hogy ezt a NAVI esetében a GCN-nel szemben kb 1,4-gyel kell szorozni, azt is tudjuk hogy Zen2 magos processzor lesz, azt is tudjuk hogy (a PS5 esetében biztosan) az SSD-t egyfajta virtuális memóriának fogja használni, innentől iszonyat nagy matek összevetni a 4k/30 FPS-t és 1440p/60 FPST tudó Xbox One X-szel összevetni, és az arányokból tisztán látszik hogy nem a levegőbe beszélnek 4k/60 FPS-t illetően, és még marad is bőven valamiféle custom raytracingre.Rohadt nagy különbség hogy az egyik dolgot 2 cég hivatalosan elismerte, a másikat meg most hasraütésre kitaláltad.

-

válasz

GeryFlash

#40512

üzenetére

GeryFlash

#40512

üzenetére

Látod itt kezdődnek a gondok.

8 magos Zen2 Renoir? Az egy APU lesz, VEGA és nem NAVI integrált VGA modullal, maximum 65W-os fogyasztással, ez ugye CPU és iGP együtt.

RX 5700M? Az egy mobil dVGA 120W-os TDP-vel.A kettő együtt nincs 200W, ha még a hozadékot (SSD vagy SSHD, USB-s cuccok, akármi) is számoljuk, akkor is max. 250W-ról beszélünk és nem 450-500W-ról. Plusz nem értem hogy sikerült a Renoir-t idekeverni, hiszen az egy APU, a mellé nem kell(ene) dVGA.

-

válasz

GeryFlash

#40508

üzenetére

GeryFlash

#40508

üzenetére

Miután egy még több, mint fél év múlva érkező HW-ről beszélünk, amelynek a pontos specifikációi sem ismertek, az ilyen kijelentésekkel csak csínján.

Ezzel az erővel azt is lehet mondani, hogy az RTX 3060 hozza majd az RTX 2080 Ti teljesítményét 250$-ért 75W-ból, az RTX 3080 pedig a Titan RTX teljesítményének tízszeresét hozza 500$-ból és 250W-ból.

Pontosan ugyan annyi az alapja fentinek, mint a te állításodnak...

-

X2N

őstag

Nincs? Akkor ezmiez?

-

-

Televan74

nagyúr

Ezt erősen eltoltátok, konzoloknál már nem a 4k/60fps a cél,hanem a 8k/60fps! Természetesen valódi sugárkövetéssel!

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

X2N

őstag

válasz

GeryFlash

#40500

üzenetére

GeryFlash

#40500

üzenetére

Már megint a hülyeség megy? Az új konzolok ki sem jöttek még. Nem fog az tudni 4k-ba semmilyen raytracinget

főleg nem 60 fps-el. Kicsit unom már ezt, hogy egy számításteknikai fórumon kell magyarázni hogy mennyire teljesítményigényes a sugárkövetés, és a fórumtagok többsége(tisztelet a kivételnek) azt hiszi hogy a konzol 150-170W teljesítményből 4K Raytracing-et tol majd 60fps-el. Szerinted he ez lehetséges lenne akkor a nagy cégek minek veszik a renderfarmokat, miért kerül 20 millió forintba egy nvidia grid szerver, ha mindezt a teljesítményt megkapod 150ezerért pár hónap múlva?

főleg nem 60 fps-el. Kicsit unom már ezt, hogy egy számításteknikai fórumon kell magyarázni hogy mennyire teljesítményigényes a sugárkövetés, és a fórumtagok többsége(tisztelet a kivételnek) azt hiszi hogy a konzol 150-170W teljesítményből 4K Raytracing-et tol majd 60fps-el. Szerinted he ez lehetséges lenne akkor a nagy cégek minek veszik a renderfarmokat, miért kerül 20 millió forintba egy nvidia grid szerver, ha mindezt a teljesítményt megkapod 150ezerért pár hónap múlva? ![;]](//cdn.rios.hu/dl/s/v1.gif) Biztos majd az új konzol fog olyan minőségű RT-t tolni hogy kukázni kell a célhardvereket, mint az RTX-eket.

Biztos majd az új konzol fog olyan minőségű RT-t tolni hogy kukázni kell a célhardvereket, mint az RTX-eket.  Meg se fogja közelíteni azt a minőségű RT-t a konzol ami már most elérhető pc-n Control, Metro Exodus Quake RTX játékokban. De elmondom még1x utoljára a Rajtracing baromi számításigényes, és nem kell semmilyen módon "optimalizálni" ahogy a Crytek, Wargaming meg egy pár cég megpróbálja, mert annak a minőség látja kárát.

Meg se fogja közelíteni azt a minőségű RT-t a konzol ami már most elérhető pc-n Control, Metro Exodus Quake RTX játékokban. De elmondom még1x utoljára a Rajtracing baromi számításigényes, és nem kell semmilyen módon "optimalizálni" ahogy a Crytek, Wargaming meg egy pár cég megpróbálja, mert annak a minőség látja kárát.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- gban: Ingyen kellene, de tegnapra

- PlayStation 5

- hmzs: Fujitsu Futro S920 csúcsra járatva

- Formula-1

- Mégsem lettek annyira pénztárcabarátok az új Intel CPU-k

- Napelem

- exHWSW - Értünk mindenhez IS

- Kávé kezdőknek - amatőr koffeinisták anonim klubja

- BestBuy topik

- Alkoholista nevelde

- További aktív témák...

- Gigabyte GT 1030 2GB

- ASUS ROG STRIX GeForce RTX 4090 WHITE OC EDITION 24GB - Alza garancia 2027.03.19 - BESZÁMÍTOK!

- ASUS ROG Strix RTX 3080 10G OC Gaming White (fehér)

- ASUS TUF Gaming GeForce RTX 5080 OC Edition 16GB - Garancia 2029.03 - Felbontott - BESZÁMÍTOK!

- A LEGENDA! ASUS ROG STRIX GTX 1080 Ti 11GB GDDR5X 352bit - Brutális erő, makulátlan hűtés!

- LG 75QNED86T3A / QNED / 75" - 164 cm / 4K UHD / 120Hz / HDR Dolby Vision / FreeSync Premium / VRR

- Apple iPhone 12 Pro Max 128GB, Kártyafüggetlen, 1 Év Garanciával

- Beszámítás! Asus TUF VG249Q 24 144Hz FHD IPS 1ms monitor garanciával hibátlan működéssel

- 27% - HEIGAOLA MiniPC - / 10.1" Érintőképernyő! Intel J4125 / 8GB RAM /128GB SSD

- Csak kipróbált Mini-Erőmű! Mini-PC Ryzen 7 7840HS 16GB 512GB 1 év garancia

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

RT-re gyenge lesz. Nem csak a hardver miatt. Szoftveresen is fel kéne nőni ehhez.

RT-re gyenge lesz. Nem csak a hardver miatt. Szoftveresen is fel kéne nőni ehhez.