Hirdetés

Új hozzászólás Aktív témák

-

S_x96x_S

addikt

> Azzal mi lesz ha a mezei user fogja és belecsapja a legolcsóbb SSD-t amit talál a piacon?

Nem az ár a döntő,

Ha megfelel a Sony elvárásainak, akkor semmi gond.

"5,500MB/s or faster is recommended" + Nem árt egy heatsinkde amúgy játékosként

ugyanaz mint minden játék rendszerkövetelményénél

Ha bármilyen problémád van és nem üti meg az ajánlott specifikációt a hardvered,

akkor simán leppantintanak a supportnál.

Vagyis arra nem vállalnak garanciát. -

szarnyasdino

tag

Velem nem vetetnek meg semmit. Nekem amd kártyám van. Ezek a felskálázó dolgok nem érdekelnek. Ha egy game 30 fps akkor annyi. Nem kapcsolom be a fsr-t. Sőt engem pl a ray tracing sem érdekel mivel kb semmit nem ad a játékokhoz azonkivül hogy rettentően leszedné az fps-t.

Szóval én tök jól elvagyok a "buta" "lassú" beállításaimmal

-

S_x96x_S

addikt

> Az az igazság hogy vannak akiknek érdeke

nézd úgy, hogy erre van igény - hasonlóan mint a cukros kólára;

és egyesek kiszolgálják ezt az igényt.mert az agyunk maga is egy biological DLSS

kipótolja azt is, ami nincs teljesen ott.![;]](//cdn.rios.hu/dl/s/v1.gif)

és ha a képi világot a gpu DLSS/FSR még jobban "előemészti"

akkor azt sokan kellemesebbnek érezhetik.

-

.LnB

titán

Engem ez a ray tracing sem hatott meg sose. Volt 1-2 alkalom amikor felfigyeltem rá, és azt mondtam a monitor előtt ülve, hogy wow. De én szentül hiszem, hogy grafikától még egy játék sem lett jobb. A RT-gel az volt a legnagyobb baj, amennyire tolta mindenki. Úgy, hogy tudták, hogy ki sincs forrva még rendesen az a technológia. Arról nem is beszélve, hogy hardver sincs mögé.

Ez a DLSS5 is olyan, hogy el se tudom dönteni, hogy ez tetszik e nekem. De még magáról az irányról is úgy gondolkodom, hogy van ennek jó oldala, de elég sötét is. Mert ez elviheti a grafikákat egy marha rossz irányba is, de jó kezekben viszont üthet. Ne adj isten egy autós játékban ezek a bevilágítások elég jók lehetnek. GT7-ben is elég realisztikus.

Én egyszerű vagyok. Nekem a DLAA elég mindenre.

-

.LnB

titán

Nem ment át az irónia mi?

Nem semmi ez a Youtube csatorna. Ha nem lenne a PH!-nak is egy ilyen saját bejáratú arca, hírezője, én simán felvenném ezt a csávót. Hozza a szintet.Köszi a videót. Én várok egy olyanra, ami valamelyest objektív. És esetleg várok addig, amíg ez a feature valóban meg nem jelenik. Valahogy nem érdekel a sok barom előre károgása félinformációk, és szimplán gyűlölet alapján. Értem én, hogy ezzel lehet nézettséget hozni, átütni az ingerküszöböt, de én megmaradok a magam maradi módján, és türelemmel kivárom a valós információkat, elemzéseket.

-

Busterftw

nagyúr

Te írtad, hogy ennek nincs köze az "eredetihez" meg hogy "nem ez volt a cél".

Az első Tomb Raidernél nyilván nem háromszögű mellek és balta arc volt a cél, hanem limitálta az alkotókat a technológia meg a hardver.

Így jön ide, ez ugyanúgy igaz most is.Sok játék azért néz ki úgy ahogy, mert ezt tudták akkor kihozni, nem azért mert ilyennek szánták.

-

Egy félkész demó eljárásról van szó. A Starfieldben és Residentben sokkal jobban néznek ki a karakterek arckidolgozásai.Residentben egyáltalán nem rajzolja át durván a karaktereket,sem Starfieldben,hanem kidolgozotabbá teszi.

Saját véleményem van és nem arra szánnám a komentjeim, hogy téged meggyőzzelek az ellenkezőjéről, mert izlésről felesleges és demó videók alapján 2 percből levonni szélsőséges következtetést is felesleges.

Jellemzően mind a Starfieldben és a Residentben is messze jobban néznek ki a karakterek arckidolgozásai,de te maradj a Hogwartsnál és vedd azt alapúl, mert az jobban esik neked és a lelkednek valamint győzz meg okvetlenül mindenkit az ellenkezőjéről pixelméregetéssel paintban.

A fejlesztők majd eldöntik,akik szintén a játékkot alkotják,hogy a DLSS 5 majd mennyire nyúljon hozzá a karakterekhez a mostani helyzet szerint.Az is ugyan úgy az ő alkotásukat fogja tükrözni, mivel a jelek szerint lesz rá lehetőségük hogy szabályozzák mihez és hogyan nyúl hozzá a DLSS 5. -

X2N

őstag

2025-ös videóban is vannak problémák.

Elég csak megnézni a villát, nem tudja az AI normálisan lekövetni a mozgását, se azt hogy ne lógjon bele a kezébe. Narancslé alig fogy amikor beleiszik.

Túl komplex mikro mozgások vannak amiket az ai nem tud lekövetni se. Hogy is tudná, fogalma sincs ilyen dolgokról...

Elég csak megnézni az AI gitározós videókat és figyelni a gitáros kezét. Nem beszélve arról hogy sokszor még a gitárt se tudja reprodukálni úgy ahogy kellene, több kapcsolót rak rá stb.

Ai slop a javából. Állítólag magyar az illető aki csinálta. -

S_x96x_S

addikt

>> "8GB VRAM-al rendelkezők izgulhatnak"

>Már nem izgulnak szerintem. Mivel kiderült hogy 5090 lesz a beugró. (Most is 2db-al demózták)

De az 4K -volt;

Csak megoldják - hogy 2K -n ( vagy kisebb felbontáson )

16GB VRAM -on is tudják demózni.A 12GB -on meg csak a ( kiherélt ) "DLSS 5 Light" - fog működni.

Én úgy okoskodok, hogyha a 12GB / 16GB -on nem tudják megoldani a futtatást, akkor a gaming studiók miért foglalkozzanak vele?

-

Spizzi

aktív tag

Így pedig már végképp még zavarosabb, hogy mi értelme az egésznek. Magyarán van egy játék, annak a játéknak a kinézetébe, koncepciójába stb. emberek tucatjai éveket öltek..... majd jön az Nvidia és azt mondja, hogy ez úgy nem jó?

Szeretem amúgy a filtereket, sok játéknál használom a ReShade nevű alkalmazásnak néhány olyan beállítását ami egy kis plusz színmélységet ad a játék világának, de azt is csak azért mert IPS monitorom van és ezzel ellensúlyozom hogy amúgy OLED-re vágyom.

de ezt a DLSS 5-öt akkor sem értem, amit én látok ki az egészből, hogy egy élettelen, egykaptafa, generic valamit csinál minden játékból. Ha most itt lenne egy kép fps nézetből, hogy sétál valaki egy erdőben a Starfield-ben és a Resi9-ben de nincs a képen semmi árulkodó object (pl űrhajó vagy zombi) valszeg meg nem mondanám, hogy melyik játékot látom. Ez inkább szörnyű mintsem, hogy éjjenezzek neki.

de ezt a DLSS 5-öt akkor sem értem, amit én látok ki az egészből, hogy egy élettelen, egykaptafa, generic valamit csinál minden játékból. Ha most itt lenne egy kép fps nézetből, hogy sétál valaki egy erdőben a Starfield-ben és a Resi9-ben de nincs a képen semmi árulkodó object (pl űrhajó vagy zombi) valszeg meg nem mondanám, hogy melyik játékot látom. Ez inkább szörnyű mintsem, hogy éjjenezzek neki. -

bozont

veterán

Aztán ha jól megnézed az eredeti képen annyira elmosott a ajak határvonala, hogy simán benne van az a pár pixel hibalehetőség, hogy rossz helyre tetted a "kockát". De mindegy. Nem feltétlenül örülök ennek az iránynak, szerintem nem kell minden játéknak filmszerűen kinéznie, de azért amit a karakterekkel csinál eléggé tetszetős.

A környezet az más tészta, legalább is ezen a Resi képen jobban tetszik az eredeti atmoszférája. -

Busterftw

nagyúr

Ez marhaság. Az első tomb raider sem így nézne ki az alkotó szerint, ha a technológia nem limitálta volna.

"mert itt még jobb megvilágítást kaptak a karakterek mégis mindenki idősebbnek látszik, ez valami paranormális jelenség"

Pedig már a Family Guy epizódban is ez volt, amikor HD tévére váltottak. -

_drk

addikt

De azért lesz érdekes ha már előre ezzel készítik a játékot, akkor csak a sarok pontokat határozzák meg, egyfajta külön AI programozás lesz.

A Motion capture is biztos sokkal egyszerűbb lesz, mint jelenleg. Valószínűleg nem lesz annyira jó, de AA projekteket segíthet.

Az köztudott hogy a jelenlegi fejlesztési modell fenntarthatatlan. -

_drk

addikt

De ezt írom, hogy nem a meglévő a lényeg. Jelenleg azzal promózzák ami van, nem azzal, hogy 5 év múlva az így készült játékban mennyivel jobb lesz a fejlesztőnek.

Egyébként nem egy ilyen remastert elbasztak, hogy a kicsit jobban kinéző valami már sokkal csúnyább volt mint az eredeti, ami az update-tel el is vesztette a varázsát.

-

Yutani

nagyúr

A szememet hagyd rám, majd én tudom, mit látok!

A csaj száját kinagyítottam, referencia vonalakat húztam, és lám, a felső szájszéle annyival van fentebb, amennyivel ki van nyitva a szája.

A csaj száját kinagyítottam, referencia vonalakat húztam, és lám, a felső szájszéle annyival van fentebb, amennyivel ki van nyitva a szája.  Egyébként meg tudod nagyon jól, hogy rossz megvilágításban mindenki fiatalabbnak tűnik, amint jön az éles fény, kihozza a vonásokat, és ez miért ne lenne így egy módisított bevilágítás esetén? Egyébként meg Leont jobban nézd meg az előtte képen, mert ugyanúgy van szakálla, csak nem látszik úgy az eredeti megvilágítással.

Egyébként meg tudod nagyon jól, hogy rossz megvilágításban mindenki fiatalabbnak tűnik, amint jön az éles fény, kihozza a vonásokat, és ez miért ne lenne így egy módisított bevilágítás esetén? Egyébként meg Leont jobban nézd meg az előtte képen, mert ugyanúgy van szakálla, csak nem látszik úgy az eredeti megvilágítással.A feature nem lesz kötelező, mindenki (akinek lesz hozzá kártyája) be-, illetve kikapcsolhatja egyéni ízlés szerint. Valamint a fejlesztők is eldönthetik, milyen szinten hagyják érvényesülni a DLSS 5-öt, így játékra szabva alkalmazhatják.

-

Yutani

nagyúr

Megvilágítás és anyag szerkezet változik (pl. bőr rétegeinek áttetszősége, haj szerkezete), de nem generál új modelleket és textúrát a dokumentumok szerint. A csaj szája sem lett feltöltve, mindössze más bevilágítást kapott, valamint a DLSS 5 képen kicsit nyitva is van. Ennyire nehéz objektívnek lenni?

-

S_x96x_S

addikt

Azért szerintem Notebook-ban - nem rossz a Strix Halo;

( legalábbis én ott több értelmét látom )És hamarosan jön az AMD dev-kit -je

"AMD Ryzen™ AI Halo for AI Developers"

( DGX Spark rivális )Persze Notebook-ban meg az Nvdia nyomul az N1X-el,

és ha 64GB/128GB -os verzió is lesz belőle, akkor nagyon jó AI fejlesztőgép lesz.

Lenovo Legion 7 + NVIDIA N1X ( ARM-es gaming ) -

S_x96x_S

addikt

> kipróbálnák egy Ryzen Ai MAX+-t,

> kár hogy nincs kis méretű alaplapos verzió belőle

Idén egyre több lesz;

CES2026: "Minisforum Brings Strix Halo To Desktop PCs With Ryzen AI MAX+ “BD395i” MAX Mini-ITX MoDT Motherboard"+ még:

"Framework Desktop Mainboard (AMD Ryzen™ AI Max 300 Series)"

Ryzen™ AI Max+ 395 - 128GB Ft 999,990

Ryzen™ AI Max+ 395 - 64GB : Ft 639,990

Ryzen™ AI Max 385 - 32GB : Ft 394,990Attól függ, hogy mire kell,

de ha LLM, akkor az 64GB/128GB érheti meg,

( de pont azok meg a memória miatt nem olcsók. ) -

bozont

veterán

Szerinted a gamerek hány százaléka fog hozzányúlni az időzítésekhez? Szerintem elég kicsi az a szám. Az hogy miért pont 6000-es rammal tesztelnek? Valószínűleg azért mert ez a legoptimálisabb hozzá ami még biztos működik egy kattintásra (expo) és alig drágább mint az 5600-as kit (volt, a mai árakat most hadjuk figyelmen kívül

). Nekem is azért van 6000MHz c30-as kit.

). Nekem is azért van 6000MHz c30-as kit. -

bozont

veterán

Ne is piszkálja meg az időzítéseket, hiszen a legtöbb felhasználó sem nyúl hozzá, sokkal relevánsabb így a teszt. Én is csak belőttem az expo-t mert már nincs kedvem szórakozni a ram tuninggal.

Elég ha bekerül a tuning szekcióba (vagy akár egy külön cikk születik róla), hogy mégis milyen hatása van a sebességre. -

PuMbA

titán

Defender persze. Gyors és hatásos. 2015 vége óta, azaz Windows 10 megjelenése óta csak ezt használom. Ha volt párszor malware, akkor azt kiszúrta és szólt, szóval szeretem

"hagyják is ezt ahogy a mindenféle anti cheat futtatását is a gépükön."

Persze, hogy hagyják. Csalókkal játszva teljesen elveszne a játékélmény

Anti cheat nélkül játszhatatlan káoszok lennének a multis játékok és senki se venné meg őket, tehát kihalnának.

Anti cheat nélkül játszhatatlan káoszok lennének a multis játékok és senki se venné meg őket, tehát kihalnának."O&O meg addig jó amíg a ms nem módosít valamit minden egyes update-nél. "

Eddig is frissítették folyamatosan az O&O-sok a szoftvert, most 22-én januárban jött ki a legújabb verzió, ezután is fogják frissíteni.

-

PuMbA

titán

TPM nem baj, az kötelező is pár játékhoz már, hogy egyáltalán elinduljon a csalás elleni védelem miatt.

Ma még biztosan kikerülhető, Win 11 Pro-m van

Microsoft fiókkal raktam fel, hiszen telepítéskor csak ezzel lehet, aztán csináltam egy helyi fiókot a Fiókkezelőben, a Microsoft-osat meg letöröltem. Frissítéseket így is kapok.

Microsoft fiókkal raktam fel, hiszen telepítéskor csak ezzel lehet, aztán csináltam egy helyi fiókot a Fiókkezelőben, a Microsoft-osat meg letöröltem. Frissítéseket így is kapok.De ha rákényszerítenének a Microsoft fiókra, még akkor se esnék pánikba, mert az O&O ShutUp10++ programmal egy kattintás és kiveszi a Copilotot meg minden ilyen cuccot.

-

PuMbA

titán

"Ai miatt amúgy se annyire lelkes a userek többsége a win11-re lépésre."

Ja, bár ez megkerülhető, viszont tényleg kis erőfeszítést igényel a Windows 10-hez képest, amit megjegyzendő amúgy anno is szapultak, hogy mennyi a telemetria meg spyware van benne

Azóta hirtelen szuperjó lett a Windows 10

Azóta hirtelen szuperjó lett a Windows 10 ![;]](//cdn.rios.hu/dl/s/v1.gif) Én AI-t nem látok és kapok a Win 11 alatt, mert nem lépek be a Microsoft fiókommal. Helyi fiókom van.

Én AI-t nem látok és kapok a Win 11 alatt, mert nem lépek be a Microsoft fiókommal. Helyi fiókom van.Na de ennyi off fér csak bele szerintem

-

PuMbA

titán

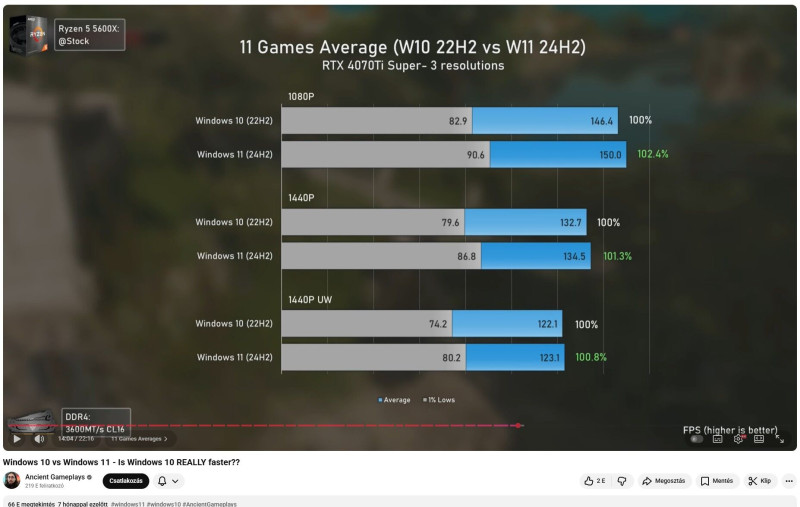

"23H-hez képest a 24H2-es update-hozott ~+10% fpst-t"

Csak AMD-n, mert hibás volt az AMD CPU kezelése a Windowsban pár hónapig

Intel CPU-knál nem volt gond sose.

Intel CPU-knál nem volt gond sose."illetve nem azzal kezdeni a tesztet hogy rögtön letörölni a Defendert"

Nem letörölte, csak deaktiválta. Ez azért fontos, mert az 0.1% minimum fps-t tudja befolyásolni, ha épp akkor kezd el szkennelni memóriában lévő folyamatokhoz tartozó egy-két újonnan betöltött fájlt a vírusírtó. Így garantálható a teszt pontossága.

-

PuMbA

titán

Windows 11 Best For Gaming? Windows 11 25H2 vs. Windows 10

Vadi új friss és ropogós teszt 9800X3D-vel és RTX5090-nel, amit hiányoltál az eddigi általunk beszúrt tesztekből, hogy nem csúcshardverrel lett mérve. Kívánságod meghallgatott, de a Windows 11 így is gyorsabb!

-

laychi

veterán

Ha rajtam múlik csak gyors tesztek lesznek.

Pár összehasonlítást csinálok beépített benchmarkokkal.

Esetleg minimális gameplay.Meg hát fontos, hogy ne legyen extrém CW se.

Régen tudom lehetett alulfeszelni az amd-t is.

Egy asus 6800-on csináltam meg, valami 850mV környékén hozta a gyári értékeket, illetve kicsit felette. Illetve a cw is szinte teljesen megszűnt.

Ha így lehet fogyasztást csökkenteni, akkor még jó lehet. -

Busterftw

nagyúr

A vita szempontjabol fontos megemliteni, mert eddig itt a narrativa az volt, hogy a Radeon usert aztan az RT nem erdekli, meg a felskalazas sem, akinek az nem kell vegyem AMD-t esatobbi...

Latod, most mar az RT a jovo, az Nvidianal meg mar regen ez a jelen, akkor az nem szamitott.

Most hirtelen fontos lett meg szamit.

#50792 X2N

Mondjuk itt teljesen mindegy, hogy "megveri" a 14 es a 23fps ugyanugy jatszhatatlan, kar volt ezt a tesztet linkelni. -

T.Peter

őstag

A sajat szubjektiv velemenyed nem lesz objektiv teny. Lehet, hogy te nem igy latod, ez teljesen elfogadhato, de attol meg szakmai szempontbol tevedes.

Az offline rt render mindig jobb lesz, mint a real time, szoval hiaba butitott, ez van. Pc-n huzhatod feljebb legalabb a beallitasokat a konzolhoz kepest.

Attol, hogy az ue5 megjobb lett nem jatekfejlesztesre is, nem csokkenti jatekfejlesztesre az alkalmassagat.

A grafika es az optimalizalas ket kulon dolog. Objektiven nezve mindenben fejlodott az ue5 render pipeline a regi pipeline-hoz kepest, szoval nem lehet azonos szinten. Az optimalizalassal kapcsolatos hibak management szinten levo problemakat mutat meg.

A techdemokat mar megugrottuk, izles kerdese, hogy ki szerint nem. Nem mindenkinek az a cel, hogy tech demo szintre huzza a jatekat. A tobbinel meg nem lehet kivetiteni azt, hogy egy reszlet valakinek nem tetszik, ezert mar az egesz nincs magasabb szinten.

Ertem, irtad mar, ettol meg ez semmit nem vesz el a felskalazok erdemeibol. -

T.Peter

őstag

A konzolok is tudnak 60 fps mellett rt-t futtatni, 1080p koruli felbontassal, szoval teljesen elerheto mindenki szamara.

Nem az rt tehet arrol, hogy nincs igazan olyan jatek, ami a dinamikus bevilagitast kihasznalna.

A hellblade 2 nem raszter, egyik ue5-os cim sem az, ami lumen-t hasznal.

A nanite 5.1 ota tamogatja a wpo-t, 2022 vege ota.

A mostani upscaler-ekrol elmondhato, hogy jobb kepminoseget biztositanak, mint a regi taa/taau.

Az ue5 elsosorban a jatekfejlesztoknek szol, amivel akar evekben merheto fejlesztesi idot es milliokban merheto penzt tudnak sporolni (amellett, hogy oriasi az a grafikai ugras, amit bemutat) -

PuMbA

titán

Azon kívül, hogy elmondtad a bajaid a beszúrt tesztekről még mindig nem vagyunk előrébb, csak feleslegesen pörögnek a hozzászólások

Nincs róla mérésünk, hogy gyorsabb lenne a 10 vagy egy kiherélt rendszer a gyári 11-hez képest játékok alatt, miközben sok mérés van arról, hogy ugyanolyan gyors a 11. Továbbra is itt tartunk, a többi a templomba tartozik, mert úgy hívják, hogy hit. Eredményeket szeretnénk látni, hogy hol van olyan újabb teszt, ahol kimérték, hogy a 10 gyorsabb, mint a 11.

Nincs róla mérésünk, hogy gyorsabb lenne a 10 vagy egy kiherélt rendszer a gyári 11-hez képest játékok alatt, miközben sok mérés van arról, hogy ugyanolyan gyors a 11. Továbbra is itt tartunk, a többi a templomba tartozik, mert úgy hívják, hogy hit. Eredményeket szeretnénk látni, hogy hol van olyan újabb teszt, ahol kimérték, hogy a 10 gyorsabb, mint a 11. -

PuMbA

titán

Ok, bár most itt játékokról van szó és közben nem szoktunk renderelni a háttérben vagy hasonlókat csinálni

Én még 22GB-nál több memória használatot nem láttam a 32GB RAM-ommal, gyári Windows 11-gyel. Simán belefér 1-2 repülő szimulátoron kívül minden ebbe a mennyiségbe bloat-tal együtt és még marad is szabad hely.

Én még 22GB-nál több memória használatot nem láttam a 32GB RAM-ommal, gyári Windows 11-gyel. Simán belefér 1-2 repülő szimulátoron kívül minden ebbe a mennyiségbe bloat-tal együtt és még marad is szabad hely. -

Ribi

nagyúr

És akkor ne is beszéljünk arról hogy W11 gyorsabb mint a 10?

-

PuMbA

titán

"Még mindig limitál a 9070"

Továbbra sem értem, hogy mit limitál

Ha a Windows miatt lenne lassabb, akkor pont hogy gyengébb hardveren jobban lassulna, hiszen kevesebb benne az erő, azaz kevésbé bírja a Windows háttérfolyamatait futtatni zavartalanul, mint egy csúcs konfig.

Ha a Windows miatt lenne lassabb, akkor pont hogy gyengébb hardveren jobban lassulna, hiszen kevesebb benne az erő, azaz kevésbé bírja a Windows háttérfolyamatait futtatni zavartalanul, mint egy csúcs konfig."1.6GB memória, az még mindig sok."

Ezt sem értem, hogy mi különség van 1,6GB memória és 1GB memória használat között, ha van bőven memória, mondjuk 32GB. Ugyanolyan kényelmesen és zavartalanul elfér mindkettő.

-

PuMbA

titán

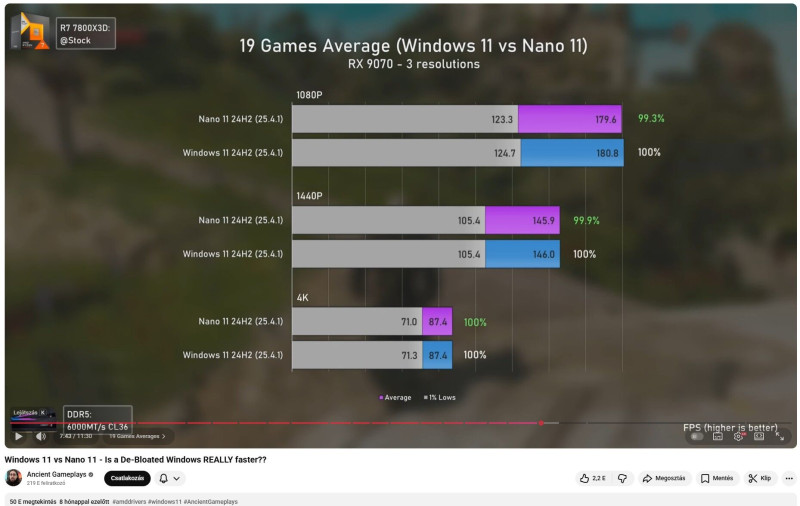

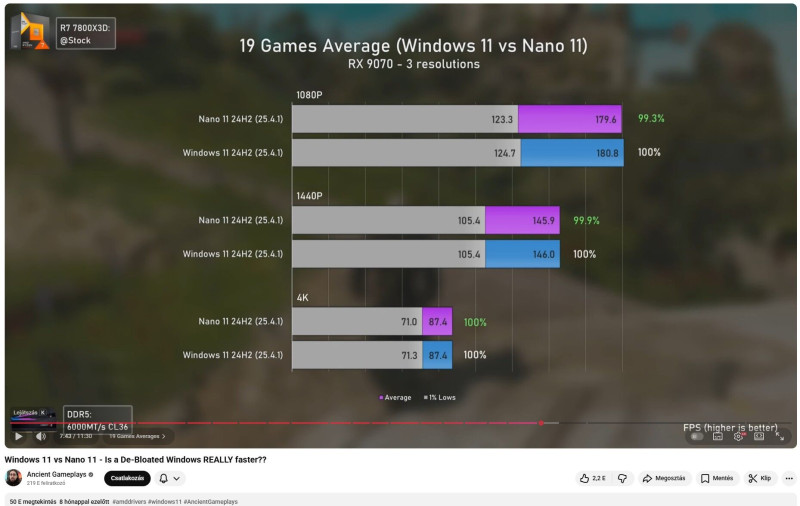

Windows 11 vs Nano 11 - Is a De-Bloated Windows REALLY faster??

Ezt is kimérték már és semmivel sem gyorsabb játékok alatt egy kiherélt Windows 11 verzió

Itt 7800X3D-t és RX9070-et használtak:

Itt 7800X3D-t és RX9070-et használtak:

-

PuMbA

titán

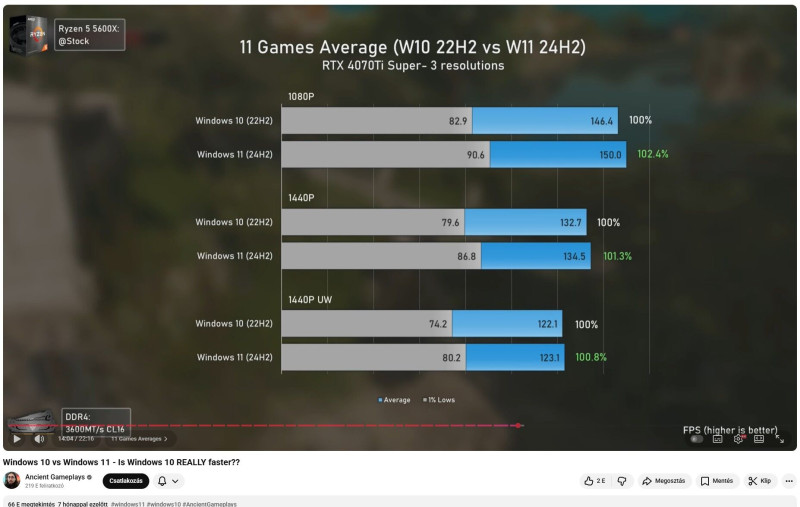

Nem láttam mostanában olyan friss tesztet, ahol lassabb a Windows 11. Ez egy 7 hónappal ezelőtti teszt és igazából picit gyorsabb a 11: Windows 10 vs Windows 11 - Is Windows 10 REALLY faster??

-

proci985

MODERÁTOR

DX12 jól skálázódik általában sok maggal. Meg CPUra játszani a 3900X (fele ekkora erővel) általában elég volt.

Fogyasztás nekem majdnem mindegy, MSI lapok amiket használtam (x370 titanium, x570s tomahawk wifi) 150Wra vannak tapasztalat alapján belőve. Meg azzal is számolj, hogy thermal headroom épített vízzel más terület.

Ram bírja a 3200at JDEC szerint, és bírja ha VMen fut a compute. Utóbbi sokkal durvábban problémás mint az ember gondolná. VBox kb érzékenyebb volt ramra mint a parancssoros memtest, mondjuk Dockert nem próbáltam ezen a gépen.

-

proci985

MODERÁTOR

Maxon tolom csak. CS2 semmilyen szinten nem érdekel. Szimulátorozni meg 7680x1440pben szoktam. Monitorok 75ör bírnak (Rift2 80at), nem látom fölötte a különbséget: Doomon és jó esetben 20fpsen nőttem fel. Volt 144es monitorom (projektor 240et tud fHDben), engem a frametime-varianca zavar nagyon, max fps kevésbé.

5950X nincs tuningolva papíron, gyakorlatilag viszont egy 360x45ös radiátor egy D5el van rajta egyedüli hőtermelőként és el van engedve TDPre. Szóval hűtésre kb három Noctua D14 van rajta ami azért látszik a headroomon. A 7900XTnek egy második D5 és 360x45 + 280x30 van, szóval kb 500W a kényelmes thermal headroom. Nem hozott 25+%ot mint anno a 290Xnél, de azért érezhetően gyorsult a blokktól.

Korábban ezzel a setuppal az akkori 1800Xem és 3900Xem kb golden sample órajeleket hozott gyárilag, mármint, hogy hagytam őket futni a default órajel kalibrációval és órajelre magasabb volt, mint amit légen tuninggal szoktak elérni.

Mondjuk ez kb 10 éve stimmel, tuningnál az első lépés a thermal headroom, ami hoz magával Vpackage headroomot a szivárgási áram miatt. Hűtésben pedig fórumszinten is jól állok: [kép]

A két m2, a VRM és a ramok meg kaptak saját ventit mozgatni direktben a levegőt.

-

proci985

MODERÁTOR

Cyberpunk brutális, nálam 1440pben 12-16GB körül eszik 1440pben.

UE5 rendben van, nálam a Stalker2 és a Borderlands4 is jól fut

. mondjuk valamennyire kiegyensúlyozott a setup. Meg épített víz mindent a thermal limit alatt tartani jóval, meg egy normális táp.

. mondjuk valamennyire kiegyensúlyozott a setup. Meg épített víz mindent a thermal limit alatt tartani jóval, meg egy normális táp.Mondjuk a sajátommal adott esetben kb hypervisorként futott az OS és hónapokig futott a számítás, szóval stabilitásra is kb oda van belőve. A 7900XT meg arra van, ha játszani akarnék (128GB ram és az 5950X oda felesleges).

-

T.Peter

őstag

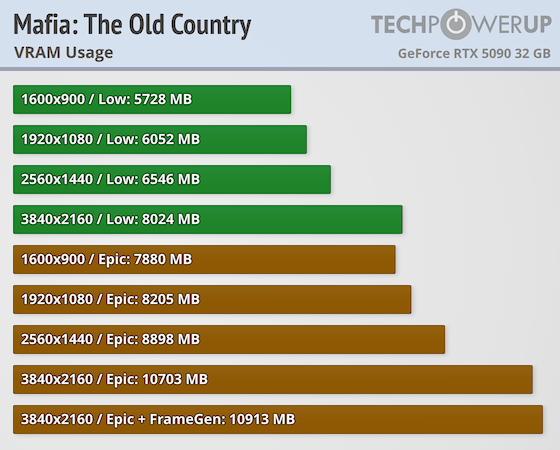

Meg mindig nem sok koze van a jatek meretenek ahhoz, hogy mennyit fog a ram-bol/vram-bol hasznalni.

Attol, hogy tps, a kamerat meg lehet ugy forgatni, hogy kozel legyen egy fal vagy akarmi mas, szoval ez nem szempont.

A legnagyobb reszet a vram-nak mindig a texturak foglaljak el, ezen pedig a Mafia eseteben is a virtual texturing segit. Csak azt a texture tile-t kell betoltenie ami eppen latszodik (+ a legkisebb mipmap-ek hogy legyen valami amihez rogton lehet nyulni ha szukseges). -

PuMbA

titán

Nem 13,5GB, hiszen az általad nagyon utált AI fake frame generation lök rajta egy csomót, amit úgy se fogsz használni

Csak 9,7GB-ot eszik a játék 4K maximumon RT-vel.

Csak 9,7GB-ot eszik a játék 4K maximumon RT-vel.Mafia: Old Country, ami szintén egy elég nagy terület is csak 10,7GB-ot eszik 4K maximumon:

Egy open world játék egész területe úgy se lesz betöltve a VRAM-ba egyben, szóval a terület nagysága ezt nem befolyásolja.

-

X2N

őstag

Egyébként ha 4k felbontást nézem akkor még mindig van 10% különbség teljesítménybe a 2 kártya között raszterbe.

Ez az állításod az UE5-el addig lesz igaz amíg nem lesz egy igazán komoly open world játék, mert messzemenő következtetéseket én nem vonnék le a jelenlegi cső játák címekből.

Itt is 13.5GB a vram használat, moddolt CP2077-szeret 20GB felett foglalni, és már készül a CP2077-Chicago UE5-re.![;]](//cdn.rios.hu/dl/s/v1.gif)

-

PuMbA

titán

"Az új kártyák(meg a 9000-es X3D proci is) meg már emelt áron jöttek ki még kevesebb teljesítménnyel"

Ez nem teljesen igaz. A 9070XT most például jóval olcsóbb, mint a 7900XTX volt a kifutása előtt és ugyanazt a teljesítményt hozza raszterban az újabb játékok esetén, RT-ben / PT-ben 15-25%-kal gyorsabb, kevesebbet fogyaszt és jóval jobb minőségű felskálázást tud.

Egyedüli dolog a kevesebb VRAM, de az UE5 miatt ezzel egyre kevésbé kell aggódni, mert 4K maximumon se nagyon esznek 12GB-nál többet az ilyen motort használó játékok. Na meg a memória válság miatt sem csinálhatnak VRAM zabáló játékokat, mert emiatt a 8GB-os VGA-k tovább lesznek velünk, mint gondoltuk.

-

S_x96x_S

addikt

a hihetetlen, hogy 1 hónap alatt "+1.75%" -el --> "3.21%" -ra nőtt.

Amúgy a CachyOS -elég trendi,

és hamarosan jön a szerveres támogatás is. -

Alogonomus

őstag

Szerintem előre készülj föl a csalódásra, ha valóban 7-10 év múlva is használható teljesítményt remélsz egy 7900 XTX-től, mert a 2030 utáni időszakban örülhetnek a birtokosai, ha az akkori 60-as szintű kártyák szintjét tudja majd.

Én is egy 7900 XTX mellett tettem le anno a voksomat, és meg is vagyok vele elégedve, de ahogy például a 2080 Ti is sokak nedves álma volt a maga idejében, most pedig az 5060-nal birkózik, úgy a 7900 XTX is csak a valamiért harmatgyenge fejlődést hozó jelenlegi generációnak köszönhetően tudta megőrizni a "racionális árú majdnem csúcskártya" pozícióját, de a valószínűleg egy év múlva érkező következő generációs kártyák mellett már menthetetlenül visszasüllyed a középkategória felsőbb régiójába, ami persze egy akkor már 4 éve a dobogóról nem leszorult kártyától még úgy is nagyon szép életút új állomása lesz. -

Jó lenne látni amúgy erre valami kimutatást, RMA-t vagy ilyesmi. Anno valami 1 % vagy iylyesmit ot mondtak erre de már nem emlékszem hol melyik cikkben ami állítólag az elfogadhatón belül van.

Szerintem pont úgy használják az itteni fórumlakók is a kártyáikat mint máshol,de aztán lehet pont én leszek az első leégős nem tudom.

-

Busterftw

nagyúr

Meg a RDNA2-k is, egy vendor szerint.

Chinese GPU manufacturer Zephyr confirms dead RDNA 2 GPU chips due to cracking, bulging, or shorting -

-

-

proci985

MODERÁTOR

Inkább kb 2005-2015. 1991 és 2004 között volt egy hatalmas technológiai ugrás, és akkori árán irdatlanul drága volt a technológia, cserébe a következő generációra el is avult. A megfizethető cuccok valahol a Geforce4 környékén indultak, majd a 8800GT 512 és a 3850 256 volt, ahol konszolidálódtak az árak. Meg a socket775.

Ja, game dev gyűjtőfogalom, game programmerek kb 10 évvel ezelőttig mindenhol kb software engineerek voltak kissé eltérő képzési fókusszal. Designereknél van szórás, audio és graphics production pedig eléggé változó, gondolok itt a zeneszerzőkre és a 2d grafikusokra (akik közül a jobbak gyakorlatilag grafikusok/festők).

Mondjuk utóbbi pár évben jött be erre a webGL, bejött a webshader alapú fizikai szimuláció ami jól fut, bejött a digital twin amit van browserre vagy Unityre targetelnek. Unityhoz ahogy láttam lehet pluginelni deepML modelleket, szóval pl a mérnökök felől elég sokan mennek arra, mint relatíve egyszerű szimulációs környezetre.

-

proci985

MODERÁTOR

Linux supporton meglepődtem, AMD ott évekig kanyarban sem volt.

nem érdekli őket már a DIY PC piac

ez évek óta így van, de lassan vissza fog ütni.Utánpótlásnál idő kérdése, és probléma lesz. Az első generációs mérnök informatikusok (computer science / software engineering) kb 10 éve nyugdíjba mentek. a legfiatalabb K&R C generáció 60 körül van - kollégák között van ilyen, eszméletlen tudása van hozzám képest is. a Doom generáció lassan 50. Viszont az utolsók akik saját pénzből fejlesztették a gépüket aktívan a mai 30asok (GTX970 / RX580 / 1070).

Lehet mondani, hogy dehát genAI, de genAI kb elsőéves programozás kurzusokat oldja meg probléma nélkül. Aztán jön az első full-stack kurzus ahol rendszerszintűen kéne programozni (pl dotnet MVC alapú egyszerű web SQL backenddel) amit viszont a genAI már képtelen hiba nélkül legenerálni. Vagy ha igen, akkor nekiáll stubolni mert nincs meg a kontextusa, hogy btw SQL felé kéne az a layer. Meg feleslegesen teleszórja a kódot lambdával ami persze szép és jó, csak ész nélkül használva az performance és maintainability szempontból is időzített bomba egy kezdő kezében.

Meg ott a felhő... ja nincs, mert felhő nincs, csak más ember számítógépe, szóval az architektúrális problémák ugyanúgy megmaradnak.

-

Nekem tényleg tök alap tunninggal, kb 10 percet szántam rá, 11 % volt a kártyában,a ramok 32 Gbps-en mennek azaz siman hozza az 5080 sávszélt, így kb 5- 10 % kal marad el az 5080 tól. A hűtés halk így is. Az 5080 karik általában nem húzhatóak így mint a 70 Ti-k.

Az 5070 Ti nek legalább 5080 sebességűnek kellett volna lennie alapból, az 5080 nak pedig 4090. Nem baj,megérdemli AMD a 9070 XT sikerét,jó kártya lett. -

Itthon is 325 K volt a Prime Alzán, csak hát nem kapható hetek óta, szerintem annyiért már nem is lesz.

Alza ebből jó bolt, hogy ha szlovákot veszed az itthon is érvényes garival van.

Kint is és itthon is konkrétan egy típust kapni az Asus 5070 Ti ből ,a Pro Art 400K +.

Úgy néz ki Nvidia tényleg elintézi az 5070 Ti és az 5060Ti 16 GB sorsát.

A maradéknál Elkezdtek felmenni az árak mindegyik gyártónál, de a 9070 XT még most is viszonylag normális áron van. -

Azzal nincs baj ha kinti mert amit én mondok az is amazon.de kártya.

A 245e-340 TUF.És nem azzal van baj hogy ki mit vesz, nűlam is Ti ketyeg most. Van réteg igény a VR és a sim ami NV jelen pillanatban. De ez minimális ember, a 30%-os felárral van a probléma és annak megmagyarázásával hogy ért borzasztó ajánlat az 5080 pl.

Azért borzatsztó mert pl. a 2070-en megverte 1070Ti-t a 3070 a 2080Ti-t, most meg az 5080 meg sem közelíti az elöző gen csúcsát. Valójában az 5080-an még a 70 kategóriát sem eri el, ezútán elhangzik a kérdés mért borzasztó ajánlat az 5080

-

Busterftw

nagyúr

Nem arrol van szo, hogy melyik a bestbuy, hanem arrol, hogy ket tiert teljesen hulyeseg osszekeverni, mert egyik a masikhoz kepest kb minden kartya borzaszto deal lesz...

Nyilvan a Porsche borszaszto deal egy BMW-hez kepest, de egy 1.4-es KIA-hoz kepest meg az utobbi lesz az.

-

Most ezen mi a meglepő hogy 18 % a különbség ár értékben? 600 dollár MSRP vs 5070 Ti 750 msrp.

Az van a listán amit az MSRP árazás is mutat. Mondjuk nekem sikerült kifognom pont MSRP-n az Asus Prime kártyát Alza garival,ugyan ez szintén alza garival kb 50 K val lett volna olcsóbb 9070 XT.- n az 20 % árkülönbség ,de kimondva 50 ezer forint már nem sok ha 300 K vagy 250 K.

Nekem 2-3 évre megért ennyit a kissé jobb RT és DLSS teljesítmény és a megszokott kezelőfelület de 100K-t már nem ért volna meg.

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Xiaomi 15T Pro - a téma nincs lezárva

- Hálózati / IP kamera

- Fejhallgató erősítő és DAC topik

- Építő/felújító topik

- MasterDeeJay: Egy nem átlagos Asus videókártya (GTX950M 2GB GDDR3)

- sziku69: Fűzzük össze a szavakat :)

- sziku69: Szólánc.

- Luck Dragon: Asszociációs játék. :)

- Vicces képek

- Apple MacBook

- További aktív témák...

- GAMING PC! i5-12400F / RTX 5060 / 32GB DDR5 / 512GB NVMe / 600w! BeszámítOK

- Keresünk iPhone 15/15 Plus/15 Pro/15 Pro Max

- Apple iPhone 15 Pro 128GB,Átlagos,Adatkabel,12 hónap garanciával

- ÁRGARANCIA!Épített KomPhone Ryzen 5 7600X 32/64GB RAM RTX 5070 12GB GAMER PC termékbeszámítással

- 218 - Lenovo ThinkBook 16p (G5 IRX) - Intel Core i9-14900HX, RTX 4060

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

de ezt a DLSS 5-öt akkor sem értem, amit én látok ki az egészből, hogy egy élettelen, egykaptafa, generic valamit csinál minden játékból. Ha most itt lenne egy kép fps nézetből, hogy sétál valaki egy erdőben a Starfield-ben és a Resi9-ben de nincs a képen semmi árulkodó object (pl űrhajó vagy zombi) valszeg meg nem mondanám, hogy melyik játékot látom. Ez inkább szörnyű mintsem, hogy éjjenezzek neki.

de ezt a DLSS 5-öt akkor sem értem, amit én látok ki az egészből, hogy egy élettelen, egykaptafa, generic valamit csinál minden játékból. Ha most itt lenne egy kép fps nézetből, hogy sétál valaki egy erdőben a Starfield-ben és a Resi9-ben de nincs a képen semmi árulkodó object (pl űrhajó vagy zombi) valszeg meg nem mondanám, hogy melyik játékot látom. Ez inkább szörnyű mintsem, hogy éjjenezzek neki.

Egyébként meg tudod nagyon jól, hogy rossz megvilágításban mindenki fiatalabbnak tűnik, amint jön az éles fény, kihozza a vonásokat, és ez miért ne lenne így egy módisított bevilágítás esetén? Egyébként meg Leont jobban nézd meg az előtte képen, mert ugyanúgy van szakálla, csak nem látszik úgy az eredeti megvilágítással.

Egyébként meg tudod nagyon jól, hogy rossz megvilágításban mindenki fiatalabbnak tűnik, amint jön az éles fény, kihozza a vonásokat, és ez miért ne lenne így egy módisított bevilágítás esetén? Egyébként meg Leont jobban nézd meg az előtte képen, mert ugyanúgy van szakálla, csak nem látszik úgy az eredeti megvilágítással.