Hirdetés

- Amazfit Active 2 NFC - jó kör

- Xiaomi 14 - párátlanul jó lehetne

- Poco F5 - pokolian jó ajánlat

- iPhone topik

- Xiaomi 15T Pro - a téma nincs lezárva

- Samsung Galaxy Watch (Tizen és Wear OS) ingyenes számlapok, kupon kódok

- Samsung Galaxy S26 Ultra - fontossági sorrend

- Új belépő a Honornál

- Poco F8 Ultra – forrónaci

- Íme az új Android Auto!

Új hozzászólás Aktív témák

-

DudeHUN

őstag

válasz

Petykemano

#48411

üzenetére

Petykemano

#48411

üzenetére

Ha csak abból indulok ki felénk hány 14. genes kékhalálos, crashelős RMA igény jön, akkor Intel ezzel el lesz még jó ideig :/

Nagyobb partnerek meg még kevésbé lehetnek megértőek, mint a fogyasztók. -

Raymond

titán

válasz

Petykemano

#48411

üzenetére

Petykemano

#48411

üzenetére

Ha az osszes partnerednel cserelni kell a CPU-k tizes nagysagrendben levo szazalekat es evekre elore kell contingency az azert odavag, fuggetlenul attol hogy publikusan az Intel es a partneruk hogy viselkednek. Senki nem fogja nagydobra verni mert a sajat poziciojukat is gyengitenek.

-

Alogonomus

őstag

válasz

Petykemano

#48409

üzenetére

Petykemano

#48409

üzenetére

Több konkrétumot is mondtam, és azok közül néhányra reagáltál is a saját gondolataiddal.

Gelsinger legkomolyabb hibája egyébként szerintem az volt, hogy a már 2021-ben is nagyon szoruló helyzetben levő Intel akkor még bőven rendelkezésre álló pénzügyi erőforrásait nem a helyzet rövid távú stabilizálására és az onnan sok évnyi kemény munkával megvalósítható kilábalásra költötte, hanem dollár tízmilliárdokat, ha nem egyenesen százmilliárdot is meghaladó összeget beleölt az IDM 2.0 elképzelésébe, és ezzel annyira kivéreztette az Intelt, hogy 2024 folyamán az Intel már kénytelen volt az ingatlanvagyonának egy részét is pénzzé tenni a pénzügyi stabilitása megőrzése érdekében.

Határozott véleményem, hogy Bob Swan tervét követve megelőzhető lett volna az Intel jelenlegi katasztrofális helyzete. Bob Swan 2020 magasságában tökéletesen látta, hogy az Intel gyártósorai hamarosan egyszerűen képtelenek lesznek a középkategória fölé szánt terméket gyártani, ezért az Intel akkor még rendelkezésre álló hatalmas pénzügyi eszközállományára támaszkodva befoglalt kapacitást a TSMC különböző generációs gyártósorain. Az volt a terve, hogy a komoly termékek egy ideig a TSMC gyáraiból érkeznek majd, a gyengébb termékekhez pedig elég az Intel saját gyártási technológiája is, és majd szépen visszaköltöztetik a saját gyártósoraikra az egyre magasabbra pozicionált termékeiket is, ahogy az Intel gyártósorai megint képesekké válnak a TSMC szintjén teljesíteni. Így a teljesítményelőny nem került volna át az AMD térfelére, vagyis az Intel is tudott volna csúcsteljesítményű termékeket kínálni a leszerződött partnereinek, azok nem kezdtek volna az AMD felé közeledni.

Gelsinger viszont "we can do it" mentalitást követve visszamondta/átadta a Swan által lefoglalt kapacitásokat, amit nem tudott elpasszolni, azt végül elsütötte a minimális mennyiségben idén piacra került új termékekre, a 2021 és 2023 között érkezett termékek fogyasztását az egekbe fokozta a szükséges teljesítmény eléréséhez, közben pedig mindent vagy semmit alapon belevágott az IFS erőltetett fejlesztésébe a saját IDM 2.0 koncepciója megvalósításához, ami végül az Intelt a jelenlegi helyzetébe juttatta.Az Intel jelenlegi helyzetét elnézve pedig már az a kérdés is felmerül, hogy melyik komoly cégvezetésben gyakorlott személy lesz hajlandó az Intel vezetését átvenni, és azzal valószínűleg a saját hattyúdalát elindítani, hiszen lényegében egy "felszámolóbiztos" lesz, akinek az Intel minél több üzletágát kellene valahogy megmentenie a totális megszűnéstől.

F1-es hasonlatokkal élve:

- 2017-ig az Intel vezetése nagyjából annyira feladatot igényelt, mint korábban a Mercedes, utóbbi években pedig a Red Bull igazgatása. Évente ki kellett hozni kicsit javított terméket, és a siker garantált volt.

- 2021-ig az Intel vezetése már annyira küzdelmes volt, mint a Ferrari igazgatása. Az élmezőnyt nem túl távolról azért sikerül követni, de ritkán volt meg a dobogó legfelsőbb foka.

- 2024-től kezdve viszont már az Intel is ugyanabba a kategóriába tartozik, mint a Williams. Valaha nagy név volt, a múltja még mindig szépen csillog, de a jelene egyre katasztrofálisabb, a jövője pedig meglehetősen bizonytalan. -

Raymond

titán

válasz

Petykemano

#48409

üzenetére

Petykemano

#48409

üzenetére

Gelsinger vagy harom es fel eve volt a posztjan. A tervei es az iranyt maradt, tehat nem az volt a gond. Szerintem azert kellett mennie mert rosszul kezelte(k) a 13 es 14 gen problemakat. Marmint nem azert mert voltak, az ekkora hajo sokkal lassaban fordul minthogy ahhoz valami koze lehessen, hanem azert ahogy az egesz ugyet kezeltek. Ez eszetlen nagy problemakat okozott es okoz nem csak a hirnevnek a nyilvanossagon es a pertnerkapcsolatoknal, hanem konkretan oriasi kihatasai vannak es lesznek meg evekig a penzugyekre is.

-

Alogonomus

őstag

válasz

Petykemano

#48407

üzenetére

Petykemano

#48407

üzenetére

Na igen, az emberiség történelme során eléggé sokszor feltették már azt a kérdést, hogy: "Hol rontottam el?"

Utólag már mindenki sokkal okosabb, és rengeteg pontra rá tud mutatni, amit máshogy kellett volna csinálni, és a végeredmény biztosan jobb lett volna. Az egyértelmű, hogy Gelsinger már eléggé rossz állapotban vette át az Intel irányítását, de még abból a helyzetből is valószínűleg kilábalhatott volna az Intel, hiszen akkor még lendületben voltak. Sőt a Bob Swantól megörökölt Alder Lake viszonylag sikeres generáció is lett. Az Intelből Gelsinger alatt fogyott ki a lendület, mert folyamatosan rossz irányba kormányozta az Intel "hajóját", így a piaci ellenfelek könnyedén lehagyhatták az Intelt. -

#90868690

törölt tag

válasz

Petykemano

#47902

üzenetére

Petykemano

#47902

üzenetére

Ne tegyünk úgy, biztosan létezik. Csak nem gondolnám hogy az ultravékony, ultrahordozható zenbook sorozat lenne az.

-

Alogonomus

őstag

válasz

Petykemano

#47883

üzenetére

Petykemano

#47883

üzenetére

Igen, a Strix Point minimálisan 4+6 "erős" magja és 8+12 szála tényleg kicsit sok egy sima utazólaptophoz, viszont a Lunar Lake 4 "erős" + 4 "takarékos" magja és magonként egyetlen szála már egy olyan szituációban is szűkös lehet, ha egyszerre fut az operációs rendszeren felül mondjuk egy böngésző, egy csevegő platform és egy irodai szoftver, ami teljesen tipikus helyzet egy utazólaptop esetén.

Az arany középút valahol a 20-24 szálas Strix Point és a 8 szálas Lunar Lake között lenne. Így nézve tényleg a 16 szálas Kraken Point lehet az ideális egy utazólaptop céljaira, de abban az összevetésben a Lunar Lake nagy hendikeppel indulna az ára miatt.

-

Alogonomus

őstag

válasz

Petykemano

#47881

üzenetére

Petykemano

#47881

üzenetére

Magok számát tekintve valóban az érkező 4+4 magos és 8+8 szálas Kraken Point tűnik inkább a 4+4 magos/szálas Lunar Lake konkurenciájának, viszont árban a Kraken Point laptopokkal összemérve a 2000 euro még kedvezőtlenebbként állíthatja majd be a Lunar Lake modelleket.

-

Busterftw

nagyúr

válasz

Petykemano

#47857

üzenetére

Petykemano

#47857

üzenetére

Egyetertek az elso ponttal en is, az Nvidianak a "fogyasztason" kivul marha jo uzlet volt a Samsung. Most mar amugy ez sem lenne gond, ha maradnak a 4000 szerianal bevezetett batar huteseknel.

Bar en remelem maradnak TSMC-n, amig nem tudunk tobbet az Intel ujabb node-jairol. -

válasz

Petykemano

#47823

üzenetére

Petykemano

#47823

üzenetére

Ez így érthető, és meg is magyarázza, hogy miért nem tudnak előre lépni.

Biztos vannak a színfalak mögött megállapodások, de a nagy gyártó cégek - akik 50c/termék pluszért az anyjukat is eladnák - csakis a profitban érdekeltek, nincs ott szó márkahűségről, vagy hogy a képzeletbeli vállalati ügyfeleknek jót akarjanak és ezért maradnak Intel vonalon...

Ahol HW vonalon fillérb$szás megy minden centre, általában az egyik fő faktor a NYÁK méret, majd jön a benne lévő réz mennyisége, SMT alkatrészek száma*, és akkor nem is beszélve a hűtéshez kellő rézről.

Pont a jelenlegi AMD procik előnye, hogy a kisebb fogyasztás miatt kisebb a teljes "package", amit fel kell pakolni egy laptop alaplapra, kisebb hűtés is elég nekik, így duplán megérős lenne a laptop gyártóknak is... Ezért is roppant furcsa, hogy ilyen potenciális árelőnnyel sem képesek versenyre kelni a kékekkel.*SMT cuccok: ez mondjuk megérne egy külön misét, mert van hogy inkább 2x területet (mm²) beáldoznak egy gagyi komponensekből épített blokkra, csak egy drága (10~20c) EC-t ne kelljen a lapra tenni.

Alogonomus #47824

Én nem temetném azért még a céget, mert hatalmas pénz és tudás van ott, csak rettentően pazarlóan működik már egy évtizede.

Én a teljes manager kar menesztésével kezdtem volna a vezetés helyében, és akkor nem kell eladni egy üzletágat sem.

De ez nem csak őket érinti, az USA összes nagy cége ugyanígy sorvadt el, kezdve az autógyáraktól, manapság pedig a hight tech cégekig ér már az a vállalati kultúra-újítás, ahol mindenki csak manager és menedzselni akar, de dolgozni nem igen.

A részvényeseknek fejhajtás, és a gátlástalan profit/jutalék maximalizálás már csak hab a tortán. -

Alogonomus

őstag

válasz

Petykemano

#47589

üzenetére

Petykemano

#47589

üzenetére

Eleve onnantól kezdve csak könnyed szórakozásnak számított a teszt, amikor Steve is leszögezte, hogy az Intel a minél magasabb üzemi frekvenciát hajszolja, míg az AMD a minél hatékonyabb működést.

Az Intel kezdetektől a magas frekvencia minél hatékonyabb kihasználásához alakította a processzorai belső logikai/szerkezeti felépítését, ami így nyilván nem tud sokat profitálni a nagy kapacitású belső cache előnyeiből. -

HSM

félisten

válasz

Petykemano

#47592

üzenetére

Petykemano

#47592

üzenetére

Hasonlóan emlékszem én is a 5600X és 5600G fronton.

Szerintem érdemes megnézni, mit mértek a 7950X3D-vel skálázódást a 7700X-hez képest: [link] .

Szerintem szépen látszik, hogy hiába háromszor akkora az L3, a sebességelőny bár jelentős, de nem földbe döngölős így sem. Megfigyelhető az is, hogy a gyorsabb memóriákkal szűkül az X3D előnye (ahogy utaltam rá). Sőt, néhány esetben a gyors ramokkal ott volt a 7700X is a lassú ramos 7950X3D nyakán.

-

HSM

félisten

válasz

Petykemano

#47578

üzenetére

Petykemano

#47578

üzenetére

Mikor melyik áll érdekükben. Ha egyik sem megy, akkor jön valami kitérő, pl. +50% Ai vagy hasonló.

#47577 proci985: Egy jó minőségű, legalább 6 hőcsöves, 12 centis ventilátorokhoz tervezett egytornyos léghűtő jól szellőző házban 150W-ot kényelmesen meghűt klíma nélkül is...

Elvileg egyébként az Intel dokumentáció erre ajánlja a PL1 limitet, hogy legyen úgy beállítva, amit még bír a hűtő tartósan. Mindenki kedvére testreszabhatja a működést a lehetőségei és igényei függvényében.

Mindenki kedvére testreszabhatja a működést a lehetőségei és igényei függvényében. -

hokuszpk

nagyúr

válasz

Petykemano

#47567

üzenetére

Petykemano

#47567

üzenetére

a hwunboxed méregette pár játékkal 253/253W limittel átlag 4% körül jött ki a teljesitmenycsokkenes. azert megneznem mondjuk a 188/253 -as limites mereseket is, vagy eppen a fentebb emlitett 125/188W -t

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

HSM

félisten

válasz

Petykemano

#47567

üzenetére

Petykemano

#47567

üzenetére

Nem hiszem, hogy olyan jól állnának a konkurenciához képest, hogy ez beleférne.

Főleg most, amikor ez így működik már amióta ez a Turbo rendszer be lett vezetve a Sandy Bridge óta.

Főleg most, amikor ez így működik már amióta ez a Turbo rendszer be lett vezetve a Sandy Bridge óta.Sokkal inkább ott a gond szvsz, hogy a beszámolók alapján brutális számban lehetnek most azok a CPU-k, amik nem bírják ezt, nyilván emiatt sok a garanciális probléma, és a negatív média visszhang sem tesz jót az eladásoknak, különösen, hogy a legdrágább, leggyorsabb otthoni flagship modellekről van szó.

-

paprobert

őstag

válasz

Petykemano

#47567

üzenetére

Petykemano

#47567

üzenetére

Egyből meglesz a +30% gen on gen.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

Busterftw

nagyúr

válasz

Petykemano

#47557

üzenetére

Petykemano

#47557

üzenetére

Errol volt par elemzes amugy (JayzTwoCents), hogy az alaplapgyartok brutal feszeket es beallitasokat alkalmaznak "auto"-n.

Persze nem azt mondom hogy nincs gond, de szerintem itt nem csak az Intel a ludas. -

válasz

Petykemano

#47449

üzenetére

Petykemano

#47449

üzenetére

mondjuk azért 27 % vs 3 % azért nagy eltérés, egyértelműen kijelenthető a MF AMd-s vonala. De érdekes, hogy ilyen AMD eladások mellett hogy lehet még Intel ilyen előnyben.

-

Yutani

nagyúr

válasz

Petykemano

#47449

üzenetére

Petykemano

#47449

üzenetére

Amazonon nagyot megy az AMD!

-

válasz

Petykemano

#47371

üzenetére

Petykemano

#47371

üzenetére

Elötte is együtt dolgoztak már az autóiparban.

Mediatek ugya a Chromebook piacán van folyamatosan dolgoznak a PC -s ökoszisztémán. valószínűleg ezzel nvidia idő és pénzt spróól, mert giga cég a z MTK is

Májusban is megkötötték a partneri viszonyt az Autókra,ami teljes ökoszisztémát biztosít a pratnereknek. Van egy halom Licensz a MTK bírtokában, nagy tapasztalatuk is van , Multimédiában is a legjobbak között vannak. gondolom ott is be fog jönni a közös nevező.

Mediateknek van 5 G, Wifi, ARm alapu CPu-k stb. Itt is komplett ökoszisztéma lesz a laptopok piacán amit nyújtani fognalk az Apple ellen Windows alapon. -

DudeHUN

őstag

válasz

Petykemano

#47202

üzenetére

Petykemano

#47202

üzenetére

A Creation engine még mindig nem tudja például a desktop felbontástól függetlenül állítani a játék felbontását...

-

DudeHUN

őstag

válasz

Petykemano

#47197

üzenetére

Petykemano

#47197

üzenetére

Szerintem sem kell ebbe többet bele látni. Nyilván mivel az AMD és az XBOX csapat is segített a Bethesdának és nincs RT az RDNA-nek jobban fekszik a dolog.

De simán lehet bug is.

Az is lehet, hogy itt többet számít az Nvidia driver overhead. Mert elég furcsa a CPU kezelés a játékban. Ugye eddig úgy fest központi RAM sávszél limites is.

13900K valami 6000+-res RAM esetében valszeg jobban pörgette volna a kártyákat, mert itt lehet az IF limitál.

Biztos kap még optimalizációt. Minden létező irányba. Mondjuk csodát nem várnék. Részemről így is örülök, hogy stabilan fut és nem microlaggos. -

huskydog17

addikt

válasz

Petykemano

#47188

üzenetére

Petykemano

#47188

üzenetére

Mi köze hozzá az AMD-nek? Nem tudom eldönteni, hogy ez a kérdés részedről trollkodás vagy tényleg komolyan gondolod. Jóhiszeműen feltételezem, hogy elsiklott a figyelmed felett a júniusi bejelentés, ami kb. milliószor volt említve a különböző világsajtókban. Bár rendkívül erősen kétlem, hogy nem olvastál/hallottál az exkluzív partnerségről, de elméletben még lehetséges.

"Nvidia vezet - Nvidia király

AMD vezet - AMD szabotázs!!444!"Ke? Hol írtam ilyet? Csak egy újabb álom a részedről. Majd ha kijózanodtál, esetleg beszélhetünk. Tőled már megszoktam, hogy mindig behaluzol valamit a hozzászólásokba.

Mi lenne, ha egyszer kizárólag arról beszélnénk, ami valóban le lett írva és nem általad kitalált mesékről?

"Ráadásul az Nvidia már elismerte, hogy nem volt elegendő erőforrásuk a day0 driver megfelelő elkészítéséhez."

Én eddig csak az AMD-nél olvastam problémákról. Az NV-nál mi volt a gond? Hol ismerte el? Lemaradtam erről.

-

válasz

Petykemano

#47188

üzenetére

Petykemano

#47188

üzenetére

Azt elismerheted hogy a 7900XTX nem 4090 teljesítményű kártya..

-

Kolbi_30

őstag

válasz

Petykemano

#47188

üzenetére

Petykemano

#47188

üzenetére

Es akkor most, kettehugyozza, megalazza, lefossa...ahogy a zold oldal szokott nyilatkozni...

-

HSM

félisten

válasz

Petykemano

#47044

üzenetére

Petykemano

#47044

üzenetére

Szerintem mindkét generáció rendben lenne, kivéve az árakat...

-

Busterftw

nagyúr

válasz

Petykemano

#46947

üzenetére

Petykemano

#46947

üzenetére

Illetve memória, akkor már miért nem GDDR7?

Micron szerint 2024 elején már tömeggyártás lesz (Samsung szintén), ha év végén jön a PS5 Pro, beleférne .Raymond-dal értek egyet, ez ilyen összecsapott wishful thinking spec, mennyiért kellene a konzolt adni?

-

válasz

Petykemano

#46947

üzenetére

Petykemano

#46947

üzenetére

A kép pletyka, csak akitől van egy elég jó leaker .

A zen 4 teljesen jó döntés. mi értelme lenne a zen 5 nek költséghatékonyságot nézve."Különös az is, hogy a nem kifejezetten jól sikerült RDNA3-at nevezik meg, mint grafikus egység"

ilyenkor elgondolkodok azon hogy miért írjátok ezt le sokszor? szerintem az RDNA3 jó lett.

Az árazással van baj de ha a konkurenciát nézem még azzal sincs.

Szépet lépett előre RT ben, erős raszterben. ha 7800 és 7800XT nak hívnák a megjelent variánsokat és 550$ és mondjuk 700 dollár körül lenne az ára elégedetten csettintenénk.

Ps5-be pedig a majd érkező új verziók átdolgozása megfelelőek lesznek. A mostani Ps5 kb RX6700 és mégis mit hoznak ki belőle. -

paprobert

őstag

válasz

Petykemano

#46936

üzenetére

Petykemano

#46936

üzenetére

"inkább tovább gyártják az RDNA2 lapkákat - megkockáztatom - azon a kedvezményes áron, amit esetleg a TSMC ajánlott"

Kis adalék információ, hogy a Sony is éppen árat vágott a PS5-ön. Nyilvánvalóan a "TSMC kongó gyártósor - AMD - Sony - vásárló" láncolaton most futott végig a chiptúlkínálat hatása, és a Sony szórni akarja a gépeket az emberek otthonába.

Szemben az AMD-vel, aki lassúdefektes árcsökkentéssel, 10 dolláronként vagy nem hivatalos akciókkal szalámizza a vásárlás előtt állók billegő részét, kevesebb sikerrel.

-

PuMbA

titán

válasz

Petykemano

#46936

üzenetére

Petykemano

#46936

üzenetére

Én is ezt látom. Navi 33-at kiadták, mert 6nm-en olcsóbban gyártható, mint a 6600-as kártyák. Navi 31-et kiadták a teljesítmény miatt, hogy aki az RDNA2-től erősebb AMD-t akar, az vehessen, illetve ezeken van a nagyobb profit. Navi 32 egyáltalán nem sietős, mert nem hoz se teljesítményben, se gyártási költségben sokat az RDNA2-höz képest.

-

paprobert

őstag

válasz

Petykemano

#46849

üzenetére

Petykemano

#46849

üzenetére

"a next big thing meg a neural rendering. Jelentsen utóbbi akármit is a gyakorlatban. "

Szerintem a következő DLSS egy extra réteget fog húzni a meglévő grafikára, pl. magasabb textúraminőség lesz vele elérhető mint a natív. Sebességet nem fog hozni (vagy nem annyit), de Ultra+ minőséget igen.

És akkor már megint nem az ár/érték arányon vagy a kártya nyers sebességén gondolkodna a vevő, hanem hogy "Nvidia kártyával a legszebb a játék".

Persze ez csak az én konteóm, de adja magát, hogy a másik irányba is elkalandozzon a sebesség-minőség tengelyen az NV.

-

Kolbi_30

őstag

válasz

Petykemano

#46849

üzenetére

Petykemano

#46849

üzenetére

Szerintem meg, a jatekokat kellene jobban megirni, es akkor nem kellene dlss meg fsr...meg nem kene a parasztvakitas az 500 fps meg 244 fps/mhz monitor ha boven jo a 120 is..mert ertem en hogy mindenki erzi a kulonbseget...

-

paprobert

őstag

válasz

Petykemano

#46757

üzenetére

Petykemano

#46757

üzenetére

A legegyszerűbb az lenne, ha az FSR beérné vagy megelőzné minőségben a DLSS-t, amivel egy csapásra értelmetlenné tenné a zöldek eljárását.

Megszűnne a felskálázók körüli fanboy sírás.

De ezt egyedül az AMD teheti meg, a pirosaknál pattog a labda.Ennek viszont van egy gátja, egy játékelméleti gond.

Az AMD csak azért kezdte el fejleszteni a mindenen futó megoldását, mert loholnia kellett a konkurencia után, mivel az előnybe került.

Ugyanez vonatkozik a továbbfejlesztésre is. Az FSR good enough already? Akkor seggre leülés, és pénzszámolgatás kezdődik, mert a fejlesztés drága.A további fejlesztés megtérülésése diminishing return kategóriába esik, amit leállít az AMD menedzsment.

Ha az AMD az FSR fejlesztése által nem tud csak magának gesztenyét kikaparni, nem fog pénzt ölni bele.

Úgyhogy az helyzet, hogy amíg minden hardveren fut az FSR, addig mindig csak közelítő eljárás marad, mert nem hoz pénzt Austinba.Ha pedig a jövőben bezár az FSR néhány funkciója, akkor ugyanott vagyunk, mint a DLSS-sel.

-

Yutani

nagyúr

válasz

Petykemano

#46757

üzenetére

Petykemano

#46757

üzenetére

Ezt hívják kettős mércének. Itt a PH-n nagyon megy az NV javára és az AMD kárára. Csak ezt nem értem, miért kell istenként imádni az egyik gyártót, és démonizálni a másikat.

Én olyan jól elvoltam tízen X évig a PH-n az ilyen csörték nélkül, aztán sajnos felhígult az úri közönség.

Mikor kezdődött ez az egész vajon itt a PH-n?

-

hokuszpk

nagyúr

válasz

Petykemano

#46757

üzenetére

Petykemano

#46757

üzenetére

pontosan ertettem eddig is, csak nem mertem ennyire polkorrekten leirni.

-

válasz

Petykemano

#46723

üzenetére

Petykemano

#46723

üzenetére

Már a követelmények is érdekesek.Nvidia oldalról eggyel régebbi generációt adnak meg mindkét esetben.

RX5700 és 1070 Ti.

6800XT és RTX 2080.

majd jól pofára esnek,mert beleheggesztik a modderek DLSS-t ami jobb lesz,mint az eredeti,mint volt rá példa legutóbb. -

Busterftw

nagyúr

válasz

Petykemano

#46723

üzenetére

Petykemano

#46723

üzenetére

"AMD and Bethesda are working together to bring cutting-edge graphics technologies for the game at launch."

Elobb nem cutting-edge hardvert kene hozni?![;]](//cdn.rios.hu/dl/s/v1.gif)

-

HSM

félisten

válasz

Petykemano

#46696

üzenetére

Petykemano

#46696

üzenetére

A dedikált gyorsítós dolog szerintem mellébeszélés. Valahol megnézték, és nem sokat használt a DLSS sem. Persze így lehet mondani, hogy nem csak dísznek rakták bele a tensor magokat....

Ami a többit illeti, én úgy látom, más a fókusz. A DLSS egyértelmű jó képminőségre és RTX-exkluzívitásra ment, az FSR viszont inkább arra lett célozva, hogy a lehető legkevesebb erőforrást vegye el a GPU-ból, miközben jó eredményt ér el (konzolok) és bármin fut. Az XeSS általános módja lényegesen több erőforrást használ el, és ezáltal az is ma már sokak szerint jobb minőséget ad, mint az FSR, de ilyenkor már nem is biztos, hogy megéri használni. Valahol olvastam erről egy alapos tesztet, de nem emlékszem már hol. Ez is jó kiindulási alap, bár régebbi: [link] .

-

paprobert

őstag

válasz

Petykemano

#46661

üzenetére

Petykemano

#46661

üzenetére

Szóval az RTX3060-ra $329 MSRP-n 180 dollárnyi VRAM került volna másfél éve?

Sántít egy kicsit.

-

Pipó

őstag

válasz

Petykemano

#46661

üzenetére

Petykemano

#46661

üzenetére

Találós kérdés: Ha veszi 3 dollár, ha eladja 100, mi az???

-

válasz

Petykemano

#46605

üzenetére

Petykemano

#46605

üzenetére

Valószínűleg igen,de az a 10 % magával rántja azokat is akik csak üzleti megfontolásból állnak bele.

Ez történt az utóbbi 6 hónapban :

És az utóbbi 5 napban nőttek 20 % ot ,mikor bejelentették, hogy plusz megrendeléseket intéztek TSMC felé a nagy kereslet miatt, ez pont elég volt ahhoz hogy az egész piac ráugorjon .

AZ Nvidia az utóbbi 6 évben 4x duplázta meg a részvényeit a vételi mélypont árhoz képest.

Ha valaki 6 hónapja megvette 168 dolcsiért a lent lévő részvényt az utóbbi 6 év trendje alapján szint biztos lehet benne hogy éven belül jókora nyereséggel eladható. Azaz az Nvidia az egyik legjobb és biztosabb gyors és nagyhozamu befektetésnek minősül mélypont vásárlásnál ,immáron sokadszor bizonyosodik be.tehát hosszú távon abból nőnek hogy bezuhannak néha

AMD folyamatosan lassan növekszik, ez látszik náluk.

Ez, ami Nvidiánál zajlik, hosszú távon nem engedi bezuhanni a vállalat részvényeinek árát és nagyon könnyen eladható, nagy kereslet van rá. azaz a legközelebbi mélypont szinte biztosra vehető, hogy nem 168 dollár lesz hanem ennél jóval magasabb és ez így zajlik náluk már 1999 óta, de szigorúan véve 8-10 éve. Ezzel növekszik ennyire a piaci kapitulációjuk. Ha az ARM biznisz összejött volna , most nem tudom hol tartanának, valószínűleg ajánlatot tennének Intelre( természetesen vicceltem).

A többi cég kb bottal üti a nyomát marketing szempontjából, ahogy befolyásoljak a tőzsdét. -

válasz

Petykemano

#46556

üzenetére

Petykemano

#46556

üzenetére

Igen csak már írtam abban a topikban.

"A másik két kártya ,a 2060 Super és a 3060 Ti is 8 GB vrammal van ugyan azon a charton ,amin a 4060 Ti 16 GB .

Szerintem az általam linkelt mondtat miatt, hogy a 4060 8 GB High a 16 GB ultra beállításokra ajánlott szerintük, megmagyarázva az árkülönbséget.

Szerintem fals következtetés, hogy nem futott le a teszt mert akkor a régebbi kártyákon sem ment volna le értékelhető eredménnyel szerintem."Nincs leírva sehol hogy nem futott le a teszt vagy hogy a 4060Ti 8 Gb miatt lett visszavéve. Nem védelemből írom, abszolút, csak a következtetést nem értem miből jött le.

-

Busterftw

nagyúr

válasz

Petykemano

#46511

üzenetére

Petykemano

#46511

üzenetére

Szerintem ha 3rd party megrendelő lenne a képletben, azt a Steam nem tenné publikussá.

Ennek így nincs sok értelme, szerintem a publikus infó az összes user/adat alapján van, ha 3rd partynak kell specifikus userbase/adat akkor azért fizet. -

GeryFlash

veterán

válasz

Petykemano

#46375

üzenetére

Petykemano

#46375

üzenetére

Mondjuk azert tegyuk hozza, hogy David Wang-nak az RTG-nel szinten joval kevesebb forrasa van mint az Nvidianal. Nem reprentativ adatok de azert a lenyeg lathato:

Itt azert latszik, hogy az AMD es az Nvidia kb hasonlo meretu ceg (2022-es eves bevetel AMD-nek 23 milliard dollar volt, az Nvidianak 26 milliard). Ugye az AMD a CPU reszleggel egyutt ,,ugyanakkora" mint az Nvidia. A vicces viszont, hogy amig az AMD osszesen 1.36 millaird dollart koltott a negyedevben kutatas fejlesztesre, addig az Nvidia ennel 50%kal tobbet, 2 milliardot. Es ugye nem nehez kitalalni hogy ebbol %-osan melyik cegnel ment tobb a GPU diviziora... Szoval tovabbra is azt varni az AMD-tol, hogy azt fogja hozni azonos gyartastechnologian mint az Nvidia, az eleg meresz. Kb ott vannak, ahol lenniuk kell. Emiatt nicns David Wang se egyik se masik iranyban megitelve. Rajanal viszont a VEGA korszak egy csod volt, es rengeteg olyan hantazasa volt ahol kijott hogy o inkabb egy nagyotmondo politikus mint top GPU tervezo.

Video: Raja Koduri: Lies in a conference meeting. Gets hired by Intel

-

Egon

nagyúr

válasz

Petykemano

#46365

üzenetére

Petykemano

#46365

üzenetére

Annál több esze van az nV vezetésének...

![;]](//cdn.rios.hu/dl/s/v1.gif)

Ha marad az iparágban, akkor még van töménytelen mennyiségű mobil GPU gyártó (Adreno, Mali, PowerVR), no meg ott az AMD is, mint kiváló lehetőség...

-

válasz

Petykemano

#46355

üzenetére

Petykemano

#46355

üzenetére

Úgy látszik más is erre gondolt , mint én. Bár nem világos a lépés hogy a 20A miatt van e de elképzelhetőnek tartom ahogy ők is. Akkor viszont 2024 ben már találkozhatunk vele az ARL képében.

[link]

[link] -

válasz

Petykemano

#46355

üzenetére

Petykemano

#46355

üzenetére

Valószínűleg a 2023 végén -2024 elején kijövő architektúrák már kész és biztosan működő gyártástechnológiára lettek tervezve, hisz ezek kihozatala 1,5-2,5 éves fejlesztési ciklussal történik.De arról is volt szó hogy az Arrow előrendeléseit eltolták a TSMC nél.

Az is lehet ,hogy pont ez miatt tolódott el és nem onnan fog érkezni.

20A ra elméletileg 2025- ben lehet számítani legelőbb a tervezést is figyelembe véve. -

huskydog17

addikt

válasz

Petykemano

#46337

üzenetére

Petykemano

#46337

üzenetére

"Engem nem zavar, hogy az Intel termékeket próbálod népszerűsíteni."

Ezt mi alapján szűrted le? (nem kell válaszolni) Én nem próbálok népszerűsíteni semmit, egy akciós hírt belinkeltem, nem értem ez nálad miért népszerűsítés, na mindegy, hagyjuk, ismét olyat látsz bele a hsz-be ami nincs ott.

Akkor legközelebb nem írok oda átszámított árakat és akkor talán nem lesz értetlenkedés és értelmetlen kötözködés (bár még mindig nem értem hogy ennyire egyszerű evidens dolgon hogy tudsz fennakadni)

"Én csak arra kívántam felhívni a Te és mások figyelmét, hogy az általad alkalmazott átszámítási mód (nem számítva persze a kézközön, vagy ilyen félhivatalos tranzit-házhozszállításos módszereket) nem helyes és ne legyenek túlzott várakozásai a magyar boltokban tapasztalható árakkal kapcsolatban és ne is kezdje el a "felárral dolgozó, lehúzó magyar kisker bandában" keresni a boltban látott és az általad beharangozott árak közötti különbségre a magyarázatot."

Erről beszélek, hogy erről szó nincs, ilyet nem írtam, ezt kizárólag te látod bele a hsz-be, nem értem miért. Itthoni boltok MSRP áron adják az Intel kártyákat, tök jó. Belinkeltem egy olyan külföldi akciót hol MSRP alatti áron lehet venni néhány Intel VGA-t, erre te meg rögtön a fenti dolgokkal állsz elő, holott szó se volt olyanokról, egyszerűen.

Hihetetlen, hogy egy rém egyszerű akció belinkelése alapján te rögtön rosszindulatú háttérszándékokkal vádolsz.

Ha nem tetszik egy hír, akkor lépj túl rajta, de nem tanácsos a másikat mindenféle hülyeséggel gyanúsítgatni, mert belinkel egy érdekességet (azt leírtam ,hogy szerintem milyen szempontból lehet érdekes, de azt is ignoráltad). Én a témát ezzel lezártnak tekintem, mert egyszerűen a semmiről nincs értelme beszélni, főleg úgy, hogy olyan dolgokat hozol fel, amit le se írtam. -

huskydog17

addikt

válasz

Petykemano

#46334

üzenetére

Petykemano

#46334

üzenetére

Huh de nagyon rugózol ezen feleslegesen.

Pofon egyszerű pedig, amint írtam is mindössze a Newegg árait számoltam át Forintra érdekességképpen, hogy ott mennyiért adják. Ahogy írtam is, fogalmam sincs, hogy a Newegg szállít-e ide és mennyiért és őszintén szólva nem is érdekel, mert nem azért írtam, hogy most mindenki vegyen onnan. Az átszámítást csak érdekességképpen említettem meg, hogy ottani ár itthon adott pillanatban mennyi.

Ilyen alacsony áron RTX 3060 (Ti) tempót még nem láttam. Ahogy szintén írtam, nem a mi mérhetetlenül kicsi piacunk a mérvadó, hanem például az amcsi és ott a linkelt árak érvényesek, így ilyen akciókkal az Intel akár számottevő piacot is szerezhet. Ár-érték arányban a fent említett árakkal az ARC A széria igencsak erős lett."Nemrégiben $249 lett az A750 hivatalos ára."

Igen tudom és a linkelt akciók azt jelenti, hogy a Newegg-en MSRP alatti áron lehet vinni az Intel kártyákat.

-

huskydog17

addikt

válasz

Petykemano

#46332

üzenetére

Petykemano

#46332

üzenetére

Ezek alapból bruttó árak. Azt nem tudom, hogy a Newegg szállít-e Magyarországra, mert US-en kívüli országok listájában nagyon kevés van és nincs köztük Hungary, így nem tudom, hogy amennyiben szállítanak ide, akkor mennyibe kerülne a szállítás, azonban nem is feltétlten rólunk van szó, hanem külföldön is sok embernek jó vételek ezek.

-

GeryFlash

veterán

válasz

Petykemano

#46264

üzenetére

Petykemano

#46264

üzenetére

Errol a chartrol osszesen ennyit kell tudni: [link]

Nem tudom mi a nagyobb problema, hogy semmihez nem erto de mindenhez hozzapofazo consultant g*cik ilyen preziket gyartanak, vagy inakbb az hogy az IT/Tech szaksajto ezeket kritika nelkul atveszi es spreadeli. -

Petykemano

veterán

válasz

Petykemano

#46263

üzenetére

Petykemano

#46263

üzenetére

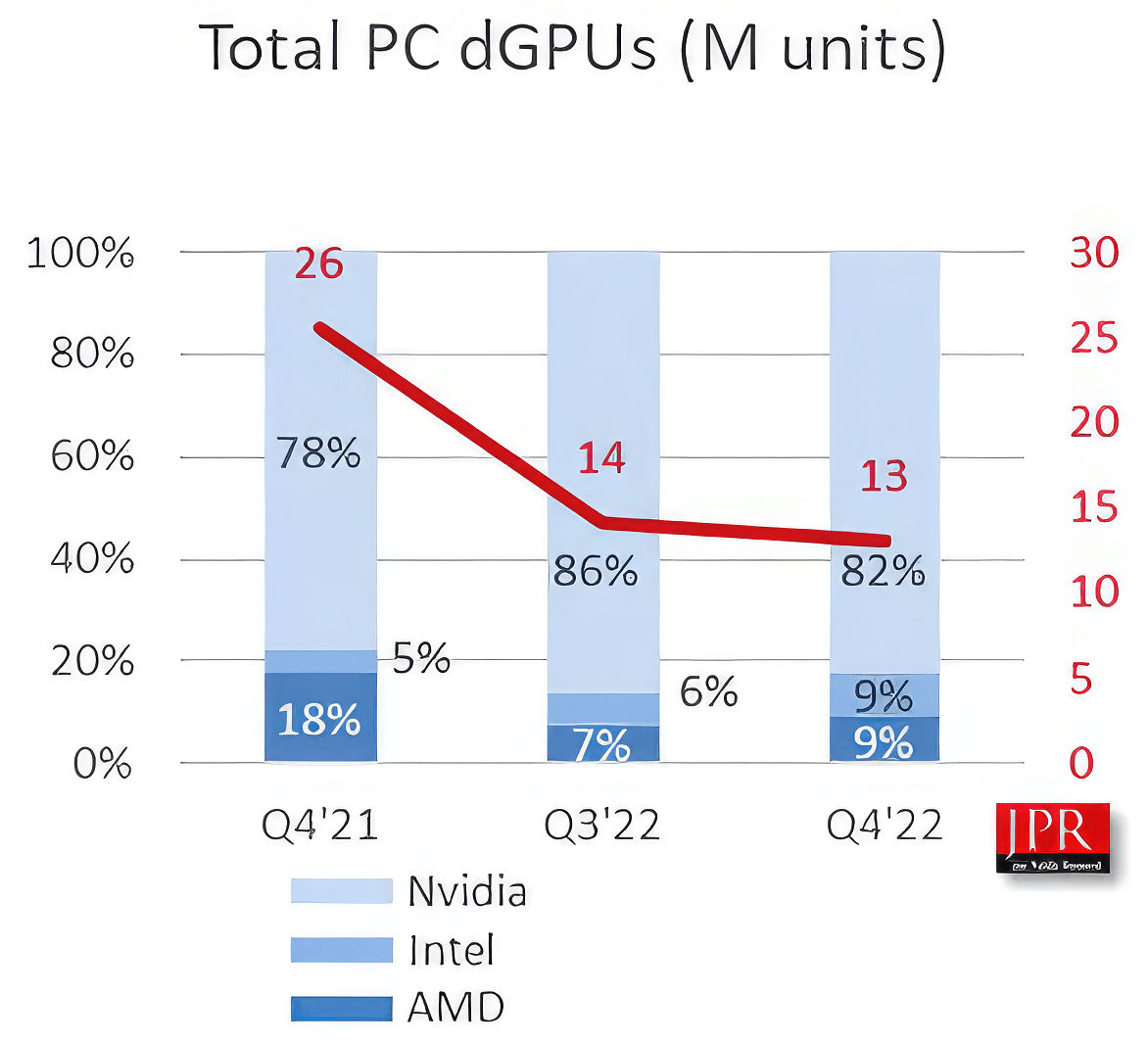

Ez még ide tartozik

Az valószínű, hogy az Intel nem a dobozos dGPU-k piacán szedi össze a 9%-os részesedést, hanem notebookokban, prebuilt gépekben.

Abu az AMD részesedésének visszaesését azzal magyarázta, hogy felhagytak a 14nm-es Polaris 14 gyártásával. De végső soron akkor nem igazán sikerült pótolni.

Így vagy úgy, de egyelőre úgy néz ki, hogy az Intel belépése valóban nem az Nvidia részesedésébe harapott bele, ahogy azt az alapján várni lehetett, hogy milyen gyakori az Intel+Nvidia kombináció, hanem az AMD részesedésébe. -

HSM

félisten

válasz

Petykemano

#46259

üzenetére

Petykemano

#46259

üzenetére

A dia szerzőjének oldaláról vetül fel a kérdés, miért éppen ezeket választotta ki, és miért emelte ki a csiplet kialakítást illetve a 2234-est és 7702-est?

Abból a szempontból értem, hogy ezek a legkisebb TCO2, és legnagyobb teljesítmény, de így úgy tűnik, mintha ezek minden további nélkül összehasonlíthatóak lennének...

Abból a szempontból értem, hogy ezek a legkisebb TCO2, és legnagyobb teljesítmény, de így úgy tűnik, mintha ezek minden további nélkül összehasonlíthatóak lennének...

Nem voltam ott az előadáson, így a továbbiakat passzolom. -

HSM

félisten

válasz

Petykemano

#46254

üzenetére

Petykemano

#46254

üzenetére

Köszönöm!

Megvannak a válaszaim... Tartottam tőle, hogy ezt fogom látni. Kicsit az a benyomásom, hogy a konklúzióhoz válogatták a résztvevőket... Lássuk a TCO2 bajnokot, egy négymagos CoffeeLake.

Lássuk a TCO2 bajnokot, egy négymagos CoffeeLake.

Igen, egy 71W-os, ehhez képest csigalassú 14nm+++++ CPU [link] 2019-et reprezentálva.

Igen, egy 71W-os, ehhez képest csigalassú 14nm+++++ CPU [link] 2019-et reprezentálva.

Ezzel persze nincs is az égvilágon semmi gond, a gond azzal van, hogy miért nem szerepel a konkurenciától bármi olyan CPU, ami ennek akár távolról is ellenfele lenne? Merthogy egy 128 sávos PCIE hubos 8 csatornás kőkemény szerver CPU, amiket melléraktak Epyc-eket többfélét is nyilvánvalóan egészen más karbonlábnyommal fog dolgozni, mint egy notebookokból szabadult mini-CPU, 16 sávos IO-val, 2 memória csatornával.

Egy reális ellenfél 2019-ből, ha már chiplet, egy 3900X/3950X lett volna, ami sajnos nem szerver, de ha már erőltetjük a megközelítést, akkor egy reálisabb ellenfél, az máris árnyaltabb képet mutat [link] , és ez a 3900X nagyon nem hatékony működésre volt ám optimalizálva....

Az is jól látszik, hogyha már méltó ellenfél, a 6348-as 'valódi szerver' felszereltségű Xeon hiába monolitikus, lényegesen nagyobb a lábnyoma, mint bármelyik chipletes megoldásnak.Én azt gondolom, hogy ebből az a konklúzió, hogy ezek a rengeteg PCIE sávos és memória csatornás monstrumok bizonyos metrikák szerint kevésbé hatékonyak lehetnek, mint egy nagyon minimalista IO-jú megoldás. Viszont nem véletlenül használnak sok területen ilyeneket, ha kell az IO is, akkor nem tudsz mit tenni. De mindenképpen hasznos, ha odafigyelnek a cégek a nagy adatparkok teljes környezeti lábnyomára, és ebbe az irányba is fejlődnek majd a cégek.

A chiplet megközelítés éppen emiatt "környezetbarát", alacsony ráfordítással akár többféle IO kiépítéssel is körítheted ugyanazt a CPU magot, ha van rá piaci igény. Az említett 3900X-ben ugyanazok a CCD-k, mint a szerver EPYC-ekben, csak kevesebb IO-t tartalmazó IOD-vel. Sőt, még a 15W-os notebook CPU-k alapja is ugyanaz a fabric, csak integrálva. Ez azért óriási megtakarítás sok szempontból a monolitikushoz képest, minden téren.

Ehhez képest minimális többlet fogyasztás csak az ár a fabric részéről, bár tény, hogy egy rengeteg CCD-s kiépítésnél a fabric már nagyságrendileg hasonlóan is fogyaszthat, mint maga a CPU, lásd pl. [link] .

Ehhez képest minimális többlet fogyasztás csak az ár a fabric részéről, bár tény, hogy egy rengeteg CCD-s kiépítésnél a fabric már nagyságrendileg hasonlóan is fogyaszthat, mint maga a CPU, lásd pl. [link] .

-

HSM

félisten

válasz

Petykemano

#46249

üzenetére

Petykemano

#46249

üzenetére

A csipletes mitől lett rosszabb a monolitikusnál? Én éppen fordítva gondolnám, a monolitikus már a magasabb selejtarány miatt problémákba kellene ütközzön nagyobb csipeknél.

Persze, nyilván van egy sweet spot, 128 mindenképpen magot pazarlóbb összekötni, szinkronban tartani, mint mondjuk 8-at.

-

válasz

Petykemano

#46224

üzenetére

Petykemano

#46224

üzenetére

Ez messze tultmutat a gamer szegmensen. Szerintem ez nem is lehet kerdes.

-

válasz

Petykemano

#46199

üzenetére

Petykemano

#46199

üzenetére

Szerintem is egy kicsit rákanntattál erre a Discord dologra. Nincs ez elbagatelizálva csak nem értem mit látsz benne mert a Discord egy több éves program és eddig viszonylag hibátlanul működött az új verziójának frissitése után történt 25- 250 Mhz memória Vram órajel esés aamit - ismét kiemelve nem azért hogy elbagatelizáljam- csak kimérni lehetett, észrevenni nem igazán állítólag.[link]

Itt videón a 7000 ről 6800 ra zuhanó Vram freki és hozzá a megoldás [link]

igazából egy alkalmazás profil frissítéssel megoldották, [link]kb ilyen szintű " hiba" volt.

A hiba kijövetele után pár nappal Nvidia kiadott már egy valamilyen szintű megoldást [link] majd után a gyorsan egy profil javítást.

Az Amd driverek hiányát nem Nvidia fanok találmánya, nem ők találták ki hanem AMD kártya tulajdonosok hiányolják és a sajtó. ezt nem rajtuk, rajtunk kellene számon kérned. -

Raymond

titán

válasz

Petykemano

#46199

üzenetére

Petykemano

#46199

üzenetére

Ez nem szerencse kerdese. Szerintem Kezd azzal hogy lenyugszol egy picit, megnezed mi is az a Cuda P2 State hogy milyen hatasa van milyen orajelekre aztan ha meg van kedved akkor elmondhatod itt hogyan veszi valaki eszre normalis hasznalat mellett.

-

HSM

félisten

válasz

Petykemano

#46196

üzenetére

Petykemano

#46196

üzenetére

"Ha AMD kártyával tapasztalunk valamilyen problémát az az AMD driver hibája."

Van egy önbeteljesítő jóslat jellege szerintem a dolognak. De ezt én is megfigyeltem.

Többször találkoztam olyannal, hogy pl. büszke, de vélhetőeg instabil CPU tuning/undervolt után az illető megjelent az AMD VGA topikban, hogy összedőlt a drivert, meg fekete kép, stb, szinte evidenciának véve, hogy a driverrel van a baj... Nv-nél pont fordítva van, ha a driver beteg, akkor is másban keresik a hibát.

-

Raymond

titán

válasz

Petykemano

#46191

üzenetére

Petykemano

#46191

üzenetére

"De érdekes módon az Nvidia találgatósban még egyetlen lelkes, de elégedetlen Nvidia rajongó sem hőbörgött azon, hogy az felhasználói élményét rontotta az Nvidia bughalmaz drivere discord használat közben."

Gondolom azert mert eszre se vettek. Annyi torrent hogy a VRAM a Cuda P2 State orajeleken ment ami par szazalek nominalis csokkentes es a jatekombal a teljesitmenyben nem veszed eszre csak ha benchmark szamokat hasonlitasz ossze.

-

omfgk

veterán

válasz

Petykemano

#46187

üzenetére

Petykemano

#46187

üzenetére

Inkább marketingfogás ez...

Több helyen is írják ,hogy ezeket az állítólagos készleteket egyébként senki nem látta.

-

Yutani

nagyúr

válasz

Petykemano

#46191

üzenetére

Petykemano

#46191

üzenetére

-

Busterftw

nagyúr

válasz

Petykemano

#46191

üzenetére

Petykemano

#46191

üzenetére

Discord frissites okozta a problemat egyes Nvidia kartyakon, miert lenne ez az Nvidia sara?

Konkretan 31-en erkeztek a hirek a problemarol, az Nvidia ra 3 napra lekommunikalta hogy kesz a fix, toltheto.Amugy en par eve Excelbe szedtem egyik ev Nvidia/AMD driver megjeleneseit, kijavitott hibak szamat es a "known issues" reszt. (jatek profilokat nem szamolva)

AMD-nel ha nem dupla annyi volt az entry, de sokkal tobb. -

válasz

Petykemano

#46187

üzenetére

Petykemano

#46187

üzenetére

Kérdéses, hogy a valóságban hány darab volt elérhető ezeken az árakon

-

huskydog17

addikt

válasz

Petykemano

#46187

üzenetére

Petykemano

#46187

üzenetére

Mindegyik elfogyott, ami nem is csoda, ezek elég brutális akciók, főleg a 420 dolláros 3080-as iszonyat jó vétel, így nem csoda, hogy mindet elvitték pár óra alatt. Amúgy szerintem egyéni raktársöprés, ahogy a videocardz is írja:

"However, this is a good sign that even NVIDIA premium retail partners are now expecting to upgrade their inventory to next-gen series, which are hopefully coming in the following weeks."Kár, hogy itthon ilyen akciókat nem nagyon látni. 420 dolcsiért én is gondolkodás nélkül beruháznék egy 3080-ra.

-

paprobert

őstag

válasz

Petykemano

#46157

üzenetére

Petykemano

#46157

üzenetére

Aki nagyot mond, az (statisztikailag) nagyot tévedhet.

Az AMD esetében pedig inkább nem valósultak meg a kívánt dolgok, mint igen, azaz jócskán 50% felett van az a szám, hogy tévedtél, ha pro-AMD jellegű jóslatokat tettél.

-

HSM

félisten

válasz

Petykemano

#46148

üzenetére

Petykemano

#46148

üzenetére

"És csak a piaci penetráció vs extra munka kérdéskörön bukhat el"

Ha okosan csinálják, szerintem nem túl nagy extra munka, hiszen kész az API, és a konzolokon is elérhető a feature. Főleg, ha később esetleg szabvány is lesz belőle, ami nem elképzelhetetlen, mert mások is látják azért a DXR jelenlegi korlátait, köztük az nv is, azért hozták a 4000-es széria fejlesztéseit a fixfunkciós blokkba [link] .#46149 Busterftw : Nem tudok róla, hogy lenne olyan játék, ami az AMD saját RT API-ját használná.

#46150 b. : A helyzet, hogy a DXR és az RTX-ek eléggé egymásra lettek szabva... Lásd DXR1.0 - Turing, DXR1.1 - Ampere. Így könnyű. Az AMD más megoldást képzelt erre el a konzolokkal és RDNA2-vel kezdődően. A nagy költői kérdés, hogy annak támogatása miért nem került bele a PC-s DXR-be, főleg, hogy a konzolok is tudják?

Egyébként már a DXR rendszer megjelenésekor többen panaszkodtak a rendszer black-box jellegére és bizonyos pontokon a programozhatóság, rugalmasság hiányára. Szintén Abu85 linkelte nemrég [link] , teljes mértékben egyetértek vele szoftverfejlesztési szemszögből.#46156 paprobert : "De hát mindhárom állítás igaz. ... A kártyákban nincs elég számítási kapacitás ... rövid távon."

Ezzel a pontoddal nem értek egyet. Jó példa erre a mostani RDNA2 és RDNA3 kártyák (Navi21, 31). Elég komoly RT-re képesek még úgy is, hogy rá vannak kényszerítve a korlátozott DXR megvalósításra.

Természetesen a fixfunkciós hardver + rá szabott, a konkurencia erősségét nem támogató API mellett nyilvánvalóan az RTX-es megvalósítás tűnik szükségesnek és jobbnak. De ne csak a chartokat nézzük, hanem a tágabb kontextust is, és máris nem lesz ez olyan magától értetődő.

-

paprobert

őstag

válasz

Petykemano

#46155

üzenetére

Petykemano

#46155

üzenetére

"az AMD megközelítése a programozhatóságról volt a helyes megközelítés

Abu majd hiába mondja, hogy 5 éve pofázom nektek, hogy a fixfunkciós hardver zsákutca

Nvidia fanok részéről, hogy azért kellett a fixfunkciós hardver a hőskorban, mert a kártyákban nem volt még akkor elég számítáci kapacitás"

De hát mindhárom állítás igaz.

A programozhatóság a helyes megközelítés... hosszú távon.

A fixfunkciós hardvernek van elméleti korlátja ... hosszú távon.

A kártyákban nincs elég számítási kapacitás ... rövid távon.Emiatt lett a FFRTU a megoldás, a mankó a jelen kor problémáira. Amelyre majd valamikor nem lesz szükség többé. De addig is Abu 2 évente kidobatja a kukába fórummal az NV gépparkot.

-

válasz

Petykemano

#46146

üzenetére

Petykemano

#46146

üzenetére

Ez pontosan ugyan olyan hardveres implementáció mint a fixfunciós hardverek direkt támogatása nem érzek benne különbséget. Egyértelműen ha olyan hardverelemre optimalizálnak amivel csak az egyik gyártó rendelkezik.

Nvidia jelenleg a szabványos DXR-t gyorsítja RT magokkal, és ez látszik abból, hogy az Intel meg az ARC 770 nel egyből belépett a raszteres párja mellé ( RTX 3060) raytracingban , sőt gyorsabb is annál, bármiféle Inteles játék optimalizáció nélkül Nvidia támogatott játékokban is... [link]

Tehát nincs itt Nvidia varázslat hanem az van hogy van egy szabványos kód amit mindenki támogathat a maga módján.

Tehát abból, hogy valaki arra vár hogy az Amd milyen jó lehetne ha rá optimalizálnának és közben Nvidiát kritizálja mert ő hardveres részegységekkel gyorsítja a szabványos API-t számomra kissé érthetetlen és azt várja hogy pont AMD ne legyen szabványos hanem direkt rá legyen majd írva a DXR Raytracing... köszi...El kellene tudni fogadni pár dolgot azt gondolom az AMD rajongók részéről...

-

HSM

félisten

válasz

Petykemano

#46146

üzenetére

Petykemano

#46146

üzenetére

Architektúrálisan azért itt lehetnek szűk keresztmetszetek.

Pl. hogyan kommunikál a shader a fixfunkciós metszésvizsgálóval? Egyáltalán nem ugyanaz, ha ezek egy komplett blokk, mintha a compute shaderrel kell intenzíven együttműködni. Az már csak hab a tortán, hogy az RDNA-ban több és potenciálisabban optimálisabban kihasználható cache van.

Pl. hogyan kommunikál a shader a fixfunkciós metszésvizsgálóval? Egyáltalán nem ugyanaz, ha ezek egy komplett blokk, mintha a compute shaderrel kell intenzíven együttműködni. Az már csak hab a tortán, hogy az RDNA-ban több és potenciálisabban optimálisabban kihasználható cache van.Én erre számítok, hogy DXR lesz, és nem fog olyan jól futni, mint az AMD-specifikus kód. Nem is kifejezetten az L2 miatt. De ez mind csak találgatás az elérhető információ-motszákból.

-

Yutani

nagyúr

válasz

Petykemano

#46118

üzenetére

Petykemano

#46118

üzenetére

Szép új világ. Tulajdonképpen bármilyen is a szituáció, árat kell emelni. Ha túl nagy a demand, azért, ha túl kicsi, akkor meg azért. Gyalázat.

-

Busterftw

nagyúr

válasz

Petykemano

#46083

üzenetére

Petykemano

#46083

üzenetére

Engem sem, oke hogy draga, de konkretan a 4090 a jo vetel.

-

Yutani

nagyúr

válasz

Petykemano

#46068

üzenetére

Petykemano

#46068

üzenetére

Igen, csak így tudja a GPU gyártó szabályozni a piacot, az AIB-okra nem lehet ilyet rákényszeríteni (azaz legyártott kártyákat raktározni).

Van egy régi bölcsesség, mely szerint jobb a sűrű fillér (cent), mint a ritka forint (dollár), de ezek szerint ezt az AMD és NV nem osztja.

-

Raggie

őstag

válasz

Petykemano

#46065

üzenetére

Petykemano

#46065

üzenetére

Ez sajnos "bevett" a VGA gyártóknál. Az Nvidia egész 2022-ben ugyanezt csinálta és őkis tök nyíltan meg mondták a részvényeseknek.

LINK -

Raymond

titán

válasz

Petykemano

#46063

üzenetére

Petykemano

#46063

üzenetére

Sokat nem ernek vele szerintem. A piaci ara mar most is 299EUR ami nem lett volna rossz amikor bejelentettek anno a kartyat de mire sikerult kiadni teljesen mas lett a helyzet. Per pillanat ez a 299-es araval a 269-289EUR-os RX6600 es a 299-329EUR-os RX6650XT-vel all szemben es ott azert nem tundokol.

-

paprobert

őstag

válasz

Petykemano

#46045

üzenetére

Petykemano

#46045

üzenetére

Ami érdekes, hogy Vulkan-nal elégséges lenne a Polaris tudása, a Directx limitál.

A Forspoken a legjobban sikerült, szándék nélküli NV-szponzorált cím lett végeredményben.

-

válasz

Petykemano

#46002

üzenetére

Petykemano

#46002

üzenetére

ebből az jön le hogy hiányzik a 3080-3080Ti 3090-3090 Ti a volt kínálatából, míg AMD nél szinte teljes portfólió van.

-

Petykemano

veterán

válasz

Petykemano

#45993

üzenetére

Petykemano

#45993

üzenetére

De másutt is ezt írják. Abban az értelemben, hogy kurrens kihasználtság. Sőt, azt is, hogy N7/N6 esetén 40% alá eshet. [link]

Eredetileg innen: [link]

Ez megmagyarázza, miért marad sokmindem N6-on az AMD-nél.

Amit még hozzá akartam tenni az az, hogy azt gondolnám, hogy a félvezetők iránti kereslet ilyen mértékű csökkenésével szerintem minden más komponens árának is idővel csökkennie kéne.

PCB, szubsztrát, VRM - Ezekre is mind visszaeshetett a kereslet. A legdrágább komponens talán egy gpuban a GDDR. De annak is csökkennie kéne. Egyrészt mivel a gpun és a konzolon kívül nem használja semmi. Előbbire biztosan súlyosan visszaesett a kereslet, utóbbira talán nem, vagy nem annyira, de a gpu kereslet negyedévente 13 millióról 6-ra esett vissza, PS5-ből meg most tartanak 30 milliónál 5 év alatt.

Egyedül a hűtő alapanyagai (réz és alumínium) Azok amelyek más iparágakban is használatos, de utoljára mikor méztem, Azok is visszakorrigáltak a csúcs árból.Az energia ára persze magas még és a megmunkálás biztosan sok energiát használ. De a gáz ára is lefelé tendál manapság.

A szállítási költség visszaállt.Egyedül az infláció miatt esetleg nagyobb mértékben növelt bérköltség marad meg. De egyrészt nem mindenhol akkora mértékű, mint nálunk. Euban 9.2% vllt tavaly. Tehát összessségében egy infláció körüli áremelkedés magyarázható lenne a bérköltségek emelkedésél.

Szerintem csökkennie kéne az áraknak.

-

Raggie

őstag

válasz

Petykemano

#45974

üzenetére

Petykemano

#45974

üzenetére

Szerintem csak simán van egy "rough binning" azaz durván meghatározzák installálás nélkül az adott CCD-ről, hogy jó-e szerverbe, vagy jó-e 7950/7900/7700/7600-asnak majd után van újra egy finomabb(alaposabb) ellenőrzés azután, hogy a CCD-k beültetésre kerülnek, ami során még kihullhatnak két CCD-s példányok amik nem tudnák a fentebbi modellek speckóit 100%-ra hozni így azok lekerülnek alacsonyabb kategóriába és a rosszabb CCD-t letiltják. Azt ennyi.

@#45975b. : ez tényleg nagyon rossz hír. Szintén támogatnék akár pl egy Patreon site-on keresztül ahol ezt a programozó csávót lehet rendszeres pénnzzel támogatni kifejezetten erre a projektre.

-

paprobert

őstag

válasz

Petykemano

#45961

üzenetére

Petykemano

#45961

üzenetére

"Azt a kérdést akartam neki feltenni, hogy akkor ugye lehet olcsó a Navi33?"

Lehetne.

De nem igazán értem, hogy miért még mindig költségeket számolunk, amikor az árak önkényesen vannak megszabva mindkét cég által.

Gyakorlatilag nincs kapcsolat az AMD költsége és a végfelhasználói ár között.Fognak egy elkészült terméket, beillesztik a meglévő teljesítmény/dollár listába lineárisan. Pár dollárt csúsztatnak rajta (felfele), hogy kijöjjön egy szép kerek szám, és ezzel "elkészült az ár."

Ebben a folyamatban át sem fut a fejükben, hogy mennyibe is került a HW. Az a beszerzés és a K+F dolga. Az árazás pedig a marketingé.

-

HSM

félisten

válasz

Petykemano

#45961

üzenetére

Petykemano

#45961

üzenetére

"akkor tessék nem ennyire spórolni a waferral"

Első olvasatra maximálisan egyetértettem ezzel a gondolatoddal. Aztán jobban belegondolva, hogy vajon miért nem ezt lépték, az jutott eszembe, hogy ha ezt a GPU-t tényleg nagy tömegekben akarják adni, akkor azért a gyártókapacitások végessége miatt lehet, hogy mégis érdemes lehet józan keretek között spórolni a mérettel. Hiába nem lenne lényegesen drágább, ha mondjuk lényegesen kevesebbet tudnának belőle legyártani, ami az OEM-ek (laptopok, előre összeszerelt gépek) piacán elég komoly versenyhátrány lehet, gondolva arra, hogy akár komoly megrendelésektől eshetnek el, ha nem képesek nagyobb rendeléseket időre leszállítani. Ahogy láthattuk a korábbi 4000/5000-es Ryzen CPU-k esetén, hiába voltak ilyen notebookok, elég nehéz volt őket évekig beszerezni, gyakran hónapokig kellett várni, mire leszállították a megrendelt gépet, mivel nem volt kellő mennyiségben elérhető a CPU. -

Petykemano

veterán

válasz

Petykemano

#45925

üzenetére

Petykemano

#45925

üzenetére

Abu az Nvidia találgatósban újra elmondta, hogy milyen olcsó az N6. És hogy azért tartotta N6-on az AMD a Navi33-at, meg más budget termékeket, mert olcsó.

Azt a kérdést akartam neki feltenni, hogy akkor ugye lehet olcsó a Navi33? Mármint $400 alatti.

Persze az AMD találgatósban is felmerült már ez a kérdés és többen azzal csaptátok le, hogy álmodozás, hogy az árak visszacsökkenjenek a kriptóboom után.

Az Nvidia találgatósban megemlítésre került, hogy fless számolgatott is. Nyilván nem tudom sem megerősíteni, sem megcáfolni a számait. Nem is ez a célom.

Az jutott eszembe arra, hogy a Navi33 lehet-e olcsóbb, hogy "jójó, a wafer lehet, hogy olcsóbb, de hát ott a sok más költségtétel, a board, a hűtő, a VRAM, ami azért még relatíve drága - drága ahhoz, hogy a termék akármilyen wafer árral se lehessen olcsó."

És épp ezért ide írom és nem a két találgatós valamelyikbe, ahonnan a fenti info-morzsák származnak.

Mert a gondolatot továbbvive valahogy elképzelhetetlennek tartom, hogy miközben néhány negyedév alatt megfeleződött a dGPU kereslet, hogy ez ne legyen hatással az egyéb komponensek - board, hűtő, VRAM - árára. Persze nem feltétlenül azonnal.A másik megjegyzésem pedig az, hogy ha esetleg az összes komponens közül a wafer vált az olcsó tényezővé, akkor tessék nem ennyire spórolni a waferral. TEhát akkor nem azt kell csinálni, hogy egy 200mm2-es lapkát húzunk 250W-ig, hanem egy 250W-os kártyába teszünk egy alacsonyabb órajelen járatott (nem túlhúzott) 350mm2-es lapkát és máris ott a teljesítménytöbblet.

-

paprobert

őstag

válasz

Petykemano

#45954

üzenetére

Petykemano

#45954

üzenetére

Szerintem hullámoztatva volt az ár. Tavaly, a sajtóból az "AKCIÓ VAN" hírek előbb jöttek, mint hogy a valódi akciók egyáltalán megjelentek.

A valódi akciók egy igencsak visszafogott leárazást jelentettek pár hónapon keresztül.

Hiába, a kétszeresre kúszott árból 15%-ot engedni még mindig jó biznisz.

Mostanra pedig a kereslet kapott egy olyan lendületet, hogy akárcsak egy lavina, van akkora inerciája, hogy akár vissza is lehet emelni az árat, el fog fogyni a maradék termék, amelyet az új generációs áremelés(magasabb kategóriás lineáris felárazás) ugyancsak racionalizálni tud.

-

HSM

félisten

válasz

Petykemano

#45952

üzenetére

Petykemano

#45952

üzenetére

"miért jutnak mindig arra a következtetésre ... miért nem hozza ki azt a számológép, hogy ha beleállnak a versengésbe, akkor az a nagyobb volumen miatt ... eredményez nagyobb hasznot"

Mi van akkor, ha nem foglaltak le ehhez elég kapacitást? A 7900XTX pl. elvileg elég foghíjas készletek tekintetében, ami arra utal, hogy a kereslet/kínálat többé kevésbé egyensúlyban van a mostani árakon.... Az is érthető, hogy ha nem sikerült tökéletesen az első revízió, akkor nem fognak a szükséges minimumnál többet legyártani belőle, és inkább a jól sikerült Zen4-ből készítenek többet.#45953 b. : "arról volt szó az AMD lényegesen olcsóbban gyárt a Chiplet miatt"

No, de mihez képest? A 4090-hez képest egészen biztosan, a 4080-hoz képest talán, a 4070 Ti-hez képest egészen biztosan nem.#45956 b.: "A 4090 és a 4080 sem teljes értékű, de azonos GPU ra épül .Szerintem túl nagy különbség nincs köztük gyártást nézve."

4090: AD102, 608 mm², 384 bit

4080: AD103, 379 mm², 256 bit

Gyártási költségben ez igen jelentős.....

"Jó példa erre a 900 dolláros 3090 Ti"

Nem jó példa a készletkisöprős akciós ár. A 2000$-os MSRP inkább iránymutató.

A 2000$-os MSRP inkább iránymutató. -

Raggie

őstag

válasz

Petykemano

#45957

üzenetére

Petykemano

#45957

üzenetére

Igen, de ha a "nem tudnak" kifejezés helyére a "nem akarnak" kifejezést tesszük máris reálissá válik a feltételezésem. Azt nem tudom, hogy miért ne akarnának többet gyártani, de egy tippem erre az, hogy az adott szilícium területből jóval nagyobb haszon margó sajtolható ki CPU-kkal, mint VGA-kkal...

-

válasz

Petykemano

#45954

üzenetére

Petykemano

#45954

üzenetére

Szerintem az általam leírt konteókból nagyjából semelyik állítás nem igaz illetve rész igazságok vannak mögötte. Tehát az AD 102 és 103 közel azonos profitra hozható ki eladásilag( per sku, nem úgy átlalában volumenre értve, abban biztos hogy Nvidián keresnek igazából jelentős összegeket) vele egy szinten lévő AMD lapkákkal.

Valószínűleg AMD nagyobb árrést ad az AIB partnereknek az Nvidia meg lényegesen nagyobb volument hoz.

A 4090 és a 4080 sem teljes értékű, de azonos GPU ra épül .Szerintem túl nagy különbség nincs köztük gyártást nézve. Biztos van kisebb nagyobb eltérés de nem hiszem hogy akkora összegről beszélünk gyártás szintjén, ami jelentősen befolyásolná a besorolási árazásukat még VRM és PCB szintjén sem.Jó példa erre a 900 dolláros 3090 Ti...

Valószínűleg AMD-t és Nvidiát is súlytotta a nagy raktárkészlet de Nvidiát felvásárolták, AMD a kisebb raktárkészlettel lassab forgási sebeséggel( A hirtelen elbillent piaci részesedés erre utal) lehet egalizálta a piac a dolgot de igazából értelmes áron már alig / szinte nincs is Ampere/ RDNA2 kártya ,nagy SKU-k. úgy az EU piacot is nézve, Raymond linkjei alapján.- nem vagyok meggyőződve az utolsó bekezdésedről, de nem tartom kizártnak.

-

Raggie

őstag

válasz

Petykemano

#45954

üzenetére

Petykemano

#45954

üzenetére

Én látok egy harmadik esetleges magyarázatot is: hiába szeretnék növelni a volument, mert nem tudnának eleget gyártani belőle.

Inkább fordítva történt a számítás: kiszámolták, hogy kb mennyit tudnak gyártani a VGA modellekből és ahhoz méretezték a teljesítményt és árat.AMD kártyákat is alig kapni bárhol, elviszik az összeset. Ahol mégis van ott 1400-1600 EUR. Tehát bőven MSRP, de még az MSRP+vám/ÁFA fölött is.

(német webshopokban is ez a helyzet)

(RX 7900 XTX-et néztem) -

válasz

Petykemano

#45952

üzenetére

Petykemano

#45952

üzenetére

Na igen nem védve az nvidiát de burkoltan mégis a felsorolt érvek némileg konteót nyújtanak arra miért is van most ez( talán) náluk...

- arról volt szó az AMD lényegesen olcsóbban gyárt a Chiplet miatt, [link] (L:https://prohardver.hu/tema/amd_talalgatos_topik_2/hsz_58248-58248.html)[link](/L)rengeteg plusz előrendelés van amit ha vissza mondanak akkor buknak inkább termékbe legyártják. ( ergo Nvidia sokkal drágábban gyárható, abu szerinta 7900XTX az AD103 nál is[link]

- arról volt szó hogy az AMD nek nincsenek akkora hatalmas felhalmozott előző genes készletei mint Nvidiának.[link] ( Nvidinak nagy készletei vannak márciusig Állítólag ( alig kapni már 3080 és az fölötti kártyát.)

- Arról volt szó hogy Amd történelmi mélyponton van piaci részesedés tekintetében. ( Nvidia csúcson van 88 % is volt állítólag)

- nem a GPU és VGA gyártás a fő profitja( Nvidiának kizárólag)Tehát akkor mi a szarért aszisztál ehhez?

Milyen piaci logika diktálja ezt?

vagy afelsorolt hozzászólások mind mellétrafálások voltak és AMD nek is nagy a raktárkészlete vagy Nvidiának is elfgyott ami volt, plusz az RDNA 3 lehet hogy még sem gyáérható olyan olcsón vagy az Ada mégis csak jó áron gyártható?

Abu nem győzi kihangsúlyoznia cikkekben és a topik hozzászólásaiban Nvidia mennyire kiszolgáltatott AMD nek mert ezt nem engedik meg neki meg azt nem engedik,meg nó a CPu ban, meg miért nincs CPU nekik mert amúgy kampó,mindenki függ az AMd től és őket követi fejlesztésben stb... tehát ergó ők diktálnak nem? Ezt mondja a paraszti eszem.

Nvidia úgy csinálja hogy a 3080 10 GB 699$ MSRP ennél 20- % kal gyorsabb a 4070Ti 799$ MSRP és így tovább tehát kb márciusig ez lesz a felállás. Ha mégis lenne felhalmozott készlet az AIB oknál, mert erről cikk is született hogy sírnak mert nagy a készlet és nem akarják hogy Nv bedobja még az Ada-t, [link]hát beillesztette a régi porfólió fölé. De AMD ? Vagy talán akkor ez sem igazán a vaólóság? -

válasz

Petykemano

#45950

üzenetére

Petykemano

#45950

üzenetére

Most ezek után ha szerinted a 7900XT 899$ árán nem fanyalgott senki akkor a 4070Ti kb hasonló teljesítményén fog majd sopánkodni valaki 799$ áron?

Ezzel az árazással ( meg a hűtő balhéval) AMD előkészítette a terepet a kártyának. ( Mond hogy ezek után is kétségeid vannak a két cég összejátszásáról. Mindkét kártya azonos, 899 dolláros áron jött volna.

AMD nél + 8 GB ram, Nvidiánál némi RT előny, némi fogyasztáselőny, nagyrészt 5

% teljesítményen belül oda vissza )

Amúgy CB is meg több oldal pont az árazást miatt írta hogy nem egy kiemelkedő kártya.[link]

Nem véletlenül őket nézem elsőnek teszteknél. -

válasz

Petykemano

#45925

üzenetére

Petykemano

#45925

üzenetére

Szimplán az árazás pofátlan még a fejlet nyugat többségének is, és ez egy remek hír. Csak így tovább, csak így lehet ilyen árazás ellen tenni.

-

Devid_81

félisten

válasz

Petykemano

#45925

üzenetére

Petykemano

#45925

üzenetére

Megerdemlik mind, ennyit tudok hozzatenni.

Majd most amikor a kozepkategoria is $1000-be kerul az fog meg egy nagyot alajuk rugni.

-

HSM

félisten

válasz

Petykemano

#45900

üzenetére

Petykemano

#45900

üzenetére

"Ez megvalósulhat úgy is..."

Természetesen. A lényeg, hogy a magok elég gyorsan, kis késleltetéssel tudjanak adatot cserélni egymás között.

Anandék szoktak ilyen méréseket csinálni, legyen itt szemléltetni 5950X vs. 3950X vs. 12900K vs. 13900K: [link] [link] .

Játékoknál sok az összefüggő adat, sok az adatcsere, ezért háklisabb erre, mint pl. egy renderelés, ahol sokkal jobban függetleníthetőek a részfeladatok. -

paprobert

őstag

válasz

Petykemano

#45893

üzenetére

Petykemano

#45893

üzenetére

#45893 Petykemano

" és úgy tűnik, nemsokára eljön a pillanat, amikor 12-16 magos processzort kell majd játékra venni."

Az a baj, hogy ez nem lenne gyorsabb 16 maggal sem, mert itt az egy szál limitál.Amúgy jól látod, amint lett elég mag mindkét gyártónál, megint az egy szálas tempó lett az a tulajdonság, ami a differenciál a termékek között játékra (+ az effektív latency).

""minek vegyek drága sokmagos CPU-t, ha ott a DLSS3, ami megvéd a CPU limittől", úgy legalább annyira érvényes mondás lehet, hogy "minek használják DLSS3-at a CPU kíméletének céljából, ha egyébként van elég erős CPU elérhető áron"

Egyelőre nincs olyan CPU amire ezt rá lehetne mondani, hogy elég erős egy szálon, és ez sajnos nem ár függvénye. Egyszerűen nem létezik.

Az AMD-nek jól jön a kisebb DX12-es driver overhead, de az nem tud egy képkocka-duplázást behozni (másnéven ha a GPU teljesítménynek legalább a felét bennehagyja a CPU), a 10-20-30% ahhoz kevés.

#45894 HSM

"A probléma, hogy nem véd meg, a linkelt videóból is tisztán látható, hogy az input lag még nőtt is, nemhogy nem csökkent a DLSS3-tól."

56-ról 59 ms-ra. -

HSM

félisten

válasz

Petykemano

#45893

üzenetére

Petykemano

#45893

üzenetére

A 2017-es Ryzenen nem sok értelme volt a sok magnak játékokra, mert CCX-ekre darabolva a magok fele csak dísznek volt jó a legtöbb játékban.

Most is ugyanez látszik, az 5800X3D szinte mindig előrébb végez, mint pl. az 5900X. Persze, nem lehetetlen, hogy idővel ez változzon, de azért van bennem nagy adag szkeptikusság ezzel kapcsolatban."ott a DLSS3, ami megvéd a CPU limittől"

A probléma, hogy nem véd meg, a linkelt videóból is tisztán látható, hogy az input lag még nőtt is, nemhogy nem csökkent a DLSS3-tól. Lehet, a darabosság élményén javít, de a karakter irányításának az élménye ekkora késéssel nehezen tudom elképzelni, hogy kellemes legyen."Felmerült bennem még az a kérdés is, hogy vajon a CPU terhelése AMD kártyával is ilyen magas?"

Tegnap kipróbáltam a játékot egy RX 6800XT-vel. WQHD maxon, kimaxolt RT-vel volt kb. 20-30 FPS-em FSR meg hasonló marhaságok nélkül, CPU-limitnek nyoma sem volt az 5600-as Ryzenemmel. Hasonló számokat láttam amúgy másoktól is RTX3070-ekkel, szóval a szokásos RT-tempót hozta a Radeon.

Hasonló számokat láttam amúgy másoktól is RTX3070-ekkel, szóval a szokásos RT-tempót hozta a Radeon.

A képi világ számomra nagyon meggyőző volt, szívesen hagynám bekapcsolva az RT-t is, látszik a hatása, bár nem biztos, hogy ennyi FPS-el akarom majd kínozni magam.

Egyébként a tesztben arra jutottak, nem az tűnik a bajnak, hogy erős CPU kellene alá, hanem hogy kevés magra összpontosul a terhelés, és valami más baj is van, mert ugyanazt az RT nélküli képvilágot a DX11 mód lényegesen magasabb FPS-el hozza. Ebből az látszik, inkább a kódbázison lenne még tennivaló a motorban.

-

Yutani

nagyúr

válasz

Petykemano

#45840

üzenetére

Petykemano

#45840

üzenetére

Igen, erre, mint a Vegák esetén, egy hordozóra a GPU-val együtt.

-

Yutani

nagyúr

válasz

Petykemano

#45837

üzenetére

Petykemano

#45837

üzenetére

Kicsit kellett nézegetnem, mire felfogtam, hogy itt konkrétan egyetlen memória IC-ról van szó, azon belül eddig egy belső PCB-re tették a chipeket, most pedig egy szilícium ostyára szerelik a chipeket, ezért lesz alacsonyabb és költséghatékonyabb.

Továbbgondolva: ezt a memória típust is lehetne GPU mellé építeni talán, mint a HBM-et.

-

válasz

Petykemano

#45837

üzenetére

Petykemano

#45837

üzenetére

Ebbe azért van nem kevés marketing BS is, de jó lesz.

Várjuk az első fecskét.

-

Yutani

nagyúr

válasz

Petykemano

#45761

üzenetére

Petykemano

#45761

üzenetére

Akkor nemsokára várhatjuk Steve-től vagy Linus-tól a tesztet.

-

válasz

Petykemano

#45743

üzenetére

Petykemano

#45743

üzenetére

Nem nagyon látok változást a 4090 és 3090 hűtők között. Szerintem egyszerűen megtartották az előző generációs hűtőket azok 500 wattos 3090 Ti-ket is kis túlzással de lazán hűtötték.

Giga, Asus, MSI, Inno nem igazán változtatott ha megnézed képeken a 4090 és a 3090 kártyákat. -

válasz

Petykemano

#45740

üzenetére

Petykemano

#45740

üzenetére

Mert 800 wattig fel lehet húzni. Valószínűleg a 4090 Ti 5-600 W körül fog menni.

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Óvodások homokozója

- Amazfit Active 2 NFC - jó kör

- Graphics: Telefonvásárlási kálváriám....avagy clickbait cím: Horror a hardveraprón

- Kerékpárosok, bringások ide!

- Gitáros topic

- Parkside szerszám kibeszélő

- D1Rect: Nagy "hülyétkapokazapróktól" topik

- One otthoni szolgáltatások (TV, internet, telefon)

- EAFC 26

- Xiaomi 14 - párátlanul jó lehetne

- További aktív témák...

- Dell Latitude 5410 - 14" FHD touch, Core i5 10310U, 16GB RAM, SSD, jó akku, számla, 6 hó gar

- Eladó EDIFIER ES prémium hangszórók ES300 / ES60 / ES20

- AKCIÓ! Asrock Z270 i7 6700K 16GB DDR4 512GB SSD RTX 2060 6GB GameMax Storm 2 AB Adata 600W

- ÁRGARANCIA! Épített KomPhone Ultra 9 285K 32/64GB RAM RTX 5070 Ti 16GB GAMER PC termékbeszámítással

- ÁRGARANCIA!Épített KomPhone Ryzen 7 9800X3D 64GB RAM RTX 5090 32GB GAMER PC termékbeszámítással

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

Főleg most, amikor ez így működik már amióta ez a Turbo rendszer be lett vezetve a Sandy Bridge óta.

Főleg most, amikor ez így működik már amióta ez a Turbo rendszer be lett vezetve a Sandy Bridge óta.

Abból a szempontból értem, hogy ezek a legkisebb TCO2, és legnagyobb teljesítmény, de így úgy tűnik, mintha ezek minden további nélkül összehasonlíthatóak lennének...

Abból a szempontból értem, hogy ezek a legkisebb TCO2, és legnagyobb teljesítmény, de így úgy tűnik, mintha ezek minden további nélkül összehasonlíthatóak lennének...

Igen, egy 71W-os, ehhez képest csigalassú 14nm+++++ CPU

Igen, egy 71W-os, ehhez képest csigalassú 14nm+++++ CPU

Hasonló számokat láttam amúgy másoktól is RTX3070-ekkel, szóval a szokásos RT-tempót hozta a Radeon.

Hasonló számokat láttam amúgy másoktól is RTX3070-ekkel, szóval a szokásos RT-tempót hozta a Radeon.