Hirdetés

- Xiaomi Mi 9T Pro - tizenegyes!

- Xiaomi 15T Pro - a téma nincs lezárva

- Külföldi prepaid SIM-ek itthon

- One mobilszolgáltatások

- Milyen okostelefont vegyek?

- iPhone topik

- Samsung Galaxy S25 Ultra - titán keret, acélos teljesítmény

- Nagy aksival és erős hardverrel megjött Magyarországra a Poco X8 Pro és Pro Max

- Poco F5 - pokolian jó ajánlat

- VoLTE/VoWiFi

Új hozzászólás Aktív témák

-

S_x96x_S

addikt

> . leírtam hogy a PS5 esetén is fel lett vázolva hogy az SSD miatt a PC hátrányba lesz,

A PS5 megjelenéskor - a Kraken hw-res tömöritéssel növelt "raw bandwith"-et nézve,

tényleg hátrányban volt a PC."At the moment, Sony won’t cop to exact details about the SSD—who makes it, whether it utilizes the new PCIe 4.0 standard—but Cerny claims that it has a raw bandwidth higher than any SSD available for PCs. That’s not all. “The raw read speed is important,“ Cerny says, “but so are the details of the I/O [input-output] mechanisms and the software stack that we put on top of them. "

-

S_x96x_S

addikt

Amit te írsz az pedig nem ez, hogy nem lesz szűk keresztmetszet az SSD sebessége mert ez nem is volt az. Teljesen másról beszélsz.

Azért ezt mégis te irtad:

#51477"Jelenleg még a PS5 SSD korlátját sem tudták elérni, úgy hogy a végét járja a konzol pályafutása. Kihasználni sem használták ki egy játékban sem, még a demózottak se futottak rosszabbul egy átlagos SSD-s PC-n.. pedig arról volt szó hogy az limitálja őket. Gondolom, hogy majd az 50TB/s lesz a korlát PC-n..."

A “nem érték el az SSD korlátját” nem cáfol semmit se,

hanem pont azt jelenti, hogy még nem az SSD a bottleneck.A hardver limitje akkor érdekes, amikor már beleütköznek.

Addig meg az látszik, hogy van benne tartalék.

Ha viszont tényleg elérik a plafont, az már nem érv, hanem baj.> leírtam hogy a PS5 esetén is fel lett vázolva hogy az SSD miatt a PC hátrányba lesz,

PS5 extra i/o tartaléka , a PS4 extrém lassú i/o-ja miatt kapott prioritást,

amire már mindenki panaszkodott.És éppen az,

hogy a PS4 - teljesen kihasználta a diszk sávszélességet

volt az igazi probléma - mert már mást is limitált.És most mennyivel jobb a PS5 -ben lévő tartalék.

És éppen az az egészséges hogyha van tartalék."The larger a game gets—last year’s Red Dead Redemption 2 clocked in at a horse-choking 99 gigabytes for the PS4—the longer it takes to do just about everything. Loading screens can last minutes while the game pulls what it needs to from the hard drive. Same goes for “fast travel,” when characters transport between far-flung points within a game world. Even opening a door can take over a minute, depending on what’s on the other side and how much more data the game needs to load. Starting in the fall of 2015, when Cerny first began talking to developers about what they’d want from the next generation, he heard it time and time again: I know it’s impossible, but can we have an SSD?"

-

S_x96x_S

addikt

>Már a múltkor is előnyként vázoltad hogy a porhintett ultra gyors PS5 SSD nincs kihasználva, mert így legalább nem limitál

( azt hittem lefejelem a képernyőt)

( azt hittem lefejelem a képernyőt)A tartalék azt jelenti, hogy nem limitál

- és ez is volt a publikus célja a Sony-nak.

Hogy túlbiztosították-e ilyen szinten a PS5 -öt ?

Az majd a PS6 megjelenése után 4 évvel kiderül, mert addig fognak kiadni rá játékokat.

( de szerintem a Gen3 -as SSD már most is egyre inkább limitálná az új játékok tervezését )---

az UE eg kicsit le van maradva, de a roadmap -ből és a fejlesztési colkoból

egre inkábblátszik az egyre agresszivabb streaming,

Másképpen a jövőbeli UE5 játékok - egyre jobban fognak profitálni a jó PS5 I/O - ból,"Watch this session recorded at Unreal Fest Orlando 2025 and find out about the UE5 streaming improvements for dense worlds showcased in The Witcher 4 Unreal Engine 5 Tech Demo. You’ll learn about the significant improvements that have been made to performance in UE 5.6 when streaming static content in and out at runtime. With the Fast Geometry Streaming Plugin (Experimental), you can have a greater amount of immutable static geometry in your worlds that will load faster with constant frame rates. Additionally, all projects will benefit from further improvements over content streaming such as asynchronous physics state creation and destruction."

---

De amúgy hasonló logika alapján

egy RTX 5090 32GB -ban sincs kihasználva játékok esetében a memória,

vagyis van benne tartalék. -

szarnyasdino

tag

-

Abu85

HÁZIGAZDA

Nem hiszem, hogy a régi konzolárak élni fognak az új generációban. A következő generációnál inkább a 700-900 dolláros szint fog dominálni. Már most szó van arról, hogy a next-gen PC-s GPU-k is drágábbak lesznek. Ami most 400 dolláros szint, vagyis a tipikus 128 bites középkategória, az a következő körben 800-1000 dollár lesz. A mostani prémium olyan 1500-1800 dollár felé halad.

Mindennek az ára masszívan elindul felfelé, mert drágább lesz a gyártás, több befektetést igényelnek a fejlesztések, és a waferár is csak nő.

-

PuMbA

titán

Nekem a DLSS 5 bejelentésével, ami ugye nem felskálázó!, valahogy az az érzésem lett, hogy ez a felskálázás dolog elért egy plafont a jelenlegi hardverekkel, ahonnan nehéz lesz továbbmozdulni

Ugye már a DLSS 4.5 sem egy általános dolog, hiszen Performance módban aktiválódik csak, arra ajánlja az NVIDIA. Quality módban DLSS 4 maradt. Most, hogy az FSR4.1 ennyire közel került a DLSS felskálázáshoz, eléggé “megakadt” a felskálázó rivalizáció. Koránt sem FSR3.1 kontra DLSS 3.5 szinten vagyunk, amikor tényleg nagy különbségek voltak.

-

S_x96x_S

addikt

> Jelenleg még a PS5 SSD korlátját sem tudták elérni, úgy hogy a végét járja a konzol pályafutása.

De ez éppen előny és nem tervezési probléma

Mert hála az extra Kraken-es hw-res tömörítésnek + IO -nak

annyi tartalék van a disk io -ban, hogy nem az a szűk keresztmetszet.

és így a GPU-t se fogja vissza , vagyis a tervezők jól dolgoztak.Ellenben a PC-n - a Gen sávszél erősen limitálhat

és ha nincs tartalék akkor az szívás

és kimérhető még a Gen5 vs Gen4 között is

> egy átlagos SSD-s PC-n.. pedig arról volt szó hogy az limitálja őket. Gondolom, hogy majd az 50TB/s lesz a korlát PC-n...

AI ... AI ... AI ... AI ....

vagyis kihagyod az AI -t a számításból, mert a jövőben arra is lehet használni.

"LLM in a flash: Efficient Large Language Model Inference with Limited Memory"

https://arxiv.org/abs/2312.11514 (Apple )és éppen ez a trendi téma a HN- on.

"iPhone 17 Pro Demonstrated Running a 400B LLM"

https://news.ycombinator.com/item?id=47490070 -

szarnyasdino

tag

-

Abu85

HÁZIGAZDA

Egyrészt ezek kikapcsolható dolgok. Ha veszel új hardvert bekapcsolod, ha nem, akkor kapod az effekt nélküli grafikát. Másrészt ha valaha is akarunk komolyabb neurális eljárásokat, akkor nincs más út, mint megoldani azt a problémát, ami miatt ma nincsenek ilyen eljárások, ez pedig a sávszélesség problémája.

Azon vitázhatunk, hogy valóban a neurális leképezés-e a jó út, de egyelőre a Sony és a Microsoft is így látja, tehát ez maximum egy userek közötti vita lesz.

-

Abu85

HÁZIGAZDA

Ez egy teljesen eltérő probléma. De segítek megérteni. Tegyük fel, hogy van egy GPU-d, aminek a memória-sávszélessége mondjuk 1 TB/s, FP8 mellett pedig mondjuk 600 TFLOPS-ra képes a mátrixfeldolgozója. Ha még fel is osztod a tartalom feldolgozását mozaikokra, akkor is nagyon kicsi mozaikok kellenek, hogy ne a sávszélesség legyen a limitáció, és ilyen kis mozaikok mellett jelentős számítási overhead van, hogy jól összeilleszthető legyen a végső kép a mozaikokból. Tehát a mostani működési modellel legjobb esetben is eldobod a hardverben rejlő számítási teljesítmény legalább 70%-át, mert olyan adatokat számol ki, amelyeket végül nem használsz majd fel a megjelenő képhez. Ha viszont az overheadet csökkented, hogy több kiszámolt adatot hasznosíts, akkor nagy lesz a mozaik ahhoz, hogy a számítás ALU-limitált legyen, vagyis nem fogja a hardvered elérni a beletervezett 600 TFLOPS-ot, hanem teszem azt 200-250 TFLOPS-ot hoz belőle, mert a memória elérési sebessége limitálja a skálázást.

Ezért van az, hogy a nagy AI gyorsítók HBM-et használnak, mert kell a több 10 TB/s, csak ez végfelhasználói szinten nem realitás, senki sem fogja megvenni az 6000 dolláros VGA-t, a 3000 dolláros középkategóriáról nem is beszélve.

Emiatt a következő körben okosabbnak kellett lenni, így már a Sony-nak felmerült az az ötlet, hogy itt igazából csak a memóriabusz a szűkös, de ha a számítások eredményei nem kerülnek erre a buszra, hanem a GPU-n belül maradnak, akkor van 200 TB/s-od is. És ez született a PS5 Pro nagy felfedezéséhez, hogy bizony ezeket a számításokat nagyrészt a GPU-n belül lehet tartani, hogy ne is terheljék a memóriabuszt. De ez a koncepció, amihez azért kellett hardveres változás is, még egyik PC-s GPU-ba sem kerül

implementálásra. Viszont a következő generáció már erről fog szólni, mert túl jó dizájnötlet ez, hogy elmenjenek mellette a cégek. Csakhogy ez automatikusan azt jelenti, hogy olyan nagy lesz a különbség a next-gen és a jelenlegi dizájnok között, hogy a next-gen effekteket a jelenlegi hardverek nem fogják tudni jól futtatni, még akkor sem, ha a kód amúgy kompatibilis lenne. Ez egyébként érthetően marha gáz, de ahhoz, hogy grafikailag előrelépjünk szükségünk van ezekre a hardveres képességekre. Aztán, ha valaki nem akarja őket, akkor nem futtatja a legújabb effekteket és játszik az alap minőségen. Ez se baj, nyilván erre is lehetőség lesz. -

Abu85

HÁZIGAZDA

Az új Xboxhoz tervezett megoldások egyetlen ma elérhető GPU-n sem fognak futni. Egyszerűen a Microsoft nem arra viszi az API-t, hogy fussanak, mert nem jól vannak felépítve a mostani hardverek. Mindegyik rossz ilyen szempontból. Az RDNA 4 is, a Blackwell is. Mind kuka lesz az új effektekkel.

Az AI irány legnagyobb gátja ma az, hogy lassú a VRAM elérése. Amelyik hardver nem kínál legalább 50 TB/s-ot valamilyen belső memória felé, az nem lesz jó az Xbox effektjeihez.

Nem véletlen amúgy, hogy a Sony is ugyanerre viszi a saját dizájnját. Ők is ott érzik magukat limitálva, hogy VRAM-ból nem lehet 50 TB/s-ot építeni. Hiába van több ezer TOPS-od, ha nincs hozzá sávszélességed. Érdemes egyébként megnézni a PS5 Pro dizájnját ilyen szempontból, mert a Sony és a Microsoft is ezt tekintette 0. generációnak. Az új Xbox és PS is a PS5 Pro koncepciójának továbbfejlesztése lesz. Bármennyire is fura a PS5 Pro egyedi GPU dizájnja az első, ami megoldotta ezt a jelentős problémát, csak ugye ez a dizájn PC-re sehol se lett átmentve. A következő generáció valószínűleg átmenti, és nem csak az AMD oldalán, mert rendkívül hasznos a koncepció.

-

PuMbA

titán

Amúgy tényleg tök érdekes ez a két kép. Én semmiben nem vettem észre, hogy az FSR 4.1 részlettelenebb lenne, de meg fogom nézni megint Cyberpunk 2077 alatt

Utak, épületek, emberek, tükröződések, mindenhol nagyon részletes textúrákat láttam csak.

Utak, épületek, emberek, tükröződések, mindenhol nagyon részletes textúrákat láttam csak.Azt is el tudom képzelni, hogy az AMD nem tud két képet rendesen megcsinálni, hiszen láthattunk már hasonló bénázásokat tőlük. A marketing csapatuk nincs a magaslaton.

-

PuMbA

titán

-

PuMbA

titán

Jó lenne, ha ki lehetne kapcsolni a Ray Reconstruction-t PT esetén és úgy csinálni egy összehasonlítást

Egyébként már félig megcsinálták modderek, mert fut 9070XT-n a PT mód, de csak denoiser nélkül, tök jó sebességgel, van róla YouTube videó. Borzalmasak ezek a mesterséges korlátozások.

-

S_x96x_S

addikt

> A jelent hasonlítod egy 3-4 év múlva piacra kerülő konzolhoz.

ha Kepler-nek igaza van,

( "both Xbox and PS6 are still in track for Holiday 2027" )

akkor az eredeti menetrend

2027 ünnepek ( és az pontosan 1,5 év )---- [ fikciós visszakövetkeztetés ] ----

2027.03 ( T-6 hónap)

Vagyis 2027 tavaszától minden arról fog szólni a szaksajtóban, hogy az új konzolok ( + RDNA5)

- milyen képességűek

- mennyi VRAM-al rendelkeznek

- és mibe kerülnek majd.

- és mennyire jövőálló a 8Gb /12GB / 16GB VRAM.És a Sony / Microsoft / AMD -is telinyomja a sajtót az új infókkal,

aminek az a célja, hogy egy átlagos vásárló elcsábuljon

( és nehogy beruházzon egy 12GB vagy 16GB - os GPU-ba,

vagyis halassza el a vásárlást és adjon esélyt egy konzolnak, RDNA5 / XBOX-PC-nek )

a prohardver fórumain azon megy a vita,

hogy egy új gaming PC-nek érdemes-e az XBOX-PC-t választani )

( jövőállóság szempontjából )

vagy még mindig jobb egy nvidia alapú megoldás.2027.05:

Az Nvidiánál a fejesek összeülnek,

hogy milyen ellenkampányt tudnak

az eladások fenttartása érdekében.És addigra

a DLSS 5.5 "Neural rendering" -nek

szépen és kiforottan müködnie kell 40-50 játékban.

( és addigra várhatóan cipőskanállal belefér a 16GB VRAM-ba is )Vagyis az nvidiánál fel kell készülni

a konzol riválisok legjobb bevezetési stratégiájára

és arra egy jó válasz stratégiát kell kihozni.A FŐ KÉRDÉS, HOGY

AZ NVIDIÁNAK KELL-E REAGÁLNIA AZ ÚJ KONZOLOKRA VAGY SEM.

MIT JAVASOLNÁTOK JENSEN-nek ?> A Valóság pedig megcáfol évek óta, de nem akarsz mégsem tanulni

Mert te már tudod, hogy az RDNA5 és az AMD konzol stratégiája nem fog működni ? Mert az asztrológia nem téved?

Nehogy már komolyan vedd magad.![;]](//cdn.rios.hu/dl/s/v1.gif)

----------------

A jövő kiszámíthatalan,

és a valóságot csak úgy tudod (részben) alakitani,

hogyha felkészülsz az összes lehetséges forgatókönyvre.

[ Scenario Modeling 101 ]A múlbéli adatokra alapozott érvelés - amolyan Pulykás érvelés

ha nem ismernéd :""""

A pulykát nap mint nap etetik. Az első napon, a tizediken, sőt a századikon is az a tapasztalata, hogy az ember jóindulatú, és az etetés az élet része. Minden egyes nappal nő a pulyka bizalma abban, hogy a következő nap is ugyanúgy fog telni. A statisztikai adatok (100 nap tapasztalata) azt mutatják, biztonságban van.

Aztán a 101. napon, közvetlenül a hálaadás előtt, a pulyka számára eljön a Fekete Hattyú: az addig gondoskodó ember elvágja a nyakát - és ott találja magát a tepsiben.

tanulság, hogy a múltbeli adatokból (100 nap) nem lehet biztonsággal megjósolni a jövőt.

"""""

-

S_x96x_S

addikt

> Az egyik legsikeresebb konzol Nvidia hardverrel fut.

És futni fog rajta a DLSS5?

amúgy a Nintendó elég jó,

https://en.wikipedia.org/wiki/List_of_best-selling_game_consoles

De ha a jelenleg a piacon lévőket nézed, ( zöld háttérrel kiemelve )

Akkor az amd alapú PS4+PS5+XBOX - ok

együttes darabszáma meghaladja még a nintendóét is.A gaming piac - elég tág.

( konzol, pc, mobil handheld, android, ios, macos, ... )Csak a Sony PSN havi aktiv userek száma ~132 millió,

ami megközeliti a Steam userek számát. ( 132 - 147 millió )"User engagement trended well in Q3 FY25, with Monthly Active Users* in December reaching a record 132 million accounts and total gameplay hours increasing year-on-year.

*Monthly Active Users is an estimated total number of unique accounts that played games or used services on the PlayStation Network during the last month of the quarter and is based on company research and may be updated in the future."> A gaming PC piac 90 % része Nvidia hardverrel fut.

Mégha ez igaz is ( de most ne menjünk bele definiciós és módszertani problémákba )

Szerinted ez az arány

- a PC-s XBOX és

- az RDNA5 -el is

megtartható?

Mert szerintem nem.>Manapság egy átlagos gaming PC ben is 24 GB-tól 48GB-ig terjedő ram van, az enyémben 80 GB pl.

és egységes és egyformán gyors ?

és 100%-ig kihasználják a játékok ?

szerintem nem.mert az új konzolok lényege -

- 32-48 GB GDDR7 + unified memória

és amiatt küzd az nvidia,

hogy az ACE és a DLSS5 beleférjen a relative pici és fix VRAM-ba. -

S_x96x_S

addikt

> Az Nvidia erre építette fel a birodalmát a gépi tanulásra 10 év alatt.

És ?

A NOKIA meg a mobiltelefonra.

az IBM meg a PC-kre

az Intel meg az x86 -ra

és még lehet folytatni.Nincs örökös foglalt hely a csúcson.

És a csúcson nem lehet megpihenni.

> nevetséges hogy az Nvidián van nyomás ebben.

Éppen arról szeretnélek, meggyőzni,

hogyha az nvidia elpul, akkor pikk-pakk utolérik a versenytársak.szerintem elég tanulópénz volt Jensen-nek a korai "Radeon 9700"

"ATi Takes Over 3D Technology Leadership With Radeon 9700" -

S_x96x_S

addikt

> Ember az Nvidia már 2023 ban erről beszélt,

Ember !

A Sony meg legalább 2020 óta dolgozik a neural rendering-en ;

és nem véletlen, hogy milyen hardvert kértek a PS6-ba."The patent's author, Sony Senior Principal Engineer Andy Bigos, is listed on LinkedIn as "working on the application of machine learning and neural rendering to real-time graphics on the PlayStation 5".

"Most recently I've spearheaded work in using Neural Rendering to enhance traditional rendering methods, focusing on using implicit neural representations and how to make them run efficiently. This includes creating custom high performance interference using compute shaders. The target for this work is PlayStation 5," continues Bigos' experience description on LinkedIn" ( via )ÉS itt nem az a lényeg, hogy ki kezdte korábban!

Az igazi KÉRDÉS :

Érezhet nyomást az nvidia a PS6/RDNA5/Helix felől?

Vagy a győztesek nyugalmával hátradölhet ?És ha te azt sugalmazod, hogy hátradölhet az nvidia,

mert a PS6 nem okoz problémát,

akkor én kapok agymenést a spekulációdtól !

-

PuMbA

titán

Igen, mert az NVIDIA Ray Reconsturction-ja felskáláz is

Az AMD-é nem. Csak DLAA / Native AA módban lesz a kettő minősége megegyező, a videóban látható Performance felskálázásnál nem.

Az AMD-é nem. Csak DLAA / Native AA módban lesz a kettő minősége megegyező, a videóban látható Performance felskálázásnál nem.A Ray Reconstuction-nak viszont itt is látszik az a hibája, mint a Resident Evil-ben, amit megmutatnak a videó végén, hogy például az esőcseppeket teljesen eltünteti, tehát amellett hogy statikus elemek esetén nagyon részletes, több mozgásban lévő elemnél elmossa a részleteket.

-

.LnB

titán

Srácok, múlt hét csütörtökön volt ünneplés vagy megemlékezés a topikban? Csak azért kérdezem, mert múlt hét csütörtökön volt a hetedig évfordulója annak, hogy Abu nem hajlandó tudomást venni a JPR adatairól. Hét éve nem hajlandó még kihírezni se az eredményeiket. Mindezt egy Prohardver nevű oldalon. És akkor a Steam felmérésekről ne is beszéljünk.

Mondjuk biztos jobb is egy elképzelt álomvilágban élni, mint a valóságban.

-

S_x96x_S

addikt

> A kompatibilitás és hogy egy helyről jön a CPU-GPu amit kínált ami kényelmes és kifizetödő és fontos valóban ,ha erre gondolsz,mint sokkal több értéket adott,de valószínűleg nem.

mivel a konzolok ára limitált, emiatt nem lehet elszállni az árban.

> Az Nvidiának ez aprópénz

Inkább stratégia lett volna;

( ahogy az arm felvásárlása is annak indult )

Ha a konzol piacról sikerült volna kiszoritani az AMD-t,

akkor a gaming-ben is kvázi monopolhelyzete lett volna az nvidiának.Amúgy az nvidia is érintett a TEGRA(Nintendo) -val a konzol biznisszel, és a jövőben azt is frissiteni kell ( arm alapú )

Amúgy az XBOX (2023 -as belső MS leak-je tartalmazta,

hogy a next gen xbox : arm vagy zen6 cpu -ban gondolkodnak.

És amikor 2022 elején az nvidia+arm akvizició meghiúsult - az xbox/ps6 konzol bizniszbe való belépés esélye is jelentősen csökkenhetett.> az Intel pedig nem tud erre áldozni semmit.

Az intel elég komolyan vette a PS6 lehetőséget,

a Broadcom egy picivel korábban kiesett."Intel and AMD were the final two contenders in the bidding process for the contract."

Exclusive: How Intel lost the Sony PlayStation business

és hogy mekkora összegben gondolkodott az Intel:

"Sony’s console business could have pumped roughly $30 billion into Intel over the course of the contract, according to Intel’s internal projections, two of the sources said" -

Abu85

HÁZIGAZDA

Akkor kiemelem neked abból, amit bemásoltál: "down 13% from the previous quarter". És nem azért, mert kevesebbet vettek, hanem azért, mert kevesebbet gyártanak. A Q3-ban volt a gyártás a csúcson, ahhoz képest a Q1-ben a deficit közelít a 20%-hoz. Ezért fog Q4-ről Q1-re is csökkenni.

-

Abu85

HÁZIGAZDA

Most másoltad be, hogy az NVIDIA jelentése szerint is csökkent a bevételük. De itt már Q1-ről van szó, ott jelentős a változás, és meg is mondták Q/A-n, hogy szűkös lesz a kínálat legalább két negyedévig még. Egyszerűen nem gyártanak annyit, mint régen. Azt nem tudni, hogy miből van kevés, gondolom GDDR7-ből.

-

Abu85

HÁZIGAZDA

A DLL-t cserélgetheted, de az nem ugyanaz, mint egy adott API esetében driverből cserélni a kódot magát. Ezért van az, hogy ezt a gyártók egységesítették, hogy innentől kezdve ne is kelljen új kódokat kiadni, megcsinálják ezt driverből. Ennek a hátránya persze, hogy eltűnt a natív támogatás a játékokból, mert régi API-kat implementálnak, és onnan mindenki cseréli a kódot az újra.

Ez a lényeg, hogy a limitáció az mesterséges, mert ki tudod venni. Ugyanígy mesterséges lesz az AMD érkező limitációja egy másik játékban.

-

PuMbA

titán

Ezzel a játékkal sajnos vannak gondok NVIDIA oldalon, is mert a hozzá készült driverekkel jelenleg lassan fut: Resident Evil Requiem Driver Comparison and Forced Ray Reconstruction Preset E Testing

Túl sok a furaság, itt egy szándékos NVIDIA üzlet / előnybe helyezés történt, úgy hogy még a saját felhasználóit is kártya cserére buzdítja ezzel a lassulással.

-

Abu85

HÁZIGAZDA

Akkor elárulom, hogy nincs olyan, hogy FSR 4 vagy DLSS 4.5 meg ilyenek. Mind az XeSS-nek, mind a DLSS-nek, mind pedig az FSR-nek van egy API-ja. Ezt kell implementálni. Ez a DLSS esetében a 2.valamennyit jelenti, az AMD-nél az FSR 3.1.4-et, az Intelnél pedig az XeSS 1.valamennyit.

A valóságban nulla cím jön DLSS 4-gyel, FSR 4-gyel, vagy XeSS 2-vel. Az alap API-t implementálják a fejlesztők, vagyis rendre a 2.valemnnyit, a 3.1.valamenyit és az 1.valamennyit. És utána ehhez az API-hoz adják hozzá az újításokat. És pont azért működik a drivereknél is a egyes részeit cserélik ki az eredeti kódnak, mert maga az API kompatibilis előrefelé, vagyis a programban szállított kód ugyanaz, mint a driverben szállított. Tehát olyan technikai értelemben nem létezik, hogy valami natív DLSS 4 vagy natív FSR 4 vagy natív XeSS 2, stb., mert az API az, amit a fejlesztők implementálnak, ami régebbi.

Van megoldásuk erre. Implementálva is van az új Resident Evilben, csak nem aktív, mert ez volt az egyezmény. De pont azért tudják megoldani a modderek, mert az egész egy teljesen mesterséges limit, amit ki lehet kapcsolni. Ugyanez igaz lesz majd arra a játékra, ahol az AMD kérte ezt. Ott is implementálva van az NV megoldása, csak nem lesz aktív a szállított kódban. Valószínűleg ott is be lehet majd kapcsolni, mert az a módszer sokkal komplexebb, mint egy denoiser, de valószínűleg annyit meg tudnak oldani, hogy magát az ellenőrzést kiüssék, és akkor a PT működni fog, csak sokkal lassabban, mert nem kap ML-alapú könnyítést a kód, így mindent számolnia kell. De mondom, az megoldható lesz biztos, hogy magát az ellenőrzést kivegyék, és bekapcsolható legyen a kizárt mód.

Nem mintha sokat veszítenének ezzel az emberek, mert még mindig nem PT first szinten tervezik a játékokat, így sokszor rosszabb a PT minőség, hiszen erre is tervezni kell a tartalmat, és amíg nem erre tervezik, addig ez nem fog jól működni. Majd a következő konzolgenerációtól lehet itt áttörés.

-

En ehez nem ertek, de szelmalomharc ugyis bukjak kinaval szember...

Ez olyan mint amikor "nalunk" a jobboldalra szavaznak mert sok az arab, de amikor megkerdezem hogy az ittlevo 800-1m-val mi a terv akkor neznek akik 5-8 gyereket szulnek svedek meg nem akarnak....

akik 5-8 gyereket szulnek svedek meg nem akarnak....Na ennyi a tech tiltas es a vigyuk haza a gyartast ertelme..

-

-

Abu85

HÁZIGAZDA

Tudtommal - és ez eléggé jó helyről származó infó - az AMD kétféle CCD-t csinál a Zen 6-ra. Az egyik a normál Zen 6 CCD, amiben 12 mag és 48 MB-os L3 cache lesz. A másik elvileg a Zen 6c CCD, amiben 32 darab Zen 6 mag lesz, de nem tudni az L3 cache pontos kapacitását, viszont valószínűleg 64 vagy 96 MB lehet.

Ezek eltérő 3D V-Cache lapkát is kapnak, mert a mostanit mindenképpen át kell tervezni a Fan-out átalakítás miatt. Ezek pontos kapacitása sem ismert, de a kicsi verzióra 96 MB-ot, a nagyra pedig 256 MB-ot mondanak. Valószínű, hogy így jön ki a 2,5 GB-os L3 cache a HPC EPYC-re, amiről szintén van pletyi. -

proci985

MODERÁTOR

Áh, PS5 ha meg is van papíron az 5700XT szintjén, a gyakorlatban bőven nem bír annyit.

Cyberpunkot néztük: RTvel is meglepően elfogadhatóan fut (bár ebben lehet bennevolt a DLP projektor is), nade grafikára (a PChez képest) ronda. Textúrák nem rosszabbak, mint PCn (amit azért manapság már ki szokás cserélni 16+GBs kártyákon), de az effektek... látszik, hogy a geometriát és a shadow mapeket jóval alacsonyabb felbontáson számolja, amitől pl a pálmafák, az árnyékok, meg még pár dolog valami szörnyen néz ki. Az 5700XT az 1440p ultrát (RT nélkül) bírta FSR qualityvel. RT van papíron, gyakorlatilag a PCs RT Psychohoz képest így... hát nem sok.

Vagy a karakterek modelljei közelről érezhetően gyengébbek, ami meg a fél játék.

Lehet egyébként azt kéne, hogy kirakni a PCt is direkt összevetésre, hogy lehet csak a 120" vs 32" jön ki, de anno PCn próbáltam amikor kijött projektoron, és ott is szép volt. Ja igen: 5 éves játék, és már ezt se bírja

Platformexkluzív játék mostanra kb nincs. Ami szuper. Ok, Nintendo kivétel.

Persze, úgy nézve, hogy kerül annyiba, mint egy belépő laptop és lehet rajta játszani, meg nem kell konfolni, úgy jó.

PC piacot senki nem fogja sokkolni.

-

S_x96x_S

addikt

> Az AI az nem egy varázsszó,hogy az AI miatt miatt sokkal optimálisabb. bármit is jelentsen ez a képzeletedben,ez egy marketing maszlag.

most az nvidia marketing maszlagára gondolsz ?

( Jensen : RTX 5070 = RTX 4090 )persze sok minden túl van hype-olva,

de én mélyen hiszek abban,

hogy a GenAI át fog mindent alakítani - még a gaming-et is. -

S_x96x_S

addikt

ha bőven elég lenne - akkor a Sony is igy csinálná ..

de nem igy csinálja.

talán mert a PS6 már a jövő játékaira optimalizál.az AI miatt - sokkal optimálisabb a Sony PS6 architektúrája.

mert a GPU/NPU/CPU - val elérhető lesz a 30GB nagy része.a mostani rendszermemóriás GPU cache - eléggé kompromisszumos a kis VRAM miatt -

emiatt vagy a grafika vagy az AI mellett kell dönteni - és a kettő együtt csak a PS6-nál lehetséges.

( AI alatt nem a grafikai felskálázást értem, hanem az AI ágensekeket és a gaming LLM modelleket ~ 8-24 GB méretben. ) -

S_x96x_S

addikt

szeretném kihangsúlyozni, hogy

a technológiai jövő kiszámíthatlan.Emiatt, a "mai elérhető információk" alapján

csak korlátozottan látjuk,

hogy a jövőből viszanézve - ( az újabb információk alapján ) mi lesz racionális döntés....

Vagyis én a "disruptive innovation" lehetőségét - nem söpörném le azzal az érvvel, hogyha az nvidiának "nem éri meg akkor másnak még úgy sem" ( te irtad )

mert itt épp az a lényeg, hogy egy kisebb erőforrással rendelkező - fortélyosabb cég - más technológiai és üzleti stratégiával és paradigmával - eléggé bele tud ronditani a nagy cég üzletébe.

És ami a nagy cégnek nem éri meg,

az egy lehetőség a többi cégnek, hogy ott növekedjék és megkapaszkodjék.Az nvidia pl. törekszik a 70-80% -os haszonkulcsra - és ami az alatt van az nekik "nem éri" meg;

De más cégeknél más a technológia és üzleti stratégia.---

"According to Christensen, disruptive innovation is the process in which a smaller company, usually with fewer resources, is able to challenge an established business (often called an “incumbent”) by entering at the bottom of the market and continuing to move up-market.

1. Incumbent businesses innovate and develop their products or services in order to appeal to their most demanding and/or profitable customers, ignoring the needs of those downmarket.

2. Entrants target this ignored market segment and gain traction by meeting their needs at a reduced cost compared to what is offered by the incumbent.

3. Incumbents don’t respond to the new entrant, continuing to focus on their more profitable segments.

4. Entrants eventually move upmarket by offering solutions that appeal to the incumbent’s “mainstream” customers.

5. Once the new entrant has begun to attract the incumbent business’s mainstream customers en masse, disruption has occurred.

https://online.hbs.edu/blog/post/4-keys-to-understanding-clayton-christensens-theory-of-disruptive-innovation...

persze az nvidia a nagy haszonkulcsával - rengeteg pénzen ül

és ha valamilyen technológia innovációról le is késik,

akkor a felvásárlás lehetősége - mindig ott lesz mint "B" terv.

( hasonlóan mint a Groq esetén )Vagyis helyesebb úgy nézni az nvidia stratégiáját, hogy azt kell eldönteniük, hogy mi a gazdaságosabb:

- maguk fejlesztik ki

- felvásárolják / licenszelik a technológiát. -

S_x96x_S

addikt

> Most komolyan az üzleti életben nincs ilyen szabályszerűség hogy valami megéri valami nem? milyen butaság ez? Az üzleti életben vagy nyersz valamin vagy nem,ez a dolog ahol ez a szabályszerűség főleg él.

abból - hogy valami

"megéri" vagy "nem éri" meg - egy adott cégnek

(vagy személynek )

nem lehet következtetni, hogy más cégnek ( más embernek ) mennyire éri meg.pl. az AMD-nek megérte a konzol biznisz - az nvidiának meg nem.

De az nvidia meg elég korán az AI -ra fókuszált - és bejött neki.de ott a Groq -esete is;

és még lehet folytatni.

-

S_x96x_S

addikt

> Ha nekik nem éri meg akkor másnak még úgy sem

az ilyen általánosításban nem hiszek,

mert teljesen más az nvidia technológia menedzsmentje

- mint a többi cégé.És nincs meg minden tudás az nvidiánál.

( Nem véletlenül vásárol fel cégeket, fejlesztési csapatokat )És persze ott az AMD chipletes GPU-ja;

Az AMD-nek megéri az nvidiának meg nem.Vagyis nincs olyan szabályszerűség: hogyha az nvidiának nem éri meg, akkor másnak se.

-

S_x96x_S

addikt

a lényeg, hogy - később (March 19, 2025 )

Jensen - egyértelműen úgy fogalmazott, hogy

az optikai összeköttetés még nem éri meg az nvidiának.

"Nvidia CEO says power-saving optical chip tech will need to wait for wider use""But Huang told a group of journalists after his speech that while Nvidia examined using it more widely in its flagship GPU chips it had no current plans to do so, because traditional copper connections were "orders of magnitude" more reliable than today's co-packaged optical connections.

"That's not worth it," Huang said of using optical connections directly between GPUs. "We keep playing with that equation. Copper is far better.""a Neurophos - meg ALL-IN -t mondott a fotonikus compute-ra.

- állítólag van 300 ezzel kapcsolatos patentjük.ráadásul - elég merészet állítanak:

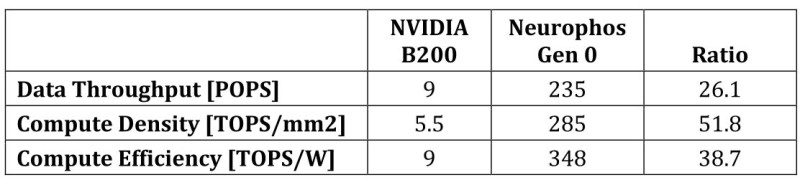

https://www.neurophos.com/whitepapers

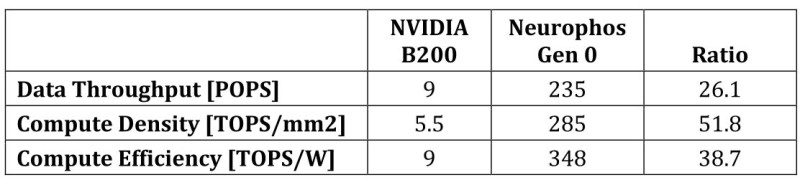

"Neurophos’ first generation product OPU will deliver a 1024 x 1024 pixel metasurface array, with 4 bit precision, at 56 GHz. Each vector-matrix multiplication translates to 10242 multiplications and 1024×1023 additions, for a total of 2.1 million operations. This product can perform two such multiplications in parallel, and at 56 GHz this yields a peak 235 Peta Operations per Second (POPS) (2.35×1017) during peak operation while consuming 675 W, corresponding to 348 Tera (3.48×1014) Operations per Second (TOPS) per Watt and a compute density of 285 TOPS/mm2.

In contrast, NVIDIA’s B200 GPU delivers 9 POPS (dense FP4 precision) and consumes approximately 1,000 W. This corresponds to an efficiency of 9 TOPS/W with a compute density of 5.5 TOPS/ mm2.

""" -

S_x96x_S

addikt

Lehetséges,de a meglévő legnagyobb partnerek Miért állnának meg a kapcsolódásnál? Már az Intel is mutatott be ilyen mintadarabot.

nekem a trend a lényeges ;

vagyis pár év múlva a jelenlegi technológián alapuló gyorsítók ( GPU/AI/... )

elavultak lesznek,

ami a jelenlegi nagy GW-os AI beruházások megtérülésébe eléggé bekavar.amúgy - szerinem -

legalább 50 hasonló startup lehet, és ha az nvidia úgy érzi,

hogy ezen a területen lemaradt, akkor majd vesznek 2-3 ilyen startupot. -

"nem tudom miért lett törölve a kommentem"

Semmi gond nem volt a kommenteddel, bekerült egy lánctörlésbe, mert az adok-kapokban ha meghagyok 1-2 árván maradó hozzászólást, akkor a törölt előzmények függvényében értelmetlenül állna magában.

Alogonomus: "Gondolom a "szórásba" belecsúszott véletlenül." Lényegében igen, de nem véletlenül, önmagában álló hozzászólás lett volna a többi között.

-

PuMbA

titán

"raszterben a 7900XTX sokszor elveri a 9070 XT-t "

Ez azért kevésbé számít, mert régebbi / régi motoros játékokban veri el az esetek legnagyobb többségében és ott is 100+ fps felett vagy, tehát most hogy 130 vagy 140 fps-ed van, nem tudod szemmel megmondani a különbséget.

RT-ben viszont többször 25%-kal gyorsabb a 9070XT a 7900XTX-hez képest és mivel RT a jövő, ez számít. A sima 9070-em, ami 220W-ot fogyaszt RT-ben ugyanazt a sebességet hozza, mint a 350W-os 7900XTX, szóval gigantikus az előrelépés ezt nézve. Ugyanígy a jövő a különböző RT kiegészítő technológiák, amit most már nem csak az NVIDIA csinál, hanem az AMD az FSR Redstone-nal: Ray Regeneration, Neural Radiance Cache.

A 16GB VRAM meg nem lesz gond, elnézve, hogy most a 8GB-os VGA-k kezdik az újra virágzásuk korszakát. Az NVIDIA "bejelentette", hogy a 8GB-os 5060 és 5060Ti-ből lesz egy raklapnyi, a többiből meg kevés.

-

X2N

őstag

Szerintem nem az a lényeg hogy érdekli-e vagy nem a Radeon tulajdonosokat az RT-hanem hogy amíg kimerül abban az RT hogy alapkövetelmény hozzá a felskálázás(DLSS/FSR) és a Frame Gen, valamint csúcskártya kell még az 1080p natívban értelmes fps-el futtatásához frame gen nélkül, addig nincs miről beszélni, kevesek hozzá a kártyák és nem éri meg vele foglalkozni se, még jó ~10 évig, mert a felhasználók elenyésző %-a tudja jelenleg is kihasználni. Az agyon butított RT sem egy nagy élmény, ahol nincs igazán kihasználva az hogy minden fény/árnyék/tükröződés dinamikus lehet, a korábbi statikus, bakelt megvilágításhoz képest. Path tracingről ne is essen szó, az továbbra is irreleváns amennyivel több teljesítmény igénye van, nem realisztikus célkitűzés jelenleg, se 10 év múlva ezekkel a videókoránya teljesítményekkel, meg a 2-3 évente +25% teljesítménnyel az hogy majd PT-el realtime 3D grafikát fogunk futtatni.

Közben meg raszterizációval, Horizon Forbidden West, Senua's Saga: Hellblade II, játékok készülnek a hagyományos global illumination-al amik büntetősen néznek ki, mindössze azért mert nagyon részletes modellek/textúrák vannak, jól bevilágítva. Amíg ilyen limitációk is vannak hogy nem tudunk részletes modelleket/textúrákat kipakolni a képernyőre, mert még Nanite sem tud mindent, pl. vegetációt(csak a mostani újabb 5.x verzióban már) megjeleníteni így addig az RT ne legyen már prioritás. Persze az NV-nek prioritás, meg kell teremteni az eddig nem létező igényt, még akkor is ha ez nem realisztkus célkitűzés, hogy eladhassák a kártyáikat valami újabb feature-el, lásd AI.

Az pedig nem előrelépés azoknak akik régebbi kártyákon vannak, hogy majd bekapcsolhatják a DLSS-t hogy értelmes fps-ekkel tudják futtatni a legújabb optimalizálatlan címeket még rosszabb képminőséggel, kép artifactokkal, mert letolták a fejlesztők torkán is az RT-t, ami egy jelenleg nem kiforrott technológia.

Ebből az egészből a "nyertesek" igazából csak a filmesek akik kaptak egy UE5-t amiben lehet már Path Tracelni is meg LED falakkal-virtuális kamerát mozgatva videózni, ezzel jelentősen közelebb hozza a valós idejű munkát a moziminőségű látványhoz, gyorsítja ezzel a gyártási folyamatot.

-

Alogonomus

őstag

Én sem értem, hogy miért lett a hozzászólásod is törölve, mert abban nem volt személyeskedés vagy sértegetés. Gondolom a "szórásba" belecsúszott véletlenül.

A HWU a hivatalos MSRP áron túl rögzíti a valós piaci állapotokat is a kártyatesztjeinél a tényleges ár-érték számokhoz, és a 600 dolláros 9070 XT érkezésekor a 7900 XTX még 900 dollár volt. Jelenleg is itthon 275 ezerért kapható a 9070 XT, míg a 9700 XTX 350 ezertől indul. Bőven kijelenthető, hogy a 9070 XT sokkal kedvezőbb vétel a játékosok túlnyomó többsége számára.

-

Abu85

HÁZIGAZDA

Ezen nem segít. A DLSS-nél az élesítő jó ideje nem a rendszer része. Erről a 2023-as év elején írtunk. [link]

Az eredetileg igaz volt, hogy az NV használt a futószalagon élesítőt, amit speciálisan erre terveztek, de kifejezetten rossz volt a működése, és nem volt értelme megtartani. A fejlesztők, amikor implementálták anno a DLSS-t, akkor ezt a részét helyből nullázták, és külön helyettesítették CAS algoritmussal, mert sokkal jobb minőséget kaptak tőle. Ezért döntött igazából úgy az NVIDIA, hogy akkor ez nem kell bele, mert csak a panasz volt rá. A NIS-t is azért ajánlják, mert az a saját különálló élesítőjük, de kb. minden nagyobb játékban az AMD-féle CAS van alkalmazva, mert jobban működik a NIS-nél. Nyilván ezt az NV nem mondhatja, hogy akkor használjátok az AMD kódját, de a szeparálás pont azt szolgálta, hogy akkor használja mindenki azt, nem kell ragaszkodni a NIS-hez. Emiatt van az, hogy a DLSS nem tartalmaz élesítőt, míg az FSR és az XeSS igen. Az AMD erre egy speciális RCAS implementációt használ, az Intel pedig alapjaiban az AMD-féle CAS, csak Arc GPU-ra optimalizálva.Viszont a DLSS 4-nél a homogén felületek jellegzetes kezelése nem az élesítő miatt van. Ha kikapcsolod, akkor is megmarad a művies hatás, mert maga a helyreállító algoritmus működik úgy, hogy a színben nem elütő képi tartalomba elkezdi belesúlyozni azokat a radikálisan eltérő színű pixeleket, amelyek szintén ott vannak a képen, akár a kép sarkán. Ez a globális konzisztencia okozza azt a fura jelenséget, amire PuMba rákérdezett, és hiába tologatod az élesítőt, nem függ a kettő egymástól. Ahhoz, hogy ez ne legyen a felskálázás része, a transformert kell kikapcsolni, amire például a Cyberpunk 2077 direkt lehetőséget is ad, mert tele van a játék homogén felületekkel, és más módon a fejlesztők nem tudták kezelni a gondot.

Hosszabb távon egyébként jó hír, hogy a Sony dolgozik egy megoldáson, ami direkt erre a problémára reflektál. Eredetileg a PSSR szintén transformer lett volna, de elvetették az ötletet, mert rosszul kezelte a homogén felületeket. Viszont az apró részletek helyreállítása kellene, tehát magáról a tervről nem mondott le a Sony. Amin most dolgoznak az egy frequency domain modell, és ennek pont az a lényege, hogy megmaradjon úgy a globális konzisztencia által biztosított jobb kontrol, hogy közben külön kezelje az alacsony és magas frekvenciájú tartalmat a képen. Ezáltal úgy állíthatók helyre a magas frekvenciájú apró részletek a képi tartalmon, hogy közben nem kell ennek a negatív hatását elszenvedni például az alacsony frekvenciájú bőrfelületeken. Valószínű, hogy rövidebb távon mindegyik felskálázó erre fog elmenni, mert csak nagyon kicsit kell módosítani a mostani hardvereken, hogy igazán hatékonyan fusson (a PS5 Prónak ez a multiprocesszorokat összekötő egyedi koncepciója például helyből alkalmas rá). Eközben megszabadulunk azoktól a képi torzításoktól, amik a mostani felskálázókat jellemzik.

Hosszabb távon egyébként van a Sony-nak egy másik kutatása is, de az szerintem bőven a PS6 érára van tervezve. Annak az a lényege, hogy maga a neuronháló tudja, hogy mi az anyag. Tehát effektíve fel tudja ismerni a képről, hogy az a terület rajta bőrfelület, amaz üveg, ez meg hó, stb. És eszerint konkrétan úgy tudja kezelni ezeket, hogy a helyreállított képen már azt is tudja, hogy a kép egyes részei hogyan viselkednek a fényben.

-

Abu85

HÁZIGAZDA

Én egy szóval sem mondtam, hogy a DLSS 4 rossz, csak azt írtam, hogy a jellegzetes hatásának megvan az oka, ami az elvi működéséből ered. És ez mint írtam nem élesség, hanem a transformer elvi működése által biztosított globális konzisztencia, ami a homogén felületeket túl műviessé teszi.

Az analitikai élesítők ilyet nem csinálnak, mert azok nem dolgoznak a teljes pixeltartományon, hanem van egy szűk tartományuk, implementációtól függően 6-8 pixel, és azon belül teszik a dolgukat. Ráadásul a modern élesítők még kontrasztadaptívak is, jó a NIS éppen nem ilyen, de a CAS például igen, tehát eleve nem torzít jelentősen.

#50660 Callisto : Kicsit vigyázzunk a RIS-szel, mert ha FSR 4-et használunk, akkor tuti RDNA 4-ünk van, és az hardverben implementálta a RIS-t, ami nem ugyanaz az algoritmus, amit a driverben szállít az AMD a többi GPU-ra. A hardveres RIS nagyrészt ugyanúgy működik, de nagyobb a feldolgozási tartománya, tehát az eredmény is jóval pontosabb. Ezért ez a driverben bekapcsolom a RIS-t nem általános érvényű, mert az RDNA 4-en ez számottevően jobb minőségű, mint bármelyik játékban szállított élesítő. A szoftveres megoldásokkal az a gond, hogy nagyon kell figyelni a kernel méretére, mert a sebesség szempontjából optimális, ha csak egy pass alatt lefut, tehát a feldolgozási tartomány méretét nagyban meghatározza az, hogy ne legyen túl regisztergyilkos. A hardverben implementált RIS konkrét célhardver, ott eleve úgy tervezheted magát a fizikai áramkört, hogy a feldolgozási tartomány legyen annyira nagy, amennyire kell. Itt nem számít a terhelés, mert úgysem a shadereket fut.

#50663 T.Peter : Abszolút, ha megpróbálod ugyanazt megcsinálni raszterben, amit RT-ben, akkor valószínű, hogy találsz rá valami trükkös megoldást, főleg a compute shaderek világában, de esélyes, hogy teljesítményben rosszabbul jössz ki vele. Viszont ez nem jelenti azt, hogy nem érdemes trükközni. Az Ubisoft külön csapatot tart arra, hogy kutassák az RT lehető leggyorsabb alkalmazási lehetőségeit. Például a Far Cry 6-ban példásan kombinálták a sugárkövetést a raszteres megoldással. Gyakorlatilag a visszaverődést úgy oldották meg, hogy amíg az minőségi hátrányt nem okoz, addig SSSR-rel működik, ahol pedig ez a technika nem működik jól ott RT-vel. Az eredmény rendkívül hasonló képminőség lett ahhoz, mintha csak RT-t használtak volna, miközben bő 50%-kal gyorsabb lett a hibrid megoldásuk. Ugyanezt eljátszották az árnyékokkal is, bár ott nem nyertek ennyit. Tehát az, hogy van RT nem jelenti azt, hogy nem érdemes optimalizálni és gondolkodni.

-

Abu85

HÁZIGAZDA

Ez nem egy élesítési probléma, hanem a transformer modell alapvető működéséből eredő jelenség, ami kivédhetetlen. Tudom, hogy látszólag élesnek tűnik, de nem az, a gond az, amit leírtam.

#50646 Ancsika99 : Nem lesz. Mint írtam ez pusztán abból eredő tényező, hogy a technológia elvi működése mellékhatásként előhozza a szóban forgó képi jelenséget. Ha az AMD vagy az Intel készít hibrid CNN+transformer modellt, akkor ott is bejátszik majd az az elvi működés, hogy minden elem figyel a többire a feldolgozás során, ami a kellemetlen mellékhatás konkrét okozója.

Ezt fontos megérteni, mert így látszik, hogy ez nem bug, hanem feature, még akkor is, ha nem kellemes a jelenség. Szóval ezt nem az NVIDIA rontja el, hanem az alkalmazott eljárás működési elve ilyen. Persze a transformert sosem képi feldolgozáshoz szánták, de elvi szinten lehetséges.

-

Alogonomus

őstag

Persze figyelmen kívül lehet hagyni a teljesítményfaktort, és mindent beleszámolni amit konzolként adtak ki, de ha a Geforce GT 1010 teljesítményének is csak a felére képes Switch beletartozik, akkor már a handheld vonalon a PSP-től kezdve is beleszámolhatunk mindent, ahogy desktop vonalon a Dreamcast, PS, GameCube, Xbox, Wii is beleszámít. Függetlenül attól, hogy valójában mennyire potens teljesítményre képesek.

A PS5 Pro valós teljesítménye egyébként az RX 7800 XT – RTX 4070 – RTX 3080 szintjén van. -

S_x96x_S

addikt

Ha az általad kiemelt táblázat tartalmazná

a VRAM/$ sort, akkor nem hoztam volna fel.

De nem tartalmazta, és ezért volt a megjegyzés.A táblázat amúgy is csak egy pillanatkép.

Egy adatközpontban 1-3 éves lekötésnél - amúgy is a jövőre fogadsz, és nem a mai benchmarkra. Az AI modellek nőnek, az optimalizációk változnak, de az extra VRAM ad egy rugalmasságot. A ROCm is gyorsan fejlődik vagyis a szoftveres hátrány csökkenhet, de a hardveres VRAM előny megmarad.

Ugyanez a logika érvényes consumer GPU-nál is.

A több VRAM = hosszabb élettartam ; nagyobb rugalmasság. -

S_x96x_S

addikt

nyilvánvalóan ebben a use case -ben ( "Our findings show that NVIDIA B200 does outperform AMD MI355X configurations for dense architectures and smaller MoE models." )

- az nvidiának pillanatynyilag előnye van.De más use casekre ideális lehet az AMD

mivel ugyanakkora árért

- 3x annyi VRAM-ot ad ( 2304GB vs 756GB )

- és extraként - ott van még 128 core CPU + CPU RAM = 3072GB

amúgy VRAM hiányos esetben még a Strix Halo APU (128GB) is lenyomja az RTX 5090 (32GB) -et.

Az AMD MI355-nél még az FP6 -ot preferálnám FP4 helyett,

mert azt kifejezetten kigyúrta az amd extra tranzisztorokkal.---

https://www.oracle.com/cloud/compute/pricing/

8*$8.60

BM.GPU.MI355X.8 8 x AMD MI355X 288GB Matrix Core CDNA 4 AMD Infinity Fabric VRAM = 2304GB CPU core = 128 CPU RAM = 3072GB ; 8 x 7.68TB ; 8 x 1 x 400Gb/sec RDMA

4* $16.00

BM.GPU.GB200.41 4 x Nvidia B200 189GB (NVL72)BlackwellNVIDIA NVLINK VRAM= 756GB ; 4 x 400Gbps InfiniBand $16.00

---------amúgy az Oracle már listázza a GB300 -at ( Blackwell Ultra )

ami több VRAM és gyorsabb hálózat,

és nem is értem, hogy miért nem az szerepel az összehasonlításban.

azzal szemben az AMD-nek csak 2x VRAM előnye lenne.

BM.GPU.GB300.42

4 x Nvidia B300 279GB (NVL72)Blackwell 4 x 800 Gbps $18.00 -

Kolbi_30

őstag

JA 2024.08 raktam ossze a gepemet, multheten gondoltam veszek memoriat, hogy kicsit legyen tobb...akkor 32 giga ddr5 45 ropi volt.. 64es kitet vettem volna alzarol...470k..meg hasonlok...aha koszi..lehet eladom a piicsaba a gepemet a penzt elrakom es hasznalom a laptopot..eleg durva vicc lett ismet a pc hobbi..

-

Alogonomus

őstag

Az egy év múlvát persze úgy értettem, hogy mondjuk majd a 2027-es CES-en bejelentik az új kártyákat, amik valójában persze hónapokkal később kerülnek a boltokba. Kepler is 2027 közepéről írt.

A memóriaárak elszabadulása messze nem annyira érinti a GDDR6-ot használó RX 90-es vonalat.

500-600 ezer nem lesz sem az 5070Ti sem a 9070XT.

A 9070 XT 270 ezres árán is kényelmes nyereségük lehet a gyártóknak és kereskedőknek. A memóriahiány elvileg csak 8 GB-onként 10-20 dollárt emel az árakon, de még ha az végül dupla akkora is lenne, az is csak mondjuk a jelenlegi 330 ezres 5070 TI árakig lökné a 9070 XT árakat.

Az 5070 Ti pedig már a jelenlegi 20% felárral sem igazán kelendő, szóval még 330 ezres 9070 XT árak mellett is legfeljebb szűken 400 ezer lehetne majd.

Az RX 90-es kártyákkal piaci részesedést akarnak szerezni, ezért nem fogják túlságosan drágán árulni. Az RTX 50-es kártyákat pedig azért nem adhatják drágán, mert ott vannak alternatívaként az RX 90-es kártyák.

500-600 ezer környékén legfeljebb az eddig nagyjából csak MLiD által pedzegetett "5080 killer" RX 90-es kártya lehetne majd, ha tényleg érkezik idén év elején. Azzal az állítólag 32 GB-os és az eredeti Navi 48-hoz képest 20%-kal magasabb üzemelési frekvenciára képes áttervezett Navi 48 "v 2.0" GPU-val szerelt kártyával már rámehetnének az 1200-1700 dolláros 5080 piaci szegmensére is egy mondjuk 900 dolláros RX 90(80) kártyával.

A maximalisták számára pedig nyilván megmaradna a pletykák szerint akár pletykált 4-5 ezer dolláros árig is emelkedő 5090. -

X2N

őstag

A lényeg az hogy neked mi az elfogadható.

A gyártó sz@rik rá amíg nem akarják beperelni. Bírja ki a kártya a 3 évet aztán kalap/kabát.

Nekem nem ez az elképzelésem, én azt szeretném hogy addig legyen jó a kártya amíg teljesen el nem avul, ami az én esetemben 7-10 év lesz a 7900XTX-el. Ezért is vettem ezt csúcskarit 3 évvel ezelőtt megjelenéskor, 4K-ra kellett minél több VRAM-al. Ki akarom próbálni hogy a saját gépemben normális tárolási körülmények között meddig megy egy ilyen kártya úgy hogy nincs sag, mert az oldalára támaszkodik a kártya, normális használat mellett, évi 1x takarítással. Leégős NV kártyával nem volt kedvem kísérletezni, pedig egy 3090-4090 se lett volna rossz, de akkor az egy használt kártya lett volna ismeretlen előélettel.

-

X2N

őstag

Itthon nem biztos h népkártya az 5070 és afölötti nv ezért nem látod. A másik hogy ezek az emberek nem is használják ki igazából azokat a kártyákat. Annyi órát még nem tettek bele. Kevés olyan van aki egy 5090-est 16+ órákon keresztül használ 100%-on, vagy aki egész este renderel majd még napközbe is tolja a gépet. Azt viszont garantálni tudom hogy ha nekiállsz tuningolni egy 5090-est és tartósan 100%-ba terheled úgy hogy 600W- vagy felett fogyaszt nagy valószínűséggel már a garancia ideje alatt lesz égett csatlakozód.

Sok leégett csati van, Ha megnézed a külföldi vga javítós youtuber csatornákat doboz számra küldik nekik a leégett csatlakozós nv kártyákat.

Busterftw-Nézd ez így ide kevés lesz, ha minden gyártónál hullanának az RDNA2 kártyák akkor lenne probléma, de így h egy noname kínai gyártónál van csak egy minimál hibaszázalék ez akár az ő saruk is lehet, akár egy elrontott hűtés leszorító/rosszul megtervezett hűtés, gyenge pcb miatt is lehetnek ilyen problémák nem beszélve a rossz tárolásról. Ez kb annyira probléma ebben a mennyiségben h nem éri meg foglalkozni se a hiba feltárásával.

Ahogy az előző Ryzenes problémánál is érdekesnek tartom hogy csak 1 internetes kávézóban hibásodik meg a 150 processzorból a processzorok 10%-a...

Érdemes lenne utánanézni milyen lapokba lettek rakva ezek a processzorok és milyen feszültségekkel üzemelnek. Az a sanda gyanúm hogy a túl magas VSOC feszültség nyírja a procikat, ahogy megjelenéskor is előszeretettel állítgattak be 1.3-1.4V-okat. Majd amikor ment a balhé akkor ezt bios frissítés után 1.3V-ban maximalizálták(elméletben). Manapság 1.2V-al szoktak ezek menni de én nem vagyok róla meggyőződve hogy az X3D-k ennyire bírják ezeket a feszültségeket, a simák lehet jobban bírták, az X3D-lehet háklisabb. -

Nem árt tisztában lenni a tervezési problémákkal. Ugannis elsősorban nem a csatlakozóval van a probléma, hanem a kártyákon spórolnak mivel lespórolják róluk a load balancing-ot. Ezért lehetséges az, hogy a csatlakozó valamelyik tűjének rossz érintkezése esetén a többin veszi fel a kártya az összes szükséges áramot. Ezért hullanak el. A csatlakozó/kábel valóbasn 600W-ra van tervezve, de nem vezetékenként, hanem összesen.

-

X2N

őstag

"A 3000 széria nem volt ebben érintett ott ez jól működött."

Az hogy ez a széria működött attól még nem lesz jó ez a csatlakozó.

Attól h valami működik még nem biztos hogy jól meg is van tervezve.300-400W-os videokártyákat én nem szeretnék pc-kbe, 300W+ az rengeteg teljesítmény, ott már nem lehet bohóckodni a gyártóknak se.

Évek óta hullanak a Ryzenek, hol ASRockban, hol Asus-ban. Az a szerencséjük hogy nem annyi mint Intelnél a legutóbbi blamánál.

-

Alogonomus

őstag

Pontosan erre utaltam. Egyedül a divat követése érdekében van értelme a minél kisebb helyet elfoglaló kábelezésnek.

Aki a számítógépházára nem csak funkcionális eszközként tekint, hanem szobadíszként is, és ezért lehetőleg minél több RGB elemet is belehelyez, nekik hasznos az egyetlen csatlakozós megoldás, hogy azáltal a számítógépházukban elhelyezett divatos elemekből a kábelezés minél kevesebbet takarjon ki. Cserébe pedig bevállalják az egykábeles verzióval járó extra kockázatot.RTX kártyák esetén a középkategóriától kezdve erről nem dönthet a custom gyártó, míg RX kártyák esetén teljesen a custom gyártó döntésén múlik az extra kockázat bevállalása. A döntésük eredményeként pedig kénytelen a Sapphire vagy Asrock vezetés lenyelni azt, hogy az érdeklődők egyre több olyan cikkbe futnak bele, amit újabb Sapphire vagy Asrock kártya tönkremeneteléről írnak, ezzel az érdeklődőket inkább egy másik gyártó RX kártyája felé terelve.

-

S_x96x_S

addikt

Alatta kettővel van a Data center és Cloud szval nem hinném hogy fontossági sorrendet takar

természetes fókuszváltás

és ez valamennyire fontossági sorrendet is takar

( a marketingben is )Most a "Gaming and Creating" a 4. helyen szerepel

[ "Artificial Intelligence", "Design and Simulation", valamint "High-Performance Computing" után. ]Egy régebbi vátozatban

a gaming megelőzte az AI-t és a AI + data centert is.

https://web.archive.org/web/20191231174328/https://www.nvidia.com/en-us/az Nvidia átpozicionálta magát AI vállalattá, a

és a Gaming már másodlagos,

az a szerencse, hogy egységes architektúrát alkalmaznak és az AI valamennyire húzza a gaming-et is// az AMD -nél a szétválasztás utólag már nem volt szerencsés, amit az UDNA -val próbálnak javítani.

-

proci985

MODERÁTOR

Aha, arra, amiatt vállalható, az árán is. Teljesítménye megvan.

Ára horror, de utóbbi hat évben mindennek az. Cserébe a 3 éves 7900XTm jobban tartja magát, mint anno a 290X CF ennyi idősen.

---

Ami para viszont, hogy a fiataloknak nincs pénzük PCt építeni. Ez IT szakembereknél szívás, amikor a képzésben kiderül, hogy sose rakott össze saját PCt.

-

-

Mondom top es low hutest hasonlitasz.

Nincs problema mert ezt mar nehez ertelmes embernek tagadni. En is NV mondtam neked nincs azzal problema.

Azzal van problema ha ezt tagadja valaki, szerintem most meg jobban fog nyilni az ollo arban.De ahogy irtak lejebb ha qhd felbontas van legjobb a 9070 sima.

-

Hogy vettel te uj Primet az alzan 300e-ert? Legolcsobb windrorce ssf 351e.

Na hanolvastal teszteket a Sappgire Pulse a egyik leghalkabb hutessel rendelkezo kartya 25dbi a tpu szerinti tesztben, volt vagy 5 nalam full kuss hibatlan kisnkartya es a legolcsobb.

Ellentetben volt a gepemben Prime 70Ti hat en attol biztos nem ajultam el, kozepszer messze van a top tiertol.Nincs most az alzaban Prime Ti de egyebkent itthon 360e a legolcsobb

Ez 100e dragabb egy pulse XT-nel, es hidd el jobb a Pulse hutesen mint a Prime. -

Az mar regen a mult..

245e vs 340e ez a kulombseg most a heten 9070TUF vs 5070TUF lehet ez tagadni veletlenul atsiklani folotte nagylelkuen

Mennyiert vetted hasznaltan a Primot?

230e-ert adtam el mult heten 9070XT-ben...

70k a kulonbseg e hasznalt vs uj

De hat ezek elhanyagolhato tenyezok tudjuk

-

hokuszpk

nagyúr

a klasszikus közgazdaságtan szerint ilyen esetben ilyenkor újabb szereplőknek kellene a piacralépniük, hogy kielégítsék a keresletet ; csakhogy a chipgyártók pontosan tudják, hogy

- egy új gyár felhúzása k*sokba kerül

- a szükséges technológia fejlesztése k*sokba kerül

- ha valaki mégis bepróbálja, akkor nincs az az isten, hogy ne szegjen meg valami TSMC/Samu/Hynix/Intel/Toshiba/NVidia/Amd/*.* szabadalmi védelmet a fejlesztés során.azaz kb. esélytelen, hogy friss konkurrencia lépjen be, és moderálja az árakat. Max. a Kínaiaban bízhatunk, hogy összelopják a szükséges szellemi tőkét és leszarják a patenteket, ahogy a rendes üzletmenetükben szokták.

-

Abu85

HÁZIGAZDA

Én nem akarok most lufizni, tehát arra nem reagálnék, de pusztán a TSMC szemszögéből az a fő gond, hogy ők ugyan biztosítják a gyártástechnológiát, de ezt ők is úgy teszik, hogy nekik is szükségesek a tömeggyártáshoz szükséges eszköz. Na most ezt ugyanúgy beszállítóktól szerzik, és a beszállítók által biztosított ellátás limitálja azt, hogy mennyire tud bővülni a gyártás. A legtöbb esetben azért, mert a TSMC és a modern chipgyárak által használt csúcstechnológiás berendezések összerakási ideje nagyon sok hónap. Tehát mindegy, hogy a TSMC lát-e az AI-ban fantáziát, az számít, hogy mennyi berendezést tudnak szerezni a partnereiktől a gyáraikba, és alapvetően úgy építik a gyárakat, hogy kb. minden elérhető eszközt megvesznek. Szóval itt egy beszállítói limit van, ami akadályozza a gyártókapacitás bővítését. És pont az a gond, hogy ezen a ponton nagyon nehéz növelni az ellátás sebességét, mert annyira bonyolultak ezek a berendezések, hogy iszonyatosan sok komponensből épülnek fel, és iszonyatosan fontos, hogy amikor leszállítják őket, akkor be legyenek állítva, szuperül működjenek stb. Tehát ez nem pusztán egy gyártási kérdés, itt azért nagyon komoly technikai személyzet van a háttérben, és az ultimate limit egy ponton az elérhető, kellően képzett humánerőforrás lesz. Ebből érthető szerintem, hogy ha a TSMC mondjuk azt mondja holnap, hogy kéne háromszoros kapacitás egy év múlva, akkor sem tudják megcsinálni, mert egyszerűen a legszűkebb keresztmetszetek már így is a limiten dolgoznak.

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Kompakt vízhűtés

- Mikrokontrollerek Arduino környezetben (programozás, építés, tippek)

- Folyószámla, bankszámla, bankváltás, külföldi kártyahasználat

- Sorozatok

- Xiaomi Mi 9T Pro - tizenegyes!

- Óvodások homokozója

- iPhone-ra és iPadre is megérkezett a Control Ultimate Edition

- Gyúrósok ide!

- Projektor topic

- Soundbar, soundplate, hangprojektor

- További aktív témák...

- Sok Extra! Playstation Portal 6 hó garancia, számlával!

- Keresek Xbox Series S / Series X / Playstation 5 konzolokat

- HIBÁTLAN iPhone 12 Pro 256GB Graphite - 1 ÉV GARANCIA - Kártyafüggetlen, MS3283

- Dell Inspiron 16 Plus 7640 Ultra 7 / RTX 4060 16gb DDR5 1TB SSD/2.5K 120Hz Garancia

- ÁRGARANCIA!Épített KomPhone Ryzen 7 5700X 32/64GB RAM RTX 5060 Ti 8GB GAMER PC termékbeszámítással

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

( azt hittem lefejelem a képernyőt)

( azt hittem lefejelem a képernyőt)

![;]](http://cdn.rios.hu/dl/s/v1.gif)

8x FG gondolom meglesz a 4k-240.

8x FG gondolom meglesz a 4k-240.