- Garmin Forerunner 970 - fogd a pénzt, és fuss!

- A sógorokhoz érkezik a kompakt Vivo X200 FE

- iPhone topik

- Milyen okostelefont vegyek?

- Megjelent a Poco F7, eurós ára is van már

- Samsung Galaxy S25 - végre van kicsi!

- Motorola Edge 30 Neo - wake up, Jr...

- Youtube Android alkalmazás alternatívák reklámszűréssel / videók letöltése

- Apple iPhone 16 Pro - rutinvizsga

- Xiaomi 14T - nem baj, hogy nem Pro

-

Mobilarena

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Televan74

nagyúr

válasz

Petykemano

#47078

üzenetére

Petykemano

#47078

üzenetére

Sajnos ez igaz!

Több helyen olvastam hogy csak a drágább Navik kapják meg a Ray Tracing támogatás. Valós lenne ez? Milyen érték határ fölött kell gondolkodni? 150.000 Ft vagy még magasabb összegben?

-

ƵøŁĭ

veterán

válasz

Petykemano

#47073

üzenetére

Petykemano

#47073

üzenetére

Értem. 5600xt és társait akkor nem vennék ha jönne ebbe a szegmensbe is új.

-

paprobert

őstag

válasz

Petykemano

#47045

üzenetére

Petykemano

#47045

üzenetére

Mármint miben lenne gyorsabb?

-

Busterftw

nagyúr

válasz

Petykemano

#47022

üzenetére

Petykemano

#47022

üzenetére

Szerintem is inkabb ez a valasz.

A 2xxx szeriara sokan nem valtottak Pascalrol, foleg az elejen, nem csak ar miatt, koztuk en is.

De nem rohantam 5700XT-t venni, inkabb megvarom a 3xxx szeriat, hogy nagyobbat ugorjak egy valtasnal.AMD oldalon meg rengeteg Polaris tulajnak vegre jo alternativa a Navi.

A Vegasoknak is, miutan a csucskartya egy ido utan lekerult Nvidia kozepkategoriaba. (2060) -

-Solt-

veterán

válasz

Petykemano

#47022

üzenetére

Petykemano

#47022

üzenetére

Ez már az okok taglalása, én az érdem negligálására reagáltam.

-

hokuszpk

nagyúr

válasz

Petykemano

#46998

üzenetére

Petykemano

#46998

üzenetére

ezzel rancfelvarrott Vegat a nepnek !

-

Devid_81

félisten

válasz

Petykemano

#46998

üzenetére

Petykemano

#46998

üzenetére

Polaris 7nm+GDDR6-al lehet jo lenne valamire, csak epp kar minden befektett dollaerert mar ha Polarisrol van szo

-

Alogonomus

őstag

válasz

Petykemano

#46991

üzenetére

Petykemano

#46991

üzenetére

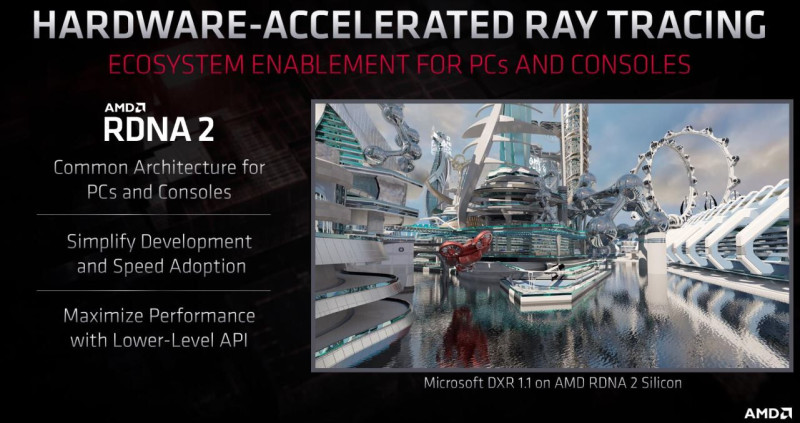

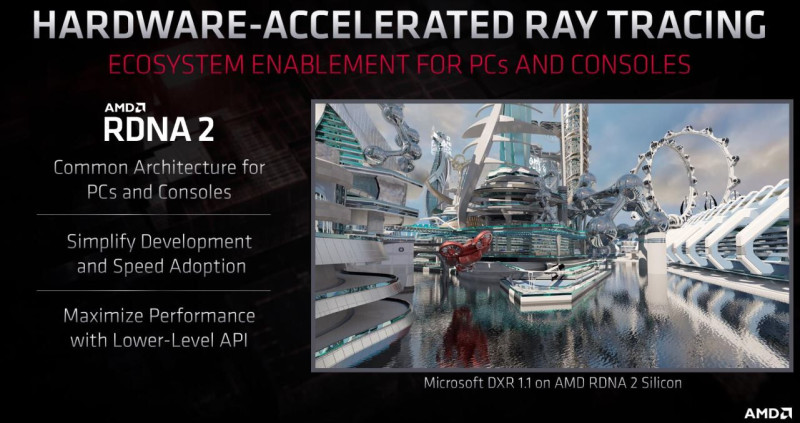

1) Esetleg az RDNA2-höz használt waffer mégsem ugyanaz (drágább), mint az RDNA1-es chipekhez használt. Ez máris magyarázhatná, hogy miért próbál az AMD alsó kategóriában továbbra is RDNA1-et használni, és külön RDNA2 RT részeket csatolni hozzá, ahogy a CPU-k is vegyesen 12 és 7 nm-es chipekből állnak.

2) Plusz funkcióhoz mindig vagy kell plusz lapkaterület, vagy meglévő egyéb funkció helyett lehet betenni. Olcsóbb - és Turing ellen már bizonyított - RDNA1 megfejelve egy új RT egységgel mindenképpen olcsóbb, mint gigantikus chipeket használni. Alsóbb kategóriában a költséghatékonyság elsődleges szempont.3) Az 500mm2-es big navi elméletileg a csúcsra érkezik. A 2080 Ti által bevezetett 2000+ dolláros árszinten már sokkal inkább bevállalható egy tisztán RDNA2-es chip, ami cserébe sokkal flottabbul működhet, mert mindennek közös (belső) ütemező adja a ritmust.

És akkor még nem is számoltunk azzal, hogy esetleg az AMD csak nagy raktárkészlettel rendelkezik még RDNA1-es chipekből, és ugyanúgy ki akarja csak szórni azokat az elején még jó áron, ahogy az Nvidia pont most szórja ki a TU106-os chipeket 1650-es kártyaként.

-

Malibutomi

nagyúr

válasz

Petykemano

#46989

üzenetére

Petykemano

#46989

üzenetére

Mondjuk ha lenne mind a 3 lapkabol vga akkor kb le is fednek vele a piacot

Ugye 230 az kicsit kisebb mint az 5700Xt de valoszinu tudna minimum ugyanazt ha nem tobbet + abbol egy vagott valtozat lejjebb

A 350mm2 az mar elvileg 2080Ti szint kellene legyen ha jol skalazodik (ez persze kerdeses de meretre kb akkora ha a node kulonbseget beleszamoljuk), az 500mm2 meg valami szornyeteg kellene legyen (az 12nm-en 855mm2 lenne - 2080Ti-nel 10-15%-al nagyobb es tobb tranzisztor) ersze kerdes mire lesz ez eleg mennyit lep elore az RDNA 2 az 1-hez kepest teljesitmenyben.Kiderl majd mennyi igaz a pletykakbol, de elvileg ezekkel kb beernek/megugranak a Turingot RDNA1 szinten csak azzal hogy nagyobbak a chipek...ha az Ampere ellen akarnak menni akkor tenyleg kelleni fog a plusz 30-50% elorelepes

-

Alogonomus

őstag

válasz

Petykemano

#46989

üzenetére

Petykemano

#46989

üzenetére

Viszont egy kártya, ami gyengébb, mint az 5700, viszont RT képes, az elég bénakacsa lenne.

Nem feltétlenül. Turing kártyák közül a 2060 Super - mint kicsivel 5700 alatti teljesítményű kártya - elfogadható kártya lehetne a maga 100+ fps értékével FHD mellett, ha a plusz 20-30 ezres áráért cserébe a sugárkövetés is érdemben (~60 fps) használható lenne vele FHD szinten.

RDNA2 elvileg egy sokkal kevésbé erőforrás-zabáló megoldással tudja majd a sugárkövetést számolni. Egy szintén 400 dolláros kártyával - amin viszont már lenne értelme bekapcsolni a sugárkövetést - nagyot arathatna az AMD. -

Devid_81

félisten

válasz

Petykemano

#46981

üzenetére

Petykemano

#46981

üzenetére

Pontosan igy ertettem!

Jo lenne vegre valami kezzel foghatot latni.

Nem feltetlenul kell a nepnek 2080Ti-t vero valami, picit erosebb lehet a 5700XT-tol ertelmes aron, az mar valami.

Talan johet a Ray Tracing is, de csak azert, hogy csend legyen vehre a morgo userek kozott.

De legeleloszor ossze kell seperjenek egy ertelmes drivert am, igy nehez lesz barmit is elerni, egyre jobban benne van az emberekben ez, hogy driverekkel baj van

-

Busterftw

nagyúr

válasz

Petykemano

#46984

üzenetére

Petykemano

#46984

üzenetére

Azt lehet tudni, hogy rdna2 kartyakkal lefedik a piacot rajtkor, vagy jon egy big navi es csa?

-

Malibutomi

nagyúr

válasz

Petykemano

#46984

üzenetére

Petykemano

#46984

üzenetére

Teljesen mas a CPUY es a GPU piac.

CPU-banmar kipicsaztak az intelt, ott megeri kiadni a jobb yield termeket hogy az arak visszamenjenek egy kicsit. Plusz ez megint pozitiv PR lesz nekik, mert meg ravernek egyet az intel fejere, mielott jon az uj.CPU piacon nyero helyzetben vannak (legalabbis PR es megiteles szempontjabol) ott mar lehet utni a vasat.

GPU piacon meg mindig a regi AMD lassabb, driver nem jo stb beidegzodes van ott meg nem lehet ilyeneket csinalni.RDNA1 refresht max ugy tudok elkepzelni ahogy regebben is csinaltak, hogy felso kategoria RDNA 2, also RDNA1 de minden egy kategoriaval lejjebb csuszik. De ez szerintem nagyon rossz taktika lenne, ezzel maradnanak a second opcio szinten.

-

Malibutomi

nagyúr

válasz

Petykemano

#46981

üzenetére

Petykemano

#46981

üzenetére

Semmi esetre sem lesz refresh a GPU piacon.

egyreszt pont azert nem is volt nagyobb kartya mert egybol az RDNA2-re ment az AMD,masreszt mivel most jon a nagy Navi, annak az arat pont nem befolyasolja az 5700XT ara.

Az meg pont egy koltseges es felesleges rohadt nagy bukta lenne, hogyha a beharangozott RDNA2 helyett jonne egy NAvi refresh es azzal lenne tele a sajto hogy az AMD meg mindig csak beerni tudta az NV teljesitmenyt evek ota...minek adnanak ki refresh kartyakat azert hogy rossz PR-t kapjanak es aztan par honap mulve kiadjak az ujakat.

Plusz az AMD csak ugyanazzal a strategiaval lehetsikeres a GPU piacon mint a CPU-nal. Ugyanaz vagy jobb teljesitmeny alacsonaybb aron 2-3-4 even keresztul (tehat legalabb ket generacio) aztan lehet az arakkal szarakodni.

Jelenleg ha az 5700XT totalisan egyenlo a 2070 superrel akkor is csak alacsonyabb aron lehet adni, erre van beallva a piac.

-

válasz

Petykemano

#46977

üzenetére

Petykemano

#46977

üzenetére

Ennyivel kisebb a HBM vezérlő? Komoly!

-

Jack@l

veterán

válasz

Petykemano

#46969

üzenetére

Petykemano

#46969

üzenetére

A lémyeg: ezekhez képest a számítás szinte ingyen van. R U sure?

-

Jack@l

veterán

válasz

Petykemano

#46955

üzenetére

Petykemano

#46955

üzenetére

"Az RT mag valójában egy nagy cache." Ezek a jól bevált abu aranyköpések, annyira azért nem kellene ismételgetni a hülyeséget...

Adatmozgatásra meg csak megkérdezném, hogy mikor, milyen mértékben van szükség? (nekem csak pálya betöltáskor jutnak eszembe ilyen dolgok)

Adatmozgatásra meg csak megkérdezném, hogy mikor, milyen mértékben van szükség? (nekem csak pálya betöltáskor jutnak eszembe ilyen dolgok) -

paprobert

őstag

válasz

Petykemano

#46955

üzenetére

Petykemano

#46955

üzenetére

Egy 200+ wattos GPU tetejére most biztosan nem fognak tudni VRAM-ot stackelni. Az Intel is csak most próbálkozik vele, látod milyen TDP-vel.

Elméletek vannak csak, hogy hogyan lehetne több réteget jobban hűteni, termék előfutár és tömeggyártás pedig sehol a láthatáron.

-

stratova

veterán

válasz

Petykemano

#46952

üzenetére

Petykemano

#46952

üzenetére

A HBM eleve stacked memory, csak GPU-memória viszonylatban 2,5D stacked. Ezek sem tudják már mivel szerezzenek nézettséget.

Amúgy abból kiindulva, hogy adtak már 1000$ (Vega FE) 700$ (VII) ársávban 16 GB HBM2-es VGA-t és mibe kerül most a 2080 Ti még jobban is kijöhetnének belőle, mint VII-nél. Bár RDNA alapú, de már kisebb lapkát is kiadtak HBM2-vel, csak kifejezetten Apple részére és Radeon Pro vonalon (ahogyan hasonlóan jártak el a Radeon Pro Vega 20 esetében is). -

Jack@l

veterán

válasz

Petykemano

#46952

üzenetére

Petykemano

#46952

üzenetére

Beindult a bullshitgenerátor?

AMD akkor fog árat emelni, ha versenyképes lesz és NV is árat emel majd. Különben marad a gödör alján. -

Z10N

veterán

válasz

Petykemano

#46946

üzenetére

Petykemano

#46946

üzenetére

"A 5600M Pro (8GB HBM2)-nél."

Hogy mi? A 5600M gyorsabb az 5600M Pro-nal, ami hbm2-s?! Akkor a az 50W nerfelesnek sok ertelme volt."Nem állítom, hogy a vega48/56-hoz nem érdemes hasonlítani, de azt biztosan állítom, hogy csak amiatt nem érdemes, mert azokon HBM van."

1) Pedig igy a fair.

2) Ezenkivul a cikkben ez van..."Vega48/56-hoz úgy érdemes hasonlítani, hogy fú, de mennyire hasonló, vagy még jobb teljesítmény is - mennyivel kisebb TDP-ből."

Masodjara mondom, ez van a tesztben..."Az 5600M-hez (6GB GDDR6) meg azért érdemes hasonlítani, mert mégiscsak azzal visel majdnem megegyező nevet."

Akkor inkabb mar core config alapjan az 5700-hoz..."Egyébként ahhoz érdemes hasonlítani, amivel egy TDP osztályba tartozik."

Arrol napokig el lehetne beszelni a semmit. Arra nincs idom..."Az 5600M és az 5600M Pro mondjuk pont nem egy TDP osztály - legalábbis a TPU adatai alapján."

Igy kell elb@szni egy jo lapkat. De hat az Apple kifizette. A Desktop tulajok meg le vannak sajnalva..."Nem tudom, hogy most melyikünk nem olvasta el elég figyelmesen. Az általad linkelt cikkben 5300M és 5500M van amiről írják, hogy szintén 50W. A másik oldalt vega 48 és vega 56 van. Arról hol írják, hogy 50W-ra limitált lenne?"

Nem olvastad el...

"the Pro 5600M runs at peak 1035 MHz frequency to meet a strict 50W TGP standard for the notebook. It’s worth noting that both 5500M and 5300M are 50W as well."

"Én egyébként csak arra akartam felhívni a figyelmedet, hogy az általad linkelt cikkben tesztelt 5300M, 5500M, vega 48 és 56 mellett van már 3dmark teszt 5600M-mel is (6GB GDDR6)"

Desktop verziot nem kapunk beloluk, szoval egyaltalan nem erdekel. Egyedul a $200-s RX5600 oem verzio lesz erdekes, de arra meg varni kell mire kidobaljak a gepekbol. Viszont addigra lesz XSX es PS5...

-

Z10N

veterán

válasz

Petykemano

#46943

üzenetére

Petykemano

#46943

üzenetére

"már van 3dmark eredmény is."

Igen, ott van a cikkben..."Az 5600M 6GB 17%-kal gyorsabb nála."

Minel? A vega48/56-hoz erdemes hasonlitani, azokon hbm van."A TDP-re vonatkozólag nem tudom a pontos differenciát. a TPU adatai alapján 50W vs 150W."

Ott van szinten a cikkben. Mindegyik 50W-ra limitalt.Se ezt hbm-mel, se kis vega12/16-t, se vega 20/24-t nem kaptunk. A $200-os RX 5600-t se, mert ment az oemeknek. Az AMD mindent megtesz, hogy sajat maga alatt vagja a fat folyton. Csomo lehetoseg...

-

válasz

Petykemano

#46910

üzenetére

Petykemano

#46910

üzenetére

Erre gondolsz?

-

Jacek

veterán

válasz

Petykemano

#46910

üzenetére

Petykemano

#46910

üzenetére

Vagy az Intellel, főként mindig ott a gáz amikor szar a cucc ami jönni fog, iszonyat hype-ot lehet csapni aminek lehetetlen megfelelni, CPU-nál most az Intel GPU-nál emg valszeg megint az AMD fog cummantani.

-

válasz

Petykemano

#46910

üzenetére

Petykemano

#46910

üzenetére

Miért pont ebben a témában? mert uborka szezon van és ezek az érkező újítások egyelőre.

Igazából.nem hinném, hogy ugyan ezt el lehet érni már CPU fronton a gyártott álhírekkel. Ezelőtt 5 éve még igen, most már azért eléggé lefutott kör az Intel AMD erőviszonya CPU fronton. Most már az lenne álhír értékű, hogy Intel elővett valami csodafegyvert a kamrából,de ilyen nem lesz szóval, zen 3 jön lenyom mindent aztán kb ennyi a szitu.

Inkább már az a kérdés az emberekben, hogy érdemes e váltani a Ryzen új generációjár, a régiről, nem az hogy Intel mit hoz ellene.

hHa megnézed már az új sebezhetőségre is alig van reakció. Első napokban ölték a népek egymást 1000 + hozzászólás, most meg 30-40 üres valami van a komment szekcióban. -

Petykemano

veterán

válasz

Petykemano

#46908

üzenetére

Petykemano

#46908

üzenetére

Néhány igaz, vagy igaztalan szivárgás megjelent AMD és Nvidia oldalon is videokártya témában az elmúlt 1-2 hétben. (Volt egy visszavont AdoredTV video és ma egy 6900XT-ről szóló MLiD, amit természetesen csak erős idegzetűeknek ajánlok, mármint azoknak, akik képesek idegroham nélkül saját maguk megítélni, hogy mi lehet igaz, vagy mi nem)

Mivel maguk a szivárgást közreadók (kitalálók?) szerint sem minden vonatkozásukban valóságosak a számukra eljuttatott anyag, ezért felvetődött, hogy maga az AMD és az NVidia kezdte el fals (féligazságokat tartalmazó) információkkal teleszórni az internetet.

Jó, ehhez persze nem kell AMD-nek és nvidiának lenni, ezt bárki megteheti, aki ráér és szeretné szivatni a Jútúbereket és nézőiket.Mindenesetre miért tenné ezt bárki pont most? Vagy miért pont és csak Nvidia és AMD témában? Ugyanilyen izgalmat lehetne kelteni ezeknek a JúTúberekben és közönségükben zen3-mal, vagy valami Armos anyaggal.

-

Z10N

veterán

válasz

Petykemano

#46893

üzenetére

Petykemano

#46893

üzenetére

Van itt minden, csak sz@rnak a desktopra.

5600 LE, aka 5600 D (32CU)

https://www.amd.com/en/products/graphics/amd-radeon-rx-5600Van fullos 24CU-s igazi 5500XT is, nem kamu/csonkitott.

Van 20CU-s "5400" is, persze ebbol semmit nem fogunk latni.Radeon Pro 5600M, 40CU-val miert 5600? Amikor ez 5700XT es most mar hbm2-vel.

-

stratova

veterán

válasz

Petykemano

#46893

üzenetére

Petykemano

#46893

üzenetére

Szóval 1035 Mhz környékén mehet max a GPU órajel. HBM-mel meg már volt tapasztalatuk MacBookban Radeon Pro Vega 20/16-tal, csak azok egy kategóriával kisebb lapkák voltak.

Ha ezt hatékonyan le is tudják hűteni ügyesek. Azért ilyen kaliberű lapka eddig nem volt MacBookban, de szerintem en bloc ilyen méretű és kategóriájú gépben sem.

Bár most ahogy nézem a HP Envy 15 és DELL XPS 8930 is behúzta a 8 magos Intel 2060 MaxQ kombót, erre nyilván lépni kellett. -

Jack@l

veterán

válasz

Petykemano

#46883

üzenetére

Petykemano

#46883

üzenetére

AMD a legszarabb vga címre gyúr.

-

válasz

Petykemano

#46883

üzenetére

Petykemano

#46883

üzenetére

Javítalak:

ASUS: fogd meg a söröm

Nem az AMD erőltette ezt a kártyát, mielőtt még bárki elkezdene mocskos AMD-zni teljesen feleslegesen.

-

awexco

őstag

válasz

Petykemano

#46865

üzenetére

Petykemano

#46865

üzenetére

Lehet , hogy excluzívba kérték ...

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46874

üzenetére

Petykemano

#46874

üzenetére

A HBCC az egy vezérlő csak. A HBC-t pedig programból kell használni, ha az inkluzív cache módot akarod. Bele kell írni a programba, hogy a memóriában mely címtartományok a cache-elhetők.

Az exkluzív cache módhoz nem kell ez, de ilyenkor meg rengeteg rendszermemória kell.Az SSG az SSG API-val működik. [link]

CCIX-hez egy vezérlő kellene a processzorba, illetve a GPU-ba. Egyelőre az AMD csak Infinity Fabricben gondolkodik. Ahhoz van vezérlő már az egyes CPU/GPU-kban, és lesz mindegyik készülő komolyabb fejlesztésben. De ez nem kell egyébként az SSD-s dolgokhoz. Oda egy megfelelő memóriavezérlő kell, mint például a HBCC, illetve egy SSG API-hoz hasonló API, vagy például a Xbox Series X-es DirectStorage API és SFS PC-s verziója a Microsofttól. Egyik sem készül.

Azért kellene amúgy az utóbbiban gondolkodni, leginkább a DirectStorage API-ban, mert az ISA független lehetne (jó SFS ettől még nem lenne, de az se megoldhatatlan). Nem kellene a GPU-ba mondjuk x86/AMD64-es címfordítókat építeni (amihez ugye kellene x86/AMD64 licenc is), hogy működjön a rendszermemória felé egy HBCC-szerű megoldás. Egy API-val az efféle licencproblémák nem léteznének. Elvileg a Microsoft el tudná intézni a DirectStorage API-t PC-be. Olyan különösebben komoly követelményei azért nincsenek. Persze majd modernebb gépek kellenek hozzá, mert nem mindegy az SSD sem, de nem megugorhatatlan feladat ez. Csak ugye ezeket a GAB intézi, és a GAB-ban ha egy gyártó tenyerel a piros gombra, akkor nem lesz belőle semmi. Márpedig az Intelnek és az AMD-nek sem igazán érdeke egy DirectStorage API, mert csinálnak ők maguknak olyat, ami majd szépen működik AMD CPU+GPU-val, illetve Intel CPU+GPU-val, de semmi más kombinációval nem. Nagyon nem szívbajoztak azon sem, hogy saját interfészre zárják le a HPC-piacot, elvégre hogy megnyerte már nekik ez a trükk az USA három exascale rendszerét, és az NV nulla fejfájást okozott.

-

válasz

Petykemano

#46874

üzenetére

Petykemano

#46874

üzenetére

valamim ilyesmi jön Nvidia részéről az ampereben , biztos, nem marad el az RDNA 2 sem ebben.

-

Z10N

veterán

válasz

Petykemano

#46860

üzenetére

Petykemano

#46860

üzenetére

Marmint?

565 kent siman kiadhattak volna, mint a 7790-t anno, a kamu 590 melle. Inkabb ez, mint a hulladek 550. Ertelmesebb lepes lett volna, mint az RX400/500 szeriaba GCN1/2/3-t rakni. Csoda HBM-bol se kellett volna 4G, eleg lett volna 2G a HBCC miatt. Szerintem az 1600-t siman birta volna kis lapka leven. Erosebb az 560-nal, de az 570 alatt marad. My2c.

-

Petykemano

veterán

válasz

Petykemano

#46792

üzenetére

Petykemano

#46792

üzenetére

-

awexco

őstag

válasz

Petykemano

#46826

üzenetére

Petykemano

#46826

üzenetére

Lehet , hogy rx6xxx széria kap aluról pár pár Navi 10 et ? Bár ha rdna2 ténleg annyira ütős lesz akkor egyszerűbb lenne azokat megvágni .

-

válasz

Petykemano

#46817

üzenetére

Petykemano

#46817

üzenetére

Eddig ezek hol lehetettek, hogy a steam most kezdi bemérni?

Bányászgépbe!

Amúgy nem tudom. -

válasz

Petykemano

#46817

üzenetére

Petykemano

#46817

üzenetére

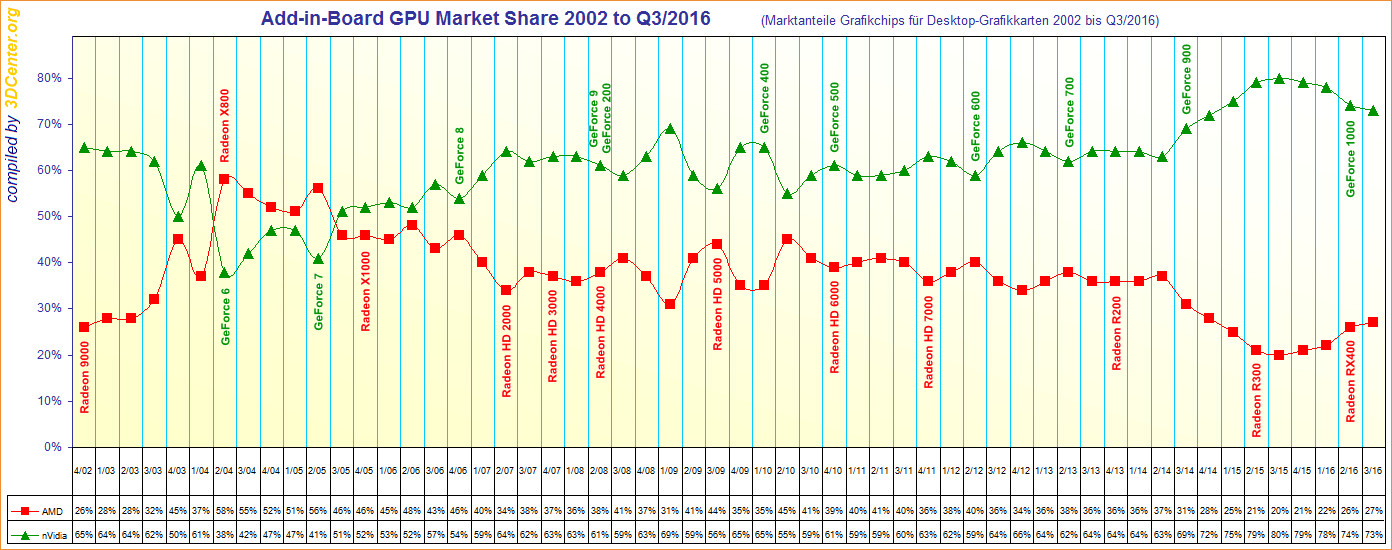

Megnézném, hogy alakult később ez az AiB market share grafikon, de nem találok sehol újabbat.

-

awexco

őstag

válasz

Petykemano

#46769

üzenetére

Petykemano

#46769

üzenetére

Órajelek tekintetében mennyire tápos ?

Most szúrtam ki , h lpddr5 ...

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46799

üzenetére

Petykemano

#46799

üzenetére

A primitive shader arra jó, hogy gyorsabb legyen a legacy kódok futtatása. Az RDNA dizájnok sebességet nyernek így, és a fejlesztőknek semmit sem kell tenniük.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46796

üzenetére

Petykemano

#46796

üzenetére

Semeddig. Ha ezt tényleg használni fogják, akkor az RDNA2-n kívül mindennek kampó.

-

awexco

őstag

válasz

Petykemano

#46792

üzenetére

Petykemano

#46792

üzenetére

Mi ez a dual Pipe dolog ? Dual gfx ? 🤔🤷♂️

-

awexco

őstag

válasz

Petykemano

#46769

üzenetére

Petykemano

#46769

üzenetére

Nem biztos ....Tudható , hogy samu rendelt mobilba radeont .

-

válasz

Petykemano

#46749

üzenetére

Petykemano

#46749

üzenetére

így van, és ezt írta Busterftw is.Ez az asszisztálás sajnos.

-

do3om

addikt

válasz

Petykemano

#46720

üzenetére

Petykemano

#46720

üzenetére

Akkor ebből a jóslatból legalább most kivételesen kimaradt.

-

awexco

őstag

válasz

Petykemano

#46720

üzenetére

Petykemano

#46720

üzenetére

Ahhoz képest kiadnak olyan lapkákat ami a pici darab szám miatt nem térülhetnének meg . Pl Radeon VII .

-

Valdez

őstag

válasz

Petykemano

#46697

üzenetére

Petykemano

#46697

üzenetére

Akkor van értelme talán, ha nem ugyanezen a node-on jön, hanem valami pipe cleaner megoldás lesz 7nm+-on vagy valami ilyesmi. Elvégre zen2 refresh is jön, remélhetőleg nem csak arról fognak szólni akkor ezek, hogy feljebb csavarjuk a feszültséget párszáz mhz-ért cserébe ugyanazon a node-on. A 5700-nak ez nem nagyon tenne jót performance/watt esetén.

-

awexco

őstag

válasz

Petykemano

#46693

üzenetére

Petykemano

#46693

üzenetére

Kíváncsi lennék rá , hogy egy 17 es tuf-ba 90 es aksival 5700 mobil változata mit tudna 4900h vagy hs mellett . Ahogy néztem nem vészesen gáz az 5600m de mindenhol nvidiát tesznek mellèjük kevés kivétellel .

-

GeryFlash

veterán

válasz

Petykemano

#46685

üzenetére

Petykemano

#46685

üzenetére

Simán a kicsit pénz temető VEGA projektet valahogy korrigálni kell, igazából jó megoldás beépíteni sok évvel később más termékekbe és akkor JIRA-ban le lehet zárni az epic-et sikeresnek

A másik az, hogy még ez is elég hogy leverjék az Intelt. Majd ha jön a Tiger Lake akkor időszerű lesz lereagálni egy RDNA-vel. -

GeryFlash

veterán

válasz

Petykemano

#46680

üzenetére

Petykemano

#46680

üzenetére

Jó ezt tudjuk hogy kamu.

-

#82819712

törölt tag

válasz

Petykemano

#46678

üzenetére

Petykemano

#46678

üzenetére

as all Ryzen “G” series APUs are based on Radeon Vega.

tudnának RDNA2-t adni hisz ott a konzolba látjuk

, csak irigyek nem adnak, ráfoghatják jó az most a konzolé

de CDNA-t meg miért nem? Miért Vega ? -

#82819712

törölt tag

válasz

Petykemano

#46675

üzenetére

Petykemano

#46675

üzenetére

PS5 APU 36 CU RDNA 2

tehát tudnának olyat

Jó nem RDNA2 de miért nem CDNA ? -

#82819712

törölt tag

válasz

Petykemano

#46652

üzenetére

Petykemano

#46652

üzenetére

Igen csak tudjuk hogy bár nem mondjuk ki az ilyen fórumokon de van a nemzetállam meg a háttérhatalom.

(petyke mindjárt megszólal na az megint háttérképet nézett )

)Kiteszek egy linket aztán jövök beszélgetni.

Open Gpu úgyse érdekel már senkit mindegy azért elmondom ma a Ryzen és RDNA optimalizálása a téma. (mélyvíz)

Grafikára vágyóknak kiteszek egy linket, nem tudom mi bajotok van a mai AMD grafikával (gameplay) ,

nincs baj csak az egér hiányzik picit

Na szóval az azért jól körülírható hogy hol kell a nemzetállamnak valami és Trumpnak és hol a háttérhatalomnak.

Az hogy odaviszik most Arizónába a TSMC gyárat az munkahelyeket teremt , megépíteni, és kevés dolgozó is a végén.

De ott ugye csak a DIE lesz (nyugi nem halt meg senki ez a nem a trónok harca.) AMD-nek ez nagyon kényelmes lenne, itt gyártani és itt eladni sokat...

de azt még össze kellene szerelni, CPU-vá GPU-vá.

Ahhoz bizony sokminden kell, és bár arizónában sok a homok de sok víz is kell, ritka fémek, és munkások akik összeszerelik.

Ahhoz meg komoly morál kellene hogy 3 műszakba betereljék az embereket, vaaaagy megy vissza Thayland-ra, Honkongba kínába összeszerelni. Itt már bukik Trump ötlete.

Az egy másik kérdés hogy ők rendelkeznek a föld chip tervező cégeinek 90%-ával és paráznak hogy nehogy hirtelen ne legyen nekik...

Iphone sem tudna mit kezdeni TSMC nélkül és kell Dél Korea is

Persze a Huaweinek azt mondja Te ide nem jössz Te nem veszed meg ezt azt. De mikor kell a vírus maszk akkor kína nem mondja hogy akkor neked sem... A ritkafémek na ott már remeg a léc. A háttérhatalomnak kellenek a zsíros üzletek erre jó lesz ott az Intel meg amíg felépül a gyár. Hirtelen rájöttek hogy nagyon sebezhetőek és amerika nem tud megélni a munka alapú piacon a háttrérhatalom licenszei éltetik azt a gazdaságot. Ha megnézzük mennyi a kínai hitelük egészen döbbenetes... -

Abu85

HÁZIGAZDA

válasz

Petykemano

#46620

üzenetére

Petykemano

#46620

üzenetére

Valószínűleg semmi. A CDNA nem hiszem, hogy alkalmaz külön részegységeket AI-ra. Szóval kétlem, hogy lesz kétféle formátum 32 bites operációkra. Az NV-nek azért van, mert a szabványos előírások miatt a fő ALU-kkal mindenképpen IEEE 754-nek megfelelő lebegőpontos adattípusok kellenek. Ezek hátránya viszont, hogy bonyolultabb hardvert követelnek. Viszont tenzorban igazából nem szükséges ennyire kötötten tervezni. Jó az IEEE 754-nek nem megfelelő lebegőpontos adattípus, amivel sokkal egyszerűbb lehet a hardver. Persze így nem lesz mindenre jó, de lényegében csak mátrixszorzást akarsz azokkal a tenzorokkal, tehát nem is követelmény, hogy a gépi tanuláson kívül másra működjön.

Az NVIDIA nevezi A100-nak. [link]

Mostantól a GPU kódneve maga a terméknév is. Az ő döntésük, különösebb jelentősége nincs. -

Abu85

HÁZIGAZDA

válasz

Petykemano

#46612

üzenetére

Petykemano

#46612

üzenetére

Az új Titán azért nem az A100-zal gyün, mert annak a számítási kapacitása csak 19,5 TFLOPS, és ehhez neki 400 watt kell. Na most, ha azt leviszed 250 wattra, akkor abból marad kb. 15 TFLOPS, amit most elkapnak a combosabb GPU-k, nemhogy egy új generációs csúcs-Navi.

-

do3om

addikt

válasz

Petykemano

#46581

üzenetére

Petykemano

#46581

üzenetére

Lehet azért mert ez az új polaris

![;]](//cdn.rios.hu/dl/s/v1.gif)

Majd kiadják még párszor ha még marad készlet. -

Jack@l

veterán

válasz

Petykemano

#46581

üzenetére

Petykemano

#46581

üzenetére

Mert kb 0 munkával megoldható...

-

#82819712

törölt tag

válasz

Petykemano

#46581

üzenetére

Petykemano

#46581

üzenetére

Nem biztos hogy csináltak , mivel kicsi az eltérés jobb kihozatal is elérheti a magasabb órajelet, de ha csináltak akkor a a jobb hatékonyságot energiafogyasztásra is költhette, így is megmagyarázná a dolgot. 295W -> 250W

-

#82819712

törölt tag

válasz

Petykemano

#46579

üzenetére

Petykemano

#46579

üzenetére

70% ban azért most mert most van NV bejelentés és ez tudott időzített, és jól mutat a quadro 5000 0.3 TFLOPS értéke mellett a PRO VII 6.5 TFLOPS-a,( nem írtam el előbb, tényleg quatro van odaírva a VC táblázatba!)

Persze mi ezt tudjuk hogy ez egy döntés kérdése.

Csináltak egy halálcsillagot fotontorpedós fézermező bejárattal

és a kis LUKE most mászik be mellette a PR szervíz alagúton

30%-ban azért most mert Te is mutattad a tanúsítványokat hogy most jön ki 2-3 dolog tehát ez már tervezett.

és 20% azért mert most van nekik valószínű egy sample termék 7nm valami ami talán az EUV vagy más amivel le tud mérni pontos

ezt pedig a FP 32 eredményeken látod 13.1 TFLOPS- > 13.4 TFLOPS

ez egy valószínű magasabb MHz eredménye.

és hogy hogy jött ki a 120% ? ..

hát úgy hogy ez egy PR működését leíró bemutató volt

az 1TB/s sávszélesség meg a PCI E4 meg adott.

Magyarán holnap ciki lesz ezektől az értékektől kevesebbet bejelenteni, ráadásul úgy hogy igazándiból be sem jelentetted, ez a jó a szivárogtatásokban hogy bizonyíték nélkül rombol.

azt meg Abutól kérdezd meg hogy a 3.5 ből hogy lesz 6.5 és driver átsütve mi lenne a helyzet...

és driver átsütve mi lenne a helyzet... -

#82819712

törölt tag

válasz

Petykemano

#46577

üzenetére

Petykemano

#46577

üzenetére

Jó hát holnap jön az Új turing aztán kellett csinálni gyorsan egy táblázatot hogy szanaszéjjel kaszabolja a Quarto RTX 5000 Quarto RTX 6000-et FP64 be,

sokkal nagyobb 1 TB/s -es memória sávszéleséggel és azokon

csak gen 3 volt

értsed már az üzenetet na

-

#82819712

törölt tag

válasz

Petykemano

#46574

üzenetére

Petykemano

#46574

üzenetére

-

válasz

Petykemano

#46574

üzenetére

Petykemano

#46574

üzenetére

Na végén még josgombot kell vennem Ampere helyett

[link]

[link] -

Abu85

HÁZIGAZDA

válasz

Petykemano

#46546

üzenetére

Petykemano

#46546

üzenetére

Az említett nagyok stúdióinak megvan ahhoz az erőforrásuk, hogy saját eljárásokat fejlesszenek. Csak az olyan dolgok érdekelhetik őket a FidelityFX-ből, amelyek például nagyon egyediek. Például CAS, SPD, LPM.

(#46547) Jack@l: Például hány játékban van ezek közül valamelyik (mondjuk tekintsük az elmúlt egy évet, kb. azóta létezik a FidelityFX, amit ugye az említett időintervallumban 15 játékba építettek be):

NVIDIA Blast

NVIDIA FleX

NVIDIA Flow

NVIDIA HairWorks

NVIDIA HBAO+

NVIDIA Turbulence

NVIDIA TXAA

NVIDIA Volumetric Lighting

NVIDIA VXGI

NVIDIA WaveWorksMeg is nézted a forkokat, hogy milyen régi motorverzióhoz vannak? Mert ugye egy csomó dologról le kell velük mondani, emellett ugye nem main branch egyik sem, tehát az Epic nem fogja támogatni. Egy Unreal Engine-t választó fejlesztő ma minimum 4.22-es motorverziót választ a gyors build miatt, de akár a 4.25-ösre is ugorhat. Nézd csak meg, hogy az említett GameWorks effektek közül mennyinek van ezekre...

Ha az NV-nek vannak ezekre megoldásai, akkor biztos nem esik nehezedre ide belinkelni az NVIDIA adaptív kontraszttal dolgozó élesítő eljárását, a sztochatikus SSR-jüket, az adaptív AO megoldásukat, az ALU-alapú tone és gamut mapping kiegészítőjüket, illetve az egyfázisos MIP generálójukat.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46542

üzenetére

Petykemano

#46542

üzenetére

"Persze azon el lehet dünnyögni, hogy a google, a MS és a Sony ebből esetleg hasznosít valamit, amit aztán a PC-n a Gameworks miatt kidobnak."

A Google, az MS és a Sony ezek közül nem szokott hasznosítani semmit. Nem fejlesztők.

A Gameworks miatt pedig manapság pláne nem dobnak ki semmit, mert ma már senki sem erőlteti a Gameworksöt, még az NVIDIA sem. Leírtam, hogy miért.(#46544) paprobert: A CAS csak a FidelityFX licencével érhető el. Az, hogy valami nyílt forráskódú, még nem lehet más tulajdona. Ugyanúgy licencelni kell az AMD-től, csak a felhasználás módja sokkal szabadabb, mint zárt kóddal.

Az NVIDIA nem szállítja a CAS-t a driverben. A CAS egy kontraszt adaptív megoldás az sharpenre. Még az AMD sem szállítja, mert maga a CAS nem jó driverbe. Ez az AMD driverében át van alakítva, így egy a kód PAL-ban van megírva és RIS az eljárás neve, ami a CAS-nak egy olyan szinten butított verziója, hogy nem támogat különböző skálázási lehetőségeket, amik driverben amúgy nem működnének. Az NVIDIA a saját meghajtójában korábban luma sharpen (még a FreeStyle időkből), majd az új verziókban egy high pass sharpen megoldást alkalmaz. Ezek a ReShade-ből származnak. Erre például azért nem épül konkrét játékokba szánható effekt, mert nem kontraszt adaptív maga a szűrés, tehát nem tud igazodni a megjelenített képhez. Ez elég nagy különbség, mert a high pass sharpen szűrő nem működik igazán jól azokban a jelenetekben, amikor sötétebb a környezet. Konkrétan megtörténik az élesítés, de magával hozza mellékhatásként a kontraszt növekedését. Az AMD CAS/RIS pont annyiban különbözik a tradicionális élesítésektől, hogy ezt a problémát az adaptív mivolta miatt nem nyeli be, miközben az élesítést így is megcsinálja.

Végeredményben a CAS nem azért sikeres, mert élesít, erre már rengeteg alternatív megoldás született. Azért építik be a fejlesztők, mert a korábbi alternatívák úgy élesítettek, hogy voltak képtorzító mellékhatásaik. Egy élesítésnél pedig élesíteni akarsz, és nem akarod, hogy negatív irányba manipulálja a képet. Az NVIDIA ezért nem kínálja a saját sharpen eljárását külön fel a fejlesztőknek, mert igazából nem adaptív, kb. ugyanazok a hátrányai, mint a motorokba eleve beépített sharpen szűrőknek, tehát a fejlesztők a licencelésével nem lennének előrébb.

Egyébként az NVIDIA licencelhetné az AMD CAS-t, és onnan lehet megtudni, hogy megtették-e, hogy felkerülnek ennek az oldalnak az aljára, mint FidelityFX partnerek. [link]Az integrált CAS-nak semmi köze a meghajtóhoz. Sosem hívhatja meg egy alkalmazás a meghajtóba épített RIS-t. Nem kompatibilis a HLSL és a GLSL nyelvekkel a PAL. A CAS-t úgy kell integrálni, hogy magában az alkalmazásban fusson valamilyen shader nyelven. Ez különösen fontos, hogy egyáltalán működjön a konkurens gyártók hardvereivel is, mert az AMD rendszerein kívül semelyik hardver nem értené meg a PAL kódot.

-

paprobert

őstag

válasz

Petykemano

#46540

üzenetére

Petykemano

#46540

üzenetére

Így van, ezek fejlesztőknek szánt funkciók, a végfelhasználót nem kell hogy érdekelje.

Ha van közötte olyan, amit tudnak az engine fejlesztők használni és gyártófüggetlenül előnyös, akkor legyen, tolja be az AMD az UE4-be és a Unity-be őket, és akkor örülés van.

Egy sokadik post process AO tényleg nem fog lázba hozni senkit.(#46541) Abu85

A CAS-et túlságosan is FidelityFX exkluzívként állítod be.

Annyira jól portolható, hogy már az NV is szállítja driver szinten.

Sőt, annyira jól portolható, hogy a "támogatás" tulajdonképpen csak egy flag a drivernek, hogy ne futtassa kétszer az élesítést ha valaki driver szinten is bekapcsolná. -

Abu85

HÁZIGAZDA

válasz

Petykemano

#46540

üzenetére

Petykemano

#46540

üzenetére

Nagy tévedés. Egyrészt a GameWorksről már azért nem beszélgetnek, mert lassan kikopik a játékokból. Nem működik úgy az effektek beépítése, hogy black box az egész, és a motort kell módosítani, hogy működjön. Erről az Ubisoft tudna mesélni az AC: Unity és a GeometryWorks kapcsán, ami be lett harangozva, de sose jelent meg: [link] . És nem egy ilyen aktív Gameworks projekt fuccsolt be, hanem csak az Ubisofton belül a tervezet implementációk kétharmada sosem lett megcsinálva. Egyszerűen nem működtek, és a működés elősegítéséhez az NVIDIA nem volt hajlandó módosítani a forráskódot, a motort pedig hónapokig tartott volna átírni, hogy eredményt érjenek el, és rohadtul nem támogatta a kiadó, hogy a játékok motorját alapjaiban módosítsák, amikor maga a játék már ki van adva.

Ugyanakkor a GameWorks nem volt egy halott ötlet, csak ahogy megvalósították az alapvetően akadályozta, hogy ebből bármi is legyen hosszabb távon. Ha az Ubisofton belül az erre irányuló projektek kétharmada kaszát kapott, akkor az egészen rossz arány, mivel egy csomó pénzt költesz olyan dolgokra, amiből végül nem lesz semmi. Ezért sem erőlteti már az NVIDIA sem, mert nagyjából mindenki rájött, hogy egy masszív pénznyelő az egész, aminek sokszor eredménye sincs. Effektíve hasznosabb az erre szánt pénzzel befűteni a stúdiók épületeit.

A GameWorks viszont pont a FidelityFX alapötletét adta, mert az NV jól látta, hogy a stúdiók mire vágynak, csak nem értette, hogy mennyire fontos a nyílt forráskód. Az AMD tehát nem tett mást, mint lemásolta a GameWorks koncepcióját, csak éppen a sokat kritizált hibái nélkül, amik miatt nem tudott például megjelenni a GeometryWorks az AC: Unity-hez, ésatöbbi. Ez egyelőre sikeres, mert a CAS-t rengeteg cég implementálja, vagy implementálta már egy vagy több projektbe: Saber, Luminous, Codemasters, Ubisoft, NetEase, WB Games, Capcom, Stardock, Unity, Rebellion, QLOC, Teyon, Qearbox, Shiver, Croteam, Exor, Netherrealm. Ők azok a partnerek, akiknek a CAS igénylésén túl van egy reklámszerződésük az AMD-vel.

A játékok szintjén eddig a CAS ezekbe a címekbe lett integrálva:

Resident Evil 3

Borderlands 3

Tom Clancy’s Ghost Recon Breakpoint

Gears 5

Monster Hunter World: Iceborne

Star Control: Origins

World War Z

F1 2019

NiShuiHan

22 Racing Series

Anno 1800

Shadow of the Tomb Raider

Mortal Kombat 11

STAR WARS Jedi: Fallen Order

Hitman 2Annyit tudni a tegnapi bejelentéssel kapcsolatban, hogy a CAS továbbra is nagy sikernek örvend, így több új játékba érkezik, illetve továbbra is lesznek olyan fejlesztők, akik visszaportolják a már megjelent játékukba. Annyian jelezték már a CAS használatát, hogy nem sorolták fel.

Az új eljárásokkal kapcsolatban az új effekteket is fogják alkalmazni a fejlesztők, többen is, de a fő figyelem jelenleg az SDP-re és az LPM-re irányul, mert ezek olyan problémákra reagálnak meg, amelyeket korábban senki sem próbált megoldani. Például az LPM-mel rengeteg időt lehet nyerni a HDR integrálása szempontjából. Az idő pedig pénz. Ez lesz talán a leginkább alkalmazott megoldás az újítások közül, mert jobb minőséget eredményez kevesebb idő alatt, vagyis kevesebb pénzt kell költeni a játékra, miközben a végeredmény szebb lesz.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46503

üzenetére

Petykemano

#46503

üzenetére

Annyiban nem mindegy, hogy hogyan osztod el a PCI Express sávokat. 8x-8x az ideális akkor is.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46498

üzenetére

Petykemano

#46498

üzenetére

A B450 idejében még javában voltak hitelesítések és licencek, mert abban reménykedett az AMD és az NV, hogy életben maradhat a CF és az SLI, de azóta már lassan lelövik őket. Ilyen formában az alaplapokra vonatkozó hitelesítés és licencelés is eléggé visszaesett. Tehát ma már egy alaplapgyártók nem számít arra, hogy CF-et vagy SLI-t használ majd a felhasználó, arra számít, hogy majd valami explicit API-n keresztüli multi-GPU-t fog futtatni, arra pedig se hitelesítés nem kell, se licenc. Konkrétan kihagyható az a mikrokód is, amire korábban szükség volt. Ezért lett olcsó az implementálás. Gyakorlatilag elég felrakni egy extra slotot, kivezetni a sávokat, és innentől kezdve nincs semmilyen tesztköltséged, és mikrokódból adódó licenc és hitelesítési költséged, plusz a kötelező terméktámogatás, ami szintén rohadt drága volt.

Mivel a gyártók kezéből minden lehetőséget kivett a Microsoft, így az, hogy mi lesz leginkább a fejlesztőkön múlik. A gyártók a hardvereken kívül többet nem tudnak hozzátenni. Ez akkor hidalható át legközelebb, ha készítenek a gyártók egy olyan interfészt, ami kellően gyors, és memóriakoherenciát biztosít a lapkák között. Az valóban visszaadna némi kontrollt a gyártóknak, de ez amúgy inkább hardveres dizájn lenne, mint szoftveres vagy firmware-es. Eleve azt csinálnák a memóriakoherenciával, hogy a két GPU-t egynek mondanák a rendszer felé.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46491

üzenetére

Petykemano

#46491

üzenetére

Igen egyszerűsödött. Korábban ahhoz, hogy több GPU-t támogass kellett szervizkönyvtár, az abban definiáltak szerint két teljesen eltérő kód a gyártókra, majd arra lehetett a meghajtóban írni támogatást, de ha az nem volt jó, akkor át kellett írni a programban, stb. Tehát nem csak az API-n múlott az egész, hanem az API mellett a szervizkönyvtárakon, illetve a meghajtókon. Az explicit API-kkal ezek nem léteznek már. A legegyszerűbb megoldás meghívni a WDDM-be épített AFR-t. Ez olyan mintha egy szervizkönyvtár lenne, azzal a különbséggel, hogy egységesítve van a gyártók között, tehát kötelező a meghajtó oldaláról ugyanúgy kezelni. Ezt a Microsoft felügyeli. Ha az adott motor nem csinál semmi jelentős interframe kommunikációt, akkor elég meghívni a WDDM AFR-jét, és az megcsinál mindent automatikusan. Jelentősebb interframe kommunikáció mellett azért írni kell egy saját megoldást, de az is sokkal egyszerűbb, mint a régi driveres modellt kezelni. Ilyen, motor szintjén kezelt AFR-t használ például a Frostbite, az Asura, stb., illetve tulajdonképpen a Nitrous is, csak ott van még némi extra fázis, hogy kezelhető legyen két eltérő gyártó.

Nem tudhatja senki előre, hogy ki mit szeretne. Alapvetően a több GPU támogatása nem nagy költség az alaplap szintjén. A licencek voltak azok, meg a hitelesítés még az explicit API-k előtt, de ma már ugye ezek nem kellenek, az explicit API-kba épített megoldások akkor is működnek, ha az alaplapgyártók egy fillér hitelesítési és licencköltséget sem fizetnek az AMD-nek és az NV-nek. Tehát effektíve az egész annyiból áll, hogy kivezetik a sávokat és kész. Semmi extra költsége nincs a mikorkód szintjén már. Ez az oka. Licencek és hitelesítés nélkül olcsó lett.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46489

üzenetére

Petykemano

#46489

üzenetére

Mert ugye a DirectX 12 és a Vulkan játékok megoldják ezt a kérdést maguktól. Elég sok explicit API-t használó program támogatja legalább a WDDM beépített AFR-jét. Régen azért volt nagy baj a több GPU-s módokból, mert nem teljesen az alkalmazás feladta volt, hanem meg volt osztva a meghajtó és az applikáció között a probléma. Ilyen formában a fejlesztők nem nagyon tudtak erre minőségi támogatást írni, mert gyakorlatilag meghajtónként változott a minőség. Az explicit API-kkal viszont kiszámítható lett, jóval kevesebb munkából megoldható a jobb minőség, és attól sem kell félni, hogy a gyártó drivere elcseszi a működést, tehát a support költségek is minimálisak.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46484

üzenetére

Petykemano

#46484

üzenetére

Igen, ezt írtam a híremben.

Nem jelent amúgy semmit, ez csak egy lehetőség. Nem kötelező vele élni, csak korábban a B450-nél nem is volt ez önmagában lehetőség.

A jelentősége annyi, hogy B550-hez is lehet majd SLI licencet kérni, de ugye már ezt is egyre kevesebb alaplapgyártó fizeti meg a felsőházban, mert az SLI sem működik DirectX 12 és Vulkan alatt. Oda már nem kell licenc a gyártóktól, hogy összekapcsolj két GPU-t, az alkalmazásnak kell támogatni.

-

válasz

Petykemano

#46470

üzenetére

Petykemano

#46470

üzenetére

én is azt gondlom, meg hát tartogatni kell valamit a nyári geforce bemutatóra is

vagy fordítva, Nv tartogat addigra, mindegy honnan nézzük. mindkét cég egymáshoz trollkodik

vagy fordítva, Nv tartogat addigra, mindegy honnan nézzük. mindkét cég egymáshoz trollkodik

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46425

üzenetére

Petykemano

#46425

üzenetére

Vagy a Sanyi lapkája jár alacsony órajelen. Bár inkább a 80-ra szavazok én is.

Nem hiszem hogy Threadripper. Régóta pletykálják, hogy a Zen 3 CPU chiplet 48 MB L3-at kap.

-

TESCO-Zsömle

titán

válasz

Petykemano

#46361

üzenetére

Petykemano

#46361

üzenetére

Én láttam/használtam felpimpelt MC-ot és már ott is jók voltak a cuccok, de ez szebb. Egyszerűen jobbak tudnak lenni a fények.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46334

üzenetére

Petykemano

#46334

üzenetére

Eredetileg az E3 lett volna a bemutató, ahogy azt szokta csinálni az AMD. De nem tudom, hogy az E3 törlésével mi lesz majd.

-

válasz

Petykemano

#46306

üzenetére

Petykemano

#46306

üzenetére

Engem például nagyon rég kérdezett a Steam, pedig automatikusan indul és minden nap be van kapcsolva a gépem.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46306

üzenetére

Petykemano

#46306

üzenetére

Amennyire le se szarják az adatok értelmezését, gyakorlatilag semmi esélyt nem látok rá.

Az meg tök mindegy, hogy egy játékot min játszanak. A fejlesztésre használt hardverről nem ez dönt, hanem mondjuk az, hogy lehet-e rajta normálisan fejleszteni. Attól nem lesz jobb egy fejlesztőnek, hogy GeForce-on játsszák többen a játékát, de eközben a RenderDoc csak RGP interoperabilitást kínál. Kitörölheti az információval a valagát, ha a debug eszközről nagyon nehéz átvinni az információkat a profilozóba. Valószínűleg az Unreal Engine 4-et sokkal többen használják GeForce-on, mégis le kellett cserélni a VGA-kat Radeonra a Vulkan porthoz. Ennek az oka a RenderDoc volt, amibe csak az AMD profilozójára van kiemelt támogatás.

Ugyanez volt a No Man's Sky esetében is. Azzal a különbséggel, hogy ott a Vulkan portra nem oldották meg a megjelenésre a jó teljesítményt GeForce-on. Hiába játsszák a játékot sokan ilyen hardveren, ha nincs eszköz, amivel optimalizálni lehetne rá. Az NV egyébként ezt a problémát éppen pár hete oldotta meg a Vulkan esetében, noha RenderDoc interoperabilitás még mindig nincs, de legalább már nem lehetetlen feladat az optimalizálás. Csak az a baj, hogy eközben az AMD memóriaelemzőt fejlesztett, tehát megint egy lépéssel előrébb vannak. Ezek döntenek arról, hogy min fejleszt egy fejlesztő.

-

#82819712

törölt tag

válasz

Petykemano

#46295

üzenetére

Petykemano

#46295

üzenetére

és mennyi lesz a 8GB GDDR6 polaris ? 99

érted alsó kat 99 közép kat 180 felső kat 360

minden is rendbe van

-

beef

őstag

válasz

Petykemano

#46287

üzenetére

Petykemano

#46287

üzenetére

Így már világos!

-

válasz

Petykemano

#46270

üzenetére

Petykemano

#46270

üzenetére

Persze, mint minden ilyen esetnek, ez a lényege a sértett fél felé.

-

válasz

Petykemano

#46267

üzenetére

Petykemano

#46267

üzenetére

Most , hogy utánanéztem módosítom mert egy védetlen és kódolatlan szerverről származnak az AMD től.. [link] , bár updatelték a cikket, AMD nyilatkozatával.. aztán hogy ki mond igazat... szerintem ez egy önkéntes akció.

-

válasz

Petykemano

#46267

üzenetére

Petykemano

#46267

üzenetére

célozni arra célzok, hogy ha valaki egyáltalán lopatta és nem önkényes dolog áll a háttérben és az Xbox felépítésére / tudására szüksége volt az nem hinném, hogy az Nvidia ,mikor hivatalosan is meg tudták oldani sőt szerintem meg is oldották, ha a Microsofttal így együtt dolgoztak...( szóval: igen, akár nekik is érdekükben állhatott, bár kétlem, hogy erre szükségük volt)

-

válasz

Petykemano

#46260

üzenetére

Petykemano

#46260

üzenetére

Ez ügyben a versenytárs a Sony, nem az Nvidia. Ráadásul nem hinném, hoyg annyira hülyék hogy GitHubon kívánják a részleteket megkapni

A sony még specifikációkat sem igazán közölt az utolsó pillanatig, ráadásul kész gépük sincs. Volt infó még 1 éve hogy GCN alapú lesz nem RDNA stb..

Nvidia együtt dolgozott a Microsofttal az új konzolon a Dx12 U fejlesztésén ezért nagyon valószínű , hogy hivatalosan és legálisan már képben voltak az Xbox lehetőségeivel és felépítésével is +ha megnézed nagyon sok mindenben hasonlóan úgy oldották meg az Xbox RT hardveres felépítését ahogy a Turingokban van és ez egy 2 éves széria ami ráadásul el is tolódott kiadásilag a bányászat miatt , azaz legalább 4 éve létezett tervezési fázisban,. Fordítva gondolom a dolgot, ki-kiről és merre fejlesztett. -

paprobert

őstag

válasz

Petykemano

#46260

üzenetére

Petykemano

#46260

üzenetére

Csak egy erősen elméleti felvetés: tudni azt, hogy az ellenfelem stratégiája sz*r, még nem teszi jobbá a saját termékemet.

De persze látom a pozitív hozadékát annak, ha valaki felhasználta ezeket. -

válasz

Petykemano

#46260

üzenetére

Petykemano

#46260

üzenetére

Eszembe jutott, amit a Pepsi lépett a Coca Cola receptje kapcsán, de lehet csak mert piros szemüveges vagyok, bár bevallom, kólában kék.

(#46262) Petykemano: jogos, nem tényekről beszélünk, csak sejtésekről, finomítottam is.

-

Carlos Padre

veterán

válasz

Petykemano

#46239

üzenetére

Petykemano

#46239

üzenetére

Azt azért tegyük hozzá, hogy az a "fél világ" gyakorlatilag egyenlő az olyan netes fórumhuszárokkat, mint te vagy bé, szóval érted

-

válasz

Petykemano

#46239

üzenetére

Petykemano

#46239

üzenetére

értem mire gondolsz, jó volt a példád.

-

paprobert

őstag

válasz

Petykemano

#46239

üzenetére

Petykemano

#46239

üzenetére

A custom elég sok mindent tud jelenteni.

Ebben a cikkben semmi konkrétum nincs, csak az látszódik, hogy a wccftech-nek írnia kellett, hogy legyenek látogatók.

Nem kell túlgondoni, a visszafele kompatibilitás supportja, a GPU cache fölötti nagyobb kontroll már kielégíti a custom definícióját.

-

#82819712

törölt tag

válasz

Petykemano

#46204

üzenetére

Petykemano

#46204

üzenetére

Tudjátok mi a vákuum és a semmi között a különbség?

Na pont ez volt rá a példa amit mondtál.

Van két nagyon érdekes aspektusa a történetnek.

Egyik hogy nem arról van szó hogy a PS5 rossz lenne csak az előadás volt az és most itt elharapom a példámat...

36 CU annyit tesz nem csak a Big Navi de ha lesz alatta kártya 5800 6700 RT ?? akkor az is el fog boldogulni a Ray Tracinggel.

Igen a jogok egy érdekes kérdés, látod mind a két fejlesztést de ha nem fizetsz bele akkor nem használhatod fel magadnál.

Gyönyörű erős APUk amik nem jönnek ki PC-re. Pedig tarolna egy Last OF US 2 AMD exclusivvel

Valószínű azonos mérnököket sem oszthatnak be az ipari kémkedés elkerülése érdekében, de hogy érted ott az AMD ebédlőjében de megnézném ahogy ezek nézegetik egymást gúnyosan:

- Na nézd jön a ps5-ös kokka

és aki eddig kitartott az olvasásban annak elmondom ma sem maradunk magunkra előadás nélkül Jeej

A GDC elmaradt ugyan ! de ezt szeretnék valahogyan kompenzálni.

virtuális DirectX fejlesztői nap van MA a Mixer-en!

"A Microsoft DirectX csapata, az AMD és az NVIDIA partnereivel együtt, egy olyan beszélgetés sorozatot közvetít (STREAM), ami arról szól, hogy miként jelenik meg a játék grafika a jövőbe, izgalmas új funkciókat vezet be, bemutatunk még soha nem látott demokat, és belemerülünk mind a PIX-be, mind a shader fordítók világába."

Jó szórakozást aztán gyertek ide megbeszéljük! -

DudeHUN

senior tag

válasz

Petykemano

#46186

üzenetére

Petykemano

#46186

üzenetére

Elméletileg pár érdekes technológiát fog beletenni a gépbe a Sony. Ami nem biztos, hogy a számokon lovagló közönséget fogja boldoggá tenni. Meglátjuk. Mindenesetre érdekes lesz a mai ötkor kezdődő prezentáció.

-

#82819712

törölt tag

válasz

Petykemano

#46151

üzenetére

Petykemano

#46151

üzenetére

a dedikált magokat is munkára bírják ??

A SETI-nek is megvan a végeredménye. de nem akarok SPOILERezni nézzétek meg magatok.

Szóval visszatérve volt egy jóféle megoldás a memória megosztásra az OS és a GPU között és nem lett belőle semmi.

Alapvetően az ilyen alaplapra integrált megoldások mint ez is a nagyoknál elhal, pedig egyértelműen törhetne magának új piacot vele. -

hokuszpk

nagyúr

válasz

Petykemano

#46151

üzenetére

Petykemano

#46151

üzenetére

-

Komplikato

veterán

válasz

Petykemano

#46148

üzenetére

Petykemano

#46148

üzenetére

Mi van a Feng Huang procival?

-

Z10N

veterán

válasz

Petykemano

#46123

üzenetére

Petykemano

#46123

üzenetére

Akkor megint a szokasos amd-s marketing atb@szas megy, aka 580-2048sp, aka 560D, etc.

Pedig 12nm-es lapkaval meg lett is volna ertelme, aka R5 1600AF, de megint sumakol az RTG."This is without a doubt a continuation of misleading product naming by AMD and this is likely why we won’t see this model on different markets. AMD’s Polaris 20 is a 14nm processor, while Polaris 30 is 12nm. The latter offers more headroom for higher clocks and there is no logical reason to call the new model an RX 590. Yet, here we are."

"In fact, the RX 590 GME is around 5% slower than non-GME. In terms of overclocking, the reviewer at Expreview basically gave up, because even an 80 MHz uplift resulted in issues. In other words, the RX 590 GME is basically a rebranded and overlocked RX 580." -

Petykemano

veterán

válasz

Petykemano

#46045

üzenetére

Petykemano

#46045

üzenetére

[link]

590 gme = P20XTX

Tényleg csak a szokásos: kínában ugyanaz eggyel nagyobb számozás + betűk -

Callisto

őstag

válasz

Petykemano

#46111

üzenetére

Petykemano

#46111

üzenetére

Mégsem érted...

-

#82819712

törölt tag

válasz

Petykemano

#46111

üzenetére

Petykemano

#46111

üzenetére

/me megbök Petykemanó. Te figyi már hogyhogy itt van Abu és nem kezded el idegesíteni a szokásos témátokkal ?

-Hogy hogy a konzol RDNA2 ??? hát nem egy portfólióból válogatják össze teljes RDNA2 ? És a Ray Tracing-es konzolport PC-re akkor ütje a 2080 TI-t mert ugyanazon a hardveren fut itt iiiiis ?

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#46109

üzenetére

Petykemano

#46109

üzenetére

A lényeg nem ez, hanem a csomagolás. Az RPM-nél csomagolod az operációkat, hogy ugyanazon a SIMD-en több operációt végezhess el és/vagy feleannyi regisztert kelljen allokálni. Ez a koncepciója.

Az FP16 ennek az egyik eszköze, de ez önmagában csak egy adattípus. -

Abu85

HÁZIGAZDA

válasz

Petykemano

#46106

üzenetére

Petykemano

#46106

üzenetére

A rapid packed math nem egyenlő az FP16-tal.

-

TESCO-Zsömle

titán

válasz

Petykemano

#46099

üzenetére

Petykemano

#46099

üzenetére

Szóval akkor lesz 2080Ti-t verő Radeon, de 1500$-ért?

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

Állásajánlatok

Cég: CAMERA-PRO Hungary Kft

Város: Budapest

Cég: PC Trade Systems Kft.

Város: Szeged

)

)![;]](http://cdn.rios.hu/dl/s/v1.gif)