Hirdetés

- Samsung Galaxy A52s 5G - jó S-tehetség

- Milyen okostelefont vegyek?

- Poco X8 Pro Max - nem kell ide sem bank, sem akkubank

- MIUI / HyperOS topik

- Szívós, szép és kitartó az új OnePlus óra

- Megint Samsung-gyártott Snapdragonról pletykálnak

- iPhone topik

- Két új Poco C-széria mobil érkezett

- Honor Magic 8 Pro Air a neve, január 19-én mutatják be

- Xiaomi 14T - nem baj, hogy nem Pro

-

Mobilarena

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Abu85

HÁZIGAZDA

válasz

Yutani

#72441

üzenetére

Yutani

#72441

üzenetére

Ha kiadják csak úgy, ahogy eredetileg tervezték, akkor több helyen rosszabb lenne az FSR 4 képminősége RDNA 2/3-on, mint az FSR 3 képminősége, mert nem az Int8 neuronhálóra szabták a rendszert. A kérdés innen az, hogy ezt hogyan érdemes javítani. Az egyik irány, amerre elindultak, hogy legyen a képminőség megegyező az RDNA 4-gyel, és akkor így menjen RDNA 2/3-on. Ezt akarta a Valve is a saját portjával. De ez sem működik, mert túl lassú lesz tőle az RDNA 2/3, és emiatt van az, hogy a Valve is arra a következtetésre jutott, hogy az aktuális kód csak RDNA 4-en fut jól a teljesítményt és minőséget tekintve.

Innen alakult konkrétan három másik irány, hogy akkor az RDNA 2/3-on el kell felejteni a hagyományos FSR 4-et, az nem megvalósítható, helyette viszont lehetne egy ML FSR, ami jobb az FSR 3-nál. Ilyet jelenleg párhuzamosan csinál az AMD, a Sony és a Valve is. Lehet, hogy nem fog mind elkészülni, mert elég, ha az egyik megvan, és az portolható mindenhova.

Annyi biztos, hogy az FSR 4 abban a formában, ahogy aktuálisan működik nem megvalósítható RDNA 2/3-on. Ha az lenne, akkor a Valve engedélyezte volna ezekre a saját portját, vagy a Sony sem írta volna át a PSSR 2-höz.

Igazából a gond az, hogy hardverelemet nem tudnak utólag belerakni a GPU-ba, tehát amikor az FSR 4-nél eldöntötték, hogy mi lesz a matrixelrendezés és az alkalmazott formátum, akkor már ott megpecsételték az RDNA 2/3 sorsát, mert nem tudták hozzáoptimalizálni a kódot azokhoz. Ez akkor működött volna több architektúrán, ha a tervezés során nem azokat a döntéseket hozzák meg, amiket meghoztak, de akkor meg a minősége nem lett volna olyan jó az FSR 4-nek. Ezt az eltérés sosem fogják átlapolni szoftveresen, mert nem tervezték erre az RDNA 2/3-at. Ha valaha is akarnak ezekre gyári szinten ML FSR-t, akkor úgy kell megírni a kódot, hogy az RDNA 2/3 dizájn adottságait vegyék figyelembe, de az sosem lesz FSR 4 minőségű.

Az AMD nem foglalkozik a JPR méréseivel, mert ők azt látják jelenleg, hogy nő a GPU-eladásuk negyedévről negyedévre és nem csökken. Ami csökken az a konzolokból származó bevétel. Az most Q4-ben már alig volt több 100 millió dollárnál, de az életciklus végét járja a csomag, tehát ez nem probléma, már rég visszatermelte a befektetést sokszorosan. Egyik cég sem foglalkozik azzal, hogy a JPR mit mér, mert ők is le tudják mérni, hiszen ők konkrétan látják, hogy mit adnak el, míg a JPR az eladási csatornák egy jó részét nem is látja.

-

Abu85

HÁZIGAZDA

válasz

Lacccca87

#72435

üzenetére

Lacccca87

#72435

üzenetére

Nem, az FSR 4 az más, mert ott igazából csak az a gond, hogy az Int8 neuronhálóval vannak bizonyos szituációk, ahol a felskálázás minősége rosszabb az FSR 3-nál. Tehát a jelenlegi formájában nem jó, de ezt lehetne jóvá módosítani. És talán nem FSR 4 néven, hanem valami más jelzéssel ki lehetne adni RDNA 2/3-ra. RDNA 3-on még gyors is lenne. A kérdés az, hogy az AMD hogyan akarja ezt megoldani. Eddig ugye az volt a cégnél a koncepció, hogy meg lehet ezt próbálni az FSR 4-gyel is, tehát egy kódbázisból is működhetne az RDNA 2/3/4, de egyre inkább úgy tűnik, hogy ez nem lehetséges. Viszont kérdés, hogy ezt most ráhagyták-e, és majd építenek a Valve saját megoldására, ami az FSR 4 módosítása lesz az RDNA 2/3-ra, ami nyilván jó az AMD-nek, vagy megcsinálják még maguk is.

#72436 Busterftw : Nem, az FSR 4-et módosítva, Int8 neuronhálóval elég jó sebességgel tudná az RDNA 3 is, az RDNA 2 talán nem annyira, de menne az is. Az FSR Diamond esetében a gond az, hogy bármilyen nem RDNA 5-ös GPU ezt a kódot úgy futtatná, hogy a felskálázás aktiválása gyakorlatilag jóval lassabb lenne annál, mintha a játék kiszámolná a natív felbontású tartalmat. Úgy meg nincs értelme egy felskálázónak, hogy lassít. Az FSR módosítása Int8-cal legalább nem lassítana RDNA 3-on.

#72437 Yutani : Ha tényleg úgy működik az FSR Diamond, ahogy hallani, akkor egy 4K-ban natívan számolt sebességű képkocka egy RX 9000 vagy GTX 50 sorozatú GPU-n úgy futna 720p-ben számolva és onnan 4K-ba skálázva, hogy a natív 4K minőségű sebesség kb. 20-30%-át hozná csak. Tehát ha a natív 4K lenne 60 FPS egy RDNA 4 dizájnon, akkor a 720p-4K felskálázás lenne kb. 10-15 fps. Az RDNA 5 az első GPU-dizájn, ami nagyméretű mozaikokra van felkészítve. Ilyen hatékonysággal akkor tudna működni az RDNA 4 és a Blacwell, ha a memória-sávszélességük ~300 TB/s lenne.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#72433

üzenetére

Busterftw

#72433

üzenetére

Nem lesz exkluzív. A GDK-ban sztenderd HLSL kód van, és ez papíron akármilyen GPU-n fut, ami azt a HLSL kódverziót képes futtatni. Lényegében shader modell 7.0 kell majd hozzá. Viszont az FSR Diamond nem biztos, hogy gyorsan fog futni a mai GPU-kon, még akkor sem, ha a driver fordítója éppenséggel megeszi a HLSL kódot, mert munkamenetenként sokkal nagyobb adatmennyiséggel dolgozik az új eljárás, mint a Redstone. Emiatt olyan GPU-ra van szüksége, amely képes elég gyors memóriaterületet adni ehhez, hogy a mátrixfeldolgozók optimálisan dolgozhassanak.

Az RDNA 5-öt célirányosan így tervezték, tehát ott az FSR Diamond képes az elméleti matrix TFLOPS közelében működni. A többi GPU nem feltétlenül ilyen, és annak ellenére gondjai lehetnek az FSR Diamonddal, hogy a szabványos kódot a fordító meg tudja enni, csak maga a számíts az elméleti maximális TFLOPS 5-10%-án fut majd a gyakorlatban, tehát a hardverben lévő mátrixfeldolgozók a feldolgozás időtartamának 90-95%-ában nem csinálnak majd semmit. Ha ennyi hatásfokot veszítesz, akkor a natív képszámítás is sokkal gyorsabb lesz. Emiatt nem kizárt, hogy pusztán manuálisan letiltják az FSR Diamondot a nem elég gyors GPU-kon a fejlesztők. De maga a kód teljesen szabványos lesz, semmiféle specifikus kiterjesztést és AGS interoperabilitást nem használ, ezért is tudja integrálni a Microsoft a GDK-ba.

A Redstone amúgy 204 játékban aktiválható.

-

Abu85

HÁZIGAZDA

Igazából ez a helyzet tök egyszerű. Az AMD elkészítette az FP8 és az Int8 neuronhálót is. És eredetileg úgy is volt, hogy kiadják mindkettőt, de később másképp döntöttek, mert az Int8-nak jelentős képminőségproblémái vannak. Ezeket nem sikerült megoldani. Emiatt FSR4-ben sosem lesz Int8. Az nem kizárt, hogy lesz valami FSR Lite.

-

Abu85

HÁZIGAZDA

válasz

Chiller

#72398

üzenetére

Chiller

#72398

üzenetére

Erről másképp vélekedik az AMD, mert elég sok Strix Halot eladnak. Jóval többet, mint tervezték. Nem véletlen, hogy az eredeti tervekkel ellentétben kap egy frissítést idén. Mert alámérték az igényeket.

A 12 sáv az nagyon kevés. Ha bedobsz egy NVMe SSD-t, akkor marad 8 sáv. Azokra még kötnöd kell különböző vezérlőket, hogy meglegyenek az alapszolgáltatások, és akkor maradt kb. 2-4 sávod a GPU-nak. Kb. 20 sáv kell egy mobil platformba, hogy bőven legyen 8 sáv a GPU-ra, és ne kelljen lemondani semmiről.

Jó, de rakott-e bármelyik gyártó? Mert az oké, hogy az Intel nagyon szűkösen lehetővé teszi, de ugye azok a sávok nem csak a GPU-nak vannak, és a különböző extra vezérlők eszik őket. Nem véletlen, hogy nincs egy gyártó sem, amely rakott volna ezekbe GPU-t, mert kb. 1-2 sávuk marad rá, ha minden extra funkciót biztosítanak.

-

-

Abu85

HÁZIGAZDA

válasz

Chiller

#72394

üzenetére

Chiller

#72394

üzenetére

Tök mindegy, hogy mit akarsz te látni, ha a gyártók a mobil dizájnokhoz nem adnak elég PCI Express sávot bekötni a GPU-t. Az Intel és az AMD tranyót akar spórolni, és igyekeznek olyan területeken meglépni ezt, ami nem veszélyezteti a platform versenyképességét. Az egyik legegyszerűbb spórolási lehetőség tehát a PCI Express sávok szűkítése.

A RAM drágulása pont annak az iránynak kedvez, hogy legyen nagy IGP-d, mert akkor a teljes rendszernek csak egy, minden által elérhető memóriaterület kell, és nem kell külön a GPU mellé még egyszer sok gigabájt. A memóriahelyzet tehát pont azt fogja eredményezni, hogy minél kevesebb memórialapka legyen a notebookban, és ennek a legegyszerűbb módja, ha nem kell a GPU mellé VRAM, mert nincs GPU sem.

Ezek már látszanak a Panther Lake-en, amire nem készült olyan notebook, amiben lenne dedikált GPU. Tehát, ha valami üzemidőben használható notit akarsz, modern platformra építve, akkor se a Panther Lake, se a Strix Halo eszközök nem kínál olyan lehetőséget, hogy GPU-t kapj melléjük. Persze valószínű, hogy az előző generációkat még sokáig gyártani fogják, de a modern mobil rendszerek már nem arra vannak tervezve, hogy GPU-t használj velük.

-

Abu85

HÁZIGAZDA

válasz

Asshur

#72388

üzenetére

Asshur

#72388

üzenetére

A teljes értékű mód az az a kódút, ami fut az RDNA 4-en. Ez lesz némileg módosítva visszaportolva a gfx1170-re. Ennek a kódútnak a képminősége megegyezik a gfx12-es RDNA 4 hardverekével, de a gfx1170-es dizájnok nem lesznek benne olyan hatékonyak, viszont a sebességcsökkenés valószínűleg nem lesz jelentős.

A többi gfx11-es hardver nem tudja futtatni az FSR 4-et, mert nem támogatják azt a kódutat, amire az eljárás épül. Erre kiadhatnak alternatív kódutat, de biztos nem FSR 4 lesz a neve.

-

Abu85

HÁZIGAZDA

Lehet, én mindenesetre továbbra is tartom, hogy Jensen önállóan döntött a részesedés megvásárlása mellett, bízva abban, hogy a kapcsolódó üzletek kedvezően alakulnak majd az Intellel. Nekem ez hihetőbbnek hangzik annál, hogy Trump elvitte vacsorázni, és ott elmondta, hogy mit parancsol neki.

-

-

Abu85

HÁZIGAZDA

válasz

Chiller

#72371

üzenetére

Chiller

#72371

üzenetére

A laptop GPU a Strix Halo miatt nem fontos az AMD-nek. Egyszerűen IGP-vel lefedik azt a teljesítményspektrumot, amiben az eladásaik zöme volt. És ez látszik is azon, hogy merre viszik a notebook SoC-k fejlesztéseket. A következő körben még kevesebb PCI Express sáv lesz benne, mert ugye most sincs sok. És ezért nem nagyon törődik ezzel se az Intel, se az AMD, mert a next gen platformoknál az a helyzet, hogy ha raksz egy NVMe SSD-t a gépbe, és akarsz Wi-Fit, meg a szokásos dolgokat, akkor kb. marad 2 darab PCI Express sávod a dedikált GPU-nak. Ha kell valami extra dolog, akkor csak egy. Ezért akarta az Intel dealt az NV olyan nagyon, az Intel meg azért, mert így egyedül ők határozhatják meg, hogy mennyi lesz az NV eladása.

-

Abu85

HÁZIGAZDA

Az AMD kurva egyszerűen meg tudná oldani azt, hogy működjön Vulkan API-val az FSR 4, ha azt akarnák, hogy a VKD3D-Protonon keresztül fusson a játék, csak nem azt akarják, és ezért készül a natív támogatás, de ezt csak a Redstone kapja meg. Ez azért nem jelent még meg, mert a DirectX 12-re van teljes AGS interoperabilitás, Vulkan API-hoz még nincs meg ugyanez a mátrixműveletekre. Maga kód egyszerű, mert ugyanazt futtatja nagyrészt, csak ki kell vinni az adatokat a szabványból, dolgozni kell vele, és vissza kell vinni az API-ba az eredményt. Ugyanakkor Vulkan játék szököévente kétszer érkezik, míg DirectX 12 játék sokkal többször, így a priorítás az, hogy a DirectX 12-re legyen támogatás.

A Valve-féle FSR 4 Vulkan implementáció más, mivel ott a VK_KHR_cooperative_matrix és a VK_KHR_shader_float8 kiterjesztéseken keresztül adták hozzá a rendszerhez az AGS WMMA támogatást. Ez a Valve számára azért fontos, mert a saját SteamOS platformjukat éptik vele. Az AMD-nek ez annyira nem fontos, tehát ők erre a szabványos formára nem csinálnak Vulkan támogatást, nekik az nem jó, ha mindenki futtathatja a kódjukat. A Valve viszont idővel azt akarja elérni, hogy a SteamOS egy általános platform legyen, amit a gémerek telepíthetnek, és ennek megfelelően megpróbálják szabványosítani ezeket a technikákat. Az FSR 4-gyel is ezt teszik, csakhogy ami most van implementáció az még mindig csak az RDNA 4-en fut jól, mert alapvetően az eljárás úgy van felépítve, hogy az RDNA 4 hardverére optimalizált mátrix elrendezést használ. Ezért van az, hogy bár a Valve elvben megcsinálta a szabványosított FSR 4 kódot, ezzel nem értek el semmit, mert az összes többi hardver, bár a kódot hibátlanul megeszi és lefuttatja, annyira nem hasonlít a hardverdizájnban az RDNA 4-re, hogy jelentős lassulásuk van belőle. Viszont a Valve-nak fontos, hogy ez hosszabb távon egy általános megoldás legyen, így kiindulópontnak jó most nekik, hogy van egy szabványos kód, ami papíron fut mindenen, ami támogatja a fenti két kiterjesztést, és most azt kell elérni, hogy gyorsan is fusson majdnem mindenen.

Az AMD és a Valve célja ugyanakkor nem egyezik. Az AMD-nek jó az, hogy maguk uralják a saját kódjukat, az nem fut más gyártó hardverén, stb. A Valve pedig azt akarja, hogy később a SteamOS legyen egy mindenki által használt gaming OS, amire lehet válatani Windowsról, és egyben az olyan bloatware-eket, amik nem nyílt forráskódúak, azokat ne is lehessen rajta futtatni, vagyis legyen az adott problémára egy nyílt megoldás, és a gyártók rá legyenek kényszerítve arra, hogy azt használja mindenki és kész. A Valve azért akarja ezt, mert a kódok zárt része optimalizálhatatlan. Tehát nem tudja a cég garantálni, hogy az a lehető leggyorsabban fut az ügyfeleiknél. Emiatt van az, hogy a SteamOS alapkoncepciója, hogy nincs olyan kód felhasználva benne, ami nem nyílt forráskódú. Amelyik gyártó nem szeretne ebben részt venni, azt a gyártót leszarják, és megoldják nélküle.

Az OptiScaler csak felhasználta a Valve munkáját, de ez nem natív támogatás, és például az anti-cheat megoldások simán berágnak rá. Emiatt nem tudja mondjuk ezt így kiadni magának az AMD, mert ide natív támogatás kell.

#72366 PuMbA :

- Fixing Frame Pacing on the Frame generation side

Erre már kiadáskor kínált megoldást a Redstone. Itt van benne: [link] - az alkalmazásnak be kell építenie a Redstone swapchaint, mert ez felismeri a generált frame-eket, míg a DXGI swapchain nem ismeri ezeket fel. Amelyik alkalmazás a DXGI swapchaint használja az adott képgenerálóra az nem képes frame pacingre. Ez driverből megoldhatatlan, mert maga a swapchain nem képes értelmezni azt, ami történik.- Bring FSR Multi Frame Generation

Technikailag növelheted a generált képkockák számát két valóban számolt közé. Ez nem igényel nagy fejlesztést. Az AMD ennek az értelmét nem látja. Ők egy alternatív megoldáson dolgoznak, hogy ne a teljes képkocka legyen generálva, hanem csak az a része, amely az előző képkockán létezett, az új része pedig számolva legyen az új adatokkal. Így van képgenerálás is, és előrefelé generálhatsz nem kell kötelezően visszafelé, tehát ezzel a megoldással a késleltetést is csökkented és nem növeled.- FSR4 INT8 for older cards

Ez el van készítve az FSR 4-ben, csak nem lett kiadva mert nem ment át a minőségellenőrzésen. Ahhoz, hogy ez jó legyen a tréninget is újra kellene csinálni, amit nem szeretnének, így inkább azon dolgoznak, hogy a teljes értékű mód működjön gfx11 besorolású rendszeren, de így is kell majd hardveres módosítás, amit a gfx1170 kap meg.#72367 huskydog17 : ML denoiser eleve nem kell minden játékba. Tehát jóval kevesebb lesz azoknak a játékoknak a száma, ami ilyet használ. Az NV-nél is kb. 30 körül van ez a szám, pedig nekik jó ideje van hasonlójuk, csak a legtöbb stúdió saját denoisert használ, és ragaszkodik hozzá.

A natív támogatás pedig igazából nem a denoiserre vonatkozik, mert az nem cserélhető komponens, az mindig natív. A felskálázóknál viszont az számít, hogy magát az API-t hány játék támogatja. Az NV és az AMD is azt csinálja, hogy az egyes felskálázó eljárásait egy API-n keresztül implementálja, és ha egy játék mondjuk x API-t használ, akkor ugyanazt az x API-t támogató eljárást kicserélheted driverből. Ugyanezt csinálja az NV és az AMD is a DLSS és FSR felskálázóknál és képgenerálóknál. Ha ez nem így működne, akkor az AMD nem tudott volna felmutatni 204 támogatott játékot a Redstone kiadásának napján.

Nem készültek el az FSR 4 Vulkan kiadásával modderek ezzel hamarabb, nem is tudják megtenni, mert az FSR 4 kódjának egy része nem publikus. A VKD3D-Protont használják, amit tudna használni az AMD is, csak mondjuk egy fejlesztő nem erre vágyik, hanem valós natív implementációra.

A Sony a PSSR-t csinálta. Az FSR 4 teljesen az AMD saját fejlesztése. Ennek az alternatív implementációját csinálja a Sony, de az alapkód az AMD-é.

-

Abu85

HÁZIGAZDA

válasz

hajbel

#72225

üzenetére

hajbel

#72225

üzenetére

Már a megjelenéskor megírtam a fórumba, hogy bugos a COD-ban az árnyék. Elvileg még idén jön a patch. Mediumon nem bugos, de fölötte minden hardveren az valamennyire, de a mértéke eltérő. Egy-egy dolog sehol sem jelenik meg.

Plusz van még egy másik hiba is, ami csak az AMD-t érinti, hogy medium szint feletti árnyék minőségnél jobban lassulnak a Radeonok, mint kellene. Ez is javítva lesz idén, így vissza tudják nyerni azt az 5-10%-ot a Radeonok, amit emiatt elbuknak teljesítményben.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#72198

üzenetére

Busterftw

#72198

üzenetére

De nagyjából tudjuk. Pontosan az AMD nem mondja meg, viszont most úgy 400 millió dolláros bevételt hozhatott a két konzol a Q3-ban. Az előző év Q3-ban ennyi volt, és mivel most még érvényes az aktuális szerződési ciklus, és nem adtak el több chipet, mint az előző évben, gyakorlatilag ugyanannyi lehet ebből a bevétel. Talán kevesebb, de most kerekítsünk fel, így a 400 millióval nyugodtan számolhatsz. Az újratárgyalással fog ez csökkenni jövőre, akkor nem lehet pontosan tudni, hogy az AMD miben állapodik meg a Sony-val és a Microsofttal, de általában 20%-ot engednek az árból újratárgyalásonként. Nyilván az AMD-nek ez már mindegy, mert rég visszatermelte a befektetés többszörösét az üzlet, innentől már minden nyereség csak plusz.

-

Abu85

HÁZIGAZDA

válasz

Yutani

#72151

üzenetére

Yutani

#72151

üzenetére

Igen, csak ennek nincs köze a RR megoldásokhoz. Ez azért van, mert a hibrid RT árnyék nem kapcsol be valamiért bizonyos VGA-kon. Szimpla bug, amit majd gondolom javítani fognak. Sajnos az ilyen előfordul, főleg megjelenéskor.

#72154 Pocoyo.hun : A ROG Xbox Ally (X) a kliensbe megy. Az AMD szerint csak akkor raknak egy terméket a semi-custombe, amikor konkrétan egyedi a dizájn valamilyen paraméterében. Ilyenek az Xbox és PlayStation konzolok és a Steam Deck. A ROG Xbox Ally (X) nem ilyen, mivel ott a Microsoft nem kért egyedi paraméterezést, hanem eleve a kézikonzolokra paraméterezett gyári Ryzen megy bele, és emiatt ezt nem a Gamingbe könyvelik el, hanem a Client üzletágon belül.

A Gaming üzletág jelenleg az Xbox és PlayStation chipek, a Steam Deck, az Atari VCS, és az összes VGA (mobil/asztali). Ezen túlmenően a Teslákba szerelt infotainment systems ugyan a beágyazott rendszerek közé lesz könyvelve a hardvereladás szempontjából, de a szoftveres háttérért való licencdíj már a Gamingben landol. De ez nagyon kevés, negyedévente 1-2 millió dollár csak.

---

A konzol témához. Az AMD állandóan elmondja, hogy eléggé specifikus szerződésük van a Sony-val és a Microsofttal. És ez a mennyiségekre is vonatkozik. A konzolok eladási nem egységesek az évben az AMD nézőpontjából. A Q3 a legerősebb, majd Q4, majd Q1, majd Q2. És megint a Q3 a legerősebb, ez a ciklus zajlik le mindig, és ez azért van, mert mennyiségileg is úgy van a rendelés, hogy Q3-ban rendel a legtöbbet az ügyfél, és Q2-ben a legkevesebbet. Ezért a konzolchipek eladása a Q3-ban mindig erősödik az AMD-nél szekvenciálisan, mert ez van rögzítve a szerződésben. Ez az aktuális életciklus állapotánál nagyjából ~400 millió dolláros bevételt jelent. Jövőre kevesebbet fog, mert idén van az újratárgyalás, mert az életciklus felénél vagyunk. Valószínűleg az lesz, ami az előző generációban, hogy az AMD leállítja az erőteljes supportot, cserébe engednek az áron, és rendelési tételtől függően, éves szinten 700-900 millió dollár között fognak hozni jövőre a két konzolcsalád chipjei. Nagyjából ugyanígy történt az előző generációnál.

-

Abu85

HÁZIGAZDA

Nem annyira hibás, csak nem tekinti tükörnek az üveget, mert a valóságban az üveg nem tükör.

Pont az a lényeg, hogy ne lássál át rajta, mert sötétített üvegnek készült az üvegfelület. És nagyon fontos kulcsszó az "üvegfelület", nem tükör. Amikor a fejlesztők csinálják a saját eljárásukat, akkor azt ők írják, és a ground truth a célzott minőség. Ezért működik a default eljárás is úgy, mint az FSR RR, mert az van közelebb a ground truthhoz.

És még egyszer írom, hogy mindenki elismeri, hogy a user csillogó, élesen tükröződő tükröket akar látni, mert valahogy azt érzi jónak egy játékban, de ez a legkevésbé valósághű!!!! Emiatt például a DLSS RR-t is átdolgoznák, hogy valósághű legyen, csak nem tudják megtenni, mert nem ismert a forráskódja. Jó hír viszont, hogy a pipeline szintjén a denoiser nem kötött eleme a DLSS-nek, tehát a fejlesztők szerint lehet úgy DLSS felskálázni, hogy majd az AMD FSR RR-jét kötik be később, és akkor nem kell implementálni a DLSS RR-t, ha annak a működése nem illik a valósághűséget üldöző megjelenítésbe. De most ezt még nem lehet megtenni, mert az FSR RR még nem az ML2Code felületen fut.

-

Abu85

HÁZIGAZDA

Az árnyékokat ne nézzétek, mert van egy ismert bug a játékban, ami némelyik hardveren hibásan jeleníti meg az árnyékokat (talán még mást is, de az árnyékot biztosan, egyelőre nem tudni, hogy miért, majd javítják). Konkrétan az a gond, hogy nem alkalmazza rá a hibrid RT shadows eljárást. Lásd itt, ahol az üveget szilárdnak tekinti:

Hibrid RT nélkül a rendszer képtelen csak a szilárd oszlopok árnyékát kirajzolni, és az egész üvegfalat tömör, fényt felfogó falnak veszi.

Ez azért fontos, mert a COD: BO7 gyárilag tartalmaz RT-t az árnyékokra, csak ez nem úgy kapcsolható be-ki, hogy on-off, hanem az RT a legnagyobb fokozatokon aktív. Csak az RT visszaverődés független eljárás. Az hibrid RT árnyék be van építve a pipeline-ba. De ami a lényeg, hogy a denoiser ettől független, az nem okoz ilyen eltérést, ezt a különbséget a bug hozza elő.Ugyanezen a képen látszik, hogy mennyire tükörként kezeli a felületeket a DLSS RR. És ez az, amit például a default és az FSR RR kerül. Itt látszik:

Az nem üvegfelület, hanem konkrétan tükörnek néz ki, pedig valójában üveg. Az üveg nem úgy veri vissza a környezetét, mint amit ott látsz. Sehol nem látod ezt a világban. És főleg nem azt, hogy a kis ágy árnyéka visszaverődik a tükörként ábrázolt felületen, de a kanapé maga nem, miközben ott van előtte.

Ezért van ground truth, aminél ellenőrzik, hogy melyik eljárás van közelebb ahhoz, mintha brute force számolnának. És elhiszem, hogy neked jobban tetszik, amit a DLSS RR csinál, hogy nagyon élesen és intenzíven tükröz szinte mindent, de a valóság nem ilyen, és a ground truth sem ilyen, sőt, még a default denoiser sem ilyen. Ez a DLSS RR sajátja, ami nyilván koncepció, okkal csinálja ezt az NVIDIA, mert a játékosok éles, tükörszerű felületeket akarnak, mert az a látványos. Ezért így van tervezve szándékosan, csak ez van a legtávolabb attól, ahogy a valóságban működik.

-

Abu85

HÁZIGAZDA

A fejlesztőknek mindig megvan a ground truth. Ez egy fontos szempont, mert valójában egy motor, ha már implementálva van a teljes leképező futószalag, akkor rá lehet küldeni az RT-t, hogy számolja ki 16K-ban, pixelenként 16-32 sugárral a visszatükröződést, stb. Csak ugye ez azért nem lenne jó programkódban szállítva, mert percenként kapsz egy képkockát. De stúdiói szinten simán csinálnak ilyen összehasonlítást, hogy kérnek 500 képkockát egy előre beállított jelenetből, és azt hasonlítják össze a tényleges grafikával. Ezekre a "sugárrekonstrukciókra" igazából csak amiatt van szükség, mert nem jó, ha egy percig számol a játék egy képkockát. Inkább 60 kellene másodpercenként. Lényegében ez egy trükkös megoldása a dolgoknak. Ha a ground truthot nézzük, akkor egyik szállított megoldás sem jó, de ugye elfogadjuk, mert sokkal-sokkal gyorsabbak. Ez teszi játszhatóvá a játékot. Viszont a jelenlegi implementációk közül az AMD megoldása áll a legközelebb ahhoz, ami a ground truth, ezért rakták bele úgy, hogy még nincs is kész, mert kellett ahhoz a minőséghez, amit elképzeltek. De azt valószínűleg minden fejlesztő aláírja, hogy a játékosoknak jobban tetszhet, ha minden felület kvázi egy tükör, mert az ad valóban éles és részletesnek tűnő eredményt, csak a valóság nem ilyen. A való világban sem látod magad minden visszatükröződő felületen úgy, ahogy egy tükörben. Na ez a nehéz ebben, hogy a tükör legyen tükör, de a többi ne. Igazából a legjobb az lenne, ha a hármat kombinálnák, mert lesz olyan felület, ahol a default a jó, lesz olyan, ahol a DLSS RR, és lesz olyan, ahol az FSR RR, de egyszerűen nincs rá lehetőség. A mostani megoldás annyi, hogy a default egy teljesítménycentrikus mód, ami részben próbálja a felületek optimális tükröződését elfogadhatóan visszaadni, a DLSS RR hozza a szokásos mindenből tükröt csinál szintet, míg az FSR RR a kettő kombinációja. A legnagyobb gond az implementáció, mert az FSR RR most még nem működik mindenen, de ha működne, akkor csak ez lenne szállítva.

-

Abu85

HÁZIGAZDA

Ez nem ilyen egyszerű. A COD fejlesztői szerint mindegyik denoisernek vannak hibái. Jelenleg nincs olyan, ami hibamentes lesz, mert másra megy a fókusza a fejlesztésnek. A sajátjuk hibája, hogy megpróbálták úgy beállítani, hogy ne csináljon minden felületből tükröt, de ez rontotta a működését azokon a felületeken, ahol meg arra van szükség, hogy tényleg szépen élesen tükrözzön vissza. Az NVIDIA megoldása gyakorlatilag minden felületet úgy ad vissza, mintha tükör lenne, ami azért baj, mert nagyon nem tükör minden felület. Az AMD megoldása igyekszik ezt egy rakás tréningadattal korrigálni, vagyis a próbálja felismerni, hogy hol mire lenne szükség. Emiatt ez illeszkedik a legjobban a BO7-féle ground truthhoz, de ennek a legnagyobb az erőforrásigénye, mert sokkal többet számol, mint a többi. És ez nem változik meg az 1.0-val sem, mert a koncepciója az, hogy ne csináljon tükröt a nem tükör felületekből. A 0.9-es verzió már elég volt a COD-ba. De a fejlesztők szerint ezen is lehetne javítani, csak az elképzelésükhöz ez van a legközelebb, ezért rakták bele külön. Később ezt elvileg az 1.0-val elérhetővé teszik úgy is, hogy mindenki be tudja kapcsolni, így az amit elképzeltek, ground truthhoz közeli maximális grafika, mindenkinek elérhető legyen.

Egyébként azt is mondták, hogy az a legegyszerűbb, ha mindenből tükröt csinálnak. Mert ott nem kell foglalkozni azzal a kérdéssel, hogy mi van a nem tükör felületekkel. Egyszerűen minden részletes és éles lesz, és azt látják, hogy ez nagyon tetszik a felhasználóknak, csak a valóság nem ilyen, és ezért nehéz olyan denoisert fejleszteni, ami valósághűen dolgozik.

-

Abu85

HÁZIGAZDA

válasz

T.Peter

#71882

üzenetére

T.Peter

#71882

üzenetére

Van is hozzá driver fél éve. Most csak a végfelhasználói driverbe került bele. Viszont a játékok még nem használják PC-n. Ennek az oka, hogy a Work Graphs futószalagja nem kompatibilis a hagyományos futószalaggal. Tehát, ha erre fordítanak le egy UE5 játékot, akkor az nem fog elindulni azokon a hardvereken, amelyek nem támogatnak mesh shadert. Emellett még van egy igen fontos követelmény a parancsmotorra, ami funkcionálisan ugyan nem okozza a Work Graphs futtathatatlanságát, de a helyzet az, hogy ha nincs teljesítményben erre kigyúrva a parancsmotor, akkor a Work Graphs lassítani fog a feldolgozáson, ha a munkamenet nincs kifejezetten a Work Graphs futószalagjára kigyúrva, de akkor meg azért gyorsul, mert túlléped az Execute Indirent határait, és ott nem nehéz az 1 fps-nál jobban elérni, mondjuk 5 fps-t. Gyakorlati haszna ugyanúgy nincs.

A jelenlegi játékok nem ilyenek, ha csak a jelenlegi jellemző futószalag mellett cseréled az Execute Indirectet Work Graphs-ra, akkor azt tapasztalod, amit a legtöbben, hogy az RDNA 3-on és RDNA 4-en hoz tempót, de máshol lassít. Az Xbox Series X-en azért gyorsít, mert a Microsoft két különálló parancsprocesszort használ, de az RDNA 2-ben, a PC-s verzióban csak egy van ebből a hardverben, és nem is ugyanolyan, amit a Microsoft alkalmaz. Emiatt RDNA 2-re már rég elvetették a Work Graphs funkciót, mert ugyan funkcionálisan megoldható, de -30% az eredménye. Mivel nem erre tervezték a hardvert, sosem fogják tudni megoldani azt, hogy az RDNA 2 PC-s változata a Work Graphs funkcióval gyorsabb legyen, mint Execute Indirecttel. A jelenlegi környezeteben ezt a teljes iparág kizárólag RDNA 3 és 4 GPU-kon tudja kivitelezni, és ezért nem látsz egy olyan játékot sem, ami Work Graphs API-t igényel. Majd akkor fogsz, amikor az UE5 PCG-je át lesz emelve valós idejűbe, mert akkor a Work Graphs megkerülhetetlen lesz. De az szerintem leghamarabb jövőre esedékes. Tehát a Work Graphs API-s játékok úgy 2027-ben jöhetnek.

SER már van fejlesztői driverben, de mivel a fejlesztők nem törik magukat azon, hogy támogassák, így majd akkor lesz bevezetve leghamarabb, ha lesz olyan program, ami kéri.

-

Abu85

HÁZIGAZDA

Az NV helyzete nagyon specifikus, mert ők tényleg egészen fura módon mappelik rá a bekötést a hardvereikre. Az AMD ezt sokkal egyszerűbben oldhatja meg, mert az összes hardverük ugyanúgy működik a bekötés szintjén, a GCN1-től kezdve az RDNA4-ig. Emiatt számukra nem kérdés, hogy hogyan mappelik rá több generációra a drivert.

Az NV-nél ezt úgy csinálják, hogy hét generációnak megkeresik a közös alapját, és arra mappelnek. És jól írod, hogy ez speciel pont a GTX 1000 szériát érinti a legjobban, mert nagyjából az az a hardver, ami a legjobban illeszkedik a driverben lévő kódhoz. Se a korábbi, se az ezt követő generációknak nem optimális ez a kód. De itt másik gond is van. Mivel itt bekötésről van szó, így az egész D3D12 implementációt érinti a kérdés, tehát még ha ugye jön is az 590-es branch, és kiszedik belőle a Turing alatti supportot, az sem fog hozni változást, mert nem tudják csak a bekötést cserélni. Meg kell írni a nulláról egy teljesen új D3D12 implementációt, és ha ezzel kész vannak, akkor visszamenőlegesen meg kell kérni az összes fejlesztőt, hogy módosítsa a már kiadott D3D12 alkalmazásokat, ha esetleg követték az NVIDIA-nak azt az ajánlását, hogy közvetlenül a root signature-be kössék be az erőforrásokat. Emiatt úgy gondolom, hogy ezt az NVIDIA már benyeli, mert sokkal nagyobb fejfájás lenne visszamenőleg kooperációban korrigálni ezt a problémát, mint használni a mostani kódokat. Egyébként a Work Graphs amúgy is kvázi egy külön API, arra lehet jobb implementációt csinálni, és akkor a Work Graphs terjedésével ez a gond is megoldódik.

-

Abu85

HÁZIGAZDA

Azért nem hasznos az RX 580 összehasonlítása, mert nincs olyan játék, ami ne lenne profilozva. Tehát ott is elvégzik azt a két kattintásnyi munkát, ahogy korábban. Egyébként a default módhoz viszonyítva egy optimálisabb profil 1-2%-ot hoz pluszban. Inkább a játékba írt kód határozza meg a sebességet az explicit API-knál, így a driver nem tud mit kezdeni azzal, ha az nem jó. De fontos itt figyelembe venni, hogy megjelenésre sosem szokott kész lenni a driver, tehát a végletes teljesítményt valamikor a hardver megjelenése után fél évvel látjuk. Utána már bele van írva majdnem minden, ami meghatározza majd a működését, és elképesztően ritkán változik. Ez logikus is, a legtöbb játék ugyanúgy használja az API-kat, tehát előre fel tud készülni bármelyik cég arra, hogy mik lesznek a játékok működésével kapcsolatos tipikus problémák, amiket enged az API driverből korrigálni. De az explicit API-k miatt nagyon kevés előny hozható ebből, viszont annyira nagy a verseny, hogy azért az 1-2%-ért is lehajolnak.

-

Abu85

HÁZIGAZDA

Az a gond, hogy a profilokon még mindenki azt érti, amit régen, de a profilok már nem olyanok, mint régen. Az explicit API-k egyik sajátossága az, hogy a munkamenet egy részét átemelik a program kódjába. Tehát a driver viszonylag kevés dologról dönt. Abban a kevés dologban is lehet sebességet találni, de ma már nincs olyan, hogy egy játékhoz specifikus kódot írnak a meghajtóba, mert azok a problémák, amelyek tipikusan befolyásolják a driver oldalán a sebességet kb. fél tucat általános beállítással lefedhetők. És amikor egy új játék érkezik a DX12 vagy Vulkan API-ra, akkor a day-1 profil annyi, hogy ebből a fél tucat előre megírt beállításból beállításból választanak egyet neki. Ezért működik még mindig az RX 580 tökéletesen, mert még ma is kiválasztják per játék alapon neki, ami az adott játékkal jól működik, hiszen ez a driverfejlesztés oldalán csupán két kattintás.

Régen ez egészen más volt, mert a DX11 játékokhoz azért a driver elképesztően sok kódot tartalmazott per játék alapon, és ennek volt is hatása, de a DX12 vagy Vulkan API-val a teljesítményspecifikus kódrészt a program tartalmazza, a drivernek kevés köze van ehhez, nagyjából 1-2%-ot tud csak dobni egy jó beállítás.

Annak sokkal nagyobb jelentősége van, hogy a fordító hogyan fordítja a shadereket, és ez például egy kellemetlen dolog volt az AMD-nél, hogy az RDNA 1/2 és az RDNA 3/4 pár dologban igencsak eltér, és az újabb fordító inkább RDNA 3/4 specifikus. Valószínűleg ezért nem hozták vissza RDNA 1/2-re, mert nagymértékben rontotta volna azok sebességét. Ezért lehet az, hogy szétválasztották a drivert, mert az új 25.20-as branch belassította volna az RDNA 1/2-t.

-

Abu85

HÁZIGAZDA

Mert csak azzal a memóriával gyárthatják, amire a gyártó hitelesít. A Samsung memóriákra az AMD nem hitelesített kezdetben, mert instabilak voltak. Aztán amikor már megtalálták az optimális működést, akkor lett a Samsung memóriára is firmware. Utána gyárthatnak azzal is, mert hitelesítve lett.

#71787 S_x96x_S : Ez normális. Eltérő memóriák eltérő időzítéseket használnak, így nagy átlagban 1% különbség lesz a termékek között.

-

Abu85

HÁZIGAZDA

válasz

Yutani

#71761

üzenetére

Yutani

#71761

üzenetére

Ezen az áron az AMD nagyjából annyit gyárt, amennyit reálisan megvesznek. És ezt a VGA-gyártók is alátámasztják, mivel a raktáridő relatíve rövid. Ha többet gyártanának, attól még nem adnának el többet. Akkor tudnának többet eladni, ha a Radeonokat is csempésznék Kínába. Nyilván az nagyon meglátszanak a JPR számaiban, hiszen akkor a termékek nagy része kínai AI szerverfarmba kerülne.

#71762 Busterftw : Az 5050 mindegy, mert annyira azért nem veszik. Igazából most már az AMD-nél is látszik a kezdeti furcsa adatok miatt, hogy a 8 GB-os 9060 XT sem megy annyira. Az NV csinált sok 8 GB-os 5060-at, és le is csökkentik a gyártást, mert szinte alig fogynak. Szóval a 8 GB-os kártyák most már annyira nem számítanak egyik oldalon sem. Volt az első pár hét, amikor valamiért ezek verték a 16 GB-os társaikat, de az utóbbi hetekben nem ez a jellemző. Az 5080 és 5090 már számít, mert extrém mennyiségben alakítja át ezeket Kína. Nyilván ehhez előbb meg kell venniük.

-

Abu85

HÁZIGAZDA

Egyébként ezek a hardvercsoportok vannak megkülönböztetve, és a minőség/sebesség lefelé haladva csökken:

- RDNA 4 WMMA

- RDNA 3 dual-issue optimalizált packed math

- RDNA 2/RDNA/Vega packed math

- Polaris manuális packing

- általános shader modell 6.2 (minden, ami szabványosan támogat shader modell 6.2-t)A Cyberpunk 2077 eleve nem kompatibilis a FidelityFX 2.0-val, hiszen az 1.1 API alapján van benne minden összerakva. Nem mellesleg a CD Projekt Red saját implementációt használ.

-

Abu85

HÁZIGAZDA

Nem teljesen. Maga a FidelityFX API kezel mindent. Az FSR 4 kapott több kódutat, és automatikusan választ az API a hardvereknek megfelelően. Ha valaki anno FSR 3-at implementálta, akkor az is ugyanígy csinálta. Az pedig természetesen, hogy az FSR 3.1.5-ben ugyanazok a fallback kódutak vannak, amik az FSR 4-ben, nem fog két eltérőt írni az AMD ugyanarra a problémára. Viszont itt a lényeg az, hogy most már elég az FSR 4-et implementálni, és utána működik minden out-of-box. Korábban szükség volt még az FSR 3 implementálására is, de most már ott van minden az FSR 4-ben.

-

Abu85

HÁZIGAZDA

Nem léptek vissza. Fontos különbséget tenni a forráskód és az implementáció között. A változást azt szolgálja, hogy saját, módosított FSR-verziót nem lehet rakni a játékba az AMD nevével. De a nyílt forráskód megmarad, mert ugye több projekt épül az FSR-re. Például az ARM-féle felskálázó is. Ilyeneket továbbra is lehet csinálni, csak nem úgy, hogy a FidelityFX jelzés alatt fut. Ha a FidelityFX jelzés és az AMD cégnév használva van, akkor kötelező az aláírt dll. Viszont, ha valaki csinál egy "Pityuka veri kúl felskálázója" opciót, akkor használhatja a forráskódot akárhogy, és természetesen arra nem vonatkozik a kötelező dll, mert nem használja a gyári neveket.

#71708 PuMbA : Nem minden kártya kap külön kódutat, hanem csoportosították a kártyákat a képességek szerint. Az alap tök natúr fallback mellett van kétféle mixed math, egy dual-issue optimalizált, illetve egy CNN. Ezek mind új kódutak, azért nem voltak eddig benne az FSR 4-ben a CNN-en kívül, mert meg kellett írni őket. Így viszont már nem kell az FSR 3-at is implementálni külön egy játékba.

-

Abu85

HÁZIGAZDA

De. Az újítás lényege, hogy elég ezt implementálni, és többet nem is kell, mivel az FSR 4 így implementálva már nem csak RDNA 4-en működik, hanem shader modell 6.2-es GPU-n és felette. És végül négynél több kódút lett.

A mostani modellben több FSR-t kell implementálni, egy FSR 4-et és egy FSR 3-at minimum, mert az FSR 4-nek nem volt fallbackje, de az új rendszerrel már elég csak az FSR 4-et.

Ez pont úgy működik, ahogy az XeSS. Van a specifikus kódút, és pár szabványos.

-

Abu85

HÁZIGAZDA

válasz

DudeHUN

#71694

üzenetére

DudeHUN

#71694

üzenetére

Az mindegy, hogy a Sony és a Microsoft mit mutat, mert az AMD csak beszállító. Eleinte számít, hogy mennyire nagy az eladás, mert akkor adja nekik az AMD 150 dollár környékén a lapkákat. A vége felé már inkább 70 dollárért mennek ezek. Tehát amíg eleinte ebből nagyon sokat keres az AMD, a vége felé már jóval kevesebbet, még akkor is, ha az eladás ugyanannyi lenne. A semi-custom úgy van beállítva, hogy a befektetést egy év alatt hozza vissza. Azon túl minden év nyereség.

-

Abu85

HÁZIGAZDA

Igen. Mindegyik olyan konzol, amiben az AMD van, a generációja végét járja. Ilyenkor már az AMD sem számol olyan eladásokkal és pénzzel, mint amikor kezdték. De ez normális. Most a Gaming az főleg gaming GPU.

A jövőben lesz nehezebb, mert lesz a semi-custom, abból az Xbox dizájnok, amik mennyiségben nagyon-nagyok lesznek, mert az Xbox dizájnok a PC-t célozzák, és csak úgy kapnak Xbox plecsnit a PC-s gyártók, ha Xbox dizájnokat használnak. És ezeket egészíti még ki a PC GPU.

-

Abu85

HÁZIGAZDA

válasz

szarnyasdino

#71621

üzenetére

szarnyasdino

#71621

üzenetére

Nincs. Eleve egy gyártó sem tud arról, hogy idén frissítés lesz.

Láttam a pletykákat amúgy, és neki is szegeztem a kérdést az egyik gyártónak, de szerinte irreális idén, mert arra épül maga a pletyka, hogy léteznek 24 gigabites GDDR7 memóriák is, és azokra le lehetne cserélni a 16 gigabiteseket, amiket most használnak. És elméletben igen, le lehetne, csak a pletyka abba nem gondol bele, hogy a 24 gigabites GDDR7 memória a teljes GDDR7 termelés 10%-át teszi ki maximum, emiatt ennek az ára 2-3x nagyobb, mind a 16 gigabitesé. Ez jó a notebookba, mert ott a 4-5000 dolláros gépeknél van elég puffer rá, de ha mondjuk lecserélik az 5070 16 gigabites memóriáit 24 gigabitesekre, akkor az úgy keletkező 5070 Supert rögtön 1500 dollárért kell adni, hogy legyen rajta haszon. Ezért nem ez a memória van most alapból rajta, mert amúgy ez a memória létezett már akkor is, amikor az 5070 megjelent.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#71563

üzenetére

Petykemano

#71563

üzenetére

A méret itt nem számít annyira, mert az első Infinity Cache az más volt, mint a második és harmadik verzió. Az első IC az ugyanaz, volt mint a Ryzenekben az L3 cache. A második és harmadik már a GPU-khoz volt tervezve.

-

Abu85

HÁZIGAZDA

Itt a kóddal van probléma, ami az említett játékban nem működik jól a VMA-val, amit ugye elég sok fejlesztő használ manapság, például az idTech is. Tehát, amikor egy játék ezt alkalmazza, akkor memory leak lehet a következménye annak, ha sok az olyan TLAS instance bejegyzés, ahol nincs beállítva a BLAS hivatkozás. Ilyenből elég sok van abban a szállított kódban, amit például kapott az Indy, az új Doom, vagy a Wukong, aminek a miértjére nincs hivatalos válasz, de a probléma vele az, hogy létrejön egy TLAS instance, aminél a gyorsítóstruktúra referenciamezője 0 vagy nem inicializált érték.

Valószínűleg szándékos nullázásról van szó, amikor átmenetileg kikapcsolt objektumokat próbálnak kezelni úgy, hogy 0-s BLAS-t rendelnek hozzájuk, ami a TLAS számára érvénytelen lesz.

Ezt elméletben a DXR és a VK RT nem engedi, de az API maga funkcionálisan nem tudja tiltani, mert így vannak felépítve. A javaslat egyértelműen az ezekre az esetekre, hogy a kód használjon dummy BLAS-t, ha feltétlenül erre lenne szükség (ilyenkor az üres objektumot egyetlen egy háromszöget tartalmazó, végeredményben érvényes BLAS-szal helyettesítik), és a dummy BLAS nem okozhat rendellenes működést, például közvetett módon nem lehet tőle memory leak.

A dummy BLAS-nak a másik előnye, hogy nem csak érvényes, hanem jóval gyorsabb is, persze észszerű keretek között. Emiatt nehéz megérteni, hogy az Indy miért van olyan kóddal szállítva, ami pusztán működésben is lassabb végrehajtást eredményez mindenen, mert a 0-s BLAS-t máshol kell korrigálni, hogy ne legyen memory leak belőle. Emiatt van egy alternatív memóriamenedzsment az említett játékban, ami csak GeForce RTX 30/40/50-en aktiválódik. És ez majd később bajt jelent, mert így ha két év múlva jön egy GeForce RTX 60-as sorozat, akkor az is a memory leakes menedzsmenttel fog futni. Ezért nem ajánlja ezt a fajta működést a Vulkan, mert így minden egyes új VGA-generációt külön patch-csel kell megszabadítani a memory leaktől. Ezért jobb a dummy BLAS, mert az egy API szempontjából helyes működés, és nem igényli azt, hogy egyenként kelljen patch-cselni az érkező hardvereket. Persze lehet, hogy itt egy licencprobléma van, vagyis nem kizárt, hogy az ID nem módosíthatja az NVIDIA kódját, és ilyenkor viszont nincs mit tenni, nem tudják beleírni a dummy BLAS-t, hogy gyorsabb legyen minden hardveren. Esetleg időben van korlátozva a licenc erre, és később az NVIDIA megengedi ezt az optimalizálást, mert gondolom nem akarnak szopni azzal, hogy a GeForce RTX 60-as sorozat elveszíti ezt a beállítást. Meg nem mellesleg maga az effekt legalább 30-40%-kal gyorsabban futna a GeForce RTX 50-es VGA-kon is a Vulkan által ajánlott módszerrel, és ez alig járna módosítással a kódra nézve, az effekt is ugyanaz lenne.

-

Abu85

HÁZIGAZDA

Itt azért több dolog van. Egyrészt az 5070-nél az a 48 MB cache az nem ugyanazt csinálja. Az Infinity Cache egy globális victim cache-ként funkcionál, tehát egyrészt tárolja az alacsonyabb cache szintekből kikerült adatokat, másrészt betölt előre olyan adatokat, amelyekre potenciálisan szükség lehet.

A cache struktúra szempontjából az AMD elsődlegesen a gyors lokális cache-ekre épít, így nem igazán dolgoznak egy nagy globális cache-re, és mellette van egy Infinity Cache, aminek az elsődleges célja a memóriaelérések megelőzése, de emiatt nem közvetlen része a cache hierarchiának. Az NV dizájnja egy lassabb globális cache-re épít, amit kiegészítenek a gyorsabb lokális cache-ek. De ennek a globális cache-nek nem célja, hogy megelőzze a memóriaelérést, ez inkább egy működésből eredő mellékhatása.

Emiatt hiába néz ki úgy, hogy van két utolsó cache, ami kb. ugyanakkora, messze nem fognak úgy működni, mert nem ugyanabból a célból építették ezeket.

-

Abu85

HÁZIGAZDA

válasz

KAMELOT

#71000

üzenetére

KAMELOT

#71000

üzenetére

Érdemes inkább a GDC-s anyagra összpontosítani. Ott eléggé részletesen ki van fejtve, hogy mit akarnak ezzel megoldani. Nem a RAM és a VRAM terhelését, hanem azt, hogy egy nextgen játék ne foglaljon majd 200-400 GB-nyi helyet az SSD-n. De ettől a teljesítmény és a memóriaterhelés alapvetően rosszabb lesz, viszont csak 100 GB-ot foglal majd az adattárolón.

-

Abu85

HÁZIGAZDA

válasz

KAMELOT

#70998

üzenetére

KAMELOT

#70998

üzenetére

Nem lesz. Más lesz a neve.

A neural shader a memóriaigényt valójában nem feltétlenül csökkentik. Ugye itt arról van csak szó, hogy a normál shaderekbe, amik eddig is megvoltak helyezhetsz olyan részeket, amelyek neuronhálóval dolgoznak. Tehát lehet, hogy egy tömörítő technikával a per textúra helyigényt csökkented, de ahhoz neked szükséged van egy óriási neuronhálóra is, ami viszont a régi tömörítő technikákhoz nem kellett. Tehát a memóriaigény az nem egy olyan dolog, ami végeredményben feltétlenül csökkenni fog, mert amit megnyersz a feldolgozáson, azt elveszítheted a feldolgozáshoz szükséges neuronháló kötelező betöltésén.

Erre figyelmeztetett a GDC-n a Microsoft, amikor erről volt szó, hogy amit megadnak előny az per texture. Tehát nem a teljes technikára vonatkozik, és előfordulhat, hogy ha a teljes működést nézed, akkor nem fog csökkenni a memóriaigény.

Kicsit elnagyolt példa, de jól szemlélteti a lényeget. Teszem azt van egy 50 MB-os textúrád, amit betömörítesz 5 MB-ra neurális shaderrel. Ezzel per texture alapon sokat nyertél, de ha 600 MB-os neuronháló kell ahhoz, hogy ezt megtedd, akkor végeredményben 555 MB-tal romlott a VRAM terhelése. Emiatt említhette a Microsoft, hogy itt senki se várjon csodát, a valóságban rosszabb is lehet a VRAM terhelése. Minden a felhasználás körülményeitől függ. Szóval nincs olyan, hogy mindig kevesebb lesz a memóriaigény. Lehetnek olyan szituációk, amikor sokkal kevesebb lesz, lehetnek olyanok, amikor kicsit kevesebb, de olyanok is, amikor több, és olyanok is, amikor jóval több memóriaigénye lesz a neurális shadernek. Nincs univerzális szabály erre. -

Abu85

HÁZIGAZDA

STOC néven lesz az Arc C-ben OMM hardver. Az AMD-nél már a mostani dizájnban is van ilyen. Azért nem igazán foglalkoznak vele, mert a jelenlegi API korlátok miatt nem igazán használható. Kell hozzá a programozhatóság, hogy valódi értelmet nyerjen, és az pont kimaradt az új API-ból is. Ezt egyébként az Intel is jelezte, hogy az STOC nem fog érni igazából sokat, amíg nem oldják meg az API limiteket.

-

Abu85

HÁZIGAZDA

válasz

deathcrow42

#70497

üzenetére

deathcrow42

#70497

üzenetére

Persze, mert maga a fícsőrt használják rosszul. De ettől maga a DXR jó, ha jól használják, csak nagyon sok játékban nem ez a helyzet. Ha valamihez egy 5090 sem elég 4K-ra, az rosszul használja a DXR-t.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#70388

üzenetére

Busterftw

#70388

üzenetére

7900XT es 7900XTX van 700 dollar feletti MSRP-vel, siman lehet.

Oké, tegyük fel, hogy van. Csak egy pillanatra, nyilván nem lehet, de teoretikusan játszunk el a gondolattal. Magyarázd akkor el kérlek, hogy hol van akkor az ebből származó 1,5 milliárd dolláros bevétele ebből az AMD-nek?

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#70368

üzenetére

Busterftw

#70368

üzenetére

Az AMD mondta ezt. Az AMD ennek a forrása.

Nem, nem ezt mondták. Ezt te mondod. Az AMD azt mondta, amit írtam. De ha ez nem tetszik, akkor mond azt, hogy te ezt nem hiszed el nekik, de ne találj ki hülyeséget.

Mi értelme 2023-as adatokat közölni az RDNA 2-ről 2025-ben?

Én is ránéztem, sok helyen out of stock. Igazából már alig vásárolható, mert jó ideje nem is gyártják. Néhány beragadt készlet van, ami már nem kell senkinek, mert az AMD bejelentette a hasonló teljesítményű 9070 XT-t 599-ért.

Nem, nem ezt mondták. Ezt te mondod. Az AMD azt mondta, hogy a teljes piacnak a 15%-át teszik ki a 700 dollár feletti VGA-k, vagyis a GeForce és Radeon kombinált eladásokra vonatkozik ez az adat.

Ha csak az AMD-nek lenne a 7900 XTX-ből 15%-ja, akkor most lenne 700 dollár felett VGA-juk mondjuk 799-ért, mert az egy kibaszott jó arány, amire megéri tervezni egyetlen egy terméket. Tudod miért? Mert az kb. 4,2 millió eladást jelent évente, ami egy 800 dolláros 7900 XTX-nél GPU-nként kb. ~350 dollárt eredményez az AMD-nek, ami 1,5 milliárd dollárnyi bevételt jelent összesen egy évben csak és kizárólag a 7900 XTX-ből. És akkor még nem beszéltünk egyetlen másik Radeonról sem, amelyekből elvileg a 85%-os fennmaradt részesedés miatt megint sokat adnának el, így az AMD éves, GPU-kból származó bevétele kb. 6-7 milliárd dollár lenne. Mert gondolom, illetve a fentiek alapján csak nagyon remélem, hogy nem hiszed azt, hogy az AMD egyedül a 7900 XTX-ből szedett be 1,5 milliárd dollárt teszem azt 2024-ben, az összes többi Radeonból pedig sokkal kevesebbet. -

Abu85

HÁZIGAZDA

válasz

Busterftw

#70358

üzenetére

Busterftw

#70358

üzenetére

Ez nem volt titkos AMD meeting, ott voltak egy csomóan. Minden elhangzott dologról lehet írni már. Másképp el se mondhatnám, hogy az AMD mit mondott.

#70359 Busterftw : Még egyszer leírom érthetően. Az AMD azt mondta, hogy ez globális statisztika, amiben benne vannak a GeForce eladások is. Valamiért neked ez nem tetszik, de minden szám az AMD-t támasztja alá.

Azért is hülyeség az amit állítasz, mert az AMD-nek úgy 3-4 hónapja nincs is 700 dollárnál drágábban kínált VGA-ja. Nyugodtan nézzél rá, out of stock mindegyik, mert több hónapja nem gyártják. Korábban is csak a 7900 XTX volt ez, de az az eladások egy nagyon kicsi részét tette ki.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#70349

üzenetére

Busterftw

#70349

üzenetére

Az AMD konkrétan ezt mondta a Q&A sessionön. Igaz ők az Arcot nem említették meg, de gondolom azt is beszámolták, de ha nem az akkor is csak 1%-nyi piaci részesedés.. Az biztos, hogy ez GeForce és Radeon kombinált adat.

#70348 Pkc83 : De ez miért olyan meglepő? 10 éve a 700 dollár feletti rész csak 5% körül volt.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#70339

üzenetére

Busterftw

#70339

üzenetére

Azért írt az AMD belsős adatot, mert nekik ezek megvannak. Igazából a legnagyobb gond, hogy magadnak építesz fel egy olyan világot, ami nem létezik, és ragaszkodsz hozzá. Annak ellenére is, hogy az AMD mást mond. Csak nem értem, hogy mit nyersz azzal, hogy ragaszkodsz a saját álmodhoz a tényekkel szemben.

Ugyanúgy két slide-ot kapott az 5070 Ti és a 7900 GRE összehasonlítás is. Látod a képet ott volt az előadáson.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#70322

üzenetére

Busterftw

#70322

üzenetére

De tudjuk. És más számok is ezt mondják.

Ez egy előadás volt. Eléggé egyértelműen elmondták, hogy ez a globális számokra vonatkozik. Benne van az NVIDIA is.

De egyébként az újságírók 99%-ának egyértelmű volt, egy újságíró kérdezett csak rá erre. El is mondta az AMD, hogy ez kombinált adat, minden VGA benne van, amit eladnak a világban. Persze valószínűleg nem minden kereskedő, emiatt jöhet az ki, hogy a Mercury csak 8%-ra méri a 700 dollár fölötti szint részesedését, de valszeg az AMD nincs közvetlenül kapcsolatban a szürkepiaci eladásokkal, míg mondjuk a Mercury azt is tudja.

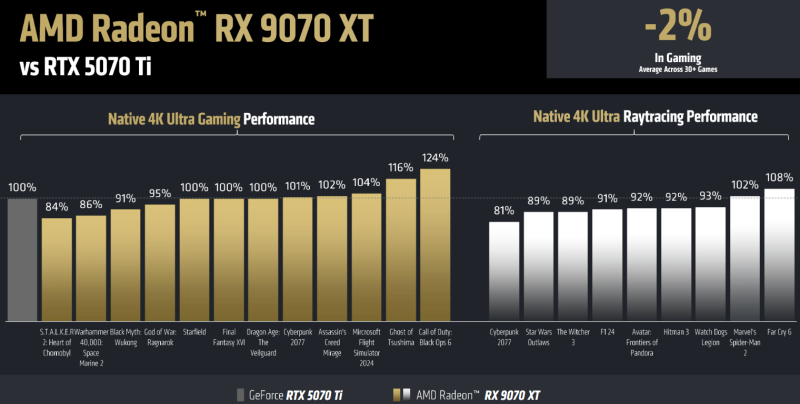

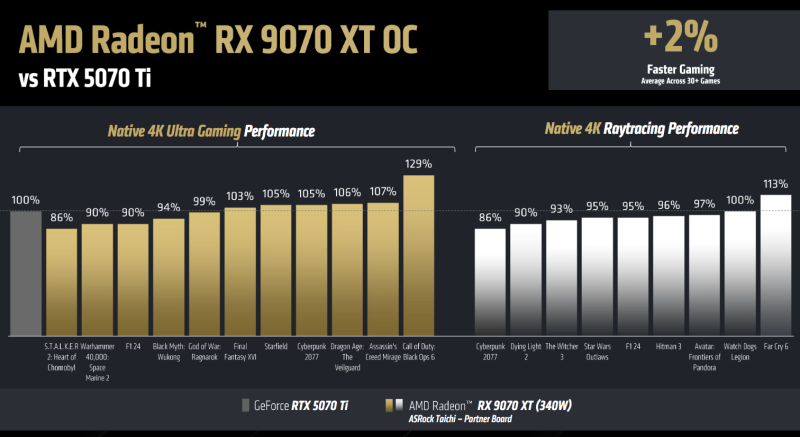

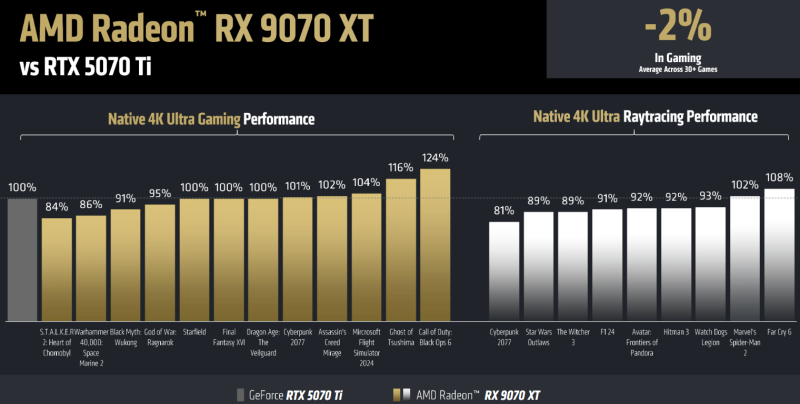

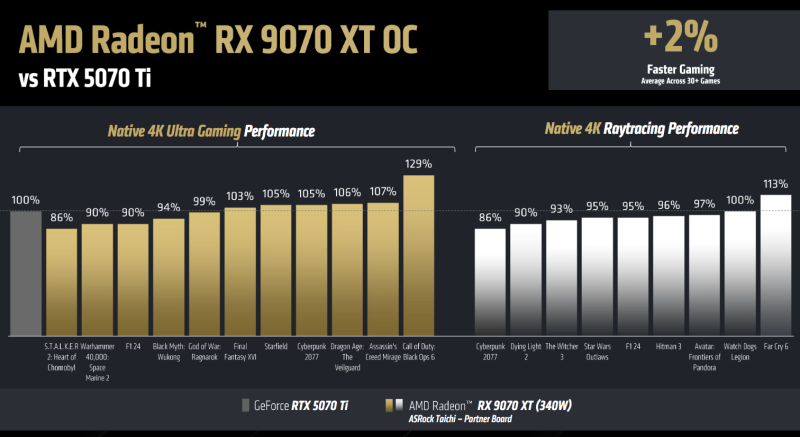

#70323 Busterftw : Nem igaz. Az AMD összehasonlította a 9070 XT-t az 5070 Ti-vel is. Több összehasonlítást csináltak:

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#70316

üzenetére

Busterftw

#70316

üzenetére

Az AMD azt a százalékot adta meg, amekkora arányban a piac vesz 700 dollár felett. Tehát nem azt, amekkora arányban ők adnak el, hanem amekkora arányban a piac!!! Ezt megkérdezték tőlük a Q&A alatt és mondták, hogy ez globális statisztika, az NVIDIA eladásai is benne vannak.

És ez a lényege annak, amit megadtak, hogy a 700 dollár feletti piac kicsi. Ezért van az, hogy az NV 700 dollár felett az első hétre még az RTX 40-es sorozatból is tízezerrel készült. Az RTX 50-ből pedig alig ötezerrel. Az AMD azért készül most sokkal több VGA-val, mert 700 dollár alatt startolnak. Ott alapvetően az eladások a 700 dollár feletti többszörösére nőnek. Ez egy erős választóvonal, mert például a legdrágább 700 dollár alattiból négyszer többet is eladnak, mint a legolcsóbb 700 dollár felettiből.

Persze a GDDR7 az elérhetőséget nagyban meghatározza, de ettől az NVIDIA sem a világ bénája, hogy ennyire kevés kezdőkészletet elégnek tartanak. Azért teszik ezt meg, mert így indították az RTX 40-es sorozatot. Ahhoz igazodnak, amiket a számaik mutatnak, és ők sem mérik máshogy a paicot, ők is ugyanazt látják, hogy a 700 dollár feletti régió a piacnak kb. a 1/7-e mennyiségben. Ezért készül tavaszra hatszor több 5070, mint amennyi eddig volt az összes eddigi a drágább RTX 50-ekből. Ugyanezt a különbséget méri az NVIDIA is. És az 5070-en is GDDR7 van.

#70317 Busterftw : Mindegy hogy eltér a vásárlóarány, mert az AMD azt az adatot adta meg, amelyben az AMD és az NV kártyák eladásai is benne vannak. Akkor számítana ez az információ, ha az AMD csak a Radeonok eladásait adta volna meg.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#70312

üzenetére

Busterftw

#70312

üzenetére

Baszki, az AMD mondta el az előadáson, hogy ebben benne vannak az NVIDIA eladásai is. Miről beszélsz? Külön meg volt kérdezve a Q&A résznél valaki által, hogy ez nem csak az AMD-re vonatkozó adat. Az más kérdés, hogy a Mercury 8%-ot mért pár hónapja, de a Mercury több kereskedővel dolgozik. Az NV is 8-15% között mondana erre adatot, mert ők is ezekkel a kereskedőkkel dolgoznak, csak kérdés, hogy mennyi az adat, amennyit számon tartanak.

Értsd meg, hogy bármennyire is szeretnéd, a piac nem nagyobb ennél 700 dollár felett. Ha nagyobb lenne, akkor nem ~50 ezer kártyával készült volna eddig az NVDIA a 700 dollár feletti szinten.

-

Abu85

HÁZIGAZDA

válasz

S_x96x_S

#70297

üzenetére

S_x96x_S

#70297

üzenetére

Szerintem leírható számmal is. A globális 9070 kezdőkészlet négyszázezer darab. GeForce RTX 50-ből eddig 65 ezret szállított az NVIDIA, de ez két héttel korábbi adat. Mostanáig úgy 70-72 ezret szállíthattak.

A gyártók szerint globálisan heti 50-100 ezer között fognak szállítani 9070-ekből. Azt is tudni, hogy 80% 9070 XT lesz, és 20% 9070, de ha ez nem jó arány, akkor három héten belül tudnak reagálni az igényekre.

-

Abu85

HÁZIGAZDA

válasz

Quadgame94

#70196

üzenetére

Quadgame94

#70196

üzenetére

A jövőben több variálhatóság lesz a wavefrontméretben.

#70198 Busterftw : Az AMD, az NVIDIA és az Intel is tudja, hogy ki mennyit ad el. Ezt a kereskedők elmondják nekik. Így vannak meg ezek az adataik. És az AMD belsős adata még felül is reprezentálja a 700 dollár fölötti szint eladásait.

#70199 ggbuffon1897 : CPU-fronton az Intel baja pont az, hogy az AMD-nek úgy két generáció előnye van. Ha ez nem lenne, akkor az Intel is egy jól működő cég lenne, és nem arról tárgyalnának, hogy melyik részét kinek adják el a cégnek.

#70232 bjasq99 : Legrosszabb esetben olyan lesz a kihasználás, mint statikus regiszterallokációval lenne. És ez egyébként elméletben előfordulhat, de a korábbi modellben meg mindig ez fordult elő. Tehát itt a cél az, hogy ha nem peak az allokáció, és általában nem az, akkor legyen több wave.

#70235 paprobert : Nem, a QoS nem erre való.

A mikrobenchmarkokban ez nem fog látszódni, mert ott nem komplexek a shaderek. Ez a játékokban fog látszódni. Látszik is egyébként, hiszen a Navi 48 nagy átlagban egál a Navi 31-gyel, miközben az erőforrások tekintetében kétharmada csak. Tehát úgy +30% hatékonyságot csak úgy hozott a dizájn azonos erőforrásszám mellett. Ez volt ugye a fő cél, hogy legyen a Navi 31 közeli teljesítmény Navi 32 szintű költségek mellett gyártható.

-

Abu85

HÁZIGAZDA

válasz

Quadgame94

#70194

üzenetére

Quadgame94

#70194

üzenetére

De az RDNA 3 és 4 már dual issue, tehát az a 4096 valójában 8192. Ebből a szempontból a nyers FP32 operációban nincs nagy különbség az AMD és az NV dizájnja között.

Az AMD dizájnja egy ponton sokkal jobb, az pedig a memória kezelése. Ott jóval kevesebb sávszéllel is beéri, mint az NV, de nyilván az NV ezért ugrott kényszerűen GDDR7-re, míg az AMD a saját, sokkal hatékonyabb memóriakezelésével megengedhette magának, hogy maradjon a sokkal olcsóbb GDDR6-nál.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#70190

üzenetére

Busterftw

#70190

üzenetére

Nem náluk ennyi nem érted? Globálisan ennyi! Minden gyártót belevéve. Bármelyik nagyobb kereskedőláncot megkérdezed kb. 10%-ot mond a 700 dollár feletti eladásra.

A piac 700 dollár felett 15%-nál nem nagyobb az AMD adatai szerint, amik a kereskedőktől származnak, vagy ha a Mercury adatát nézzük, akkor 8%-nál, nyilván a Mercury sokkal több kereskedővel van kapcsolatban. Régen sem volt nagyobb, ma sem az. Sőt, régen a 700 dollár feletti piac csak 2-3% volt. Az emberek nem gazdagok, nehogy azt hidd. Egyáltalán nem véletlen, hogy a konzolok is 700 dollár alá vannak árazva, ez az a határvonal, ami alatt a termék eladása tömeges lehet, fölötte viszont már inkább luxus. És ezért nőnek nagyon nagy mértékben a 700 dollár feletti árazások, mert ott már azért számolni kell azzal, hogy tizedannyi eladás sem lesz, mint 700 dollár alatt, de nem gond, mert luxuspiacnak is kell lennie. De a luxus sosem jelent nagy piacot, csak tehetős vevőkört. Nagyon el vagy tévedve, ha azt hiszed, hogy itt mindenki szarja a pénzt. Ha így lenne a konzolok is 1000+ dollárba kerülnének.

#70184 S_x96x_S : Így van, de a JPR összesítés definíciója szerint, ami 500 dollár feletti az már high-end. Ezzel amúgy nincs baj, mert definiálják, hogy mit értenek high-end alatt. De speciel szerintem a Mercury 700 dollár feletti definíciója közelebb áll ehhez. Viszont így látható az is, hogy az 500-700 dollár közötti részben zajlik a JPR-nél is a legnagyobb, úgymond "high-end" eladás.

És pont emiatt a fura értelmezés miatt kicsi az entry level piac, miközben ezt nagyon nem így látják a gyártók. De a JPR szerint csak az az entry, ami 100 dollár alatti. Megint nem gond, mert definiálva van, hogy mit tekintenek annak, csak rossz a határvonal szerintem.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#70179

üzenetére

Busterftw

#70179

üzenetére

Miért notebookba ad el high-end GPU-t az Intel? Mert amúgy a JPR kimérte, hogy igen. Muti má melyik az.

A Mercury is jó adat, mert ők ezt tényleg a 700 dolláros sávhoz mérik, csak nekik 92% a 700 dollár alatti kártyák részesedése. De mint mondtam az AMD belső adata szerint lehet 85%, mert kisebb részét látják a piacnak, mint a Mercury. De valószínűleg az AMD sem vonná kétségbe, hogy a Mercury pontosabban mér. Viszont az üzenet ettől még ugyanaz marad. A piac nagyon picike része vesz VGA-t 700 dollár felett.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#70102

üzenetére

Busterftw

#70102

üzenetére

Csak ez nagyon rossz adat, mert más a definíciója az egyes cégeknél más az entry, a midrange és a high-end definíciója. Ezért van az, hogy az Intel több high-end GPU-t ad el, mint az AMD. Holott mennyivel is rendelkeznek? Be tudod linkelni nekem az Intel high-end GPU-it?

A JPR elemzésekhez nagyjából 80-90 oldal magyarázat tartozik. Anélkül ezek az adatosorok nem érnek semmit, mert nem tudod, hogy mit ért a JPR rajta. De ezért várom, hogy mutasd meg az Intel high-end GPU-it.

Ilyen szempontból egyébként jobb a Mercury, mert nekik a szegmentálása egyértelmű. Ár szerint nézik, és úgy szegmentálnak, hogy az entry az 200 dollárig, a midrange az 200-700 dollár között, és a high-end az 700 dollár fölött van, függetlenül a gyártótól. És ők egyébként a Q3-ban azt hozták ki, hogy a piac 8%-a vesz 700 dollár fölött GPU-t. Az AMD 15%-ot hozott ki, de itt lehet azért olyan különbség, hogy a Mercury azért jóval több üzlettel van kapcsolatban, jóval több országot vesznek figyelembe, a csóróbbakat is, míg az AMD-nél igazából a fő partnerektől van adatuk, ami még mindig jó, mert itt történik az eladások 90%-a, de persze lehet tőlük venni kisebb mennyiségben is, nem partneri szerződéssel. Utóbbi szerződés hiánya a kötelezettségeket is leveszi, tehát összességében azt van rengeteg üzlet, amire nincs rálátásuk, nem kérhetik számon a brand arányt, stb. Tehát a Mercury ilyen szempontból pontosabb, nekik azért nagyon nagy rálátásuk van erre, mert a céljuk az, hogy pontos adatokat szolgáltassanak. És ha ezt nézzük, akkor az AMD még felül is reprezentálta a teljes high-endet. A valóság inkább 8% körüli, tehát 700 dollár alatt a piac ~92%-a vásárol. És persze beleköthetünk ebbe, hogy a Mercury szerint a high-end az AMD adatánál is kisebb, de az AMD közleményének a lényege az, hogy a high-end, a 700 dollár feletti rész az eladásokban aprócska, nüansznyi, bizonyos szegényebb régiókban kerekítési hibák. Ez az AMD üzenetének a lényege, nem az általuk azért jelentősen felülreprezentált százalékos adat.

#70123 PuMbA : A GTA5 PC-s portját sem foglalták le, mert a Rockstar többgyártós szerződést kötött. Azt nem tudom, hogy ez mennyire változott. De az RDR2 is többgyártós volt. Exkluzívat nem igazán kötnek a Rockstarék. De egyébként mindegy, mert az alkalmazott eljárásaik, amiket nem maguknak fejlesztenek, azok zömében GPUOpenesek. Az RDR2-ben is azok voltak, és az új GTA5 frissítésben is azok lesznek. Valószínűleg ezért sem kötnek specifikus gyártói szerződéseket, mert nekik nagy teljesítményű eljárások kellenek PC-re, amiket csak a GPUOpenből tudnak szerezni, hiszen máshol nem írható annyira szabadon át a forráskód, amivel azért a Rockstar rendre él. Hasonlóan dolgozik a Bethesda is, lásd Starfield, ott is az eljárások zöme GPUOpen volt, csak átírták nagyon a kódokat. Azért tudták olyan gyorsan javítani a GeForce-ok árnyékokhoz kapcsolódó teljesítményproblémáját, mert visszaírták az AMD saját ShadowFX kódját, ami jobban futott az NV-n, mint a Bethesda módosítása.

-

Abu85

HÁZIGAZDA

Közben van mail, hogy lehet, hogy változik az 5070 MSRP ára. Nem mintha számítana jelenleg. Úgy néz ki, hogy az NV is nézte az előadást.

#70085 Sundesz : Nem... van mérés, hogy a 9700 XT +/-3%-ra van az 5070 Ti-től, játékfüggően, de az átlag kb. egál. Az 5070-et megeszi reggelire. Valószínűleg ezért is merült most fel, hogy mégse 549-ért jön.

#70087 Busterftw : Mondom a gyártók azt is tudják, hogy melyik kereskedő mennyi konkurens GPU-t adott el. Teljes képük van a teljes piacról, nem csak arról, hogy ők mennyit adtak el. A Mercury is hasonló arányt mér.

#70088 deathcrow42 : Azért nem számít, mert a GeForce RTX 50 sorozatnak nem az ára a gondja, hanem az, hogy kvázi nem kapható. Így az MSRP jelenleg lehet akármennyi.

-

Abu85

HÁZIGAZDA

Elhiheted, hogy ezt nem így tervezték. Nem csak a Samsung szállított volna nekik GDDR7-et, hanem az SK Hynix és a Micron is. Csak a Samsung memóriája volt stabil azokkal a követelményekkel, amiket az NV elvárt. Így gyakorlatilag a tervezett mennyiség 60%-a kiesett. Ezt nem látták előre, szimplán pech.

-

Abu85

HÁZIGAZDA

válasz

ggbuffon1897

#70049

üzenetére

ggbuffon1897

#70049

üzenetére

Mármint a memóriagyártók, mert egyre több cég mondja, hogy nem rajtuk múlik, a GDDR7-ből van extrém kevés jelenleg.

-

Abu85

HÁZIGAZDA

válasz

ggbuffon1897

#70042

üzenetére

ggbuffon1897

#70042

üzenetére

Most ez nem olyan nehéz, ha szállítanak heti 101 VGA-t, akkor valszeg többet szállítanak, mint az NV.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

Abu85

HÁZIGAZDA

válasz

S_x96x_S

#69956

üzenetére

S_x96x_S

#69956

üzenetére

A Project Amethyst az más. És a PSSR, illetve az FSR4 is eléggé eltérő. Mindkettőnek saját a neuronhálója, stb.

A Project Amethyst célja sokkal inkább kötődik a PlayStation 6-hoz. Ugye nagyon nehéz meghatározni, hogy milyen helyen lehet jól használni az AI-t. Nincs igazából univerzális irány, nem igazán látszik, hogy hol van úgy nagyon világosan értelme. Tehát erről kb. mindegyik cégnek van egy némileg eltérő elgondolása, és ezeknek az elgondolásoknak van ugyan közös halmaza, lásd upscaling, de vannak szempontok, amelyek alapján nem biztos, hogy van egyezés.

A Sony gondja az, hogy rájöttek, hogy megéri kiadni PC-re a játékaikat. Egyszerűen kis munkával jár, és viszonylag sok pénzt hoz. Nem véletlenül vették meg a Nixxest. Na most a gond az, hogy a PlayStation 6-hoz meghatározhatnak maguknak egy irányt, hogy mire használják majd az AI-t, ehhez tervezhetnek egy hardvert is, illetve ugye terveztetnek az AMD-vel, de mi van akkor, ha az AMD ezt túlságosan szélsőségesnek találja? Nem beszélve az Intelről és az NV-ről. A Project Amethyst ezért jött létre. A Sony és az AMD megpróbálja közösen meghatározni, hogy mire lesz optimális az AI, és talán nem lesz teljes az átfedés, de biztos, hogy egy nagyon nagy közös halmaz lesz. Ehhez pedig az AMD garantálja, hogy hoz ideális PC-s hardvereket, hogy a Sony tudja ezekre portolni a saját AI megoldásait. Aztán követhetik őket a többiek is, nyilván annak a Sony nagyon örülne, mert akkor a többiekre is tudnák a megoldásaikat portolni, de most egy garanciát akartak, hogy lesz PC-n is a saját elképzelésükhöz hasonló koncepció.

-

Abu85

HÁZIGAZDA

Cserélhetők a fájlok. Csak az nem jó megoldás, mert ugyanazok a gondok jöhetnek elő, amik általánosan jellemzők például a DLSS-es fájlcserékre. Például hiányzik a játék által használt preset az új állományból, és akkor jön a legrosszabb képminőséget adó fallback mód. Emellett ezt a módszert az NVIDIA nem véletlenül nem ajánlja, mert rengeteg képi hibát detektálnak vele. Ugye vannak túlbuzgó userek, akik fényképezik a képi hibákat DLSS-sel, aminek örül az NV, csak az így leadott hibajelentések zömében kiderül, hogy kicserélte a dll-t a user. Aztán csukhatják be a ticketet, és írhatják vissza a felhasználónak, hogy "persze, hogy hibás a kép, ha kicseréled a dll-t te hül...". Egyébként erre majd később jön egy ellenőrző a meghajtóba. Ezért is lesz jó az új NV App. A ticketet el sem küldi kivizsgálásra, ha fájlokat cserélgetsz, hanem automatikusan visszaírja, hogy a játék integritása rossz, és javítsd ki Steamen. Ettől persze cserélhetsz dll-t, csak nem fogják kivizsgálni, ha bajod van. Van erre hivatalos módszer gyárilag, ami ellenőrzött az egyes játékokra.

Az API modularitása az FSR 3.1-ben inkább azt szolgálja, hogy az AMD később az FSR eljárások elemeit ki tudja cserélni driverből. Nem te, mint user, mert azt nem tudod, hogy mi kompatibilis mivel, hanem ők, mert tudják, hogy melyik program hogyan és mit használ. Emellett ugye van egy érdekes igény a fejlesztők részéről is, hogy tudják vegyíteni az egyes különálló modulokat más technikákkal. Például működjön a DLSS-sel az AMD-féle képgeneráló. Ez már meg is van oldva. És ilyen formában nem kellene a DLSS képgenerálóját implementálni. Amúgy is jelenleg már négy különböző képgeneráló módszer van, ami nagyon sok, mivel sok teszteléssel jár. Mindegyiket karban kell tartani, miközben három között alig van működésbeli eltérés. Emiatt függetlenítette az AMD a képgenerálóját az FSR-től, mert egy csomó fejlesztő azt kérte, hogy tegyék ezt használhatóvá a DLSS-sel és az XeSS-sel, és akkor nem kellene olyan képgenerálókat beépíteni, amelyek csak kevesebb VGA-n működnek. Elég lenne az AMD-é, ami működik minden VGA-n, miközben mellette használható akármilyen upscaling.

-

Abu85

HÁZIGAZDA

válasz

deathcrow42

#69883

üzenetére

deathcrow42

#69883

üzenetére

Mert az FSR 3.1 kapott egy moduláris API-t. Tehát ki lehet cserélni egy elemét úgy, hogy közben a többi eleme működőképes marad.

Vagy az FSR 3.1-et kell beépíteni, és akkor a driver kicseréli az egyes elemeit, vagy az FSR 4.0-t kell direkten beépíteni. Utóbbi csak az újabb, érkező címekben lesz megoldva.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#69845

üzenetére

Busterftw

#69845

üzenetére

Legközelebb akkor válaszolok, ha hozol bizonyítékot linkekkel. Mert felesleges ezeket a köröket futni. Látható, hogy többször adtam neked lehetőséget az állításaid igazolására. Majd bocsánatot kérek, ha megteszed. Addig viszont tartom, hogy a saját állításomat. Ha nem tetszik, akkor perelj be érte.

#69851 ggbuffon1897 : Hát ha ez tény, akkor miért nem jönnek a linkek arról, hogy mi nem tény a cikkekben/hírekben?

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#69837

üzenetére

Busterftw

#69837

üzenetére

Te hoztad fel az FSR 2 cikket. Kértem, hogy mutasd meg, hogy melyik része nem tény. Nem én jelöltem ki ezt a cikket, hanem te. De akkor gondolom, nem tudod ezt megmutatni.

Nincs olyan, hogy DXR 1.0-s és 1.1-es hardver. Ezek API-k. Ezeket a hardverek támogatják. Mindegyik amúgy. De mivel a DXR 1.1 elterjedt, ezért a DXR 1.0-nak kvázi kampó lett.

Ti állítottatok valamit. Bizonyítékot kértem rá. Megadtam a lehetőséget, már sokadig hsz-en keresztül. Egy bizonyítékot sem hoztatok. Én nem állítottam rólatok semmit, de mivel nem teljesítettétek a kérésem, kénytelen vagyok elhinni, hogy rosszindulatú hazugságokat akartok terjeszteni, mert az állításaitokat sokadik felszólításra sem vagytok hajlandók igazolni.

Én majd akkor kérek bocsánatot, ha én állítok valamit rólad, ami nem igaz, de egyelőre ilyet csak ti tettetek. Vagy bizonyítod, vagy ha nem, akkor az számomra automatikusan azt jelenti, hogy hazugságot terjesztesz. Csak megjegyzem, hogy ezért jogilag bármelyik ember beperelhető, ezzel azért vigyázzatok.

-

Abu85

HÁZIGAZDA

válasz

ggbuffon1897

#69815

üzenetére

ggbuffon1897

#69815

üzenetére

Ez viszont a vásárlók hibája. Amíg a piac vásárol ezen az áron, addig miért is csökkentsenek? Most jelen pillanatban azt várjátok el tőlük, hogy adják olcsóbban a VGA-kat, eközben ezen az áron kipucolják a vevők a raktáraikat. Úgy, hogy eltelt két év, és még mindig maximum öt hetet tölt egy legyártott VGA a raktárban. Ez egy nagyon lényeges dolog a gyártók számára. Mondhatjátok, hogy drága, de ők nem érzik annak addig, amíg a raktárakból eladnak mindent. Számukra ennek van üzenetértéke, és azt üzenitek nekik, hogy jól vannak beárazva a VGA-k. Ha mondjuk három hónapig porosodik a raktárban a VGA, akkor ott már mérlegelnek árcsökkentést, mert onnantól kezd az egész ráfizetős dolog lenni a gyártó számára. Tehát előnyösebbé válik olcsóbban eladni a VGA-t, hogy újra 5-6 hetet álljon csak raktárban.

#69828 Busterftw : Legyen az FSR2-es cikk. Mutasd meg, hogy melyik része nem tény.

És melyik új játékban van DXR 1.0? Némelyik játék még a DXR 1.1-en is túlmegy, mert kevés neki, lásd az Avatar. És nyilván látható, hogy az a mostani hardverekből bizonyos részegységeket nem is használ, mert compute shader dolgozik helyettük. Tehát a mostani hardvereknek így kampó lett. Az ALU kapacitással számolnak. Tök hasztalan a hardveres blokk bennük.

És még mindig nem látom a cikkek és hírek linkjét. Most vagy nem érted, hogy mit szeretnék, vagy nem szeretnéd érteni, mert pontosan tudod hazudtál.

-

Abu85

HÁZIGAZDA

válasz

ggbuffon1897

#69795

üzenetére

ggbuffon1897

#69795

üzenetére

Én minden driverről beszámolok a PH-n. Az AMD átlagosan havonta ad ki drivert. Hogy ezt bizonyítsam, belinkelem az összes hivatalos, vagyis tesztelt meghajtót 2024-ből:

1. [link]

2. [link]

3. [link]

4. [link]

5. [link]

6. [link]

7. [link]

8. [link]

9. [link]

10. [link]

11. [link]

12. [link]

13. [link]

14. [link]Mivel egy évben 12 hónap van, és 14 darab hivatalos, vagyis nem béta, nem preview, stb. driver érkezett, ezért 2024-ben az AMD havonta 1,1667-szer adott ki drivert.

Itt felmerül a kérdés, hogy ezt most nem tudtad-e, és téves információk alapján jelentesz ki fals információkat, vagy valami más ok van e mögött. Én remélem, hogy az előbbi, és akkor a jövőben utánajársz, mielőtt leírsz valami hülyeséget.

#69797 b. : Akkor újra. Kérem a linkeket a cikkekről és hírekről. Nem regényt kérek. Cikk és hír linket. Mindenki kíváncsi rá, ha nem tudod teljesíteni, akkor bocsánatot kérj, és el van intézve.

#69799 Busterftw : Neked is itt a lehetőség. Linkeld a híreket/cikkeket. Ez egy szabad fórum. Azt írsz, amit akarsz. De bizonyítsd! Ha nem, akkor kérj bocsánatot, mert ez az illem által elvárt minimum. Ha nem teszed meg, akkor az nem engem minősít.

-

Abu85

HÁZIGAZDA

válasz

ggbuffon1897

#69791

üzenetére

ggbuffon1897

#69791

üzenetére

Kérlek válaszolj a kérdésre, hogy neked miért jó, hogy pár meghajtó óta ott lévő profilt csak később aktiválnak? Tényleg csak erre válaszolj. Miért nem jó úgy, hogy ha bekerül, akkor aktív alapból, akár a játékok megjelenése előtt több héttel, és akkor nem kell Game Ready driver.

Csak erre akarok választ kapni. Nem akarom azt, hogy nem kötelező telepíteni, meg van benne más javítás, stb. Ezt már tudjuk. A kérdésre szeretnék választ.

#69794 Hellwhatever : Oké. Ez számomra egy elfogadható válasz.

-

Abu85

HÁZIGAZDA

válasz

ggbuffon1897

#69786

üzenetére

ggbuffon1897

#69786

üzenetére

Nem válaszoltál a kérdésemre. Miért jó neked, ha köteleznek téged egy driver telepítésére, mert nem aktiválták korábbi 4-5 meghajtóban azt a profilt, ami neked kellene? Ez egy nagyon egyszerű kérdés. Mit nyersz vele? Nem érdekel, hogy mi van még a driverben, hogy javított két olyan hibát, ami a te gépedet nem is érinti. Az érdekel, hogy ezzel az egy tényezővel te személy szerint mit nyersz, hogy szerinted ez előnyös dolog számodra? És ezt most nem viccből kérdezem. Tényleg nagyon kíváncsi vagyok, hogy miért jó ez.

#69789 b. : Most kezd el ide linkelni a cikkeket, amiben nem írtam tényeket az NVIDIA újításairól. És kérlek ne menekülj el, hanem tedd meg ezt. Mert olyan dologgal vádolsz, amit most nem bizonyítottál. Itt az esély, hogy bizonyítsd. Ott van a cikkeket kereső funkció a főoldalon. A termékeket ki tudod keresni, a tesztekben pedig én írtam az architektúra részeket.

-

Abu85

HÁZIGAZDA

válasz

hokuszpk

#69783

üzenetére

hokuszpk

#69783

üzenetére

Pontosan. De az NV-nél valamelyik marketinges kitalálta anno, hogy ez egy pszichológiai hatást gyakorol a felhasználóikra, és azt hiszik, hogy törődve van velük. De nehogy azt hidd, hogy ezzel mindenki egyetért, a rendszerprogramozók például nem, viszont ettől még a marketinges győz, mert látod, hogy Ggbuffon1897 örül neki, ha havonta többször telepít drivert feleslegesen.

De egyébként egyszer sem tudták elmagyarázni nekem, hogy ez a módszer miért jó. Mit nyer vele a felhasználó. Mindig csak azzal jöttek, hogy informálva van a user, hogy a profil tuti ott van, aktiválták. És rendben, tegyük fel, hogy elfogadom. De a következő kérdésem itt az, hogy mit nyer vele az a user, aki nem informálódik? És erre már nincs válasz.

#69780 deathcrow42 : Az FSR4 még nem jelenik meg a mostani hardverekkel. Az FSR3.1 lesz kiegészítve az ML móddal, és ez driverből működik. Ehhez RDNA4 kell. Amúgy ennek a működése megegyezik az FSR4-gyel.

Az FSR4 SDK majd később jön, és az már gyárilag működni fog az összes, shader modell 6-ot támogató hardveren. Nem csak az AMD-n, hanem NV-n, Intelen, stb. Lesz öt vagy hat működési módja, amivel az adott hardverekhez igazodik. De a legjobb mód mindig a csúcs-Radeonhoz kötött, ahogy az FSR3.1-nél is a legjobb működéshez RDNA3 kell. A régebbi és gyengébb hardverek nem kapják meg a fő működési mód előnyeit, így ahogy az FSR3/3.1 a legjobb képminőséget RDNA3-on adja, addig az FSR4 a legjobb képminőséget RDNA4-en fogja adni. -

Abu85

HÁZIGAZDA

válasz

ggbuffon1897

#69779

üzenetére

ggbuffon1897

#69779

üzenetére

Mitől törődés az neked, hogy már szállított profil tiltva van, majd telepítened kell egy extra drivert, hogy engedélyezzék, miközben amúgy használhatnád a szállított profilt, ha nem lenne tiltva? Csak ezt magyarázd meg, hogy mit nyersz azzal, hogy rá vagy kényszerítve egy új driver telepítésére, csak azért, mert ami kell neked belőle, a korábbi 4-5 driverben ugyan benne volt, de tiltva.

Nyilván az AMD is csinálhatja azt, hogy ha nektek kell, akkor tiltják a funkciókat a driverben, hogy újra kelljen telepítened a drivert havonta négyszer. Ez a legegyszerűbb dolog, amit lehet tenni fejlesztés címszóval. De mit nyersz vele a telepítéseken kívül? Miért válassza az AMD ezt a módszert, ahelyett, hogy engedélyezi a profil használatát, amikor belekerül, jóval egy játék megjelenése előtt.

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#69777

üzenetére

Busterftw

#69777

üzenetére

Most ez viccesen hangzik, de nem egy fícsőr ott van a decemberi driverben, csak át kell kapcsolni developer módba a meghajtót.

Általában nagyon tipikus, hogy ha készül valami újdonság, akkor az nem abba a driverbe kerül bele, amiben hivatalosan megjelenik. Kb. 3-4 hónappal korábban ott van már, csak le van kapcsolva, hogy ne használhasd, amíg nem élesítik.