-

Mobilarena

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Petykemano

veterán

válasz

Jack@l

#35259

üzenetére

Jack@l

#35259

üzenetére

Nem értem, ezt miért kérdezed.

Kicsi lapkákat a kihozatal miatt kell gyártani. Nagyjából közmegegyezés tárgya, hogy ez elkerülhetetlen, vagy legalábbis nagy költségmegtakarítást eredményezhet.Ha ezeket a kicsi lapkákat nem csak interposeren lehet egymás mellé helyezni, és nem csak MCM lehet egybetokozni (EPYC), hanem akár egymásra is akkor az eggyel több lehetőség. Pepe azt mondta, zátonyra futás. Arra kérdeztem rá, ha eggyel több féle lehetőség van az egybetokozásra, akkor az miért zátonyra futás és nem révbe érés?

Ha 3d stacking esetén csak 1Ghz-en mehet egy (több) lapka, akkor azt nyilván nem lehet mindenütt felhasználni. Én nem tudom, hogy a helytakarékosságnak mennyi valódi jelentősége van. Lehet hogy a 3d stacking - az említett hőelvezétési nehézségek miatt - a gyakorlatban, vagy legalábbis az AMD és az Nvidia szokásosf elhasználási területein nem bevethető. De attól még a kis lapkákra épülő koncepció miért lenne zátony?

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#35238

üzenetére

Jack@l

#35238

üzenetére

4 TB-os fedélzeti tárhoz már kell a nagyobb HBC. A következő SSG 2-4 TB-ra van tervezve. Az 1 TB egy jó kezdet volt, de problémát jelent, hogy már van olyan tartalom, ami nem fér bele.

A másik szempont a rendszermemória. A Vega 20 már nem csak szimpla SSG-be megy, hanem olyan rendszerbe is, ahol egy CPU mellett lesz a tokozáson. Ott a CPU-val közösen elért rendszermemória 1 TB lehet, amihez nem árt 32 GB-nyi HBC. Ez a következő kör SSG-je, ahol a CPU-s tokozásban lehet egy olyan konfiguráció, amin van egy sokmagos proci, mellette négy GMI-vel bekötve egy Vega 20, azon 32 GB HBC, kifelé 1 TB rendszermemória, és SSG konfigurációban annyi tárkapacitás, amennyit a felhasználó beállít. Bár a doksik 16 TB-ot jeleznek elméleti határnak, tehát lesznek azért még limitek.

-

válasz

Jack@l

#35235

üzenetére

Jack@l

#35235

üzenetére

Azt írják abban a cikkben, hogy nem biztos az az 1000MHz, mert valószínűleg nem sikerült kiolvasni az értéket, mint a Vega10 tesztpéldánynál.

The clock speeds were obviously read incorrectly, but the same issue could be observed for Vega 10 before it was released (so yes, it does not mean it was running at 1000 MHz). The Vega 20 testing platform features Ryzen 7 1700.

-

válasz

Jack@l

#35221

üzenetére

Jack@l

#35221

üzenetére

Na kíváncsiságból utánanéztem, itt a teljes átirat:

Szóval 1,65 milliárd dollár bevételből ezek szerint 165 millió dollár származik a bányászoktól. Nem tudom mennyiért adnak egy videokártya chipet, de ha az egyszerűség kedvéért 165 dollárt feltételezek, akkor egymillió kártya ment a bányászoknak 3 hónap alatt.

Az 1,65 milliárd bevételből a CPU + GPU részleg 1,12 milliárd bevételre tett szert, a "konzolos és szerver részleg" meg 532 millió dollárt hozott.

Szerintem ezek hihető számok, persze el tudom képzelni, hogy az a 10% inkább 14,38% vagy ilyesmi. Viszont ha tovább gondolod, akkor Nvidiával együtt számolva havi egymillió darab körüli kártya mehet bányákba...

Total revenue of $1.65 billion was driven by strong demand for our new products, with Ryzen and Radeon products growing double-digit percentage year-on-year, Ryzen sales coming in higher-than-expected and EPYC server processors ramping. Gross margin was 36%, up 420 basis points year-on-year, driven by a higher proportion of revenue from new products.

...

Now, turning to the first quarter business segment results. Computing and Graphics segment revenue was $1.12 billion, up 95% year-over-year due to strong sales of both Radeon and Ryzen products. Our Ryzen offerings outperformed our expectations in Q1, accounting for approximately 60% of client processor revenue and contributed to strong sequential double-digit percentage growth in client revenue. The strength in Radeon products was driven by both gaming and blockchain demand. We believe blockchain was approximately 10% of AMD revenue in Q1 2018.

...

Enterprise, Embedded and Semi-Custom revenue was $532 million, down 12% year-over-year, with lower semi-custom revenue partially offset by higher server and embedded revenue. As a reminder, revenue in both Q1 2018 and Q1 2017 include semi-custom revenue related to quarter-end inventory, associated with non-cancelable purchase orders as required under the ASC 606 revenue accounting standard.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#35217

üzenetére

Jack@l

#35217

üzenetére

Jon Peddie Research

Ha mindenképpen programhoz ragaszkodsz, akkor a FireFox hardware database relevánsabb, mert sokszor nagyobb a minta. [link] - de ennek is ugyanaz a baja, mint a Steamnek, csak a minta nagysága közelíti a valós piac 10%-át, emiatt közelít jobban a JPR eredményekhez.

-

válasz

Jack@l

#35199

üzenetére

Jack@l

#35199

üzenetére

óh, contract keller.

a vicc a sztoriban az, hogy az ürge saját magával fog így versenyezni.@Pepeeeee: nem lehet örökké korlátozni a dolgozó jogait. amit tiltani, és amiért perelni lehet, az a versenytilalmi megállapodás megsértése (feltehetőleg ez miatt nem ment keller direktben az intelhez, hanem tett előtte egy teslás kitérőt), vagy ha a termék szabadalmat sért. utóbbit nem nagyon fog tudni az intel, köszönhetően a keresztliszensz-megállapodásnak.

-

#45185024

törölt tag

válasz

Jack@l

#35199

üzenetére

Jack@l

#35199

üzenetére

Ott az egyik kommentelő írja hogy "

Mindig is kíváncsi voltam, ezek a magasan képzett mérnökökre, akik

cégről cégre ugrálnak, hogy nem jelentenek nagy veszélyt a bizalmas vállalati fejlesztésekre?" Ezen én is sokat gondolkozom...

Koduri amikor azt mondják neki hogy nem használhat AMD technológiát attól még ott van a fejében az összes tapasztalati tudás. Tudja mit kell elkerülni max hívhat magához szakembereket pl Jim Kellert aki érti a gondolatait

Meg érti mikor kimondja hogy "gémorsz"

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#35134

üzenetére

Jack@l

#35134

üzenetére

A Microsoft DXR kiegészítése a DirectCompute API-t használja. Ezen fut. Nem tud OpenCL-en vagy CUDA-n futni, mert ezekre nem tudod lefordítani a DXR shader nyelvét, ami a HLSL 2017, de még a támogatott IR-ből, ami egyébként a DXIL, sem tudsz fordítani más platformra. Esetleg Vulkan API-n oldható meg a futtatás, ugyanakkor ehhez mindenképpen szükséges lenne direkt támogatás, amit a Microsoft nem igazán biztosít. Azzal önmagában nem mész sokra, hogy a DirectXShaderCompiler tud neked a HLSL shaderedből SPIR-V 1.3-at fordítani.

(#35135) gbors: Én inkább játékot kérdeztem, mert gondolom, ha ezt megnézted, akkor legalább kértél egy profilozást a hardverre.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#35120

üzenetére

Jack@l

#35120

üzenetére

A ray-tracing maga egy compute probléma. Minden GPU-n compute shader lesz a számítás. Az esetleges meghajtók ebbe nem fognak beleavatkozni, maximum a denoisingra adnak valami alternatív, nem compute shaderen futó megoldást. A fallback mód csupán azokra a hardverekre van, amelyek egyáltalán nem kapnak meghajtót. Pascal és korábbi GeForce-ok, Intel IGP-k, állítólag a GCN1 és GCN2.

Aszinkron compute mindenképpen használva lesz, mert maga a sugárkövetés egy rendkívül jól beolvasztható probléma minden olyan raszterizációs számítás mellé, ahol a multiprocesszorok amúgy is jórészt pihennek. Itt mindig is az volt a gondunk, hogy nincs elég számításigényes compute feladat ide, de a sugárkövetés tökéletes. Maga a fallback mód is támogatni fogja az aszinkron feldolgozást, persze a DirectCompute implementációnak továbbra is joga lesz visszautasítani a parancsokat, és akkor az OS beírja ezeket a saját grafikai parancslistájába.

Jelenleg egyik gyártó sem ad még eredményt a DXR-ről, mivel a Microsoft még tervezi a kiterjesztést. Nemrég találtak benne pár komolyabb hiányosságot, amit őszre bele akarnak kalapálni. De mivel a fallback layer publikusan elérhető, így természetesen tesztelhető is az aktuális verzió.

-

Cathulhu

addikt

válasz

Jack@l

#35052

üzenetére

Jack@l

#35052

üzenetére

Mit merjek ki? Hogy van-e 2x8 MB-nyi kozos cache terulet a magok kozott? Vagy hogy az OS dobalja-e a taskokat ide-oda a CCX-ek kozott mint Ryzenen? Oszinten varom az indoklasodat tovabbra is (es nem a mellebeszelest) hogy miert lenne hatranyos egy IF-al osszedrotozott tobb kisebb complexre szetosztott GPU architektura? Azert erdekelne, hogy tudjam valoban kapizsgalod-e amirol beszelsz, vagy csak "frocsogsz" a te szohasznalatoddal elve.

-

Cathulhu

addikt

válasz

Jack@l

#35031

üzenetére

Jack@l

#35031

üzenetére

A Ryzen igy sem szar, ha ertelmes sebessegen tud futni az IF. Ryzen+ tovabb csokkentette a latencyt, es ez csak egy tock volt, jovore a Ryzen 2-vel kiderul mennyit fejlodott a technologia az elmult evekben, es ez szamit, mert a Naviban is az lesz, ha lesz. Mas reszrol a GPU magok mennyit kommunikalnak egymassal? Kozos cache teruletuk nincs, global memoriat ugyanugy erik el, a feladatok fuggeltenek es jol parhuzamosithatok. Egyaltalan nem ugyanaz a helyzet.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#35031

üzenetére

Jack@l

#35031

üzenetére

Eleve nem lehetséges a felsőkategória egy ilyen megoldás nélkül. 5 nm-en még rosszabb lesz, mert 7 nm-en még csak kihozatali gondokkal küzdenek a bérgyártók, amit lehet úgy kezelni, hogy nem csinálnak nagy kiterjedésű lapkákat.

A Ryzennek ez adja az erejét. Ettől nem lehet sok helyen befogni sem az EPYC-et.

-

válasz

Jack@l

#34947

üzenetére

Jack@l

#34947

üzenetére

igen, gondolom. legalábbis ha az apple el akar adni ugyanannyi, vagy több terméket, akkor kénytelen lesz abba ugyanannyi, vagy több procit is venni. persze dönthet az apple úgy is, hogy megveszi a terveket, és a gyártást saját maga intézi.

amirt az applenek jobban megérheti az amd az intel helyett, az a már említett semicustom üzletág. ha az apple valami extrát akar, akkor az x86/64en belül más nem fog vele foglalkozni. az intel ehhez túl nagy, a via nem versenyképes, másnak meg se liszensze, se szabadalmai, és azokat megvenni sem tudja, mert senki nem adja el neki.

ez egy alapvetően teoretikus fejtegetés. egyelőre az sem biztos, hogy az apple valóban kukázza az intelt. de ha elkezdenek majd pletykálni thunderbolt csatolós amd termékekről, az elég egyértelmű lesz.@fules

: ja a bits elég megbízhatatlan. ez viszont nem azt jelenti, hogy 100% nem igaz, amit írnak, hanem azt, hogy nem tudod, mi igaz, és mi nem. mondjuk az eredeti bloomberg által lehozottnál ez éppenséggel hihetőbb.

: ja a bits elég megbízhatatlan. ez viszont nem azt jelenti, hogy 100% nem igaz, amit írnak, hanem azt, hogy nem tudod, mi igaz, és mi nem. mondjuk az eredeti bloomberg által lehozottnál ez éppenséggel hihetőbb. -

füles_

őstag

válasz

Jack@l

#34947

üzenetére

Jack@l

#34947

üzenetére

Mi értelme lenne egy lassabb, többet zabáló procinak az új gépekben akkor?

Mert gyorsabb és kevesebbet fogyaszt?

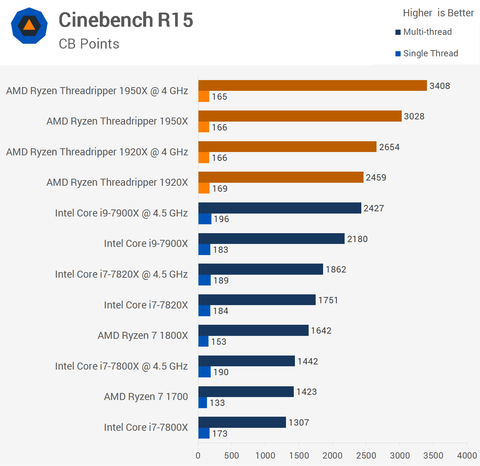

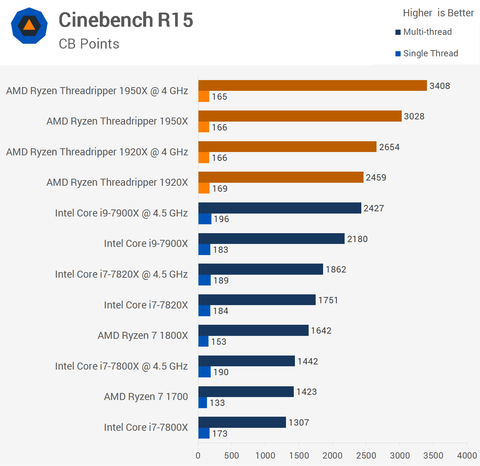

Tegyük fel, hogy egy esetleges új iMac Pro-ba Threadripper kerülne:

Nem látom, hogy annyival többet enne a Threadripper és annyival lassabb lenne, mint az azonos áron lévő i9.

Amúgy meg nem tudom, hogy mennyire akarok én a Bits and Chips-nek bármit is elhinni. Voltak már ilyen-olyan jóslataik a "megbízható forrásaikból".

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#34947

üzenetére

Jack@l

#34947

üzenetére

Nem az Intellel van szerintem bajuk, hanem azzal, hogy az Intel egy extrém tömeggyártásra berendezkedett gyártó. Ők nem fognak csak az Apple kérésére olyan lapkát tervezni, amibe az Apple saját IP-ket akar beépíteni. Szó szerint azt fogják mondani nekik, hogy ha nem jó az általános termék, akkor takarodjatok a picsába. Azért az 5%-os bevételért nem éri meg külön lapkákat tervezni, mert a jellemző diverzifikációjuk mellett túl nagy lesz a befektetés mértéke. Az AMD ezzel szemben külön üzletágat húzott fel arra, hogy a megrendelőnek esetleg lehetnek egyedi igényeik, és erre teljes portfólióval rendelkeznek, illetve nem egy design win kapcsolódik az üzletághoz. Az Apple számára ez is egy megfontolandó irány, mert ők igazából csak a saját IP-iket akarják beledobni a lapkába, az nekik gyakorlatilag mindegy, hogy az AMD vagy az Intel teszi meg. Főleg úgy, hogy a Zen igazából eléggé erős, a fogyasztása is élvonalbeli, a Thunderboltra idén már tervezhetnek saját vezérlőt is, mert szabadon felhasználóható lett a specifikáció, GPU-ból pedig eddig is a Radeonra tervezték a Metal 2 asztali fícsőrjeit. Tehát különösebb indokuk nincs az Intel mellett. Az egész azon múlik, hogy az Intel hajlandó-e sokkal kevesebb haszonért sokkal többet dolgozni az Apple kérésére. Ha nem, akkor megkérik erre az AMD-t, ha ők sem, akkor megcsinálják maguknak.

-

Petykemano

veterán

válasz

Jack@l

#34899

üzenetére

Jack@l

#34899

üzenetére

Nem világos, hogy mire gondolsz.

A 2. számú versenyző egy 45W-os TDP-vel rendelkező procival és ha az 1760 az a vga turbó órajelét jelenti, akkor még csak nem is maxq, hanem sima 120W TDP-vel rendelkező gpu.Az 1700+580 noti valószínűleg még ennél is nagyobb fogyasztási keretekkel rendelkezik.

Hogy érted, hogy ezekkel a NUC817HVK (100W target TDP)nem összevethető?

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#34883

üzenetére

Jack@l

#34883

üzenetére

Annyi memória kell a scene-hez, amekkora az assett. Jelen bemutatón 700 GB körül volt. Ha nincs a VGA-n ennyi memória, akkor be se tölt. Látod mellette, hogy kiírja out of memory. Erre szokták az assetteket feldarabolni. Leszeletelik ~10 GB-os részekre, és külön-külön ellenőrzik. Ez az SSG-vel nem szükséges. Befér egyben az egész assett. De amúgy nem ez a jellemző, hanem inkább procikat használnak 2-4 TB memóriával.

Nincs értelme 10-20GB-os kártyákról beszélni, amikor ~700 GB a tartalom. Akkor se fér be, ha 128 GB memória van a VGA-n. Out of memory üzenettel leáll a program a tartalom betöltésekor.

Az SSG vásárlóbázisa erről tud. Ha másképp nem, akkor elmentek az AMD hollywoodi stúdiójába, és megnézték személyesen. Ez az egész SSG egy filmes irányt fed le, ahol az assett mérete marha nagy. Mint a legtöbb nagyobb produkciónál. Másnak nincs különösebb haszna belőle, nem dolgoznak elég nagy adatokkal, hogy számítson az a sok memória. -

Abu85

HÁZIGAZDA

válasz

Jack@l

#34880

üzenetére

Jack@l

#34880

üzenetére

Attól, hogy nem kell egy részét leképezni, még be kell tölteni a modellt a programba. Aztán a 16 GB-os gyorsítótárként működő HBC-be elég az éppen feldolgozott adatokat használni.

Azon a jeleneten fel van cserélve a két kép alatti aláírás. Ki is javítják, ha nézed tovább. Röhögnek is rajta, hogy pont az alá rakták az SSG-t, amin nem volt, és az alá írták, hogy nem SSG, ami az.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#34876

üzenetére

Jack@l

#34876

üzenetére

Láttak már közel terabájtosat is. Az AMD maga mutatta be az SSG bejelentésekor. [link] - 2 TB az optimálisan betölthető tartalom határa. Egyébként fölé lehet menni, a Radeon Pro elfogadja 512 TB-ig, de 2 TB fölött erősen esik a sebesség, mivel ott már az adattárolóról kell streamelni, egy elég lassú buszon keresztül. De technikailag 512 TB-ig megcímzi.

(#34877) Z_A_P: A HBCC miatt teljesen mindegy. Láthatod a videóban, hogy mennyire nincs baja még a terabájthoz közelítő tartalommal sem.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#34868

üzenetére

Jack@l

#34868

üzenetére

A shader modell 6.0, és a 6.1-et, illetve a 6.2-t is támogatja az összes GCN-es Radeon. Nem értem a +SM6 mire vonatkozik. Az más kérdés, hogy a fejlesztők továbbra is az AMD AGS4/5 szervizkönyvtárát használják a szabványos shader modell 6.0 helyett, de ez igazából nem technikai akadály, hanem egy szimpla fejlesztői döntés. Az AMD számára mindegy, hogy melyiket vetik be. A fejlesztőnek persze nem, mert az SM6-hoz Xbox One shaderek kellenek, míg az AGS4/5 úgy van felépítve, hogy a PS4 shadereit lehessen rá jól fordítani.

-

Cathulhu

addikt

válasz

Jack@l

#34861

üzenetére

Jack@l

#34861

üzenetére

Es mintha most fordulna elo eloszor az AMD vagy az nVidia torteneteben, hogy a kozepkategoriat vagy az alsot eppen csak az elozo generacio atnevezesebol kepezi. Masresz mondd melyik az a feature, ami kihagyhatatlan a vega11-bol es nincs az RX580-ban es meg fognak veszni erte az atlagemberek?

-

Cathulhu

addikt

válasz

Jack@l

#34852

üzenetére

Jack@l

#34852

üzenetére

szvsz felesleges. ott vannak a polarisok. fogyasztasban, teljesitmenyben, featurokben nem tudna tobbet, cserebe dragabb gyartani

Amugy szerintem nincs szabad kapacitas, ott vannak a ravenek, a kaby lake, a nagy vegak, ezek mind vegak, utobbi 3 hbm-mel. Polarisnak legalabb jo normal RAM. -

Petykemano

veterán

-

HSM

félisten

válasz

Jack@l

#34721

üzenetére

Jack@l

#34721

üzenetére

"és cserélhetsz procit gpu-t egyben 150e-ért"

Pont ez a cél gyártói oldalról.

"Bizonyára fogákonyak lesznek rá a népek."

A "népek" pont hogy azt se tudja, mit vesz, mi van a gépházon belül. Leveszi a polcról az OEM gépet amire van keret és kész. Majd amikor elmegy szervízbe évek múlva, hogy lassú, upgrade kell, akkor szembesül majd először vele, hogy hoppá van, kukázhatja az egészet.... -

Abu85

HÁZIGAZDA

válasz

Jack@l

#34717

üzenetére

Jack@l

#34717

üzenetére

Inkább ne legyen úgy, mert alapvetően nem örülök ennek az iránynak, de sajnos kétségtelen tény, hogy az utóbbi időben mindenki erről beszél, nem csak az AMD. Addig biztos, hogy a CPU és a GPU, illetve a memória tokozáson belülre kell. Az NVRAM esetében már vannak kétségek.

-

golya87

őstag

válasz

Jack@l

#34682

üzenetére

Jack@l

#34682

üzenetére

Nem igazán értem a céljaidat, persze te és do3om vagytok a helyi megmondó kapitányok. Mire jó ez? A melóhelyen mindig szétszivatnak és itt megmutatod a világnak?

Az AMD következő generációs APU-ja hétfőn jön, Intel-nek is van/volt ilyenje, de GPU hiányában ez eddig nem volt az igazi. De nem hiszem, hogy nagy jóstehetség egy Raja-val az oldalukon hasonló terméket várni tőlük pár éven belül.

A Bulldozer nem jött össze, így egyet visszaléptek és készítettek egy procit, amivel megvolt a belépő, most pedig jön az APU szerényebb felhasználói igényekre.

Az Inteles házasságnak a jelenlegi bevétel mellett az lehet még az értelme, hogy így az Intel fogja megteremteni azt a termékkategóriát, amit egyedül nem tudtak volna. Így az Intel farvizén akár még előzhetnek is itt. -

Abu85

HÁZIGAZDA

válasz

Jack@l

#34676

üzenetére

Jack@l

#34676

üzenetére

Az AMD-nek és az Intelnek a Kaby Lake-G nem sokat ér önmagában. De azért nem nehéz elképzelni, hogy hamarosan az Intelnek ugyanide saját pGPU-ja lesz, ahogy az AMD-nek saját megoldása erre a koncepcióra. Innentől kezdve a piac jelentősen megváltozik, mert nem fognak az OEM-ek a pGPU-val eladott CPU-k mellé még egy extra GPU-t venni. Erről szól ez az egész. A magam részéről még azt sem zárom ki, hogy az NV is átáll erre a modellre, elvégre a Microsoft feléjük dolgozik az S móddal.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#34674

üzenetére

Jack@l

#34674

üzenetére

Nem lehet választani, hogy ki hol szeretne versenyezni. Az IGP-k olyan gyorsakká váltak mára, hogy a piac majdnem ~90%-át le tudják fedni. A Kaby Lake-G-vel pedig lefedhető a maradék ~10%-ből ~6%. Senkit sem érdekel az OEM-eknél, hogy ki mit gondol erről. Az IGP és a pGPU csomagban jön, tehát akkor is ki kell fizetni, ha sose használják. Ergo értelmetlen ez ellen küzdeniük, mert csak a pénzük megy rá, a felhasználó felé pedig nem közvetítenek értéket.

Mondhatod, hogy neked nem tetszik, mert a választás szabadságát gátolják vele, de mit tudnak ellene tenni? Nem ők kérik ezeket, hanem az Intel és az AMD erőszakolja rájuk.Egyébként játszani is nagyon jól lehet a Raven Ridge-dzsel. A Kaby Lake-G pedig gyakorlatilag felér egy GTX 1060 Max-Q-val. Nagyjából 7-9%-ra van az asztali GTX 1060-tól a teljesítménye. A probléma az, hogy ennél ezek csak jobbak lesznek, elvégre a HBM2-t sem használja a határon az Intel, és sajnos nekik azért megvan arra is a hatalmuk, hogy kivegyenek pár PCI Express csatornát a CPU-ból, mert most éppen az lett az érdekük. Mind ismerjük az Intelt, hogy ha a saját piacukat kell védeni, akkor a tisztességtelen módszerektől sem riadnak vissza. Aztán az NV és az AMD csak leshet.

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#34618

üzenetére

Jack@l

#34618

üzenetére

Az id software ezt pénzt nélkül is megtenné. Ami megakadályozza őket ebben az a dokumentáció, az ISA disassembler, a nyomkövetésre épülő profilozó, valamint az adott API-hoz/IR-hez való kiterjesztések/kiegészítések hiánya. A kódjuk igazából a PSSL-ből megvan hozzá, tehát akárhogyan tudnak fordítani SPIR-V-re, esetleg módosítani, ha a fentieket biztosítja az NV.

-

do3om

addikt

válasz

Jack@l

#34599

üzenetére

Jack@l

#34599

üzenetére

Nekem egyáltalán nem szimpatikus amit művelnek, már Abu is megint valami új ifcsört emleget, ami xx% os gyorsulás lesz. Nagyotmondásban az AMD csíkja magasan vezetne, folyton kitalálnak valamit és ennek van aki még örül is mondván fejlesztenek! De valójában meg az történik mindig hogy maguknak találnak ki valamit amivel saját magukat húznák ki a szarból és ezt próbálják úgy beállítani hogy na ez mindenkinek jó főleg a fejlesztőknek, próbálják elérni hogy a fejlesztő javítsa ki amiért valójában a VGA-jukban van a limit.Van egy VGA-juk ami papíron igen jó valójában meg amit tud az lényegesen kevesebb, de majd adnak a fejlesztőknek megint valamit hogy na erre menjetek rá feloldjuk a titeket sújtó korlátokat amiket valójában mi nem tudunk megoldani mert a saját hardverünkben van. Ezt próbálják úgy előadni mintha teljes piacnak szükség lenne rá.

Aztán csodálkozás van ha szinte senki nem alkalmazza mert eseti problémára ad választ amit az generált aki pont a megoldást akarja eladni nekik. -

Abu85

HÁZIGAZDA

válasz

Jack@l

#34534

üzenetére

Jack@l

#34534

üzenetére

Ez nem a jövő. Ez a jelen. Frostbite, id tech 6.5 már csinálja. A Dunia is csinálni fogja.

Ami új dolog lesz az egy olyan tool, amit integrálva egy motorba leegyszerűsíthető a GPGPU-s culling implementálása (értsd a meglévő és kivágás szempontjából fontos vertex shadereket compute shaderré konvertálja, és kiegészíti a legacy modellt). Mert azért ez ma eléggé nehéz. -

-

-

-

Cathulhu

addikt

válasz

Jack@l

#34429

üzenetére

Jack@l

#34429

üzenetére

"Revenue: $1.48 billion vs. $1.41 billion as expected by analysts, according to Thomson Reuters."

Akkor sem hasonlitunk Q4-et Q3-hoz, se Q1-et Q4-hez, se semmilyen modon, mivel mind a piaci mind az ipari mozgasok masok az ev kulonbozo szakaszaiban, viszont evrol evrel jol ismetlodnek. Ha te peldadbol indulnank ki, az osszes mobilreszvenyes panikolna a Q1-es adatokat latva, mert ott jellemzoen a Q4 az eros.

-

Petykemano

veterán

válasz

Jack@l

#34420

üzenetére

Jack@l

#34420

üzenetére

Mi tartozik a "Computing and Graphics" és mi a "Enterprise, Embedded, and Semi-Custom" alá pontosan?

Az RTG az C&G?

A Ryzen melyik? C&G?

A Semi-custom nyilvánvaló.

Az EPYC Enterprise?A C&G javított. Ha az RTG ide tartozik akkor nyilván benne van, hogy eladtak minden tervezett GPU lapkát. Ha a Ryzen is, akkor nyilván az is ide tartozik. Előző évhez képest +60%

Az EE&SC meg rontott. Gondolom az lehet, hogy Q3-ban befolyt az X-box X és a PS4 pro-ból nagy bevétel, aztán meg már nem olyan nagy. Vagy lehet, hogy akkor fizetett az intel a Vega M tervezésért. De ez lehetett az oka annak, hoyg előre figyelmeztettek, hogy a Q4 rosszabb lesz, mint a Q3 volt.

Számomra úgy tűnik, hogy az EPYC vagy nem érett még meg, vagyis még nem adták el, vagy olyan kismértékű a vásárlás belőle, hogy az elképesztő.

A jólmenő ryzen és a bányászatra az utolsó darabig eladott GPU is csupán +400 millió dollárt ér? Értem, hogy az +60% és nyilván a termelés nem annyira rugalmas, hogy ha terveznek 100db-ot és menet közben jön a kereslet, akkor hirtelen elő tudnak rántani 200-at vagy 300-at. Valószínűleg az évről évre +30%-kal növekvő bevétel a block-chain miatt az óvatos tervezésnek köszönhető.

De akkor is a jólmenő ryzen és a bányáaszatra eladott gpu csak +$400M. Jó, az nvidia is "csak" kb negyedévente $2B bevétellel rendelkezik, tehát itt nincs nagyságrendbeli különbség, de az intel? Ott nem ilyen negyedéves szinten $15B bevételről van szó?

Tehát jól menő ryzen, utolsó darabig eladott gpu, EPYC => +$400M bevétel

Miből jön az intelnél a $15B? Ebből $5B Data center, $9B pedig Client computing.Mi az, ami miatt az AMD a kiváló(nak látszó) cpu termékeivel és az utolsó szemig eladott gpu-kkal is erről a majdnem húszmilliárdos piacról ha megfeszül is csak néhány százmillióval többet tud elhozni. Ráadásul úgy, hogy közben az intel is növelte a bevételeit.

Nyilvánvaló persze, hogy a client computingnak csak kis része a DIY, és nagy része OEM és/vagy notebook.

És ringathatjuk magunkat abba is, hogy az EPYC esetleg még nincs eladva.De ha csupán ez, akkor az AMD egy óriási boom előtt kellene, hogy álljon. Ha a Data center 10%-át elvinné, az intel szinte meg se érezné, miközben a z AMD duplázná az ottani bevételeit.

Ha a client computingból az AMD elhozna 10%-ot, ott ugyanez. Ehhez képest csak 30%-os növekedést prognosztizálnak és azt is a block chain miatt.

-

#45185024

törölt tag

válasz

Jack@l

#34419

üzenetére

Jack@l

#34419

üzenetére

Ebben nem az a borzasztó amit kiemeltél

a Vega 20 Instinct az amire poor voltázott a Koduri majd ő harcol a Titán V ellen.

Ez a 3000 dolláros kategória úgyse érdekel se téged se engem.

De az hogy ilyet mond hogy

" AMD expects revenues to grow by a staggering 30 percent quarter-over-quarter in Q1-2018, riding on the blockchain (crypto-currency mining) wave. The company's graphics processors offer high efficiency at mining popular crypto-currencies, such as Ethereum, Z-cash, and Bitcoin. "

30%-os növekesést ??? Az a baj nem tünik úgy hogy elfordulnának a bányászattól, sőt...

A Gamerek nem fognak 800 dollárt adni egy Vega 56-ért, de egy 6-os bányász rig ami kitermel havi 900 dollárt az viszont igen ! -

Petykemano

veterán

válasz

Jack@l

#34401

üzenetére

Jack@l

#34401

üzenetére

Hát ez szerintem attól függ, hogy mit értünk "lóvé" alatt.

Nyilvánvaló, hogy ha az nvidia számaiból indulunk ki, akkot ott az látszik, hogy sokkal nagyobb árbevétel jön a gamer piacból, mint a profiból. Vajon ez a haszonra is igaz?

Az nvidia nyilván magasabb árréssel tud dolgozni a gaming piacon. Lehet, hogy szűkös kapacitások mellett - bizonyos számítások szerint - jobban megéri törekedni a gigantikus árréssek dolgozó pro piacra néhányezer termék eladásával, mint hogy az árrés minimálisra csökkentésével növelni a gaming piacon az eladási volument.Ez most persze csak pure speculation. De hát valami oka csak kell legyen, hogy szerencsétlen polarist (ami nem a GCN skálázódásának határa) nem tápolták fel ROP-pal, meg miegyebekkel, ami nem a CU, hanem következetesen olyan compute-nehéz lapkákat készítenek, amit a főleg compute képességeket használó pro szegmensben is el lehet sózni egy kalap alatt. Ez alól hosszú ideje a Vega M lesz az egyetlen kivétel.

Persze lehet, hogy csak simán tök hülyék.

-

-

apatyas

Korrektor

-

TTomax

félisten

válasz

Jack@l

#34379

üzenetére

Jack@l

#34379

üzenetére

"One representative told us that it might be possible to configure a gaming system through Micro Center's online store and get the discount approved there, but you'd have to pay for it first since it's online, and then call in and have a partial refund given."

Aham,rögtön,mint a kutya vacsorája,ha úgy gondolják akkor meg nem adnak egy vasat se vissza és így jártál.

-

Yany

addikt

-

válasz

Jack@l

#34320

üzenetére

Jack@l

#34320

üzenetére

Ez most irreleváns. Nem 6-os sorozatról beszélünk, hanem egy nyújtott élettartamú 5-ös sorozatról (szégyen, hogy nincs még utód kanyarban sem, a Vega meg triple facepalm), így érthető, ha az MSI úgy láttam jónak, ha frissít rajta. Persze mondhatjuk, hogy feleslegesen, mert enélkül is elkel mind egy szálig (thx to miners), de azért el kell ismerni, jól néz ki ez az új Armor design.

-

válasz

Jack@l

#34302

üzenetére

Jack@l

#34302

üzenetére

A: driverből biztosan lehetett volna valami generic sweep jellegű megoldást csinálni, ami nem hoz iszonyú sokat, de működik. Ilyenkor persze mindig benne van a fals pozitívok lehetősége, lehet, hogy ezekkel nem bírtak végül zöld ágra vergődni.

B: ennek az egész mókának akkor van értelme, ha olyan háromszögeket is kidobál, amiket aztán ki kell textúrázni / shadelni / pixelizálni / anyámkínja, és a végén nem látszanak (közvetve sem). Ha csak arra jó, hogy az eldobálást korábbi fázisban ejti meg, de a shadingbe eljutott háromszögek halmaza ugyanaz, akkor beépíteni is felesleges volt. Nehezen akaródzik elhinni, hogy az utóbbiról van szó (olyan arcok adták a nevüket a sztorikhoz, mint Rys Sommerfeldt), de most már nem tartom kizártnak.(#34304) HSM: én el tudom hinni - lehet, hogy a DSBR esetében előbb jöttek rá, hogy ebben a konfigurációjú chipben nincs túl sok értelme

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

Petykemano

veterán

válasz

Jack@l

#34302

üzenetére

Jack@l

#34302

üzenetére

Lehet új irány is. Mármint hogy rádzsa elképzelése ez volt. Volt szó róla, próbálták, aztán úgy döntöttek, a gyakorlatban mégsem jól kivitelezhető.

A minden játékra megcsinálnihoz csak meb annyit, hogy nem azt csinálják, hogy cserélik a shadereket driverből? Abu mimdig valami ilyen tevékenységet mond.

Ezzel együtt persze biztos nem lehet umiverzálisam olyan nagy hatást elérni, mint direkten. És ha univerzálisan brtuálisan x% előnyt jelentene, ehhez képest kutya se macska programozna driektben. Míg ha nincs univerzális megoldás 100-ből 2 játékhoz oda tudnak ültetni egy fejlesztőt

-

#45185024

törölt tag

válasz

Jack@l

#34278

üzenetére

Jack@l

#34278

üzenetére

Nemcsak a bányászat.

+Nőttek a Memória árak (HBM) amit szerintem eddig is megbeszéltek egymással a gyártók és mesterségesen visszafogtak a kialakult nagyobb haszon reményében, csak nem lehet rájuk bizonyítani

+Custom kártyák ára most jött rá ami a tervezett 75 dollár helyett inkább 100 font fölött van mert most mindenkinek erősebben fog a ceruza

+Hiánygazdaságból adódó nagyobb haszonkulcsok, ami egyrészt a kis kihozatal másrészt a bánya miatt jóval nagyobb mint máskor.

Miért ne használnák fel a 64et bányára? A rajta levő Samsung memória jobban tartja a magasabb órajelet

ami most már esetenként 1100 fölé is felmegy (1200)

A bányász részben akkor lesz változás ha Dél Korea törvényileg betiltja a krptovaluták forgalmazását (SOON)

Az a vicces a történetben hogy az 1000 Watt feletti tápok elérhetetlenek és hogy március végéig ne is számítsunk a helyzet javulására VGA fronton...

Kíváncsi leszek az első negyedévi jelentésekre de a tavalyi Q4 is érdekes lesz... -

stratova

veterán

válasz

Jack@l

#34143

üzenetére

Jack@l

#34143

üzenetére

Míg Envy x360 15,6"-ba bekerült az i7-2700U/2500U addig a magasabb kategóriába sorolt Spectre x360 15-nél érkezőben a kisebbik i7-8705G (4/8+20CU), ugyanez a gép jelenleg i7-8550U + MX150-nel is fut.

A pletykák szerint Dell és Asus is épít rá.Mi marad szegény Ryzen 5 2400G-nek?

-

HSM

félisten

válasz

Jack@l

#34140

üzenetére

Jack@l

#34140

üzenetére

Nem nyert.

MX150: GP108, 384 shader, 64bit bus. [link]

GTX1030: GP108, 384 shader, 64bit bus. [link]

GTX1050: GP107, 640 shader, 128 bit bus. [link]

Szerintem is az utóbbira hasonlít, ja, nem, lol.

Perf/watt arányban szvsz bőven lesz benne potenciál, kapásból rengeteget spórolnak a HBM-el, és itt ráadásul nem kell eszetlen magas órajelre hajtani a GPU-t sem.

(#34141) Ribi: Így van, kell a nagy borda. Írtam is, hogy inkább kisebb 50-65W TDP-vel látom életképesnek kisebb (13-14") gépekbe.

A 6W-os proci azért 90 fokos, mert lespórolják róla a hűtést. Persze, a legtöbb gamer notin is ez a helyzet, de ez nem a belerakott hardver hibája.

Meg lehet amúgy ~100W hűtését normálisan is csinálni, pl. hardveres szempontból szvsz elég jó lett a Lenovo Y700 hűtése [link], ott 15,6"-os gép szintén 100W-nyi hardverrel van, és ha szoftveresen nem bő 70 fokra lőtték volna be a throttling határát akkor a sebessége is jó lenne. (Nem tudom, azóta ezt javították-e már.)

2,5cm vastag, 2,6KG-os gép, egyáltalán nem vészes [link]. Ha ugyanezt megcsinálnák egy ilyen APU-val, kapásból csökkenne a súly, mert rövidebb heatpipe elég lenne, és nem kéne két platni a VRM-eknek és memóriáknak, és jelentős hely felszabadulna a gép belsejében. Ezen kívül a hőleadás is hatékonyabb lehetne, hiszen a hűtőbordához közelebb tudnák rakni a melegedő APU-t és VRM-et.

Szval szvsz egyáltalán nem szükséges 3-4 centi vastag gépházú 17-19"-os, praktikusan hordozhatatlan gép 100W-ot meghűteni.

-

HSM

félisten

válasz

Jack@l

#34137

üzenetére

Jack@l

#34137

üzenetére

Azzal, hogy az a 100W egy helyre összpontosul, elég egy helyről elvezetni a hőt, egy VRM-et tenni, hűteni. Borda fog neki kelleni masszívan, de bőven lesz neki hely, mivel rengeteg szabad helyet teremt a GPU és memóriájának kvázi elhagyása. Kelleni fog neki egy durván 130W-os táp ez tény, az még nem olyan vészes.

"Kicsit ráver" a mostani IGP-kre? Egy 24CU-s Vega dedikált 4GB HBM memóriával? LOL...

LOL...

Az MX150 az kb. egy GT1030, azt még egy 14CU-s RX460-as Polaris is megeszi reggelire 128bites GDDR5-el, ez egy "picit" izmosabb GPU lesz 24CU-val. -

HSM

félisten

válasz

Jack@l

#34135

üzenetére

Jack@l

#34135

üzenetére

Pedig ezek nagyon-nagyon vad holmik lesznek játékos notebookba. Ugyanis nem csak a kétajtós szekrény méretű gépekre van igény, és egy ilyen HBM-es IGP-s rendszerrel nagyban leegyszerűsödik a hűtés és a korábbi megoldások helyigényének töredékén elfér, ami olyan gépek előtt nyitja meg az utat, ami korábban elképzelhetetlen volt. Kicsi, erős, és mondjuk még egy nagyobb akkunak is több hely marad. Egy kicsit megvágva a TDP-t (50-65W magassága) pedig még mindig burálisan erős, és mégis kicsi 13-14"-os gépeket is el tudok köré képzelni....

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#34128

üzenetére

Jack@l

#34128

üzenetére

És meg is pusztult minden program, ami arra az erőforrásra volt kötve. Ha az erőforrás létrejött, akkor nem lehet anélkül leválasztani, hogy az ne kényszerítené bezárásra az erőforrást használó alkalmazást.

Egyébként alapvetően a Chill lényegesen többet hoz, mint amit egy alternatív profil hozna. Nekem például a Dungeon Seige 3 feleakkora fogyasztással is elfut 45-60-as Chillel Enhanced Sync mellett, mintha nem alkalmaznák semmit. És ez a teljes gép fogyasztása, nem csak a VGA-é. Egy szimpla update-elt profillal örülhetnék a 10%-os előrelépésnek és ez nagyon maximum. -

válasz

Jack@l

#34046

üzenetére

Jack@l

#34046

üzenetére

Pixelben a GTX 1080 cca. 20%-kal gyorsabb, mint a Vega64. ALU-ban a Vega64 cca. 30%-kal gyorsabb, mint a GTX 1080. Ha egy motor egyensúlya eltolódik valamelyik irányába, akkor az eredmény simán elmehet a status quo-tól 10-15%-kal. Aztán azon persze lehet vitatkozni, hogy miért tolódott el

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#33927

üzenetére

Jack@l

#33927

üzenetére

A Doom és a Wolf 2 nem a Vulkan miatt erős a Radeonon, hanem azért, mert a Radeonok a PSSL-ből fordított SPIR-V kódokat futtatják. A GeForce-ok és az Intel IGP-k a GLSL-ből fordított SPIR-V kódokat kapják meg. Ez egy nagyon specifikus tényező. Az id software számára kedvezőbb, ha az AMD-re szimplán a PS4 shadereit fordítják le, mivel így a GLSL shadereket az NV-re és az Intelre tudják optimalizálni. Alapvetően nem végeznek sokkal több munkát, mert PS4-re úgyis elkészülne a játék, és cserébe szét tudják választani a PC-n belül az AMD és a többiek optimalizálását. Ergo nem kényszerülnek olyan döntésekre, hogy kérdéses esetekben az egyik gyártó megoldását favorizálják.

-

-

Abu85

HÁZIGAZDA

válasz

Jack@l

#33816

üzenetére

Jack@l

#33816

üzenetére

Régen egyszerűbb volt a tervezés, mert nem kellett megoldani az árnyékolást effektív 6 GHz fölött. Ma nem véletlen, hogy nincs 512 bites megoldás, nem igazán realitás a megszokott NYÁK-méretekkel.

Mindkét megoldásnak vannak előnyei és árnyoldalai.

A GDDR esetében a problémát az árnyékolás, a NYÁK komplexitása, a sok stack kötelező használata, és az energiaigény jelenti.

A HBM esetében a probléma az interposer miatt megnövekvő komplexitás a tokozás oldalán. Vagy ha nincs interposer, mert hamarosan ilyet is lehet kérni a Samsungtól, akkor ott is komplex lapkák tokozáson keresztüli összekötése. Cserébe elég csak pár stack, nincs árnyékolási probléma, nem lesz komplex a NYÁK, és az energiaigény a töredéke a kivezetett memóriákhoz viszonyítva.Itt általánosan ütköznek a pro-kontra érvek. A gyártói oldalon egyébként a fő kérdéseket már az eldönti, hogy mekkora kapacitásra van szüksége. Ha sokra, akkor érdemes a GDDR6 felé menni. Ha kevésre, akkor jobb a HBM2. Általánosan viszont mindkettőnek számos előnye és negatívuma van. Ugye ha az egyiknek nem lenne negatívuma, akkor a másik eleve nem is létezne, mert minek, ha az egyik maga a tökéletes memória. Ellenben mindkettő létezik, mert ami az egyiknek az előnye, az a másiknak a hátránya és fordítva.

-

HSM

félisten

válasz

Jack@l

#33819

üzenetére

Jack@l

#33819

üzenetére

Én is kerülöm ezeket, de attól még bőven léteznek.

És gyakran a magasabb memória órajeleken gondot is okoznak. Elég torkos a gyors GDDR5 a kis hőleadó felületéhez képest.

És gyakran a magasabb memória órajeleken gondot is okoznak. Elég torkos a gyors GDDR5 a kis hőleadó felületéhez képest.Ami a GPU szomszédságát illeti, azzal semmi gond nincsen, a szilícium nagyon rossz hővezető, a levegő mégkevésbé, szóval a 90 fokos GPU mellett jó, ha 50-60 fokos a borda, ami bőven ideális hely egy memórialapkának. Ami kérdés, az interposeren mennyi hőt tud kapni, de szvsz nem sokat.

-

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- Honor Magic5 Pro - kamerák bűvöletében

- Honor Magic6 Pro - kör közepén számok

- OnePlus One - Kína már itt One

- AMD Ryzen 9 / 7 / 5 9***(X) "Zen 5" (AM5)

- Autós topik látogatók beszélgetős, offolós topikja

- Ingatlanos topic!

- Gumi és felni topik

- Autós topik

- Milyen billentyűzetet vegyek?

- Kertészet, mezőgazdaság topik

- További aktív témák...

- AKCIÓ! Apple Macbook Pro 16" 2019 i9 9980HK 64GB DDR4 1TB SSD Radeon Pro 5500M garanciával

- Bomba ár! Lenovo ThinkPad Yoga 260 - i5-G6 I 8GB I 256SSD I 12,5" Touch I W10 I Cam I Gari!

- AKCIÓ! MSI B450 R5 5500 16GB DDR4 512GB SSD RTX 2070 8GB GDDR6 Rampage Shiva Zalman 500W

- LG 27GR93U-B - 27" IPS - UHD 4K - 144Hz 1ms - NVIDIA G-Sync - FreeSync Premium - HDR 400

- 3DKRAFT.HU - 3D NYOMTATÁS - AZONNALI ÁRAJÁNLAT - GYORS KIVITELEZÉS - 480+ POZITÍV ÉRTÉKELÉS

Állásajánlatok

Cég: Promenade Publishing House Kft.

Város: Budapest

Cég: CAMERA-PRO Hungary Kft

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

: ja a bits elég megbízhatatlan. ez viszont nem azt jelenti, hogy 100% nem igaz, amit írnak, hanem azt, hogy nem tudod, mi igaz, és mi nem. mondjuk az eredeti bloomberg által lehozottnál ez éppenséggel hihetőbb.

: ja a bits elég megbízhatatlan. ez viszont nem azt jelenti, hogy 100% nem igaz, amit írnak, hanem azt, hogy nem tudod, mi igaz, és mi nem. mondjuk az eredeti bloomberg által lehozottnál ez éppenséggel hihetőbb.