- Xiaomi 14T Pro - teljes a család?

- Honor Magic6 Pro - kör közepén számok

- Xiaomi 13 - felnőni nehéz

- iPhone topik

- Nothing Phone (3a) és (3a) Pro - az ügyes meg sasszemű

- Samsung Galaxy S21 és S21+ - húszra akartak lapot húzni

- Android alkalmazások - szoftver kibeszélő topik

- Íme az új Android Auto!

- Samsung Galaxy Watch7 - kötelező kör

- Samsung Galaxy S24 FE - később

Új hozzászólás Aktív témák

-

HSM

félisten

válasz

#85552128

#29673

üzenetére

#85552128

#29673

üzenetére

1. Az architektúra az általad említett esetekben nem változott jelentősen, hanem gyakoraltilag csak tovább csiszolták a meglévőt, kb. mint a GCN1 és GCN2 váltás, és ehhez jött az új process.

Plusz gyorsan tegyük ide hozzá, hogy a 80% előrelépéshez a megjelenéskor kellett egy Titán, valamint új memória technológia (GDDR5X), aztán persze később a gyengébb 1080Ti is feljött erre a szintre.A Vega esetében viszont nemhogy 25%-al gyorsabb memóriát kapott volna, hanem memória sebesség tekintetében még visszalépés is történt. Tehát oké,ez egy komoly előrelépés volt, de nem teljesen ugyanez a helyzet, mint most a Vega-val, ahol egy jó adag funkció még ki sincs használva, mivel egy lényegesen durvább technológiai váltás történt, és ilyenkor nem elég csak tovább reszelni a meglévő drivert. Demókon már láthattuk pl. a HBCC hatását, hogy Vega-n vígan szalad olyan kód, ami a konkurencián el sem tud indulni.... Na, az hány % előrelépés?

-

HSM

félisten

válasz

#85552128

#29666

üzenetére

#85552128

#29666

üzenetére

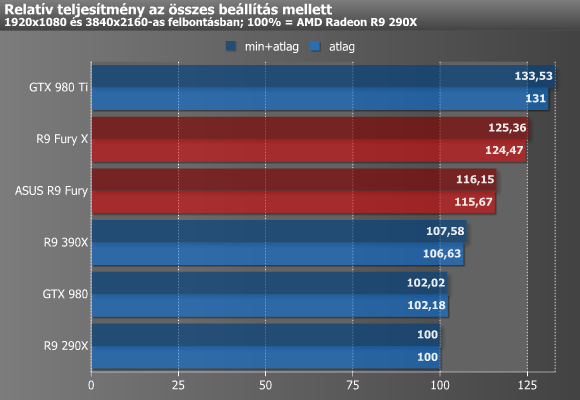

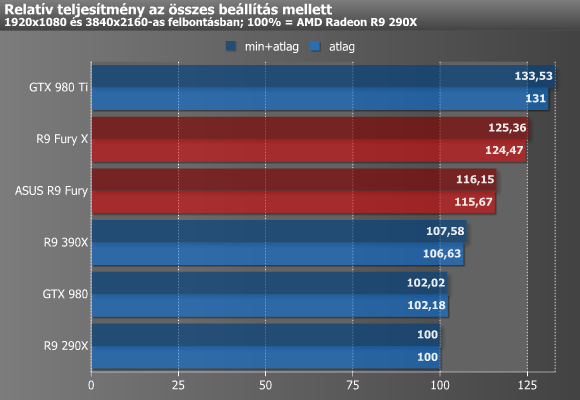

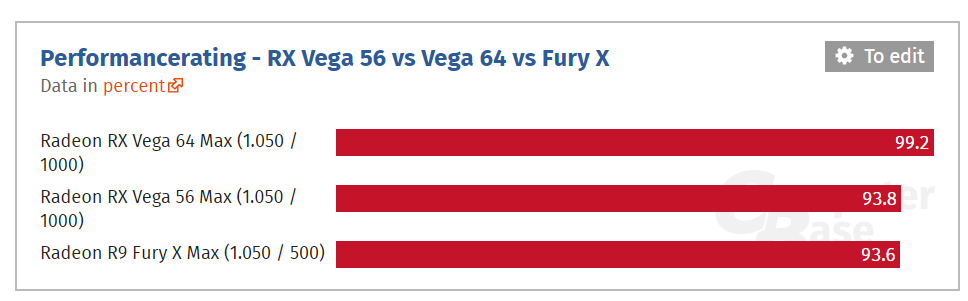

Mondjuk azt a +25%-ot?

(Mindezt úgy, hogy a memória sávszélesség még csökkent is a Fiji óta!) Egyébként más területeken ennél több is viszsajöhet még ebből.

(Mindezt úgy, hogy a memória sávszélesség még csökkent is a Fiji óta!) Egyébként más területeken ennél több is viszsajöhet még ebből.Architektúrális fejlődésről beszéltünk, tessék, megkaptad az eredményed. A 4K-t nincs értelme nézni, mert ott ezt a frissebb kártyát is megfogja a memória sávszélessége, így nem architektúrák közötti fejlődést néznénk, hanem azt, hogy mi történik, ha memória sávszélesség limitessé tesszük a tesztet.

-

Oliverda

titán

válasz

#85552128

#29657

üzenetére

#85552128

#29657

üzenetére

Akkor épp itt az ideje kukázni a GCN-t, aminek a több mint 5 éve megjelent első verzió sikerét leszámítva évről évre egyre kevesebb babér terem. Láthatóan hiába foltozgatják, ebből már nem lesz énekes halott. Őszintén remélem, hogy a Navival alapjaiból gondolják újra a GPU mikroarchitektúrát, máskülönben még sok évig nem lesz normális verseny a piacon, az NV pedig azt csinál majd amit akar.

-

HSM

félisten

válasz

#85552128

#29657

üzenetére

#85552128

#29657

üzenetére

" Minimal architectural improvement over Fiji"

Az igen. Csak úgy süt ebből a szakértelem....(#29660) Moby: Ha megnézed a Vega újításait, a legtöbb pont ilyen jellegű problémákat próbál orvosolni, hogy ne több erőt próbáljunk belepakolni, mert már így is brutális erő van benne, és ez egy nagyon nem gazdaságos irány, hanem próbáljunk magán az architektúrán fejleszteni, hogy esetleg okosabban megközelítve a kérdést, hátha kevesebb erőforrással is elérhető ugyanaz, vagy akár jobb képminőség.

Gondolok itt, primitve shader, hbcc, fp16 packed math. Ezek mind olyan funkciók, amik olyan problémákat oldanak meg, amik mellett a mai vasak letérdelnének. -

Egon

nagyúr

válasz

#85552128

#29633

üzenetére

#85552128

#29633

üzenetére

Ennyi.

Tegyük hozzá, hogy Abu szerint a GloFo fillérekért gyárt az AMD-nek (sőt: hovatovább a GloFo fog fizetni, hogy az AMD ott gyártasson...), mindeközben a buta nV meg a TMSC-nél gyártat, ahol embert még nem húztak le olyan csúnyán, mint szegény zöldeket - nekem ebből az jön le, hogy az AMD adhatná (akár jóval) olcsóbban az azonos teljesítménykategóriát mint az nV, közben meg mégsenem...

-

válasz

#85552128

#29633

üzenetére

#85552128

#29633

üzenetére

Az AMD is csak egy kapitalista cég, nekik is a haszon a lényeg, ők sem fogják olcsóbban adni, ha nem muszáj. Ők sem jobbak, mint a többi. Ráadásul valszeg drágább is az előállítása ezeknek a Vega kártyáknak, így nem is tudnák sokkal olcsóbban adni. Ugyanakkor meg ha többet is kifizetnek a vevők a Vegáért, hülye lenne olcsóbban adni. Majd a piac megmondja, mennyire árazza be a Vegát. Ha a nyakukon marad, leviszik az árát. Erről szól a kapitalizmus.

(#29634) Puma K: A Vega 56 jó lehet, ha az ember időt szán rá, hogy találjon egy jó perf/watt arányt, na meg persze max 1070 áron, ami nem biztos, hogy mostanában lesz. De megint ott tartunk, hogy ha AMD kártya, akkor bizony legyél expert user, hogy tudd, mit állítasz a Wattmanban. Ha majd működni fog.

(#29637) HSM: Ennyi, kereslet-kínálat viszonya az ár.

-

->Raizen<-

veterán

válasz

#85552128

#29470

üzenetére

#85552128

#29470

üzenetére

Hát ez nagyon nem ham ham, még a ref 1080 fe szintjét sem üti meg a vega jó pár tesztelt játékban. Tegyük fel a léges verzióban kb semennyi oc tartalék nincs akkor mégis mit tudna felhozni egy 2100 mhz-re húzott gtx 1080 ellen? Na rendelek 1080-at 2-3 év használatra.

-

cyberkind

félisten

-

#45185024

törölt tag

-

#45185024

törölt tag

válasz

#85552128

#28845

üzenetére

#85552128

#28845

üzenetére

Igy vigad a Magyar. Epic pillanatok...

-

-

Laja333

őstag

válasz

#85552128

#28107

üzenetére

#85552128

#28107

üzenetére

Ebből úgy jön, hogy a 290=390. Ha nem így van, akkor most szépen mindenki arcon köpte magát, aki anno dobta a sarat az AMD-re a rebrand miatt. Megjelenéskor a 970 befogta az OC 290X-et, most meg az OC 290 után lohol. Ezek után vicces olvasni a "milyen jól tartja magát a 970" írásokat.

-

Laja333

őstag

válasz

#85552128

#28104

üzenetére

#85552128

#28104

üzenetére

Igen, a Hawaii-n nagyon sokat dobott a memórai tuning.

Az a +250 MHz azon a core clockon szintén volt legalább 1% teljesítmény növekedés, ha felfelé kerekítek. Ezeken az értékeken már tényleg elérte a ref 290X szintjét, viszont ha jobban megnézed az összesített eredményt, az OoB custom 970 ettől még lemarad, és csak OC-val éri utol.

Az a +250 MHz azon a core clockon szintén volt legalább 1% teljesítmény növekedés, ha felfelé kerekítek. Ezeken az értékeken már tényleg elérte a ref 290X szintjét, viszont ha jobban megnézed az összesített eredményt, az OoB custom 970 ettől még lemarad, és csak OC-val éri utol. -

#45185024

törölt tag

válasz

#85552128

#27900

üzenetére

#85552128

#27900

üzenetére

Ó ilyen időszakban mikor a fél világ csatolmányban megnyitott vírustól szenved elég nekünk ha így mutatod meg:

Az egy dolog hogy Gddr6 lesz idén de azt rá is kell tenni kártyákra

customosoknak is az meg jó ha március az meg tavasz, csak megjegyzem hogy most is tavasz van még csak egy másik év.

Viszont ha a Instinct és /vagy Radeon Pro akar 16 Gigát akkor 4 modulosra kell gyártaniuk ami most csak 2.

-

válasz

#85552128

#27869

üzenetére

#85552128

#27869

üzenetére

a 1080 Ti már olyan teljesítményt nyújt, hogy 1080p-n CPU limit van a legtöbb játékban

Erre dobsz nekem valami linket?

Mert PH! tesztben két ilyet találtam: GTV5 és Total War: Warhammer.

A többinél látszik, hogy az OC-zott 1080Ti-k FHD-ban is gyorsabbak, mint a Ref 1080Ti...

Köszi!

-

#45185024

törölt tag

válasz

#85552128

#27803

üzenetére

#85552128

#27803

üzenetére

Laza volt hogy zsebre vágta , ismerve az értékét ...én biztos páncélszekrényben viszem ki.

Érdekes hogy a Holoboxról egyikőtök sem beszélt pedig érdekes dolog volt

(Hol van a holofedélzet orvosunk ? )

)

A kocsi renderelése nagyon szép volt az elején csak azt nem értettem miért promózták azt deep learniggel ?

Valós időjárás jelentésekkel vagy valós google maps képekkel dolgozott vagy miért volt a környezet fontos ? -

-

füles_

őstag

válasz

#85552128

#27781

üzenetére

#85552128

#27781

üzenetére

Tényleg. Majd átfutom, hogy mit írnak.

De hogy hogyan fogyaszt ugyanannyit, mint a P100? Csak egyszer kell ránézni a P100 és a V100 specifikációira. 16nm-->12nm váltás nem hoz ennyit.

Mondjuk mintha talán Abu vagy valaki mondta volna hogy ilyen piacokon meg van adva egy fogyasztási határ, ami fölé nem mehet a hardver, és ezt mindenképp be kell tartani. -

füles_

őstag

válasz

#85552128

#27568

üzenetére

#85552128

#27568

üzenetére

Hogy az övé bírná-e azt nem tudom. Az enyém az bírja, GPU limittel 1-2 óra játék után full stabil FC Primal-ban. Már a megvétele óta így használom, alulfeszelve.

& (#27569) s.bala31

Ezt én sem tudom. Amit Szaby is említett, az AVFS-nek éppenhogy az lenne a dolga, hogy minél magasabb órajelhez minél alacsonyabb feszültség társuljon. -

cskamacska

addikt

válasz

#85552128

#27518

üzenetére

#85552128

#27518

üzenetére

De azt nem mondd nekem hogy az természetes, hogy egy office konfigban egy bele való GTX1050Ti lenyomja a továbbra is hájend Fury X-et.

Igazából ezért lenne jó, ha valósabb körülmények is bekerülnének a tesztekbe, az hogy még RX460 alá is csutkára húzott i7 kerül, nem hogy egy 570 alá az elég abszurd.

más

Abu-t emiatt ekézik:

[Re:]Évek óta húzódó iparági problémára is megoldást kínál az AMD Vegaés ekézik szegényt már most is

[Re:] Friss Radeon Software jött a Prey futtatására tervezve -

Petykemano

veterán

válasz

#85552128

#27473

üzenetére

#85552128

#27473

üzenetére

Egyet kell értsek. Se a bónapokkal előre tízelés nem jó, sem az overpromising, underdelivering. Utóbbi a sok konkrátum nélküli szivárgásra alapuló okoskodás miatt létezhet. Az nvidia nem jelenti be a fejlesztéseket, higy aztán azon 1 évig agyalhasson a közönség, milyen jó lesz. És egyébként a szivárgás pillanatában tényleg jó is lenne. De a megjelenésig eltelő év alatt már nem nagy szám.

Abu meg olyan, mint egy politikai tudósító, akik beszélgetnek a tévében. Narratívákat beszél el. Az biztos, hogy nem pusztán okoskodik, mint más youtuberek. De azt nem tudom, hogy vajon kajakra bekajálja a marketing dumákat, amik részben marketing dumák, másrészről meg a cégek tervei, elképzelései, víziói. Ezeket tolja le abu a cikkeiben és kommentjeiben. Vagy még az lehet, hogy az amd direkt szivárogtat ki fals információkat, és figyeli, hogy hol jelenik meg. És abu ezeket is bekajálja.

Azt értem, hogy ha volt bf1 indulás terven, akkor az amd egy be nem jelentette termék esetén nem fogja bejelenteni a késést. De abu tényleg nyomon követhetné saját állításait és offban korrigálhatná saját korábbi állításait. Legalább annyival, hogy téves volt. Nem jött be.

-

#45997568

törölt tag

válasz

#85552128

#27467

üzenetére

#85552128

#27467

üzenetére

Szoval ezen a kepen az van odairva, hogy a Vega jon a Prey-el egyutt? En nem latom.

Abu megvedi magat, nem az en dolgom. Amugy meg kesobb Abu leirta, hogy megsem egyutt jelennek meg, ezaltal meg mindig ott tartunk hogy probalod kivakarni magad a rosszmajusagodbol

Szoval ha meg nem allt volna ossze a kep, nem fog holnap megjelenni a Vega, majd akkor jelenik meg amikor az AMD hivatalosan azt mondja: most.

(#27466) cyberkind: kerdesedre a valasz az elozo mondatban van.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#27431

üzenetére

#85552128

#27431

üzenetére

Nem, a NAVI az inkább 2019-es fejlesztés. Az már új memóriarendszert használ, leszivárog az SSD a sima Radeonokra, így nem csak a Pro és az Instinct sorozat része lesz, mint a Vega esetében.

A következő nagy probléma a GPU-piacon az adatmennyiség kezelése. Egyszerűen a rendszermemória kapacitása kevés ahhoz, hogy fél terabájtnyi kódolatlan textúrát belezsúfoljanak a fejlesztők, a háttértár pedig túl messze van, és az összeköttetésre használt buszok lassúak. Ezek ellensúlyozására a megfelelő optimalizálást PC-n nem lehet elvégezni, mert túl sok mindent kezel az OS vagy a driver. Tehát még ha a VRAM menedzselése szempontjából a hardveres megoldás sok szemetelési problémát meg is old, akkor is kell a VRAM mellé egy gyors, legalább negyed terabájtos tároló, amibe bemásolható a kódolatlan textúra jelentős részlete. És ez még kódolt textúrával is eljátszható, mert vannak erre formátumok, így gyakorlatilag olyan játékterek építhetők, amelyek kódolatlan formában számolva terabájtos mértékű adatmennyiséggel dolgoznak. Tulajdonképpen megvalósul Carmack nagy álma a megatextúrázásról. A legtöbb mai motor ezt a formát amúgy is támogatja, sőt használja, csak az adatmennyiségnél nagyon finomra veszik a beállítást.

-

Asbee

veterán

válasz

#85552128

#27385

üzenetére

#85552128

#27385

üzenetére

Évek óta ezt hallgatjuk. Majd, lesz, azóta, így, úgy, gcn-re hú de szuper jó. Aztán nagy részben vagy teljesen, megy a süllyesztőbe és jön a következő hitegetés... Röhej az egész. Bár a nagy számok törvénye alapján egyszer csak bejön már valami. Amekkora a lista, lassan ideje lenne.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#27385

üzenetére

#85552128

#27385

üzenetére

Azóta a SPIR-V előállt a saját megoldásával, és ez sokkal jobb a PC-nek. A wave intrinsics igazából csak az AMD GPU-ra tudja elhozni az egyszerű portolást. A GCN-nek biztos jó, hogy több függvény is rámeppelhető egy kibaszott utasításra, de ez egyáltalán nem előny általánosan a PC-nek.

Itt alapvető félreértés van a lehetőség és az igény között. Tök jó, hogy egységesítve lesz ez az egész a PC és a konzol között, és nyilván a gyártók kötelezve lesznek az emulációra is, de a fenébe is nem az a szabvány célja, hogy egy konzolt és egy hasonlító alaparchitektúrát kiszolgáljon a szabványalkotó, míg a többin majd le lesz emulálva. Nem erre van szükség! -

Abu85

HÁZIGAZDA

válasz

#85552128

#27378

üzenetére

#85552128

#27378

üzenetére

Wave intrinsics kell nem shader modell 6.0. Remélhetőleg csak a Microsoft fogja használni, mert a SPIR-V sokkal általánosabb a hardverkezelés szempontjából. Ma viszont van AGS4.0, ami ugyan nem szabvány, de részben ugyanazokat kínálja, mint a szabványos wave intrinsics. Az AGS4.0 egyes függvényeit már kezeli a Battlefield 1, a Deus Ex: Mankind Divided, a Civilization 6, a Sniper Elite 4, a Resident Evil 7: Biohazard, a Doom, a Warhammer 40000: Dawn of War 3 és a Sniper Ghost Warrior 3. Remélem nem hagytam ki semmit.

(#27380) mcwolf79: A Microsoft wave intrinsics nem AMD-s csodák. Jelenlegi állapotát látva az Xbox One mono hozzáférésének intrinsics függvényéi PC-re másolva. Arra szolgálnak, hogy PC-re direkten átmásolhatók legyenek az Xbox optimalizálások. Az, hogy ez az AMD-nek addig jó, amig GCN-t használnak csak mázli. Viszont PC-re ilyen újításokat nem így kellene hozni, hanem úgy, ahogy a Khronos hozza. Semmi baja az AMD-nek például az 56 bites maszkkal visszatérő bollatt függvénnyel, de a Microsoft mégis 64 bites maszkkal dolgozót hoz, amivel az Intel és az NV hardverek sem igazán tudnak mit kezdeni, így hatásfokot veszítenek. Ez így hülyeség.

-

#45185024

törölt tag

válasz

#85552128

#27355

üzenetére

#85552128

#27355

üzenetére

Meg is érdemlik hogy zuhant a részvény, Fury X óta több mint másfél év eltelt, legalább kommunikálja le az emberekkel mi van, emlékszem a Fury is az egyik negyedéves jelentés előtt jött ki hogy megnyugtassa a részvényeseket ilyenkor szoktak előtte robbantani. Most meg semmi nem volt.. PR megint béka feneke alatt...

hátha észhez térnek tőle.

Nem tudjátok a FreeSync 2 monitorok mikor jelennek meg ? Mert elvileg Vega már tudja kezelni... -

Asbee

veterán

válasz

#85552128

#27298

üzenetére

#85552128

#27298

üzenetére

Szokásos és sokadik mosdatás.... nem kell folytatnom szerintem. Az még oké, hogy valakit nem érdekel, de hogy meg kell magyarázni ez miért is jó és extra... Nem egy nagyon nagy dolog, de elég pofátlan, teljesen jogos akit zavar és elítéli az ilyen titkolt reklámokat.

-

#45185024

törölt tag

válasz

#85552128

#27247

üzenetére

#85552128

#27247

üzenetére

Az egész REBELS kampány rossz.

Nem azért mert az arcukat odaadták hozzá. Hanem mert ez refress ezért nem üt.

Tehát rosszkor rossz helyen...

Ráadásul negatív kamány, az meg etikusan sosem jó! Kitűnni kell nem másról mondani hogy miben rossz...

Amúgy ha igazi VS-t akartok látni akkor most jön ki az AORUS 1060 9Gbps

Na ez egy remek hűtés és van az 580-ból is ugyanez a refress úgyhogy nekik kell le VSezni, árban és FPS-ben. -

válasz

#85552128

#27237

üzenetére

#85552128

#27237

üzenetére

Jó, akkor egy másikat, amiről több minden leolvasható:

p/w

980 < 390X

980Ti > Fury X

És hasonló az arány, mint 480 és 1060 közöttMásk érdekesség, hogy mi történt az ASUS Furyval két év alatt. A régi tesztben még bőven a 980 fölött volt a p/w. Ha pedig a Fury X is ugyanígy bukott, mint a sima Fury, akkor még rosszabb az arány.

-

-

huskydog17

addikt

válasz

#85552128

#27167

üzenetére

#85552128

#27167

üzenetére

De legalább a DXVA alatti eddigi irreálisan magas fogyasztást végre hosszú évek után kijavították.

Bár az érdekelne, hogy itt most miért működik a DXVA idle órajeleken, hogy pontosan mit módosítottak, ugyanis a memóriavezérlő elvileg pontosan ugyanaz, mint a 400-as szériánál, így logikusan nézve itt valami szoftveres mókolás lehetett. Ha így van,. akkor a 400-as szériánál is ugyanígy javítani lehetne a DXVA fogyasztást. Ez utóbbi esetben azonban az egyetlen előnye is tovaszállna az 500-as szériának.![;]](//cdn.rios.hu/dl/s/v1.gif)

-

Petykemano

veterán

válasz

#85552128

#27030

üzenetére

#85552128

#27030

üzenetére

Nem érzed úgy, hogy ez a még három megahertzel gyorsabb, és 11.4Gz RAM, letiltás nélkül.... hogy ez olyan preemtív izzadságszagú? Hogy megpróbálnak mindent kisajtolni a kártyából (Pont úgy, ahogy a Polarisból az AMD az 1266Mhz-cel, és akkor húhú, 20, meg 40Mhz-cel gyorsabb az AIB kártya)

-

Abu85

HÁZIGAZDA

válasz

#85552128

#26895

üzenetére

#85552128

#26895

üzenetére

Nem mindegy, hogy miképpen váltanak motort. Ők eleve a CryEngine-t is nagyon durván átírták, amit tettek az annyi, hogy az eddig megírt kódot átvitték a Lumberyard alá, amit nem volt nehéz megtenni, mert a használt és az új motor struktúrája megegyezett. Tehát nem sok munkájuk volt ezzel, lévén a saját kódjukkal dolgoznak így is, csak mostantól az Amazontól kapnak technikai támogatást, és használhatják az AWS-t, alapvetően csak ezért váltottak.

Ha mondjuk nem a saját kódjukkal dolgoznának, akkor más lenne a helyzet, de nekik alapvetően nem a Lumberyard képessége kellett, hanem az Amazon Web Services.Eddig nagyrészt a Mantle kódot fejlesztették pusztán amiatt, mert ebben volt a legnagyobb időmennyiségük, illetve ez elfogadta a HLSL-t (ugye rengeteg effektet a játékba az AMD ír, tehát olyan API-n kell lenni, ahol ez tesztelhető). Ugyanakkor már be volt építve a DX12 és a Vulkan támogatás is, csak nem volt leoptimalizálva. Ez nem akkora gond, mert a három említett API alapvetően nagyon hasonlít egymásra, tehát az egyik API-ra írt struktúra helyből alkalmazható a másik kettőre. Vagyis a low-level leképező optimalizálása nem vesz el többet két hétnél. Annyit kell eldönteni, hogy a Mantle-ről merre lépnek tovább. Eredetileg a DX12-re akartak lépni, de inkább a Vulkan API-t választották. Ez összességében a terveket nem vetette hátrább, mert ugyanannyi idő és erőforrás kell az aktuálisan használt kiindulópontból mindkét API-ra optimalizálni. Talán Vulkánra még egy picikét könnyebb is, de ez csak a saját fejlesztési modelljük specifikus hatása.

Persze a shader fordításnál lesz egy kis extra meló, mire a HLSL-ből SPIR-V-t kapnak, de a nyílt forrású infrastruktúrák miatt ez ma már kivitelezhetővé vált. -

Malibutomi

nagyúr

válasz

#85552128

#26893

üzenetére

#85552128

#26893

üzenetére

Pont ezért volt szétszedve két részre, és előbb jöt volna a single. Melyik is jelent meg ezek közül ? Semmi.

Elobb is jon a single, de mivel a ketto ugyanazt a technikat hasznalja, a motort meg kellett varni vele

Nem, de van más. A legnagyobb különbség, hogy az említett két játék elkészült, a másik meg ígérgetés szintjén létezik..

Lovacskazas meg szex? Ezek komoly fejlesztoi munkat igenyelnek.

Tudsz mondani esetleg konkretumot, aminek a technikai megvalositasa igenyel nehezebb fejlesztoi munkat, ami hasonlo nehezseg mint egy MMO felepitese, vagy amiket fentebb emlitettem? Nem hinnem.

Tudsz mondani esetleg konkretumot, aminek a technikai megvalositasa igenyel nehezebb fejlesztoi munkat, ami hasonlo nehezseg mint egy MMO felepitese, vagy amiket fentebb emlitettem? Nem hinnem.

Ja latom kozben szerkesztetted, jott az "elkeszult" utokartya. Gyakorlatilag elismerted hogy nincs bennuk semmi technikailag nehez. Szoval ja kesz studio el tudott kesziteni egy single player jatekot mindenfele technikai kulonlegessek nelkul hamarabb mint egy nullarol indulo studio ami sokkal komplexebb MMO-t keszit. Ez aztan sokkolo.Ez mivel is magyarázza azt, hogy folyamatosan olyan dátumokat adnak meg saját maguk amelyeket nem tudnak teljesíteni ? Ha azt akarod bizonyítani, hogy felelőtlenül ígérgetnek sikerült.

Hmm, csuszas fejlesztes kozben mikozben olyan dolgokat probalnak a jatekba pakolni, amik tulmutatnak az egyszeri gyorsan kiszort tucetjatekokon. Letaglozo.

ME:A miert csuszott egy evet? Ennyi kellett hogy rondabba tegyek az animaciokat?Egy játékon nem dolgozott három stúdió a pénzügyi háttérről semmit nem tudunk. A CDPR mögött pedig senki sem állt.

Nem irtam hogy egy jatekon dolgozott 3 studio, te irtad hogy tobb jatekon dolgoznak, en meg irtam hogy tobb studioval.

"Jövőbeli"

Ertem szoval felhozod hogy atirjak a motort az baj, ramutatok hogy nem irnak at semmit, ez kesobbre vonatkozo kijelentes, akkor meg tapsikolsz. Szimpla trollkodasnal azt hittem tobb eszed van.

A motorvaltasra irtam a kb nulla raforditast mivel Cryengine->Cryengine valtas volt gyakorlatilag

A DX12 Vulkant nem emlitettem egyaltalan hogy mennyi raforditas lenne a valtas de latom a motor es az API kulonvalasztasa nem sikerult.Reszemrol befejeztem, mert tul sok az off, es mar kezdesz elmenni a csusztatasos csavargatas iranyaba, ahhoz meg nincs kedvem.

-

Malibutomi

nagyúr

válasz

#85552128

#26889

üzenetére

#85552128

#26889

üzenetére

Nem akartam mar offolni itt, de fogalmatlansagbol 5-os.

A gond az, hogy 5 év alatt semmit sem fejeztek be. A Bioware 5 év alatt kiadott 2 játékot és dolgoznak egy harmadikon, miközben új motorra is átálltak. A CDPR 3.5 fél év alatt majdhogynem feleannyi pénzből egy Witcher 3-at csinált.

5 ev alatt semmit nem fejeztek be: 2013-ban 12-en voltak, fel kellett epiteni a csapatot es a studiot, infrastrukturat. Meg 2014-ben is csak 60-100 fo kozott volt a team.

Bioware 3 studioval dolgozott folyamatosan meglevo penzugyi hatterrel.

Mass Effect es a Witcher MMO-k? Van bennuk valami specko fizika? Lokalis fizikai grid? 64bit pontossag hogy tobbmillio km lehessen egy rendszer? Proceduralis komplett bolygok?

Egyik sem. Ha csak egy single playert csinaltak volna az meg lehetett volna 5 ev alatt itt is. Egy single+MMO+studio felepitesre 5 ev nem sok.Ezek 5 év alatt az általuk megadott határidőket csak tologatják, tavaly motort váltottak, most meg bejelentették, hogy megint átírják a motort mert a korábban hypeolt DX12 helyett most már a Vulkan tetszik...

Motorvaltas: Cryengine-> Lumberyard (ugyanaz a Cryengine csak Amazon AWS tamogatassal) Kb nulla raforditas, de partnerseg az Amazonnal ami kifizetodo.

DX12 helyett Vulkan: Semmit nem kell atirni, a jatek DX11-en van, annyi tortent hogy a jovobeli DX12 konverziop helyett jovobeli Vulkan port leszSzoval ja. Par cikkbol levont vegkovetkeztetes ismet, ahogy mar fentebb is emlitettem.

Azt kellene felfogni, hogy tul sok az info a projekttel kapcsolatban ahhoz hogy valaki par (idonkent clickbait) cikk alapjan velemenyt nyilvanitson.

Pont ezzzel kezdtem feljebb, jon valaki es benyog egy informalatlan kliset, leirtam hogy ez nem igy van, nem lehet 1-2 cikkbol levonni ilyenkovetkeztetest, es jon a kovetezo ember a kovetkezo alulinformalt klisevel.Akit erdekel a tema SC topicban vagy priviben meg lehet vitatni, szerintem tul sok itt az off mar.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#26849

üzenetére

#85552128

#26849

üzenetére

Nem is az új Frostbite-ra kellett volna lepni, hanem az egyel újabbra, amire elég könnyű lenne váltani, hiszen csak optimalizálást tartalmaz. A könnyűséget jelzi, hogy a Battlefront átváltott rá a legújabb DLC-vel.

A BF1-ben azért vannak átvezetők, hogy azok lejátszása alatt a pályabetöltés megkezdődjön. Akár real-time-ban is meg lehetne oldani, hiszen eleve egy Radeon Pro Duós gépen lettek rögzítve.

Mint írtam a legújabb motorverziót kivéve elég gyenge az animációs pipeline. Minden Frostbite játékot érint a probléma a BF1-en kívül. Ez van. Az új motorban már jobb rendszer van, tehát a jövő fényes.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#26842

üzenetére

#85552128

#26842

üzenetére

Ezt én másképp látom. A BF1-nél jobb a PBR. Különösen a fémes felületeké. Az égboltban egyetértek, de abban a Mass Effect megkapta a Frostbite kísérleti rendszerét. Ez a BF1-ből hiányzott. Ebben tényleg jobb a Mass Effect, de másban nem.

Az animáció és a mimika az egyes játékokban azért rossz, mert a régebbi Frostbite verzióknál nehéz volt bánni ezzel a modullal. A BF1-ben azért jó, mert kapott egy sokkal egyszerűbben kezelhető új pipeline-t, ami ráadásul sokkal jobb is. Sajnos ez nem igazán a munkamennyiség kérdése, illetve csak részben, sokkal inkább a felhasznált motorverzió animációs moduljának hiányossága.

Haj megjelenítése dettó ugyanilyen probléma. Öreg a motorverzió.

Ezeket sajnos nem nagyon tudják frissíteni, mert erre van meg a tartalom, így ezt a modult kell használni. Még a fejlesztés elején lehetett volna azt csinálni, hogy kooperációban dolgozik a Bioware a DICE-szal, és akkor esély lett volna a legújabb animációs modult használni. -

Abu85

HÁZIGAZDA

válasz

#85552128

#26825

üzenetére

#85552128

#26825

üzenetére

A verzió az mindegy. Eleve a DX12 is fejlődik, hiszen most kap shader modell 6.0-t, és ettől az API-t még DX12-nek hívják. A Vulkan is fejlődik, bár az 1.1-es verzió valószínűleg csak az év második felére jön.

De maga a Vulkan lesz a jobban elterjedt hosszabb távon. Mint írtam csak is azért, mert a licenelésre felkínált motorok azt választották. A top stúdiók jelentős része valószínűleg marad a DirectX-nél. Már csak azért is, mert ez gyorsabban fog fejlődni, mint a Vulkan. Eleve tervben van már a shader lépcsők egyszerűsítése, illetve a memóriamenedzsment újragondolása. Azt nem tudom, hogy amikor ezekre megjönnek a frissítések, akkor a DX12 DX12 marad, vagy már DX13, esetleg DX12.5. Őszintén szólva lényegtelen.

Azt is figyelembe kell venni, hogy a DX12 egyik legnagyobb hibája a top stúdiók által az volt, hogy csak nagyon nehezen tudják kiegészíteni a gyártók. Emiatt az AMD, az Intel és az NV is külön szervizkönyvtárat ír hozzá. A DXIL-lel ez sokkal egyszerűbb lesz, mert magát az IR-t úgy építették fel, hogy nagyon egyszerűen rakhassanak bele a cégek vagy a stúdiók gyártóspecifikus kiterjesztést. -

Abu85

HÁZIGAZDA

válasz

#85552128

#26819

üzenetére

#85552128

#26819

üzenetére

A játékok mennyisége pusztán a Unity és UE Vulkan melletti kiállása miatt fog a Vulkan irányába eltolódni. Mindkét motorban van ugyan DX12 támogatás, de a Vulkan lesz az elsődleges, így a fejlesztőknek sem lesz értelme a DX12-re menniük, ha Unity és UE motort használnak. Ráadásul a Vulkan annak ellenére jobban áll mindkét motorban, hogy a DX12-höz képest jóval később kezdték a beépítését. Ennyit tesz az, hogy a befektetéseknél látják az értelmét az egyik API-ra költeni, míg a másikra nem. A CryEngine is inkább a Vulkan felé fog menni, ahogy a Lumberyard is, illetve az Open Source motorok is mind Vulkan API-ra mennek a DX11-ről. Aki licencelésből él, annak nincs értelme a DX12-t választania. Be fognak építeni egy alapvető DX12 támogatást, mert az pusztán a hibakeresés miatt megéri, de a megrendelők úgyis a Vulkan módot fogják engedélyezni, mert a jóval több befektetett munkaóra miatt az lesz a jobb.

Úgy gondolom, hogy a top stúdióknak megéri a DX12 mellett maradni, mert a Microsoft gyorsabban fogja fejleszteni, illetve a top stúdiók eleve arra álltak/állnak be, hogy GCN optimalizálásokat hozzanak át a konzolról PC-re, amihez valóban egy GCN-hez igazított API a legjobb alap. Májustól ezeknél az optimalizálásoknál nem is kell az AGS4-re építeni, hanem jön a szabványos shader modell 6.0. A nem csőlátásban konzolra fejlesztő rétegnek a Vulkan mindenképpen jobb API. Sokkal általánosabban kezeli a PC-s hardvereket, ezért a tradicionálisan PC-s fejlesztésekhez mindenképpen ez az ideális.

A PC-s felhasználó is jobban jár a Vulkan API-val, mert ha az általános felépítést nézzük, akkor sokkal függetlenebbül kezeli a hardvereket, mint a DX12. Persze nincs bindless, de nem muszáj ilyen kódot írni, bindless módban a DX12 is rendkívül részrehajló, sokkal jobban kezeli a GCN-t és a Gen9-et, mint bármi mást. A Vulkan inkább trükközve oldja meg ezt a problémát. Igazság szerint elég jól, nem mellesleg a jelenlegi modellje kiegészíthető bindlessé, ha szükség lesz rá.

-

Raggie

őstag

válasz

#85552128

#26763

üzenetére

#85552128

#26763

üzenetére

Az előtted szóló ezt nem ilyen formán reagálta. HA így tette volna igaza lett volna.

Ha már ennyire figyelünk a minőségre, akkor arra is figyeljünk, hogy mit milyen minőségben írunk le és fogalmazunk meg.

Egyébként nem néztem most utána, de attól mert sok az olcsóbb és rosszabb minőségi FreeSínc-es monitor attól még szerintem van legalább annyi(ha nem több) jó és minőségi belőle mint G-Sync-esből. Ilyen szempontból vehetjük úgy, hogy a minőségi szegmensben egálban vannak. De a választék fogalma pont arról szól, hogy választhatok az egy adott kategóriától eltérőt. Magyarán pont akkor van választék van szar is meg jó is. Ha csak jó van, akkor nincs választék, mert akinek nincs pénze vagy csak kevesebb van, nem tud venni.

-

gyiku

nagyúr

válasz

#85552128

#26752

üzenetére

#85552128

#26752

üzenetére

a gyartok gondolom extrakent reklamozni a termekeket, amolyan buzz word. akkor is olcsobb, mint a gsync, a szeretett nv meg egyszer nezhetne a userek erdekeit es beallhatna a szabvany moge. monitort azert ritkabban cserelget az ember, mint vgat, ne legyek mar roghoz kotve azert mert freesync/gsynces monitort vettem anno

90/144: direkt megneztem a vasarlas elott. de valoban johetne out of the box igy, nem mindenki tud/mer trukkozni.

viszont hol vannak a 100hz-es 3440x1440 freesynces panelok? csak gsync van 1-2 eve, pedig ugyan az a panel. ha zold kartyaval tudja a 100hz-t, akkor tudnia kell pirossal is

->Raizen<-: párszor még kiszürkülsz, megtudod

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

gyiku

nagyúr

válasz

#85552128

#26750

üzenetére

#85552128

#26750

üzenetére

Ezzel szemben a VESA megoldása egy már (a VESA által) korábban elfogadott variálható VBLANK szabványra épül, ...

Az Adaptive-Sync kihasználásához támogatás szükséges a kijelzők firmware-jének és a grafikus vezérlők részéről, valamint a grafikus eszközillesztőn belül. Jelentős különbség tehát az NVIDIA megoldásához képest, hogy ez esetben nincs szükség egy külön beépítendő, dedikált elektronikai modulra, mint a G-Sync esetében (ami nem mellesleg plusz pénzbe kerül, és a gyártási költségen felül még licencdíjat is kell fizetni), hiszen az Adaptive-Sync-nél csupán a szabvánnyal eleve kompatibilis kijelző firmware-jének (ami esetleg egy frissítést jelent csak, tehát nem feltétlenül kell új kijelző), valamint a grafikus vezérlőknek és a meghajtóknak kell ismerniük a kiterjesztést.

G-Sync és Adaptive-Sync (FreeSync) [link]

a 144hz panel 30-90hz freesync ranggel jogos, en sem ertem. ilyenem van, de 1 perc alatt at lehet allitani CRU-val 58-144-re es megy.

-

do3om

addikt

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Motorolaj, hajtóműolaj, hűtőfolyadék, adalékok és szűrők topikja

- PlayStation 5

- Xiaomi 14T Pro - teljes a család?

- Xbox tulajok OFF topicja

- Honor Magic6 Pro - kör közepén számok

- Milyen program, ami...?

- Trollok komolyan

- One otthoni szolgáltatások (TV, internet, telefon)

- Melyik tápegységet vegyem?

- Battlefield 4

- További aktív témák...

- Asus Rog Strix RX 6800 XT LC 16 GB - GARIS (ritkaság)

- PowerColor RX 6700 XT 12GB GDDR6 Hellhound Eladó!

- Csere-Beszámítás! Sapphire Pure RX 7700XT 12GB GDDR6 Videokártya! Bemutató Darab!

- Eladó használt Gigabyte AMD Radeon HD 6750 videókártya

- Csere-Beszámítás! Asus Tuf RTX 5070Ti 16GB GDDR7 Videokártya! Bemutató darab!

- BESZÁMÍTÁS! Gigabyte Z370M i5 9400F 16GB DDR4 512GB SSD RX 5700XT 8GB ZALMAN S2 TG Corsair S650W

- 2db Dell PowerEdge R740 2U Rack Szerver és 3db Netapp FAS2040 NAS

- TELJES KÖRŰ IT BESZERZÉS

- BESZÁMÍTÁS! Intel Core i9 14900KF 24 mag 32 szál processzor garanciával hibátlan működéssel

- Bomba ár! MacBook AIR 13" 2018 - i5-8210Y I 16GB I 512SSD I OS X Sonoma I Cam I Gari!

Állásajánlatok

Cég: PCMENTOR SZERVIZ KFT.

Város: Budapest

Cég: CAMERA-PRO Hungary Kft

Város: Budapest

(Mindezt úgy, hogy a memória sávszélesség még csökkent is a Fiji óta!) Egyébként más területeken ennél több is viszsajöhet még ebből.

(Mindezt úgy, hogy a memória sávszélesség még csökkent is a Fiji óta!) Egyébként más területeken ennél több is viszsajöhet még ebből.

![;]](http://cdn.rios.hu/dl/s/v1.gif)

)))

)))

Szoval van meg mit gyakorolni

Szoval van meg mit gyakorolni