-

Mobilarena

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Alogonomus

őstag

válasz

Petykemano

#59354

üzenetére

Petykemano

#59354

üzenetére

Az RDNA3 legkomolyabb hibája, hogy a valós helyzetben jelentkező teljesítménye valószínűleg túlságosan függ a környező hardverek képességeitől. Erre tökéletes példa ez a tweet is. 36% és 57% között hatalmas a különbség, és ezért volt az 52%-os tesztelőnél olyan cím, hogy "These cards make the Nvidia GeForce RTX 4080 look silly.", a 36%-os tesztelőnél pedig olyan cím, hogy

. Eléggé más a kettő üzenete.

. Eléggé más a kettő üzenete.Ma jött ki az első "nem béta" driver célzottan a 7900-as kártyákhoz. Remélem több tesztoldal legalább futólag kipróbálja az új driver hatását, hogy a >40%-os tesztrendszereken is meglett-e az 50% javulás például a tweet alapját jelentő Watch Dogs: Legion esetén.

-

válasz

Petykemano

#59361

üzenetére

Petykemano

#59361

üzenetére

-

Pakmara

őstag

válasz

Petykemano

#59361

üzenetére

Petykemano

#59361

üzenetére

Egy ilyen azért nagyon durva lenne....

-

válasz

Petykemano

#59354

üzenetére

Petykemano

#59354

üzenetére

Más jellegű,de redditen született egy ilyen frankó bejegyzés.[link] Ez alapján ( igazából HWU megkérdőjelezve az eredeti bejelentést[link] és idevetve az Abu által említett 34 játékot ami ugye titkos) lehetetlennek tartom, hogy legyen bármilyen csupán 10 db játék, ami a 6950 XT hez nézve abszolválja az 50 % sőt a 70 % előrelépést.( RT vel van 2 darab játék ami ezt megközelíti egy darab oldalnál)

Még a mérnöki példányokkal húzva se tudnák hozni ezt, a kommetek között megtalálható.Ez alapján kérdéses mi alapján hozta be AMD a magasra ígért perf számokat ?még hetekkel a megjelenés elött is ugye bedobta valamelyik AMD mufti hogy mennyire hatékony lesz az 7900XTX és poénkodott a tápcsatlakozókkal...valóban ennyire nem voltak tudatában a dologgal, hogy nem igaz ami a bejentésen elhangzott és hogy problémás a hardver? Ezt nehezen hiszem el.

Közben redditen megjelentek érdekes hírek is, hogy hirtelen az RDNA3 megjelenése óta megszűntek a kigyulladó tápcsatlakozó hírek és bejelentések, minden " jó" lett. Na persze nem jók az összeesküvés elméletek, csak érdekes adalék a sztorihoz hogy az Ada megjelenése és az RDNA3 megjelenése között azzal volt tele a sajtó hogy egyes embereknek kigyullad a kártyája és hogy mennyire tré lett az Ada és ezzel kötötték össze az emberek az új szabványt... Ennek a megjelenés óta vége szakadt... -

hokuszpk

nagyúr

válasz

Petykemano

#59339

üzenetére

Petykemano

#59339

üzenetére

a terhet azt ugy kell levenni, hogy rajta is maradjon

![;]](//cdn.rios.hu/dl/s/v1.gif)

ez ilyen Mátyás királyos hoztam is meg nem is, hardveres is meg nem is. -

S_x96x_S

addikt

válasz

Petykemano

#59336

üzenetére

Petykemano

#59336

üzenetére

> megérkezhet az N33 és az N32 is a jövő év első felében?

akár ..

...

"N33 desktop before N32. Will refresh late hardware fix."

...

"Should Q1 mobile & Q2 desktop."

https://twitter.com/All_The_Watts/status/1602699424739872768 -

szmörlock007

aktív tag

válasz

Petykemano

#59336

üzenetére

Petykemano

#59336

üzenetére

Ha az AMD nem adja ki az N33-at 2023 év eleje körül ezzel megszívatva kicsit az Nvidiát, meg mellette kicsit piacot szerezve, akkor tényleg balfékek

Mondjuk látva a navi 31-es lapkát, lehet a navi 33 sem lesz nagy eresztés, akkor meg mindegy is. -

Petykemano

veterán

válasz

Petykemano

#59321

üzenetére

Petykemano

#59321

üzenetére

És akkor mit gondoltok...

Az AMD most kiadta az N31-et. Létezhet, hogy az N33 majd tavasszal (tavasz végén) kerül kiadásra, az N32-re pedig közel 1 évet kell várni?

A túloldalt az NV hezitálását arra alapozva meg lehet érteni, hogy sok a beragadt Ampere. Már a talán $900-os 4070Ti is elég necces, hogy gyorsabb lesz-e, mint egy 3090Ti, de legalább jó eséllyel kevesebbet fogyaszt.

Tehát ha tényleg olyan sok még az Ampere készlet ott, akkor érthető, ha van egy kis hezitálás, hogy kiadják-e a kisebb kártyákat. Ezzel együtt azért 4060Ti-ről meg 4070-ről is vannak már pletykák, ami alapján látnám esélyét, hogy fél éven belől megjelenjenek.De arról volt szó, hogy az AMD-nek sikerült hamar kipörgetni a készleteit.

És akkor midrange (már nem merem leírni, hogy olcsóbb) termékek nélkül vág neki a 2023-nak?

Vagy gyártja tovább a Navi2-t on demand?Vagy inkább arról lehet szó, hogy a kései megjelenésről szóló pletykák tévednek és megérkezhet az N33 és az N32 is a jövő év első felében?

-

Callisto

őstag

válasz

Petykemano

#59334

üzenetére

Petykemano

#59334

üzenetére

Gyári volt nem babrált. Fórumokon is utánanéztem és ennél a típusnál eléggé ismert probléma a rossz gyári pasztázás. Valószínű volt egy rosszul MEO-zott hibás széria.

Azért a fejlesztők nem hülyék, mint én voltam (annak ellenére, hogy magam is az vagyok ). Ők monitorozva igyekeznek reprodukálni a hibákat.

). Ők monitorozva igyekeznek reprodukálni a hibákat. -

válasz

Petykemano

#59323

üzenetére

Petykemano

#59323

üzenetére

hát jött helyette új nyomozni való és vád

:

:

[link]There seems to be quite the variance with GPU junction temperatures for these reference 7900 XTX cards.

TechPowerUP got 73c on the GPU hotspot, whereas CapFrameX and many others I've seen online are getting 105-110c; that's too big a gap for margin of error.

110 foknál beszabályoz a kártya erősen el kezd throttlingolni.

Charlie amire hivatkozott egy példa:[link]

A vád :[link]

"Either quality control for these reference cards is really poor, or AMD sent out review units with thermal paste on the GPU package to get better temps in reviews and is using those carbon pads for retail units."

Jött pár példa már, hogy kiskerből vették és nem ennyire magasa hőmérséklete, hanem normál 70-80 fok

-

Raymond

titán

válasz

Petykemano

#59321

üzenetére

Petykemano

#59321

üzenetére

For reference [link]

-

válasz

Petykemano

#59308

üzenetére

Petykemano

#59308

üzenetére

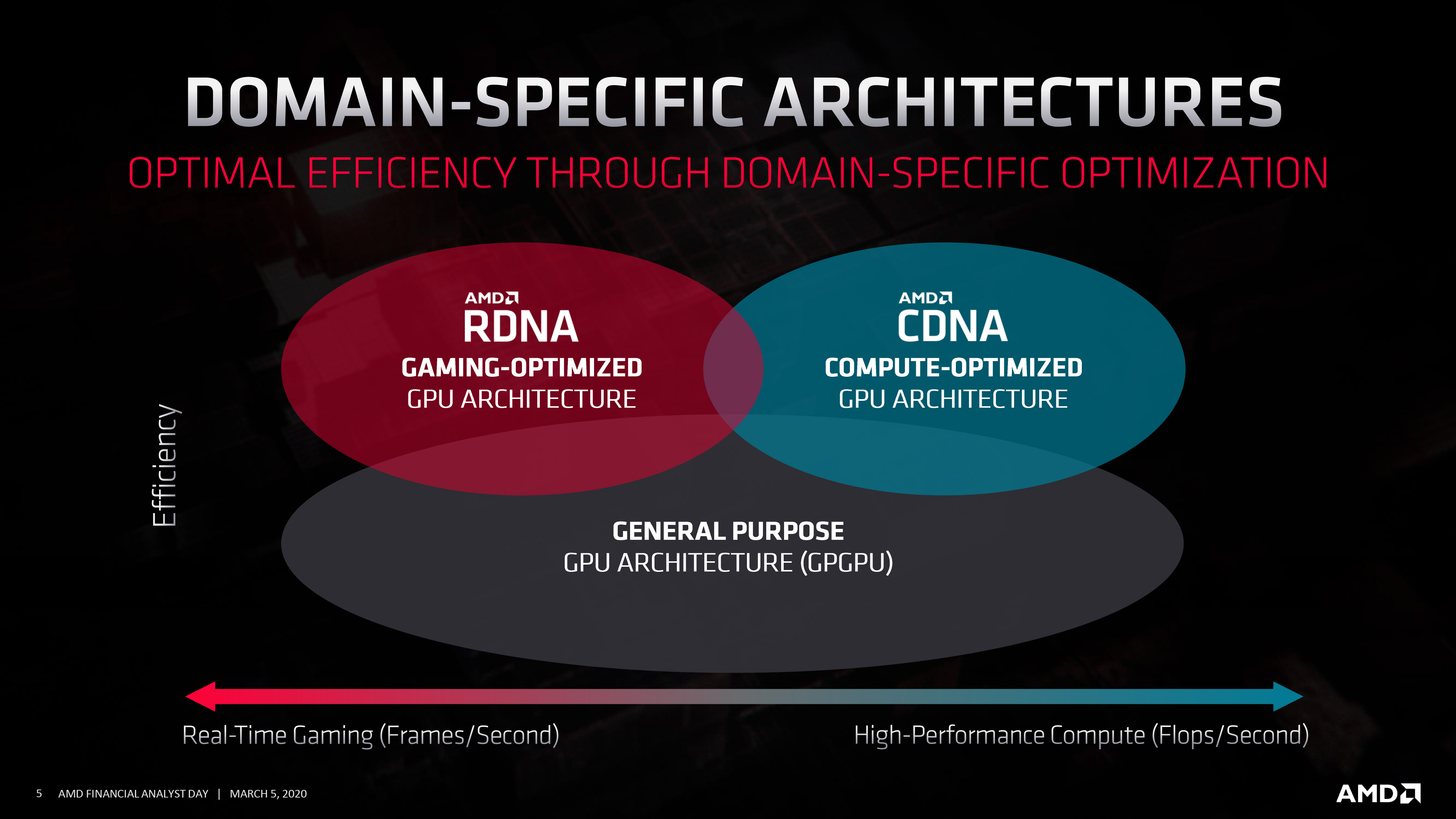

A fenti képen halmazokat látunk, amelyeknek van közös metszetük. Ha ez most tényleg jelent valamit, akkor a különböző célú GPU-knak vannak közös fejlesztési pontjai.

-

Busterftw

nagyúr

válasz

Petykemano

#59308

üzenetére

Petykemano

#59308

üzenetére

"While traditional GPUs have been built to be general purpose in nature, designed to drive both graphics-oriented as well as compute-oriented workloads, AMD recently introduced a different approach to fuel even higher efficiencies. There are now two architectures: AMD RDNA™ is optimized for gaming to maximize frames per second and AMD CDNA is optimized for computing to push the limits of flops per second. "

A CDNA whitepaperben pedig elég nyilvánvalóan írják, hogy két külön arch van. Aztán lehet igazad van, hogy a valóságban az R&D teljesen máshogy zajlik. Csak akkor meg kinek adjunk igazad, erről több cikk is született, pontosan ugyanígy előadva, miszerint kettévált a kettő.

-

Busterftw

nagyúr

válasz

Petykemano

#59298

üzenetére

Petykemano

#59298

üzenetére

Hát azt elég nehéz lenne, mert ezt az AMD kommunikálta, illetve ott van a whitepaper a mai napig az oldalukon.

-

Busterftw

nagyúr

válasz

Petykemano

#59292

üzenetére

Petykemano

#59292

üzenetére

De akkor mi ertelme volt nagy dobra verni anno, hogy fejlesztes kette valik, CDNA/RDNA, ha ugyanugy pro spinoff a gamer cucc?

Most megint (Vega/RadeonVI) azt latni, hogy van egy raklap tranzisztor ami pro cuccokban remekel, jatekokban nem annyira. -

válasz

Petykemano

#59289

üzenetére

Petykemano

#59289

üzenetére

Ez tényleg érdekes! Most akkor mi van ezzel a uarch-val? Milyen terhelést helyez rá a játék, ami a pro alkalmazásoknál nem lép fel és felmegy ilyen órajelre?

-

válasz

Petykemano

#59287

üzenetére

Petykemano

#59287

üzenetére

Ezzel teljesen egyetertek.

Gyari UV meg ugye nem jatszik, nem veletlen ezekkel a VCORE ertekekkel lettek a chip-ek bin-elve (vagyis ez az az "UV" (teljes voltage curve-re ertve) ertek amit a legrosszabb kiszort chip is biztosan visz).

-

válasz

Petykemano

#59285

üzenetére

Petykemano

#59285

üzenetére

A lényeg, hogy itt az eredmény inkább az UV-től, semmint a TDP emeléstől érkezik.

Szerintem kettonek a kombinaciojabol, persze egyszeru kitesztelni, hogy TDP emeles nelkul, csak UV mellett is hozza e ezt a novekmenyt.

-

TESCO-Zsömle

titán

válasz

Petykemano

#59271

üzenetére

Petykemano

#59271

üzenetére

Tudom vicc, de mivel nálam 24/7 megy a gép, az üresjárati fogyasztás sokat nyom a latba és ez a mostani széria siralmas. A jelenlegi 6900 Formula a gépben 11W-ot eszik idle multimonitorral. Ezek a szörnyek meg 100W felett.

-

Raggie

őstag

válasz

Petykemano

#59271

üzenetére

Petykemano

#59271

üzenetére

Leírják, hogy hogyan OC-znak és teljesen power limites a kártya.

Tehát a TDP-re adnak +15%-ot és annyi. (az UV és OC csak ezen a kereten belül játszik)

Tudom, hogy ez nem mérés, de ez alapján szerintem jó közelítéssel a Nitro kártya alap fogyasztására ha rászámolunk 15-20%-ot akkor megjaphatjuk az OC fogyasztást is.

Ez alapján kb 505-525 W lehet szerintem a "gaming" fogyasztása OC alatt. -

válasz

Petykemano

#59260

üzenetére

Petykemano

#59260

üzenetére

Fentebb b linkelte a Sapphire 7900 XTX tesztet. Fogyaszt, mint az állat, de közben 2%-ot tudott javítani a default kártyához képest. Tehát jelentősen nő a fogyasztás és éppen csak látszik valami teljesítmény javulás.

-

hokuszpk

nagyúr

válasz

Petykemano

#59252

üzenetére

Petykemano

#59252

üzenetére

az hagyjan, de a Sapphire Rapids még meg sem jelent...

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

hokuszpk

nagyúr

válasz

Petykemano

#59245

üzenetére

Petykemano

#59245

üzenetére

azon filozom, hogy lehet tudna a chip a 3+ Ghz -t, viszont a prefetch nelkul ertelmetlen, mert nemlesz mivel etetni a feldolgozokat.

DE. az is lehet, hogy a 3D cache modellre az AMD elengedte a bug javitasat, mert a bazinagy pluszcache mar eleve feleslegesse teheti a prefetchert... -

#36531588

törölt tag

válasz

Petykemano

#59252

üzenetére

Petykemano

#59252

üzenetére

-

hokuszpk

nagyúr

válasz

Petykemano

#59238

üzenetére

Petykemano

#59238

üzenetére

valoszinuleg megtorternt a javitas, de egy ilyen chip legyartasa -- majd ABU pontosit -- sacc 2 honap, utana validacio, amiről valamelyik AMD mernok -- talan a Phenom procik TLB bug javitasa magassagaban -- aszondta anno, hogy 90 nap. lehet ez utobbi azóta lerövidült.

-

szmörlock007

aktív tag

válasz

Petykemano

#59239

üzenetére

Petykemano

#59239

üzenetére

Simán lehet, hogy közben az 5nm-es techet is optimalizálják a jobb teljesítmény/fogyasztás végett (rdna1 és rdna2 között is sokat nyertek ilyen optimalizásással), aztán ez idő.

-

Raymond

titán

válasz

Petykemano

#59234

üzenetére

Petykemano

#59234

üzenetére

"mert egy 1-2 hónapos csúszással érkező A1 steppinggel nem javítható."

LOL, 6+ inkabb

-

awexco

őstag

válasz

Petykemano

#59200

üzenetére

Petykemano

#59200

üzenetére

Ez legalább olyan elbaszott lett mint a vega .... de miért ? van munkaerő és pénz is ...

-

Busterftw

nagyúr

válasz

Petykemano

#59169

üzenetére

Petykemano

#59169

üzenetére

Én is ettől félek, ugye nem ez lenne az első eset, hogy az év végi csoda driver volt várva, aztán ehelyett hónapokig +15 átlag known issue volt görgetve.

-

Alogonomus

őstag

válasz

Petykemano

#59169

üzenetére

Petykemano

#59169

üzenetére

Az egyértelmű, hogy legkésőbb január végéig ki kell adniuk egy javított drivert, amivel a kártyák jelentőset (akár 20% is) erősödnek, mert a jelenlegi kb 30% perf/$ előny nagy része az árazásból származik, és az valószínűleg nem lesz elég kompenzálni az erősebb Nvidia mindshare és RT együttes hatását. A tavaszi éves nagy driverfrissítés előtt meg kell oldani ezt a gondot, ha a market share javítása érdekében erős eladásokat szeretne realizálni az AMD.

Na persze amennyiben általános lesz majd a custom kártyáknál az a 400 wattból 3,5/3,7 GHz, az is egy új helyzetet teremthet...

-

Alogonomus

őstag

válasz

Petykemano

#59158

üzenetére

Petykemano

#59158

üzenetére

Szerintem nagyon elkapkodod az N31-es kártyák temetését.

A tesztek alapján egyértelműen látszik, hogy a kártyák adott játékban vagy "rendben" működnek, vagy egyenesen szembemennek a logikával. Több esetben például a QHD felbontáshoz képest UHD felbontáson jobban teljesítenek a 4080/4090-hez képest. Ez szinte biztosan driver eredetű probléma, nem hardveres gond. Több esetben a tesztelők is kihangsúlyozták, hogy egyértelműen szoftveres hiba áll egy jelenség mögött, és nem szabad az eredményt komolyan venni.

Sok tesztelő panaszkodott például a kártyák hiányzó tuningtartalékáról, közben viszont érkezett hír 400 wattból elért 3,5/3,7 GHz-es levegős tuningról is, ami 40+% tuning.Az AMD fő hibája a teszthez biztosított béta-driverek optimalizálatlansága volt. Amelyik esetekben nem ütközött gondba a driver, azokra a PCWorld végkövetkeztetése volt igaz, a problémás esetekre pedig a belengetett 70% gyorsulást és 50% energiaspórolást hiányoló végkövetkeztetések.

Az AMD szoftvermérnökei előtt kemény év végi időszak áll, mert egyértelműen van mit csiszolni a driveren, hogy jövő év elején már kedvezőbb képet mutassanak a tesztek. -

Busterftw

nagyúr

válasz

Petykemano

#59162

üzenetére

Petykemano

#59162

üzenetére

Ami nagyon furcsa, mert ugye az RDNA/CDNA pontosan ezért lett szétválasztva.

-

válasz

Petykemano

#59146

üzenetére

Petykemano

#59146

üzenetére

Emlékezz vissza Májusban kopite első RDNA3-nal szemben eldobott negatív kommentjére, erre: [link]

Már akkor tisztában volt egy nvidia leaker azzal mit hoz az RDNA3, Jensen pedig februárban eltörölte a GH202 chipletre alapuló csúcs gamer GPU-t..

#59147

Az RDNA2 nél Nvidia is hibázott az mellett hogy az AMD is is jó lett.

A Samsung gyártás miatt lett elcseszve. 20 % kal gyorsabb lett volna a 3090 Ti és a 3090 is, mint ahogy kijött aztán. -

Petykemano

veterán

válasz

Petykemano

#59118

üzenetére

Petykemano

#59118

üzenetére

(+50% perf/W a túlhajtott 6950X-hez képest)

A CB +18% perf/W-ot mért ki a 6900XT-hez képest [link] -

Abu85

HÁZIGAZDA

válasz

Petykemano

#59121

üzenetére

Petykemano

#59121

üzenetére

Mondta az AMD, hogy külön órajelen fut a front-end és a shader. Ez nem újdonság. És ennek az oka az, hogy a mai hardverek nagyrészt front-end limitesek, így azt az AMD az RDNA 3-mal akkor is magas órajelen hajtja, ha a shadereket már nem tudja a fogyasztási keret szűkössége miatt. Ez egy logikus lépés azt látva, hogy mennyire kezdenek CPU-limitessé válni az új címek.

Mi éppen végeztünk az alap mérésekkel a példányunk kapcsán. Szóval nem tudtuk megnézni. De látható, hogy nem gond 3 GHz fölé menni, csak a fogyasztás megnő.

-

Petykemano

veterán

válasz

Petykemano

#59109

üzenetére

Petykemano

#59109

üzenetére

@Abu85

Erre a képre reflektálnál?

- egyrészt tényleg igaz ez, hogy külön clock domain van / shader engine?

- másrészt azt látjuk a képen, hogy a gPU tudja a 3.5Ghz-et, csak túl sokat fogyaszt közben?

- harmadrészt a Ti példányotok mit produkál? -

Abu85

HÁZIGAZDA

válasz

Petykemano

#59106

üzenetére

Petykemano

#59106

üzenetére

Azért az MDIA nekem kellene. Meg kb. mindenkinek must-have, aki nem a leggyorsabb processzort használja, mert pont segít a CPU-limiten. A mi tesztünkben már az 5800X-en is látszik, hogy korábban CPU-limitesnek tűnő beállításoknál jött az RDNA 3 és skálázódik.

Ez a funkció tökre fontos azoknak, akik 200-300 dollár között veszik a CPU-t.

-

Alogonomus

őstag

válasz

Petykemano

#59091

üzenetére

Petykemano

#59091

üzenetére

Átgondolt a gondolatmeneted.

Az Nvidia - és a piac is - egyértelműen egy minden szinten a csúcs Lovelace szintjén teljesítő kártyát vártak az AMD mérnökeitől, ezért is készült eredetileg a 600 wattos verzióval az Nvidia. Azért az információért valószínűleg sok iparági szakember sokat fizetne, hogy az AMD mikor engedte el a 4K-s és azon túli koronát.

A pletykák viszont jelentős RDNA3 előnyről szólnak az alacsonyabb felbontásokon, ami hihetőbbé is teszi, hogy ebben a generációban kezdetben valóban a piaci részesedés növelésére fókuszál majd az AMD, hiszen az eladott kártyák nagy részét egyébként sem a csúcskártyák teszik ki, hanem a takarékosan gyengébb kártyák. Bár 4K felbontáson a 30% fogyasztási előnyért - 7900 XTX alighanem ugyanúgy nem a 355 wattot eszi átlagosan, ahogy a 4090 sem a 450 wattot - cserébe talán már 15%+ lemaradása is lesz a csúcskártyának, de a 3 slotnál kisebb kártyával learatja az AMD azt a piacot is, amelyik erős kártyát igényel, de a 4090-es kártyák már méretileg nem opciók oda, hacsak nem folyadékhűtésesek.

Az alacsonyabb felbontásokon pedig esetleg bizonyos címekben már a "kis" N31 is előnyben lesz a 4090-hez képest, mert az Nvidia látszólag a Lovelace kapcsán is beleszaladt az alacsony felbontás melletti alacsony kihasználtság problémájába.Ráadásul készülnek 3x8 pines 525 wattig nyújtható custom 7900 XTX kártyák is, amik talán le is dolgozzák majd azt a 4K-ban jelentkező 15% lemaradást a 30% fogyasztási előnyből, csak persze azok a custom kártyák már 3+ slotosak lesznek, vagy folyadékhűtésesek.

Aztán hogy a refresh mit hoz az egyik és a másik oldalon, az egy új helyzet lesz, de drasztikus változást aligha hoz.

A "benne felejtett" hardware bug koncepcióját nem érzem hihető magyarázatnak az RDNA3 vártnál gyengébb teljesítményére, hiszen az RDNA2 állítólag stabilitási okokból beállított 2,8 GHz-es korlátja után valószínűleg ez a terület komoly figyelmet kapott az RDNA3 tervezésekor. -

Abu85

HÁZIGAZDA

válasz

Petykemano

#59091

üzenetére

Petykemano

#59091

üzenetére

Nincs még HDL 5 nm-re. HPL van csak. A HDL majd a Zen 4c chiplettel érkezik. Egyébként az AMD évek óta nem használt már HDL-t GPU-khoz. Ennek az oka, hogy a GPU-k áramköreinél már nincs nagy előnye. Tranzisztorsűrűségben igen jó a HPL is, és magasabb órajelet tudnak belőle kihozni. Ezért vannak már egy ideje 2 GHz fölött a GPU-k. És a Vega óta minden GPU dizájnt HPL-lel hozott az AMD. A Navi 31-et is.

Nincs olyan, hogy GFX11.5. GFX11.0.x van. Ezek a különböző iterációk.

-

válasz

Petykemano

#59091

üzenetére

Petykemano

#59091

üzenetére

Érdekes eszmefuttatás!

A Navi31 6nm-en HPL könyvtárral vajon kezelhetetlenül nagy lenne? Talán olcsóbb lenne gyártani a nagyobb kiterjedés ellenére is.

-

fatal`

titán

válasz

Petykemano

#59074

üzenetére

Petykemano

#59074

üzenetére

Jah értem. Igen, így jogos.

Illetve elnézve az amazonos árakat, még lehet, hogy amúgy is bejön az 5%.

-

válasz

Petykemano

#59074

üzenetére

Petykemano

#59074

üzenetére

Ezt írtam le régebben én is.

AMD most lépte meg az Nvidia "90" behozását ami addig a 80 és Ti volt.

AMD most lépte meg az Nvidia "90" behozását ami addig a 80 és Ti volt.

Mondjuk abban még lehet bízni, hogy lesz egy két AMD-gyártó aki igyekezni fog majd MSRP környékén maradni, mint az XFX . -

fatal`

titán

válasz

Petykemano

#59009

üzenetére

Petykemano

#59009

üzenetére

Nem csökkentett árat, csak az európai árat hozzáigazította az EUR-USD árfolyamhoz, az USD MSRP változatlan maradt. Ahhoz, hogy elgondolkodjak egy 4080-on, le kéne vinniük az árat legalább oda, ahova a 12GB-os 4080 (most 4070Ti) érkezik, $900-ra. Vagy $1200-ért kellene érkezzen egy Ti a 4080 és a 4090 közé félúton. És még persze ez is drága. De jelenleg az összes új nv kártyának az ár/érték aránya szar.

Az AMD-t ugye még nem tudni, mert ezek csak pletykák.

-

fatal`

titán

válasz

Petykemano

#59004

üzenetére

Petykemano

#59004

üzenetére

hanem sikerült megint az NVidia alá árazni 5%-kal.

Ez hogy jött ki? Csak mert a 4080 20%-kal drágább, mint az XTX.

-

Pakmara

őstag

válasz

Petykemano

#59004

üzenetére

Petykemano

#59004

üzenetére

Kösz az első rész, így világosabb. Ha nagyságrendileg valós eredmények akkor sem értem teljesen. (bár lehet rosszul hasonlítom az adatokat.) 6950 XT 335 W TDP; 7900 XTX 355 W. Ez cca +6%. Max bench ugrás cca 24%. Ez teljesítmény/ W-ban sem olyan eszméletlen ugrás sztem.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#58986

üzenetére

Petykemano

#58986

üzenetére

Majd az NDA lejártakor.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#58984

üzenetére

Petykemano

#58984

üzenetére

Ne élj Twitter foszlányokból, amelyet olyanok osztanak meg, akik nem is látták a kiadott pdf-eket.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#58981

üzenetére

Petykemano

#58981

üzenetére

Miért lenne gond a wave32 móddal? Írja az RGP is, ha VOPD-ben átmegy a kód. Ez nem egy hardveres képesség, hanem fordító fordítja be. A hardvernek semmi köze hozzá, mert a szoftver oldalán van ütemezve.

Ha már Locuza kirakta, akkor itt van a rá vonatkozó slide: [link]

Egyébként a VOPD-nek csak akkor van értelme, hogy ha a két wave-en másféle operációt akarsz végrehajtani. Az más kérdés, hogy lehet ugyanazt is, de akkor már hasznosabb a fordítónak wave64-et fordítani, mert értelmét veszti a két wave-re bontás és a dual-issue képesség. Tehát nem véletlenül nem látnak a fordítótól két FMA-s wave32-t. Egyszerűen semmi haszna az egy FMA-s wave64-gyel szemben. Ellenben az egy FMA-s és egy ADD-os wave32-nek marha nagy haszna van, mert azt nem lehet egy ciklus alatt wave64-gyel megcsinálni. Ettől függetlenül a fordító be tudna fordítani két FMA-s wave32-t, csak ugye minek?

-

válasz

Petykemano

#58981

üzenetére

Petykemano

#58981

üzenetére

Nem hangzik túl jól.

-

Petykemano

veterán

válasz

Petykemano

#58963

üzenetére

Petykemano

#58963

üzenetére

Ide - a 6144 stream processzorhoz - kapcsolódó beszélgetés:

"It seems that N31 has a serious efficiency problem in wave32 mode, and it has been improved in wave64 mode, but not completely." [link]

"Yeah, RDNA 3 can't dual issue FMAs in Wave32, so a lot of applications predictably won't see major increases vs RDNA 2 on a per WGP and per clock basis" [link] -

válasz

Petykemano

#58973

üzenetére

Petykemano

#58973

üzenetére

Két csúcs GPu-t nézve régebben betettem ide, Kepler tweetje szerint hogy a 4090 GPU $177, a 7900 teljes GPU $88.

Tehát van 90 dollár különbség / GPU, memóriában legyen plusz $100 a 4090 , a 4080 hoz sztem a + 8 GB elviszi a különbséget.

Innentől az AIB partnereknél mi a különbség a két gyártó között?

valószínűleg az AIB kártyák zöme 3x8 pin, 400W fölötti fogyasztás mindkét gyártónál. Tehát kell megfelelő VRM és PCB és hűtő. Nagyjából ugyan az ami a 4080/ 4090 alá kell.

Sok multi gyártó egyszerűen azt a hűtőt alkalmazza amit az Nvidiánál is használ, tehát nem olcsóbb, plusz némileg kisebb volumenre is készülnek megtérülés szempontjából.

Igazából az a kérdés akarnak e csökkenteni, mert valószínűleg a válasz hogy semelyik gyártó nem akar. Nvidia is csak normalizál némiképp. -

Abu85

HÁZIGAZDA

válasz

Petykemano

#58973

üzenetére

Petykemano

#58973

üzenetére

Nem számolnak azzal, hogy a 4080 lapkája elég nagy, illetve azzal sem, hogy a GDDR6X drága a GDDR6-hoz viszonyítva.

Igazából a Navi 31 és a kapcsolódó memória olcsóbb, mint az AD103 és a kapcsolódó memória. Eközben a két kártya fogyasztása is hasonló, tehát nincs az a fizika, ahol ugyanazon a gyártósorokon olcsóbb lesz az AD103.

-

Z_A_P

addikt

válasz

Petykemano

#58971

üzenetére

Petykemano

#58971

üzenetére

"van Twitter fiókod "

Csing-csong-jing néven. Átkozott kínaiak fecsegnek

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#58968

üzenetére

Petykemano

#58968

üzenetére

Ezúttal az is NDA alá tartozik, hogy ki mit tud és hol van kártya. Kérem kapcsójaki.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#58964

üzenetére

Petykemano

#58964

üzenetére

Úgy, hogy Chiphell és Bilibili. Szokás szerint nettó marhaság. Eleve nem gondolnak bele abba, hogy az AMD lapkája 305 mm2. Akkor az NV veszteséggel adja a sokkal nagyobb, és drágább node-on készülő AD103-at és AD104-et? Nyilván nem.

Az a bajuk a kínaiaknak, hogy az AMD letiltotta őket fullon a kártyákról. Egy deka cuccot nem kapnak a startig, mert korábban mindent kiszivárogtattak. És most néznek, hogy hogy lesz ebből VGA, amikor nekik még nincs. Hát persze, hogy nincs, nem kellett volna elpofázni az adatokat, és lenne a start előtt. Ezért sincs még egy valós teszteredmény sem az új Radeonokról. Nincs Kínában, ahonnan szivárogtatni lehetne. A tesztelést most nyugatabbra végzik, megbízható cégek, akik tényleg tartják a szájukat. -

Busterftw

nagyúr

válasz

Petykemano

#58964

üzenetére

Petykemano

#58964

üzenetére

Nem lehet inkább úgy veszteséges, hogy az AMD a "szokásos" volumennel számol?

Tehát nem megy el annyi, hogy az visszahozza az R&D-t?Yutani

4 magos AMD CPU?

Ők is úgy lesznek ekézve mint az Intel?![;]](//cdn.rios.hu/dl/s/v1.gif)

-

Cyberboy42

senior tag

válasz

Petykemano

#58944

üzenetére

Petykemano

#58944

üzenetére

Nem is lesz itt 3+Ghz 2 nyolc tűs tápcsatikkal. ahhoz több kakaó kéne.

-

awexco

őstag

válasz

Petykemano

#58941

üzenetére

Petykemano

#58941

üzenetére

A +60.7% az jó vagy sem ?

-

válasz

Petykemano

#58944

üzenetére

Petykemano

#58944

üzenetére

Annak már mi értelme lenne? Felesleges/ értelmetlen húzás is lenne már azt gondolom. valószínűleg a zöld oldalon egyelőre nincs több a tarsolyban max egy 4090Ti 2000-2500+ dollárért ami kit érdekel kategória sztem.

Árat csökkenteni meg tudnak így is úgy is ha akarnak. -

válasz

Petykemano

#58933

üzenetére

Petykemano

#58933

üzenetére

Jó meglátásaid vannak. Valóban, amennyire tudni lehet, azé az elsőbbség, aki az OEM piacot nagy mennyiségben ki tudja szolgálni, ha jó terméket tud letenni az asztalra. Ehhez az AMD-nek szükséges volt a Ryzenre. Valószínűleg az AMD CPU-k térnyerése sem a DYI piacon látható jó pozíció miatt annyi, amennyi, hanem mert az OEM-ek elkezdtek a Ryzennel gépet építeni. Így is elég lassan indult be a dolog.

VGA fronton is ez lehet. 2022Q3-ban azt láttuk, hogy brutálisan kevés GPU-t szállított le az AMD. Most kérdés az, hogy azért, mert kevés a gyártókapacitás, vagy mert alacsony volt a beérkező rendelés a termékekre? Vagy direkt lett visszafogva a termélés? Ki tudja...

-

awexco

őstag

válasz

Petykemano

#58933

üzenetére

Petykemano

#58933

üzenetére

Nemrég volt a hír hogy csökkentik a cégek a tsmc-hez leadott rendeléseiket . Pont most tudnának jó szerződéssel sokat gyártani/szállítani . Oem-eknél meg a managgerek 2 forintért csinálnának valamit az anyukájukkal . Mondjuk nem tudom mi a helyzet oem fronton(régi termékek raktárkészletével ) , de alig látni 6xxx szériás laptopot .

-

válasz

Petykemano

#58928

üzenetére

Petykemano

#58928

üzenetére

Teljes mértékben egyetértek.

Valahol talán Abu írta le, és igazolódni látszik, hogy az AMD nem akar az NV olcsó alternatívája lenni. Sosem térnek már vissza az R770-es idők, és nem is akarnak ők annyira nagyon market share-t növelni a DVGA piacon, legalábbis az látszik.

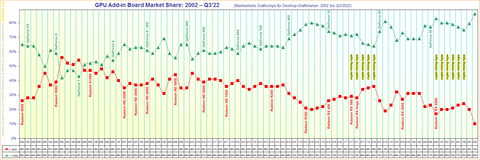

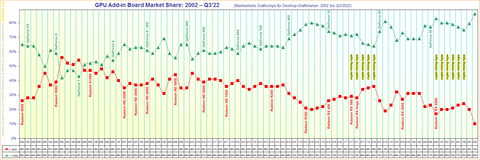

Chart 2002-2022:

Forrás -

Raggie

őstag

válasz

Petykemano

#58928

üzenetére

Petykemano

#58928

üzenetére

"Ilyenfajta elköteleződéstől természetesen az AMD rajongók sem mentesek. Szó sincs arról, hogy az AMD vásárlók / rajongók lennének a racionálisak és az Nvidia vásárlók / fanok pedig az elvakult őrültek. Én legalábbis nem így látom.

Ennek ellenére én annyira elvakult vagyok, hogy nem is szoktam Nvidia kártyákat nézegetni. Valahogy nem. Nem gondolom, hogy szar, csak azt feltételezem, hogy piacvezetőként biztosan sosem lesz olyan kedvező ajánlata, ami az én árérzékenységemnek megfelelne.

Ennek ellenére viszont sosem esett nehezemre nemet mondani AMD ajánlatra sem, amit nem tartok a magam számára kedvezőnek, nem okoz nehezemre felróni az AMD-nek ha az árazási gyakorlata fogyasztó-ellenes vagy hogy (ha) nem ők csinálják a legjobb terméket."

Hatalmas +1 a részemről, az egész fenti részre. -

awexco

őstag

válasz

Petykemano

#58923

üzenetére

Petykemano

#58923

üzenetére

Nagyon korrekt irás !

on : van már valami tip ai ra ? ( talán raytracingra is hadra fogható ? )

-

válasz

Petykemano

#58923

üzenetére

Petykemano

#58923

üzenetére

Ó igen. Az NV az NV fanokból él, akik sirdogálnaik, hogy milyen drágák az NV kártyák, majd megvonják a vállukat és nincs mit tenni, vesznek egyet. Egy NV-t. Nem AMD-t, amivel szavaznának az NV árképzése ellen, hanem pont amellé teszik le a voksukat. Ja persze, miért vennének AMD-t, amikor az sz@r RT-ben. Meg sz@r a driver. Meg minden is sz@r, ami AMD. De hát tudjuk ezt, évtizedek óta vesződünk vele elégedetten.

-

válasz

Petykemano

#58872

üzenetére

Petykemano

#58872

üzenetére

Mass prodra szinte 100%, hogy nem lesz ket fajta.

-

awexco

őstag

válasz

Petykemano

#58863

üzenetére

Petykemano

#58863

üzenetére

Ha jól rémlik xilinx elég sok videó coder cuccot is gyárt . Lehet hosszútávon egyszerűbb beletenni majd minden spéci feladatra és munkára fogni . Mert mostanság elég gyakran jönnek a video codec-ek . Lehet adat tömörítésre is hatékony lehet . Valami ok tuti van . Sokkalta izgalmasabb téma mint a dls vs fsr vagy a sugárkövetés .

-

válasz

Petykemano

#58863

üzenetére

Petykemano

#58863

üzenetére

Kiválthat-e encoding/decoding egységet vajon? Ha igen, akkor külön blokkot nem kellene tervezni a GPU-ba erre a feladatra.

-

awexco

őstag

válasz

Petykemano

#58861

üzenetére

Petykemano

#58861

üzenetére

Az fsr-el együtt fhd-ben sokmindenre elég lehet …🤷🏼

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#58858

üzenetére

Petykemano

#58858

üzenetére

Pontos számom nincs, de ránézésre nagyobbnak tűnik. És ez valószínű is, mert mindenből kétszer-háromszor több van benne, mint a Navi 23-ban, és ugyanazon a node-on jön.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#58855

üzenetére

Petykemano

#58855

üzenetére

Nem kisebb a Navi 23-nál a Navi 33. Nagyobb, és nem is kevéssel. Emiatt a Navi 23 és Navi 24 megmarad. A Navi 33 a Navi 21-et váltja, és a kisebb, butított verziói a Navi 22-t.

Ami a Navi 33-nak kicsi az a tokozása. Abban inkább hasonlít a Navi 23-ra, de a lapkaméret az nem.

-

huskydog17

addikt

válasz

Petykemano

#58855

üzenetére

Petykemano

#58855

üzenetére

Nem, nem túl szigorú, tökéletesen igaza van, a 6500-as semmire nem jó, egy ipari hulladék, kár a homokért, semmi értelme. Ha az ember 100 dolcsit akar költeni dVGA-ra sokkal jobban jár egy használt GTX 1060-al, ami minden szempontból sokkal jobb. Az RX 6500-as még a 6,5 éves Polaris/Pascal szériához képest is masszív visszalépés. Nincs olyan ár, ahol a 6500-as értelmet nyerne. Bár mondjuk egy dologban talán lenne értelme: büntetni az ősellensége(i)d, azaz ha valaki mondjuk felvásárol ebből a sz*rból 100 dollárért darabját és mondjuk 200-ért eladja az ellenségeinek, akkor megvan a tökéletes büntetés nekik és az okos keresett rajta egy csomó pénzt.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

Yany

addikt

válasz

Petykemano

#58853

üzenetére

Petykemano

#58853

üzenetére

Amíg létezik RX480/570/580, vagy bármi a másik oldalról, ami 1060+, addig sehová nem való, kukába sem,mert az környezetszennyező.

-

Petykemano

veterán

válasz

Petykemano

#58746

üzenetére

Petykemano

#58746

üzenetére

rebate-tel együtt $99-ért lehet kapni a Nav24-re épülő 6500XT-t

Oda került, ahová való -

Petykemano

veterán

válasz

Petykemano

#58849

üzenetére

Petykemano

#58849

üzenetére

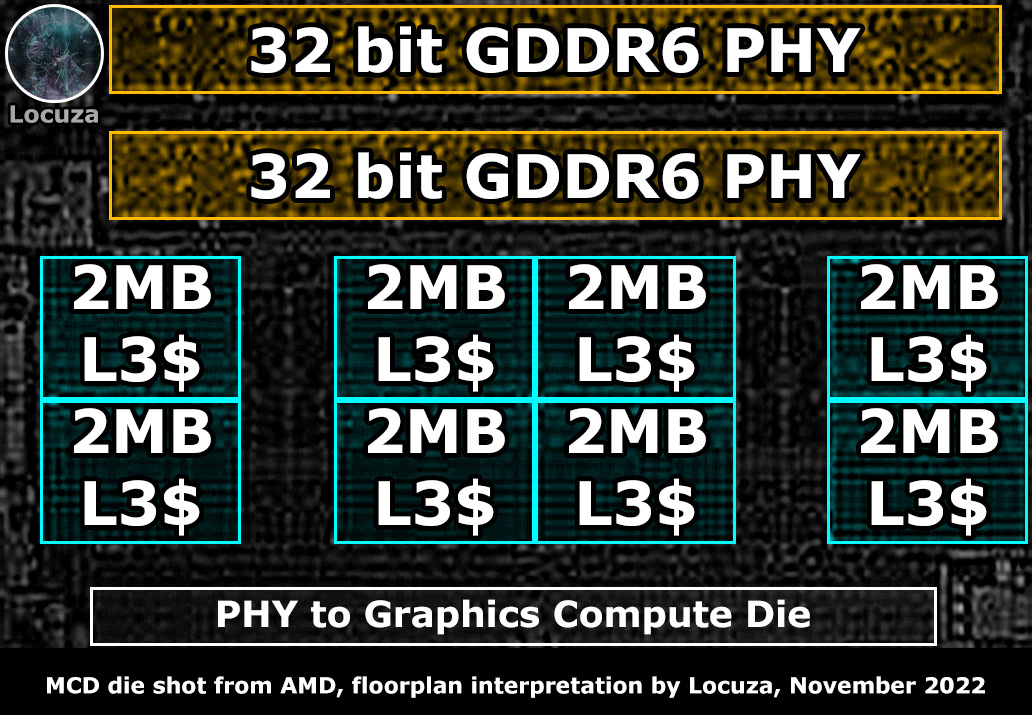

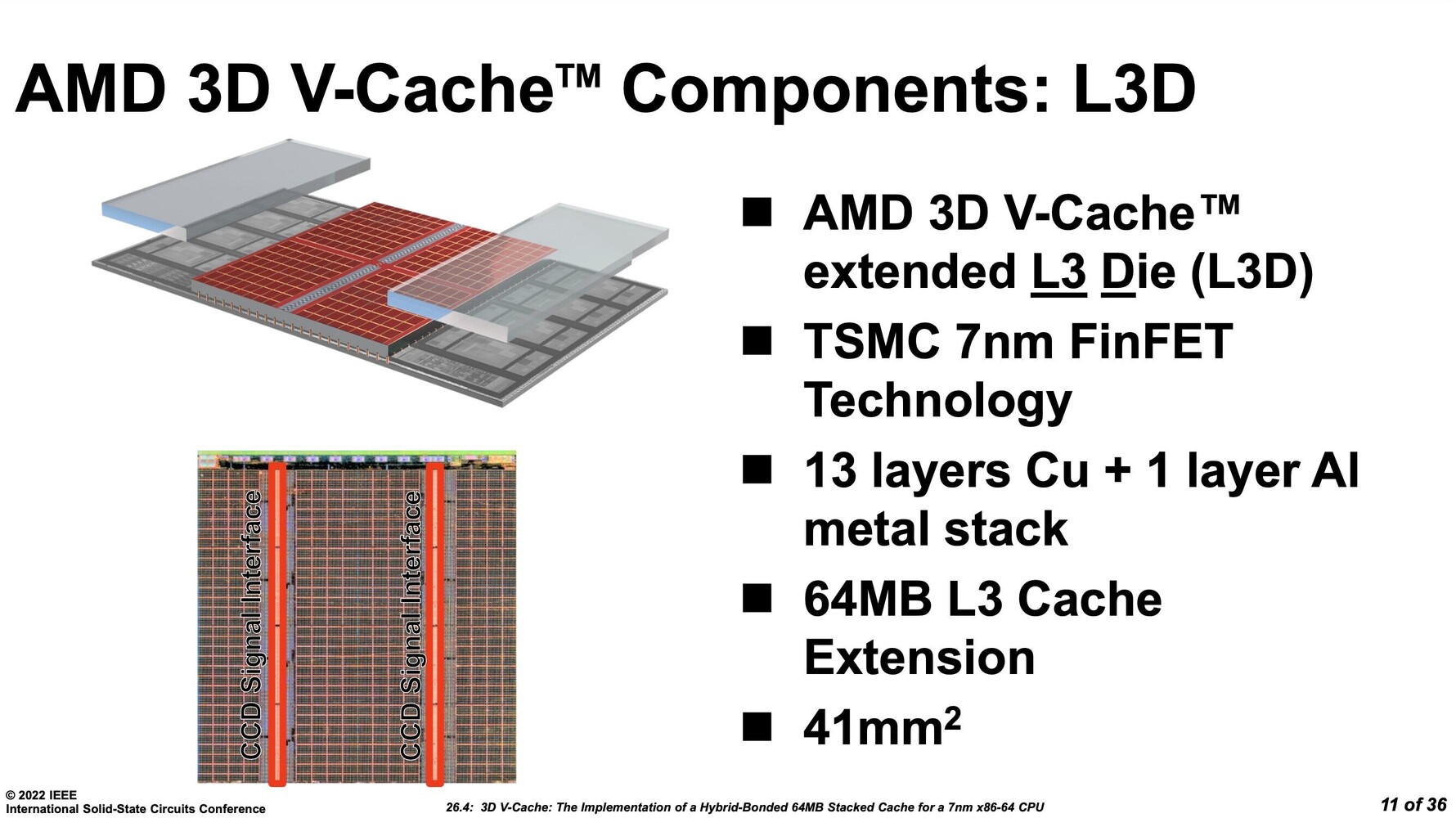

Mindenki abban a hitben van, hogy a 0Hi v-cache (vagyis az alap) az 6x16MB és a 1Hi az 2x6x16MB.

Adná magát, hogy olcsón gyártható MCD-ket stackeljen egymásra az AMD.

Ugyanakkor Abu azt mondta, hogy elvileg az MCD is tudja fogadni a CPU-khoz gyártott v-cache lapkát.

Hogy ez tényleg így van-e, azt nem tudom, de minden jel arra utal.

Így néz ki a 3D v-cache

Így pedig az MCD:

A méret elvileg nagyjából ugyanakkora.

Pontosabban nem tudhatjuk, hogy ha az AMD N6-on gyártja az új v-cache-eket, akkor azon N7 helyett mennyivel lesz ténlyegesen sűrűbb - kisebb.Persze akárhogyis, nem lenne tökéletes az átfedés.

Esetleg el tudnám képzelni, hogy mondjuk a 3D V-cache lapka felét le kell tiltani, vagy a TSV-től tábolabb eső részek elérése valamivel nagyobb késleltetést eredményezne.Mindenesetre amire utalni akarok ezzel az az, hogy nem kizárt, hogy nem 2x6x16MB, hanem 6x16MB + 6x32 esetleg 6x64MB lehet a v-cache-sel szerelt változat kapacitása.

Amennyiben igaz, hogy az MCD fogadhatja a CPU-knak szánt V-cache lapkát.

Máskülönben talán MCD-k egymásra pakolása lehet célszerű.

Ami azért érdekes gondolat, mert most jelentette be a Samsung a GDDR6W-t, ami ugye két GDDR6 lapka egymás fölé tokozva. egy GDDR6 lapka 32 bites szokott lenni, de egy GDDR6W 64bites kapcsolatot igényel.

Milyen praktikus lenne, ha a vertikálisan duplázott GDDR6 lapkákat vertikálisan duplázott duplázott memóriavezérlő szolgálná ki és csak a huzalozást kellene megduplázni? -

Abu85

HÁZIGAZDA

válasz

Petykemano

#58746

üzenetére

Petykemano

#58746

üzenetére

Ár szerinti bontás csak desktopra van, mert ott egyszerű lekövetni, hogy a dobozba vagy OEM szinten eladott VGA mennyibe került. Mobilnál ez nagyon nehéz, mert például az AMD úgy adja el a termékeinek nagy részét a notebookgyártóknak, hogy Ryzen+Radeon ár van, de nincs külön Radeon ár. És egyébként a Ryzen+Radeon ár is annak a függvénye, hogy van-e Advantage deal. Az Intel is egyre több ilyen árukapcsolást csinál, és így nehéz egzakt módon meghatározni, hogy a csomagban eladott dGPU végül mennyibe volt a csomagból. Ezek sokkal bonyolultabb szerződések, mint az, hogy dobozba kerül egy cucc, vagy az OEM rendel x mennyiséget.

-

Alogonomus

őstag

válasz

Petykemano

#58731

üzenetére

Petykemano

#58731

üzenetére

Arra próbáltam utalni, hogy az Activision Blizzard és az Epic talán úgy látják a saját méréseik alapján, hogy a 88%-os piaci részesedés csak a legyártott darabszámokat jelzi, de a 88% túlnyomó részét nem a versenyképes RTX 20xx és RTX 30xx kártyák teszik ki a játékosoknál, hanem az eredetileg is tömegterméknek szánt, és már túlhaladott GTX 1030/50/60, és GTX 1630/50/60 kártyák.

Ezzel lehetne csak magyarázni, hogy látszólag miért maguk alatt vágják a fát a 88%-os oldaltól elfordulással. A milliárd dolláros cégek pedig megfontolt döntéseket szoktak hozni.

Az persze nem kérdés, hogy sok Ampere kártya készült, de ahogy az elmúlt években tapasztaltuk, azok szinte sosem a boltokba kerültek, hanem a bányákba, és annyira nem jelennek meg raklapszámra a bányászkártyák a használt piacon. Semmiképpen sem milliós nagyságrendben. -

Abu85

HÁZIGAZDA

válasz

Petykemano

#58721

üzenetére

Petykemano

#58721

üzenetére

Továbbra is fontos adat, hogy annak a 100%-nak a 76%-a 100 dollár alatti VGA, 18% 100-300 dollár közötti, és mindössze 6% 300 dollár fölötti. És ugye, amikor az NV és az AMD hozza az új generációt, akkor ezt a 6%-os részt célozza, mert egyik next-gen VGA sem lesz 300 dollárnál olcsóbb.

Ezzel szemben a piaci részesedést nagyrészt az dönti el, hogy abban a 100 dollár alatti 76%-ba mennyi VGA-t adnak el, tehát alapvetően a Polaris 23, a GM107 és az ARC-G11 versenyéről volt szó eddig. Ebből a Polaris 23-at nyár óta nem gyártják, helyére megy a Navi 24, csak nincs annyi kapacitás a TSMC-nél, hogy annyit lehessen gyártani belőle, amennyi Polaris 23 készült negyedévenként.

Viszont, ha a bevételeket tekintjük, akkor hiába nagy a 100 dollár alatti VGA-k forgalma, a húsosfazék inkább a piac 6%-a. Persze nyilván a maradék 94%-ot sem a vásárlók két szép szeméért csinálják, de ezeken nagyon kevéske a nyereség. Ezért van az, hogy a JPR visszaesése egyáltalán nem korrelál a negyedéves jeletnésekben olvashatókkal:

Az NV ugye eladási darabszámban -19.7%-ot esett éves szinten, miközben bevételben a PC gaminget magába foglaló Gaming szegmens eredménye éves szinten 53,9%-kal csökkent.

Eközben az AMD eladási darabszámban -47.6%-ot esett éves szinten, miközben bevételben a PC gaminget magába foglaló Gaming szegmens eredménye éves szinten 14%-kal nőtt.

És ugye a múlt évi Q3 mindkét cégnek egy nagyon zsíros bányásznegyedév volt. A különbség most abból ered, hogy darabszámban nem ugyanazokból a szemgensekből veszítettek. Emellett persze mindkét cégnek tartalmaz mást is a PC-n kívül a Gaming szegmens, de a jó hír itt annyi, hogy ezek nem igazán változnak éves szinten, tehát, ami csökkenés-növekedés van, azt a PC indikálja, a többi terület stabilan állandó eredményt biztosít.Ez a tendencia folytatódni fog, mert az NVIDIA jelenleg 4,5 milliárd dollárnyi eladatlan GPU-n ül, és mellé még van 4 milliárd dollárnyi előre lekötött tétel, ezek nagy része még mindig a Samsungtól jön, tehát prev-gen. Ergo az NV rá lesz kényszerítve arra, hogy ezeket szórja ki gyorsan, mert ennyi tételt normál esetében, tehát nem bányászláznál másfél év eladni, de kellene majd hozni az amúgy már kész AD106-ot a tömegpiacra, miközben szeptemberben még tavaszra volt időzítve a start, októberben már nyárra, most pedig jövő őszre. De nem azért, mert bármi baj lenne a hardverrel, úgy működik, ahogy a nagyobb modellek, csak ugye van hozzávetőleg 9 milliárd dollárnyi olyan már kifizetett termék, amelyeket ki kellene dobni, ha tavasszal jönne. És érthető módon az NVIDIA nem akar úgy 7 milliárd dollárnyi tételt csak úgy leírni. Tehát a jövőben ezek eladása lesz a fontos, és emiatt a piaci részesedésük biztosan nőni fog, mert belemennek majd a veszteséggel történő értékesítésbe is. Utóbbi miatt viszont a Gaming szegmens szzonális eredménye még pár negyedévig romlani fog. Persze az egész attól is függ, hogy az AMD hogyan árazza majd a Navi 33-at. Ha nagyon ki akarnak baszni az NV-vel, akkor benyomják 400 dollárra, és akkor az NV-nek is le kell vinnie a GA102-ket erre a szintre. Szóval olyan nagyon ennek a helyzetnek az NV nem örül, az AMD annál inkább, mert a Gaming részlegük már most növekszik a bányászláz után, és még nincs is itt a next-genjük.

#58723 Albus_D : Az NV-nek nem az a baja, hogy nem ürül a raktár, hanem az, hogy orbitális készleten ülnek. Olyan készleten, amit normál piaci környezetben másfél év eladni. Bányászlázzal nem lenne gond, mert arra tervezték a mennyiséget, de normál piaci körülmények között már lassan ürül a raktár, a most jellemző visszaesés mellett pedig még az sem kizárt, hogy két év múlva is Ampere-eket árulnak 800 dollár alatt.

#58726 Albus_D :

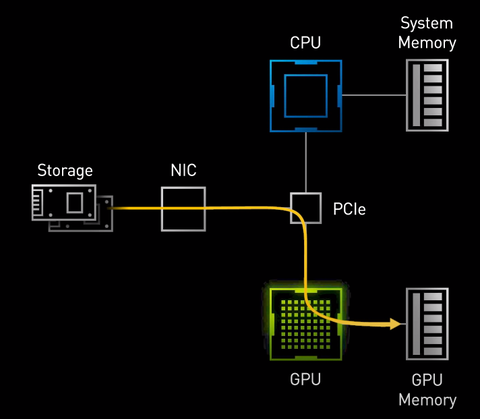

Az RTX IO, ahogy be lett mutatva:

Az RTX IO, ami végül lett:

Tehát végül nem az lett, aminek mondták eredetileg, hogy a GPU közvetlenül tudja olvasni az adattárolóról az adatot, hanem olyan megoldás, ami a rendszermemóriából olvassa be az adatot. Ez egyébként a DirectStorage API. Ilyen formában az egész RTX IO nem létezik, mert egy szimpla név maradt belőle, semmit nem ad hozzá a szabványhoz. Nem is kell külön támogatni, mert nem történt semmi változás. Olyan, mintha a többi gyártó elnevezné az implementációt jucuskának, és innentől kezdve jucuska technológiaként hirdetnék, de közben működésben nem módosul semmi a szabványhoz viszonyítva.

Amiről én beszéltem az az, hogy a GPU-nak közvetlenül kellene elérnie az NVMe adattárolót, így megkerülve a rendszermemóriát. Az RTX IO erre nem képes, holott eredetileg ezt hirdették még két éve. Mi történt szerinted két év alatt? Csak nem rájöttek, hogy nem tudják megcsinálni egyedül, az Intel és az AMD segítsége nélkül? De!

#58727 b. : Nem a nyitottság a gond. Az rendben van az UE5-nél. A baj az, hogy ha a Nanite használva van, akkor nem tudsz használni hardveres RT-t. Ha pedig bekapcsolod, akkor fallback módba kapcsol a Nanite, tehát ez nem fog működni. A két eljárás nem kompatibilis egymással. Lényegében a DXR megöli az UE5 fő újítását.

-

Alogonomus

őstag

válasz

Petykemano

#58721

üzenetére

Petykemano

#58721

üzenetére

Az AMD akkor engedte el az RDNA 2-es piacszerzést, amikor a konzolgyártók lehívták az opciós jogaikat, és az AMD a konzolokhoz gyártotta az APU egységeket. Persze ez is nagyon megérte az AMD számára, és a piacszerzést ráér az RDNA 3-mal megvalósítani, mert egyáltalán nem az Nvidia a valódi technológiai ellenfele, hanem az Intel.

Ráadásul a látszólagos Nvidia dominancia ellenére az Epic sem az Nvidia kártyák adottságait nézte az UE5 megalkotásakor, de például már az Activision Blizzard sem az Nvidia kártyáinak a képességeihez igazította az utolsó két címét. [link] [link]

Ahogy Abu is utalt rá, a piaci részesedésben ugyanúgy egységnyinek számít egy $100 alatti GTX, ahogy egy $2000 fölötti RTX. -

Busterftw

nagyúr

válasz

Petykemano

#58714

üzenetére

Petykemano

#58714

üzenetére

AMD 8%?

Ez új történelmi csúcs.

Én egyszer felvetettem már, hogy az Intel az AMD piacát fogja érinteni, úgy látszik így is lett/sz. -

válasz

Petykemano

#58714

üzenetére

Petykemano

#58714

üzenetére

Nem nagyon tudom felfogni a Total PC dGPUs grafikont, ahol 2022Q3-ban NV 88%-ot, AMD 8%-ot, Intel 4%-ot szállított.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#58714

üzenetére

Petykemano

#58714

üzenetére

Miért lenne pánik? A raktárkészlet ürül, és csak +2 hónapra számolják most a Navi 21 és 22 kivezetését a tervezetthez viszonyítva, ami például egész jó, mert tavaszra le lehet cserélni mindkét lapkát. Ez teljesen jó az AMD-nek. Állhatnának úgy is, ahogy az NVIDIA áll, hogy van kb. 60 millió eladatlan vagy lekötött GPU-d az előző generációból, és nem tudod hozni a next-gent a tömegpiacnak, mert tök lassan veszi meg a piac az előző generációt. Az Navi 33 ellen szánt AD106 például most 2023Q3 végén jönne. Nem azért, mert nem készül el gyorsan, hanem mert ha kihozzák, akkor le kellene írni úgy 4 milliárd dollárnyi eladhatatlan készletet. Az AMD felhalmozott GPU készlete nincs 50 millió dollár, tehát ha nagyon szorít az idő, akkor ennyit még le is tudnak írni, de nyilván nem szorít, ráérnek azt eladni februárig.

Ha a piac valamilyen okkal beomlik, az mindig annak fáj, akinek nagy tartalékja van.

-

Petykemano

veterán

válasz

Petykemano

#58702

üzenetére

Petykemano

#58702

üzenetére

Van már ábra is hozzá:

Tavalyhoz képest csaknem megfeleződött az eladótt PC dGPU-k száma.

Az AMD ebben a szegmensben Q/Q elvesztette eddigi eladásainak több mint felét.

Számoljunk:

AMD:

2021Q3: 4millió kártya

2022Q2: 2.85m kártya

2022Q3: 1.12 kártya(Az Nvidia eladásainak csökkenése is jelentős: 20millió eladott kártyáról 12-re esett vissza)

Abu, az AMD-nél nincs pánik emiatt? Őket nem csak kriptó bezuhanása és az akkor még csak várható recessziós hullámverés érintette, tehát nem csak a darabszám csökken, hanem még piaci részesedést vesztettek. Ez mitől lehet ennyire súlyos? És nem aggódnak?

-

Cyberboy42

senior tag

válasz

Petykemano

#58712

üzenetére

Petykemano

#58712

üzenetére

Na ja, mondok én neked egy konkrétat is... a cég amiben dolgozom, a covid alatt annyira megdrágult az alapanyag, hogy a főnökom nagyjából dupla olyan áron tudta csak beszerezni azt, tehát fogta magát és a terméket is megdrágította amit gyártunk. Mostanra az alapanyagok ára nagyjából vissza is ált az előtte lévő árakhoz, de persze az termékünk ára az megmaradt xD most akkora profitja van hogy alig bírja elsikálni az adót xD

-

Senki9876

tag

válasz

Petykemano

#58707

üzenetére

Petykemano

#58707

üzenetére

Csak megemlítem hogy a szállításra (ez csak a hajóra érvényes) nem lehet kifogás. Jelenleg ugyanolyan vagy olcsóbb mint covid előtt.

Pl. az év elején 20" konténer Shanghai -ból 6-8e euró volt, most még 2-2,5e euró

-

awexco

őstag

válasz

Petykemano

#58709

üzenetére

Petykemano

#58709

üzenetére

bányászat alatt volt az 150 is

-

válasz

Petykemano

#58707

üzenetére

Petykemano

#58707

üzenetére

A 100k új kártyáért a pillanatnyi USD árfolyammal $200 lenne. El tudod képzelni azt a szenáriót, hogy $200-ért vesztegessenek egy eredetileg $329 kártyát? Ilyen drop még talán a Polarisnál sem volt. Na jó, ott talán igen.

-

Hellwhatever

aktív tag

válasz

Petykemano

#58702

üzenetére

Petykemano

#58702

üzenetére

Ezt az ünnepi szezont kéne még valahogy kibírni mindenkinek és elnapolni a VGA vásárlást jövő tavaszig. Lenne itt normális ára megint mindennek.

-

FireKeeper

nagyúr

válasz

Petykemano

#58702

üzenetére

Petykemano

#58702

üzenetére

nahát, kriptó hajó földbeállt, rá kell jönnie a piacnak a gémerek meg nem tudják/akarják megfizetni ezeket az árakat (pláne évtizedes rekord infláció mellett). nem tudom ebbe a professzionális piac is benne van-e, de nem lennék meglepve ha ott is hasonló visszaesés lenne.

én amondó vagyok hogy r.hadjon is rájuk a raktárkészlet, nyerészkedett mindkettő amikor ment a buli. azért egy 6900 XT-t 150k-ért elfogadnék

-

awexco

őstag

válasz

Petykemano

#58702

üzenetére

Petykemano

#58702

üzenetére

Sok volt a bánya ... Intel bányász procijával mi a szitu ?

-

#36531588

törölt tag

válasz

Petykemano

#58681

üzenetére

Petykemano

#58681

üzenetére

"Azt persze én is tudom, hogy nem először történik, hogy Abu azzal érvel, hogy amit az AMD csinál, azt a fejlesztők akarják és pont úgy akarják és ez sem teljesítményben, sem a könnyebb programozhatóság miatt szélesebb penetrációban nem igazán mutatkozik meg"

Ennyi a lényeg.

-

S_x96x_S

addikt

válasz

Petykemano

#58677

üzenetére

Petykemano

#58677

üzenetére

>> Radeon Raytracing Analyzer

> Szóval mi van, ha ezt a toolt éppen annak kimérésére fogják majd használni,

> hogy meddig lehet elmenni? Hogy az nvidia még zökkenőmentesen bírja,.de az AMD

> dadogjon?a kérdésfelvetés jó ..

de én nem emiatt aggódnék az AMD/nVidia/Intel helyében ..1.) Biztos használnak hasonló eszközöket a versenytárs erősségeinek és gyengeségeinek meghatározására, és biztos bevásárolt jópár nvidia 4090-est az AMD, hogy apró darabokra szedje .. és kielemezze .. és az nVidia is hasonlóan figyeli az RDNA3-ast ..

2.) De szerintem az nVidiának is van hasonló tool-ja.

"NVIDIA Nsight™ Graphics is a standalone developer tool with ray-tracing support that enables you to debug, profile, and export frames built with Direct3D, Vulkan, OpenGL, OpenVR, and the Oculus SDK."

3.) és az Intelnek is .. "Intel® Graphics Performance Analyzers

Improve your game's performance by quickly identifying problem areas."

4.) Ha túl sokat titkolóznak, akkor pont a játékfejlesztőket akadályozzák meg, hogy a Radeonra (vagy nVidiára, Intelre ) optimalizálják a programokat és a game engineket.de viszatérve ..

a Radeon 6000 gyengeségeire nem lett volna célszerű technológia stratégiát építeni az nVidia és az Intel-nek ( esetleg csak rövid távú marketing kampányt )

mert ezeket a problémákat az AMD is ismeri .. és tudhatólag dolgozik is rajta ..

És most már azt is tudjuk, hogy a Radeon 7000 -res teljesen más

.. máshol vannak a szűk keresztmetszetei ..Szerintem az jobb stratégia, hogyha a versenytárs következő legjobb jövőbeli lépéseit próbálják megtippelni és arra felkészülni.

Az nVidia szerintem most az RDNA 4,5,6 gen -re próbálhat felkészülni.

és kicsi a valószínűsége, hogy az RDNA2-es gyengeségeire építenének ..

Viszont a játékfejlesztőknek a meglévő 1-2-3 éves GPU-kat is optimalizálni kell

( már amennyire az időbe belefér .. ha van hatékony tool .. akkor több minden fér bele .. ha nincs hatékony tool .. akkor pedig kevesebb ..

Vagyis lehet titkolózni .. de ezzel pont nem érdemes. ) -

válasz

Petykemano

#58680

üzenetére

Petykemano

#58680

üzenetére

Igen teljesen értem mit írtál. Azt nem értem hogy egy ilyen AMD-s monitorozó/ optimalizáló programból ,amit az AMD fejlesztett segítségnek az RT hardverhez való hozzásimításához és megpróbálja kiaknázni a benne rejlő potenciált, hogy lett az hogy majd most jól kibukik hogy az Nvidia korlátozza az AMD-t és szűk keresztmetszetet helyeznek el? Azt gondolod erre szükségük lenne?

Nvidia és Intel is használ ilyen optimalizáló szoftvercsomagot már régóta több API-ra ez nem új keletű dolog enélkül nem is igazán tudnák belőni az optimális terhelhetőséget.

Miért gondolod hogy erre szükség van mikor felhasználói / professzionális programok alatt ennél amit játékok alatt látsz még nagyobb a különbség ?

Maga a szűk keresztmetszet az annyi hogy az Nvidia erre helyezte a hangsúlyt tranyó milliókat költ egy GPU-n belül erre az AMD meg másra használja azt fel, mondjuk IC-t épít be. Egyszerűen nincs szükség a korlátozásra és kimérésre, fejlődni kell hardveresen is ahhoz hogy a Raytracing menjen.

Intel alapból akkorát lépett például RT terén az ARC-cal a saját raszter teljesítményéhez képest amit az AMD 2 generáció alatt. Tehát valószínűleg ha van is ilyen korlátozás first time hozzák azt, amit az Nvidia azonos szinten lévő kártyái.

AZt gondolom ez pont azért kell hogy ne dadogjon az RX 6000 AMD kártyákon még az RT amit az RX 7000 hez lőnek be, vagy pedig pont mondjuk az IC-cachehez tudják majd optimalizáni az RT-t ami meg Nvidiának lenne hátrányos. Tehát ez a megközelítés kétélű dolog. -

paprobert

őstag

válasz

Petykemano

#58680

üzenetére

Petykemano

#58680

üzenetére

Én inkább azt mondanám, hogy Pistike szülei nem etették eléggé a gyereküket, hogy megfelelően fejlődjön fizikailag, és teljesíthessen az iskolában.

Naponta egy parizeres zsömlével akarják megúszni, és mindent elkövetnek, hogy az iskola változtassa a testnevelésórát inkább csak egy órás nyújtássá.Ha mindenki egy parizeres zsömlével beérné naponta, -mondják Pistike szülei- akkor nem kellene ezt a feleslegesen sok nehéz izomzatot cipelni, a világ sokkal környezetbarátabbá-takarékosabbá válthatna, és kevesebb erőszak is lenne, és hát Pistike sem lenne akkora nyominger.

-

pRoject22

őstag

válasz

Petykemano

#58681

üzenetére

Petykemano

#58681

üzenetére

De még nem tudjuk ,hogy a 7900XTX RT-ben mennyit javul, vagy tudjuk?

-

#36531588

törölt tag

válasz

Petykemano

#58677

üzenetére

Petykemano

#58677

üzenetére

"Mármint az sejthető, hogy az RT-vel valami hasonló történik, mint a tesszelációval."

Dehogy sejthető. Az nv-nek speciális fix hardvere van rá, az amd meg már ki tudja hány generáció óta kullog utána, igyekezve mindenféle szoftveres csalásokkal megoldani a hátrányt. Lásd ezt is. Gondolom a szűk keresztmetszetet felismerve a problémás részt egyszerűen kihagyják az elvégzendő feladatok közül, így próbálva sebességet nyerni.

Természetesen megvan az a kemény mag a fórumon, akik szerint az amd bármilyen sikertelenségéről csak és kizárólag a kokurencia tehet, és nem unják meg ezt hirdetni.

-

válasz

Petykemano

#58677

üzenetére

Petykemano

#58677

üzenetére

Ezt amúgy hogy tudtad ebből kihozni? Mint mindig, mindenben az a szűk keresztmetszet az egyik gyártónak ami a másiknak jobban megy. Lásd Resident Evil 13 GB Vram igény...

AMD, Nvidiától független saját támogatású játékaiban amúgy is kevésbé terhelő RT effektek vannak mert szimplán trükkök nélkül is az Nvidia kártyák erősebbek raytracingban lásd a Quadro-k teljesítményét tervezésnél és filmkészítésnél, aminek nem sok köze van a játékokhoz.

Nvidia egyértelműen a saját hardverére szabja a saját támogatású játékait.

Valószínűleg még mindig a Turing a legelterjedtebb RT-képes hardver a piacon amit azért illő most már hozni mindegyik oldalnak. -

Petykemano

veterán

válasz

Petykemano

#58674

üzenetére

Petykemano

#58674

üzenetére

Közben olvastam a raktárkészletes sztorit.

A navi 23-24 marad. Úgyhogy ez egy rebrandelt navi24 lehet -

hokuszpk

nagyúr

válasz

Petykemano

#58672

üzenetére

Petykemano

#58672

üzenetére

mi van, ha ez egy mernoki minta apu, csak rosszul van detektalva a cpu neve ?

mondhatni miert 5600G -vel tesztelnek ? igp nelkuli proci nem volt keznel ? -

válasz

Petykemano

#58608

üzenetére

Petykemano

#58608

üzenetére

Architected to achieve 3 GHz

Ez volt az original goal, amihez végül a respin kell? Ha az megvan, akkor lehet a 4090-re lőni? Érdekfeszítő kérdések!

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- BESZÁMÍTÁS! MSI B450M R7 2700X 32GB DDR4 512GB SSD RTX 3050 8GB Rampage SHIVA Thermaltake 500W

- PlayStation Network Card (PSN) ajándékkártyák, egyenesen a Sony-tól!

- Apple iPhone 14 128GB , Kártyafüggetlen

- Bitcoin Miner Eladó Bitmain Antminer S19 JPro 104 Th 3150 watt

- Csere-Beszámítás! Lenovo Ideapad 3 Gamer notebook.I5 10300H / 16GB DDR4 / GTX 1650 / 250SSD +500HDD

Állásajánlatok

Cég: PC Trade Systems Kft.

Város: Szeged

Cég: PCMENTOR SZERVIZ KFT.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

). Ők monitorozva igyekeznek reprodukálni a hibákat.

). Ők monitorozva igyekeznek reprodukálni a hibákat.