- Leica kamerákat kap a Xiaomi Mix Flip 2 is

- India felől közelít egy 7550 mAh-s Redmi

- Xiaomi 13 - felnőni nehéz

- Megjelent a Poco F7, eurós ára is van már

- Xiaomi 13T és 13T Pro - nincs tétlenkedés

- Samsung Galaxy A56 - megbízható középszerűség

- Yettel topik

- Samsung Galaxy S24 Ultra - ha működik, ne változtass!

- Fotók, videók mobillal

- Xiaomi 14T - nem baj, hogy nem Pro

-

Mobilarena

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

bjasq99

tag

Megpróbálnék én is bekapcsolódni ebbe kartell témakörbe és kifejteném gondolataim, hogy milyen magyarázatok lehetnek amelyek nem feltételezik a kartellt a két cég között, de mégis magyarázná részben az előállt furcsa helyzetet.

1.Kérdés: Ha a hardverek tudják amit tudnak akkor a jelenleginél az Amd miért nem áraz le jobban?

1. Válasz:

1. tényező: ha az Amd lejjebb ad minimálisan az árakból akkor nem változik jelentősen semmi, szerintem az Nvidia vásárlók nagy része el van köteleződve cégük mellett, (részben featurok, marketing stb) számukra nem jelentene semmit ha a konkurencia minimálisan még jobban alávágna az áraknak.(És ne írjátok, hogy nektek fontosabb lenne a price/performance mert akkor nem tartoztok ebbe az elkötelezett vevőtáborba) Lássuk be most is ez a helyzet, hogy Amd -nek jobb a price/performance (Raytrcinget leszámítva) de a vásárlók elkötelezettek Nv mellett a jól ismert dolgok miatt.

Igazából úgy modellezhető talán a piac, hogy mindkét gyártónak megvan a saját fanatikusan elkötelezettei akik bármi áron kitartanak a cégük mellett, semmi esetben sem vennének a másik márkától. Ebbe a rétegbe szerintem kevesebben tartoznak, de az Nv nél jóval többen mint Amd -nél. A második rétegbe azon elkötelezettek tartoznak akik nem szimpla hívők, nekik kell valami kézzel fogható ami visszaigazolást ad döntésük helyességéről. Melyik ember miben találja meg az igét azon múlik, hogy ki hova tartozik. Aki a price/performance -ban találta meg az élet értelmét az Amd -re szavaz, aki pedig a feautorok, megbízhatóság, konzisztencia, kényelem valamelyikében azoknak az Nvidia felé húz a szíve. Itt szerintem hatalmas a különbség, és ide tartozik a legtöbb vásárló.

A harmadik csoport a résen lévők akik az általuk legjobbnak megítélt kártyát veszik, cégtől függetlenül. Szerintem belőlük kevesebb van, (Magyarországon több), de itt is Nv vezet (szerintem).

2. tényező: Nézzük meg 7900 xtx és rtx 4080 kb egy ár gyártani kb egy teljesítmény Msrp 1000 vs 1200 Usd az 20 % +. Tehát ha Amd brutális leárazásba kezdene és 0 bevétellel adná Gpuit akkor is követhetné őket Nv úgy hogy van még 20% nyereségük, de inkább több mert az 1. tényező miatt sokan maradnának Nv nél mert csak azon emberek pártolnának át akik nem elkötelezettek.

Az Amd -nek elég a mostani ár is, hogy megadja vásárlói számára a lelki nyugalmat a price/performance körében.

A 2. kérdést majd később vetem fel így is túl hosszú lett.

Állitásaim nem puszta tényként vagy szigorúan vett mérési eredményként kell kezelni, csupán meglátásaim amelyekre szívesen várok megjegyzéseket. -

Petykemano

veterán

Valóban fura.

Tényleg ennyire ugyanazt lehet kihozni nagyjából ugyanabból a gyártástechnológiából még olyan nagyon eltérő megközelítésekkel is?Mondjuk ha ránézünk Chips&cheese elemzéseire, azt látjuk, hogy a mikrobenchmarkokban sincs olyan nagy különbség.

Ezzel együtt igazából nem annyira az Nvidia piaci viselkedése szokatlan. Piacvezetőként azért teheti meg, hogy felüláraz, mert már így is az övé a piaci részesedés meghatározó része. Persze az igaz, hogy az árszabásával nem csak a piaci részesedésére, hanem a piac egészének volumenére hatással van. Az áremelés szűkíti a piacot, hiszen a kisebb jövedelműek kiszorulnak.

Piacszerzésre akkor van érdemi lehetőség, ha valaki technológiai és/vagy költségelőnyt tud elérni. Az nvidia piacvezetőként érthető,.hogy ha ilyen előnyt ér el,.akkor azt kevésbé tudja piacszerzésre fordítani.

Ezért gondolom,.azt, hogy az AMD részéről szokatlan az a magatartás, hogy kooperál. Persze érthető volt, amíg a csőd szélén álltak, hogy a megmaradt piaci részesedésükön kapaszkodva ragaszkodnak az azon elért haszonhoz, különben annyit se tudnak fejleszteni, mint előtte.

De ez valóban összetett kérdés, nem biztos,.hogy kizárólag $50-100-on múlik. Mindenesetre valóban úgy tűnik, az AMD megelégszik a piaci követő pozícióval és se hardver, se szoftveres fejlesztést nem kíván többet belerakni a pozíciója megőrzéséhez szükséges minimumnál.Viszont mit mivel látsz párban?

A 7900XT valamivel erősebb a 4070Ti-nál, de drágább is. Ők egy pár.

7800XT - 4070

7700XT - 4060Ti

7600XT - 4060

7600 - 4050

Így?$599

$449

$349

$279

Így? -

Devid_81

félisten

Nah ha eddig az Nvidiat birizgaltuk, hogy wtf ez az uj generacio a 4090-at kiveve, akkor most lehet nezni nagyokat.

7800XT vagy akarminek hivjak majd talan felveszi a versenyt a regi gen csucs kartyajaval 280Wattal

Orulok neki, hogy kiszalltam az asztalibol egy idore komolyan

-

PuMbA

titán

Szerintem is vicces lesz a helyzet

A 4070 Ti L2-je ugye 48MB, akkor szerintem a 4060-é 32MB-ra várható, ahogy az AMD Infinity Cache-e is jelenleg ennyi a 6600XT-nél. Még mindig ott vagyunk, hogy erősebb GPU-val, de azonos memória sávszélességgel memória sávszélesség limitált játékokban nem fogja elérni a Navi 33 a 6700XT sebességét. A 3060 8GB is a 3050 8GB sebességét hozza memória sávszélesség limitált játékokban, hiába az erősebb GPU. A lényeg, hogy itt nem a GPU lesz a lényeg, mert az elég erős lesz. A kérdés, hogy a memória sávszélesség mennyire "hajtja ki" a GPU-t.

A 4070 Ti L2-je ugye 48MB, akkor szerintem a 4060-é 32MB-ra várható, ahogy az AMD Infinity Cache-e is jelenleg ennyi a 6600XT-nél. Még mindig ott vagyunk, hogy erősebb GPU-val, de azonos memória sávszélességgel memória sávszélesség limitált játékokban nem fogja elérni a Navi 33 a 6700XT sebességét. A 3060 8GB is a 3050 8GB sebességét hozza memória sávszélesség limitált játékokban, hiába az erősebb GPU. A lényeg, hogy itt nem a GPU lesz a lényeg, mert az elég erős lesz. A kérdés, hogy a memória sávszélesség mennyire "hajtja ki" a GPU-t."Az előző genben a csúcs GA102 ben is csak 6 MB volt itt meg 32 MB lesz a legkisebben is."

32MB tudod mennyit ér...semmit. Az Xbox One-ban is a 32MB ESRAM annyit ért, hogy a PS4 is így agyonpüfölte.

-

Petykemano

veterán

> de ezek az Ada-k laptop verziók nem?

A VCZ táblázatban szerepel az AD102, úgyhogy szerintem a táblázat a adatai nem az adott lapkák laptop verziójára vonatkozó adatokat sorolja fel.

Amikor a techspot grafikonjából tippelgettem, akkor én sem laptop verziókra gondoltam.

> Azaz ha a 4070 ≈3080 lesz akkor a 4060Ti ≈3070 Ti a 4060≈ 3070.

Ezzel, ahogy mondtam nagyjából egyetértek.

Annyi, hogy elképzelhetőnek tartanám, hogy a 4060Ti, mivel állítólag/elvileg levitték a TDP-t 160W-ra, ezért talán talán alulról fogja kapargatni a 3070Ti-t, a 4060 pedig a 3070-t.> Tehát a navi 33 megítélése majd a 4070 teljesítményétől is függhet.

Ez nem tudom, hogy érted.

Szerintem a Navi33 elég messze elmarad majd a 4070-től. -

S_x96x_S

addikt

logikusnak tünik, hogy a 3DV-cache-t itt is bevetik a jövőben.

"Semiconductor engineer Tom Wassick has discovered what he believes to be 3D V-Cache functionality on one of AMD's best GPUs, the RX 7900 XT. The engineer took a peak inside the 7900 XT's die with infrared imaging and found the same type of 3D V-Cache connection points used on AMD's Zen 3 and Zen 4 architecture. Wassick spotted the connections on the MCD die. "

-

Petykemano

veterán

38%-kal magasabb tranzisztorsűrűség.

Bár az ábrákon szerepelt, hogy a fő cél az RDNA3 esetén a tranzisztorsűrűség növelés volt.

De én azért egy picit tartok tőle, hogy nem volt ennyire májer a AMD és lesz ára ennek.

Pl

- 4x Pcie5 csatoló (Igen, természetesen nyilván a legolcsóbb kártyához fogod venni a legdrágább alaplapot...)

- CoDec kiherélése a Navi24-hez hasonlóanReméljük persze hogy nem.

Kár volna, ha az 2mrd tranzisztortöbblet és az erőfeszítés az RDNA3 CU beépítésére dual-issue + AI accelerator) kárba vészne végül. Legalábbis egyelőre úgy tűnik, ennek a dual issue-nak nem sok hatása van.

-

Abu85

HÁZIGAZDA

Q3-as adat. Hiszen még nincs Q4. De a tendenciát azt látod gondolom. Két lehetőség van:

- az NV úgy gondolta, hogy innentől kezdve GPU-kat gyűjt, és inkább nem adja el a legyártott termékeket

- nem tudják rávenni a partnereket, hogy megvegyék a folyamatosan bővülő készletetSzerinted melyik lehetőség a reális?

#59911 Petykemano : Az 5 nm-es waferár is olcsóbb lesz teszem azt két év múlva. Ez normális, de van egy minimum szint, amit azért tart a bérgyártó.

Nem is rohannak. A gyártókapacitás átépíthető. Nem fosnak be a TSMC-nél attól, hogy pár hónapja nem pörögnek a gyárak 100%-on. Ha mondjuk 50%-on lennének az más kérdés, de attól még messze vannak.

-

Abu85

HÁZIGAZDA

Ezt sokszor átbeszétük. A gond pont az, hogy nem viszik eléggé a boltok a raktárakból a termékeket. Emiatt a boltokban is hiányos a termékskála, és így az NV-nek sokadik negyedéve csak nő az inventory-ja, és olyan magasságokban van, ami több hónap kiszolgálására elég akkor is, ha semmit sem gyártanak.

Ez nem kitaláció, az NVIDIA írja, hogy az invertory állapota 4,5 milliárd dollár fölött van, ami kb. 4 milliárd dollárral több, mint a normális. Kérted, hogy mutassam be hol van ez az adat, azt is megtettem. Vagy gondolod az NV felcsapott kártyagyűjtőnek, és már meg sem próbálják eladni a raktárkészletet?

-

Petykemano

veterán

Ez nem meglepő azokután amit a mobil változatból láttunk.

+10-15% teljesítmény

-15% lapkaméret

(vs N23)Ha a teljesítményelőnyt nem úgy érték el, hogy +50W-ot rálapátoltak a fogyasztásra (180-225W) akkor tulajdonképpen ez egészen korrekt szaldó ahhoz képest, hogy fél node-ot léptek előre.

Az ár lesz a döntő.

Az RX 6600/6600XT/6650XT $330/$380/$400 msrp-vel rendelkezik.

Utóbbi időben $230/$280 körül mentek.Ha az új szériát csak azért, mert "új" betolják $300-400 körüli szintre, akkor - mivel csekély 10-15%-os az előrelépés, ezért legkevésbé sem forgatná fel a piacot. Szerintem meglehetős csalódást váltana ki.

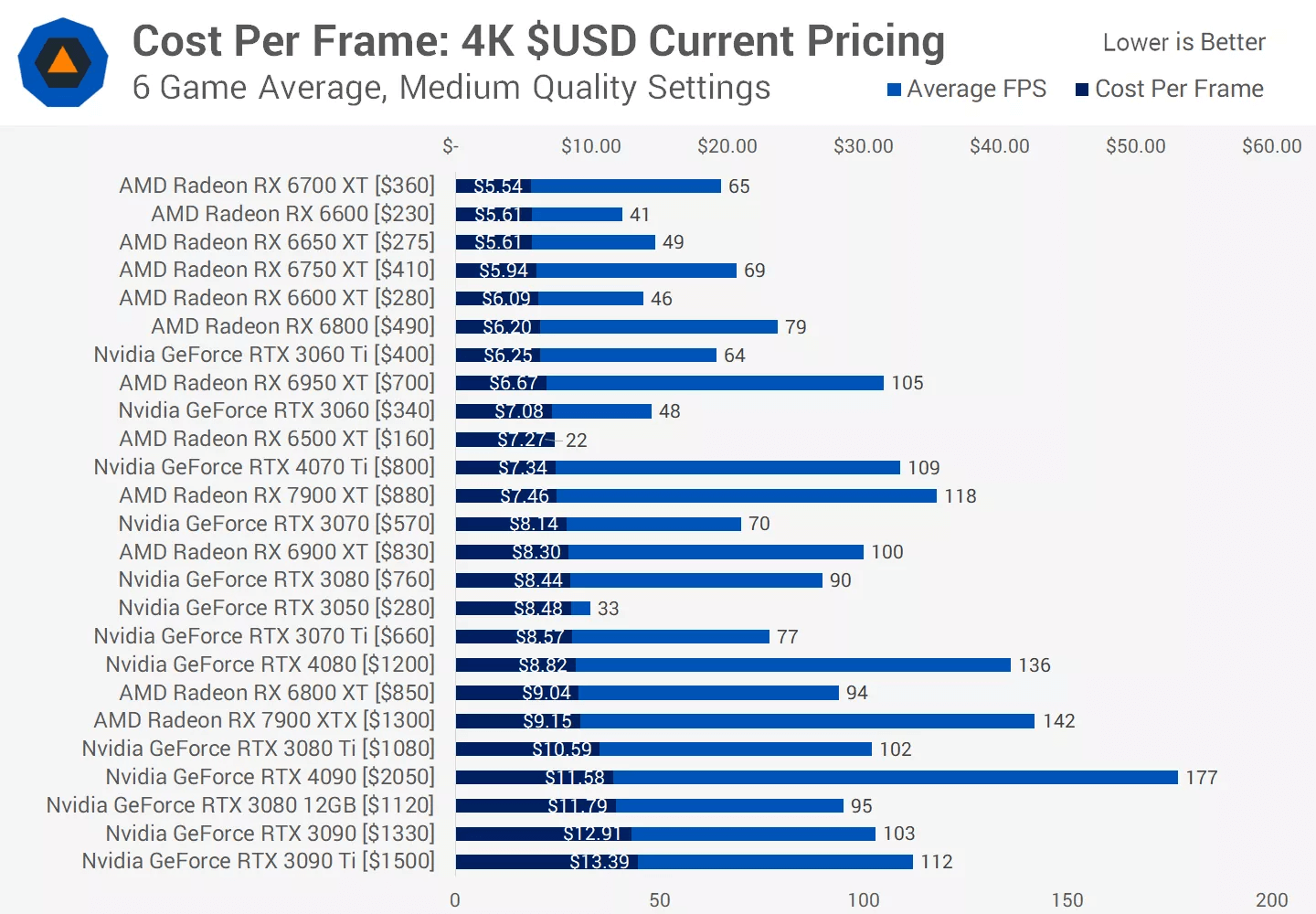

A fenti tábla alapján a 6700XT szintjét (60-65fps) hoznia kellene $299-319-ért. (~4.9-5$/fps)

És a 6650-et (~50fps) kellene $239-249-ért ($4.9-5)És egy RX 6600 szintet (40fps) egy nagyon visszafogott/vágott 75W verzióból $199-ért.

Ennyi "kedvezmény" egy 15%-kal kisebb lapkából készülő kártyáért mondjuk eléggé a minimum

Ez amit most itt mondam, még nem az a legalacsonyabb ár, amit én szeretnék látni (mert mondjuk egy most $$230-280-ért adott lapkánál 15%-kal kisebbet árulhatnának $199-$249-ért is), hanem az az objektív fair minimum, ami alapján egy olcsóbban gyártható készüléket kereslethiányos időben a felhozatalba objektíve be lehet illeszteni és amit még én is lehümmégnék.

A realitás persze az, hogy "fair minimumhoz" képest az AMD jellemzően csalódást kelt, ezért reálisabb egy $279 (~RX 6650) és $349 (~RX 6700XT)-es árszabás, ami persze fogyasztói szemmel nézve pofon a szarnak.

Ehhez érdemes még hozzánézni, hogy mit kínálhat az Nvidia?

Várhatóan lesz ott is sku-tól függően egy $100-200-os korrekció.

Tehát kalkulálhatunk azzal, hogy 1-2 negyedév múlva a 4070Ti $699 lesz.

A 4080 és 4070Ti között 27 fps van. Csökkenő trenddel csökkentsük az fps-t

Akkor egyen 4070 mondjuk 90fps => $549

4060Ti 75fps => $449

4060: 60fps => $349Persze nyilván +/-5 fps ide vagy oda számolható, meg +/- $50 piaci helyzettől függően. Most nem az volt a célom, hogy pontosan belőjem az Nvidia felhozatalt, csak a várható lejtést kívántam belőni.

Tehát ha van egy 60fps-es 4060 $349-ért az már 25%-os előrelépés a 3060-hoz képest, tehát a plebs örülhet, mint majom a farkának és ha ehhez képest $349-ért az egy 65fps-es kártyát kínál valahol $319-349 között úgy, hogy titokban mondjuk 50W-tal többet fogyaszt (pssszt!!!), elmondhatjuk, hogy minden stimmel, mert nagyjából ez szokott történni. És Abu is elmondhatja majd, hogy nem baj, hogy csak $319, mert az Nvidia kártyát sokkkkkkkkkal drágább gyártani és az AMD valójában még úgyis sokkal többet keres egy kártyán, hogy kevesebbért adja. Közben a piacszerzést elfelejtjük, a piaci részesedést pedig tovább magyarázhatjuk a fogyasztási, driver és feature különbségekkel - és ezzel helyreáll a világ rendje.

-

Abu85

HÁZIGAZDA

"Inventories - 4,454 millió"

Az év elején még csak 2,605 millió volt, ami szintén nagyon soknak számít. 1 milliárd dollár alatt az optimális. Láthatóan nem mozog a készlet, csak nő az értéke, vagyis egyre több terméket gyártanak raktárra, és nem tudják eladni a boltok felé, mert nem veszik a kereskedők. Emiatt pont az a bajuk, hogy nem tudják megvenni a felhasználók se, vagyis van egy irdatlan készletük, amit nem tudnak mozgásba hozni.#59836 Busterftw : A piaci részesedést nem az 5 nm fogja változtatni, mert azok a teljes piac 1%-át sem teszik ki. Nagyon kis mennyiségben készülnek ahhoz, hogy beleszóljanak egy olyan piacba, ahol negyedévente 20 millió GPU megy el.

Szerintem csak azért lett nagy az AMD 5 nm-es kapacitása, mert lefoglaltak maguknak egy csomót előre, és közben megvették a Xilinxet. Nekik is volt egy csomó lefoglalva, de végül úgy döntöttek, hogy nem használják fel, így az AMD átvette a szerződött kapacitást a TSMC-től. A TSMC-nek meg igazából mindegy, hogy azon mit gyártanak. Ők akkor is a pénzüknél vannak, ha nem FPGA készül rajtuk, hanem GPU.

-

Abu85

HÁZIGAZDA

Pontosan ez a bajuk. Nincs a boltokban az a brutális készlet, aminek a raktárazását fizetik. Fel van tüntetve a pénzügyi jelentésükbe, hogy ülnek egy irdatlan értékű készleten, ami annyira nem mozog, hogy már a kereskedőkig sem jut el.

Persze lehet filozofálni, hogy ki a hibás, de a kereskedők esetében is érthető, hogy nem szívesen vesznek meg mindent a saját raktárukra a bányászláz és a Covid után. Valószínűleg van egy olyan árszint, aminél megmozdul a készlet, csak még egyik érintett sem érte el a kereskedők alsó ingerküszöbét, hogy gondolkozzanak a beszerzésen.

-

Abu85

HÁZIGAZDA

Pont az a baj, hogy nincsenek tele a boltok a régi GeForce-okkal. Mert a bolt sem veszi meg őket a gyártótól, ezért azok a gyártó raktárában vannak. Ilyen formában a gyártó sem vesz új GPU-t az NV-től, amik az NV raktárában vannak, és ebből nekik van 4 milliárd dollár értékű készletük. Ha lennének a boltban ezek a termékek, akkor az azt jelentené, hogy a piac veszi a raktárakból a termékeket, de pont az a baj, hogy nem veszik, ergo a gyártói raktárakban ragadtak.

#59828 Petykemano : Papíron a partnerek kárpótolva vannak, ha nem adnák el a raktárkészletet. Ha pedig eladják, akkor van némi kompenzáció az AMD felé, de a lényeg, hogy szabadon tudják árazni, és ne féljenek attól, hogy veszteségük keletkezik. Az AMD ezt leírta.

Ha olcsóbbnak látják a terméktől való megszabadulást a megsemmisítéssel, akkor azt is megtehetik. Nyilván itt az a kérdés, hogy a raktár mennyire van tele. Ha annyira nincs, akkor nem érdemes megsemmisíteni a terméket, ha tele van, akkor el lehet rajta gondolkodni. -

Petykemano

veterán

"Mondjuk ehhez képest az RDNA3 több mint 40% eladásokat produkál, az nvidia 55% körüli eladásaival szemben, szóval az hogy most itt megfeszül ez a valaki elég vicces mert piacilag az Nvidia horror árazása és az RDNA3 megfelelő teljesítménye így egyben vonzóvá teszi a vásárlók felé."

Ha a Mindfactory adatokra célzol, akkor ugye érdekes adalék, hogy a MF heti GPU értékesíti adataiból az derül ki, hogy 2022 elején kevesebb eladásuk volt, mint a crypto crash / ETH merge után. Tehát miközben a JPR jelentésekből Q3-ban már zuhanást mutattak ki, a retail jellegű MF eladásai inkább növekedtek.

Ennek persze sok tényezője lehet. Lehet, hogy pl az egyik az, hogy a cryptovaluta bányászat idején a kártyák szinte el se jutottak a retail üzletekig, de legalábbis sokkal gyakrabban volt minden "out of stock".

A korábban általam vizsgált 2022-es adatokhoz képest egy 2020-as MF adatot találtam: [link] Ez 1 hétre szintén ~4000 körüli eladást mutat.

Ebben is az az "érdekes", de ez nem új info, hogy a retail az általad is említett 40-60 piaci részesedést mutatja, nem pedig a JPR jelentésből ismert 10-20 / 90-80 arányt. Ezt csak azért mondom, hogy azt már korábban is megállapítottam, hogy nem a (német Mindfactory) retail szegmensben valósul meg a JPR által jelentett piaci részarány, amiből következtethetnk arra, hogy a hozzánk hasonlók körében sokkal kiegyenlítettebb a mindshare, mint amire a tényleges piaci részesedésből következtetni lehet és a tényleges piaci részesedés inkább az OEM gyártóknál dől el.De erről is sokszor volt már szó, hogy vajon miért. És általában az a magyarázat, hogy

1) A belépőszintű Nvidia kártyák fogyasztása jobb, mert az olcsóbb szegmenseket általában valamilyen továbbvitt átnevezetet lapkával

2) vagy az AMD valamilyen nagyon kiherélt megoldással valósítja meg

3) Vagy az AMD képtelen olyan mennyiségben szállítani, mint amennyire igény lenne.Részleges lefedettség, double-sourcing esetén viszont az OEM-ek valószínűleg buknak bizonyos mennyiségi, vagy termék-portfólió arányhoz kötött kedvezményeket az NVidiánál, amivel végül bukóra jönne ki az ugrálás.

Kompletten AMD-re váltani pedig nyilván kockázatos.NA mindegy, elnézést, ez messzire vitt.

A másik dolog pedig az eladásokra az az, amit szoktam mondogatni, hogy az egyenlőtlenség növekedésével mindig lesz egy egyre szűkülő csoport, akik számára még az egyre dráguló GPU-k is megfizethetők lesznek. Soha nem lesz az, hogy egy bizonyos termék, vagy egy termékszegmens-t egyáltalán senki sem vásárol, mert az túl drága.

"Ami gáz, hogy alig van AIB kártya választék. Míg egyes Nvidia modellekből van vagy 30-40 féle egy helyen addig AMD ből választhatsz 4-5 ből."

Nem tudom, hogy ez mennyire számít. Én nem is nézegetem annyira sűrűn, hogy melyik partner milyen kártyákat készít, egymáshoz képest melyik mennnyire jó. Számomra inkább zavaró lenne, ha egy lapkából 30-40 féle körítés közül kellene választanom. Tényleg van olyan szignifikáns különbség a modellek között, amiért érdemes 30-40-nek léteznie?

Engem az zavar, amikor egy gyártó 100 és 200W-os kártyák esetén is ugyanazt a hűtőt teszi rá kártyára (bizonyára más komponensek újrahasznosítása mellett) és akkor csodálkozunk, hogy a kis prüntyögő kártyák alig olcsóbbak a komolyabb társaiknál.

"A 7900XT-t le kellene dobnia AMD-nek 599 re a 7900XTX-et 899 re."

899 helyett jó lenne az 749-799-nek is.

De én egyre kevésbé bízok abban, hogy az Ada és RDNA3 árazása csak olyan készletkisöprő célú lett volna. Mármint hogy abban, hogy nagyobb mértékű árcsökkentés következne be akárhogyan is állnak az Ampere és RDNA2 készletek.

Lehet, hogy idővel a 4070Ti-t ejtik $100-ral, a 4080-at $200-zal.

Elképzelhető, hogy a Navi31 árazása is csökken $100-ral.Az elmúlt hetek híreiből (Nvidiánál respin, TDP csökkentés, TSMC és más gyártóknál utilizációs mutató csökkenése, stb) mintha azért kiolvasható lenne egyfajta törekedés az költségcsökkentésre, fogyasztói ár mérséklésére. De egyelőre a fenti összegeknél többet nem olvasok ki belőle.

És ez még mindig az az szint lenne, ami alá simán befér a $400-500-os Navi33 és 4060/TI

Persze ha majd ránézünk a Q4-es eladási adatokra, akkor feltehetjük majd a kérdést, hogy miért lenne annyi, hát nem akarnak ezek eladni?

Hm, majd meglátjuk.Sajnos nem hiszem el Abunak, hogy pl a Navi33-mal a AMD piacszerzésre készül, meg hogy azért N6-on gyártják, hogy olcsó tudjon lenni.

A "megfeszülés" jelentőségét én csak abban látom, hogy ha létezne egy rövid határidőn belül ledobható RDNA3+ vagy refresh, vagy v-cache, vagy akármi, akkor az katalizálhatná ezt a lassú egymás alá licitálásos árversenyt. Ha nem nőnek égig a fák, akkor nem lehet egy új valamivel gyorsabb terméket az előzőeknél még drágábban kínálni, hanem lefelé kell tolni a stacket.

10-15 éve legalábbis úgy emlékszem, hogy kb félévente trompfoltak egymásra a gyártók egy-egy új kártyával és az jellemzően árcsökkenést indukált a meglevő portfólión.

-

-

S_x96x_S

addikt

( next-gen konzol )

> Több forgatókönyvet el tudnék képzelni.ez akkora üzlet,

hogy az Intel és az nVidia csak küzdés nélkül nem fogja átengedni az AMD-nek.Bár az AMD-nek nagy esélye van, semmi se garantált.

Ha az Intel CEO, Pat Gelsinger mégis valami eredményt fel tudna mutatni,

akkor az eléggé megnyugtatná az Intel részvényeseket is, hogy jó kezekben van a cég. -

Petykemano

veterán

"értem én hogy Abu it az AMD ben csak pozitívumokat sugall és minden jó ami itt születik, míg az Nvidásba átjön benyögni annyit hogy 549$ lesz a kártya meg ennél szarabb lesz aztán elmegy"

Általában az történik, h abu beharangozza, h az nv kártya drága, vagy szar, az AMD meg mennyivel olcsóbban tudja gyártani, vagy mennyivel jobb és versenyképesebb lesz.

Aztán (vegyük most ezt a 4060ti=3070=$500 pletykát) általában az nv végtermék jobb lesz annál, mint amennyire abu lehúzta (mondjuk a népharag elkerülése végett csak $449-479 lesz, vagy sokkal fogyasztással fog bírni az N6-on gyártott konkurenciával szemben. Egyébként ez se biztos, mert jelen állás szerint a 4060ti-4070ti közötti rész fedéséért az N32 felelhet) és az AMD termék pedig elmarad attól, amennyire.abu felmagasztalta. Nem lesz annyira gyors, többet fogyaszt, vagy nem is lesz annyira olcsó. Az AMD mindig beáraz az nv alá. Aztán csalódás.

(Aztán jön valaki vastag pénztárcábal és kioktatja a csalódottakat, hogy az élet nem mindenkinek fenékig tejfel.) -

Yany

addikt

Amiről fLeSsen kívül még nem nagyon hallottam embert beszélni az pedig a hangoztatott perf/consumption faszaság, ami iszonyat blama, mert ezzel akartak NVIDIA-nál jobban virítani, mert tudták, hogy netto perfben csúnyán lemaradnak. De a legnagyobb pofon épp az lett, hogy ebben is csúnyán kikaptak (kivéve ph tesztekben

). Vagyis a bejelentéskori húzóérvben bukott hatalmasat. Ez pedig azért ciki, mert ebben a kérdésben régóta bőven lenne mit fejlődni. Amióta létezik Tegra, az NV nagyon tudja, hogy kell (legalábbis a konkurens termékekhez képest) hatékonyabb chipet letenni.

). Vagyis a bejelentéskori húzóérvben bukott hatalmasat. Ez pedig azért ciki, mert ebben a kérdésben régóta bőven lenne mit fejlődni. Amióta létezik Tegra, az NV nagyon tudja, hogy kell (legalábbis a konkurens termékekhez képest) hatékonyabb chipet letenni.Akárhogy csűrjük csavarjuk, mindig ott lyukadunk ki, hogy rengeteg dologban fejlődhetne az AMD a köv. generációkkal, de épp nem az fps a baj. Legalábbis nem önmagában.

-

Abu85

HÁZIGAZDA

Nem is klasszikus CPU-limites. Inkább vegyes limit van. A klasszikus CPU-limit az, amikor sorakoznak a VGA-k. Ha nem sorakoznak, de nem skálázódnak annyira, az vegyeslimit.

Én meg isten tudja, hogy hányszor írtam le, hogy az NV hardvereknek nem az a baja, hogy ne tudnának működni, ha a program a root signature-be ment erőforrást, hanem az a bajuk, hogy ha nem így van megírva a program, akkor register flushra kényszerülnek, és ez elveszi a sebességet, amellett, hogy CPU többletterhelést is okoz. De ez játékfüggő. Ha az erőforrás berakható a root signature-be, akkor a flush elkerülhető, és elég csak az ellenőrzést futtatni a CPU-nak a driver által, hogy van-e elég regiszter a bekötéshez. A Fortnite például ilyen program. Tehát meg lehet írni úgy is a játékot, hogy skálázódjon a GeForce hardvereken, csak nem mindig kifizetődő, és az már a motor felépítésétől függ, hogy az-e. Ezért van az, hogy a régi HU-s overhead tesztekben az egyes D3D12 játékokban abszolút nem látszanak a GeForce-ok limitesnek, míg más D3D12 játékokban játékokban elég szar sebességet adnak gyengébb procival. Ez teljesen a játék válogatja, és főleg aszerint, hogy a fejlesztők mennyire tartották be az NVIDIA ajánlásait.

Egyébként attól is függ még, hogy saját memóriamenedzsmentet írtak-e a játékhoz, vagy egyszerűen letöltötték az AMD D3D12MA-ját, és jóvanazúgy, megspóroltak egy év optimalizálást. Ez azért kritikus kérdés, mert a D3D12MA csak a Microsoft ajánlásai szerinti bekötéssel tud működni, a root signature-be kötött erőforrásokat nem támogatja. Ezért nem túl jók a legutóbbi COD játékok GeForce-on, mert az Activision stúdiói leállították a saját memóriamenedzsment fejlesztését, és mindenhova az AMD D3D12MA-t használják. És ezzel jönnek azok a kötöttségek, hogy hiába mondja az NV, hogy nem olyan jó a GeForce-onak, ha nem a root signature-ben van az erőforrás, nem tudják hova helyezni, mert a D3D12MA máshol nem kezeli.

A 7900 XTX az talán pár százalékkal nagyobb sebességet kínálna a HU új tesztjében, mint a 6950XT, mert ott az MDIA. De a tesztelt játékok annyira nem használják ennek előnyeit, tehát maximum 2-3%-ról lenne szó. Kb. úgy nézne ki a teszt, hogy a WD Legion alatt a 4090 tud 90 fps-t a 13100 CPU-val, a 6650XT 98 fps-t, a 6950 XT 99 fps-t, és a 7900XTX tudna 100-101-et.

#59689 Hellwhatever : Kisebb GPU-t viszont használsz hozzá, és ott ugyanúgy létezik ez a jelenség. Alapvetően számolni kell azzal, hogy ha 150 dollár alatti CPU-t használsz, akkor D3D12-re jobb a hasonló árú Radeon, mert kisebb az overheadje a drivernek. De ez nem újdonság. Régóta így van.

-

Abu85

HÁZIGAZDA

Az Ada ebben az Ampere-hez képest nem változott. Az RDNA 2-höz képest az RDNA 3 annyit változott, hogy kevesebb prociidővel is beéri az execute indirectes játékokban.

Ha pedig látni akarod ezt a limitet az Ada és az RDNA 3 esetében, akkor nézzél AC Valhallát, vagy Cod MW2-t. Azok CPU-limitesek, és a Microsoft ajánlásai szerint vannak írva, vagyis az NV-nek nagyon sok többletterhelése lesz a driver emulációs rétegéken intenzív működése miatt.A CPU-limit önmagában nem számít, ha a Microsoft ajánlásaival ellentétben van írva a program. Akkor a GeForce is tud jól működni. Le is írtam a linkelt hsz-ben, hogy miért. Akkor van nagyon erős többletterhelés a GeForce-on, hogy a Microsoft ajánlásai szerint vannak elhelyezve az erőforrások. Ez régen is így volt. A korábbi HU tesztben sem volt mindig driverből mindent verő a Radeon. Bizonyos játékokban volt az. Nyugodtan nézd vissza.

-

Abu85

HÁZIGAZDA

[link] - mert nem olvastad el ezt. Ebben benne van, hogy az NV hardverét is lehet jól működővé tenni, ha az adott motor megszegi a Microsoft ajánlásait, és olyan helyre rakja az erőforrásokat, ahova nagyon nem ajánlott. Ennek megvan a maga baja, de alapvetően megcsinálható. Vannak azonban olyan stúdiók, akik nem tesznek így, például Ubisoft, Infinity Ward, Treyarch, IO interactive, ésatöbbi-ésatöbbi. Ennek ezernyi oka lehet, például akár olyan banális is, hogy egy erőforrásra olyan formátumot használnak, amit nem eszik meg a root signature, tehát akármennyire is követni akarnák az NV ajánlásait, muszáj a Microsoft által javasolt helyére rakni az erőforrást.

Ezért van az, hogy a HU is csak bizonyos D3D12 játékban mér erőteljes limitet, és nem mindenhol. Jellemzően az Ubisoft játékokban, mert azok erőforrás-kezelése teljesen szabványos, ugyanis elég sok olyan formátumot használnak, ami nem tölthető be a root signature-be. Nem tudnak mit tenni ezzel, nem úgy építették fel a motorjaikat, hogy figyelembe vették volna az NV hardverek kényességét, utólag átírni pedig már extrém körülményes lenne, mert minden optimalizálást az aktuális működésre húztak fel. Egyszerűen meg kell várniuk, amíg az NV hoz egy pure bindless hardvert, és akkor az is úgy fog működni, ahogy a Radeonok.

-

Abu85

HÁZIGAZDA

Leírtam már párszor, hogy az RDNA 3-nak a többletterhelése az RDNA 2-nél is kisebb. Emiatt még gyengébb procival is beéri. Ennek az oka, hogy minden olyan előnnyel rendelkezik, amivel az RDNA 2 rendelkezett, és mellé még az MDIA fel tudja venni az execute indirectet alkalmazó játékok parancskötegeit, amikről ad egy információt a drivernek, hogy ha látja a parancsköteget a parancslistában, akkor ne is költsön rá a CPU erőforrást, hanem csak szóljon az MDIA-nak, hogy a GPU-ban letárolt adatot töltse be újra. Ezzel minden ilyen művelet nulla CPU-időt vesz igénybe az RDNA 3-nál. A többi hardver azért bukik ezen, mert nem tudja hol tárolni az előre felvett parancsokat, egyszerűen minden frame során újra meg kell csinálni ugyanazt, míg az RDNA 3 addig csak töltöget, amíg a parancsok ismétlődnek. Tehát az első feldolgozás után minden további ismétlés teljesen ingyenes a CPU oldalán.

Ezt az MDIA-t valószínűleg sokan le fogják másolni a jövőben, mert nem nehéz megvalósítani hardveresen, és elképesztően sokat ér CPU-limites környezetben.

-

Abu85

HÁZIGAZDA

A HU már csinált egy tesztet 4090-nel és 6950XT-vel. [link] - látható, hogy az overhead probléma az erre érzékeny D3D12-es játékokban megmaradt. De ez normális. Ahhoz, hogy ez megváltozzon, az NV-nek pure bindless hardvert kell építeni. Utána ki tudják dobni a driverből a bekötéshez számukra alapvetően szükséges emulátort, ami végeredményben a nagyobb többletterhelést okozza.

-

Abu85

HÁZIGAZDA

Megvan ugyanez a különbség az Ada és az RDNA 3 között is. Annyi, hogy az RDNA 3-nak az MDIA miatt, az RDNA 2-höz viszonyítva még kisebb lett a többletterhelése az execute indirecttel dolgozó D3D12 címekben.

A problémát egyébként leírtam elég részletesen ebben a hsz-ben: [link]

-

Abu85

HÁZIGAZDA

Az 5800X az egy gyors processzornak számít, így csak ott ütközik a GeForce limitbe, ahol nagyon erőteljes az execute indirect használata. Gyengébb procival nyilván nem kellene erőteljes processzorterhelés a játék oldaláról. Ezt egyébként a beállításainkkal eleve igyekszünk kiütni, mert VGA-tesztről van szó, de nem minden játékban sikerül.

Majd csinálunk ilyen CPU-GPU párválasztó tesztet, ahol nem törekszünk erre.

-

HSM

félisten

"Magyarul ott is megmaradt e ez vagy az RDNA3 mar elter a 2-tő."

Ha már találgatós... Nem hinném, hogy eltérne. A blokk alapján maradt a parancskiosztás alapvető felépítése, így a driver sem hinném, hogy jelentősen eltérne, legfeljebb a shader fordítás bonyolódott picit meg a dual-issue miatt.

RDNA2: [link] , RDNA3: [link] . -

HSM

félisten

Tényleg nem értem, mi nem érthető azon, hogy a CPU-t próbálta tesztelni, kiiktatva a GPU limitáló hatását?

De volt ott azért gyengébb VGA is, szemléltetve a reálisabb összeállítást.

De egyébként nekem WQHD alatt is már kevésnek érződött bizonyos címek multijában az R5 3600-asom (kb a tesztbe az 5500 szintje) egy RX6800XT mellett, az 5600-al viszont már kellemes a tempó mindenhol. -

Alogonomus

őstag

Na jó sokáig tartott találnod egy elképzelésednek kedvező értékeket bemutató tesztet.

Csak azt felejtetted el, hogy a 2070 Super és az 5700 XT között nagyjából 25% árkülönbség volt ($400 vs. $500). Az 5700 XT árban a 2060 Super szintjén volt, mivel mindkét kártya $400 volt. Na az 5700 XT vs. 2060 Super kapcsán ott is van az a kényelmes különbség jelenleg. -

Petykemano

veterán

De.

Szal a különbség, hogy az nvidiának még nincs szabadszemmel látható megoldása / opciói arra nézve, hogy miként veszi fel a késztyűt az sram skálázás megállásával, ami miatt racionális elképzelés régebbi, más gyártástechnolóián, más libbel gyártani.De úgy tűnik számomra, hogy a 2D irányú chiplet esetén a növekvő késleltetés túl nagy ár, vagy' legalábbis a méret nehezen kompenzál. Szemben a 3D iránnyal.

-

Petykemano

veterán

-

Petykemano

veterán

Hát.. nem zárom ki, hogy az AMD-közeli hangadóknak lehetett köze a csatlakozó problémáinak felhangosításában, de azt azért kétlem, hogy AMD rajongók direkt vettek volna 4090-et, hogy ők is leégessék a csatlakozót.

A dark-marketing létezik. Ha ehhez volt köze az AMD-nek, akkor nyugodtan mondhatjuk, hogy az összes driveres probléma, "kazán", "hangos", "leolvad", stb unos-untalan visszhangzása Nvidia-közeli profiloktól is ide tartozik. Olyan ez, mint a Megafon - természetesen azokhoz az arcokhoz politikai pártnak semmi köze, ők csupán elkötelezett közeleti hangadók, akik felhangosítják azokat az egyébként valós alapokat nem nélkülöző gondolatokat, amelyek véletlenül épp azoknak hajtanak politikai-hatalmi hasznot, ahonnan több áttételen keresztül finanszírozás érkezik.

Egyébként ez remekül működik.

Mindenesetre ha az AMD "hálózata" igyekezett is felnagyítani a problémákat, az akkor sem magyarázza, hogy miért maradtak el az eredményeik a saját számaiktól.

-

Pahli

tag

Nem értem, hogy miért olyan bonyolult értelmeznie egy rakás embernek, tech csatornáknak a marketing bullshitet.

´Há oda van írva!111! UP TO 1.7x, miért ilyen nehéz ez? Az nem átlag.

Nyilván olyan játékokon tesztelnek, olyan beállítások mellett, ahol kaptak AKÁR 70% upliftet, ennyi.

Amúgy meg ha azt szeretnénk megkapni hogy X az mennyivel gyorsabb mint Y, akkor nem lehet a 7900xtx a baseline, hisz ha 6950xt 73% a 7900xtx 100%-hoz képest, ott a 6950xt 27%-kal lassabb. Ezért van hogy a 6950xt-nek kéne lennie amihez viszonyítom, mert úgy viszont a 7900xtx 37%-kal gyorsabb mint a 6950xt. És ha pont olyan beállításokon, játékokkal tesztelnék tuti, hogy megkapná mindenki a 50% upliftet, kerekítéssel, vagy ahhoz nagyon közelit. És az a középérték mi pontosan, mer ha módusz akkor simán.

Amúgy meg arról semmilyen cég nem tehet, hogy a saját vásárlóbázisa nem tudja rendesen üzembe helyezni a 2000+ Eurós hardverét. User error. -

szmörlock007

aktív tag

Nvidia hype kell? Nesztek, adok én

Rumor: NVIDIA RTX 50 Series ‘Blackwell’ GPUs Will Bring Biggest Performance Leap In NVIDIA’s History

Viccet félretéve nyilván ahogy írtam ezek csak pletyik, hogy legyen min csámcsogni. Én Koduri miatt már amúgy is intelnek drukkolok gpu fronton

Épülget a csapat

: https://www.tomshardware.com/news/vivian-lien-joins-intel-to-build-arc-discrete-graphics-business

: https://www.tomshardware.com/news/vivian-lien-joins-intel-to-build-arc-discrete-graphics-business -

S_x96x_S

addikt

> El kell engedni egyelőre ezeket a hype, kamu dolgokat

szerintem meg össze kell vetni a következő gen-es nVidia és Intel ARC - hájpokkal.

amúgy néha érdekes jóslatok is vannak, ha visszanézzük.

pl. hogy az RTX 4080 csak 2023-ra csúszik .. Ez se jött be ...> ráadásul féláron lesz ahhoz nézve amennyiért

> a zöldek tudják majd gyártani és így tovább..ez még bejöhet ..

habár az RDNA3-ban sokkal több memória van ..

amit azért nem adnak ingyen. -

#36531588

törölt tag

"nem a Dx12 implementáció az oka amit írt Abu, hanem a stabil működés."

Pont az MW2-vel példálózott, hogy az MDIA miatt van a remek teljesítmény, közben pedig csak egy bug. Gondolom addig tesztelték míg elkaptak egy jó "szériát" amikor éppen szárnyalt a gpu, és Abu egyből lecsapott rá.

-

GeryFlash

veterán

Twitteren vannak olyan spekulaciok hogy egy adott teljesitmeny szintet neztek 100%-nak, tehat mondjuk a 6950XT-t overclockoltak addig amig megutotte az uj kartyak szintjet (esetleg azokat emg power limitiltek) es akkor kijon mestersegesen az 50%. Csak hogy a valosagban ezeket a kartyakat nem igy hasznaljak.

-

Abu85

HÁZIGAZDA

Review guide-ban. Ha publikussá teszik, akkor el lehet olvasni. Én nem tehetem azzá. Viszont valóban megvannak az eredmények, ha ugyanazokat a beállításokat futtatod, akkor ugyanazt kapod ugyanazon a konfigon.

Mivel ezek üzletileg is lényeges kijelentések, így nyilván megvan az alapja az egésznek, hiszen ha nem lenne, akkor az AMD-t beperelhetnék a részvényesek.

De egyébként ha egy programra vetíted le, akkor tudok olyan programot és beállítást, amiben kihozok neked 80%-os perf/watt javulást is. Elég kihasználni azt, hogy az RNDA 2-nek kétharmadnyi regiszterterülete van, és belefuttatni a dizájnt egy kihasználtságlimitbe, ami az RDNA 3-at a több regisztere miatt nem fogja érinteni. Nehogy azt hidd, hogy ez annyira nehéz.

-

-

Abu85

HÁZIGAZDA

A régebbi Radeonok a jobb DirectX 12-es driver miatt verik el benne a régebbi GeForce-okat. Abban a szituációban, amiben a CoD van, az számít, hogy mekkora a meghajtó többletterhelése, és a GeForce drivernek viszonylag sok, míg a Radeon drivernek viszonylag kevés. Az RDNA 3 ezen annyiban javít, hogy bizonyos parancsokra már nincs is a drivernek többletterhelése, tehát még többet tud ebből a koncepcióból kihozni. Ezért tud ennyire nagyon elhúzni.

-

-

2xar

tag

Már hogy kapnál több FPS-t a felbontás emelésétől? Legfeljebb nem csökken, ha CPU limitben vagy.

Az XT árazása teljesen értelmezhetetlen. Valahol 700 USD körül kéne legyen, figyelembe véve az inflációt is, a bányászláz hatásait stb. A 900 USD-s ár simán csak upselling, hogy mindenki XTX-et vegyen. Ahogy Nv-nél a 4080.

De szerintem nem marad egyik se sokáig így. Jól megfejik az early adopter-eket, rávezetve őket a 4090/XTX-re, majd 1-2 hónap és ejtik 2-300 USD-vel a 4080/XT árát. -

Abu85

HÁZIGAZDA

Az NV nagyobbal dolgozik, mert nem állnak annyi lábon, mint az AMD, így muszáj nagyobb marzzsal menniük a GPU-knál, amíg beindulnak a fontos, de ma még picike üzletágak. Az AMD-nek csak hasznos a nagy marzs, de nem kritikus, mert nekik ott az EPYC és a Xilinx.

Viszont a dolog annyiban nem számít, hogy ha árcsökkentés kell, akkor nyilván nem az AIB fog többet engedni, hanem a GPU beszállítója. -

-

Petykemano

veterán

igen, az gyanúsan alacsony volt. Ez se olyan hűdesok...

BTW: ha már az órajelnél tartunk. Olvastam olyan véleményt, hogy ez a respin történet kacsa, copium/hopium.

Viszont akkor hová lettek a 3+Ghz-ek?

Tipp:

Nem állítom persze, hogy igazam van, de remekül magyarázná, ha az AMD minden architektúrából kettőt készítene. Egyet high Density library-val, ami kisebb, olcsóbb, nem ér el olyan magas frekvenciát és egyet High Performance Library-vel, ami értelemszerűen nagyobb 25-30%-kal, ezért drágábbra jön ki, de mondjuk 25-30%-kal is magasabb lehet maximális frekvencia is, ami nagyjából megfelel egy szokásos tier különbségnek.

Nem csak azt magyarázná, miért tud abu merőben más Navi33 lapkaméretről, mint SkyJuice, de azt is, hogy hová tűntek a 3+Ghz-ek.Szerintem ravasz húzás lenne, de lehet, hogy tényleg csak az van, amit látunk.

-

PuMbA

titán

A kérdés az az, hogy hogy csinálják ezt meg a 7600XT 8GB VRAM-jával és a 128bites busszal? 8GB VRAM már most kezd kevés lenni a középkategóriában és az alsó kategóriához tartozik. RT-hez pedig egy 350GB/s körüli memóriasávszélesség a minimum, hogy normális sebességgel fusson a mai kártyákból kiindulva.

-

Abu85

HÁZIGAZDA

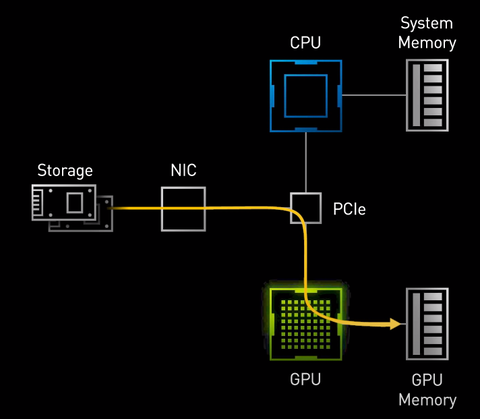

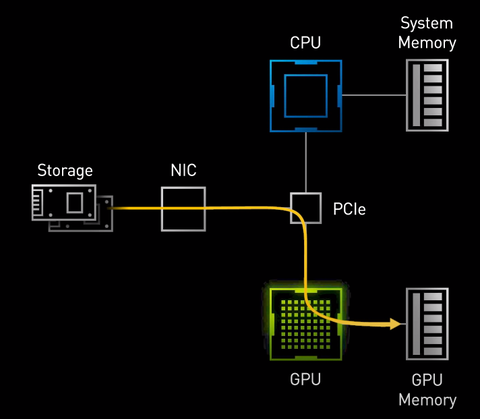

Ezen a képen világosan látszik, hogy minek indult:

Na most végül nem ilyen lett. Az RTX IO a DirectStorage-et akarta optimálisabban megoldani, mert amúgy tényleg be lehet ám olvasni közvetlenül az NVMe meghajtóról az adatot, és akkor nem kell tenni kitérőt a rendszermemóriáig, de ahhoz, hogy ezt megtegyék a gyártók, szükségük van egy olyan CPU mikrokódra, ami támogatja azt, hogy a GPU a CPU mellett NVMe parancsokat hív meg. Erre kell egy szinkronizáció, mert szar dolog, ha a CPU és a GPU nem tud egymásról, miközben ugyanazt az adattárolót kezelik. Erre CPU mikrokódot az AMD és az Intel tud kiadni egy új BIOS formájában, de ezt nem tudta elérni az NV, mert nem érdeke egyik cégnek sem az, hogy az NV-nek az egyedi igényeivel foglalkozzon. Valószínűleg amúgy maguknak meg fogják csinálni, és ha az NV akar, akkor ahhoz a mikrokódhoz alkalmazkodhat, ahogy például a ReBAR implementációjuk is alkalmazkodik az AMD és az Intel mikrokódjához. Csak úgy nem is olyan hatékony, mint amilyen implementációval házon belül elő lehet állni.

Ha meg a GDelfate-re gondolsz, az csak egy formátum, amit a Microsoft alapértelmezetten beépített. De nem kötelező azt használni. Sőt, az első DirectStorage játék egyedi formátumot fog használni. A GDeflate-hez hozzá sem nyúl. Ez azért van, mert a Microsoft lehetővé tette azt is, hogy a fejlesztők egyéni formátumot is definiálhassanak. Nem egyet, hanem akármennyit.

Ez a DirectStorage formátumkezelése:

enum DSTORAGE_COMPRESSION_FORMAT {

DSTORAGE_COMPRESSION_FORMAT_NONE = 0,

DSTORAGE_COMPRESSION_FORMAT_GDEFLATE = 1,

DSTORAGE_CUSTOM_COMPRESSION_0 = 0x80

} ;Ebből a DSTORAGE_CUSTOM_COMPRESSION_0 teszi lehetővé egy egyedi formátum használatát. És ahány egyedi formátum van, annyiszor kell ezt definiálni, tehát így: DSTORAGE_CUSTOM_COMPRESSION_0, DSTORAGE_CUSTOM_COMPRESSION_0 + 1, DSTORAGE_CUSTOM_COMPRESSION_0 + 2, stb.

-

Abu85

HÁZIGAZDA

Egyrészt az NV-nél sem csak a PC gaming a Gaming, mert ott van náluk a cloud elkönyvelve, másrészt az AMD-nél a konzol nem változó bevétel. Stabilan fix összegeket hoz össze ugyanabban a negyedévekben. Ennek az oka, hogy a Microsoft és a Sony rendelései nem nőnek. Sőt, inkább csökkenni szoktak, de ugye ezeket kompenzálja az AMD-nél a PC Gaming eladás.

Nem kell kukázni semmit, csak maga az Unreal Engine 5 nem tudja futtatni a DXR effekteket és a Nanite-ot együtt. Nem képes rá a motor, mert a két eljárás nem kompatibilis egymással. Egy fallback mód van beépítve erre, így ha a fejlesztő bekapcsolja a DXR-t, akkor a Nanite a fallback meshre kapcsol át.

-

T.Peter

őstag

Nekem leirhatnad, hogy merre nyitott, mert most igy hirtelen fogalmam sincs mire gondolsz. Az omniverse es a plugin-ek eddig is elerhetoek voltak, UE4-hez is, nem? Gyors kereses alapjan ugy tunik nekem. Szoval itt sem tudom mire gondolsz.

Amugy nincs itt semmi latnivalo, a hw ray tracing opcio ott van az engine-ben, azt bekapcsolva nanite fallback mesh-t fog hasznalni es ennyi. Mas kerdes, hogy az sw ray tracing van olyan allapotban hogy nem feltetlenul eri meg atkapcsolni.

-

Petykemano

veterán

Nem értem, mit nem értesz.

Azt Te is elismered, hogy az egy létező jelenség, hogy az egyik gyártó hardvere valamiben számottevően jobb, mint a másik. Ez régen például a tesszeláció volt, most például az RT.Azt gondolom ez alapján, Te is érted, hogy össze lehet hozni abból a feladattípusból annyi mennyiséget, ami az erősebb hardver és a gyengébb hardver számára is elfogadható időn belül (ami mivel párhuzamosságról beszélünk, akár lehet közel ugyanannyi is) elvégezhető. Ez persze azt jelenti, hogy az erősebb hardverelem ebben az esetben feleslegesen erősebb.

És össze lehet hozni annyi mennyiségű feladatot is, amelynek végrehajtása az erősebb hardverelem számára még éppen nem megterhelő, viszont a gyengébbik azzal már sokat szöszmötöl, és az összteljesítmény dadogni kezd.A kérdésem az, hogy ezt az eszközt lehet-e majd épp arra használni, hogy kimérjék, hogy mi az a feladatmennyiség, ami az erősebb hardver számára még elfogadható, a gyengébbik meg dadogni kezd tőle.

Mondok egy példát.

Pisti és Béla kiváló értelmi képességű gyerekek, de Béla évvesztes és egy fél fejjel magasabb és erősebb testalkatú az igazi nyominger szemüveges Pistikénél. Pisti és Béla apukái kompetitív alkatok és nagyon szeretnék, ha a saját gyerekük lenne az osztályelső. Mindketten jelentkeznek a szülői munkaközösségbe, hogy beleszólásuk legyen az osztály és az iskola életébe.

Az első szmk-s értekezleten felvetődik, hogy csináljanak-e egy szekrényt a gyerekeknek, ahová a tancuccaikat betehetik, vagy kelljen-e inkább minden könyvet és füzetet minden nap behordani. Béla apukája takarékosságra int és felhívja a figyelmet, mennyire fontos a megfelelő fizikai erőnlét. Pistike apukája hiába érvel gerincferdüléssel, sajnos a közösség Béla apjának érveit fogadja el. (Nem tudhatjuk hogy ebben szerepet játszott-e a pogácsás kosárka, amit az értekezletre hozott)Innentől kezdve minden gyerek cipeli a táskákat és míg Béla elbírja a 15kg-os táskát, Pistike meg igazi nyominger és nem, ezért hiába cipelik a szülei az iskoláig a táskát, a kaputól a teremig és bármilyen teremváltás esetén is a földön ráncigálva képes csak megoldani. Emiatt persze nincs ideje elfogyasztani a reggelit, néha el is késik az óráról, amit a tanítónéni nem mindig ír be, de ahát azért a magatartás jegye emiatt már csak négyes. Az éhségtől gyakran nem tud figyelni, az is előfordult már, hogy akkorát korgott a gyomra, hogy osztálytársai kinevették. A késések miatt rövidebb ideje marad a dolgozatra, ami meg is látszik a jegyein. Vagy akár az is előfordul, hogy azért kap egyest, mert az óra első 5 percében írt 3 kérdéses röpdolgozaton nem tudott részt venni. Pisti egyre távolabb és távolabb kerül az osztályelsőségtől.

Esetleg így érthető?

-

HSM

félisten

"- a 7900XT egy átnevezett 7800XT (á la 4080 12GB, ami szvsz még 4070Ti néven is átverés), az elődjéhez (6800XT) képest $250-al drágábban"

Egyébként szerintem annyiból jogos a 7900-as "átnevezés", hogy a 8-as kategória általában a 256 bites kártyákat jelentette AMD-nél. A 7900-asok határozottan feljebb léptek ebben a tekintetben pl. a 6800-asoktól, ami csak 256 bites volt. Persze, ott is kellett a 6900, mint elnevezés, ami eléggé kilógott. A korábbi nevezéktan alapján annak illett volna 6800 XTX-nek lenni.

A 4080 12GB vs. 16GB esetén nincs is miről beszélni, más GPU is lett volna a 12-es, ők is belátták, hogy ez így nem oké...

-

2xar

tag

Fél napon keresztül érveltél amellett, hogy téged idézve:

"Nem tartom szerencsésnek, hasonlóan megtévesztő számomra [az XT és XTX elnevezés] mint Nvidiánál pusztán a Vram mennyiségével megkülönböztetni egy kártya teljesítményét."Ugyanerről szólt a fenti kommentem első pontja is, csak a másik irányból megközelítve. Nem ahhoz a kártyához viszonyítva, amihez a nevével közelebb lett tolva, hanem aminek normál esetben hívni kellett volna:

"a 7900XT egy átnevezett 7800XT (á la 4080 12GB, ami szvsz még 4070Ti néven is átverés), az elődjéhez (6800XT) képest $250-al drágábban"Erre a hsz-re annyit válaszoltál, hogy:

"jé,nem csak én gondolom akkor így .![;]](//cdn.rios.hu/dl/s/v1.gif) "

"Ezek után nem érted, hogy kerül ide az Nv...

Hát remélem most már érted."Vs ehhez a témához hosszú sorokon át kifejtve milyen fos cég stb míg AMD a félisten akit védeni kell. Mint minden AMD párti hozzászóló..."

Miért személyeskedsz?

Minden amit leírtam teljesen objektív és tényszerű, érvekkel alátámasztva. Objektív TÉNY, hogy az Nv eljárása a nevezéktanban most átverés volt. SOKKAL nagyobb megtévesztés, mint amit az AMD csinált. A "pofátlan" jelzőt ezért objektíve kiérdemelték. Nem volt véletlen az elsöprő elégedetlenség amit kaptak, ami miatt vissza is kellett vonják a nevet.Személy szerint pedig az elmúlt 20 évben kb ugyanannyi Nv kártyám volt mint ATI/AMD. Mint pl. jelenleg is. Mindig az ár/érték szerinti jobb kártyát választottam és fogom is. De ettől még felismerhetem és megjegyezhetem ha egyik vagy másik gyártó épp pofátlanul át akar verni. Vagy ez tilos?

Ha valamelyik gyártótól van egy kártyám, akkor azt a gyártót kötelezően meg kell védenem és minden aljas húzását meg kell bocsátanom, sőt meg kell védenem?

Ha valamelyik gyártótól van egy kártyám, akkor azt a gyártót kötelezően meg kell védenem és minden aljas húzását meg kell bocsátanom, sőt meg kell védenem?"...a fő érv az AMD mellett hogy Nvidia milyen fos és hogy azért drága egy AMD kártya mert Nvidia feláraz .. What?"

Ilyet nem írtam. Nem szép dolog a szalmabábozás, inkább ne csináld kérlek.

-

2xar

tag

Sztem azért van különbség a kettő között: az Nv mint mindent, ezt is sokkal pofátlanabbul, tenyérbemászóbban csinálta. Nem véletlen hogy ők kénytelenek voltak változtatni az elnevezésen, míg az AMD-t senki nem nagyon basztatja emiatt.

Egyrészt az AMD nem csak a memória mennyiségével különbözteti meg a két kártyát, hanem a név végződésével is, ami mindkét gyártónál hagyományosan utal arra, hogy a GPU-k teljesítménye is eltér, nem csak a memória mennyisége.

Másrészt, a 4080 12Gb vs 16GB között elég nagy szakadék tátong, 24-30% az Nv szerint is. Az 7900XT vs XTX között még nem tudjuk pontosan, de valszeg inkább csak 5-15% különbség lesz. Nagyon max. 20%.

Harmadrészt az XT és az XTX legalább ugyanarra a die-ra (Navi31) épülnek, ezzel feljogosítva az AMD-t, hogy ugyanazt az alap elnevezést használja rájuk. Ezzel szemben az Nv két teljesen különböző die-ra (AD103 vs. AD104) épülő kártyát próbált ugyanazon név alá beszuszakolni.

+ Bónusz: az Nv másodjára is átverős nevet adott a kártyának. Azt a GPU-t 4060 (TI), vagy legfeljebb sima 4070-ként kellene árulják. Majd meglátjuk persze a teszteredményeket, de ha csak azt nézzük, hogy az előző genből a legnagyobb 192 bites kártya a sima 3060 volt, akkor a 192 bites AD104-nek még a "4070 TI" név is igencsak bicskanyitogató...

De ezektől eltekintve, a két helyzet között tényleg van hasonlóság. Mindkét gyártó a reális teljesítményéhez képest egy tier-rel feljebbre (igazából az Nv inkább 2-vel) pozícionálta a leggyengébb új GPU-ját, mind árban, mind pedig elnevezésben. Remélem az emberek nem lesznek olyan hülyék hogy bedőlnek nekik és messze elkerülik ezeket a termékeket.

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- Felújított laptopok Számlával, garanciával! Ingyen Foxpost!

- LG 65QNED87T / 65" - 164 cm QNED / 4K UHD / 120Hz & 3ms / HDR 10 Pro / FreeSync Premium / HDMI 2.1

- Samsung Galaxy S21 FE 128GB, Kártyafüggetlen, 1 Év Garanciával

- Készpénzes számítógép PC félkonfig alkatrész hardver felvásárlás személyesen / postával korrekt áron

- Telefon felvásárlás!! iPhone 13 Mini/iPhone 13/iPhone 13 Pro/iPhone 13 Pro Max/

Állásajánlatok

Cég: CAMERA-PRO Hungary Kft

Város: Budapest

Cég: PC Trade Systems Kft.

Város: Szeged

A 4070 Ti L2-je ugye 48MB, akkor szerintem a 4060-é 32MB-ra várható, ahogy az AMD Infinity Cache-e is jelenleg ennyi a 6600XT-nél. Még mindig ott vagyunk, hogy erősebb GPU-val, de azonos memória sávszélességgel memória sávszélesség limitált játékokban nem fogja elérni a Navi 33 a 6700XT sebességét. A 3060 8GB is a 3050 8GB sebességét hozza memória sávszélesség limitált játékokban, hiába az erősebb GPU. A lényeg, hogy itt nem a GPU lesz a lényeg, mert az elég erős lesz. A kérdés, hogy a memória sávszélesség mennyire "hajtja ki" a GPU-t.

A 4070 Ti L2-je ugye 48MB, akkor szerintem a 4060-é 32MB-ra várható, ahogy az AMD Infinity Cache-e is jelenleg ennyi a 6600XT-nél. Még mindig ott vagyunk, hogy erősebb GPU-val, de azonos memória sávszélességgel memória sávszélesség limitált játékokban nem fogja elérni a Navi 33 a 6700XT sebességét. A 3060 8GB is a 3050 8GB sebességét hozza memória sávszélesség limitált játékokban, hiába az erősebb GPU. A lényeg, hogy itt nem a GPU lesz a lényeg, mert az elég erős lesz. A kérdés, hogy a memória sávszélesség mennyire "hajtja ki" a GPU-t.

![;]](http://cdn.rios.hu/dl/s/v1.gif)