- Apple iPhone 15 Pro Max - Attack on Titan

- Poco F5 - pokolian jó ajánlat

- Xiaomi 15 Ultra - kamera, telefon

- Azonnali mobilos kérdések órája

- Nothing Phone (3a) és (3a) Pro - az ügyes meg sasszemű

- A Samsung gyártja az első 2 nm-es Qualcomm lapkát?

- Garmin Forerunner 970 - fogd a pénzt, és fuss!

- Apple Watch Ultra - első nekifutás

- Egyszerre legnagyobb és legkisebb is a Garmin Venu X1

- Xiaomi 14T - nem baj, hogy nem Pro

-

Mobilarena

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

PuMbA

titán

válasz

Yutani

#65695

üzenetére

Yutani

#65695

üzenetére

Micsoda hírek napról napra! Ez most a belátások időszaka. Az AMD látja, hogy az NVIDIA végig jól csinálta a Tensor magokkal történő GPU felépítést

A Reflex-szel is igaza lett az NVIDIA-nak, amit meg az Anti-lag 2 óta tudunk. Már várom, hogy az FSR is mikor fog átvariálódni a konkurenciák mintájára.

A Reflex-szel is igaza lett az NVIDIA-nak, amit meg az Anti-lag 2 óta tudunk. Már várom, hogy az FSR is mikor fog átvariálódni a konkurenciák mintájára. -

PuMbA

titán

válasz

Yutani

#65233

üzenetére

Yutani

#65233

üzenetére

Igen, de akkor ne "for the gamers"-ezzenek, ha ők adják nagyobb profittal a kártyáikat, mint az NVIDIA

Gondolom Scott Herkelman-nak már elege volt az erőltetett mosolygásból meg a kamu szövegből, amit alig bírt leplezni az RDNA3 bemutatón. Meg is érdemlik így a 10%-ot a VGA piacon.

Gondolom Scott Herkelman-nak már elege volt az erőltetett mosolygásból meg a kamu szövegből, amit alig bírt leplezni az RDNA3 bemutatón. Meg is érdemlik így a 10%-ot a VGA piacon. -

Alogonomus

őstag

válasz

Yutani

#65207

üzenetére

Yutani

#65207

üzenetére

A PCI-Express akkor jelent komolyabb korlátozást, ha a VRAM kevés. 4 GB-os csak nem lesz még a 7300 sem, 6 GB-ig pedig a legtöbb játék "lebutítható".

Navi 34-ről nem olvastam híreket, így a 7300/7400 is valami Navi 33 kártya lehet majd, csak csökkentett teljesítményű változatban. A csökkentés oka lehet majd pár CUP "egység" letiltása, de lehet inkább minden CUP "egység" alacsonyabb – még stabil – órajelen üzemelése.

A legvalószínűbbnek azt érzem, hogy a 7300 és 7400 a mobilpiacon végül annyira nem kelendő 7600S , 7600M, 7600M XT és 7700S asztali verziós válozata lesz. -

Jacek

veterán

válasz

Yutani

#65038

üzenetére

Yutani

#65038

üzenetére

Hype: Nálam a 7900XTX teljesítmény, ADA szintű RT és 500 dollár a hihwtwtlwn kategoria

már csak a wunderdriver hiányzik az elméletből.

már csak a wunderdriver hiányzik az elméletből.

Real: Lesz egy kártya kicsit jobb RT-vel nem éri el az ADA-t, 7900XT teljesítményű és 650 dollár Pont mint egy 7900XT

Pont mint egy 7900XT  10%+ RT és -20W fogyi.

10%+ RT és -20W fogyi. -

Abu85

HÁZIGAZDA

válasz

Yutani

#65018

üzenetére

Yutani

#65018

üzenetére

Azzal a jellegű problémával, amivel például a Nanite szembesül a hw-es megoldás nem is futna egyáltalán, hacsak nem butítod a geometriát hozzá a bejáráshoz. Egyszerűen nincs meg hozzá a GPU-kban a memória. Szóval itt nem egy méregethető különbségről van szó, hanem aki sw-es megoldást alkalmaz a folyamatossághoz, az azért alkalmazza, mert a hw-es sebessége az 1 fps-t sem érné el.

Nyilván az Ubisoftnak is sokkal egyszerűbb lenne a DXR-re építenie kizárólag, de egyszerűen az 1 fps sincs meg vele, ezért kell a programozható bejárás nekik, amivel meg megvan a 60-120 fps is hardvertől függően. Az Avatar játék tipikus problémája az, hogy a geometriai részletessége messze meghaladja egy átlagos játék szintjét, és ha azt elkezdenék bedobni a memóriába, akkor a VRAM terhelése 50-60 GB lenne. Nincs olyan GPU, ami ezt elviselné. Persze streaminggel összeraknák, de csak diavetítésre lenne jó, hiába számolja a hardver a sugárkövetést. Éppen ezért alkalmaznak olyan szoftveres megodlást, amivel ezt a VRAM terhelést 2-3 GB környékére csökketnik. Így ugyan az ALU-k számolnak, de nem 32 GB/s-os sebességgel lesz etetve a 600-900 GB/s-ra optimalizált GPU.

Ezt sokan nem értik meg. Cseszheted a hardvert, ha a programozhatóság hiánya 32 GB/s-ra korlátozza a memóriaelérést.#65020 paprobert : Persze, hogy használhatatlan a mostani VGA-kon. Nincs elég VRAM-juk hozzá. De ezen később segít a több VRAM.

Teljesen mindegy, hogy a VRAM sebessége mennyit gyorsul. A DXR jelenlegi működését az korlátozza le, hogy a sugár kilövésének pillanatában nem tudod, hogy az mit talál el. Éppen ezért nem tudod meghatározni, hogy a sugár kilövésekor milyen LOD szintet állítsd be az egyes objektumoknak. Ha túl alacsonyat állítasz, akkor szar lesz az eredmény, ha túl magasat, akkor pedig be kell tölteni a teljes modellet úgy is, ha csak 10 pixelt foglal el a képernyőn, vagy rosszabb esetben nem is látszik. Most elkezded DXR-rel betölteni a max LOD-ot, mert kényszerülsz rá programozhatóság hiányában, és így a GPU adatelérése 32 GB/s lesz, mert a PCI Express sáv fogja ezt korlátozni, hiszen nincs elég VRAM, hogy minden ott legyen a GPU mellett. Rakhatsz rá 4-5 TB/s-os memóriát is, akkor is 32 GB/s lesz a rendszermemória elérése.

A programozhatóság pont ezt a problémát üti ki. Nem kell a sugár kilövésének pillanatában meghatározni a LOD szintet, elég akkor, ha a sugár egy adott dobozba belép. Minél távolabb van a doboz a kamerától, annál kisebb részletesség kell, így lehet spórolni a VRAM-mal, vagyis nem kell küzdeni azzal, hogy elfogy, és nem lesz ettől 32 GB/s-ra korlátozva a munka.

És az teljesen mindegy, hogy lassabb maga a bejárási lépcső, ha közben az összes másik lépcső fényévekkel gyorsabb a memória jobb felhasználása miatt. Összességében ettől sokkal gyorsabb lesz a programozhatóság. Azért ezt az Avatar vastagon bizonyítja, ott annyira gyors maga a sugárkövetés, hogy ki sem lehet kapcsolni. Nem kell, mert nem akadályozza a sebességet a DXR masszív limitációs hatása.

#65021 T.Peter : Nyilván nincs ott a DXR masszív korlátozó hatása, ami az UE5-nek elég problémás. A Fortnite geometriai részletessége lófasz. Meg sem közelíti azt a határt, ahol a DXR kifutna a VRAM-ból. De ha ugyanez Avatarban lenne megoldva, akkor nem is lenne ott a hardveres mód, ahogy például a Hellblade 2-ben sincs ott. Egyszerűen nagyjából 30 GB lenne a VRAM terhelése. Nincs elég memória a VGA-kon hozzá. Az meg nem sokat ér, ha az adatelérés 32 GB/s-ra esne vissza.

És miért dönthet úgy, hogy a szoftveres használja (ami default engedélyezve van)? Mert gyorsabb. Túl pici a háromszög, hogy a hardveres megoldás gyorsabb legyen. És ez egy olyan jellegű működés, ami rosszabb lesz a jövőben, mert még kisebbek lesznek a háromszöget, hiszen már az UE5 tudja kezelni. És minél részletesebb a geometriai váz, annál inkább a szoftveres raszter fog dominálni benne. Márpedig a részeltesség nőni fog, és ez egyre inkább kiszorítja a hardveres rasztert. Itt is visszatértünk oda, hogy egy ideig jó volt a fixfunkciós hardver, de már most látszik, hogy van olyan tipikus körülmény, ahol annyira részletes a geometria, hogy túl lassú vele, és a szoftveres megoldás gyorsabb.

-

Abu85

HÁZIGAZDA

válasz

Yutani

#65015

üzenetére

Yutani

#65015

üzenetére

Sajnos ez nem ilyen egyszerű. Egyszerűen a Nanite-hoz hasonló geometriai háttér nem is megvalósítható DXR-rel. Nem vélelten, hogy az Epic default szoftveres RT-t használ. Valamelyest hasonló koncepció a Nanite-hoz az Ubisoft Snowdrop 2, de nem annyira kifinomult, mint az Epic megoldása. De az Ubisoft már eljutott addig, hogy hardveres RT-t használjon rajta, anélkül, hogy lebutított geometrián futna a rendszer. Viszont a részletesség miatt muszáj volt programozható bejárást használni, így a hardverbe épített BVH gyorsítókhoz nem tudnak hozzányúlni. Cserébe sokkal gyorsabban fut, mintha hozzányúlnának.

Mondom ez hasonló irány, amit már egyszer átéltünk a T&L-nél. Először jött a fixfunkciós hardver, aztán gyorsan el is tűnt, mert a programozhatóság hasznosabb volt.

#65016 b. : A Sony API-ja default programozható bejárást alkalmaz. Ők ezt nem tudják már megkerülni, és nem is fogják, hiszen miért is fejlődnének visszafelé egy fixfunkciós gyorsítóval. Nem is tudna futni rajta az összes kiadott játék, mert az API nem ismeri.

Mert a DXR mellőzése a gyenge pontokon, mint például fixfunkciós bejárás, pont azt a célt szolgálja, hogy az összes, ismétlem az összes hardveren gyorsabb legyen a sugárkövetés. Ez el van baszva a DXR-ben, és szarul lett kialakítva az egész hardveres háttér hozzá, amit a fejlesztők különböző kerülőutakkal és szoftveres megoldásokkal próbálnak menedzselni. Nem véletlen, hogy a konzoloknál ez programozható, ami a DXR-nél nem az. Így a hatékonyabb, mert programozhatod azt, hogy ki tudd vágni azt a geometriát, ami nincs is rajta a képkockán. DXR-ben erre nem vagy képes, egyszerűen számolod a nem látható dolgokat is. Nyilván masszív hátrányt jelent, hiszen egy programozható rendszer megszabadul ezektől a számításoktól.

Erre a problémára reflektálnak ezek az új tanulmányok, de nem tudod megcsinálni ezt fixfunkciós BVH részegységekkel, mert nem tudod őket programozni. Ahogy írtam az egész kísértetiesen hasonlít a hw T&L-re. Ahol jött egy újítás, nagyon ütött, de masszív limitjei voltak, így a hardver a következő generációra el is tűnt, helyére jött a programozható ALU. Sokszor van az, hogy a fejlődést nem egy extra hardverelem adja, hanem annak az elvétele. Ennek van is definíciója: Wheel of reincarnation: Term used to refer to a well-known effect whereby function in a computing system family is migrated out to special-purpose peripheral hardware for speed, then the peripheral evolves toward more computing power as it does its job, then somebody notices that it is inefficient to support two asymmetrical processors in the architecture and folds the function back into the main CPU, at which point the cycle begins again. Several iterations of this cycle have been observed in graphics-processor design, and at least one or two in communications and floating-point processors.

Ha megnézed egyébként, hogy mi történik az Unreal Engine 5-ben, akkor láthatod, hogy a hardveres raszterizálás is szoftveresre vált. Tehát hiába van ott a GPU-kban egy rakás raszter motor, az Unreal Engine 5 compute shader raszterizálást használ a Nanite-hoz. Nem azért, hogy lassítsanak a teljesítményen, hanem azért, mert így a gyorsabb, hiába a fixfunkciós extra hardver, meg anyámkínja. Sőt, ez még fejlődni fog, mert a Work Graphs API pont a kapcsolódó a problémákra fókuszál, tehát egyre többen fognak majd szoftveres raszterizálást választani. Annak ellenére, hogy a hardveres raszterizáló még egy darabig ott lesz a GPU-kban. Az új leképeződizájnokban a szoftveres már gyorsabb, és teljesen mindegy, hogy erre van egy extra erőforrás a hardverben.

-

Jacek

veterán

válasz

Yutani

#64954

üzenetére

Yutani

#64954

üzenetére

Probléma mindig ott van hogy minden ilyen ugrás 40-50k

És már sajnálok sok pénzt kiadni GPU-ra, sokat állna a gépben feleslegesen.

Igen nekem optimális aTi Super lenne de annyit nem akarok bele rakni már az már amit tudok legolcsobb 280e.

Inkább régi RT nélküli cucokkal tolom legoptimálisabb 150e egy 7800XT max egy GRE mert abban nagy tuning potenciál van. -

Jacek

veterán

válasz

Yutani

#64951

üzenetére

Yutani

#64951

üzenetére

Jó igen, kicsit válogattam de ez nem került pénzbe. Aztán az akkori gépemet eszemet pénzért adtam el itt kint

Nem is ez a lényeg jelen pillanatban nincs szükségem nincs ekkora teljesítményre,

Legegyszerűbb lenne venni egy 4070S-t azt kész 40e különbséggel lenne 7900XT Ez olyan dilemma mint az ingyen disznó hús.

Ez olyan dilemma mint az ingyen disznó hús.

-

#36531588

törölt tag

válasz

Yutani

#64770

üzenetére

Yutani

#64770

üzenetére

A valamiért az pedig az az ok, hogy nyilván nekik 50 millió cpu kell, nem 8. Amiből esetleg lehet 10 vagy 12, ha az amd 1-2 évvel előre leköti, de nem 50 millió. Ebből az 50 millió userből pedig szerintem 45 milliót nem érdekel milyen cpu-n rendeli meg a kaját, tervezi meg a nyaralást, levelezik vagy más napi tevékenységet végez. És nincs is jelentősége.

-

-

Abu85

HÁZIGAZDA

válasz

Yutani

#64316

üzenetére

Yutani

#64316

üzenetére

Az MSI sajna nagyon gyenge a globális VGA-piacon. Pár piacon mennek, de globálisan kevesek. Az a legfőbb gondjuk, hogy a nagyok, mint a PC Partner, TUL, Palit csoport, stb. 5-10 márkával nyomják piacra összpontosítva. Ezzel nagyon nehéz versenyezni, mert sokkal nagyobb a nagy gyártók mozgástere.

#64317 Albus_D : Az MSI, mint gyártó nem nagy. A VGA-piac leginkább azoknak a gyártóknak megy, amelyek 5-10 leányvállalatot tartanak fent, hogy per piac külön márkával támadjanak. És ez a stratégia beválik. Ugyanez volt az EVGA-nak is a gondja. Egy piacra összpontosítottak, és hiába kevésbé ismertek mondjuk a Palit csoport vállalatai, összesen 8 cégről van szó, amelyek egyenként nem túl nagyok, de együtt nagyon is azok, és célzottan támadják a piacokat. Ezzel nincs mit tenni. Az ASUS neve akkora, hogy valamit kompenzáljon, de összességében még őket is megverik a több márkával dolgozó cégek.

Az MSI-nek az alaplappiacon van esélye, mert ott 10% körül vannak, az még egy tűrhető részesedés. A VGA-piacon nagyon futottak még csak, mert globálisan csak nyugatabbra vannak jelen.

-

#36531588

törölt tag

válasz

Yutani

#64316

üzenetére

Yutani

#64316

üzenetére

Nyilván évek óta a béka segge alatt az msi amd-s dvga eladása, hiszen 17% volt a piaci részesedése, amit idióta árazással tudott feltornászni 19%-ra. Ez tény.

De nyilvánvaló a kettős mérce is, hiszen az evga esetében szó szerint azonnal lehozta a piros betűs cikket, jelen esetben pedig megy a hallgatás, ráadásul próbálja úgy beállítani, mintha nem érte volna nagy veszteség az amd-t ezzel. Pedig de, mert azt kell nézni, hogy egy első háromban levő gyártó kapitulál, mert évek óta nem tesz le az amd versenyképes terméket, csak olcsót, amin vagy van profit vagy nincs, de inkább nincs. Ráadásul általánosít, és azt sugallja a vevők nem szerertik az msi-t mint gyártót, holott pontosan tudja hogy nem ez az az amd kártyák prpblémája - ahogy rámutattam az nv kártyáival rögtön "szeretik" az msi-t. Remélem nem asszisztálsz a megtévesztés és mellébeszélés újabb példájához. -

#36531588

törölt tag

válasz

Yutani

#64308

üzenetére

Yutani

#64308

üzenetére

Ez pont nem így van. Abu nagyrészt általánosan beszélt az MSI vga üzletágáról, amiről rohadt gyorsan kiderült, hogy nem úgy van. Az MSI a 3 nagy vga eladó egyike. De ha már foglalkoztál a témával szerinted mennyire igaz ez a kijelentés "Hiába tetszik az MSI valakinek, akkor sem veszi a piac az MSI VGA-kat." annak fényében, hogy egy német bolt eladási listáját heteken keresztül MSI vga vezeti, és két olyan áruház mint a Newegg és Amazon best seller listáján is többszörösen szerepel mint gyártó?

-

Abu85

HÁZIGAZDA

-

válasz

Yutani

#63823

üzenetére

Yutani

#63823

üzenetére

Én ebbe nem akartam belefolyni, végig olvastam azt a 20 kommentet , amiben minden kommentjében a DLSS3 van megemlítve egyéb játékok kapcsán emlékeztetőül magyarázatként, takaróként, mindegy, de fentiek kapcsán emlékeztem az általam linkelt kommentre és arra is hogy mire lett kihegyezve. lehet hogy ő korrekt akart lenni, akkor így gondolta, most meg amúgy ,de ez mellékes.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

S_x96x_S

addikt

válasz

Yutani

#63823

üzenetére

Yutani

#63823

üzenetére

> korrekt tájékoztatást ..

Abu még az nVidiás álhírt se hozta le ..

Annak ellenére se, hogy "b." terjesztette .. és azzal tényleg rossz színben lehetne feltüntetni az nVidiát.![;]](//cdn.rios.hu/dl/s/v1.gif)

"Update 15:48 UTC: Our friends at Hardware Busters have reliable sources in the power supply industry with equal access to the PCIe CEM specification as NVIDIA, and say that the story of NVIDIA adopting a new power connector with "Blackwell" is likely false. NVIDIA is expected to debut the new GPU series toward the end of 2024, and if a new power connector was in the offing, by now the power supply industry would have some clue. It doesn't. Read more about this in the Hardware Busters article in the source link below."

https://www.techpowerup.com/319242/nvidia-rtx-50-series-blackwell-to-debut-16-pin-pcie-gen-6-power-connector-standard#63822 b.

> A "kedvenc" konkurenciájának állandó negatív színben

> való feltüntetése is sokat tesz ehhez hozzá."b." tessék önkritikát gyakorolni ..

Nem ér alattomosan befeketiteni az nVidiát![;]](//cdn.rios.hu/dl/s/v1.gif)

-

Busterftw

nagyúr

válasz

Yutani

#63820

üzenetére

Yutani

#63820

üzenetére

Hát látod, pedig másoknak is megy itt, költik a meséket és terelik a problémát egy teljesen irreleváns témára (userbenchmark)

S_x96x_S

"Szerintem te a UserBenchmark pártiságoddal ;] a kisebbséghez tartozol .. "

Szerintem meg a kutya nem beszélt az userbenchmarkról, de idezheted tőlem ha már te így levetted valahonnan én őket "pártolom"

Azért egy wall of text marhaságot azért sikerült összehozni, ami már azért is vicces mert épp az AMD került tűz alá pont amiatt, hogy az AMD címekben nincs DLSS vs fordítva.

Ha az Intel fizetett volna, akkor inkább az Nvidiat golyózták volna ki, ha már az userek többsége Nvidiás. -

válasz

Yutani

#63820

üzenetére

Yutani

#63820

üzenetére

Ne minket hibáztass az első mondatodért, hanem őt, ott az élő példa linkeltem.Sok munkát fektetett ebbe.

A "kedvenc" konkurenciájának állandó negatív színben való feltüntetése is sokat tesz ehhez hozzá.

Igen azt látom hogy nem akarod elhinni. van ez így, hogy az ember vak akar maradni.Amúgy visszatérve a fentire.

Az első esetben ez az Nvidia hibája az AMD nél az UE5 engine hibája.

Ez nem azt jelenti amúgy hogy nem lehetséges az utóbbi, sőt szerintem is igaza van, csak tudod ez gyártótól függetlenül így van... -

PuMbA

titán

válasz

Yutani

#63704

üzenetére

Yutani

#63704

üzenetére

Az a baj, hogy kategóriailag nagyon szétcsúsztak a kártyák. A 7900XT egy 3 ventis féltégla, ami 315W-ot fogyaszt. 315W-ot nem fogyaszthat egy közép kategóriás kártya az én világomban. Nálam a középkategória az még az ésszerűségről szól. 200W körüli, 2 ventis, értelmezhető méretű kártya. Ezért sem szimpatikus, amit az AMD csinál, hogy az RDNA3 esetén a belépő kártyájuk már 165W-nál kezdődik. Pár évvel ezelőtt a belépő szint 70W volt.

-

hokuszpk

nagyúr

válasz

Yutani

#63606

üzenetére

Yutani

#63606

üzenetére

ha jolertettem, az RX 7xxx már telivan, csak jelenleg nem hasznalhato, mert arra van kigyurva, hogy majd a programozhato bejaras.

na addig alljon valaki vivoallasban, amig az megjon. Lehetoleg az, aki az AMDnel megint kitalalta, hogy "csinaljunk olyat, amit az MS kér".

Tehat majd 3+ ev mulva talan megjelenik hozza a szoftver ; de addigra jól megvaltoznak az MS igenyei ha meg megsem, akkormeg mindenre is keveslesz, amit a jelen genbe beepitettek. -

Petykemano

veterán

válasz

Yutani

#63597

üzenetére

Yutani

#63597

üzenetére

Nekem az Johnny Firpo és Bob fogadása jutott eszembe erről 10%-kal jobb eredmény 20%-kal magasabb áron.

Még csak azt sem lehet mondani, hogy ma még mindig egyértelmű szabályszerűség volna az, hogy a drágább termékkatégóriák felé haladva romlik az ár/érték arány, hiszen ezen az alapon sokáig a 4090 volt a legjobb vétel.

Nem hiszem, hogy ezt a lapkát érdemben lehetne natív 4K-ra használni. Ennek megfelelően kétlem, hogy a 16GB VRAM hosszabbítaná meg a használhatóság időtartamát. A HWBU tesztben nekem úgy tűnt, komolyabb teljesítmény előrelépést RT használata mellett ért el.Nyilván a 8GB-tól való ellépés egy szükséges, elkerülhetetlen lépés.

-

PuMbA

titán

válasz

Yutani

#63449

üzenetére

Yutani

#63449

üzenetére

Nekem csak az a bajom az AMD-vel, hogy láthatóan kapálóznak. Miért nem fogadják el, hogy oké, 265W helyett fogyasszon 200W-ot az RX7800XT és akkor legyen 5%-kal lassabb. Az összes kártyájuk annyiból áll, hogy kinyomják a szemüket, hogy aztán nézzük, hogy milyen sokat fogyaszt. 7700XT? 18W-tal kevesebbet fogyaszt, mint a 7800XT és 20%-kal lassabb. Jóvanezígy.

-

Raymond

titán

válasz

Yutani

#63295

üzenetére

Yutani

#63295

üzenetére

De abban legalabb nem volt akkora kavaras a nevekkel. Na meg azokban az idokben voltak olyan oruletek is mint a 3080-12GB/3080Ti/3090/3090Ti

Egyebkent job lett volna szetvalasztani az egyik kategoriat meg, de nem igazan Pitbull-os (mr. worldwide) a GRE kartya igy eredetileg hagytam, de igy nezne ki jobban inkabb:

Egyebkent job lett volna szetvalasztani az egyik kategoriat meg, de nem igazan Pitbull-os (mr. worldwide) a GRE kartya igy eredetileg hagytam, de igy nezne ki jobban inkabb:Family RDNA2 RDNA3

-------------------------------------------

Navi x3c 6600 7500XT* 7600

Navi x3f 6600XT/6650XT 7600 7600XT

Navi x2c 6700 7700XT 7700

Navi x2f 6700XT/6750XT 7800XT 7700XT

Navi x1c 6800 7900GRE 7800

Navi x1c 6800XT 7900XT 7800XT

Navi x1f 6900XT/6950XT 7900XTX 7900XT(a 6750XT eliras is javitva)

Az utolso oszlopban van hogyan kene kineznie a neveknek ha nem kavarnak.

-

PuMbA

titán

válasz

Yutani

#62824

üzenetére

Yutani

#62824

üzenetére

Igen

, ahogy sok helyen mondták már, az RTX4090 az NVIDIA legnormálisabb kártyája a felhozatalban, mert az előző generációhoz képest tényleg nagy előrelépés és még csak VRAM-ban sem fojtották le.

, ahogy sok helyen mondták már, az RTX4090 az NVIDIA legnormálisabb kártyája a felhozatalban, mert az előző generációhoz képest tényleg nagy előrelépés és még csak VRAM-ban sem fojtották le.b.: Úgy látszik, hogy csak NVIDIA-é a csúcs szegmens már, de az még jobban aranyáron lesz. RTX5090 3000 dolcsi

-

-

Petykemano

veterán

válasz

Yutani

#62241

üzenetére

Yutani

#62241

üzenetére

"a chipletezés nem tart itt, hogy két közepes die-ból kiállítson egy felső kategóriás terméket"

Nem vagyok chiptervező. De számomra - elképzelve - nehezebb feladatnak tűnik (szoftveres támogatás nélkül) megoldani, hogy két külön-külön is teljesértékű chip úgy működjön együtt, mintha ők mindig egy összetartozó egység lennének.Nem annyira a Shader Engine, hanem sokkal inkább a központi egységek összehangolása, a közöttük való kommunikáció és adat-és különösen a feladat megosztás megoldása kérdéses számomra.

Abban egészen biztos vagyok, hogy ez nem tudna úgy működni, mint a Zen chipletek esetén, hogy szubsztráton keresztül valamilyen relatív vékony csatornán kötik össze a chipleteket. Ezt a Mi250 és az Apple M1 Ultra (Fusion) esetén is brutálisan széles interconnect oldja meg. (Mindazonáltal tudomásom szerint a Mi250 nem is látszódik 1 GPU-nak.)

Ezért nekem könnyebben kivitelezhetőnek tűnik egy olyan bontás, hogy központi egységet tartják egyben és a Shader Engine-eket választják le.

Így csak 1 db Shader Engine chipletet kéne gyártani és ezek számával, valamint a központi egység méretével lenne skálázható. Persze gyanítom, hogy a központi egység és a SE között is borzalmas sávszélességre lenne szükség.Ezt nem biztos, hogy meg lehet vagy érdemes valósítani olyan 2.5D csatlakozókkal, mint amit a Navi31 és Navi32 esetén láttunk. Életképesnek egy a Mi300 esetén is látott 3D megoldást látnék, ahol a base Die egy pl N6-on gyártott lapka, ami tartalmazza a központi egységet, parancsprocesszort, L2$-t , valamint az IO-t és a fixfunkciós egységeket, továbbá 2.5D csatlakozókat a széleken található szintén külön gyártott, infinity cache-t tartalmazó MCD-khez.

És ennek a base die-nak a tetejére vannak integrálva a V-cache-nél látott 3D tokozásos (vagy ahogy a Mi300-nál is láttuk) módszerrel a compute lapkák.

A Base Die-ban az L2$ mérete és a parancsprocesszor képességei nyilván skálázhatók bizonyos mértékben.Látjuk, hogy ez működik a Mi300-nál is.

Az persze elképzelhető, hogy egy ilyen tokozással készülő lapka most még vagy drágább, vagy ha minden figyelembeveszünk , nem is feltétlenül drágább, de kisebb volumenben állítható elő, mint egy "monolitikus" GCD. Viszont ez az elképzelés tulajdonképpen visszafelé kompatibilis maradhat azzal, ahogy most összerakják az RDNA3-at. Tehát a kurrens MCD-k akár fel is használhatók.Mi van, ha nem azért kaszálták el a nagyobb RDNA sku-kat (lapkákat), mert nem sikerült összerakni a multi-GCD GPU-t, hanem mert sikerült összerakni a Mi300-hoz hasonló módszerrel és annak fényében már nem is lenne érdemes kiadni azokat, viszont a kisebb RDNA4 lapkák esetén meg nem érné még (költség vagy volumen miatt) meg ezt a módszert bevetni?

Ha ez így is van, akkor is valószínű, hogy ez már nem RDNA4 lesz. Ha emlékszel, a Polaris esetén is volt pletyka egy nagyobb Polaris lapkáról, amit végül elengedtek, mert "mindjárt" itt a Vega.

-

Busterftw

nagyúr

válasz

Yutani

#62241

üzenetére

Yutani

#62241

üzenetére

AMD ugye azt nyilatkozta, hogy hozhattak volna 4090 ellen valamit, de inkabb az "energiatakarekos" termekeken volt a fokusz RDNA3 eseteben.

Ami erdekes, mert amikor Nvidia a rosszabb node miatt (Samsung) Amperenel kenytelen volt jobban huzni a kartyait, siman megtettek annak erdekeben hogy a piaci elsoseg megmaradjon.

Most az AMD ezt sem tudja kihasznalni, mert az Nvidia vegre nem csoroskodott a gyartas technologian. Kerdes az AMD miert nem tette most meg ugyanezt, a valasztott node azert nem gyenge.Ennyire nem akartak az uj csatlakozot, vagy ennyire rosszul skalazodik az RDNA3?

-

Devid_81

félisten

-

Abu85

HÁZIGAZDA

válasz

Yutani

#61877

üzenetére

Yutani

#61877

üzenetére

Eleve ez nem játék, hanem techdemó. Nyilván a szándékosság sem zárható ki, de az sem, hogy annyira magasról leszarta az NV, hogy nem rakott bele erőforrást, úgy meg hiába csinálod, szarul fog futni pusztán amiatt, hogy nem adsz pénzt az optimalizálásra. A legtöbb játék a kezdeti szakaszban ilyen, és később gyorsítják be. Itt nem tették meg, mert annyira nem volt fontos a projekt, hogy jóvanazúgyahogydöcög...adjátokki.

-

S_x96x_S

addikt

válasz

Yutani

#61835

üzenetére

Yutani

#61835

üzenetére

> Starfield

> ha az AMD kártyákon jobban fut, mint a szokásos NV párjaikon. De ezt kötve hiszem."AMD is Starfield’s Exclusive PC Partner"

és az FSR 2.0 -át direkt ki is emelik ... (1:19-től)

https://youtu.be/9ABnU6Zo0uA?t=78

vagyis ez a játék - elméletileg - kap egy átlagosnál erősebb AMD optimalizációt.

a gyakorlatban meg majd meglátjuk, hogy ez mire elég ..remélem, hogy az RDNA3-as APU-kon is jól fog futni .

-

-

Alogonomus

őstag

válasz

Yutani

#61664

üzenetére

Yutani

#61664

üzenetére

A 6900 XT és a 4070 teljesítménye között minimális a különbség. A 7700 XT és 7800 XT között minimum egy 15% különbségnek kell majd lennie, hogy a tuningolt 7700 XT és az alap 7800 XT között is megmaradjon valamennyi távolság.

A fentiek alapján:

A 7900 XT erejéből kiindulva a 7800 XT nagyjából a 6950 XT szintjén lehetne jó helyen a 7900 XT "alatt" kb 15%-kal, de kevesebb memóriával.

A 7700 XT a 7800 XT "alatt" 20%-kal a "sima" 6800 magasságában lehetne jó helyen.

A 7600 XT pedig ott is lehetne újabb kb 20% csökkenéssel a 6700 XT környékén, ahogy azt már te is jósoltad. -

válasz

Yutani

#61475

üzenetére

Yutani

#61475

üzenetére

Igor kivette az RT-t belőle úgy is 3 % az előnye a 7600 nak.Pár multi cím löki meg a7600 szekerét mind a COD pédául ahol 20 % fölötti az előnye.

De legyen 10 % overall akkor is egy kalap... Új generációs kártyáról beszélünk.

A 6650 279 euro MF nél [link] normális hűtéssel, a 3060 305 euro. Az egyik jobbat nyújt RT ben és több vramot ad a másik meg olcsóbb.

Akinek kell vegye, de igazából eza kártya még akkora előrelépést sem nyújt , a 6650 XT hez nézve, mint a 399$ 4060 TI a 499$ 3070 hez nézve. -

PuMbA

titán

válasz

Yutani

#61473

üzenetére

Yutani

#61473

üzenetére

Szórnak a tesztek, mert mások a játékok

Az RX7600 nagy előnyben van a multi címekben: COD: MW2, Rainbow Six Siege stb. Ha ezeket kiveszed, akkor lesz az RTX3060 közelében. Én nem multizok, csak egy játékosokkal játszik ellenben RT-zek, szóval az én szempontomból helyeset írtam, de más szempontjából meg természetesen nem.

Az RX7600 nagy előnyben van a multi címekben: COD: MW2, Rainbow Six Siege stb. Ha ezeket kiveszed, akkor lesz az RTX3060 közelében. Én nem multizok, csak egy játékosokkal játszik ellenben RT-zek, szóval az én szempontomból helyeset írtam, de más szempontjából meg természetesen nem. -

hahakocka

őstag

válasz

Yutani

#61227

üzenetére

Yutani

#61227

üzenetére

Èn is 3060ti sima 6700 at làttam erőben egâlra vele pletykakènt, e a 8 GB vram akkor is kevés. Ha olcsó lesz s nem eszik sokat na csak akkor lehet csak sikeres. Igaz ez a 4060-4060 ti 8 GB vramosokra is. Inkàbb a 7700-7800 xt èrdekelne persze azt csak jún- júl felè olvastam hogy jöhet mindegy tudok vàrni nem sietek . Elvileg 16 GB vramosak lesznek a 20 GB os 7900 xt utàn.

-

HSM

félisten

válasz

Yutani

#60981

üzenetére

Yutani

#60981

üzenetére

"Van egy lila hajú lány is az egyik képen, ahol mindegyik upscaling sz@rul néz ki"

Éppen ez a baj az upscaling-ekkel, a hiányzó részleteket egyik sem tudja elővarázsolni... Egy egyszínű falon meg nyilván egyik sem fog rosszul teljesíteni.

#60980 Petykemano : Azért azt is meg kellene nézni, melyik eljárás mekkora erőforrásigényű. Épp a kézikonzol, stb miatt lehet más az ideális működése pl. az FSR-nek, mint a többinek (energiaigény a célzott hardvereken).

-

Alogonomus

őstag

válasz

Yutani

#60960

üzenetére

Yutani

#60960

üzenetére

A 8 GB-os asztali 7600 valószínűleg ugyanúgy nem tudja majd komolyan felkavarni a jelenlegi helyzetet, ahogy a 4060 is lényegében csak egy takarékosabb 3070 lehet majd, vagy ahogy a 4070 is egy takarékosabb 3080 lett. Amíg a Navi33 erejét még a 6900 XT szintjére mondta Abu, addig komolyabb piacbefolyásoló hatása is lehetett volna a 7600-nak, de jelenleg egy 6700 és 6800 közé érkező 8 GB-os kártyának várom, ami az energiahatékonysága mellé a többi 8 GB-os kártya korlátozásait is magával hozza majd.

Ahogy Petykemano is fogalmaz, a 8 GB VRAM lassan kimegy a divatból. Az új 8 GB-os kártyáknak ettől még lehet piacuk, hiszen még az eddigi 8 GB-os világnézetet megtorpedózó, és ezért mostanában sokat ostorozott LOA és HL is elmegy 100 fps fölött 1080p medium beállítással, a régebbi játékok közül soknak pedig elég is 1080p ultra beállításhoz a 8 GB. A 7600 és 4060 fogadtatása ugyanúgy az árazáson fog múlni, ahogy az a 4070 esetén történt.

A 7800 XT viszont valahova a 3090 Ti és 6950 XT szintjére érkezhet majd 16 GB-tal, és a +4 GB egyértelműen ideálisabb 1440p kártyává teszi, mint a 4070 Ti. -

Petykemano

veterán

válasz

Yutani

#60960

üzenetére

Yutani

#60960

üzenetére

Na igen.

Kiváncsi lennék, hogy vajon csupán egy hangos enthusiast rétegről lehet-e szó, akik valami olyasmi jóárasított és energiahatékony megoldást várnak, mint a 6800 volt, vagy inkább az lehet a magyarázata, hogy a Navi33 várhatóan 8GB VRAM-mal fog érkezni, ami kb "most megy ki a divatból". -

Alogonomus

őstag

válasz

Yutani

#60818

üzenetére

Yutani

#60818

üzenetére

Amennyiben a 40%-os változatok kevesek lettek volna, akkor amolyan béta driverként azért esetleg kiadták volna. Egyébként is kiadják többször WHQL aláírás előtt már a drivereket. Amennyiben igaz a híresztelés, akkor valószínűleg több órás egyhuzamú játék esetén jön csak elő a gond, vagyis aki mondjuk csak 1-2 órát játszik egyhuzamban ugyanazzal a játékkal, sőt néha ki is alt tabol belőle, annál akkor valószínűleg elő sem került volna a gond. A kártyának pedig nem árt az artifacting, csak zavaró.

Igazából ezért is kételkedem abban, hogy csak ennyi az ok a 7900-as kártyák gyenge rajtja mögött.

Persze az is valószínű, hogy egy 4090 szintű 7900 XTX nem 1000 dolláron, de talán egy 4080 szintű 7900 XT sem 900 dolláron debütált volna.Azért már régóta nincs a béka feneke alatt, vagy legalábbis a kedvezőbb perf/$ bőven meggyőzi a vásárlókat. Legalábbis Németországban erre utalnak a számok GPU alaplap CPU

A prebuilt rendszerek persze egy másik téma, ott a vásárló abból választhat, amit kínálnak a prospektusban.

-

Petykemano

veterán

válasz

Yutani

#60804

üzenetére

Yutani

#60804

üzenetére

Számomra azért hihető a sztori, hogy valami a chiplet kapcsolattal, sávszélességgel lehet, mert hiszen az AMD és rajongótábora nagyon nagy reményeket táplált az infinity cache kapcsán, hogy mennyire fontos, hogy az adat közel legyen, mert a legdrágább művelet (energiában) az adatmozgatás és a legpazarlóbb az adatra várás. A GCN esetén az async compute célja épp az volt, hogy a malmozó számító egységeket hasznos munkára fogják.

Erre most? Ja hát igazából rájöttünk, hogy kevesebb is elég. Kicsit bűzlik.

Viszont ha ez igaz, akkor tulajdonképpen azt kéne látnunk, hogy a monolitikus designok jobbak.

Navi 33 esetén: a monolitikus design kompenzál az régebbi gyártástechnológiát (N6)

Viszont az N4-en készülő Phoenixnek brillíroznia kéne.Meglátjuk.

Hogy Végülis lesz-e javított kiadás, arra.nem vennék mérget. Egyrészt talán okkal ennyivel később érkezik az N32. De ha az javítva érkezik, az elavulttá teszi a 7900XT-t. Szerintem javított változatban akkor reménykedhetünk, ha megjelennek hírek 3D stacked változatokról.

De Legutóbb arról volt pletyka, hogy a javítást elkaszálták. Talán csak az RDNA4-ben lesz javítás.Tudja a pék...

-

TESCO-Zsömle

titán

válasz

Yutani

#60758

üzenetére

Yutani

#60758

üzenetére

Future is Fusion

Még mindig az van, hogy x86 alapon az AMD-n kívül senkinek sincs értelmezhető "csomagja". Intel-nek, ha az ARC beérik, akkor ~5 év és lehet értelme strongarm-ozni a piacon, de pl ilyen AYANEO-kat nem fog tudni betörni, mert ott pont az a cél, hogy fullfullmax a legjobb legyen, ami elérhető, ha az AMD akkor is jobb, azzal fogják szerelni.

-

Petykemano

veterán

válasz

Yutani

#60395

üzenetére

Yutani

#60395

üzenetére

Egyébként ez tökre sajnálatos.

Bárcsak tudnánk a valódi okát - az érzékelhető tüneteken túl -, vagy legalább hogy mikor és mivel tervezik korrigálni.Mármint a chiplet megközelítés még ezzel a teljesítménnyel is bejöhetett volna, ha nem feleződik meg a kereslet a GPU-kra. Jól kivédték volna a kapacitás-korlátokat. Így viszont a chiplet kissé holt tehernek tűnik és egészen addig amíg a régebbi node használatával jelentős árelőnyhöz, vagy kihozatali előnyhöz vagy a teljes chip méretéből fakadó előnyhöz nem jutnak, akkor az is marad. Utóbbi ugye azt jelentené, hogy nagyobb chipet tudnak összelegózni, mint ami monolitikusan ki tud jönni. (>800mm2) Ettől azért elég messze vannak és hát legkevésbé sem kizárható, hogy mire eljutnak oda, addigra ezt a lépést az Nvidia is megteszi.

Végül hiába készültek a 3D stacked Infinity cache bővítménnyel, azt se hasznosítják És az RDNA3 fő architekturális újítása, a dual-issue se különösebben érezteti a hatását. Talán vannak, akik még reménykednek abban, hogy ezt majd még driverből haszonra fordítják.

És az se mentette meg őket, hogy szorosabban működnek együtt a TSMC-vel, vagy hogy több különböző design-t készítettek már N5/N4-re - valahogy a GCD egy bizonyos ponton túl frekvencia/hősűrűség korlátozottnak tűnik.Arra milyen büszkék voltak, hogy milyen nagy sűrűséget sikerült elérni. Akár N5-ön, akár N6-on. Teljesen olyan, mintha arra készültek volna az RDNA3-mal, hogy a hatalmas kereslet a GPU-ra örökké fog tartani. Mert azt meg annyira nem lehet mondani, hogy a sűrű és waferhatékony designnal olyan nagy árelőnyhöz jutnának, vagy legalábbis biztosítanának a fogyasztók irányába.

Jelen körülmények között én már inkább meglepődnék, ha mégiscsak érkezne valamiféle javítás/refresh.

Ugyanakkor azt gondolom, hogy az Intel szinrelépése ha földrengésszerű mozgásokat nem is, de valamiféle lassú mozgolódást elindíthat.

Azért mégiscsak eggyel több szereplő, akire oda kell figyelni, aki eltérő stratégiát alkothat.

Elképzelhető, hogy miközben az AMD az Nvidia mögé nyugodtan beállna, az AMD és az Intel között esetlegesen kialakuló Az Nvidia szemszögéből nézve "morzsákért zajló cicaharca" indítja el őket egy olyan árversenybe, ami (a hírverés, az igyekezet, az alacsonyabb árak) máskülönben Nvidia vásárlókat vonz be és/vagy az Nvidiát is ármérséklésre kényszeríthet. -

Pakmara

őstag

válasz

Yutani

#60302

üzenetére

Yutani

#60302

üzenetére

Oké up to. Nekem személy szerint nem ez a bajom. Hanem hogy kijön a 7900 xtx egy adott power limittel. De nem azzal mérik, hanem visszaveszik és úgy hasonlítják. Értem, hogy így 300 W vs.300 W van, de mennyiből tart volna 6900 XT fps-e /300 W vs 7900 xtx fps-e / 355 W-al számolni. Szvsz nincs olyan kartya a piacon sok sok éve amiből ne lehetne jobb perf/w-ot kihozni azzal hogy csökkented a power limitjét.

-

válasz

Yutani

#60226

üzenetére

Yutani

#60226

üzenetére

Szerintem nincs ez mondva, kár kisarkítani a dolgot. Egy kártya életciklusát jelentősen megnöveli, ami nem mellékes a mai árak mellett és mivel egy kikapcsolható ficsőr az ember eldöntheti hogy DLSS/ FSR + több effekt vagy RT, vagy nincs skálázás / jobb felbontás de kevesebb részlet és látvány vagy FPS.

Szerintem egy lehetőséget ad az ember kezébe, nem egy kötelező elem, de akinek kell annak ez egy remek találmány..

Anno CP 2077 alatt nem láttam azt hogy működne, (mondjuk nem is performance módban toltam hanem Quality-n) de legalább 30 % többletet nyújtott annak idején a 2070 hez amihez natívban egy 2080 TI kellett volna.

Sok Turing tulaj fog még 2025 ben is játszani ezekkel a kártyákkal szerintem. -

Yany

addikt

válasz

Yutani

#60226

üzenetére

Yutani

#60226

üzenetére

Szerintem tényleg fölösleges személyes sértésnek venni, ha valaki értékeli ezt a feature-t, legyen az FSR vagy DLSS. Szerintem látványban perpill többet ér az RT-nél is, de persze az RT jelenlegi implementációinak feladata inkább a jövő felé nyitás, semmint az akut vizuálorgazm.

-

PuMbA

titán

válasz

Yutani

#60209

üzenetére

Yutani

#60209

üzenetére

Pedig nem úgy volt, hogy az AMD driver írók már unatkoznak, annyira gyors, optimalizált, hibátlan az egész? Meg hogy az open source AMD profilerrel minden problémát egy csapásra felfednek?

![;]](//cdn.rios.hu/dl/s/v1.gif) Megint kiütközik, hogy az elmélet meg a gyakorlat az teljesen más. NVIDIA-n jól fut, AMD meg bajban van. Hiába az okosságaik, ha semmire se mennek vele.

Megint kiütközik, hogy az elmélet meg a gyakorlat az teljesen más. NVIDIA-n jól fut, AMD meg bajban van. Hiába az okosságaik, ha semmire se mennek vele. -

Alogonomus

őstag

válasz

Yutani

#60201

üzenetére

Yutani

#60201

üzenetére

Pontosan. Egyik területen sem ugyanazt a kategóriát képviselik. Esetleg egy megengedőbb RT címben képviselhetik ugyanazt a kategóriát azért, mert a 6950 XT 15% előnyét a 3080 visszahozza egál közelébe az eredeti hardveres DXR hatékonyabb kezelésével.

Az már csak ráadás, hogy az erőviszony bőven függ az alkalmazott felbontástól is. -

szmörlock007

aktív tag

válasz

Yutani

#60101

üzenetére

Yutani

#60101

üzenetére

Nem zárnám ki teljesen, anno a hd 7000 sorozatnál 2012-ben is volt a hd 7700, hd 7800 és hd 7900 sorozat. Simán elnevezhetik rx 7700 xt(x)-nek, az csak egy név. Nvidiánál is 192 bit lett a 4070ti amit sokan nem hittek volna, de ez teljesen irreleváns az egyszeri felhasználónak, neki a teljesítmény a lényeg és az ár, ha ugyanazt a teljesítményt nyújtja 8xPCIe sávval mint 16-al, mert nem limitál, akkor lényegtelen. Legtöbb vásárló szerintem azt se tudja mi az, hogy PCIe sáv

-

Petykemano

veterán

válasz

Yutani

#60066

üzenetére

Yutani

#60066

üzenetére

Különös...

Persze tudom, hogy ez csak egy szűk aspektus. A nagyvilág nagyobb ennél.

Azt akartam mondani, hogy 100e-ért én is vettem volna RX 6600-at.

Matek alapon érthető, hogy ha olcsóbban adják a kártyákat, akkor lehet, hogy több fogy, de közben kisebb a margó.Az a különös, hogy közben meg Abu azt mondja, hogy az Navi23-mal dugig van a raktár, közben meg jön a Navi33. Persze valószínűleg valami olyasmi lehet a magyarázat, hogy azt talán még nem is gyártják nagy volumenben és amíg a konkurens termékek árai nem csökkennek olyan mértékben, hogy elvigye ennek a terméknek az eladásait, addig csorog a pénz, nem szorít annyira a cipő, minek sietni a kiárusítással.

Talán úgy vannak vele, hogy semmi gond, ha az ilyen magamfajta spúrok nem vették meg 280euróért, akkor majd ha valaki behoz egy új terméket és ár-feszültséget alakít ki, ráérünk akkor lejjebb vinni a megmaradt termékek árát és/vagy behozni a saját új termékünket és SpúrManók majd megveszik akkor.

Ami a 8-20%-ot illeti. Gondolom az AMD-nek lehet egy olyan mára kiakalult hozzáállása, hogy az Nvidia mindshare-t (vélt vagy valós alapokon nyugvó driverstibilitás, feature-set, fogyasztási vagy teljesístményelőnyök, stb) képtelenség volna az árcédulával kompenzálni.

Teljesen mindegy, hogy 5, vagy 10%-kal ajánlana az Nvidia alá. Ez nem döntő mértékű.

És az is mindegy, hogy 15 vagy 25%-kal ajánlana alá, mert olyan mértékben nem tud, ami ha már döntő mértékű lenne, akkor arra az Nvidia ne reagálna a piacivesztés ellen árcsökkentéssel. -

S_x96x_S

addikt

válasz

Yutani

#60064

üzenetére

Yutani

#60064

üzenetére

> Éppen most derült ki, hogy az AMD (is) visszatartotta a szállításokat,

> így tartva magasan a termék árakat, saz "undershipping" -nek több jelentése és oka is lehet.

"In terms of the under shipment, I mean, I think we’re — we undershipped in Q3, we undershipped in Q4." ( via videocardz )pl.

- az egyik, hogy nem foglalt le elég kapacitást a TSMC-nél,

- és az hogy a kevés legyártott prociből - annak adnak akik rögtön fizet. ( pl. Cloud )A COVID-ot és a termékeinek a sikerességét például eléggé alulbecsülete

az AMD, mivel elég konzervativan foglalt gyártókapacitást a TSMC-nél.Amúgy se lenne értelme visszatartani a már legyártott CPU/GPU-kat mivel csak annál több Intel és nVidia fogy ( hatalmas raktárkészlettel mindig tudnak szállítani )

"And so, AMD has the design wins and Intel has the supply wins when it comes to CPUs. "

"We are inventing a new term here: “Supply win.” This is distinct from a “design win.” We have been dancing around this idea since the pandemic started, joking that if AMD had believed more in its own Epyc CPU business it could have sold even more processors than it has in the past several years. And because AMD did conservative forecasts – and honestly, who can blame them because it overshot its forecasts with Opterons and Athlons in a bygone era – Intel could sell relatively ancient “Skylake” and “Cascade Lake” Xeon SPs based on 14 nanometer technologies, and now “Ice Lake” Xeon SPs based on a very cranky 10 nanometer process, against “Rome” Epyc 7002 and “Milan” Epyc 7003 chips based on 7 nanometer cores, and soon the 5 nanometer cores used in “Genoa” and “Bergamo” Epyc 9000 series chips. (The Epyc processors have a chiplet design that has 14 nanometer and 12 nanometer I/O and memory controllers linking the cores together into what amounts to a distributed CPU.)"

( via ) -

-

válasz

Yutani

#59966

üzenetére

Yutani

#59966

üzenetére

Tényleg nem fut Polarison a játék, én legalábbis a demót kipróbálva ezt látom. Elindul a demó (a teszt gépben 8GB ram van, erre panaszkodik is, de elindul), majd bejön a főmenü, de új játékot indítva kilép a program. Már akkor is kilépett, ha a beállításokat akartam megnyitni. Ma reggel jött valami frissítés a demóhoz, de nem változott a viselkedése.

-

válasz

Yutani

#59962

üzenetére

Yutani

#59962

üzenetére

Erről beszéltem: Forspoken gameplay on GTX 970

Még az FSR sem segít, hogy 60 FPS meglegyen (LOW + FSR Performance ~ 30 FPS), ráadásul ronda, mint a bűn felskálázással.

-

HSM

félisten

válasz

Yutani

#59938

üzenetére

Yutani

#59938

üzenetére

Nekem a kedvenc demóm tőlük se nem Ruby, se nem story nélküliek. A "The Leo" nevezetű, amit a HD7900-as sorozattal mutattak be: [link] .

#59939 PuMbA : Jelenleg ha benézek a kiskerekbe, Nv-től azt látom, hogy vehetek egekbe árazott 4080/4090-et, vagy az árához képest szvsz alulteljesítő 4070Ti-t. A piros oldalról ár/értékben számomra sokkal szimpatikusabb a 7900 XT. Bőven rendben van az építési minőség, bőven elég a memória mennyiség, raszterben ott van a 4070Ti/4080 között, és RT-ben is van kellő ereje, mindezt ~4070Ti áron. Hab a tortán, hogy CPU-ból is elég jópár címben gyengébb is alá. DLSS/FSR meg Ai buzzwordökre én már immunis vagyok, köszönöm, láttam eleget.

Működjön inkább normálisan natívban, annyi FPS-el, amire képes.

Működjön inkább normálisan natívban, annyi FPS-el, amire képes."RTX Overdrive mód DLSS 3-mal"

Na, ezek a pontok, amikor én már így vagyok marketing-szagtól: [link] (Star Trek-es double facepalm mém, ha esetleg nem élne a link ).

).De sajnos nekem is úgy fest, hogy a nagy pénzt a Ryzen vonal hozza, és inkább oda vannak csoportosítva a nagyobb erőforrások. Sajnos könnyen lehet, hogy nincs annyi gyártó/tervező kapacitás, hogy mindkét piacon kihozhassák magukból a maximumot.

#59940 Yany : A szomorú hírem, hogy a 3. versenyzőtől marad a piac ugyanúgy oligopólium, ahogy most is az.

-

-

-

Petykemano

veterán

válasz

Yutani

#59893

üzenetére

Yutani

#59893

üzenetére

Abu mondta, hogy az AMD piacszerzés (nagy mennyiségben és olcsóbban gyártható) tartotta meg a Navi33-at N6-on.

Abu mondta, hogy az AMD sokkal nagyobb N5 gyártókapacitást kötött le, még a csak GPU-ra fordított kapacitás is több, mint az Nvidiáé. És ebben nincs benne az N6.

Bár valószínűleg arról van szó megint, hogy Abu elhívott egy AMD PR menedzsert egy bárba, leitatta és szegényből tajtrészegen előtört a frusztráció:

(Abu, amikor látja, hogy a már nincs eszénél a tag)

- és akkor milyen lesz a RDNA3?

- Krrrrrva jó!!! Figy, ezzel kinyírjuk a zenvidiát végre. Örökre, hikkk

- Aham, és hány százalék?

- 100%! vagy több is! Öregem, ez tuti!

(Abu izgatottan fészkelődve a székén)

- És akkor miért tartottátok meg a Navi33-at N6-on?

- Na figyelj, blurp, elárulok neked egy titkot. G**isok kapacitást kötöttünk le a TSMC-nél érted? G**isokat! CSak GPU-ra többet lövünk el, mint az NVidia! Ebben biztos vagyok! (Persze szerencsétlen fickónak halvány fogalma sincs, hogy az Nvidia mennyit foglalt)

Le fogjuk tarolni a piacot! Hikkk

(Kezét meglendíti, hogy lesodorja az üres poharat az asztalról, hogy így adjon nyomatékot mondantójának, de azzal a lendülettel megbillen és maga is beesik az asztal alá.) -

Petykemano

veterán

válasz

Yutani

#59891

üzenetére

Yutani

#59891

üzenetére

Egy 6700 XT helyét átvevő Navi33 ára a realitás talaján állva nézve pont $350 lesz.

Ezt nem úgy értem, hogy ennyi a "reális" ára a költségeket figyelembe véve. Hanem hogy ismerve az Nvidia és az AMD árazási gyakorlatát, ha én azt mondom, hogy $300-nál többnek nem szabadna lennie, akkor pont annyival lesz több, ami abszolút értelemben némiképp csalódást keltő, másfelől viszont mégis remekül érvelhető inflációval és a teljesítményben váltott kártya névleges árazásához viszonyított kedvezménnyel.A vérprofin kiszámított, élére állított, fanyalgást kiváltó megosztó árazással mennyire lehet könnyű piacot szerezni?

-

Petykemano

veterán

válasz

Yutani

#59886

üzenetére

Yutani

#59886

üzenetére

Jó, hát ha már le van gyártva, akkor végülis tényleg kár azon filózni, miért nem voltak okosabbak, előrelátóbbak.

Engem nem zavar, hogy van még belőle, ha megfelelően van árazva. De mondjuk gyártani már ne gyártanak abból a lapkából.

Megfelelően...

TEhát mondjuk ne úgy, hogy a Navi23-nak az msrp-je $350 volt, most $250-ért adjuk, akkor legyen az egyébként ma már sokkal olcsóbban gyártható Navi33 $350. Alapvetően nem azért, hogy nekem mennyire tetszik hanem mert $350-ért kapható Navi22 most is. Ráadásul 10-12GB-os.

A Navi23 árán szerintem ehhez kellene ejteni még $30-40-tPersze nincsenek illúzióum, az árazás ezúttal is csalódást keltő lesz a közösségben. Biztos vagyok benne, hogy nem olyan árazással fognak előállni, amire csettint a közönség, hanem amire majd lesz szívózás egyik oldalról, inflációzás és a 2021-22-es cryptovalutabányászat közepén meghatározott elszállt msrp árakhoz való hasonlítás a másik oldalon.

-

Petykemano

veterán

válasz

Yutani

#59879

üzenetére

Yutani

#59879

üzenetére

Az eddig látottak alapján nincs olyan nagy különbség az N23 és N33 között.

+15% teljesítmény és -15% lapkaméret az N33 javára.Én eddig az N7 és N6 gyártástechnológiát árazás szempontjából egy kalap alatt kezelve láttam mindenütt. Tudtommal az N6 egy olyan halfnode-ja az N7-nek, amely előnyét leginkább az EUV használatának köszönheti. (The N6 node is an evolutionary design of the previous N7 node variations and simplifies the manufacturing steps by introducing light usage of EUV layers. [link] ) Már 2021 végén közel 50%-os volt az adoptáció. Tudomásom szerint N6-ra az N7-es gyártósorokat állítják át és már akkor is arról beszéltünk, hogy mivel az N6 gyártása gyorsabb az EUV miatt a quadruple patterning helyett, ezért az TSMC nyomni fogja a partnereket az N6-ra való átállásra, mert úgy több wafert tud eladni.

Bár most nem találom a kommentet, de abu 7x-es N5/N6 különbségről, $35000 és $5000-os wafer költségről beszélt. Lehet, hogy az eltelt hónapokban a wafer árak esetleg tovább is csökkentek.

Akkor tartanám lehetségesnek, hogy az N23 megmaradjon és azt kínálják RX 6600 teljesítményszintként, ha a TSMC-nek relatíve sok N6-tá át nem alakított gyártókapacitása maradt volna, amit N6-os kereslet hiányában nem éri meg átalakítani N6 gyártásra és bagóért (Az $5000-15%-nál is olcsóbban) rátukmálja az AMD-re, csak vigye.

Nekem most nincs bizodalmam Abu értesüléseiben. A Navi33 néven ő egy ~300mm2 méretű lapkáról tudott.

Őszintén?

Ha csak várt teljesítményszinteket ismertünk volna pletykák alapján, akkor azt is hihetnénk, hogy csupán arról van szó, hogy minden RDNA3 elmaradt a tervezett teljesítménytől. De csomó esetben párosult egy teljesítményinformációhoz egy lapkaméret és néha egy ár is.Szerintem az történt, hogy az AMD a Navi21,ből, a Navi22-ből és a Navi23-ból is csinált egy RDNA3 alapú N6 "portolást" - amolyan failsafe plan gyanánt.

Minden jel arra mutat, hogy

- Abu a Navi22-ből készült változatról szerzett információt. Az tényleg verdeshette a N21 hátát, miközben 290-300mm2-es méretű a lapka.

- MLiD és a VCZ (Greymon híresztelései alapján) a Navi21-ből készült változatot ismerhette, ami egy ~450mm2-es lapka lehetett volna >Navi21 teljesítménnyel.

- SkyJuice pedig a Navi23-ból készült lapkáról tudott, ami 203mm2-es és amit most be is mutattak. -

Petykemano

veterán

válasz

Yutani

#59800

üzenetére

Yutani

#59800

üzenetére

Különös, mármár furcsa megközelítés.

Én nagyon örülnék, ha egy adott chipből nem a hajtaná ki a gyártói lánc (chiptervező és AiB partnerek közösen, vagy saját szakállra) a fogyasztási görbe hatékony szakaszából, hogy kifacsarja belőle az utolsó 5% teljesítményt is, ami sok esetben komoly fogyasztásnövekedéssel és ebből fakadóan komolyabb, érdemben drágább körítést (PCB, VRM, hűtés) igényelhet, ami valószínűleg 5%-nál lényegesen nagyobb költség- és ebből fakadóan árnövekedéssel jár.

De azt gondoltam volna, hogy az tuningolhatóság felárát épp az imént említett drágább körítésben fizeti meg a vásárló.

-

S_x96x_S

addikt

válasz

Yutani

#59691

üzenetére

Yutani

#59691

üzenetére

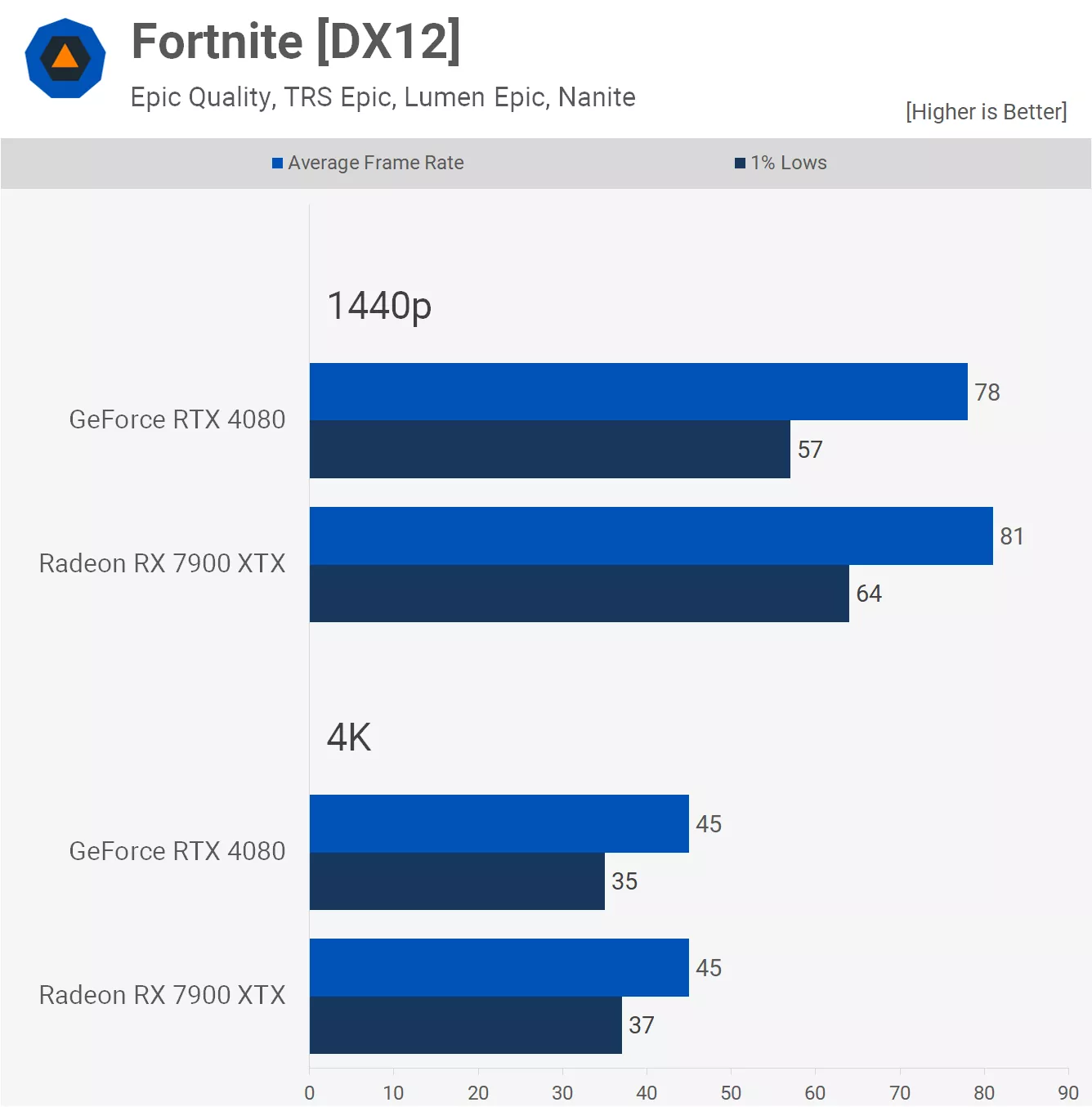

>> Abu85: NV hardverek ... A Fortnite például ilyen program.

> Viszont ahogy bekapcsolod az RT-t, okafogyottá válik a fejtegetésed.Fortnite ( RT Lumen and Nanite enabled ) esetén azért az 7900 XTX elég versenyképes,

és az RTX 4080 nem nagyon tud akkora előnyt mutatni.persze lehet más magyarázat is mint az ABU-é .. de akkor fejtsd ki jobban.

"What's interesting here is that ray tracing performance in Fortnite, which is one of the best examples of RT effects in any game right now, sees the 7900 XTX and RTX 4080 neck and neck. In fact, the Radeon GPU actually does a better job here with RT Lumen and Nanite enabled, and that's a surprising result."

https://www.techspot.com/review/2599-radeon-7900-xtx-vs-geforce-rtx-4080/

-

Petykemano

veterán

válasz

Yutani

#59647

üzenetére

Yutani

#59647

üzenetére

Csak érdekességképpen küldöm, mert felmerült bennem is a kérdés, hogy jójójó, helytállni biztos helytáll egy midrange GPU mellett egy 5 éves CPU, de mit adna hozzá egy új CPU?

Elég érdekes. zen2-ről zen3-ra nem feltétlenül érdemes váltani, bár van különbség. De a 5800X3D baró! Ha az AMD ledobna egy 7600X3D-t (vagy legalább 5600X3D-t), akkor azzal igencsak nagy népszerűségre tehetne szert.

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- Xbox Series X|S

- Mini-ITX

- AMD K6-III, és minden ami RETRO - Oldschool tuning

- Kertészet, mezőgazdaság topik

- Luck Dragon: Asszociációs játék. :)

- Milyen belső merevlemezt vegyek?

- Kínai és egyéb olcsó órák topikja

- Óra topik

- Apple iPhone 15 Pro Max - Attack on Titan

- One otthoni szolgáltatások (TV, internet, telefon)

- További aktív témák...

- Akciós Windows 10 pro + Office 2019 professional plus csomag AZONNALI SZÁLLÍTÁS

- AKCIÓ! Épített KomPhone R5 4500 16GB RAM 240GB SSD RX 6500 XT 4GB GAMER PC termékbeszámítással

- ÁRGARANCIA! Épített KomPhone Ryzen 7 9800X3D 64GB RAM RTX 5090 32GB GAMER PC termékbeszámítással

- Telefon felvásárlás!! Xiaomi Redmi Note 10, Xiaomi Redmi Note 10s, Xiaomi Redmi Note 10 Pro

- Bomba ár! Lenovo ThinkPad T490 - i5-8GEN I 16GB I 256GB SSD I 14" FHD I Cam I W10 I Garancia!

Állásajánlatok

Cég: CAMERA-PRO Hungary Kft

Város: Budapest

Cég: PC Trade Systems Kft.

Város: Szeged

A Reflex-szel is igaza lett az NVIDIA-nak, amit meg az Anti-lag 2 óta tudunk. Már várom, hogy az FSR is mikor fog átvariálódni a konkurenciák mintájára.

A Reflex-szel is igaza lett az NVIDIA-nak, amit meg az Anti-lag 2 óta tudunk. Már várom, hogy az FSR is mikor fog átvariálódni a konkurenciák mintájára.

Pont mint egy 7900XT

Pont mint egy 7900XT

![;]](http://cdn.rios.hu/dl/s/v1.gif)

, ahogy sok helyen mondták már, az RTX4090 az NVIDIA legnormálisabb kártyája a felhozatalban, mert az előző generációhoz képest tényleg nagy előrelépés és még csak VRAM-ban sem fojtották le.

, ahogy sok helyen mondták már, az RTX4090 az NVIDIA legnormálisabb kártyája a felhozatalban, mert az előző generációhoz képest tényleg nagy előrelépés és még csak VRAM-ban sem fojtották le.