- iPhone topik

- Android alkalmazások - szoftver kibeszélő topik

- Profi EKG-s óra lett a Watch Fitből

- Honor 400 Pro - gép a képben

- Samsung Galaxy S21 és S21+ - húszra akartak lapot húzni

- Honor Magic7 Pro - kifinomult, költséges képalkotás

- Samsung Galaxy A54 - türelemjáték

- Milyen okostelefont vegyek?

- Telekom mobilszolgáltatások

- Apple iPhone 16 Pro - rutinvizsga

-

Mobilarena

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

villamos

őstag

Emlegetett páratlan újjú patás...

-

S_x96x_S

addikt

ebben a témában más a véleményünk.

> Azt mondtam hogy az AMD nem hülye hogy ezt meglépje gamer fronton.

Én meg azt mondom,

hogyha piaci részesedést akar, akkor kockáztatni kell.Attól még, hogy a high end teljesítményben

nem akar versenyezni - adhat olcsón VRAM -ot.----------

A termék portfóliókban az átfedések már régen teljesen normálisak

konkurenciánál ott van pl.

- NVIDIA RTX 4000 Ada Gen - ( 20GB ECC; 360Gb/s )

- NVIDIA RTX 4500 Ada Gen - ( 24GB ECC; 432Gb/s )

vs.

- RTX 4090 Ada ( 24GB - 1008 GB/s ) <---- GamingHa az nvidia meglépte, akkor az AMD -től se hülyeség.

-

hahakocka

őstag

Lehet 1000 éves de miért nem hallottam sose róla? Vagy mert ahogy írják mindig túl drága valamiért ...

vagy mert hát nem jók a tapasztalatok. A Computer Imperium is elég régóta létezik, de sajnos sose vásárolnék ott.

vagy mert hát nem jók a tapasztalatok. A Computer Imperium is elég régóta létezik, de sajnos sose vásárolnék ott.

Nem tudom mit pörögnek sokan ezen a már humorizált 32gb os kiadáson ha lesz lesz de tuti nem mostanság és erősen gyanús hogy munkakártya lesz. -

S_x96x_S

addikt

(32GB)

> Az AMD nem hülye hogy kirúgja a lábát a radeon pro 7800-7900 kártyájának.

néha meg kell lépni dolgokat !

ahogy az nvidia is az RTX 5090 32GB -vel a saját 32GB és alatti Quadro kártyáinak

állít konkurenciát - ugyanaz lenne az AMD-nél is.

( amúgy is a PRO/Quadro kártyáknál az ECC memória elsődleges )Ha a market share a fontos, akkor meg kell lépni dolgokat !

A 16 magos AMD desktop cpu -kat is sokan furcsálták az elején,

főleg mert ezáltal a termékportfólió átfedésésbe került a workstation/szerver procikkal.

De a vásárlók megszokták - és az AMD is túlélte a váltást :-)-----------------------

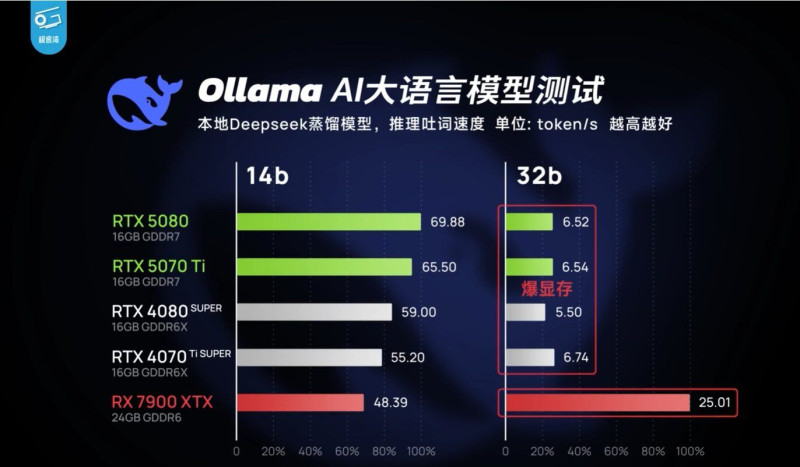

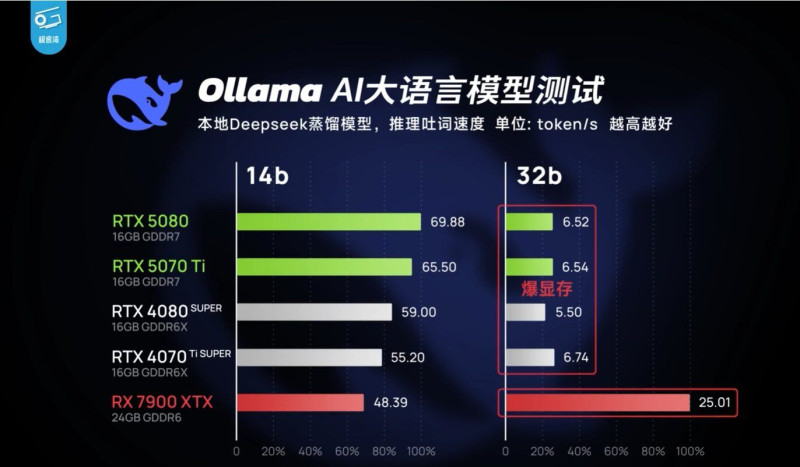

A sok VRAM kifejezetten ideális az AI -hoz ( Deepseek, LLM )

( és nekem nincsenek kétségeim, hogy hamarosan a játékokban is megjelennik az újdonság - vagyis kelleni fog a VRAM)egy nagyobb modellnél ( deepseek:32b )

az új RTX 5080 ; RTX 5070 Ti - 16 GB -al

egyáltalán nem rug labdába egy 24GB-os RX 7900 XTX -el szemben.

( lásd jobboldali oszlop - 3.8x nagyobb token/s teljesítmény ! ) https://x.com/9550pro/status/1892234998251471255

https://x.com/9550pro/status/1892234998251471255 A piaci helyzet jelenleg az,

hogy az NVIDIA oldaláról jelenleg nem elérhető

16GB -nál nagyobb VRAM-os consumer GPU.

( a 4090 már ki van vezetve, az 5090 meg extrém drága és nem is kapható ; az 5080 meg maradt 16GB -on. )

úgyhogy egy relative olcsó 32GB -os kártyára lenne igény.

Persze ott a StrixHalo és jön majd az nvidia digits is - de ezek mellett elférne még egy olcsó 32GB -os kártya is; mivel nem mindenkinek van annyi pénze,

hogy két kütyüt vegyem ( egyet játékra és egyet AI-re )Kell olcsó 32GB VRAM -os kártya - nevezzük bárminek is.

-

-

-

hokuszpk

nagyúr

"Miért nem adott egy 800 dolláros konzolba AMD egy Zen4 CPU-t és egy RDNA 4 GPU-t?"

ha a Zen4 nem is, de a Zen3 mehetett volna, az is 7nm ; a kompatibilitas is megmarad, és gyorsabb is. Tippre az volt a problema, hogy APU es ujra kellett volna legozni az egeszet azt meg kimatekoltak, hogy úgy már sokba van.

-

Kajoszbobber

lelkes újonc

Hát igen, miután mindenről le késtek ami pénzt pumpalt volna nem marad más mint hogy jó lenne innovalni valahogy. Elnézve az 5070ti előzetes rumor tesztjét ha letisztazodnak az árak és beállnak a készletek és valóban olyan erőss az 5070ti nem látok indokot a 9070xt mellett, ami mindenben rosszabb lesz értem ez alatt a felskalazast a frame gent, tuning modellek esetén a fogyasztást.

-

Abu85

HÁZIGAZDA

Akkor a CPU-ra. Az egyik legfontosabb tényező a konzolokon, hogy bizonyos szempontból konzisztensek legyenek. A szimulációt nehéz skálázni, míg a grafikát könnyű. Tehát amikor terveznek egy játékot, és tudják, hogy egy konzolnak mennyi teljesítmény van a CPU felöli részén, akkor arra tervezik az egész program futtatását. Emiatt az a teljes generáció során nem változik, még a köztes generációkban sem, ami azért nagyon-nagyon fontos, mert erre az x teljesítményre van és lesz tervezve az összes játék.

Például a mostani generációban az Xbox Series X CPU-ja gyorsabb, mint az Xbox Series S dizájnja. De semmit nem nyer vele az Xbox Series X, mert a programnak kötelező futnia az Xbox Series S konzolon, vagyis arra tervezik a játékokat. És a terv annyi, hogy ne is legyen CPU-limited, mert a PC-n a CPU-limitet az generálja, hogy tucatnyi konfigurációt összerakhatsz, de a konzolon tudod, hogy mid van, és tervezhetsz rá. Erre van a Sony-nak és a Microsoftnak is nagyon jó profilozója. Ha a PC-n tudnák a fejlesztők, hogy mi van a user oldalán, akkor itt is be tudnák úgy lőni, mivel nem tudják ezt, ezért a CPU-limit PC-n egy valós jelenség lehet, mert nem tudnak rá tervezni. Max megadnak egy gépigényt, ami kb. jó, de a konzol az mást. Ott fix hardver van, fixen tervezett programfuttatással. Ennél egyszerűbb környezet nincs a fejlesztő számára, mert pontosan tudja, hogy mi kell ahhoz, hogy nagy átlagban hozzon a program 30 vagy 60 fps-t, vagy amire éppen céloznak. És mivel tudják ezt, meg tudják írni a programot úgy, hogy ez meg is legyen. PC-n erre nem képesek, mert sok a konfiguráció, plusz konzolon még a szoftveres háttér is nagyon kötött, nincs az API-ban se több tier az egyes funkcióknak, nincs igazán driver sem, nincs az OS-nek memóriamenedzsmentje. PC-n maga a CPU-limit is máshol van AMD, NVIDIA és Intel GPU-val, mert a driverek hatékonyságában is igen extrém különbség van, lásd itt: [link] , [link] - tehát alapvetően a CPU-limit a leghamarabb Intel driverrel fog megjelenni, NV driverre később, míg legkésőbb AMD driverrel. Ebből látható, hogy PC-n is mennyire bonyolult kérdés a CPU-limit, mert hiába használod x CPU-t, mert lehet, hogy azzal az AMD drivere nem limites, de az NV és az Intel drivere az.

A PSSR-re a Sony már az elején reagált, hogy annak két verziója van. Az egyik a régebbi fejlesztőkörnyezethez, míg a másik az újhoz. Erre azért volt szükség, mert bizonyos játékokat még a régebbi kittel készítették, és nagyon-nagyon sok munka lenne azokat áttenni az új kitre. Emiatt a Sony inkább visszaportolta a PSSR-t a régi kitre, de mivel az nem támogat egy csomó API funkciót, így nem tudják úgy használni a PSSR-t, mint az új kiten. Nyilván ezekben a régi kitet használó játékokban nem érik el a hardver egyes részeit, mert maga a fejlesztőkörnyezet nem támogatta ezekhez a hozzáférést. És itt mindegy, hogy a PSSR követeli-e, nem kap akkor sem elérést, mert nem tudja, a régi SDK, hogy mit kezdjen az új hardverrel, még nem ismerték a PS5 Pro konzolt, amikor az SDK alapspecifikációját tervezték.

Persze van úgy, hogy a fejlesztők átrakják a játékot az új SDK-re a PSSR miatt, a Stellar Blade esetében ezt tették. Rögtön teljesen más volt az eredmény, mert egy csomó PSSR funkció nem csak fallbackben futott, hanem eljutott a hardverig, mert az új SDK már értelmezni tudta, hogy mi van a PS5 Próban, konkrétan tudta, hogy mit címez a rendszer. Nem kell hozzá fallback kód.2. A felskálázás fontos része lesz a Switch 2-nek, de az RT nem hiszem. Kb. 70 GB/s-od van sávszélből az alap móddal, miközben az RT a leginkább sávszélzabáló folyamat a sok memóriaelérés miatt. Nagyjából olyan szintű RT-t lehet majd hozni, mint a mobiltelefonokon. Mert ott sem igazán a hardver maga limitálja a folyamatot, hanem a sávszél. Például a Qualcomm RT hardvere azért nem annyira rossz, ha a számítási teljesítményt nézzük, de semmit sem ér, mert a sávszél lekorlátozza, és megközelítőleg sem lehet használni a hardvert. Még amikor az ARM bővebben beszélt egy előadáson az RT-ről, akkor tértek ki egy kérdésre, ami azt taglalta, hogy a nyers adatok tekintetében a Qualcomm IGP-je elméletben is sokkal több ütközésvizsgálatot végez, és erre volt az a válasz, hogy amíg nem raknak az IGP mögé 300 GB/s-os sávszélt, addig ennek nincs valós haszna, mert nem elég gyors a memória elérése, hogy legyen elég adatod etetni ezt a hardvert. És nyilván mobilban egy jó darabig nem lesz még 300 GB/s-od.

3. Nagyon egyszerűen. A konzolra a játékokat nem úgy fordítják, mint PC-re. A PlayStation 5-ben simán használnak olyan jellegű, Assembly szintű optimalizálást, ami csak a Zen 2-n működik. Tehát technikailag lecserélhetik a CPU-t Zen 4-re, az utasítások zöme megegyezik, de lassulni fognak a programok, mert maga a Zen 2-re szabott kód nem fut júl futni a Zen 4-en. Maga a megírt optimalizálás jellege olyan, hogy újra kellene írni az egészet, hogy jól fusson, mert a Zen 4 dizájnja megváltozott, tehát a Zen 2-es trükkök nem működnek már rajta. Ugyanez igaz volt a PS4->PS5 váltásnál, csak ugye ott a CPU-k között a teljesítménykülönbség legalább 3-szoros volt, tehát a kódfuttatás hatékonysága lehet, hogy esett bő 60%-ot, de ezt kompenzálta a hardverek közötti teljesítménykülönbség. Egy Zen 2->Zen 4 váltás ezt nem tudja kompenzálni, így lassulna a már kiadott játékok futtatási sebessége.

A Switch 2 esetében ilyen probléma nem létezik, mert az egy új konzol, új dizájnnal, és ha alkalmaztak is Switch-re szabott, Assembly szintű optimalizálást, akkor is legalább kétszer gyorsabb lesz az új gép a CPU hardverét tekintve, így lehet, hogy esni fog a hatékonyság egy már kiadott Switch játékot tekintve 50-60%-kal is, de kompenzálja a különbséget az erősebb hardver.

RDNA 4 GPU-t pedig azért nem kapott a Sony, mert ott is van egy olyan tényező, hogy a shadereket nem fordítják le, hanem szimplán binárist szállítanak a programban. Ezért nincs a PS5 játékokban "várj 20 percet, amíg a shadereket fordítjuk jellegű kezdőképernyő". Viszont így az RDNA 4 nem jó, mert binárisan nem kompatibilis az RDNA 2-vel. Egyszerűen egy játék se indulna el rajta. Szóval a Sony az RDNA 2-t használta továbbra is, hogy megőrizzék a bináris kompatibilist, és bizonyos részegységeket átemeltek az RDNA 4-ből, olyanokat, amelyek ezt a kompatibilitást nem veszélyeztetik, vagyis kapott a PS5 Pro új hardverelemeket, de az ISA nem módosult ezzel, csak nagyon-nagyon picikét, jól megtervezetten, hogy ettől még a régi játékok fussanak. Plusz a PSSR-re terveztek egy érdekes megoldást a hardverbe, ami a VGPR-ekkel bánik furán, de ez nem teljesen hardveres módosítás, inkább egy extra állapot a hardveren belül.Amire utalni akartam a korábbi hsz-ben az az, hogy a Switch 2, azért dizájnban is 7 éves dizájnt kap. Kb. olyan régi a CPU és az IGP része az ISA-t tekintve. Egy PS5 viszont kb. egy időben kapta meg az RDNA 2-t, mint a Radeonok, és kb. egy éves volt akkor a Zen 2, amikor megjelent.

Azért ne mondjuk már azt, hogy ez ugyanaz, mint 2025-ben kiadni egy 2018-ra tervezett hardveres alapot. És nyilván a Nintendo tök boldogan elfogadott volna 2024-es hardveres alapot, csak nem kapták meg azon az áron, amiben gondolkodtak, mert a Switch 2-nek fontos az ár, hogy sokat adjanak el belőle, emiatt a Nintendo nem tud sokat fizetni a rendszerchipért. Az NVIDIA pedig nem fog sokat adni, ha nem kap elég pénzt. Szóval 7 éves technikát kaptak. Ettől még a konzol valószínűleg jó lesz, csak ettől még a hardver benne 7 éves már a start pillanatában. -

-

huskydog17

addikt

"Ez azért jelenti, hogy a SoC-nak 20 dollárba kell beleférnie, mert a megszokott árazást akarják a japánok, és így ez a költségkerete rá a Nintendónak."

7 órával később:

2025-02-16 14:50:07

"Emiatt ugyanazok a feltételek is. 15 dolláron belül kellett SoC, mert ez fér bele ebbe a stratégiába.Hej de gyorsan változik a Nintendo stratégiája.

Holnap vajon már csak $10 vagy $5 lesz? 7 óra alatt 25%-ot esett a Switch 2 SOC költségkerete. Vajon hol áll majd meg? Tudom, biztosan megint értelmezési problémáim vannak.

Holnap vajon már csak $10 vagy $5 lesz? 7 óra alatt 25%-ot esett a Switch 2 SOC költségkerete. Vajon hol áll majd meg? Tudom, biztosan megint értelmezési problémáim vannak.

-

Quadgame94

őstag

Két versenyző van. És nagyon az látszik, hogy az AMD most is csak követi a zöldeket. Nem hoztak előrelépést, szegmentálással és az árképzéssel eléggé gyenge generációt tettek le az asztalra. Namost erre reagálni kell. Az AMD-nek lehet szerencse, mert így drágábban adhatja az elején a kártyáit, de a végcél miatt ez egyáltalán nem pozitív sem nekik, sem a vásárlóknak. Mármint, hogy az NV-t követik mindig. A saját kezükbe is vehetnék a sorsukat és árazhatnának jóval az NV alá, de most sem lesz így. Majd talán nyáron már ahogy beszéltük is jobb árak lesznek.

Az hogy kivel fog versenyezni még nem tudjuk. Az 5080 nagyon közelvan a 4080 Superhez, márpedig ha lesz 300W+ 9070 XT ezen a szinten akkor igenis annak a kártyának is versenytársa lesz. Főleg 800 dolláros áron.

MInt fogyasztó miért ne kritizálhatnám az NV-t ezért a generációért? Elnézést hogy jobbat és többet vártam. Ha az AMD-t kritizálni lehet, hogy az NV-t követi, akkor az NV-t is lehessen hogy szembeköpi a vásárlóit egy 5070-el.

-

Abu85

HÁZIGAZDA

Az lehet, hogy próbálták, de az egyik first party fejlesztő szerint a pályázatban ugyanazok voltak az igények, mint a Switch esetében. Ez azért jelenti, hogy a SoC-nak 20 dollárba kell beleférnie, mert a megszokott árazást akarják a japánok, és így ez a költségkerete rá a Nintendónak. Nyilván, ha az NV 20 dollár alatt ad nekik zsír új rendszerchipet, akkor hülye lett volna a Nintendo 7 éve elavult dizájnt választani. Szóval a bőrkabátos lehet frusztrált emiatt, de kizárólag az ő döntésén múlott ez, mert aligha lehetett ismeretlen számára a költségkeret.

Hála az égnek a Nintendo az API-nál hallgat a fejlesztőkre. Szóval az NVN2-t ugyan fejlesztik, de a Vulkan sokkal nagyobb szerepet kap majd a következő gépen. Ez a multiplatform címek miatt fontos, mert nagyon-nagyon eltér az NVN és az NVN2 a két másik konzol API-játék, vagy a PC-s explicit API-któl. A VK_EXT_shader_object például elsődlegesen a Switch miatt érkezett. Ez marha fontos lesz, hogy jöjjenek a gépre a multiplatform címek, mert NVN/NVN2-re nagyon-nagyon-nagyon nehéz ezeket portolni.

A PS5 Pro GPU limites még mindig. Igazából még erősebb GPU-t akartak bele rakni, de nem tették meg, mert túl nagy költség lett volna. A CPU-val sosem volt baja a Sony-nak, és a fejlesztők is inkább a GPU-ra panaszkodtak, hogy abból van kevés erő.

#69062 Land : Február első hetében kapták meg ez első szállítmányokat a kereskedők. Januárban csak mintát kaptak, ami egy-két darab.

Hetente kétszer szállítanak az AMD partnerei.---

32 GB-os Radeon lesz, de PRO verzióban, nem pedig klasszikus Gaming kiadásban.

-

S_x96x_S

addikt

> A XTX a csúcs kártyát jelenti teljesítményben,

Valószínüleg te jobban tudod - de a lényeg szerintem az, hogy:

- Az AMD módosította a névadási stratégiáját, hogy jobban tükrözze az nVidia modelljeit.

- Nvidiánál a csúcskategória a számokban jelenik meg (például 090 > 080 > 070 > 060), illetve további jelzők (TI, SUPER) is léteznek; ami csak annyit jelent, hogy valamivel jobb teljesítményű - mint az alap.

- Az AMD számozása azt jelzi, hogy a 9070-es nem a csúcskategória, és a termékek közötti különbség az XT és XTX jelzéssel egyértelműbb.

- Így a 9070 XT és az XTX modell körülbelül a nVidia 5070 TI és 5070 SUPER modellekhez hasonlítható ( névadásban )persze sok apró nüansznyi eltérés van,

és ezekre megint az válaszolnám,

hogy dehát az AMD módosította a GPU névadási stratégiáját

-------------újra:

#69073 Kajoszbobber

> "Velemenyem szerint ez az ''XTX'' jelzo megcsufolasa lenne.

> Mintha Jensen egy 80as vgat Titannak hivna "![;]](//cdn.rios.hu/dl/s/v1.gif)

marketing. RTX 4060 TI :

- Titanium is a chemical element; it has symbol Ti and atomic number 22.

- A titán a periódusos rendszer kémiai elemeinek egyike. Vegyjele Ti, rendszáma 22 -

Komplikato

veterán

-

Kajoszbobber

lelkes újonc

Hat az majd kiderul, mert azert 4070ti rt teljesitmeny az nem olyan fu de massziv. Termeszetesen sajat magukhoz kepest decens elore lepes, amit mar velemenyem szerint a 7000-es szerianak is tudnia kellett volna, de a toptol messze maradnak.

A masik hogy azert az fsr terhoditasa messze nem olyan merteku mint a dlss-e, hiaba pakoljak jatekokba valahogy a 2.0 megy a legtobbe, es meg csak mostanaban kezdik rakosgatni a 3.0-3.1 kombot. Velemenyem szerint ezen dolgokban is erosodni kene az amd-nek.

En is orulok a valtasnak, csak ez az eddigi marketing szoges ellentete, 7000es vga tulajkent joggal ereznem magam hulyenek nezve (persze a marketingen valtoztatni kellett, en megertem, a tulajok mar annyira nem biztos)

(persze a marketingen valtoztatni kellett, en megertem, a tulajok mar annyira nem biztos)Hogy meddig lesz a blackwell? En ugy gondolom az evben jon a rubin az ai, es hpc piacra, es jovo ev vege fele meg consumer piacra. addig lesz super jelzovel 3gb-os frissites szamos 5000es modellnel. Az mcm-et nem merem betippelni. Szerintem, de ez a testver topik temaja

-

Kajoszbobber

lelkes újonc

Ezt ertem en, viszont eddig az RT az ordogtol valo volt, a 9000-es szeria meg ott fejlodik a legtobbet ami eddig nem szamitott

, a pure raszter detto, az volt az isten, abban nem tud majd tobbet mint a tobb mint 2 eves modellek, de lesz fsr 4, a felskalazas eddig ordogtol valo volt (mondjuk minosegileg nem is volt toppon), es az lesz a masik selling point, mert elkvileg az fsr4 a 9000es szerian fog a legszebb kepet adni. Micsoda fordulat ez

, a pure raszter detto, az volt az isten, abban nem tud majd tobbet mint a tobb mint 2 eves modellek, de lesz fsr 4, a felskalazas eddig ordogtol valo volt (mondjuk minosegileg nem is volt toppon), es az lesz a masik selling point, mert elkvileg az fsr4 a 9000es szerian fog a legszebb kepet adni. Micsoda fordulat ez

A nagy szoras vicces lesz, mert ha jol sejtem lesznek olyan modellek amik sokkal jobban fognak menni mint az olcsobb modellek, erdekes lesz na. -

-

Quadgame94

őstag

Ha elmarad 10%-al a teljesítménye akkor biztosan nem lesz 650 dollár. Az nagyon rossz ár lenne. Rosszul fogalmaztam, amikor azt írtam, hogy "biztosan" kijelenthető. Amikor árat írtam, akkor kontextust mindig adtam.

Fan factor nincs bennem. Így is - Úgy is lesz új kártyám. Az a kérdés, hogy melyik.

A legrosszabb, hogy itt jó árak nem lesznek jó ideig. Remélem, hogy legalább az induló ára alacsony lesz és arra majd visszacsökkent.

-

yarsley

aktív tag

> Fájdalmas

Ugyan, ne légy már ilyen negatív, szerintem tök szórakoztató.

#69051 X2N :

>Szerencsétlen módon covid miatt előbb kiadták mint kellett volna

Fhuuu, akkor már értem miért volt olyan WTF érzésem, hogy itt egy új konzol, játék meg sehol...Szerintem a januári megjelenéssel lett volna 750 a kártya, aztán most 7050ti msrp miatt visszább veszik kicsit... Vagy nem, mert a 10% vám az csak meg fogja dobni az árakat.

-

X2N

őstag

Dehogy lett cpu limites a "Pro" konzol. Ugyanolyan limites mint a PS5 is volt, nem véletlenül, konzolon kijelenteni azt h cpu limit van az vicces, eleve nem akartak bele erősebb cpu-t. Szerencsétlen módon covid miatt előbb kiadták mint kellett volna, így gyengébb a hardver nyilván, de ez akkor is csak egy "konzol".

A játék engine-k viszont rosszabbak lettek, és cpu igényesebbek is mert komplexebbek és kell a mindenféle Raytracing hogy ugyanazt szebben, nagyobb felbontáson fusson. Stagnál az ipar. -

Kajoszbobber

lelkes újonc

Mikor en ezt itt irtam hogy mar reg van ara jott a sok mesemondo hogy de hat ez mind a nagy terv resze, es most itt olyan taktikazas van hogy megorul az egesz ipar

Semmi nincs, kinlodas, mindket reszrol maximum.

Semmi nincs, kinlodas, mindket reszrol maximum.

Csoro leakerek mar annyi forgato konyvet leakeltek hogy egy abbol csak bejon, aztan majd jon az en megmondtam, bizony... Kozbe januar ota mindenki mond mindent, 450 dollaros ostoba feltetelezesektol mar vegig jarunk mindent 1000 dollarig. -

Alogonomus

őstag

Mivel a leakerek eléggé egybehangzóan 500 dollár fölé, de bőven az 5070 Ti 750 dolláros ára alá jósolják a 9070 XT árát, valamint szintén nagyon egybehangzóan a 7900 XT és 7900 XTX közé jósolják a teljesítményét, így a megállapításod legfeljebb úgy lenne helyes, hogy: "Kivéve, ha egyhuzamban másodszor tévedne hatalmasat szinte minden leaker az AMD érkező kártyagenerációjával kapcsolatban."

-

hahakocka

őstag

[link]

Itt egy friss techspotos 5080 teszt pl s látható igaz 1440p-4K ban csak hogy a 7800xt jobb vagy egál a nála drágább 4070 nél.

De van még lehet szemezgetni a youtubeon is a a 3-4 másik általam említettel pl. hasonló mód eredménnyel. Gondolom majd lesz tesztelés a 5060-5070-9070 esekkel kérdés megfutatják e ott a régieket is újra. No akkor majd sok sok féle teszt lesz akkor majd ténylegesen kiderül nem csak 1 oldal tesztje kerül terítékre.Persze elhiszem hogy fejlődik, AMD nél is 380 nál meg 580 nál is ez volt annó, de azért hirtelen 1 hó alatt 10-15% okat pl nem szoktak. Ezek is évek alatt fejlődtek kb 10-15% ot ha talán a driverekkel.

Hát igen az Indiana Jones már FDHD be kiírhatja néktek hogy hé 8gb vramod van nem elég! S volt ismerősöm aki szembesült is ezzel a felirattal.

Aztán jön a 1440p ott is már necces a 12gb le kell venni ezt azt, az FG meg DLSS meg RT már nem tuti játszik stb. S aki frissen 1-2 éve vagy most vesz ilyen kártyát azért na rácsodálkozhat hogy 240-250e ért mit kapott.Hát igen a DLSS-FSR nagy segítség a fejlesztők jó részének. Nem kell optimalizálni azóta

Kevesebb költség, kevesebb idő, jobb fizu-munka arány stb

Kevesebb költség, kevesebb idő, jobb fizu-munka arány stb

-

Busterftw

nagyúr

En is, csak nem ertek egyet azzal hogy nem vesszuk figyelembe az egesz csomagot.

A 4060 user nem fog 4K-n RT-zni, sot amugy 4K-n jatszani, mert 1. az Nvidia sem oda szanja, 2. valoszinuleg nincs 4K monitorja, 3. egyertelmu, hogy nem fog ertelmesen futni.Az Nvidia tehetne tobbet a kartyakra, de ne tegyunk ugy, hogy nem ismerik a jatekos piacot, nem dolgoznak egyutt a fejlesztokkel. Az Nvidia eddig kb mindig koppra hozta a vga kategoriakat, de nagy atlagban nem erte oket hatranyosan vs a konkurencia.

-

Abu85

HÁZIGAZDA

Igen, ez a DGF. Volt már hír róla korábban, de most van kiadva, és teljesen gyártófüggetlen, mindkét explicit API-val kompatibilis, illetve csak egy extra shadert kell hozzá szállítani, hogy a GPU elvégezze a kitömörítést. Nagy átlagban a memóriahasználat a jelenlegi hatodára csökkenthető így a geometriára levetítve.

#68679 Jacek : Ezer éve vannak textúratömörítések az API-kban, tehát az nem újdonság. DXT gyűjőnévek futnak. De geometriára nem igazán volt ennyire egységesen kidolgozott alternatíva.

-

Abu85

HÁZIGAZDA

DirectX 12 és Vulkan API-ra lesz támogatás.

Shader modell 6.0-s meghajtót igényel csak. Gyakorlatilag ez azt jelenti, hogy bármelyik DirectX 12/Vulkan GPU-val fut. A shader modell 6.0 miatt kell egy kicsit frissebb driver, de igazából ez bőven megoldható. Igazából 2020 óta mindenkinek van ilyen meghajtója.

-

Jól emlékeztem amúgy erre a Die Size 390 mm² - GCD Size200mm² - MCD Size 36.6 mm² x4 kavarásra, lásd Techpowerup oldal

Most már tényleg zavaros, most ez egy monolitikus chip, vagy valami jó kis nextgen chiplet fusing ez

Most már tényleg zavaros, most ez egy monolitikus chip, vagy valami jó kis nextgen chiplet fusing ez

Én egyre kevesebb esélyét látom a 650 dollár vagy alatti 9070XT-nek, hacsak nincs pariban teljesítményileg az 5070 Ti-val sem.

A kihozatali arány miatt látom, hogy elkerülhetetlen az alsó hangon 700 dodós ár:

- Míg az 5070Ti alapját adja a "selejt" GB203, a fullos GB203 az 5080-ba kerül. Azaz a fullos Navi48 a selejtes GB204 ellen menne, olcsóbb GDDR rammal.

-

-

Pkc83

őstag

Nem tekintek egyáltalán az Nv-re mint ősellenségre sőt,hiszen az rx580-am óta NV-t használok én is (1060,1660 super, 2060, és most 3060Ti).

Ami pozitív azt el kell ismerni (leggyorsabb vga, DLLS, RT....) ami viszont már gusztustalan azt is (árazás, a 3x-es széria óta tartó hazudozás(készlethiány stb.)) -

Pkc83

őstag

Lakásból és autóból is lehet használtat venni vagy lakás esetében mondjuk pár km.el arrébb és máris olcsóbb.. A bolt jogos ott minden annyi amennyi viszont azt muszáj megvenni mert ugye enni kell.

Igen a 600w-ot az 5090-re értettem(ami egy vicc) a 600k-t meg az 5080-ra mert ugye az 5090 bőven millió felett van

"az emberek zöme a 4080 és 7900XTX alatti kategóriákból választ"

Nekem is csak 3060 Ti-m van mert nekem elég.

Viszont ha a két "csúcs" kártya esetében csak úgy tudnak (gyakorlatilag elhanyagolható) előrelépést felmutatni,hogy cserébe jóval többet fogyaszt és jóval drágább is mint az előző gen akkor a középkategóriában sem várhatunk csodát. +10-20% erő, +15-30% fogyasztás és persze +20-50% felár.

Erre mondom én,hogy kapják be a f......t és nézzék hülyének az a......t! -

Pkc83

őstag

Nem ezt írtam, persze,hogy jó a több Vram.

A bajom azzal van,hogy az elmúlt években olyan szinten túlárazták a Vga-kat,hogy az már a nem normális kategória szerintem. Főleg annak fényében,hogy érdemi előrelépés alig tapasztalható. Élő példa erre az "új" 5xxx-es széria ami valójában egy széthúzott 4-es lenne GDDR7-el szerelve meg szoftveres rásegítéssel, 600w-os fogyasztással. És mindezt 600k-tól felfelé..Nekem is lehetne 5900-am ha akarnám de őszintén előbb adnám az árát egy hajléktalannak mint az Nv-nek. Mondom ezt úgy,hogy Nv-t használok.

És pont azért mert: "Ez nem kenyér, szórakozás."

-

hokuszpk

nagyúr

"Egyáltalán nem lehetetlen, én nem ebből a szempontból kérdeztem, hogy lehetséges e, hanem hogy ez szerinted megvalósulhat e ez, hogy ugyan azon a gyártáson jobbak mint a zöldek?"

azt nemmondom, hogy jobbak lesznek, mint a Zöldek, de hogy ésszel nagyot lehet előrelépni ugyanazon a technológián, azt az AMD 7nm -en már bebizonyította a Ryzen 3xxx vs 5xxx procikkal. Mondjuk nekem már a 3800XT is sokkal jobbnak tűnt, mint a sima 3800X, mert magasabbra boostolt, és jobban kitartota a boost órajeleket -- lehet, hogy abból is csak szimplán megnyertem a sziliciumlottót -- aztán az 5700G még annál is jobb volt ~10% -al, pedig azon felezett cache van. Az 5800X meg még erre is pakolt ; bár igazából csak benchekben meg esetleg játékokkal jön ki, de utóbbit nemtudom megerősíteni, mert nem játszom.

-

Alogonomus

őstag

A gondolatmenetedet továbbvezetve, a 600 dolláros Nvidiás kártya és 1000 dolláros konkurens kártya azonosnak érzékelhető RT teljesítménye addig valósul meg, amíg az adott szoftver fejlesztője kiemelt figyelmet fordított arra, hogy az alkalmazott grafikai megoldások memóriaigénye a 600 dolláros Nvidiás kártyának nehogy problémát okozzanak. A Silent Hill például jó példa az "elég memóriás" helyzetre. Az új Spider-Man esetén már látszik némi probléma. Az Avatar már határozottabban jelzi a problémát, míg a Star Wars Outlaws kapcsán már egyértelműen látszik a kevés memória hatása.

Az idő előrehaladtával pedig csak még egyre nehezebb lesz, egyre több kompromisszumot igényel majd egy program memóriaigényét a 12 GB-os határ alá szorítani, így egyre kevesebb játékban érhet majd el a 600 dolláros kártya olyan teljesítményt, mint az 1000 dolláros kártya, vagy akár egy újabb mondjuk 500 dolláros kártya, amin viszont van 16 GB memória. -

Alogonomus

őstag

Az Nvidia Image Scaling első bevetését illetően tényleg igazad van, mert az Nvidia tényleg előbb tette be a lehetőséget a driverébe, mint hogy az AMD betette volna a saját beígért képességét. A gyors reagálás attól viszont még nem volt sikeres az Nvidia oldalán, hiszen látványosan gyengébb képminőséget produkált a NIS, bár tényleg hamarabb vált elérhetővé.

Mint a viccben:

– Mennyi 2x2?

– 5!

– Nem jó a válasz!

– De legalább gyors voltam! -

Devid_81

félisten

Ha most Ok valoban 40% os market share-re gyurnak akkor akarmit is akartak az Nv-hez hasonlitagatni azt -100-150$ -ert kellene adjak, de akar -200$ is lehet, pl 5070 Ti -200$ 5070-100$

Es ahogy mondod, ehhez kepest Intel, aki joforman gyermekcipoben jar VGA szempontbol AMD/NV-hez kepest, is tud valamit adni, nem megy a b@/f@$zoskodas korulotte, van amijuk van es oda arazzak ahova nagyjabol valo aztan csokolom.

-

Devid_81

félisten

What?

Evek ota az AMD alaaraz egy picivel az Nv kartyaknak es varjak a csodat ami nem tortenik meg a piacon.

Most is ez lett volna a celjuk, csak valoszinuleg sem az arakrol sem a teljesitmenyrol nem volt most eleg infojuk az ipari kemek altal.

Hol van ebben az a resz amikor az Nvidiat hozom ki mint hibas?Szerk: rossz hozzaszolast neztem, hogy mire valaszoltal, viszont tovabbra sem ertem miert hobas itt az NV?!

Nah mindegy majd mondom, vagy sem

-

S_x96x_S

addikt

A Strix Halo egy hordozható Threadripper APU, kompromisszumok nélkül.

AMD's Strix Halo - Under the Hood

https://chipsandcheese.com/p/amds-strix-halo-under-the-hood

Jan 14, 2025draft gépi fordítással - pár részlet - kedvcsinálónak.

""""

Mahesh Subramony: Ez a rendszer egy valódi munkaállomásnak készült, egy igazi erőgép. Szinte viccelődöm azzal, hogy ez egy "Threadripper", amely elfér a tenyeredben. Nem kötöttünk kompromisszumokat. Ezek a processzorok 512 bites adatbusz-szélességgel rendelkeznek, és teljes értékű asztali architektúrát képviselnek. Az alkatrészeket hatékonyság alapján válogattuk (binning), így előfordulhat, hogy nem érik el azt a maximális órajelet, amelyet az asztali változatoknál tapasztalhatunk.

"""""""

George Cozma: Most áttérünk a CPU-ról erre a hatalmas SoC lapkára, amely tartalmazza az iGPU-t. Tudom, hogy ezt a diákban nem említették, de van 32 megabájt úgynevezett MALL vagy Infinity Cache. Hogyan működik ez együtt a CPU magokkal? Hozzáférhetnek a CPU magok ehhez a 32 MB gyorsítótárhoz?Mahesh Subramony: Nem férhetnek hozzá. Szeretném ezt egyértelművé tenni. A MALL célja a grafikus sávszélesség növelése. Ez az eredeti koncepció. Az egyetlen számítási egység jelenleg, amely használja, az a GPU. Rugalmas kiosztási politikával rendelkezik, de az alapértelmezett konfiguráció szerint a GPU forrásból történő írások települnek a MALL-ba. A CPU írásai nem kerülnek bele a MALL-ba. Elméletileg egy konfigurációs bit megváltoztatásával lehetne ezen módosítani, de jelenleg nincs olyan alkalmazási terület, ahol a CPU sávszélességének növelésére lenne szükség.

Ezt a kapacitást fenntartjuk, és korábban végeztünk olyan módosításokat, amelyek lehetővé tették például a kijelző vagy a videó kódolás/dekódolás számára, hogy a MALL egyes szeleteit használják. Vizsgáltuk annak lehetőségét is, hogy például a VCN (Video Codec Engine) vagy a kijelző használja a MALL egy részét, vagy akár az AI inference motor tárolhasson benne súlyokat. Kísérleteztünk a kiosztási lehetőségekkel, de a jelenlegi konfigurációban kizárólag a GPU írhat a MALL-ba.

Ahogy újabb és újabb felhasználási lehetőségeket fedezünk fel, szoftveres frissítéssel módosíthatjuk a konfigurációt, például firmware-rel változtathatjuk meg, hogy a MALL hogyan legyen felosztva. Bizonyos részeket lefoglalhatunk a GPU számára, vagy más számítási motorok, például az NPU vagy a videó kódoló számára.

Jelenleg a MALL legjobb kihasználása az, ha a grafikus egység használja sávszélesség-növelő gyorsítótárként. A grafikus motor az egyetlen, amely olyan konfigurációval rendelkezik, hogy minden írás bekerül a MALL-ba. A MALL koherens, tehát amikor a CPU hozzáférést kezdeményez, ellenőrzi, hogy az adott adat ott található-e, mert lehet, hogy egy még el nem kötelezett írás van benne. Ha az adat már nincs ott, akkor a kérő félhez továbbítja azt. Ez a koherens fabric része.

Minden memóriába írás előtt van egy ellenőrzés a MALL-ban is, így egy extra gyorsítótárként funkcionál. Azonban, aki a legnagyobb előnyt élvezi a MALL használatából, az a GPU. Az írások a MALL-ba kerülnek, és ha magas a találati arány, az olvasási sávszélesség jelentősen, akár két számjegyű százalékkal is növekedhet. Mivel diszkrét GDDR memóriával szemben LPDDR memóriát használunk, tisztában vagyunk azzal, hogy a memória kapacitása korlátozott, de a MALL ezt ellensúlyozza sávszélesség-növelőként. Egy ilyen nagy GPU, amely 40 számítási egységgel rendelkezik, tökéletesen kihasználja ezt.George Cozma: Ha már a koherenciáról beszélünk, a MALL az összes számítási egység végső koherencia szintjeként működik?

Mahesh Subramony: Nem, továbbra is van egy blokk az adatfabric struktúránkban, amely közvetlenül a memória vezérlő előtt helyezkedik el. Ez a végső koherencia pont. Az összes memóriahozzáférés ezen keresztül történik. A memória az interleave konfiguráció szerint van felosztva különböző vezérlők között. Ha egy adott memória sort kell elérni, akkor az adott vezérlőhöz kell fordulni. Az adatfabric IP, amely a memória vezérlők előtt található, kezeli az összes beérkező kérést.

Ellenőrzi a profilstruktúrát, hogy a CPU rendelkezik-e a kérdéses adatsorral, vagy hogy a MALL-ban található-e az adat. A koherencia pont tehát ezen az adatfabric IP-n keresztül valósul meg, amely a memória vezérlőket kezeli.

""""""""

George Cozma: És hogy visszakanyarodjunk a beszélgetés végén oda, ahol kezdtük, a CPU és annak fabric struktúrája. Mekkora memória-sávszélességhez férhet hozzá egyetlen CCD, tekintve hogy az 32 bájt/ciklus olvasási sebességgel rendelkezik?Mahesh Subramony: Ez igazából attól függ. Egyetlen CCD képes telíteni a sávszélességet. Nincs szükség mindkettőre, egyetlen CCD is ki tudja használni a teljes adat-sávszélességet. Akár négy, de még két mag is képes erre, ha megfelelő írási műveletsort futtatunk, mivel a CPU minden egyes ciklusban képes kérést kiadni. A CCD CPU minden ciklusban képes új kérést indítani.

Végül az fogja korlátozni a teljesítményt, hogy milyen gyorsan érkezik vissza a válasz. A válasz visszatérése attól függ, hova megy a kérés és milyen útvonalon tér vissza. A végső korlátozó tényező az lesz, hogy a memória-kérések milyen gyorsan kerülnek kiszolgálásra az UMC (Unified Memory Controller) oldalán. Egy-két CPU mag már majdnem teljesen ki tudja használni a rendelkezésre álló sávszélességet, ha az írási folyamat megfelelően optimalizált, például nyitott oldalak (open pages) esetén.

De ismétlem, a megfelelő olvasási és írási arány mellett néhány CPU szál is képes teljes mértékben telíteni a sávszélességet. Mindazonáltal, ha a sávszélességről beszélünk, úgy gondoljuk, hogy az NPU és a GPU profitál belőle a legtöbbet, inkább, mint a CPU. A CPU szempontjából a késleltetés (latency) a kritikus tényező, különösen terhelés alatt. Az a célunk, hogy akár 15-20%-os terhelés mellett is elkerüljük a késleltetés meredek növekedését (hockey stick effect).

Nem próbáljuk mesterségesen csökkenteni a késleltetést csak az első kérés esetén, miközben minden további kérés hátrányosan szenvedne az elérési idő miatt. Célunk az egyenletesen alacsony késleltetés biztosítása a CPU számára, miközben a GPU számára biztosítjuk a nagy sávszélességet.""""

-

Alogonomus

őstag

"ők mennyit lépnek előre a 7900XTX hez vagy az Ada-hoz képest?"

Hát azért az állítólagosan 300 wattból 4080 szint és 220 wattból 4070 TI Super szint eléggé jelentős előrelépés lesz az RDNA3-as eredményekhez képest. Már persze, ha a majdani tesztek is visszaigazolják ezt a pletykát. -

Jacek

veterán

GFnow pl annyira ment most unnepek elott hogy nem adtak elofizetest mar az ingyenesre meg korlatozott volt a 1440p -is.

Amit linkeltem a nv talalgatosba azokhoz az AI osszegekhez a gamming egy nulla.. 500 millard AI adatkozpontokra gondolom mindenki legyeskedik ott de jelennpillanatban az NV a nagy hal a AI teren.

-

Alogonomus

őstag

Az Nvidiánál a teljes Gaming kategória bevétele teszi ki a bevételek 15%-át, nem önmagukban a Geforce kártyák.

"Our products for the gaming market include GeForce RTX and GeForce GTX GPUs for gaming desktop and laptop PCs, GeForce NOW cloud gaming for playing PC games on underpowered devices, as well as SoCs and development services for game consoles"Annak a kategóriának a relatív hozzájárulása peedig a teljes cégcsoport bevételéhez képest intenzív ütemben csökken. Néhány negyedévvel korábban még majdnem 30% volt, ami most 15%. Az Nvidia elkormányozta a hajóját a gaming irányból a szerverekbe szánt gyorsítók irányába.

Az Nvidia valóban könnyen – sőt a teljes bevételre vetítve csökkenő arány miatt egyre könnyebben – kompenzálni tudná a gyártópartnerei BOM-kit miatti magasabb gyártási költségeit, de a bejelentett 550 és 750 dolláros árat nem tudná semissé tenni, csak legfeljebb a gyártópartnerek 150% memóriát tudnának kínálni változatlan áron, ami pedig ahogy írtam is, a kártyák teljesítményére vajmi kevés pozitív hatást gyakorolna.

-

Alogonomus

őstag

"Nvidia lejjebb viszi az árat. miért ne?"

Nem véletlenül a Super és/vagy Ti verziókkal "csökkent" árat az Nvidia, és nem az eredeti termékek árát viszi lejjebb. Egy árcsökkentés mindig árt a gyártó/termék megítélésének, hiszen akkor az eredeti árán nem fogyott. Egy generáción belüli frissítésként tálalt megoldással viszont a negatív következmények jelentős része elkerülhető. Ahogy Jensen önérzete azt sem bírná el, hogy valaki nála erősebb terméket kínáljon, úgy valószínűleg arra sem bólintana rá, hogy valamelyik terméke árát hivatalosan és jelentős mértékben megvágja a piaci kereslet fenntartása érdekében.

"Egyből engedélyezi a gyártóknak a 18 gigás 5070 és /vagy super verziót."

Még ha rendelkezésre is állna elég 3 GB-os GDDR7 modul, azok akkor is jelentősen drágábbak lehetnek, mint a sima 2 GB-os modulok, vagyis a másfélszeres memóriakapacitású kártyák vagy még drágábbak lennének, vagy a gyártóknak kellene lenyelniük a jelentős extra költségeket, amivel valójában még gyorsabbá sem válna az 5070, csak a memóriavész alól szabadulna ki. Az 5070 Ti pedig még annyit sem nyerne a memória 24 GB-ra növelésével, hiszen a 16 GB még kényelmesen elég, ha nem 4k+PT+FG+egyéb fut egyszerre. -

Abu85

HÁZIGAZDA

Nem is akar az AMD nyílt lapokkal játszani. Miért mondanák el előre, hogy mit tud a hardver? Majd megtudjátok, ha elérhető lesz. Ha nem tudják kivárni a felhasználók, akkor vegyék meg az RTX 50-eket. Ha az NV árat csökkent 25%-kal, akkor rosszul döntöttek a korai vásárlók. De ez a lényege annak, ami most történik. Senki sem tudja, hogy mi a helyzet, senki sem tudja, hogy mit tegyen. És ez volt a cég. A pletykagyárak pedig naponta próbálják a korábbi hazugságaikat beilleszteni az eseményekbe új hazugságokkal. Iszonyatosan jó a műsor.

Egyébként az AMD-re jellemző volt az elmúlt generációk során, hogy két stratégia szokott működni náluk. Ha érezték, hogy nem elég jó a termék, akkor előre marketingelték, előre mutogatják a teljesítményt, kiválasztanak előnyös szituációkat, és azt reklámozzák már a review-ek előtt. Ha érezték, hogy elég jó a termék, akkor nagyon titkoltak mindig mindent. Ebből ki tudtok indulni, mert ez 10 generáció óta így volt az AMD-nél. Nyugodtan vissza lehet nézni.

-

S_x96x_S

addikt

> Ez egy nagyon visszás dolog, nem nyílt lapokkal játszanak.

ha az AMD meg tudja nyerni a marketing háborút

( és nem a csatát ) az elég nagy löketet ad az eladásoknak.

valószínüleg a cél, hogy a fejekben össze-mosódjék az üzenet:

- RDNA4 RX 9070 >Jensen [ RTX 5070~ 4090 Performance]

> Ha kijön 40 % árelőny akkor az Nvidia reagál, mint mindíg.

> 1, Nvidia lejjebb viszi az árat. miért ne?Az jó lenne,

- de a GDDR7 -t nem az nVidia gyártja, azt be kell szerezni;

- és a GDDR6 olcsóbb. -

-

Abu85

HÁZIGAZDA

De mit vágjanak az áron? Eleve úgy lőtték be, hogy sokkal gyorsabbnak gondolták a last gennél az RTX 50-et.

Nem, nincsenek egymás teljesítményével tisztában. Látod, hogy az AMD is mennyire elszámolta megát. Nagyon csalóka az, hogy tudják mondjuk a shaderek számát. Ez nyilván kiszivárog, de például a körítésről nincs információjuk. Tehát a legtöbb, amit tehetnek, hogy a számból, amit megtudtak, logikusan következtetnek a körítésre. Az AMD valószínűleg azért számolta azt a 30-50%-ot, mert azt hitték, hogy a két shader tömb egyesítése az NV-nél azt jelenti majd, hogy megduplázzák a regiszterterület méretét, illetve a konkurens warpok számát, hogy a kétszer hosszabb feldolgozót etetni is lehessen. De az NV csak a feldolgozót növelte meg a duplájára, az etetéséhez szükséges egyéb erőforrásokat nem fejlesztette.

Ugyanez igaz az NV nézőpontjából is. Tudják a shaderek számát, a logikai felépítést az RDNA 4-ben, de lövésük sincs arról, hogy milyen operációkat rakott át az AMD dual-issue módra. Tehát számolhatnak a best case-szel, ahogy az AMD tette az RTX 50-nél, és akkor ugyanannyi shader mellett a dizájn teszem azt gyorsul 50%-ot. De erről az NV-nek nincs fogalma. Lehet, hogy nem rakott át az AMD annyi operációt dual-issue-ra, és akkor lehet, hogy csak 10%-ot gyorsult a dizájn. Nincs fogalmuk róla.

-

Abu85

HÁZIGAZDA

Hogyne közölték volna. Minden partnertől volt ott ember a New York-i konfin. Kereskedők is voltak ott. Mindenki tudott mindent, sőt, most is tud mindent. Némelyik kereskedő nem is érti, hogy mit hord össze a média erről. Fingjuk sincs, hogy min megy a cirkusz, de nekik ettől már hetek óta tisztázva van minden. Az biztos, hogy őket senki sem kérdezte meg. De amúgy nem is nyilatkozhatnának, mert az AMD kegyetlenül megbünteti őket, ha idő előtt mondanak bármit is. És gyorsan utána tudnak ennek járni. Emiatt sem beszélt senki semmiféle dolgot a média felé, de persze mivel egy random kínai kissrác írt valamit a Chiphell fórumba, így mindenki tud mindent.

Elsődlegesen azért nem mondanak semmit sem erről, mert nem akarják idő előtt megmutatni az NV-nek, hogy miről van szó. Ezt valójában az NV sem tudja. A fogyasztása egyébként lényegesen jobb lesz, minden eddigi dizájnnál. Bár nem hiszem, hogy ezt védik nagyon, mert elég egyszerűen kiszámolható, élvégre az azért nyílt titok, hogy a 7800 XT volt a minta, annak a fogyasztását akarják hozni a 9070 XT referenciával.

-

Abu85

HÁZIGAZDA

Tudnak róla, csak NDA-s előadások ezek.

Az AMD nem szállít a kereskedőknek VGA-t. Ne

kik is lesz termékük, de ettől a generációtól kezdve a kereskedők ezt nem rendelhetik. Ez azért van így, mert a partnerek nagyon kellemetlennek érezték, hogy az AMD bizonyos VGA-k szintjén velük versenyez, így az AMD ezt úgy oldotta meg, hogy lesz saját VGA is, de csak a cég webshopjából érhető el, és csakis magánszemélyeknek. Emiatt a kereskedőknek innentől Radeont csak a gyártópartnerek szállíthatnak. És pont emiatt az AMD nem is emelhet árat, mert nincs termékük a kereskedőknél. De egyébként nem emeltek amúgy listaárat sem, most is ugyanannyi, amennyi volt a hónap elején. Ne üljetek fel fórumhozzászólásoknak, vagy X bejegyzéseknek.Az NV megmutatta a múlt héten, hogy mit tud az 5080. 4080+10-15%. Nem hazudott az NVIDIA ebben. Már vannak mérések is, amik azt mutatják, amit az NV előre mondott.

Semmi gond nincs az AMD-nek ezzel. Elszámolták magukat, azt hitték, hogy az NV jobban gyorsít, de mindegy, mert az eredetileg tervezett ár elég jónak tűnik nekik. Akár lefelé is mehetnek, mert kb. 250 dollárjuk van a VGA-kon. Ennyi az eltérés az előállítási költség és a végső ár között.

-

Abu85

HÁZIGAZDA

Az AMD a CES-sel párhuzamosan New Yorkban tartott egy zárt előadást, és már ott bejelentette az árakat. Azokon azóta nem változtattak. Az árakat az NV előadása előtt jelentették be. Ott voltam ezen az előadáson.

Nem mellesleg az AMD úgy számolt, hogy az 50-es széria a 40-eshez viszonyítva 30-50% között gyorsul, nem tudtak róla, hogy csak 10-30% között. Erre a Q&A alapján lehet következtetni, mivel mondta az egyik ember, hogy 30-50%-ot kalkuláltak az NV-nél a generáció közötti sebességugrásra, és ehhez tervezték az RDNA4 pozicionálását.

Az egyetlen dolog, ami változott a januári prezi előtt az a TBP. Eredetileg ez 285 watt volt, és hozzá 3 GHz fölötti órajel. Ezt visszavették 260 wattra a 9070 XT esetében. Állítólag ez azért történt, mert arányaiban nem lassult sokat a kártya, de jóval jobb lett a perf/watt. Meg így gyakorlatilag a 7800 XT fogyasztását célozták meg, hozzá pedig 7900 XT/XTX környéki teljesítményt, vagy bizonyos körülmények között ennél nagyobbat is. Aztán a gyári tuningos modellek majd játszanak a teljesítménnyel, nagyjából +400-500 MHz van a GPU-ban erre a célra, amit léghűtéssel ki lehet hozni, ha van elég tápcsati a NYÁK-on. Nagyjából 3,5 GHz a plafonja a Navi 48-nak, viszont ehhez +100-130 watt is kell.

-

S_x96x_S

addikt

-

Quadgame94

őstag

Csak kiváncsiságból... Nem lehetne ezt az X3D technológiát GPU-ra isátköltözteni? Főleg, hogy már a 9800X3D esetében nem is felül helyezkedik el maga a hatalmas cache. Ha az MCM dizánj megvalósul akkor én bőven látok egy olyanra lehetőséget, hogy a GCD lapka alá tegyen az AMD nagyméretű cache-t.

-

Jacek

veterán

Tuti egyeztetnek, ezert nem kell csodat varni..

1-2 het es kiderul.a dolog, ertem az atnevezest de elore megmondta nincs felso kategoria, ettol meg megy a hoborges hogy ha megkapod az elozi gen csucs teljesitmenyet 300-400 dollarral olcsobban az nem elore lepes.. pfff tenyleg?

NV-nel is lesz elore lepes csak szoftveresen sokkal nagyobb mint vasban , bennem meg GPU fejlesztokent elnek ezek a cegek, az hogy ugy lesz elore lepes hogy lenyegeben kamu hagyjuk de ugy lesz hogy nem adod oda az elozonek

Helyen kezelve en megnezem a rastert ezutan a szoftveres kinalatot aztan eldontom hogy veszek egy 2080Ti-t

-

Alogonomus

őstag

Nem a jelenlegi állapotra utaltam, hanem arra, hogy az AMD kártyapiaci részesedése abban a 2006-2007-es időszakban indult el a lejtőn, amikor az Intel eladásai az Intel Core szériának köszönhetően megtáltosodtak, és minden prebuilt gyártó Intel Core gépeket akart kiadni, amihez viszont feltételként szabta meg az Intel az aktuális Nvidia kártya felhasználását, hogy azzal gyengítse az AMD pénzügyi helyzetét. Az Nvidia az egyezségből következő fix és jelentős keresletre alapozva tudott szintén megtáltosodni, mert a prebuilt gyártóknak még felár mellett is inkább megérte Nvidia kártyát beépíteni, csak ne veszítsék el az Intel processzort a gépükből.

Az Nvidia többek között valószínűleg pont azért is nyitott a CPU-tervezés irányába pont most, mert az Intel bukdácsolásainak következtében egyre inkább kacsintgatnak az AMD felé a prebuilt gyártók – az addig Intelhez kimondottan hűséges DELL megjelenése az AMD bemutatón például kimondottan komoly sajtóvisszhangot generált –, és még azelőtt kellene az AMD CPU-k teljesítményét megközelítenie az Nvidia CPU-nak, mielőtt az AMD végérvényesen elhúzna az Inteltől, vagy az Intel magába roskadna, és így az AMD szintén megjátszhatná azt, hogy amelyik prebuilt gyártó AMD CPU-hoz AMD GPU-t társít a gépeiben, az a prebuilt gyártó kapja kiszámíthatóan az X3D, Threadripper és Epyc szállítmányok jelentős hányadát, így pedig a piacon a termékei versenyképesek maradnak. You scratch my back I scratch yours.

-

Alogonomus

őstag

Azért a felsorolásból az se maradjon ki, hogy stratégiai partnerségre lépett egymással az Intel és az Nvidia az AMD kiszorítására, és az Intel CPU mellé szinte minden esetben Nvidia GPU-t kellett tenniük az olyan nagy prebuilt gyártóknak, mint a DELL/HP/LENOVO/IBM és társaik. És ez a szövetség csak mostanában kezd repedezni a Zen-éra berobbanásának és az Intel mélyrepülésének a hatására.

-

hahakocka

őstag

RT-ben talán nem? Sima raszterben is? Bár az NV slideon FC6 ban csak 25% al volt jobb 4070TI nél max 4080 super kicsit esetleg ja fölötte, de 440e ft lesz kb amennyi most egy 7900XTX kb 24gb rammal. 4080 super mondjuk 500 fele is van még. A 9070XT ára a lényeg ha hozza 4080 at akkor 170e ft al akár olcsóbban. (270e ft vs 440e ft)

-

Alogonomus

őstag

Jelenleg még a most kifutó generáció számít egyedül olyan viszonyítási pontnak, amihez képest lehet meghatározni az új kártyák játékokban elvárható teljesítményét. Raszterben a Radeon kártyák a viszonyítási pont, sugárkövetésben pedig a Geforce kártyák. Egyik területen egyikhez mérik, másikban másikhoz.

-

Televan74

nagyúr

-

hokuszpk

nagyúr

miért "sajnos" ? megint a rövidtávú gondolkozás. Ha magasabb lesz az AMD bevétele, több jut fejlesztésre, erősödhet a verseny. Az meg hosszútávon nekünk jó.

és ha felfele vitték az árat, az azt is jelentheti, hogy a 9070/XT erősebb, mint az NV gondolta volna ; csak ár / teljesítményben a "helyére tették".

-- vagy nem.

meglássuk. -

Abu85

HÁZIGAZDA

A Reflex 2 kiegészítése. Arra használ három generált képkockát. Ennek nem a késleltetés lesz az igazi gondja, hanem az, hogy a harmadik generált képkocka is az alap jelenetadatokkal dolgozik, tehát ha mondjuk lősz egy ellenfélre a harmadik generált képkocka alapján, akkor a valós jelenetadatok szerint könnyen lehet, hogy az ellenfél már nincs ott. Ergo a lövés nem talál, akkor sem, ha úgy érzed, hogy durván fejbeküldted. Ezt majd gyakorolni kell DLSS4 FG mellett, mert érdemes a mozgó ellenfél elé célozni kb. fél centivel, hogy találjon a lövés, mert a valós jelenetben már ott járhat az ellenfél.

-

hahakocka

őstag

RT S raszterrel vegyesen akár valós lehet az àbra.

Azèrt az 5070Ti S 9070XT ha 4080 felé lesznek bőven K kèpes kártyâk lesznek, csak nem Path Tracinggel .

Na akkor mègis 15.-e? Na èrdekes lesz. Persze az igazi látnivaló majd a független tesztek lesznek. Àllítólag sokan megkaptàk már a tesztkártyàkat mindkettő fèltől

-

Alogonomus

őstag

MLiD is 15-e környékéről tud, mint a bemutató várható időpontja.

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- iPhone topik

- sziku69: Szólánc.

- Veszprém és környéke adok-veszek-beszélgetek

- Magga: PLEX: multimédia az egész lakásban

- iPhone-t használók OFF topikja

- Luck Dragon: Asszociációs játék. :)

- Milyen videókártyát?

- Melyik tápegységet vegyem?

- Elektromos rásegítésű kerékpárok

- Milyen asztali (teljes vagy fél-) gépet vegyek?

- További aktív témák...

- ASUS TUF Gaming GeForce GTX 1660 Ti OC 6GB GDDR6 192bit

- Gainward RTX 4080 Phoenix 16GB - 12 hónap garancia

- XFX Radeon RX 580 GTS XXX Edition 8GB 256 bit GDDR5 Jó állapotú

- Csere-Beszámítás! Sapphire Nitro+ RX 7800 XT 16GB GDDR6 Videokártya! Bemutató Darab!

- ASRock Radeon Challenger Pro RX 6700 XT 12GB OC Videokártya

- LG 45GS95QE - 45" Ívelt OLED / 2K WQHD / 240Hz 0.03ms / NVIDIA G-Sync / FreeSync Premium / HDMI 2.1

- Telefon felváráslás!! Xiaomi 13T, Xiaomi 13T Pro, Xiaomi 14T, Xiaomi 14T Pro

- BESZÁMÍTÁS! MSI B450M R7 2700X 32GB DDR4 512GB SSD RTX 3050 8GB Rampage SHIVA Thermaltake 500W

- Csere-Beszámítás! Asus Tuf RX 9070 XT 16GB Videokrátya! Bemutató darab!

- ÁRGARANCIA!Épített KomPhone i5 14600KF 16/32/64GB RAM RTX 5070 12GB GAMER PC termékbeszámítással

Állásajánlatok

Cég: CAMERA-PRO Hungary Kft

Város: Budapest

Cég: PCMENTOR SZERVIZ KFT.

Város: Budapest

vagy mert hát nem jók a tapasztalatok. A Computer Imperium is elég régóta létezik, de sajnos sose vásárolnék ott.

vagy mert hát nem jók a tapasztalatok. A Computer Imperium is elég régóta létezik, de sajnos sose vásárolnék ott.

, ne rontad el

, ne rontad el ![;]](http://cdn.rios.hu/dl/s/v1.gif)

Kevesebb költség, kevesebb idő, jobb fizu-munka arány stb

Kevesebb költség, kevesebb idő, jobb fizu-munka arány stb