- Samsung Galaxy A52s 5G - jó S-tehetség

- Okosóra és okoskiegészítő topik

- Apple iPhone 13 Pro Max - őnagysága

- Rekord vékony lesz a Z Flip7 is

- Red Magic 10 Air - gaming telefon is lehet kecses

- Samsung Galaxy A56 - megbízható középszerűség

- Mobil flották

- Honor Magic5 Pro - kamerák bűvöletében

- Poco X3 Pro - hardverfrissítés

- NFC Ring, avagy gyűrű, amivel fizetni is lehet

-

Mobilarena

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Abu85

HÁZIGAZDA

válasz

#85552128

#26182

üzenetére

#85552128

#26182

üzenetére

A Samsung nem áll olyan jól a 7 nm-rel, mint a GloFo és a TSMC. A GloFo is csak azért áll nagyon jól, mert az IBM "felvásárlásával" megvették az IBM eljárását, ami ugye a legelső 7 nm-es node-nak készült. Ez 2018Q1-re lesz alkalmas a kísérleti gyártásra, ahogy a TSMC is ekkorra tervezi a kísérleti gyártást a saját node-ján.

A TSMC és a GloFo node-ja annyiban fog különbözni, hogy a TSMC a saját gyártástechnológiáját az ultramobil eszközökre optimalizálta, tehát a nagyobb lapkákhoz, GPU-khoz kevésbé illik. A GloFo ennek a fordítottja, mivel az IBM nem volt érdekelt anno az ultramobil eszközökben, így inkább a nagyobb lapkákhoz optimalizálták a fejlesztést. -

Abu85

HÁZIGAZDA

válasz

#85552128

#26119

üzenetére

#85552128

#26119

üzenetére

Attól függ, hogy mi lesz a Vega 10 árazása. Ez egyelőre még nincs eldöntve.

De lesz egy kisebbik Vega, ami később jön. Viszont halottam már a gyártóktól, hogy az 1070 ellen be akarnak dobni egy Polaris 10-et magasabb órajelellel, csak megvárják, amíg kijönnek a tavaszi játékok, mert a régebbi játékokban nem lesz gyorsabb, csak az új DX12-esekben.

-

Abu85

HÁZIGAZDA

-

bozont

veterán

válasz

#85552128

#26103

üzenetére

#85552128

#26103

üzenetére

Pedig Q1-ben igen illett volna már a boltokba kerülnie. Én vártam rá, mivel AMD párti vagyok és ha már tud Freesync-et monitorom, azt is kipróbálnám, de 1440p-hez inkább az 1070 teljesítménye kellene. Az meg egyelőre nincs AMD vonalon (Fury nem kell). Szóval vagy veszek egy 480-at, aminek a teljesítményével nem biztos hogy maradéktalanul elégedett leszek (sőt valószínű), vagy 1070. És az utóbbi érik, bármennyire is máshogy szerettem volna. Legalább egy konkrét megjelenési időpontot mondhattak volna.

Ez a mai bemutató egy nagy semmi volt.

-

-

-

Petykemano

veterán

válasz

#85552128

#26105

üzenetére

#85552128

#26105

üzenetére

Az egyik slideon volt egy kép a CU-król és az a vega NCU optimalizálták frekvencia és IPC tekintetében.

Még abban lehet összeszorított fogakkal és ujjakkal reménykedni, hogy az ábra nem csak jól mutatott, hanem valóban köze volt a valósághoz és a nagy lapkaméret oka az, hogy tényleg duplázódik a frekvencia a korábbi sűrű designokhoz képest.

-

#45185024

törölt tag

válasz

#85552128

#26005

üzenetére

#85552128

#26005

üzenetére

"Csak tudnám milyen logika alapján kapta ez a Freesync 2 nevet"

-A HDR már 10 bites színmegjelenítés, ebből a szempontból sokkal jelentősebb változás IT szempontból mint a 4K ahol "csak" a pontok száma nőtt.

Az egy más kérdés hogy hány ember fogja tudni valósan megkülönböztetni a HDR-t a simától.

Jöhetnének már freesync-es TVk, mondjuk 50 colon

-

Petykemano

veterán

válasz

#85552128

#25731

üzenetére

#85552128

#25731

üzenetére

elképzelhetetlennak tartom, hogy a Vega10 lapkába beleépítseenk 384bit-es GDDR5 (ez 6 nagy kupac a lapka szélén) vezérlőt ÉS 4096bit HBM2 vezérlőt. Ha megnézed a Tonga és a Fiji lapkaképét, láthatod, hogy elképesztő pazarlás lenne. Az meg nem valószínű, hogy Vega10 néven jönne ilyen is, meg olyan is.

A másik meg hogy mainstream kártyára 384bit-es memvezérlővel 12GB-ot rátenni is elképesztő pazarlás. Pazarlás = feleslegesen drága és feleslegesen fogyaszt sokat

Amit ezen a táblázaton látunk a a számok alapján az az, hogy meg tudták oldani kevesebb Shader egységgel is ugyanazt a teljesítményt, amivel lehet nyerni egy kis lapkaméretet, amit buknak a memóriavezérlőn és a magasabb frekvencia miatt semmivel nem jobb a fogyasztás.

Azt is mondhatnám: ha így néz ki ez a széria, ezzel felesleges kijönni.

-

leviske

veterán

válasz

#85552128

#25731

üzenetére

#85552128

#25731

üzenetére

Azért a Vega 10 a GP106 ellen elég merész. BÁR, ha -ahogy a SR esetében- itt is olcsóbban jön ki, hogy sok lapkát gyártanak ÉS esetleg még meg is tudják oldani, hogy HBM és GDDR5 is használható legyen, akkor végülis hihető.

MOD: Viszont a Fury 2 és Nano 2 egy kicsit fantáziátlannak érződik.Nem lett volna rossz, ha bevezetnek valami új nevet, ha már a Fiji nem futott be komoly sikert.

-

Habugi

addikt

válasz

#85552128

#25697

üzenetére

#85552128

#25697

üzenetére

Ne fesd az ördögöt a falra..

![;]](//cdn.rios.hu/dl/s/v1.gif)

OSD/rögzítésre +1, megjegyzem ha jól tudom utóbbi része volt már a GamingEvolvedApp pakknak is, ami nálam vírus kategóriát képviselt már nagyjából a raptrkodás óta, így minden telepítés során gondosan kigyomláltam.

(#25698) Ren Hoek:

Elvileg már a Win10 van fókuszban, a magam részéről is így értettem, innen jött a párhuzam hogy rakhatom majd fel az új driver okán az Anniversaryt, mert kétlem hogy nélküle jól érzi majd magát az új fícsörpakk, végtére is majd fél éves, kis túlzással arra írták az egészet..

"Max nosztalgiarendszernek Win 7 dualban"

Nálam február (Win10..) óta így van, van egy kincstári Win7 64-em is másik partíción, többek közt ezért tudom azt, hogy a Crimsonnak tulajdonított anomáliák ~90%-a a Win10 sara és/vagy annak hogy még nem érzik kellően a ritmust hogyan lehetne/kellene rá pöpecül drivert írni..

Az első hónapokban amint valami érdekességet tapasztaltam helyből átbootoltam Win7-re, driver/egyéb szinten gyak. egyező softveres környezetbe és egy huszárvágással megszűnt minden probléma/anomália/érdekesség. Azóta is bármelyik topicban ismerek rá egy vagy több, általam már felderített/ily módon kipróbált "hibára", rendre felhívom rá a figyelmet hogy kéne oda egy Win7/Win8.1 mert ez bizony nem a Crimson sara.

Ilyen például a manapság is oly népszerű random BS, még ha csak 2-3mp-re sötétül is el, no signal kíséretében vagy anélkül.., ez semmi más csak a Win10 Tdr Delay faxsága.., amit egyébként ~két perc orvosolni.

-

Habugi

addikt

válasz

#85552128

#25684

üzenetére

#85552128

#25684

üzenetére

Hú basszus, ez nem akármilyen Pakk lesz, őszintén bevallom nem kicsit tartok tőle..

Saját OSD (?), "Chill", Wattman támogatás a 200/300/Fury szériának is (

), semmiből kikapart extra teljesítmény..

), semmiből kikapart extra teljesítmény..Emelem kalapom előttük, így első látásra nagyon bitang listának tűnik, csak egyből azt látom benne hogy pl a foskupac Win10 mellett mennyi probléma adódhat ezzel az új driverrel/fícsörkakkal az első hetekben/hónapokban..

Speciel a magam részéről mint olyasvalaki aki totál PT nélkül játszik elég keményen MSI AB-hez kötött vagyok, namost ha visszamelékszünk milyen viszonyt ápolt a Crimson és az AB a kezdeti időkben.., megjegyzem lehet már nincs is szükségem az AB féle totál PT Off-ra, bő fél- háromnegyed éve nem csekkoltam mire elég magában a PE, 16.11.5 momentán, este lehet megnézem.

A rohadt Anniversaryt azt viszont már tuti hogy nem tudom tovább halasztani.., kijövetele előtt 24h-val tiltottam, azóta is problémamentes "volt" a rendszer.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#25383

üzenetére

#85552128

#25383

üzenetére

A DXDIAG teljesen jót mutat, ugyanis annyi a teljes elérhető videomemória, amit ott kiír. Annyit tud az alkalmazás is detektálni. Attól, hogy nem érted, hogy mire vonatkozik, még nem hülyeség a kiírt érték.

A Fury X 4 GB-os VGA. Csak az egyes meghajtókon keresztül a memória máshogy van kezelve. Vagy éppen nem kezelve, mert például explicit API-val az adott alkalmazás kezeli, és nem a meghajtó. Ez az amit nem értetek meg, hogy a memória fizikailag rajta lehet, de nem feltétlenül egybefüggő 4 GB-os területként kezeli a szoftver.

(#25384) Jack@l: Semmiféle védekezés nincs erre a DX11-en. Ez az API egyáltalán nem tud semmit a VRAM-ról, van neki egy erőforrása, ami tulajdonképpen egy elérhető videomemóriára vonatkozik, és az pontosan annyi, amennyit a DXDIAG kiír a képernyő fülön az össze memória pontnál. A memória szegmentációjáért a DXGI, míg a ténylegesen dedikált memória allokációjáért a WDDM és a driver duója felel.

A rendszermemória teljesen más lapra tartozik. Azt az operációs rendszer kezeli teljesen, és nincs elrejtve egy gyártói driver mögé.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#25379

üzenetére

#85552128

#25379

üzenetére

Nem számolhatod bele. Az ugyanis egy olyan terület, ami nem látható még a D3D meghajtónak sem. Ennek az oka, hogy azon a területen belül ne éljenek a WDDM szabályok, vagyis lehessen úgy is törölni, hogy közben ne kelljen minden egyes rétegen megkérdezni, hogy az az adat használatban van-e még. Ezt a területet egyébként a Mantle meghajtója kezeli, konkrétan ennek az API-nak a beépítése tette lehetővé ezt az optimalizálási formát. De ez a program és az API oldaláról is transzparens, mindenről egy nagyon elszeparált környezet dönt az AMD kernel driverén belül. Ennek az oka pedig az, hogy marhára nem szabályos az az optimalizálás, amit az AMD csinál, de a D3D11-nél már hozzászokhattunk a "driver magic"-hez.

Ha egy ilyen 3rd party program valóban azt tudná mérni, hogy a VRAM-ból mennyit használ a futtatott alkalmazás, akkor Fiji lapkákon nem mérhetne 3,5 GB-nál többet.

Nem elég régóta nézed ezeket a VRAM-ot mérő programokat, mert régen igen tipikus volt, hogy többet mutatott, mint a valós VRAM mennyisége. Azután bevezettek egy kézi limitet, így már sosem mutathat többet annál, amennyi VRAM az adott VGA specifikációjában van.

Kérdés mit tartasz hülyeségnek az API oldalán. Üsd fel a DXDIAG-ot, és nézd meg a képernyő fülön az összes memóriát. Több lesz, mint amennyi VRAM van a kártyán.

Egy program ezt az értéket tudja kiolvasni az API által, ami egyébként teljesen valós, mivel maga a driver elfedi a valós VRAM-ot, ugyanakkor memória van az erőforráshoz, és ez egy kombinált érték lesz a VRAM és a rendszermemória alapján.

Egy program ezt az értéket tudja kiolvasni az API által, ami egyébként teljesen valós, mivel maga a driver elfedi a valós VRAM-ot, ugyanakkor memória van az erőforráshoz, és ez egy kombinált érték lesz a VRAM és a rendszermemória alapján.(#25380) Jack@l: Én úgy mondanám, hogy lebeg az erőforrás körül. Ezen a memóriaszeleten nem érvényesek a WDDM szabályok, tehát nem igazán lehet a valós erőforráshoz használni, mert szabálytalan erőforrásként létezik a rendszerben.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#25377

üzenetére

#85552128

#25377

üzenetére

Attól függ, hogy mit nevezünk működésnek? Ha valóban az igazságot írná a program, akkor 3,5 GB-nál nem jelezne többet a Fury X-re.

Az API-nak pedig fingja nincs róla, hogy a VRAM-ból mennyi memória van használva. Nem kap róla semmi adatot. Teljesen más adatokat tud visszajelezni, de abból nagyon nehéz következtetni a VRAM-használatra.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#25375

üzenetére

#85552128

#25375

üzenetére

A driver semminek nem jelenti le, hogy mennyi a VRAM használat, az API pedig nem tudja, hogy mennyi. Ezek a programok belsőleg felvett rutinok alapján tippelnek.

[link] - itt leírtam, hogy miképp működik az AMD-nek a DX11-es memóriakezelése.

A gyorsítótár azért koncepció manapság az AMD-nél, mert a felhasznált VRAM 70-80%-ához a program a futtatási idő jelentős része alatt hozzá sem nyúl. Egyszerűen csak ott van az adat, mert túl drága lenne törölni. -

Abu85

HÁZIGAZDA

válasz

#85552128

#25329

üzenetére

#85552128

#25329

üzenetére

A sample nem igazán kínálat. Azért sample, mert nem végleges, egy egyszerű termékminta a tervezéshez. Amikor tömeggyártásba kerül, akkor lesz egy termékből valós kínálat, mert eléri a végleges státsuzt. Persze saját felelősségre akárki árulhat sample-t is, csak erre se garancia, se semmi. És ugye mennyiségi problémák is vannak, mert egy 200 dolláros VGA-t nem árt gyártónként átlagosan 70k-100k-s negyedéves mennyiségben gyártani. A 8333 darab borzalmasan kevés.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#25326

üzenetére

#85552128

#25326

üzenetére

Jól van írva. A Samsung K4G41325FE-HC25 egyelőre customer sample státuszban van, vagyis nem gyártja tömeges szinten a Samsung. [link] Egy olyan VGA-hoz ez nem jó, amiből sokat eladnak eladnak negyedévente, mert a customer sample státusz maximum ötvenezer memória legyártását jelenti egy negyedévben per customer ugye. Na most egy GTX 1060 3 GB-oshoz kell 6 darab ilyen, így egy negyedévben egy gyártó 8333 VGA-t állíthat elő, ami eléggé kevés a 200 dollár körüli árszintre.

-

Simid

senior tag

válasz

#85552128

#25152

üzenetére

#85552128

#25152

üzenetére

Persze, hogy nem gyárthatod le csak úgy. De akkor a GCN4 eredetileg TSMC-re vagy GloFo-ra lett fejlesztve szerinted? Nyilván kellett mindkettőre külön tervezni valamennyire, de kétlem, hogy egymástól független fejlesztések lennének és nyilván az architektúra sajátosságai azért csak kedveznek egyik vagy másik processnek. De persze lehet hülyeség ez, csak korábban volt róla szó, hogy az architektúra meghatározó az elérhető órajel/energiahatékonyság szempontjából. Gondolom nem nyúltak bele komolyabban csak egy másik process kedvéért.

Szóval itt most inkább az optimalizációra gondolok. Nem hiszem, hogy lehet ugyan olyan jól optimalizálni két különböző node-ra. -

Interceptor

addikt

válasz

#85552128

#25117

üzenetére

#85552128

#25117

üzenetére

Igen, nyilván az a leglogikusabb, hogy nincsenek még készen, nem véletlen kezdtem úgy a kérdésemet. Viszont esetleg az az eset is fennállhat, hogy valamilyen oknál fogva nem éri meg nekik a konkurens termékével egyazon időben kijönni. Persze ebben nem látok túl sok logikát, de azért megkérdeztem hátha valakinek van egyéb ötlete. Remélem nem baj...

-

Yany

addikt

válasz

#85552128

#25074

üzenetére

#85552128

#25074

üzenetére

Bizony, de itt a fő gond nem is azzal lesz, hogy várni kell és az addig bevétel-kiesés, hanem az előre befektetett bizalmat is elveszti az egész és azt újra felépíteni sok idő lesz. Egy Doom nem csinál nyarat és a BF1-re legalább annyi figyelő szempár tapad, ha nem sokkal több...

-

Yany

addikt

válasz

#85552128

#24991

üzenetére

#85552128

#24991

üzenetére

Őszintén szólva a BF1-től én félek picit. Az early tesztek szerint nem gyorsul DX12-től, de inkább lassul. Igen, tudom, hogy beta, de a Mantle fejlesztésének is óriási reklámértéke volt, közben mégsem bevethető BF4 alatt, DX11-ben meg állva hagyja az NV a pirosakat. Pedig AMD barát engine. (?) Szóval a BF1-be vetett hitet látva én mindig inkább tartok tőle, semmint együtt éreznék.

-

Abu85

HÁZIGAZDA

-

Abu85

HÁZIGAZDA

válasz

#85552128

#25051

üzenetére

#85552128

#25051

üzenetére

Igazából nem hack, hanem gyári tuning. Olyan, mint a G-Sync 165 Hz-re emelése, csak fordítva. Csak akkor működik, ha Radeont használsz. Ellenkező esetben az LFC nem aktiválódik. Ezért van így megadva a tartomány, hogy normál Adaptive-Sync+LFC. Például Intellel az LFC nem fog már működni, ha majd lesz Adaptive-Sync implementációjuk.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#24997

üzenetére

#85552128

#24997

üzenetére

A bundle csak attól függ, hogy a gyártó kifizeti-e a kódokért a pénzt. A Battlefield 1-re úgy érezték, hogy nem éri meg bevállalni a magas árat, lesz mellette még más cím is.

Persze, hogy rossz lesz a frame time, amikor a PresentMon nem észleli a compute parancslitákon meghívott presenteket. Még nem végzett az adott frame mérésével, miközben már a sokadik képkocka is kiment a kijelzőre.

Volt már problémás eset az AotS-nél, csak más okból, de ott is a mérőprogram hibázott: [link]

Volt már problémás eset az AotS-nél, csak más okból, de ott is a mérőprogram hibázott: [link]

A DX12 és a Vulkan nem DX11! Teljesen máshogy működő API-król van szó, amikben totál fals eredményeket adhatnak vissza a külső mérőprogramok.(#24998) Z_A_P: De, a Guru3D beépítettel mért. Lesz amúgy erre a gondra PresentMon továbbfejlesztés.

Jap mi erre figyelünk. -

Abu85

HÁZIGAZDA

válasz

#85552128

#24991

üzenetére

#85552128

#24991

üzenetére

A Total War előző része Intel partnerprogramjából jött. Az NV akármelyik játékot demózhatja, akár a Doomot is. De ettől nem kaptak gyors kódokat, mint az AMD. Szerintem szükség van az olyan műfajt reformáló AAA címekre, mint az AotS, hiszen ettől fejlődik maga az ipar.

A Battlefield 1 elsődlegesen azért lett AMD-s cím, mert azokat a GCN exkluzív kiterjesztéseket használja, amiket a Doom és a Deus Ex MK. Az NV is reklámozhatja, csak őket úgy nem érdekli, hogy a Radeon exkluzív eljárások vannak benne, míg a GeForce nem kap semmit. A Doom reklámozásával is leálltak, amikor kiderült, hogy a Vulkan módban ilyeneket kap a Radeon. Ez náluk egy ilyen szabály lehet, hogy a nagyon konkurensre írt játékokat nem reklámozzák.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#24975

üzenetére

#85552128

#24975

üzenetére

Több helyen hibás a táblázat.

![;]](//cdn.rios.hu/dl/s/v1.gif)

(#24978) players111: Árverseny nem lesz. Ezt felejtsétek el. Az AMD és az NV más részpiacát célozza direkten a VGA-piacnak, ami miatt nem kényszerülnek arra, hogy árversenybe kezdjenek. Ha tripla A-s játékokat játszol, akkor elmész egy Radeonra, mert GCN-re írják azokat. Ha indie játékokat, akkor GeForce-ra, mert azokat meg arra írják. Nem is érdeklődnek egymás részpiacai iránt.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#24959

üzenetére

#85552128

#24959

üzenetére

Igazából minden aktív az NV kártyákon, ami a program oldalán aktív lehet. Az a különbség, hogy a Doom a GCN-re rakott be gyors kódokat is, amiket az NV sosem érhet el. Az aszinkron compute, ami nem aktív, de a Vulkan mód fejlesztője elmondta, hogy az NV hardverek nem tudják meghívni a presentet a compute parancslistában, így csak úgy tudnák megoldani az aszinkron compute működését az NV-n, ha a grafikai parancslistából szinkronizálnának és onnan hívnák meg a presentet. Ez is jelentene előnyt, de növelné a késleltetést, miközben a Doom aszinkron compute implementációjának elsődleges előnye nem a teljesítménynövelés, hanem a késleltetés csökkentése. Emiatt inkább hagyták így a rendszert és megvárják, amíg az NV-nek is lesz megfelelő hardvere rá.

-

-

Abu85

HÁZIGAZDA

válasz

#85552128

#24873

üzenetére

#85552128

#24873

üzenetére

Ott is csíkozódna, ha raknál rá egy bizonyos számú kijelzőt, bizonyos frissítéssel. Tehát ott sem állandó az órajel csökkentése. A gyártók a specifikációkban le szokták írni, hogy mik az adott hardverre vonatkozó határok, azaz mikortól tiltják meg a memória-órajel ugrálását. Ez termékenként változó.

Nem a GDDR5 a gond egyébként hanem a megfelelő árnyékolás biztosítása, ugyanis akkora órajelen mennek ezek a memóriák, hogy az interferencia bezavarhat.

Ez jórészt egyébként nem mérnöki probléma, hanem gyártási. Leginkább döntés kérdése, hogy ki mit akar, de egy jobb árnyékolás nagyon megdrágítja a NYÁK-ot. -

Abu85

HÁZIGAZDA

válasz

#85552128

#24852

üzenetére

#85552128

#24852

üzenetére

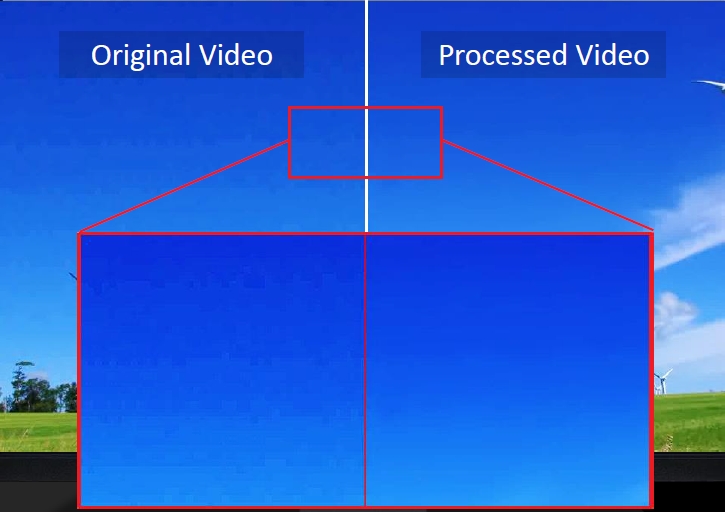

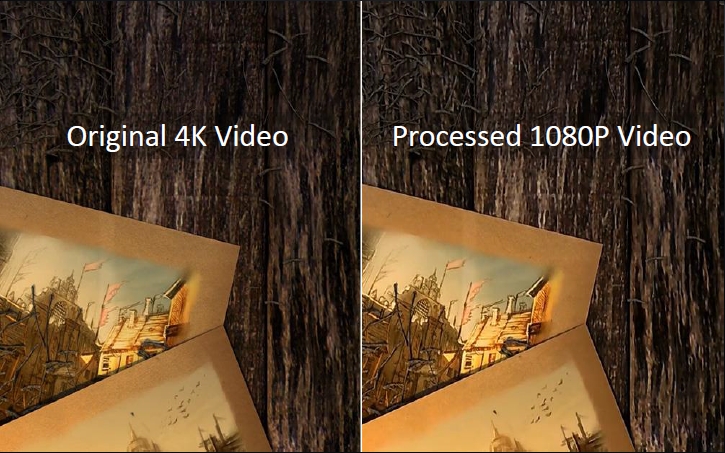

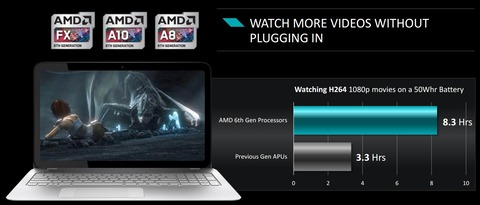

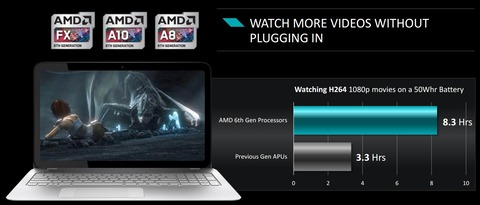

Itt van a lényeg képekben:

Ezek az Omega driver óta vannak benne a rendszerben.

Ez pedig a Carrizo, ahol kapott egy fixfunkciós blokkot a fenti dolgok számítása:

Látható, hogy mennyire megnőtt az üzemidő.

Az a baj, hogy az átlag mukinak halvány fingja nincs arról, hogy mi az a MadVR. Ők annyit tudnak, hogy hol a Windows médialejátszója. Ezek a vásárlók teszik ki a cég vásárlóbázisának a 90%-át. Emiatt lett a driver egyszerűsítve, mert 10-ből 9 ember a régi rendszert nem tudta használni.

-

xatos3

senior tag

válasz

#85552128

#24830

üzenetére

#85552128

#24830

üzenetére

a konozolokba szánt apukban lehet hogy voltak olyan hardveres kiegészítések, ami csak oda került be, hiszen egyedi megrendelésre készültek

bár mivel 1 éve bejelentette az amd hogy engedélyezi a shader 6.0-t windowsra, végülis elég logikus hogy ezzel tervezte a poalrist -

Malibutomi

nagyúr

válasz

#85552128

#24735

üzenetére

#85552128

#24735

üzenetére

Nem te a custom 480-at mered egy regebbi kevesebbet fogyaszto kartyahoz.

Custom 480 vs 390x msi: 196W vs 344WIgaz nincs ketszeres javulas nem 50 hanem 56%-at fogyasztja.

Es miert is a 290x-hez kellene hasonlitani es nem az utolso szeriahoz? Csak mert az kevesebbet fogyaszt?

Egyeb kategoriakban sem szokas visszamenni a 7970 sima (nem ghz) kartyakig csak mert ugyanaz a chip mint a 280x, de lassabb es kevesebbet fogyaszt.

Ref vs ref osszehasonlitasodbol kimaradt hogy 4%-al gyotsabb a ref 480 a TPU tesztben mint a 290x.

Igy aranyositva 60%-a a fogyasztasa. -

xxxxxxxxx

tag

válasz

#85552128

#23616

üzenetére

#85552128

#23616

üzenetére

Hello! Mintha emlékeznék egy ilyen cikkre. Gyártok sürgetik az AMD hogy minnél előbb dobjanak piacra valami kártyát. Így előbbre is hozták 1 hónappal talán, de nem emlékszem pontosan. Egyébként is nem kell nagy fejszének lenni ha emlékszel ennek a fickónak az elgondolkodtató előadására.

Elmúlt időkben hiába csak pár mérhető PFS-t hozott a SLI Crossfire megoldások akkor is voltak több 2 kártyás megoldások mert jól nézz ki a vízhűtős rendszerben, gépben. Várják a csodát, ez pedig 2 teljes áru kártya és akkor 2X annyi kraft GTX980 SLI it simán verte a 980Ti mert a GB nem adódót .

GTX980 SLI it simán verte a 980Ti mert a GB nem adódót .

-

#45185024

törölt tag

válasz

#85552128

#23616

üzenetére

#85552128

#23616

üzenetére

Ez a névjegyzéktan

Ami eddig R9 volt most RX lett, és ami eddig X végződésű volt 380x 390x az most 485 495 lett, jó megkavartál !

Igaz mondta Abu annakidején hogy nem lesz több X es kártya ami igaznak is bizonyult , de hát ez csak ilyen jelöléstani szófacsarás.-Az a baj hogy MINDKÉT cég kerüli a konkurenciát! AMD az 1070 alatti területet fogja lefedni a felette levőt meg NV founder árakon felvásárolva minden memóriát , és augusztusi 1060 ami a jelenlegi körülményeket nézve Paper launchok valóban szept októberi valós megjelenést feltételez.

Elmegy a két cég egymás mellett mintha lenne valami titkos paktum és előre meg lenne beszélve.

Lehetne csinálni belőle ilyen konspirációs videót sejtelmes zenével

Így bukja mindkét cég a legkevesebbet csak épp a vásárlóknak nem jó ez így

-

Petykemano

veterán

válasz

#85552128

#23591

üzenetére

#85552128

#23591

üzenetére

Computerbase.de szerint lesz hely a Second Revisionnek:

"So verfügt die Radeon RX 480 mit 36 Compute Units laut AMD über den Maximalausbau von Polaris 10 – auch wenn ComputerBase von externen Quellen erfahren hat, dass eigentlich 40 CUs vorhanden sind"

(Fordítás) -

HSM

félisten

válasz

#85552128

#23558

üzenetére

#85552128

#23558

üzenetére

Jó, azért nem sok kellett volna.

Mármint lefelé. Alapon most 165W-okat mérnek a tesztek, és ugye 150W kéne a szabványok betartásához. Az nem sok. A hűtőnek is könnyebb dolga lenne úgy sokkal.

Mármint lefelé. Alapon most 165W-okat mérnek a tesztek, és ugye 150W kéne a szabványok betartásához. Az nem sok. A hűtőnek is könnyebb dolga lenne úgy sokkal.

Pletykálják, hogy a kezdeti jó kihozatal miatt inaktív az AVFS még. Ez is érdekes felvetés, és elég is lehet akár a probléma megoldásához... -

Szeszkazán

senior tag

-

unrealnoise

senior tag

válasz

#85552128

#23240

üzenetére

#85552128

#23240

üzenetére

Mondjuk amúgy nem értem mire fel a 8GB ram.

Kövezzetek meg, de 1080p-re ma bőven elég a 4GB. (99%-ban.) Az a gond, hogy magasabb felbontáson viszont egyre több játéknál meg eleve gyenge lehet a kártya teljesítménye, RAM mennyiség ide vagy oda. Persze javít kicsit a helyzeten de lehet az a kis plusz pénzt sem éri meg a + 4 GB...

-

Cydie

csendes tag

válasz

#85552128

#23233

üzenetére

#85552128

#23233

üzenetére

Ezt a részét megértem, de vigyék le a régi árát... Az R9 380-at nem ennyiért hozták ki... 100k-ért ez már nem "olcsó", ami az AMD árazásban az lenne, ha nem rontaná el pár helyi kiskirály. 80-ért jó vétel lenne, 90-ért AIB modellek. De még az is sok a 380-asok nyitó árához. Hónapok óta szemezek a 100 alatti 60 fölötti kártyákkal. Fél éve várom a Polarist, úgy látszik a semmiért. Nagyon nem akartam még hónapokat várni... 250-essel...

-

Cydie

csendes tag

válasz

#85552128

#23219

üzenetére

#85552128

#23219

üzenetére

Közép-Európai idő szerint délután 4-kor kezdődik. Ha jól emlékszem 14 RX480 lesz giveawayen.

Kérdésem az AMA-n: Miért tűritek a viszonteladók irreális árait, amik az AMD-t károsítják.

Mert szerintem ez 100k-ért valóban vicc. Reference. Amikor a 970 újan USD-ben drágább. Mire ideér olcsóbb lesz. Ez hogy jön ki? A pofátlanságnak is van határa.

https://www.reddit.com/r/Amd/comments/4q8qxm/i_encourage_everyone_to_not_buy_the_8gb_reference/

-

Balazs_

senior tag

válasz

#85552128

#23195

üzenetére

#85552128

#23195

üzenetére

Megint kiforgatod a szavakat, az AMD most nem akar versenyezni az Nvidiával. Majd októberben jönnek a 1070-80 szintű kártyák. Belőtték a ~200$-ős kategóriát, az fontos per pillanat.

Azért írtam neked mert úgy tűnt az írásodból, hogy kétségbe vonod a nyilatkozatot.Olle: 'csak' 14 lesz szétosztva nem 40.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- Samsung Galaxy Felhasználók OFF topicja

- Motoros topic

- Telekom otthoni szolgáltatások (TV, internet, telefon)

- Samsung Galaxy A52s 5G - jó S-tehetség

- Okosóra és okoskiegészítő topik

- Horgász topik

- Audi, Cupra, Seat, Skoda, Volkswagen topik

- Kertészet, mezőgazdaság topik

- A fociról könnyedén, egy baráti társaságban

- Medence topik

- További aktív témák...

- BANKMENTES részletfizetés ASUS TUF F16 FX607JV-QT212 Tesztvideó a leírásban Nézd meg működés közben

- BESZÁMÍTÁS! ASRock Z370 i5 8500 16GB DDR4 512GB SSD 2060 Super 8GB Zalman Z9 Plus Enermax 750W

- Konzol felvásárlás!! Playstation 5, Playstation 5 Pro

- ÁRGARANCIA!Épített KomPhone i5 10600KF 16/32/64GB RAM RTX 3060 12GB GAMER PC termékbeszámítással

- ÁRGARANCIA!Épített KomPhone i5 13400F 32/64GB RAM RTX 4060 Ti 8GB GAMER PC termékbeszámítással

Állásajánlatok

Cég: PC Trade Systems Kft.

Város: Szeged

Cég: PCMENTOR SZERVIZ KFT.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

)

)

Egy program ezt az értéket tudja kiolvasni az API által, ami egyébként teljesen valós, mivel maga a driver elfedi a valós VRAM-ot, ugyanakkor memória van az erőforráshoz, és ez egy kombinált érték lesz a VRAM és a rendszermemória alapján.

Egy program ezt az értéket tudja kiolvasni az API által, ami egyébként teljesen valós, mivel maga a driver elfedi a valós VRAM-ot, ugyanakkor memória van az erőforráshoz, és ez egy kombinált érték lesz a VRAM és a rendszermemória alapján.

Mármint lefelé. Alapon most 165W-okat mérnek a tesztek, és ugye 150W kéne a szabványok betartásához. Az nem sok. A hűtőnek is könnyebb dolga lenne úgy sokkal.

Mármint lefelé. Alapon most 165W-okat mérnek a tesztek, és ugye 150W kéne a szabványok betartásához. Az nem sok. A hűtőnek is könnyebb dolga lenne úgy sokkal.