- Android alkalmazások - szoftver kibeszélő topik

- Milyen okostelefont vegyek?

- iPhone topik

- Bemutatkozott a Poco X7 és X7 Pro

- Samsung Galaxy A54 - türelemjáték

- Xiaomi 15 Ultra - kamera, telefon

- Brutál akkuval érkeztek az Ulefone X16 modellek

- Samsung Galaxy A56 - megbízható középszerűség

- Samsung Galaxy S23 Ultra - non plus ultra

- Azonnali mobilos kérdések órája

Új hozzászólás Aktív témák

-

Abu85

HÁZIGAZDA

Azt a koncepciót, amire építünk most a Sony dolgozta ki. Gyakorlatilag az új API-k elméleti alapjai a libGCM-ből származnak. Az AMD ezt vette alapul, amikor kidolgozták ennek a koncepciónak a PC-s verzióját. Ezekre a kutatásokra épül az összes PC-s low-level API. Bizonyos elemeiben annyira, hogy még a specifikáció is ugyanaz. Például a validator teljesen az AMD rendszere mindhárom API-ban. Ezért is egyezik a leírása. De a parancspufferek kreálása is ugyanaz. A bekötési modell specifikációjában viszont például vannak különbségek. Ahogy a shader nyelvekben és a fordításban is.

Az érdem sok értelemben a Sony-é, mivel ha nem csinálják meg a libGCM-et, akkor nem bizonyosodik be, hogy ezt így is lehet, és az AMD sem kezd kutatásba azzal kapcsolatban, hogy ezt a koncepciót miképp lehetne hatékonyan PC-re ültetni.

-

imi123

őstag

Az AMD-nek sok jó dolgot köszönhetünk.Sajnos a hasznot mindig más fölözi le.

Ez az úttörő szerep nem túl kifizetődő!

Egyébként nem hiszem hogy a Microsoft sokáig ült volna a babérjain amint megtudta hogy jön a Steam OS.

Azt hogy ki kezdett előbb fejleszteni alacsony szintű Apit azt valszeg soha nem tudjuk meg.

Legyen az érdem az AMD-é. -

hugo chávez

aktív tag

Hmm, a G-Syncről beszélsz?

Na de az itt már tényleg off, nem?

Na de az itt már tényleg off, nem?"mint a cikk címe is mutatja, a DX12-ről van szó még mindig."

Hát azt erősen kétlem, hogy arról beszélnél. Vagy talán az Intel, de főleg az Nv nem teregetné ki és nem taposna bele ezzel is az AMD-be, ha ez valóban így történt volna, ha közösen dolgozták volna ki és az AMD lenyúlta volna előlük? Olyan nehéz elfogadni, hogy az Nv-nek baromira nem volt érdeke egy olyan API, amihez ki kell adniuk az architektúráik dokumentációját? Pedig minden jel erre mutat, pl. a ShitWorks is.

De ha valaki nem akar látni, csak kényszeresen a saját elméletéhez igazítani a dolgokat és emiatt egy csomó tényt szándékosan figyelmen kívül hagy, azzal én nem tudok mit kezdeni...

De ha valaki nem akar látni, csak kényszeresen a saját elméletéhez igazítani a dolgokat és emiatt egy csomó tényt szándékosan figyelmen kívül hagy, azzal én nem tudok mit kezdeni...

-

Jack@l

veterán

válasz

hugo chávez

#135

üzenetére

hugo chávez

#135

üzenetére

Én egy másik mesének adok több hitelt:

Volt egyszer 3 nagyúr és egy király. A nagyuraknál fevetődött az ötlet némi modernozálásra, ígyhát összeültek sörözni. Éveken át csiszolgatták a specikációt, mire az egyik nagyúr felkáltott, hogy én nem tudok tovább várni rátok, nekem most kell egy implementáció, legyen mit mutogatni a marketingeseknek. Elkészített hát magának az eddig összeszedett kis tudábázisból egy működő verziót és haknizott vele egy évig.

Próbálta úgy beállítani, mintha ő találta volna fel a spanyol viaszt, amire a többi nagyúr kissé megorrolt, a végleges verzióból ki is kapták a nagyszájú nagyúr néhány tehenét.#137: mint a cikk címe is mutatja, a DX12-ről van szó még mindig.

-

hugo chávez

aktív tag

"Ezért nem nagyon értem ezt a hurráoptimizmust ami körülllengi őket. (meg a mesét se, hogy mantleből született a dx12)"

Nem érted a mesét?

Hiszen már ismert a történet, sőt, még te is olvastad, ez egészen biztos! Csak hát, ilyenkor előjön a szelektív memória-effektusod... De hogy frissítsem azokat a fránya cellákat, átismétlem neked:

Hiszen már ismert a történet, sőt, még te is olvastad, ez egészen biztos! Csak hát, ilyenkor előjön a szelektív memória-effektusod... De hogy frissítsem azokat a fránya cellákat, átismétlem neked:

Valóban nem közvetlenül a Mantle-ből született a DX12, hanem az AMD kidolgozta a "low level" API koncepciót PC-re és ezt a kezdetleges kódot odaadta a Microsoftnak is. Aztán a későbbiekben erre a kódra építették a Frostbite fejlesztőivel a Mantle-t, míg az Ms (feltehetően továbbra is együtt dolgozva az AMD-vel, már csak az Xbox One-ra szánt DX12 Mono végett is) a DX12-t. -

Mart10000

aktív tag

Végülis, ami DX11-en működött a DX12 is működni fog rajta.

-

CoolMan

MODERÁTOR

Uraim! Fejezzétek be az offolást, veszekedést, személyeskedést! Aki folytatja az megy pihenni.

-

1. Nem, és az is lehetséges, hogy később sem fog. Ettől opportunity, és nem fact.

2. Ez egy nagy kérdés. Biztos, hogy az nVidia is mozog a háttérben, de a jó ég tudja, micsodát.

3. Ez azért ennyire nem fekete-fehér. Persze, nagy ösztönző erő a 80%, de lehet azért finom szívességeket tenni a másik oldalnak. Az minden további nélkül működik, hogy 1-2 "next gen" effekt AMD jobban fut. -

Jack@l

veterán

1: Igaz, csak ez még nem jött le a mostani programoknál.

2: Igaz, kérdés hogy a nagy ismerettséggel mit kezdenek. NV is megadta nekik sztem olyan szinten guide-ot, amilyen szinten egy fejlesztőnek ismernie kell a kártyákat.

3: Nem ismerek olyan céget, aki a kereslet 80%-át eldobná magától, mert nem optimalizál azokra a kártyákra. (kivéve ha sokkal nagyobb pénz folyik be háttéralkukból, mint magából az eladásaikból)

Ez már önmagában elég ösztönző erő...

Nem kell egyéb hokuszpókuszokat mögé látni, abszolut nincs rá szükségülk jelen pillanatban. Nyugiban fejlesztgetnek, hozzák a kötelezőt. -

SylverR

senior tag

válasz

jacint78

#111

üzenetére

jacint78

#111

üzenetére

Hogy mivan??

Én még emlékszem annak idején, GeForce 4-re volt kötve bátyám tévéje, és időnként segítenem kellett beállítani a klón módot a tv kimeneten. Hát az egy halál volt. Sokszor alig találtam meg fél óra kínlódás után. Míg az itteni 8500-asomon egy kattintásból bejött a megfelelő menü. Igaz, ez régen volt. De most se hiszem, hogy másképp lenne. -

Mért lenne az nv erőszakos?

Ez ugye nem volt komoly kérdés?

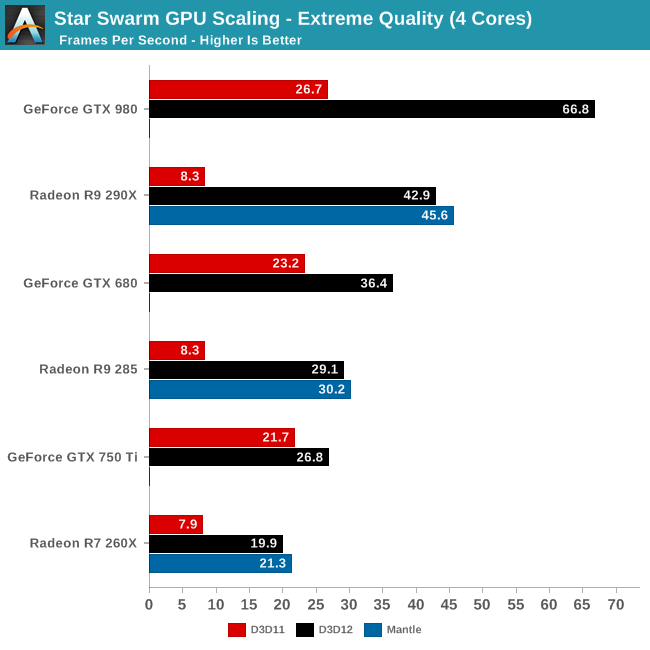

Mitől jobb a helytzete az amd-nek, mikor réges rég az nv-vel demóztak először dx12-es játékot? Star swarmban is rendre megalázták a dx12-es portban az amd kártyáit (még mantle-al is)

Azért jobb a helyzetük, mert a low-level API-s engine-ek kutatásában az ő architektúrájukat használja egy csomó fejlesztő. Ezzel most előnyben vannak. Azt meg egy szóval sem mondtam, hogy ez az előny nem ledolgozható egy év alatt.

Tények? Azokból nem sok van. Ezek a benchmarkok szart nem számítanak (se a Star Swarm, se a 3DM, se az emlegetett DX12 demo). De mondok azért pár tényt:

1. Azonos árszintetn az AMD kártyákban több az erőforrás. Opportunity: ezt egy low-level API-val jobban ki lehet használni. Időhorizont: ismeretlen.

2. Az AMD architektúráját jelenleg jobban ismerik a fejlesztők, jobban tudnak rá optimalizálni. Opportunity: az első néhány DX12-es játékban akár jelentős előnyben lehet az AMD. Risk: ld. #3.

3. Az nVidia egy tőkeerős, semmitől vissza nem riadó, pozícionálásban igen erős cég, aki birtokolja a diszkrét VGA piac közel 80%-át. A befolyását nyilván meg fogja próbálni több irányból felhasználni arra, hogy a #2-ben leírt hátrányt csökkentsék / megfordítsák. Az eredményt majd meglátjuk. -

jacint78

addikt

Innentől kezdve az egész csak a tájékozatlanság hibája, és hogy a boltosok nem okítják ilyenkor az embereket, és beszélik rá a másik fél termékére.

Ezzel csak az a gáz, hogy a boltos nem önmaga ellensége. Az átlag totál laikus júzer a boltot fogja felhívni, hogy mé nem megy valami, ha valami gond van az AMD izéivel (beállítási gondokra gondolok nem többre) és ez a boltnak nem hiányzik, inkább eladja az NVIDIA-t és nincs probléma. Ha valakinek csak az FPS számít, akkor vegye az AMD-t, de, ha minőségi cuccot akarsz nem jön szóba.

-

imi123

őstag

Nyilván ahogy kezdi a gyártás technológia elérni a határát lassul a hardveres fejlesztés sebessége.

Itt jönne képbe a minél jobb szoftveres kihasználás.Itt mindig megemlítik hogy ott vannak a konzolok.Ott rátekernek mindent amit bír.Csak ott kötött hardver van.Pc-n azért nem lesz ennyire egyszerű.

A 280X kártyával is lehetne nagyon szép dolgokat csinálni.Az más kérdés hogy a programozók nyilván nem a régi kártyákat fogják priorizálni az optimalizálásnál. -

Jack@l

veterán

A 260-280x-ekre írtam. De azért te is emélkszel azokra az időkre, mikor évente jöttek ki az új generációk és 30-50%-ot hoztak az előzőkön. Akkor a jónép is évente cserélgette a kártyáit, mert volt miért és nem is voltak elszállva annyira az árak.

@Henkel: Valóban, mért hazudnék, mért megint? Nekem rohadtul nem számít az eladásuk, nem támogat senki, nincs rá okom...

-

SylverR

senior tag

Épp azért is jó, hogy lassan fejleszt, mert így rávan kényszerítve a piac, hogy az sw-n fejlesszen. Rohadtul unalmas volt már, hogy évente duplázódott a HW, míg az SW egyre nagyobb hulladék katyvasszá vált. Ideje a váltásnak. Ha ezzel az nv is gyorsul? Gyorsuljon! Nem baj! Nem érdekel ez a része.

-

-

"Mért lenne az nv erőszakos?"

nokomment."meg a mesét se, hogy mantleből született a dx12"

másik topikban volt több link is a mantle vs. dx12 doksijairól, miszerint szórol szóra ugyanazok, ms a kozmetizázásra se vette a fáradtságot

a hurráoptimizmus arra épül, hogy hátha egy kis ideig legalább nem a vidiás ganékód lesz a jellemző a játékokra... (szerinte is naívak)

(hogy a star swarm képet meg lehessen magyarázni, ahoz star swarm fejlesztőnek kéne lenni

ezért is mondtam, hogy ~összevethetetlen a két arhitektura.... totál programfüggő.)

ezért is mondtam, hogy ~összevethetetlen a két arhitektura.... totál programfüggő.)---

(#97) jacint78

vagy nagyon fiatal vagy vagy nagyon feledékeny

-

SylverR

senior tag

Nem célozgatok, és nincs hangulatom semmiféle vitára. Csupán érdeklődtem, hogy észre veszed-e a részre hajlást magadon. De látom nem.

A tény az, hogy megveszel egy 260x-et, 270x-et, 280x-et, és jó időre van egy kellően erős VGA-d. Pont. Az ár, fogyasztás, másodlagos kérdés (az is teljesen mindegy hányan veszik meg. Sokaknál a videokártya szó egyenlő a "dzsíforssz"-szal, és ez igaz idehaza is, és odakint is. Innentől kezdve az egész csak a tájékozatlanság hibája, és hogy a boltosok nem okítják ilyenkor az embereket, és beszélik rá a másik fél termékére. Érdekes mód ha a kisebbik gyártóval indítasz, rögtön tudják ajánlani a nagyobbat...). Ergo van konkurencia. Lehet választani. Téma zárva a részemről. -

jacint78

addikt

válasz

#32839680

#95

üzenetére

#32839680

#95

üzenetére

Hagyjuk már ezeket az áras elméleteket baromság az utolsó szóig! Ha valami egyszerűen nem ér többet, nem fogják tudni többért eladni. Ha nincs konkurencia, több darabot tudnak eladni. Ha nem kell fejleszteni, csak a kihulló darabokat pótolni, vagy nem kell olyan gyorsan fejleszteni, dettó nincs miért emelni az árakat. Ja és akkor lehet valami csúcs, vagy egyszerűen jobb, ha van másik amihez képest jó, jobb. Ha nem lenne az AMD az NV kártyái nem lennének jók, csak átlagosak, mert nem lenne mihez viszonyítani őket.

-

Jack@l

veterán

Mért lenne az nv erőszakos? Mitől jobb a helytzete az amd-nek, mikor réges rég az nv-vel demóztak először dx12-es játékot? Star swarmban is rendre megalázták a dx12-es portban az amd kártyáit (még mantle-al is)

Ezért nem nagyon értem ezt a hurráoptimizmust ami körülllengi őket. (meg a mesét se, hogy mantleből született a dx12)

Szóval szerintem mesék és találgatások helyett jó lenne ha mindenki a tényeket tartaná szem előtt.

-

Nem nagyon van olyan, hogy valódi különbség, legalábbis teljesítmény terén. Olyan van, hogy egy-egy szoftver jobban támaszkodik olyan feture-ökre, amiben valamelyik architektúra erősebb. A GW ugye eszköz arra, hogy ez az nVidia legyen. A Mantle más megközelítéssel, de az AMD ilyen eszköze. A DX12nél még nyitott a helyzet, az AMD kilátásai jobbak, de soha nem szabad alábecsülni egy olyan erőszakos és sikeres céget, mint az nV.

-

jacint78

addikt

válasz

#32839680

#88

üzenetére

#32839680

#88

üzenetére

Szerintem ez az AMD nagy előnye picit túl van becsülve. Előbb várjuk meg míg lesznek konkrét elkészült játékok és akkor kiderül, hogy valójában mennyit is nyerünk az egész DX12-es kavalkáddal, Most nem nagyon lehet drivert optimalizálni, hanem a játékot kell rendesen megcsinálni mindenféle hardverre, és most nem is NV vs. AMD-re gondolok, hanem például az AMD jelenlegi termékpalettájára, mert az alacsony elérés ezzel jár. Ami a játékfejlesztőket illeti, tudjuk, hogy mennyire szeretnek, tudnak optimalizálni. Épp ezért véleményem szerint kár is erről filozofálni, várjuk meg a végeredményt.

-

-

Mart10000

aktív tag

Remélem a 3 éves configon is működni fog a DX12.

-

Venyera7

senior tag

Az lehet tudni a Fallout 4 mire jön?

-

GodGamer5

addikt

Csak jönne már ez a demo, lassan úgy érzem, hogy csak dísznek vettem meg a videokártyám...

Kíváncsi vagyok a Fable mennyire használja ki a DX12-t, mert amit eddig láttam az nem győzött meg tulságosan. -

Abu85

HÁZIGAZDA

válasz

djculture

#70

üzenetére

djculture

#70

üzenetére

Ezekért vezették be a meghajtók hitelesítését. Mindegyiket átvizsgálják, hogy jó-e, és emiatt már eleve nem csalnak a gyártók, mert még a driver kiadása előtt kiderülne.

A FutureMark jelenleg a legedzettebb cég a tiltott optimalizálásra vonatkozóan, és nagyon gyorsan fellépnek, ha ilyen történik. Számos telefont is szégyenpadra küldtek az elmúlt években.

A FutureMark jelenleg a legedzettebb cég a tiltott optimalizálásra vonatkozóan, és nagyon gyorsan fellépnek, ha ilyen történik. Számos telefont is szégyenpadra küldtek az elmúlt években. -

djculture

félisten

Nekem a 3dmark-ról eleve az nvidia fx botrány jut eszembe :

2003-ban:

"Mint köztudott, vita, sőt, kisebbfajta botrány robbant ki pár hete a 3DMark tesztprogramokat fejlesztő Futuremark és a grafikus kártya-gyártó nVidia között. Az indok: utóbbi vállalat "optimalizálta" videokártyái teljesítményét, magyarán "csalt". A vihar úgy tűnt, elül, hiszen a Futuremark kiadott egy javítást, amely telepítése után újra a normál értékeket jelenítette meg a tesztprogram, azaz véget ért az nVidia "optimalizálási aranykora". S most jön a csavar az ügyben.A két cég közös sajtóközleményt adott ki. E szerint a Futuremark "mélységében" is megértette a helyzetet és az nVidia optimalizálási stratégiáját, így eltekint attól, hogy "csalásnak" nevezze az optimalizációt. A lényeg, hogy újra szent a béke a két vállalat között. Már csak pár dolog kérdéses: némi támogatást küldött az nVidia dollárok "képében" Finnországba? Vagy ügyvédekkel fenyegetőzött és a felek tényleg leültek egy asztalhoz és megbeszélték a dolgot? Ezek azok a kérdések, amelyekre a választ sem az egyszerű felhasználó, de még a tűzhöz közelebb ülők sem fogják egyhamar megtudni."

De ugyanez megvolt már az ati/amd-vel is emlékeim szerint később csak ez az ami világszintű botrány/csalás volt..

Ilyen esetek miatt függetlennek nem nevezném se a tesztet se a céget. Most éppen pár évig nem engedték befolyásolni a teszteredményeket annyit elhiszek, de bármikor lehet megint ilyen. Volt már rengetegszer anyagilag bajba a cég. -

és egy tesztprogram eredményének (3dmark pont) miféle relevanciája van bármivel kapcsolatban is?

ha ott jó pontot ér el a radeonom, akkor örülhetek?

ha keveset ér el a geforcem, akkor rohanok amdt venni, mert kiderült valójában, hogy az a tuti?a tesztprogramoknak az égvilágon semmi értelme, puszta érdekesség

-

pl független tesztprogram az egy játék, ami a the way it meant to be played logóval indul?

ha a wicser, pcars, betmen jobban megy a vidián, akkor a vidia gpuja jobb?szerk: az biztos, hogy egy dx11/dx12 módot is tudó játék lenne a legjobb, hogy a két api jól összevethető legyen (és főleg olyan, amibe mondjuk a dx12 utólag kerülne be*, hogy lássam van-e valódi előrelépés tőle), de ott is max gyártón belüli összevetésre alkalmas _igazán_

*nyilván egy dx12-es motor egy tákolt dx11 kóddal tudhat sokkal rosszabbul futni, de ez aligha a dx12 érdeme lesz majd...

-

Érdekes lesz, nagyon kíváncsi leszek, mit fog mutatni, főleg a DX11 vs DX12 összehasonlítás terén.

Nyilván fel fognak lángolni az AMD vs NVIDIA viták is a program kapcsán - reménykedem benne, hogy a fontosabb különbségek kimutatására lesznek opciók (pl. aszinkron pipeline-ok ki / be, stb.).

-

Zorel

senior tag

Már megint félrebeszélsz! Nem az API-ról volt szó, hanem a benchmark-ról amiről a cikk is szól. Ez a bench az Oxide és az AMD közös szüleménye, AMD már demózta a GDC-n is. Teljesen egyértelmű, hogy GCN kártyákra lesz/van optimalizálva. Egyáltalán nem fog hiteles képet adni az AMD és NV erőviszonyokról ami várható a DX12-es játékok alatt. Csak ezt elfelejted megemlíteni, mert még most csak ferdíteni próbálsz az AMD javára.

-

nghost

tag

no offense, de ettől instant agyrákot kaptam:

asszinkron (ilyen szó nem létezik)

aszinkron

-

djculture

félisten

Nemtudom én úgy vagyok vele hiszem ha lehoztok majd róla egy tesztet, amit elolvasva tényleg látom hogy van előny. Egyelőre a sok igérettől úgy vagyok hogy besokaltam, vga-t is csak akkor veszek újat ha már látom a fától az erdőt. gtx960-ast eladtam mert ez is elég herélt cucc bezzeg drága. Visszatért a gépembe a jó öreg hd5850, ezzel is lehet játszani amig kialakul hogy mi a valós helyzet.

-

Jack@l

veterán

Ki mondta hogy nem lesz jó? Jó lesz, csak nem annak és nem annyira ahogy ez az utóbbi 1-2 évben túl van lihegve. Kisértetiesen hasonlít a 4 éves apu hypehoz a helyzet, aztán abból is nagyon sokminden bejött.

Pistikéknek teljesen megfelelő a konzol, ott berakja a lemezt(vagy már azt se) és játszik. Nem kell holmi driverfrissítéssel megeröltetni az agyát és hasonlók. -

Abu85

HÁZIGAZDA

Ennek az AMD-hez semmi köze. Ők csak alapot adtak a DX12-höz, de az API-t már a Microsoft fejezte be. Ugyanígy a Vulkánt a Khronos. Természetesen az az alap nem volt jelentéktelen, ha nem születik meg, talán ma nem beszélnénk új API-król, de megtörtént, így eljöhet a régóta várt reform. Bármennyire is úgy gondolod, hogy ez nem lesz jó, valójában nagyon sokat fog segíteni annak, hogy a PC és a mobil piac versenyképesebbé váljon. Azok a konzolok, amik vannak azért értek most el olyan őrületes sikert, mert egyre rosszabb a PC helyzete az állandó driver frissítésekre való igénnyel, a rendkívül rossz portokkal, stb. Ha ezek a kulcsproblémák megszűnnek, akkor talán vissza is jön valamekkora konzolra elvándorolt játékostömeg. És ez az egész piac érdeke.

-

Jack@l

veterán

Az AMD-ről nem is beszélve.

Ha tökéletesre csiszolnák a dx11-es módot, alig lenne 10-20% különbség futásban. De láttunk már oxide-ot tökéletesre csiszolt motion blurral is...

Én asszem megvárok pár független benchmarkot, játékot is a nagy örömujjongás megkezdése előtt.@Cassi: meg is lett az eredménye, a részvények elérték a mélypontot. 1978 óta csak egyszer volt ugyanilyen szar az árfolyam.

-

Cassi

őstag

válasz

Petykemano

#45

üzenetére

Petykemano

#45

üzenetére

Ma jelentette be az AMD a negyedéves eredményeit, és ismét összehoztak kb. 180 millió dollárnyi veszteséget. Az AMD-nek a mai formájában nincs egy éve sem hátra. Talán megveszi őket valaki, de ez távolról sem biztos. A bevételeiknek már több mint fele a custom designokból jött, ami nagyrészt a két konzol, ha az nincs, akkor már most kapuzárás lenne.

Ráadásul az APU-k teljesítettek legrosszabbul a termékek között. Egyszerűen nincs eladható CPU-ja az AMD-nek, a Zenig viszont nem tudják kibírni feldarabolás nélkül.

-

Abu85

HÁZIGAZDA

válasz

djculture

#50

üzenetére

djculture

#50

üzenetére

Ez nem csak benchmark, hanem egy játék, amibe gyorsan építettek egy tesztprogramot, hogy lehessen látni a DX12 előnyeit. Ugyanezt látod majd magában a játékban is, ha megjelenik, vagy ha megveszed early accessen.

Ez egyébként most jól jön az MS-nek. Álmodni sem tudnának jobb bemutatót a Nitrous motornál, amely tényleg használja a DX12 szinte összes fontos újítását. Ráadásul 3-4x-es tempóelőny lesz az amúgy tökéletesre csiszolt DX11 módhoz képest. És még a grafika is szebb. Ennél jobb reklám a Win10/DX12-nek nem kell. -

djculture

félisten

Gears of War Ultimate Edition-t várjuk meg inkább... Szeptemberre igérték pc-re de kitudja hogy kijön e idén az is. Az ilyen benchmarkok nem sok mindent mutatnak meg a valós helyzetről.

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#45

üzenetére

Petykemano

#45

üzenetére

Az AMD már eleve meghatározta a jövőt a DX12 és a Vulkan API-nak alapjaival. Viszont vannak tényleg fontos és nem olyan jelentős problémák. Előbbiekre muszáj reflektálni, és mindenki elfogadta, hogy az AMD megoldotta a skálázás problémáját. Mivel senki más nem tudott rá jobbat mondani, így beletörődtek, hogy legyen ez benne a DX12-ben és a Vulkánban. Gyakorlatilag a strukturális reformból mindenki nagyon durván profitál, és ez a piac versenyképességének a kulcsa.

A későbbi fejlesztések már mások. A soron következő problémák rétegpiacokra vonatkozhatnak, tehát az AMD-nek a potenciális megoldását nem feltétlenül fogja mindenki támogatni. Inkább tartson 3-4 évig a szabványosítás, minthogy megint az AMD mondja meg a tutit. -

-

Petykemano

veterán

Én tudom. Emlékszem, hogy már írtad egyszer és racionálisan gondolkodva is az AMD-nek az egyetlen járható és talán működőképes útja az intel kerülőúton való előzésére, így neki muszáj is lenne igyekezni effelé igyekezni terelni az ipart.

Csak ha te mondod, akkor van realitása, ha én mondom, akkor összevissza képzelgek és álmodozom. Ez a kánon.

-

carl18

addikt

Ahogy én olvastam a DX 12 36 szálig skálázodik !

Én csak arra lennék kíváncsi hogy a jelenlegi I5-3470 processzoromban lévő HD 2500-as IGP képes leszek-e használni/befogni? Ha már ott van miért ne ?

Én csak arra lennék kíváncsi hogy a jelenlegi I5-3470 processzoromban lévő HD 2500-as IGP képes leszek-e használni/befogni? Ha már ott van miért ne ?

Na erre kíváncsi leszek mi sül ki idővel belőle ? ! -

Abu85

HÁZIGAZDA

válasz

Petykemano

#41

üzenetére

Petykemano

#41

üzenetére

Az IGP-vel gyorsított grafikus API-nak van realitása. Az Oxide egy ideje azért kampányol, hogy egymillió batch legyen 2018-ban. Mivel a processzor oldaláról semmi esély, hogy három év alatt tízszeresére nőjön a teljesítmény, így az egyetlen lehetőség, ha a parancsfeldolgozás átkerül az IGP-re. Esetleg el lehet gondolkodni API-t gyorsító célhardveren, ami egy GPDSP lenne. Ennek az előnye, hogy a processzormagok és az IGP erőforrásai megmaradnának.

Ha ennyire durva fejlődésben gondolkodunk, hogy a mostani új API-k által megengedett maximális szintre három év alatt ismét tízszeres növekedést akarunk pakolni, akkor ahhoz mindenképp célhardver szükséges. -

Petykemano

veterán

Az IGP terhelése nem az AMD APUjai, hanem az intel APUjai miatt fog bekövetkezni. Ugyanis minden eladott intel dekstop prociban i3-tól i7-ig ott az IGP. De valószínűleg erre ugyanúgy igaz, hogy a fejlesztők nem fogják tovább terhelni az IGP-t, mint amit a legelterjedtebb IGP tud, mint ahogy azt is feltételezzük, hogy nem fognak több DX12-es "gyorsító" feature-t felhasználni, mint amennyit az nvidia kártyák tudnak, hiába tudnának többet az radeonok.

(Ha konkrétan az IGP-n futó Mantle-re gondoltál, akkor nyilván azt úgy kéne megcsinálni, hogy az intel IGP-in is fusson. De ha már fut IGP-n, akkor ott fut jobban, ahol erősebb az IGP, tehát értelemszerűen egy kaveri erősebb dGPU-t meghajtó processzor lehetne, mint egy i3, vagy olcsóbb, mint egy i5/i7

De az IGP-n futó grafikus api részemről csak fikció!) -

Dilikutya

félisten

IGP+dGPU kombó most is van, grafikára már használhatók együtt, de tudtommal csak az AMD-nél, és csak meghatározott APU+dVGA párosoknál működik. Picit gyorsít a dolgokon, de úgy lesz ez inkább jó, ha az IGP nem grafikát számol majd, és normális dVGA lesz mellette, mert jelenleg ez az IGP+dVGA párosítás csak alsó.középkategóriás kártyákkal megy.

-

Nagyon várom ezt a tesztprogramot!

-

BangoSkank

tag

Arra leszek kíváncsi, hogy egy APU+erős DGPU kombóban, ha heterogén multiadapter módban az IGP megkapja az utófeldolgozást, azaz le lesz terhelve, akkor hogyan változik a CPU órajel, lesz -e throttling.

Ez különösen notebookoknál lehet kritikus az alacsonyra belőtt TDP limitek miatt. Szimultán CPU+iGPU terhelés mellett, azért intel és amd oldalon is van CPU throttling, ami nem gond, ha csak igpu-n játszik az ember, de ha emellett ki kell "hajtani" egy Geforce 860M-et vagy komolyabb GPU-t, akkor lehet némi CPU limit, még akkor is, ha összességében hatékonyabb a DX12.

Három lehetőséget látok:

- nincs throttling, nincs probléma

- végeredményben némi throttling mellett is nagyobb fps-t kapunk

- olyan mértékű throttling ami miatt fps-ben zéró vagy nagyon minimális előrelépés lesz. -

válasz

Petykemano

#34

üzenetére

Petykemano

#34

üzenetére

Amíg az eladott procik ilyen kis töredéke amd apu, addig erre halvány esély sincs.

-

Petykemano

veterán

Hát én is ezt mondom kB.

Olyan eredményeket várnék, hogy innentől mondjuk egy kaveri lehagy egy fx4xxx -et. De hiába mutat minden jep erre, én is nehezen hinném, hogy az évtized végéig az igp átvehetné a számítási kapacitásban a meghatározó szerepetEz akkor változna, ha az AMD megcsinálná, hogy a mantle 2 az igp-n fusson, és persze szerezne hozzá stúdiókat, vayg kikényszerítené a dx ilyen irányú változását. Ez egy új forradalom lenne. Aztán a fene tudja. Lehet, Hogy ha megjelenik a java 9, vagymelyik, akkor felgyorsul. De ez merő találgatás.

-

mekker

őstag

válasz

Petykemano

#20

üzenetére

Petykemano

#20

üzenetére

Szerintem meg az évtized végéig csak dísznek lesz jó az IGP a procikban az átlagos használat során (tehát mondjuk nem realtime raytracing), de ne legyen igazam.

-

SylverR

senior tag

válasz

Petykemano

#25

üzenetére

Petykemano

#25

üzenetére

Oké, ezt benéztem...

Hiba van a mátrixban. Tisztán emlékszem, hogy beszélgettem a témáról, és említettem, viccből, hogy remélem nem követi az AMD a kékek hidazását. Csak azt felejtettem el, hogy ez egy szóvicc volt - a bridge -> ridge hasonlóságára -, és nem is olvastam el rendesen a kommentedben a szót.@(#28) bacsis:

Tisztában vagyok vele hogy ez egy szubjektív vélemény a részedről, de mégsem értem miért mondod. Tekintve hogy ez nem egy akciójáték, vagy fps, hanem egy stratégia, ahol sok pici ilyen kis űrhajócska fog röpködni a levegőben. Ahhoz képest szerintem eléggé jó.@(#31) jacint78: "Rajzfilm"es? Egy űrhajó más érzetet nem is kelthet bennünk. Főleg egy ilyen, mivel ilyen még nem létezik. Kicsit plasztik, hiányoznak részletek, ezt aláírom. De nem olyan rossz ez. Nekem bejön.

-

Steve1207

veterán

Nekem se tetszett, a Terminal Velocity borítója jutott eszembe egyből, de ilyen hozzászólásra nem számítottam, hogy végigolvasgattam

-

Crytek

nagyúr

Nos GeoW aug 25 után ....Fable Legends október 13-án jön! Ez már kettő db dx12-es game!

Várom a teszteredményeket mint a maci a málnásba

-

Hááát skaccok, nem akarok trollkodni, de az a repülő olyan grafikai színvonalat képvisel... hogy egy 3dfx is lerenderelné glide alatt

-

micafighter

nagyúr

válasz

Petykemano

#25

üzenetére

Petykemano

#25

üzenetére

Szerintem bridge-re gondolt a Ridge alatt.

-

SylverR

senior tag

válasz

Petykemano

#20

üzenetére

Petykemano

#20

üzenetére

Miért-miért-miért?

Miért követi a kéket nevezék tanát az AMD? Menjenek a fenébe a hidakkal már.

Miért követi a kéket nevezék tanát az AMD? Menjenek a fenébe a hidakkal már.

-

Dilikutya

félisten

CPU+IGP+VGA. Az IGP, elsősorban az AMD, játékra is jó, de csak fHD-ig, többségében high beállításoknál van az A10 APU-k teljesítőképessége, bár akadnak kivételek, a Dying Light-al és az Evil Within-nel megszenvednek. Viszont az IGP, ahogyan a GPU sem ma már, nem dedikált videóvezérlő, általános számítási feladatokra is tökéletes, párhuzamosságban a CPU előtt jár, így ha úgy van megírva a szoftver, akkor a CPU+IGP+VGA ereje együttesen is kihasználható.

-

Petykemano

veterán

Abu!

Én egy olyan tesztet kérek szépen, amiben ugyanaz a videokártya hajt meg egy játékot (A tisztesség kedvéért persze lehet 1-1 középkategóriás és 1-1 csúcskategóriás GPU az AMD-től és az Nvidiától) DX11 és DX12 alatt is és teszi mindezt különféle procikkal: intel i3, i5, i7, AMD A10, FX63XX, FX83XX

Tehát amire kiváncsi vagyok, hogy különféle CPU-k és APU-k ugyanazzal a GPU-val DX11-ről DX12-re hova gyorsulnak.

köszii

-

Petykemano

veterán

Hasonló kérdésemre Abu azt mondta valamelyik nap, hogy a zent szerverpiacra készíti az AMD, de persze szivárog majd le onnan FX is és APU is.

Ez akkor onnan indult, hogy a MS eliminálta a DX12 hatmagos limitjét és kérdeztem, hogy akkor jöhetnek-e a 12-16 magos procik.

offtopikOliverda kanonizálta az AMD-Zen-excavator-Carrizo találgatós topikot, így másról nem illendő elmélkedni-álmodozni, mint az ismert roadmapekről, amely azt mondja, hogy lesz 8 zenmagos szerver/FX proci (Summit Ridge), 4 excavator magos APU (Bristol Ridge), és 2 excavator magos APU (Stoney Ridge)

Abu szerint egyébként az IGP-s megoldás lesz a nyerő

Szerintem azért nem fogják olyan gyorsan enni a kását és a megfelelő kombináció lesz majd a jó. Tippem az, hogy az fentebb sorolt AMD procikat majd Skylake/Kabylake i7-hez fogják hasonlítani, ami pont 4 maggal lesz erősebb a BR-től és pont egy IGP-vel a SR-től -

Majd meglátjuk.Puding próbája az evés.

-

rocket

nagyúr

Ez izgalmas lesz, tud-e elni a balfek brigad a lehetoseggel, hogy elultessek az emberek fuleben a bogarat

-

Zorel

senior tag

Ennek a tesztnek semmi értelme abból a szempontból, hogyha valaki ez által szeretné eldönteni hogy AMD vs Nvidia. A teszt az Oxide és az AMD közös szüleménye, amit már az AMD a GDC-én is demózott. Teljesen egyértelmű, hogy a teszt milyen kártyákra van optimalizálva. Inkább a játékokat vagy a független benchmarkokat lesz érdemes megvárni, de nagy változásra nem igazán kell számítani, már ami az erőviszonyokat illeti.

-

Televan74

nagyúr

Én egy APU vs CPU összevetés szívesen látnék majd,akár a vélemény rovatban is.

-

Crytek

nagyúr

Hoho akkor nem is kell 2016-ig várnu hogy kiderüljön DX12-ben az amd azisten

Várjuk szerettel aztán meg a Gears of Wart. -

jedis

senior tag

Abu ! A Zen, egy IGP nélküli CPU lesz ( 4 mag, 8 szál ) . Akkor aki a játékok miatt épít modern PC-t, az jobb, ha APU-ban ( CPU+IGP ) gondolkodik ? Fogja hozni a Zen 8 szállal, az APU-k 4 szál + IGP kombójának teljesítményét ? Jó lenne tudni, hogy a játékfejlesztésben melyik lesz az elsődleges prioritás , mert az Intel már szinte nem is nagyon csinál IGP nélküli CPU-t ( max. LGA2011 )

Az AMD a Zen-t amúgy melyik "rétegnek" szánja ?

Az AMD a Zen-t amúgy melyik "rétegnek" szánja ?

-

Na akkor lehet talalgatni :

Amd erobol v. Nvidia penzbol?XD

-

Nagyon várjuk

Új hozzászólás Aktív témák

Hirdetés

- HGST HUH721010AL5200 10TB 7.2k SAS HDD, DELL branded, nettó 38000Ft + ÁFA, 1 év garancia

- BESZÁMÍTÁS! Gigabyte B550M R7 5700X 32GB DDR4 512GB SSD RX 7700 XT 12GB DeepCool CC560 Seasonic 650W

- BESZÁMÍTÁS! Gigabyte B650M R7 7700 32GB DDR5 1TB SSD RTX 5070 12GB BE QUIET! Pure Base 500DX 650W

- Bomba ár! HP EliteBook 840 G4 - i5-7GEN I 16GB I 256GB SSD I 14" FHD Touch I Cam I W10 I Garancia!

- Fotó állvány eladó

Állásajánlatok

Cég: CAMERA-PRO Hungary Kft

Város: Budapest

Cég: PCMENTOR SZERVIZ KFT.

Város: Budapest

Na de az itt már tényleg off, nem?

Na de az itt már tényleg off, nem? De ha valaki nem akar látni, csak kényszeresen a saját elméletéhez igazítani a dolgokat és emiatt egy csomó tényt szándékosan figyelmen kívül hagy, azzal én nem tudok mit kezdeni...

De ha valaki nem akar látni, csak kényszeresen a saját elméletéhez igazítani a dolgokat és emiatt egy csomó tényt szándékosan figyelmen kívül hagy, azzal én nem tudok mit kezdeni...

sokat fejlődik technika

sokat fejlődik technika

![;]](http://cdn.rios.hu/dl/s/v1.gif)