Hirdetés

- One mobilszolgáltatások

- Yettel topik

- Xiaomi 15T Pro - a téma nincs lezárva

- Külföldi prepaid SIM-ek itthon

- Samsung Galaxy Watch (Tizen és Wear OS) ingyenes számlapok, kupon kódok

- Fotók, videók mobillal

- Vivo V70 – a stílus érték?

- Luna Ring 2.0 - így van értelme

- Android alkalmazások - szoftver kibeszélő topik

- VoLTE/VoWiFi

-

Mobilarena

"A Proxmox Virtual Environment (röviden: Proxmox VE, PVE vagy proxmox) egy szerver virtualizációra optimalizált nyilt forráskódú Debian alapú Linux disztribúció. Lehetővé teszi a virtuális gépek és konténerek egyszerű telepítését és kezelését web konzol és command line felülettel. A programcsomag két LXC és OpenVZ konténerek, valamint a KVM alapú virtualizáció kezelését támogatja" (Wikipédia)

Hivatalos oldal: https://proxmox.com/en/

Hivatalos fórum: https://forum.proxmox.com/

Backup center, mail gateway, proxmox hypervisor és datacenter letöltés: https://enterprise.proxmox.com/iso/Véreshurka hozzászólásából

Új hozzászólás Aktív témák

-

Gabesz87

veterán

Végül is így csináltam:

mkdir -p /etc/vzdump

echo './var/lib/containerd' > /etc/vzdump/excludesMég a syncthing-gel kapcsolatban lenne egy utolsó kérdésem. Beállítottam tegnapelőtt, eddig működött is szépen. Ma észrevettem, hogy 94%-on áll a szinkronizálás. UI-ban a létrehozott mappánál azt írja, nincs szinkronban. 1 elem van ami szinkronizálásra vár, a fiam csinált tegnap egy videót, és ez valamiért nem megy fel. Nem látok semmilyen hibát. Telón azt írja, hogy naprakész. Erre esetleg van valami tipped?

Tegnap du. volt az egész kerületben egy kb. 2 órás áramszünet. Na ennek apropójára hadrendbe állítottam az új UPS-t is, beállítottam a NUT-ot, még HA dashboardra csiholok valami ilyesmit, és ezzel is megvagyok.

-

danih

veterán

Hahaha tegnap este én is ezzel foglalkoztam

Updateltem az enyémet, Alpine már benne volt, beletettem a Fedorat is, illetve a megállított LXC-k inditását/leállítását választhatóan, plusz a helperscript appos LXC-kben meghívja az updatert, dockeresben meg az "update-prune" láncot... -

Gabesz87

veterán

Köszi. Igen, most csak a VM+LXC mentésekre gondoltam.

Hát, megnéztem a linket, az írásodat, de őszintel leszek, nekem az kicsit kínai, nem bonyolítom az életem Bár tök jól leírtad step-by-step!

Bár tök jól leírtad step-by-step!

Tegnap miután leírtam, hogy örülök, mint majdom a farkának, és elkezdtem összerakni a másik LXC-t az AdGuard-nak, nem tudom, mi az atyaég történt, de valami nagyon összf..ta magát, és a már működő app-ok az első LXC-ből elérhetetlenné váltak: qbit, arr stack, Plex, minden. Látszólag minden OK volt, futottak a konténerek. Nem volt egyszerű menet, de végül az appdata jogosultságokkal volt valami gebasz, rossz UID volt társítva a mappához. Amit végül csak úgy sikerült megcsinálni, hogy host-ból mountoltam ideiglenesen az LVM kötetet az LXC leállítása után, és chown paranccsal hozzárendeltem az UID-t. Majd umount a temp.LXC-re, és indítva az LXC-t utána jó lett. Ugyanezt el kellett játszanom a másik (adguard-ot tartalmazó) LXC-vel is. Előző napokban is sokat szívtam ezekkel a jogosultságokkal, UID/GID beállításokkal. Minden áron azt akarta, hogy az NFS-nél no_root_squash legyen beállítva, de azzal sehogy nem sikerült összehozni, végül úgy sikerült, hogy all_squash van megadva ill. fixálva az UID és GID- (anonuid/anongid). Remélem nem írtam hülyeségeket

De végül megy minden mostmár, adguard is. Még azon gondolkodom, hogy egy WireGuard-ot is felteszek mellé, mert bár működött a WG elérés a routerben beállított VPN-nel, de amikor elérhetetenné váltak a konténerben lévő dolgok, először azt hittem, a WG VPN miatt van, AI meg is magyarázta faxán, meg azt mondta, hogy ilyen komplex rendszereknél (Proxmox, LXC) okozhat galibát a router általi VPN, és jobb inkább a szerveren futtatni konténerben. Erről mi a véleményetek? -

-

danih

veterán

Egyre tágabb a köre azoknak a fajta operációknak amelyek megengedettek ezekben a szkriptekben. Amihez meg már szinte dokumentáció kell a dependenciák miatt (pl. OpenCloud), ahhoz nincs, csak max egy mondat. Egyre bonyolultabb, sokváltozós rendszereket akarnak ilyen minden-az-egyben szkriptbe tolni és ez a minőség és megbízhatóság rovására megy.

-

Balinov

titán

ennyire azert engem nem vitt meg el, bar amikor arr stack best practice setupot csinaltam, akkor azert elvitt az SMB share rejtelmeibe, de helyreigazitva a temaval kapcsolatban seperc visszatertunk a targyra.

Amugy ja, ha meg az en kezdo tudasommal is kiszurom, hogy bammeg, hulyeseget beszel, akkor azert kello olvatossaggal kell kezelni.

-

danih

veterán

-

Gabesz87

veterán

Ha ez válasz a kérdésedre (remélem), akkor a HDD az a VM-ben futó OMV alatt lett felcsatolva. 3 HDD van (1 az új, 2 a korábbi szerverből átemelve - az egyiken vannak bad sectorok, emiatt vettem az újat, azt fogom használni, a szektorhibásat pedig amíg megy, megtartom, és lehet, hogy Syncthing-et használok majd a telókkal készült képek szerverre mentésére, erre a HDD-re). Köszi a linket, átfutom.

-

Gabesz87

veterán

Nem is tudom, erre mit mondjak

Számomra sok még az ismeretlen fogalom, új a Proxmox. Akárcsak anno az OMV volt. Nehéz volt a kezdet, ismerkedés, összeszokás, sokat kérdezősködtem a topikban, telón is volt, hogy segített 1-1 kedves fórumtag.

Számomra sok még az ismeretlen fogalom, új a Proxmox. Akárcsak anno az OMV volt. Nehéz volt a kezdet, ismerkedés, összeszokás, sokat kérdezősködtem a topikban, telón is volt, hogy segített 1-1 kedves fórumtag.

Szóval tekintve, hogy sok minden homályos nekem, gondoltam, pontosan leírom a chatGPT-nek mit szeretnék, és követem az általa leírtakat. De igen, ezt írta, ajánlotta, hogy a Proxmox host mountolja a share-t, aztán bind mount az LXC-be. Bár őszinte leszek, nekem az sem sokat mond egyelőre, mi is az, hogy bind-mount

Terv szerint 1 LXC lesz (amit már létrehoztam), és ebben futna minden konténer, ahogy azt lentebb is írtam. Nem lesz több LXC.

De lényegében akkor az ajánlásod az kb. ugyanaz, mint amit lentebb írtam 2. opcióként, hogy pl. /mnt/storage1, és ez alatt vannak a létrehozott shared folderek (tv, movies stb.). VAgy nem jól gondolom? Annyi, hogy így akkor 2 mount lesz 1 helyett. -

VANESSZA1

őstag

Na ez a korábbi mentéseknél

"lefagy a Proxmox és csak Hard Reset segít"

téma ...

Hát ismét előjött és nem tudtam mire vélni. Már azt gondoltam, hogy lehet kitavaszodott az AMD-nél is és ismét ez zavart be..

Már majdnem ott voltam, mint Te szoktad, hogy AMD, meg Ryzen, meg macera, de nem hagyott nyugodni a történet.

Rákötöttem egy KVM-et, és egy FingerBot-ot a gépre, hogy ha csinálja akkor legalább távolból megtudom nyomni a bekapcs gombot hosszan, mert nem szeretem ha az asszony a rackszekrénybe nyúlkál (és most nem az áramütés veszélyeire gondolok.. ).

).

És végül ez a KVM által látott Proxmox képernyő ami megmutatta, hogy miért hal le a rendszer mentés közben általában nagyobb LXC/VM-ek mentéseinél.Az alap mentések naponta hajnalban úgy mentek, hogy reggel a PBS ébred (külön Mini PC) a Bios-ban fix időre állítva, és ha feláll akkor elvégzi a mentést, majd ha mindennel végez 03:00-kor kikapcsolja a PBS-t.

Na most ha ilyenkor lefagyott akkor volt hogy én távol voltam, a nejem csak este tudott HR-t csinálni, és így a sok automatizálásnak értelme nem lenne, és ezért is idegesített a történet.

Azért másik mini PC-re és csak mentés idejére ébred, majd kikapcsol mert így (bár lehetne a NAS-ra is, de akkor tudom a NAS-t is úgy időzíteni, hogy amikor szinte használat nélkül van akkor kb fél nap energia megtakarítást lehet elérni a 4x12TB lemez altatással.Most húsvét alatt volt idő kielemezni, és a KVM-en keresztül figyelni.

Alapból ott az kell megjelenjen, hogy ha fut a Proxmox, hogyWelcome to the Proxmox Virtual Environment. Please......

http:// 192.168.1.55:8006/

pve login: _

És amikor elindítottam a mentést, akkor itt dobta ki az üzenetet ami elvezetett a megoldáshoz.

pve login: [FAILED] to start amdgpu-powersave.service - AMD Radeon Vega 7 GPU...Az egész fagyás a túl szigorú Powersave-nak volt köszönhető.

Most a mini PC nem klasszikus powersave-ben van, hanem schedutil governorral, 1,4–3,7 GHz tartományra korlátozva. A governor schedutil, ami terheléstől függően skáláz, de nem annyira agresszíven energiatakarékos, mint a powersave.Ez egy jó kompromisszum: egész napos futásra elég gazdaságos, de backupnál / terhelésnél nem fog annyira szenvedni, mint egy fix Powersave profillal.

Úgyhogy megoldódott a probléma és egyszerűbben mint gondoltam.

Igaz 2-4 W plusz fogyasztás, de ettől még nem fogok ereket vágni

-

Bevásárló listás terv is pipa...

Igazatok volt, Whisper cloud mindent visz. Groq api key, free plan elég. Kicsit finomítgatni kell, nem mindent ért, ha zaj van, de alapvetően működik.

Hogy Proxmox téma is legyen: rsync mentések pipa, külső merevlemezre mentés is: nincs automount, a script megnézi, h begyugtam-e a lemezt. Ha nem, akkor kilép, ha igen: mount, mentés, mail, unmount. Este rádug, reggel lehúz. Néha ismétel.

Claude AI segített ebben. Első scriptek sajátok voltak, innen-onnan és kiegészítve pár dologgal. Ezeket qwen3-al "updateoltam", de a Claude gyorsabb és a PVE-t jól ismeri. Gemini és Qwen3 ott is megakadnak, h debian 13 van nálam, ami még nem stabil, csak teszt verzió...

Persze korigálnak, miután jelzem, h kapcsolódjanak NTP-re és gondolják át.

Persze korigálnak, miután jelzem, h kapcsolódjanak NTP-re és gondolják át. -

Nem lenne egyszerűbb elengedi ezt, és adni az asszonynak egy mini pc-t amit használ?

Értemén, hogy feladat, ..... de

Persze én is agyalnék a megoldáson, de ez már több idő, és több költség, minta eleszeted a probélmát.

Értem, hogy beleöltél már időt és pénzt, de szerintem ez csak időpocsélokás. -

danih

veterán

Bt-re nem tudok megoldást, az integráltat valszeg nehezebb lenne passzolni mint egy külső usb-set. De elvileg ha az utóbbit átadod és ahhoz kapcsolódsz lesz hang. Annyit kell beállítani hogy a hang lokálban menjen és ne az rdp csatornán. És persze a közelben kell legyen valahol :)

Rustdesk esetleg még mint rdp alternatíva. -

danih

veterán

Nem, nem adja át, ezért irtam hogy valami olcsó terminált be (kezeli a monitort és a perifériákat) oszt kész - bár írod hogy van gép. Biztos írtad régebben mi volt a gond, nem emlékszem miért nem jó az rdp... Lokális mentés meg akkor van ha az ember kimondottan azt akarja, csak nem gond hálózati meghajtóra tenni mindent (akár desktop meg documents stb windows alapmappákat is)...

-

danih

veterán

Esetleg ilyen 5000 forintos tízéves terminál innen apróról asszonynak? Vagy arm sbc? Ez a hdmi szivat téged. Sriov-val semmi gond nincs. Docker, Fedora 43 és Windows 11 VM-ek plusz jellyfin, steam, retroarch lxc-k mind mennek 3d gyorsítással - egyszerre, egy csimpi N100-on. Atom stabilan.

-

Nekem három hely (iroda/itthon/szülők) TTS/STT számlája 0,75€/hó.

De ha a pipert szereted akkor a TTS-t ki is hagyhatod, bár én szeretem a microsoft TTS hangját

Ha TTS-t is használsz, válaszd a svéd szervert, ott van a legtöbb multilang hang (ha fontos esetleg hogy többnyelvű legyen) -

danih

veterán

Haha, az ezzel összefüggő aktivitás nagyobb része pár óra alvás kárára ment

De a szopira ott is van idő látom![;]](//cdn.rios.hu/dl/s/v1.gif)

Sztoridról jutott eszembe, hogy van egy régi lenovo minipc-m, gondoltam teszek rá linuxot a napokban(mert ráérek) - mennék be BIOS-ba de nem tudok. Verek mindent - ESC, F2, F10, szokásos dolgok, nem akarja. Eltartott egy ideig amíg rájöttem, hogy a szerencsétlen bill később inicializál, mint maga a gép, "nem ér oda" - pincéből régi bill előkukáz, láss csodát elérem a BIOS-t... Sosem találkoztam még ezzel....

- pincéből régi bill előkukáz, láss csodát elérem a BIOS-t... Sosem találkoztam még ezzel....Végül mi lesz VGA-ra, mekkora AI-t gondoltál futtatni? Az utóbbi egy-két hónapban hatalmas volt ezen a téren a mozgás, sok minden jött ki ami köröket ver az előző generációra.

-

dbius

veterán

Nekem korábban nem így volt, változott a név. Most ránéztem telefononról, nekem maradtak a régi, automatikus elnevezések.

Friss telepítésnél már beállítható, de korábbi telepítésnél (és arról történő frissítésnél) nem tudom, hogy mit csinál, nálam fentebb látható, mi a helyzet - nekem kell kézzel rögzíteni a neveket.

-

danih

veterán

Ez a komment nem fog segíteni de leírom (csak hogy szívrohamot kapj

![;]](//cdn.rios.hu/dl/s/v1.gif) ) hogy én lxc-be tettem (image innen)

) hogy én lxc-be tettem (image innen)

Jó ez így, aki ezeket meg tudná hekkelni nem velünk fog foglalkozni...

Azért este lehet ránézek mert jól írtad - minden jól működik, nincs mit birizgálni éppen... AI-kat tesztelgetek... -

-

Nem rakom OFF-ba, ez csak egy rövid leírás openWRT-hez, kiegészítendő a fentebbieket.

itt az online build-hez a lista, amit a Telepített csomagok és/vagy első boot script testreszabása részhez kell adni.

Csomagok:

apk-mbedtls base-files ca-bundle dnsmasq dropbear e2fsprogs firewall4 fstools grub2-bios-setup kmod-nft-offload libc libgcc libustream-mbedtls logd netifd nftables partx-utils procd-ujail uci uclient-fetch urandom-seed urngd kmod-dwmac-intel kmod-e1000e kmod-e1000 kmod-igc kmod-r8169 losetup luci luci-app-sqm luci-app-statistics luci-app-ttyd qemu-ga intel-microcode irqbalance ethtool tailscale parted resize2fs blkid fdisk nano kmod-sched-cake sqm-scripts tc-tiny kmod-ifb -kmod-cfg80211 -kmod-mac80211 -wpad-basic-wolfssl -wpad-mini -kmod-usb-core -kmod-usb3 -kmod-usb-ohci -kmod-usb2 -kmod-sound-core -kmod-amdgpuEzek Intel host-ra vannak, nincs USB, nincsenek felesleges NIC-hez meghajtók és hasonlók, de van Tailscale és nano. Elvileg ezzel nem borulnak függőségek sem, van, amit nem lehet kitakarítani. Ha benne marad pár extra csomag az nem gond igazán.

A vi aranyos, de ahogy linux userek mondják: már 5 éve vi-t használok...

...valaki megmondaná hogy kell ebből kilépni?

scriptek:

cat << "EOF" > /etc/uci-defaults/70-rootpt-resizeif [ ! -e /etc/rootpt-resize ] \&& type parted > /dev/null \&& lock -n /var/lock/root-resizethenROOT_BLK="$(readlink -f /sys/dev/block/"$(awk -e \'$9=="/dev/root"{print $3}' /proc/self/mountinfo)")"ROOT_DISK="/dev/$(basename "${ROOT_BLK%/*}")"ROOT_PART="${ROOT_BLK##*[^0-9]}"parted -f -s "${ROOT_DISK}" \resizepart "${ROOT_PART}" 100%mount_root donetouch /etc/rootpt-resizerebootfiexit 1EOFcat << "EOF" > /etc/uci-defaults/80-rootfs-resizeif [ ! -e /etc/rootfs-resize ] \&& [ -e /etc/rootpt-resize ] \&& type losetup > /dev/null \&& type resize2fs > /dev/null \&& lock -n /var/lock/root-resizethenROOT_BLK="$(readlink -f /sys/dev/block/"$(awk -e \'$9=="/dev/root"{print $3}' /proc/self/mountinfo)")"ROOT_DEV="/dev/${ROOT_BLK##*/}"LOOP_DEV="$(losetup -f)"losetup "${LOOP_DEV}" "${ROOT_DEV}"resize2fs -f "${LOOP_DEV}"mount_root donetouch /etc/rootfs-resizerebootfiexit 1EOF

Ezek fogják átméretezni a rootfs-t, reboot meg minden cukiság az első indításkor. Azért majd a status oldalon rá kell nézni.

A fenti leírás szerint létrehozni VM-et, meghajtó nélkül. Ezt online összerakja (nem két perc, de megcsinálja jól), letöltés alul a combined-efi ext4 kellene.

A Proxmoxban van valamelyik mappára backup beállítva a datacenterben, akkor pl. arra felvenni még az import-ot is, a letöltött lemezképet máris tudja importálni.

Ismét a "kopasz" openwrt VM, adjuk hozzá a virtIO RNG-t, mert kell majd.Ezután a hardware részen import hard disk, ez átveszi a feltöltött lemezt a tárhelyről a VM-be. Itt dupla katt az unused disk-re, típus virtIO blokk, discard pipa, cache write back (nem az unsafe, a sima), io thread mindegy, backup pipa.

Majd fent a disk műveleteknél adjunk hozzá 0.4 GB-ot (vagy ami tetszik, de ennyi bőven elég), ha a méretnél marhaságot ír, akkor no panic, fent detach disk és újra dupla klikk az unused-re, hozzáad ismét a fentebbiek szerint.

Options-ban boot order beállít, indítás. No para, átméretezget, rebootol, adjunk neki időt. Ha nincs hiba, akkor 1-2 perc és beléphetünk.Itt még terminállal mókolni kell az IP miatt, nekem praktikusan ez is bele lett a scriptbe pakolva, megoszthatom, de ez mindenkinél más, nagyon.

-

paizinho

tag

@markussandor :

Köszönöm, ha lesz leírásod a hogyanról, mert amit videóban láttam, az még egy kicsit furi nekem (kicsomagolt gz-t adott hozzá a VM-hez, aminek első körben nem adott ISO forrást). De az is igaz, működött.

Próbálom egyszerűsíteni a dolgaimat (csillagromboló --> hajó ), illetve a mostanság tapasztalt RAM árak mellett, akkor lehetne proxmox minimal közeli konfigon (persze csomag függő) is az igényeimnek megfelelő soft router-t összerakni a még mindenképpen 0-24-s cuccaimmal.

), illetve a mostanság tapasztalt RAM árak mellett, akkor lehetne proxmox minimal közeli konfigon (persze csomag függő) is az igényeimnek megfelelő soft router-t összerakni a még mindenképpen 0-24-s cuccaimmal. @ViZion : azt gondolom, hogy ilyen alacsony erőforrás igény mellett a felesleges csomagok kivétele (csomag tudásom sem biztosan acélos

) helyett inkább a nekem szükségesek belerakásában gondolkodtam, nehogy olyat vegyek ki, amivel elkaszálok valamit (bár azt gondolom az image builder-ben esetleg lehet ilyesmi védelem).

) helyett inkább a nekem szükségesek belerakásában gondolkodtam, nehogy olyat vegyek ki, amivel elkaszálok valamit (bár azt gondolom az image builder-ben esetleg lehet ilyesmi védelem).Azt jól értem, hogy az opnsense xml-ből Gemini-vel (ez van most pro-ban) tudok openWRT itinert összeállítani ? Csomagok, beállítások ?

Az utolsó mondatodat sajnos nem sikerült feldolgoznom. A már beüzemeltre kell folyamatos snapshot? Vagy install közben ? Az előbbi megvan most is, ráadásul stop-l. Sajnos nekem a host-s rész sem tiszta, hogy mire is kell figyelnibocsi.

Köszönöm, ha lesz lehetőséged tisztázni a kérdéseimet.

-

danih

veterán

Bizony bizony. Én is AI-ztam, pfSense-ben nem nagyon láttam listákon export lehetőséget szóval a képernyő fotókat firewall/nat cuccokról beolvastattam vele, és azt mondtam "ezt a konfigot kérném Openwrt alá, kthx". Meg is csinálta...

Tupírozás is elindult: tailscale fel, szerintem leszedem a subnet router/exit node lxc-t és beteszem ide - egyel kevesebb lxc, még kevesebb erőforrás...

Szuper -

-

https://claude.ai/acquired

elvben ez is megy

@VANESSZA1:

9 EUR-ért ajándék (ha Amerikai (Oregoni) címet adsz meg 10 USD lesz és nem lesz áfa)

-

VANESSZA1

őstag

Hey

Nem Ai kép itt az elérhetősége

VVégén lesz mégis csak passthrough?

-

Tény hogy más a felhasználási területem.

De azt kell mondjam, ha ugyanannyiért van jobb érdemes azt venni.

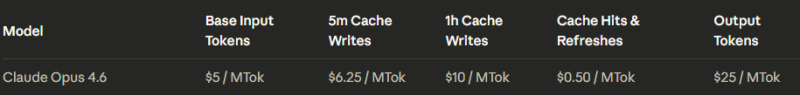

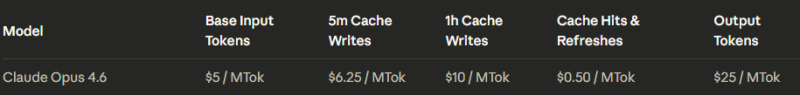

És most nem beszélek az allegro-s licencekről, nem értem a működési elvüket.De a GPT Plus/Gemini AI Pro/ Claude Pro mind 20$ vagy ennek megfelelő EUR.

És mindről elmondható, hogy a 20$-ért 200$ feletti tokent kapsz weben, amit egy aggregátor nem tud adni. Sőt a Perplexity is 20$, de ő kénytelen ezen hasznot is termelni.@VANESSZA1 igen 50$ ExtraUse Tokent kapsz (webre, sajnos nem API-ra) és itt jössz rá, hogy milyen drága az API

2 óra alatt le lehet puszilni Opussal.

2 óra alatt le lehet puszilni Opussal.

Itt az ára:

1 Millió tokenes contextussal 1 kérés kerülhet 5$-ba és ez csak kérdés elküldése volt

Egy 1millió tokenes válasz meg 25$-ba. -

danih

veterán

Az automatikus, hogy minek hány % igpu-t ad, ha többfelé osztom? Mert Ollama az kapott, sokat nem jelent, de van neki

Namost a fentit nem értem, többfelé tudtommal nem tudod osztani full PT mellett... De ha nem full pt akkor a rendszer dinamikusan intézi az osztást, nem tudsz manuálisan szeleteket osztani.

Amúgy úgy tudom megy a gvt-g, sztem régebben láttam redditen -

VANESSZA1

őstag

Így hogy rákérdeztél és össze számoltam 4 az a három.

Perplexity pro plus

Ai studio plus

Gemini pro

Chatgpt pro

Általában az első kettőt használom, mert szinte kifogyhatatlan, eddig 1x jelzet, de már nem tudom melyik volt, hogy kifogyott a keret, de az szinte egy hét full használat után.

Általában ha HA, proxmox valami kód kell akkor Claude pro modellel oldom meg és párhuzamosan megfuttatom valamelyik másikban egy másik modellel is több és komplexebb kérdésekkel.

A Gemini nálam egyszerű dolgokra még oké, de komolyabb szinten nem használom. Például proxmox passthrough-t nem bíznék rá. -

Jaja, ha magyar modellre van szükség az 3060 8G-től indul (ha headless módban fut) de olyan sokat eszik, hogy abból elvagyok a felhős előfizetéssel

kiegészítők nélkül a gpt-4o-mini (szarért hugyért) elviszi a ház irányítását.

ha valami értelmet is várunk tőle, akkor a haiku, de 5* annyiba kerül. Ehhez már durván kell optimalizálni az entitás számot. -

VANESSZA1

őstag

Az Ai sem túl lelkes, és ahogy nálam írja... Hát ez kicsit szívás lehet, de te nagy barkácsolós vagy így simán lehet hogy jó projekt lesz. 😝

Ai:

Igen, átadható, de trükkösebb, mint Linux VM-nek.Intel GVT-g (vGPU) vs. Passthrough:A 10. generáció (Comet Lake) az utolsó, ami még támogatja a GVT-g technológiát. Ez lehetővé teszi, hogy az iGPU-t "feldabold", és egyszerre több VM is használja (pl. egy Windows VM + egy Plex konténer). Ez hatalmas előny a 11-12-13. generációhoz képest, ahol ez a funkció megszűnt (ott csak az SR-IOV van, amihez speciális kernel hack kell, vagy a teljes passthrough).Teljes Passthrough (Legacy mód): Ha a teljes kártyát egyetlen Windows 11 VM-nek adod át:Működik, de a "Code 43" hibaüzenet gyakori Nvidia kártyáknál, Intel iGPU-nál ritkább, de előfordulhat.Mivel ez a "boot GPU", a Proxmox konzolját elveszítheted a képernyőn, amint a VM elindul (ezért kell a SSH vagy webes elérés).Windows 11 alatt a driverek néha kényesek, ha nincs fizikai monitor rákötve (dummy plug használata javasolt lehet). -

danih

veterán

Detto ugyanez a filozófiám...

Ha valami elkúródik = totál kuka Egyszer sem kellet a file szintű visszaálítás.

Egyszer sem kellet a file szintű visszaálítás.

Na meg nálam úgy van az alapokról minden felépítve hogy az adat külön van, olyan helyen (általában mount) ami automatikusan ki van zárva a ct/vm mentésből - és külön van kezelve, példa erre a docker vm-ben a konténer volume-ok... Ezek a mentésen felül még rsync-eznek a desktopomra is már, ahol van egy proxmox vm vész esetére. -

markussandor

senior tag

A beépített is lementi a gépeket, és vissza tudsz állni, de a PBS tud deduplikálni, tömöríteni, fájlonként visszaállni, és akár szalagos egységet is kezelni.

Nálam így néz ki a statisztika:Original Data usage: 2.306 TiBOn-Disk usage: 201.585 GiB (8.54%)On-Disk chunks: 134999Deduplication Factor: 11.71Bőven elég neki 1 CPU és 2 GB RAM.

@Patice

Nem a PBS VM holléte a lényeg, hanem a PBS adat kötete legyen lehetőleg független helyen a PVE-től. Az adataim sokadik mentését én is messze tartom. -

danih

veterán

Bennem is ez merült fel, alap backup feladatokat maga a Proxmox is el tud látni, ha ez elég nem kell még egy külön backup rendszert emiatt fenntartani.

Szerintem @Patice vizsgáld meg mire van konkrétan szükséged és tudja-e azt maga a Proxmox maga. Mert esélyes, hogy igen. -

-

VANESSZA1

őstag

Nem magára ment. Két mentés van az egyik ébreszti a PBS-t és arra, és van mégegy mentés és az pedig a NAS-ra. Mindkettőnél csinálja.

Bios nem lett turva.

Valahogy a RAM gyanús nekem, de ebbe a rohadt árkavalkádban beújítani 2db 32Gb-st az enyhén fájó projekt.

És ami furcsa, hogy ha lefagy a Proxmox, akkor az LXC-k VM-k tovább futnak, csak a PVE Webgui-n vagy SSH-n nem elérhető, és ezért nem értem a dolgot.

Nem akarok AI-al nekiállni, mert lehet úgy beküld a málnásba, hogy még felteteti a Proxmox 10.1-et is

-

történelmi okai vannak.

kezdetben vala egy nas és vala egy windows 10-es gép, ami torrentezik, tévészerverként működik, utóbb jellyfin szerver is, meg még pár apróság. a két gép nem is egy városban volt

később jött az igény, hogy a két gépből legyen egy. először a nast csináltam meg egy vm-ben az új gépen, aztán amikor egy megvolt, a másik gép feladatait kezdtem konténerekba pakolni.

mellékszál: transmissiont linuxra költöztetni sima ügy, a jellyfint viszont nem sikerült.a nas lehetne docker host, de egyelőre megnyugtatóbb szétválasztva, hátha szét találom gányolni a dockert

aztán lehet, hogy egy szép napon összeköltöztetem őket.

aztán lehet, hogy egy szép napon összeköltöztetem őket. -

-

danih

veterán

Ok makd megnézem beteszem, max 2-3 ilyen env van...

Mekkora modellre nézzek sebességet? Van ami gyorsabb, van ami lassab, attól függ ugye hány "b"

A linkeltet használom igen, 4 core és 6 gb ramot adtam neki... De érdekesen működik mert nem látszik a ram használat pvestaton, ugyanis vram-ként veszi el a ramot... -

danih

veterán

Nekem van Ollama LXC-m ami használja az IGP-t. Akkor most min vagy? Már teljesen összezavarodtam

Ha intel akkor ez kell neked. Sima portable, nincs szívás csak kicsomi alap GPU-s Ubuntu LXC-be, meg esetleg pár env változó belövése. Kis modellek simán mennek, és jobban mint csak CPU-val. Helper script ide nem jó. -

amit még meg kell fejtenem, és ebben az éáj nem vitt előbbre (ebben sem

bár sok dologban meg igen), hogy a nas vm már fut, elindítom a docker vm-et, és a nas megosztásának felcsatolására hibát dob, és emiatt persze az arról dolgozó containerek is elhasalnak. ha kézzel csatolom fél perccel később, már hibátlan.

bár sok dologban meg igen), hogy a nas vm már fut, elindítom a docker vm-et, és a nas megosztásának felcsatolására hibát dob, és emiatt persze az arról dolgozó containerek is elhasalnak. ha kézzel csatolom fél perccel később, már hibátlan.

nem indítgatom félóránként, de azért jó lenne, ha úgy tudna indulni, hogy nem kell kézzel piszkálni. -

VANESSZA1

őstag

Igen az a másik. azt én is észre vettem, hogy a NAS rendesen fel kall álljon, és után a PVE különben nincsenek jóban. De az áramszünet (oké van UPS, de az is véges) az padlóra dobja a rendszert.

powertop régi inteles vonalon nálam (i5-7500t) még tette a dolgát. Most már nem használom. 7-10W és max 17W de akkor minden megy nekem bőven jó -

VANESSZA1

őstag

AMD APU‑n (4650G, HP 805 G6) én így csinálnám:

De a host teljesen elveszíti az iGPU‑t, tehát csak akkor érdemes, ha tényleg VM‑ben akarsz natív GPU‑t, nem csak VAAPI‑t konténerben.

Biosban:

SR‑IOV, Above 4G Decoding Bekapcsolni

IOMMU / SVM / AMD‑Vi: Be

Integrált graf szintén Be, amúgy nem lesz Passtrough

Majd kezdeném a Proxmoxban:dmesg | grep -e IOMMU -e AMD-Vi(ezzel megnézni az OIMMU-t, hogy aktív-e)

Bekapcsolnám az IOMMU-t:/etc/default/grub

GRUB_CMDLINE_LINUX_DEFAULT="quiet amd_iommu=on iommu=pt video=efifb:off"

(Mondjuk itt még lehetne mókolnivfio-pci.ids=ésnomodeset-et)update-grub update-initramfs -u reboot

iGPU PCI ID azonosítása és VFIO‑hoz kötés, de ezt már Host-onlspci -nn | grep -Ei "vga|display"

ekkor már meg kellene jöjjön az AMD Devices, amiből ai ID-t láthatnánk (VGA+ Audio)

Aztán /etc/modulesvfio vfio_pci vfio_iommu_type1 vfio_virqfd

/etc/modprobe.d/vfio.confoptions vfio-pci ids=1xxxx:1xx6,1xx2:1xxx disable_vga=1(mondjuk saját ID-vel)

Blacklisted driver :

/etc/modprobe.d/blacklist-amdgpu.conf:blacklist amdgpu

frissiteni:update-initramfs -ureboot

Aztán ha újraindult és még él :lspci -nnk | grep -A3 -Ei "vga|display"

És a többit már a VM-ben , amihez jobb a Debian, és Sea BIOS+vBIOS mindenképp..stb. -

VANESSZA1

őstag

Én meg pont kiköltöztettem a HA alól a Frigate-t, de behívva be van és látom ott is a kamerákat, mert ha már van MQTT akkor már ott csak egy lépés.

PCIe passthrough‑val teljesen VM‑nek adni az iGPU‑t AMD APU‑nál macerásabb, és a host akkor nem tudja használni konzolra, GUI‑ra, stb., ezért a legtöbb Jellyfin‑/Frigate‑s setup LXC‑s/dev/dripassthrough‑t használ, de nem lehetlen. -

VANESSZA1

őstag

Én így csináltam, és adtam esélyt az AI-nak megfogalmazni a lépéseket

(bocs ha kicsit hosszú), de remélem segít.

🚀 Ultimate Frigate Útmutató:

Proxmox LXC + AMD Ryzen iGPU + Google Coral Dual Edge TPU

Ez az útmutató bemutatja, hogyan építs fel egy brutális teljesítményű NVR rendszert Proxmox alatt, LXC konténerben (nem VM-ben!), minimális erőforrás-veszteséggel.

A Vas ("A Főnök"):

• CPU: AMD Ryzen 5 Pro 4650G (Vega 7 iGPU - hardveres kódoláshoz)

• AI: Google Coral Dual Edge TPU (M.2 E-key - objektum detektáláshoz)

• OS: Proxmox VE 8.x (Kernel 6.8+)

________________________________________

🛠️ 1. Lépés: Proxmox Host Előkészítése (Driverek)

Mivel LXC-t használunk, a Host gép kernelét és drivereit használja a konténer. A Proxmox 8-as kerneléhez (6.5+) a hivatalos Google Coral driver nem jó, a közösségi javított verzió kell.

Lépj be a Proxmox Shellbe:

1. Csomagtárolók és Header-ek rendezése:

(Ha nincs előfizetésed, kapcsold be a no-subscription repót, és kapcsold ki az enterprise-t, majd frissíts).

> apt update

> apt install -y pve-headers-$(uname -r) git dkms build-essential

2. A Dual Coral Driver telepítése (Feranick Fork):

> cd /usr/src

> git clone https://github.com/feranick/gasket-driver.git

> cd gasket-driver

> debuild -us -uc -tc -b

> cd ..

> dpkg -i gasket-dkms_*.deb

> apt install -y libedgetpu1-std

3. Jogosultságok (UDEV szabály):

> sh -c "echo 'SUBSYSTEM==\"apex\", MODE=\"0666\"' > /etc/udev/rules.d/65-apex.rules"

> udevadm control --reload-rules && udevadm trigger

4. Ellenőrzés és Újraindítás:

Indítsd újra a szervert (reboot). Utána ellenőrizd:

> ls -l /dev/apex*

# látnod-kell-devapex_0-és-devapex_1

________________________________________

📦 2. Lépés: Az LXC Konténer Létrehozása

Hozz létre egy Debian 12 (Bookworm) konténert a Proxmox felületén ezekkel a beállításokkal:

• Privileged: IGEN (Unprivileged pipát vedd ki!) – Kritikus a hardver eléréshez.

• Nesting: IGEN (Options -> Features -> Nesting) – Kell a Dockernek.

• Resources: 4 CPU mag, 4GB+ RAM.

________________________________________

🔗 3. Lépés: Hardver Átadás (Passthrough)

Mielőtt elindítanád a konténert, szerkeszd a konfigurációját a Host Shellben.

(A példában a konténer ID: 300, a tárhelyed UUID-jét vagy mount pontját ellenőrizd!)

> nano /etc/pve/lxc/300.conf

Add a fájl végéhez:

# --- AMD Vega GPU Átadás ---

> lxc.cgroup2.devices.allow: c 226:* rwm

> lxc.mount.entry: /dev/dri/renderD128 dev/dri/renderD128 none bind,optional,create=file 0, 0

> lxc.mount.entry: /dev/dri/card0 dev/dri/card0 none bind,optional,create=file 0, 0

# --- Google Coral Dual TPU Átadás (Major ID: 120) ---

> lxc.cgroup2.devices.allow: c 120:* rwm

> lxc.mount.entry: /dev/apex_0 dev/apex_0 none bind,optional,create=file 0, 0

> lxc.mount.entry: /dev/apex_1 dev/apex_1 none bind,optional,create=file 0, 0

# --- Tárhely (Bind Mount) ---

> mp0: /mnt/frigate_media,mp=/media/frigate

# --- DOCKER JOGOSULTSÁG JAVÍTÁS (Kritikus!) ---

> lxc.apparmor.profile: unconfined

________________________________________

🐳 4. Lépés: Docker és Driverek a Konténerben

Indítsd el a konténert, lépj be a konzoljába, és telepítsd a környezetet:

# Rendszer frissítés

> apt update && apt upgrade -y

> apt install -y curl gnupg2 lsb-release

# Docker telepítése

> curl -fsSL https://get.docker.com -o get-docker.sh

> sh get-docker.sh

# AMD Driverek telepítése (hogy a Frigate lássa a GPU-t)

> apt install -y mesa-va-drivers mesa-vdpau-drivers vainfo

________________________________________

⚙️ 5. Lépés: Frigate Telepítése (Docker Compose)

Hozd létre a mappát: /opt/frigate.

docker-compose.yml (Kiemelt figyelem a Frigate Plus kulcsra!):

version: "3.9"

services:

frigate:

container_name: frigate

privileged: true

restart: unless-stopped

image: ghcr.io/blakeblackshear/frigate:stable

shm_size: "256mb"

environment:

# FONTOS: Frigate 0.14+ alatt a kulcsot itt kell megadni!

# A változó neve: PLUS_API_KEY (nem FRIGATE_PLUS_API_KEY)

- PLUS_API_KEY=IDE_ÍRD_A_HOSSZÚ_KULCSOT_MACSKAKÖRÖM_NÉLKÜL

devices:

- /dev/apex_0:/dev/apex_0

- /dev/apex_1:/dev/apex_1

- /dev/dri/renderD128:/dev/dri/renderD128

volumes:

- /etc/localtime:/etc/localtime:ro

- ./config.yml:/config/config.yml

- /media/frigate:/media/frigate

- type: tmpfs

target: /tmp/cache

tmpfs:

size: 1000000000 # 1GB RAM Cache

ports:

- "5000:5000"

- "8554:8554"

- "8555:8555/tcp" # WebRTC

- "8555:8555/udp" # WebRTC

config.yml (Optimális beállítások):

mqtt:

enabled: False # Vagy add meg a HA adatait

# Frigate Plus Modell (Kulcs a docker-compose-ban van!)

model:

path: plus://xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx

# Dual TPU használata

> * detectors:

> * coral_pci1:

> * type: edgetpu

> * device: pci:0

> * coral_pci2:

> * type: edgetpu

> * device: pci:1

# AMD GPU Hardveres gyorsítás

> ffmpeg:

> hwaccel_args: preset-vaapi

# Helytakarékos rögzítés (Csak események tárolása)

> record:

> enabled: True

> retain:

> days: 0 # Üresjáratot nem tárolunk

> mode: all

> events:

> retain:

> default: 10 # Eseményeket 10 napig őrizzük

> mode: active_objects

>

> snapshots:

> enabled: True

________________________________________

✅ 6. Lépés: Indítás

docker compose up -d

Ha mindent jól csináltál, a http://IP_CIM:5000 címen:

1. A System fülön látod a két Coralt (Inference speed < 10ms).

2. Látod az AMD GPU (vaapi) használatot.

3. A Frigate Plus modell aktív.

Pro Tipp: Most azonnal csinálj egy Backupot a konténerről a Proxmoxban! 😉

⚠️ KRITIKUS PONT: A Frigate Plus Kulcs és a Modell ID megkülönböztetése

A leggyakoribb hiba, hogy összekeverik a "Belépőkártyát" (API Key) és a "Terméket" (Model ID). A Frigate 0.14+ verziótól kezdve ezeket KÉT KÜLÖNBÖZŐ HELYRE kell írni!

1. A Hosszú API Kulcs ("A Jelszó")

• Hol találod: Frigate Plus Dashboard -> Settings -> API Key.

• Hova kell írni: docker-compose.yml

• Változó neve: PLUS_API_KEY (Szigorúan ez a neve! Nem FRIGATE_PLUS...!)

• Formátum: Csak a hosszú karaktersorozat, macskaköröm nélkül.

Példa a docker-compose.yml-ben:

> environment:

> - PLUS_API_KEY=xxxxxxxxxxxxxxxxxxxxxxxx... (IDE JÖN A HOSSZÚ KULCS) ...707bxaxa

2. A Modell Azonosító ("A Termék")

• Hol találod: Frigate Plus Dashboard -> Models -> A modell ID-ja (pl. plus://...).

• Hova kell írni: config.yml

• Szekció: model: path:

• Fontos: Itt NEM szabad megadni a plus: key: blokkot, mert az már a docker-compose-ban van!

Példa a config.yml-ben:

> model:

> path: plus://xxxxxxxxxxxxxxxxxxxxxxxxx <-- IDE CSAK AZ ID KELL!

________________________________________

Összefoglalva a működés logikája:

1. A konténer induláskor beolvassa a titkos kulcsot a docker-compose.yml-ből (PLUS_API_KEY).

2. Ezzel "bejelentkezik" a Frigate szerverre.

3. Ezután megnézi a config.yml-t, látja a model: path:-ot.

4. Mivel már be van jelentkezve, engedélyt kap a modell letöltésére és futtatására.

________________________________________

Mükődő AMD Ryzen Proxmox IGP átadással ! 😉 -

danih

veterán

Van rajta fogyimérő, ennyit mutat... MiniPC notebook alkatrészekkel.

Pve-t meg jól látod, mióta átment communitybe a minőség romlik, túl sok mindent akarnak gyorsan hozzáadni, sok a hiba... Most kijött az OpenCloud lxc, ki szeretném próbálni de nem néz ki valami "jól"... -

danih

veterán

Tákolásért-gányolásért simán lehet hozzám jönni

Amit írtam arra lenne kihegyezve ha csak maga a szerógép hal le, vagy mondjuk a vinyója - és cseréig nem lennék minden nélkül. Mivel nálam a szeró a router után van, a netet nem befolyásolja (kis setup, na). Van NAS is, illetve persze az meg van már oldva hogy Storage-ként be van téve a dekstop-om mint potenciális backup célpont... Szóval ezek mind nem jelentenek gondot, már így is megvoltak.

Szerintem elég egyszerűen lehetne automatizálni, boot végére berakni service-ként hogy fusson le egy "behúzás" és indítás. AI tuti megbírkózik ezzel, komplexebb Proxmox szkript feladatokkal is megbírkózott már.

Csak a legfontosabb dolgok mennének át persze - DNS szerver, Vaultwarden, Tailscale, Proxy manager, ilyesmik. -

danih

veterán

Dark módban úgy formáz a weboldal hogy kifolyik a szemem a kód blokkoknál

Amúgy szép munka!Más dolog hiányában homelab téren (mivel minden megy olajozottan - azaz unatkozom), azon gondolkodtam, hogy kéne még egy kis redundancia, de óccón. Cluster ezért kizárva, nem is akarok szenvedni vele. Ellenben az jutott eszembe hogy itt van a kis desktop mini pc-m barátságos fogyasztással amit gyakorlatilag sosem kapcsolok ki - mobil Ryzen 7, 32 GB RAM... Mi lenne, ha virtualizálnék rá egy másdolagos Proxmox-ot?

Esetleg meg lehetne csinálni azt, hogy indítás után a legfirssebb konténer mentésekből automatikusan állítsa vissza (azaz inkább "importálja") a szükséges LXC-ket és indítsa el azokat. Szerintem akár AI-val össze lehetne tákolni egy ilyen szkriptet simán.

A PC-mre pedig írhaték egy szimpla szkriptet ami monitorozza a szervert, és ha mondjuk pár percen keresztül nem elérhető, akkor indítja lokálisan a virtuálisat (és leveri ha esetleg a szeró magától visszajönne)...

Egyelőre ott tartok hogy feldobtam egy Virtuális Proxmox-ot és kézzel leteszteltem Vaultwarden-nel (szerveren LXC kikapcs, VM-en bekapcs). Működött rögtön, ahogy kell.

Szóval kotlok kicsit a láncolaton, hogy mehetne a mentés/visszaállítás (és ne gabalyodjak bele )

)

Csinált már valaki ilyet? -

danih

veterán

Ránézésre saccperkábé ezeket tudja a Bento - csak lokálisan, nem megy ki senkihez a doksid. (Én ezért proxmoxozok főleg - semmit sehova senkinek nem akarok küldeni, feltölteni, satöbbi. Ha valami kell, akkor self-hosted alternatívát keresek rá ha progi nincs jó)

Ja, és mikor, mikor - hát ma éjszaka

Új hozzászólás Aktív témák

Hirdetés

- GAMER PC! i7-12700 / RTX 3080 Ti / 32GB 4133MHz / B760M / 1TB NVMe / 700w! BeszámítOK

- Dell Latitude 5401,14" FHD,i7-9850H,16GB DDR4,512GB SSD,WIN11,ÚJ AKKU

- BESZÁMÍTÁS! ASUS B550M R7 5700X 16GB DDR4 512GB SSD RTX 3070 8GB Aerocool P500B Digi ARGB 750W

- USB Switch 2IN 4OUT KVM kapcsoló

- Eladó Dell Latitude 5340 i5-1345U 16 GB DDR5

Állásajánlatok

Cég: Laptopműhely Bt.

Város: Budapest

ddr5 kilove. Meg ha jo arban lenne a 1851 platform, akkor a 245-ben van NPU, meg az is segitene

ddr5 kilove. Meg ha jo arban lenne a 1851 platform, akkor a 245-ben van NPU, meg az is segitene

Persze korigálnak, miután jelzem, h kapcsolódjanak NTP-re és gondolják át.

Persze korigálnak, miután jelzem, h kapcsolódjanak NTP-re és gondolják át.

![;]](http://cdn.rios.hu/dl/s/v1.gif)

tasiadam

tasiadam