Új hozzászólás Aktív témák

-

-

válasz

FollowTheORI

#11713

üzenetére

FollowTheORI

#11713

üzenetére

Persze hozzáteszem az sem mindegy mit és hogyan mérnek... lehet nincs annyi egység, vagy olyan bonyolult AI, ami CPU limitet okozna... de azis lehet van, csak a bench nem hozza ki azt ami a valós játékban előfordulhat worst case.

-

-

válasz

#85552128

#11710

üzenetére

#85552128

#11710

üzenetére

Azért az SC2-őt eléggé kipofozták az utóbbi években... sőt mostmár van 64bites kód stb.

Szerintem ezzel a játékkal nem lesz gond, futni fog és már agyon van optimalizálva.

Ha valamitől akkor ettől pont nem félek. Az első két rész is "faszán fut".

Az Anno ellenben lehet még olyan, mint a Cities Skyline, jó kis cpu limittel... aztán majd jöhet a kihajcsa vagy sem témakör is. Már várom...

-

-

Szerintem az XFX ezekkel a 2-3 kártyás "szűk" rendszert építőkre pályázik. Oda nincs más/jobb megoldás.

-

-

válasz

daveoff

#11556

üzenetére

daveoff

#11556

üzenetére

Eddig nagyon optimista voltam DX12 vonalon ("papíron" jól hangzott)... Jelenleg vannak erős kétségeim már a sikerességét illetően. Föleg ebből a konzolport irányból nézve... Meg persze úgy általában is hogy mekkora előrelépés is lesz valójában.

De majd kiderül. Tényleg várjuk meg az első nagy játékokat ezzel kapcsolatban.

-

Ez nekem sem derült ki most így visszaolvasva... most akkor a GW a szar csak, vagy a játék is szar... vagy a játék a GW miatt szar... vagy nem is szar a játék csak a GW...

Ha a játékot mint játék nézzük, azért olyan sok rossz GW játék nincs... ha csak a GW-t nézzük, az meg opciális, vagyis ha csak az a szar kikapcsolod.

Amugy szerintem nem a GW miatt rossz egyik játék sem ami rossz (akármilyen szempontból nézem).

Itt a fejlesztők meg a kiadók a sarasak főleg, látva ahol gond volt azt is meg tudták oldani idővel és munkával, úgy hogy a GW is maradt. Tehát nem a GW szar, hanem az elvégzett munka max...

-

-

MS kérhet bármit, attól még az nVidia drivere csinálni fogja az aggresszív multithread-et, mert így tudják kinyerni a legtöb párhuzamosságot a GPU-ból/feladatból.

Nagy kérdés ha a játékot is így/erre optimalizálják az mennyire hátráltatja a többi hardver szállítót.

Mert azért az eléggé kézenfekvő hogy a piac 70-80%-ára fognak optimalizálni ami nVidia kézben van, gamer szinten.

nVidiának meg a DX12 fog így fájni, mert amit eddig tudtak trükközni az mostantól nincs, írták is hogy már nem lesz driver szintű multi threading a kis DX12 oldalukon, mostantól a játékfejlesztő feladata ez. Hát kíváncsi leszek hogy sikerül.

-

-

Elég sok oldal tesztel kártyákat rendszeresen... Egy ilyen hamar kibukna.

Anno amikor volt jogalapja el is kapták őket rendesen. Azóta szerintem nem nagyon trükköznek látható romlással.

-

-

válasz

Laja333

#11116

üzenetére

Laja333

#11116

üzenetére

Kívácsi leszek én arra, majd amikor max player számmal fut a szerver max grafikán.

Mondjuk lehet ezért limitálták csak 24re? Vagy mennyi a max player.

280X-el (380) már a BF4 is összeesett max grafikán bőven...

Az se lepne meg ha ebbe a bétába még benne se lenne minden csilivili.

-

-

Szerintem az apple-nél a metal miatt nem lesz nagy ugrálás... ők írják a drivert, tehát jobb ha minél egységesebb a paletta.

-

-

-

válasz

FollowTheORI

#11051

üzenetére

FollowTheORI

#11051

üzenetére

*márcus = tavasszal inkább

-

válasz

MiklosSaS

#11049

üzenetére

MiklosSaS

#11049

üzenetére

Nem hinném hogy sietnek... eddig mindig márciusban volt az új kártyák bejelentése, a 980/970 volt 1 éve a kivétel.

480 március 2010

580 november 2010 (de ez csak amolyan előrehozott "javított" kiadású 480)

680 március 2012

780 május 2013

980 szeptember 2014 (de a Titan 2015 március) -

válasz

Ren Hoek

#10955

üzenetére

Ren Hoek

#10955

üzenetére

Engem pár óra után szokott zavarni néha... amellett hogy aláizzadsz.

De mivel több ok miatt sem bömböltethetek hifit ezért ez van. Nekem az kényelmesebb lenne.És engem a 3D szemüveg is zavarni szokott... de ezt is elfogadom, mert arra az 1-2 órára még oké.

4-5 órát már valszeg nem viselném azt se el...Nem irigylem a szemüvegeseket, remélem nekem is minél később lesz.

-

válasz

-Solt-

#10947

üzenetére

-Solt-

#10947

üzenetére

Na hát ha valamiben akkor abban biztos vagyok hogy a TV-t és mozit nem váltja ki... önmagadban nem tudod közösségi élménnyé tenni.

Nincs olyan hogy leül a család és megnéz egy filmet vagy valami műsort együtt.

Meg egyébként is beteg elképzelni hogy hazamész és a gyerekek a szobájukban sisakban agymosnak meg az asszony is a nappaliban... brrr... most képzeld el... vagy négyen a kanapén.

Szerintem ez annyira "beteg" kép hogy nem lesz népszerű.A 3D tévézés egyik átka is ez volt, a kevés és gyenge tartalom mellett ami kicsit értelmetlenné tette az egészet.

Játéknál látom értelmét, meg egyéni szórakozásnál... nyilván ez lehet film vagy bármi.

De meg vagyok győződve arról hogy kényelmetlen lesz órákon át használni... és végül az lesz hogy egyre rövidebb és rövidebb ideig lesz hajlandó használni az ember aztán a végén már fel se veszi majd.

1-1 ritka alkalomra pedig nem fognak rá beruházni.

Gondolj csak bele hogy a szemüvegeket is nem győzték egyre vékonyabbra és könnyebre tervezni, mert egyszerűen zavarta az embereket... namost egy sisak? Hát... 1-1órára oké... de nem ebbe fogod végigtolni a witchert azis tuti.

Persze mondom eleinte óriási hype lesz, meg tudom hogy óriási élmény lesz stb stb. A 3D is az volt... én még emlékszek rá... abba is ugyanúgy sok pénzt toltak és az sem egyből halt el... kellett neki pár év mire a helyére került. Ezzel is ezt várom... sőt, ha elérhető lesz árban és úgyérzem nekem is lehet hogy lesz. Mert érdekel. Mint ahogy érdekel sok más is amit kipróbálnék vagy használnék szívesen egy ideig is akár... de hosszútávon én nem látom benne a rációt. Hogy pl onnantól kezdve csak úgy akarnék játszani, stb stb.

-

Szerintem az egész VR-től nem kell tartani, lesz majd egy hype aztán lecseng mint a 3D tévézés otthon.

Persze lehet nem lesz igazam, de egyelőre nagyobb pénzt tennék arra hogy bukni fog, mint arra hogy nem.

-

válasz

daveoff

#10843

üzenetére

daveoff

#10843

üzenetére

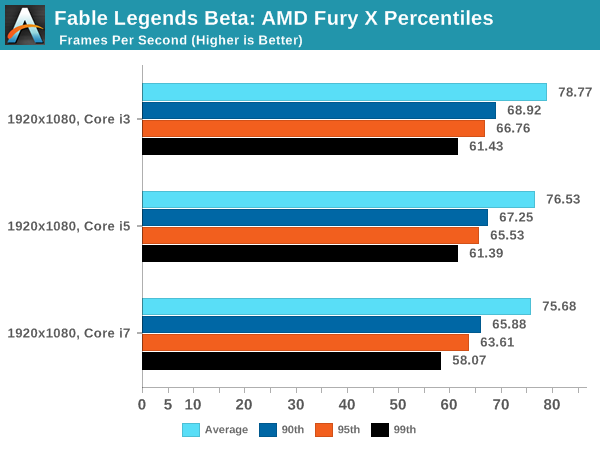

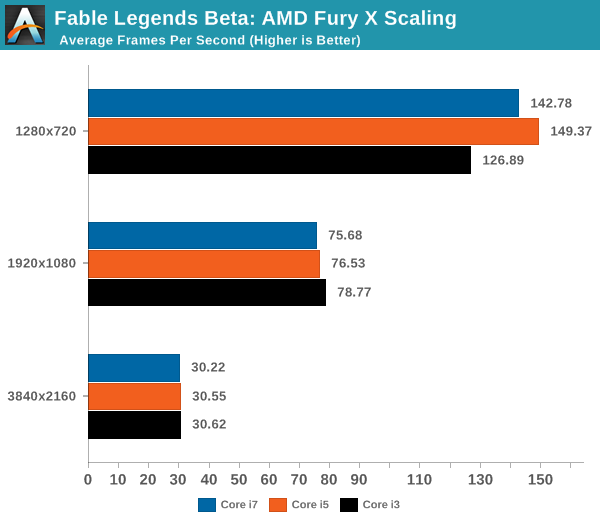

Szerintem ez összefügg azzal hogy AMD-n a HT sem megy jól... nvidia sokkal agresszívebben használja a CPU-t ezért folyamatosabban tudja etetni a GPU-t, AMD meg gondolom időnként kifogy a szuflából és akkor droppol egyet.

Gondolom ennek is köze van a szoftveres vs hardveres schedulerhez... vagy minek hívjam. Ami az async mizéria során derült ki az nVidiáról.

Mondjuk ebből szvsz alig érzékelünk valamit. Én sose foglalkoztam ezzel akármilyen kártyám volt.

-

-

-

-

-

-

Az extreme teches teszt egy nagy katyvasz, szerintem azért más.

Le van írva hogy csak a Fury X és 980Ti-t tesztelték... a többi AMD mérése (átvették/másolták).

Az AMD meg olyan driverrel és úgy mért ahogy akart.

Ettől független a tendencia látszik.

DX12 alatt a 390-ek és a 980 nagyon közel van és a Ti meg Fury X is.

-

válasz

Yllgrim

#10765

üzenetére

Yllgrim

#10765

üzenetére

Szerintem ez elég egyszerű, mindig azt hozzák ki ami a konkurecia megveréséhez, vagy megközelítéséhez elég.

Úgy lövik be az órajeleket stb stb.

Aztán van amikor túl kell lőni a terveiken, van amikor meg hátradőlhetnek és nem kell a maxot kihozni.Pl a 980 az utóbbi volt szvsz, a Fury meg az előbbi (azért nincs is benne tartalék).

-

-

-

válasz

->Raizen<-

#10744

üzenetére

->Raizen<-

#10744

üzenetére

Eddig nekem ez az egyetlen ami tetszett ilyen demókból.

Jah látom közben te is betetted.

-

-

válasz

Locutus

#10733

üzenetére

Locutus

#10733

üzenetére

No igen, nem mondták hogy minden pascal ezzel jön.

Pl a középső P104 vagy akámi lesz a kódneve GTX980/70 utód még simán jöhet GDDR5-el is. Látható a Ti alapján is hogy még bőven elég... akár 4k-ra is. Rábiggyesztenek egy 384 bites buszt 7-8GHz-el, nincs olyan amire nem elég.

A P110-el meg bevárhatják a HBM2-őt később... a Titan/Ti-vel úgysem kell majd sietniük szvsz az AMD sem tudja hamarabb hozni.

Cserébe egy olcsó középkategóriás chippel, csak immár 14/16 nanon, újra tarolhatnak egyet úgy, hogy konkurens tavasszal sehol sem lesz.

Nem is lepne meg, ha így csinálnák.

Az alsó P106 meg pláne nem lesz HBM2-es. Szóval kell hogy legyen már egy GDDR5-ös és egy HBM2-es pascal design-nak is lennie.

-

Egyáltalán nem biztos...

Az Intelnek is van HMC-s demo lapkája a Xeon Phi-vel... tehát ez létező dolog.

Ami érdekes hogy az nVidia miért dobta... ezek szerint valamiért nem jött be... lassú vagy ilyesmi. Vagy a Micron késik valamivel.

Vagy a Micron az Intellel azt csinálta amit a Hynix az AMD-vel (dobta a többi partnert az első működő termékig). És akkor már a HBM2 be lett dobva hogy nemsokára jön mindenki számára.

Na mindegy érdekes dolgok lehetnek a háttérben most memória tech fronton az tuti.

-

-

-

-

-

-

válasz

Locutus

#10275

üzenetére

Locutus

#10275

üzenetére

Ez sem egy rossz alternatíva... Ez max az nVidiának nehezítheti meg a dolgát a jövőben DX fronton.

Viszont ha ez lesz a következő Sony konzol intel+nvidia lesz megint (ha x86 kompatibilisek akarnak maradni).

Egyébként nekem a szimpibb struktúra még mindig az lenne, ha a CPU rész (ami visszafogja a bizniszt) menne IP/licenc onlyba. És az maradna önálló. A GPU+APU+SoC biznisz meg egy másik cég. Amit aztán akár az MS is megvehet, bár jobb lenne a ha független maradna.

-

Ahogy az várható volt GTX980 tejlesítmény. Kicsit zajos, de amúgy jópofa.

Kár hogy az árazása nem ide van belőve.

-

válasz

schawo

#10183

üzenetére

schawo

#10183

üzenetére

Én hiszek abban hogy a nagyobb címeknél belefeccölik azt az időt hogy ott legyen a DX12 út is a DX11 mellett.

Ez tényleg azon múlik mennyire lesz költséges a konzol kódot áthozni.Amugymeg mivel a Win10 ingyenes miért ne "mondhatnák azt maguknak", hogy én nem feccölöm bele a DX11 problémás kódba a pénzt, ha van jobb is... majd vált az aki akar. Régi konzolokra sem jön ki mindig az új játék, és itt azért mégsem feltétlen kell új hardvert venni.

De majd kiderül.

-

válasz

UnSkilleD

#10181

üzenetére

UnSkilleD

#10181

üzenetére

Hát ez azért nem ilyen problémás szerintem.

Mivel minden mai DX11 GPU (szinte, most nem 2-3 évvel ezelőttre gondolok nyilván) képes az alap DX12 támogatására, ezért a DX11 only is lehet valójában DX12 only, tehát pl soros végrehajtás, amit minden tud.

Aztán ami DX12 vas tényleg, ott bevethetnek extra trükköket (async pl). Ezt pedig használhatják plussz effektekre, vagy amit nyernek vele sebesség esetleg, azt jobb extra grafikára/fizikára stb.Magyarán DX12 only, de DX11 képességű hardver. Nincs async, lassab ezért pl csak medium-high grafika/fizika fut. DX12 vason meg van async, amivel extra grafika veryhigh-ultra + extra fizika effektek... stb.

A DX12 driver meg meg van ígérve Fremi/Kepler és GCN óta... szóval az utóbbi 1-2 év vasai támogatva lesznek.

-

válasz

Dark KillerX

#10179

üzenetére

Dark KillerX

#10179

üzenetére

Azis early 2016 leghamarabb... itt most az idén startolás a lényeg.

-

válasz

UnSkilleD

#10177

üzenetére

UnSkilleD

#10177

üzenetére

Szerintem februárra lesz DX12 bőven. Addigra lesz normális driver és támogatás.

A BF-re csak azért nem tippelem mert nagyon közel van és még most is kétségek vannak a driverek funkciók meg a DX12 ökoszisztéma körül (lást AotS). Ha nem akarnak a rajttal szívni (konzolok + PC), akkor a már meglévő DX11-el indulnak, az be van járatva, ki van pofozva, végletekig optimalizált, aztán vagy benne lesz próbaképp a 12 vagy később hozzáteszik. Márpedig szvsz sem az EA, sem a DICE, sem a Disney/Lucasfilm nem fog ezzel kockáztatni a film előtt.

De februárra, majd fél év mulva... simán lehet már a 12 az alap.

-

válasz

Laja333

#10170

üzenetére

Laja333

#10170

üzenetére

Jelenleg pletyka szinten esélyes a Witcher 3.

De garantálni még nem garantálták.Battlefront sem lepne meg, ha még DX11-el indulna (a win 10 elterjedtsége és a szélesebb tömegek elérése miatt)... de hogy a DX12 nem hoz sokat, ha lesz benne, (max annyit mint a Mantle eddig) az tuti.

Korábbi DICE játékokba meg tuti nem lesz visszaportolva. A BF4 motorját szerintem már annyira agyon customizálták hogy nem lehet bele semmi újat beletenni. (Értem ezalatt a sok "optimalizálást" az elmúlt 2 év alatt - ha most bejönne egy új motor akkor kezdhetnék előröl az időzítések, netcode meg minden optimalizálását az új megjelenítéshez pl.)

Szerintem amugy a Mirror's Edge lesz az első ami DX12-re készül elsődlegesen majd.

-

-

-

Hát lehet... bár szerintem akkor az Oculusba tettek volna pénzt (is).

Az eddigi "track recordjuk" alapján IT-Business vonalon mozognak inkább... a VR meg eléggé inkább szórakoztatóipar (meg eléggé kicsi piac is nekik). (Zen, szerver, cloud stb vonal ikább. De lehet neked van igazad).Annyi a lényeg, hogy ez mindenképp jó jel, ha összejön. A Silver Lake az egyik legjobb ilyen cég aki ki szokta kaparni a gesztenyét/aranybányát.

-

válasz

rocket

#10138

üzenetére

rocket

#10138

üzenetére

Ez egyébként jó hír, mert a Silver Lake olyan dolgokba szokott beszállni amik felfutóban vannak. Úgy értve hogy van a cégnek egy olyan technológiája amitől nagy piacbővülést és innovációt várnak (hogy a cég amibe bevásárolnak nővelni fogja értékét).

Lehet a Zen sikerére építenek most (előre), ezek szerint jó úton halad a fejlesztés a háttérben.

-

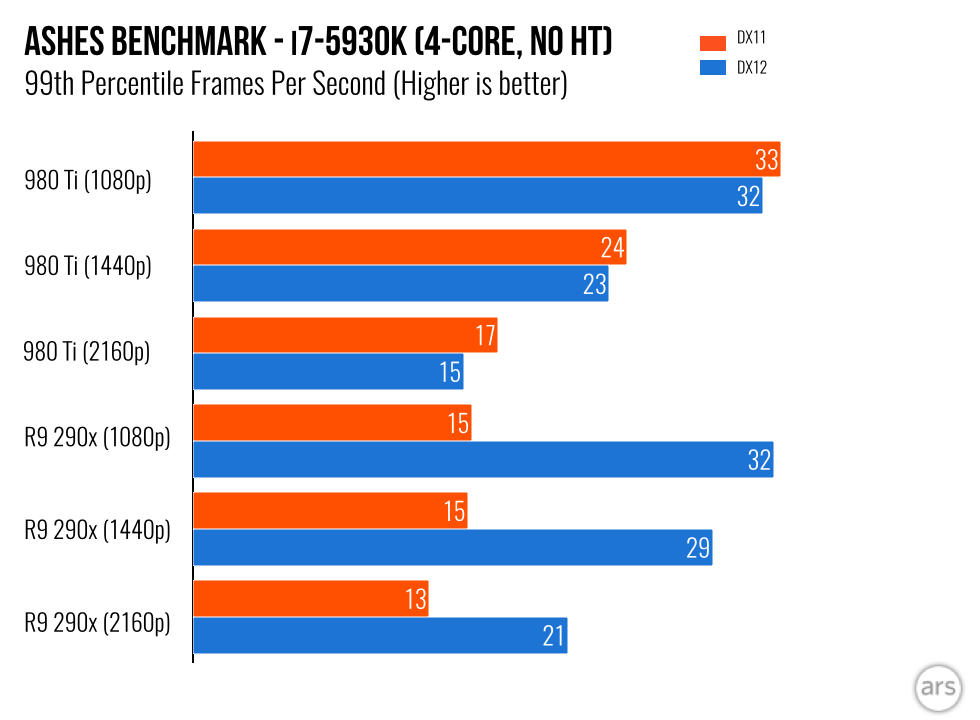

Ennyire nem tragikus a szitu... 2 dolog már most is látszik:

DX12 alapból segít, tehát az alacsonyabb CPU tejlesítmény mellett javult az nVidia is (CPU overhead kisebb lett náluk is).

A másik meg hogy még így "bugosan" is hozta az a szintet közel, amit az AMD async-el... szóval nem lehet kijelenteni hogy az async maga a kánaán. Márcsak azért sem mert attól még hogy tudja egy GPU, nem biztos hogy lesz rajta annyi szabad kapacitás hogy orrvérzésig compute menjen mellette.

-

válasz

FollowTheORI

#10002

üzenetére

FollowTheORI

#10002

üzenetére

+ a preempció/context switch:

AMD: nyilván hardver ezis, és bármikor megtörténhet, ha kell, futás közben, fine grain is van tehát (bármelyik pillanatban futás közben).

nVidia: csakúgy mint a compute/graphics feladatok, ezt is hasonlóan "be kell ütemezni", szoftver ütemezi, nem történehet meg akármikor (ugyanúgy meg kell várni míg lefut minden, tehát ideális esetben a draw végét).

-

válasz

Petykemano

#9979

üzenetére

Petykemano

#9979

üzenetére

Én ha jól értem ebből a lényeget, ezt hámoztam ki.

AMD: beadhatsz 1 graphics (legyen itt draw call most) + x compute szálat (64 van kezelve egyszerre full hw-ben, az előtte és közben is a gpu osztja be a feladatot -scheduler- stb). Tehát van async. Amikor ez elkezd futni (végrehajtódni) bármikor hozzáadhatsz új feladatokat azok elkezdenek azonnal végrehajtódni párhuzamosan, ha van rá szabad erőforrás. Tehát nem kell megváni sem a draw, sem a compute végét, máris megy utána azonnal az új feladat is, vagy vele párhuzamosan is. Tehát amolyan "full szabadon etethető" async.

nVidia: beadhatsz 1 graphics (draw) + x compute szálat (32 van kezelve egyszerre hardverben, de csak részben - munkabeosztás (shedule, stb stb) az cpu/szoftver feladat). Tehát van async. Amikor ez elkezd futni (végrehajtódni), akkor viszont nem adhatsz hozzá bármikor új feladatot már, meg kell várni amíg az 1 grafikus (draw) feladat legalább végrehajtódik (+ a már eleve elindult compute is nyilván). Szóval a minimális idő a draw call futása. Utána megint hozzá lehet csapni a következő plussz feladatokat (vagy a már meglévő mögé, vagy mellé). Tehát itt a megkötés csak annyi, hogy nem kezd ez azonnal végrehajtódni az új végrehajtandó feladat párhuzamásan akármikor.

Ez számomra nem zárja ki hogy működőképes legyen a dolog, mire kell figyelni csak?

Hát arra hogy lehetőleg amíg a draw fut, addig ne akarj végrehajtani új párhuzamos feladatot. És lehetőleg a compute feladataid ne legyenek hosszabbak a draw call végrehajtásánál.Jól értem, hogy jól értem?

-

-

Wikin amugy ez van írva a context switchről általában:

"Hardware vs. software

Context switching can be performed primarily by software or hardware. Some processors, like the Intel 80386 and its successors,[6] have hardware support for context switches, by making use of a special data segment designated the task state segment or TSS. A task switch can be explicitly triggered with a CALL or JMP instruction targeted at a TSS descriptor in the global descriptor table. It can occur implicitly when an interrupt or exception is triggered if there's a task gate in the interrupt descriptor table. When a task switch occurs the CPU can automatically load the new state from the TSS.

As with other tasks performed in hardware, one would expect this to be rather fast; however, mainstream operating systems, including Windows and Linux, do not use this feature. This is mainly due to two reasons:

1. Hardware context switching does not save all the registers (only general purpose registers, not floating point registers — although the TS bit is automatically turned on in the CR0 control register, resulting in a fault when executing floating point instructions and giving the OS the opportunity to save and restore the floating point state as needed).

2. Associated performance issues, e.g., software context switching can be selective and store only those registers that need storing, whereas hardware context switching stores nearly all registers whether they are required or not."

Szóval várjuk meg mi lesz, lehet ettől még gyors. Attól függ az nVidia hogy oldotta meg.

-

válasz

#45185024

#9962

üzenetére

#45185024

#9962

üzenetére

Ha elfogadjuk így van, akkor sincs gond feltétlen.

Ez csak azt mondja hogy az ACE bizonyos része szoftverben(driver) van megoldva, míg AMD-n hardveresen.

Ettől még nem feltétlen lassabb (pl kell context switch), csak máshogy törénik a vezérlése/előkészítése.

(Pl lehet CPU igényesebb csak, az meg ma már nem igazán gond.) -

-

-

-

Ami ennél a tesztnél érdekes hogy a 4 magos HT mentes CPU beállítással jobban futott...

Nem kerek még ez a DX12 Ashes téma... majd év vége felé talán használható lesz, igazi játékok alatt. Bár lehet azt is majd peccselgetik még vagy negyedévig mire jó lesz, addig meg "DX11" módba megy majd.

-

-

-

-

31+1 -et én most itt queue limitnek néztem, nem compute motornak... szóval a moderált is ki tudja mennyi... persze lehet jóval kevesebb meg több is.

De tekintve hogy mennyi mindent szélsőségesen paralellizáltak ebben a motorban (amivel amugy semmi gond, hisz ez a cél), könnyen lehet túlvannak a 32 queue-n (összegészében)...És igazából a problémát is abban gondoltam hogy mi van ha ennél többet akarnak rátenni egyszerre és a driver ezt úgy kezeli le hogy felbontja 31/2-es "csomagokra".

És ha nagyon beesik a teljesítmény az azért van, mert pl van egy 32-es csomag (1 graf + 31 compute queue) a második, meg a harmadik meg csak compute (nincs graf), neadjisten egy egy ilyen 32 csomag után még pre-emp is kell ami szintén időkiesés. Aztán kezdődik elölről.Mondjuk AMD-n meg jól megy, elég lehet akár azis ha csak 32-nél több, de 64nél kevesebb, és pl emiatt nem kell (meg amugyse náluk pre-emp), plusz az egészet egyszerre le is tudják kezelni, nem kell pl ketté bontani. Ami ugyan lehet tovább tart mint nVidián egy 32-es "csomag", de a többi "overhead" miatt mégis az AMD jobb összidőben. Ki tudja lehet akár 100%-al is, ami már nevezhető durva beesésnek.

Na mindegy tényleg keveset tudunk, arról is a bench mit akar csinálni és a hw/driver is, hogy működik.

Meg mást nem tudok elképzelni, mert ha a nVidia már rég közölte és dokumentálta hogy a Maxwell 2 tud egyszerre compute és grafikát is, a Maxwell 1 és előtt meg csak egyik vagy másik, akkor önmagában ez nem lehet baj. Tehát mennie kell egyszerre. Inkább csak valami limitáció van máshol rá hogy mennyi az annyi, vagy hogyan kell etetni.

Szerk +, mondjuk ez a BY3D-s otthoni barkács tesztprogi is lehet ezt jelenti, mert minden egyes 32-es csomagnál nőtt az idő... AMD meg egyforma ugye.

Ez kicsit olyan mintha 32-es csomagokra kéne bontania a drivernek a queue-kat.

Aztán persze ugyis tévedhetek, hisz nem értek hozzá ennyire (sem).

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

-

Szerintem azért mert túl sok párhuzamos feladatot kapott amit már nem tudott lekezelni elég gyosan (fel akarta pl mindet sorba fűzni, de ugye az több időt vett el a végrehajtástól), vagy olyan sok compute kerül a grafikus "időszeletek közé" a soros átrendezéssel, hogy a grafika túlságosan lassan végzett.

De túl keveset tudunk arról az nVidia driver meg hw tulajdonképpen mit is csinál párhuzamosan kapott feladatoknál.Legalábbis async problémakörben csak ezt tudom elképzelni.

Ideális esetben csak annyi a gond, hogy tényleg a jelenlegi driver csak soros feladatokat vár, és azt utána max belül ők szétdobálják párhuzamos csomagokra végrehajtás előtt (ez ugye jó DX11 és DX12 alatt is). És csak ezt kell úgy átírni hogy mostmár maga a program megtehesse ezt.

Rosszabb esetben az van hogy tényleg hw korlát van, amit spéci módon sorban kell etetni, elég korlátos módon/limitek között és azon belül tud csak párhuzamosítani valamennyire az egész rendszer. Pl egyszere ilyen 31+1-es csomagokat tud csak megenni, és a feladatot ilyen 32-es csomagokban kell sorban adni neki... nem pedig ráengedni mittomén 300-at egyszerre.

Majd kiderül.

-

-

válasz

#Morcosmedve

#9535

üzenetére

#Morcosmedve

#9535

üzenetére

Akkor már csak a Prohardveren kéne megírja valaki...

Akkor már csak a Prohardveren kéne megírja valaki... ![;]](//cdn.rios.hu/dl/s/v1.gif)

Abu?

-

válasz

Malibutomi

#9524

üzenetére

Malibutomi

#9524

üzenetére

Hát ez elég nagy gáz lesz, ha így van, mert a most készülő jövőre kijövő játékok nagyrésze használná ezt a funkciót. Konzolon ez most a húzó dolog.

Mondjuk addigra itt lehet a pascal, de akkoris gáz.

-

válasz

#35434496

#9518

üzenetére

#35434496

#9518

üzenetére

Szerintem nem, vagy max később kapja meg, mint a Mantle-t a BF4 pl. Esetleg benne lesz, de nem fog a látványhoz hozzátenni (csakúgy mint a Mantle sem tett), sőt a csúcs sebességhez sem. Hatékonyságot növelhet CPU limites szitukban viszont.

Ennél többet én nem várnék.Az igazi DX12 játékok (DX12-höz igazodó architektúrával és leképezővel) szvsz jövő ilyenkor jönnek majd. Addig csak próbálkozások lesznek, meg amolyan "nice to have". Esetleg kiütik a CPU limitet itt ott vele.

Talán annyi látszik majd hogy AMD tényleg felzárkózik majd nVidia mellé a CPU limites dolgokban (ami az Ashes benchben is látszódik kb).Mondjuk az elég nagy blama lesz, ha Maxwell2-őn se lesz async compute tényleg... eddig az volt a mondás hogy tudják. Most hogy ez tényleg csak valami driver issue most, vagy valami más is e majd kiderül.

-

Kíváncsi lennék az ARK-os srácok is ebbe futottak bele, vagy valami hasonlóba... remélem majd leírják egyszer.

(Mármint ők is valami async dolgot akartak, és driver problémák miatt nem ment pl nVidia oldalon. Ezért írtak mindkét oldalnak hogy akkor most mi van ezzel? Kinek a drivere szar?

)

) -

-

-

-

válasz

->Raizen<-

#9482

üzenetére

->Raizen<-

#9482

üzenetére

A lényeg nincs benne mondom:

Fórum:

" [08/28/15] ARK DirectX 12 Delay

ARK DirectX 12 DelayHello Survivors,

It's been a long week here at Studio Wildcard as the programming team has been grinding to get the DX12 version ready for release. It runs, it looks good, but unfortunately we came across some driver issues that we can't entirely tackle ourselves

. We’ve reached out to both NVIDIA and AMD and will be working with them to get it resolved as soon as possible! Once that’s tackled, we’ll be needing to do more solid testing across a range of hardware with the new fixes. Sadly, we're gonna have to delay its release until some day next week in order to be satisfied with it. It's disappointing to us too and we're sorry for the delay, really thought we’d have it nailed today but we wouldn't want to release ARK DX12 without the care it still needs at this point. Hang in there, and when it's ready for public consumption, it should be worth the wait!"

. We’ve reached out to both NVIDIA and AMD and will be working with them to get it resolved as soon as possible! Once that’s tackled, we’ll be needing to do more solid testing across a range of hardware with the new fixes. Sadly, we're gonna have to delay its release until some day next week in order to be satisfied with it. It's disappointing to us too and we're sorry for the delay, really thought we’d have it nailed today but we wouldn't want to release ARK DX12 without the care it still needs at this point. Hang in there, and when it's ready for public consumption, it should be worth the wait!" -

válasz

->Raizen<-

#9479

üzenetére

->Raizen<-

#9479

üzenetére

Nem jött, mármint ami a lényeg lett volna... le is töröltem.

-

-

-

válasz

velizare

#9403

üzenetére

velizare

#9403

üzenetére

Mondjuk a mobilpiacot kár idevenni, mert ott eleve tengernyi szereplő van... és az Apple a maga 20-30% eladásával gyakorlatilag piacvezető (gondolom itt az operációs rendszerre gondoltál amugy)... itt meg az AMD nem az (makó jeruzsálemtől).

Naná hogy egy piacvezető elvan... főleg hogy a bevétel és a profit igazán nagy része pont az applehez csorog.

Ha az AMD olyan szituba lenne mint az apple ezzel a 20%-al, tapsolnának nekik és a részvényeik szárnyalnának, meg pezsgőzne naponta a vezérkar kb.

Sajnos a AMD nézőpontjából egyre szarabb a szitu minden fronton: [link]

Quick highlights:

AMD’s overall unit shipments decreased -25.82% quarter-to-quarter, Intel’s total shipments decreased -7.39% from last quarter, and Nvidia’s decreased -16.19%.

The attach rate of GPUs (includes integrated and discrete GPUs) to PCs for the quarter was 137% which was down -10.82% from last quarter, and 26.43% of PCs had discrete GPUs, which is down -4.15%.

The overall PC market decreased -4.05% quarter-to-quarter, and decreased -10.40% year-to-year.

Desktop graphics add-in boards (AIBs) that use discrete GPUs decreased -16.81% from last quarter.Eladnak mondjuk 400 millió PC-t, abból csak kb a negyede, tehát 100 millióba van diszkrét GPU. Aztán hogy ebből még külön mennyi az ami ér is valamit, tehát mid-high end legalább... nos nem sok, amin haszon is lenne (nagyobb).

-

válasz

Malibutomi

#9395

üzenetére

Malibutomi

#9395

üzenetére

Mantle alatt.

-

válasz

Malibutomi

#9339

üzenetére

Malibutomi

#9339

üzenetére

Engem az se lepne meg ha a Game Ready driver valami trükkel érné el ezt... (mármint hogy a DX11 és a 12 is ugyanúgy fut).

Nyilván a valóságban nincs ekkora NV előny, mert nincs olyan játék ami a DX11-et így térdre kényszeríti.

Ez csak azt mutatja, hogy lehetne olyan DX11 játékot is csinálni ami NV-n még jól futna, AMD-n meg már nem.A 390X és a GTX980 más játékokban is fej fej mellett van, ugyanúgy mint itt DX12 alatt.

Ergo ugyanúgy fej-fej mellett lesznek DX12 játékokban is (ahogy ma is), ez csak ennyit mutat. -

-

Szerintem nem volt kevés...

Rengeteg dolog még mindig nincs PC-n, pl közös memória és cache hozzáférés, stb.

PC-n csomó ilyen lassító dolog van amit át kell hidalni vagy ki kell küszöbölni trükkökkel.

Ráadásul igazán a hardvert még konzolon sem használják ki, jövőre jönnek az igazi nextgen játékok első futárai.

-

-

-

-

Ciki lenne, ha egy Star Wars élményt a Disney engedné hogy csak a piac 25%-a se élvezzen. Pláne a film előtt nemsokkal.

Persze nyilván őket a konzolbiznisz érdekli amugy... ott fognak nagyot szakítani ezzel majd. Azon belül is a PS4 a húzó platform eddig legalábbis úgy néz ki.

-

-

Tudod hogy megy ez... RH olyan szinten van hogy mondta neki valaki akinek a haverjánál látta valaki.

Mármint szóval gondolhatod hogy nem ezzel tölti az idejét hogy ilyeneket tesztel meg vizsgál ő maga.

Mondták neki, meg olvasta, meg kapta a közösségi oldalain és továbbadta.

Sose tudni amugy nála, hogy saját véleményt mond, vagy az AMD hivatalos álláspontját is... mert szerintem inkább csak az előbbi.

Ettől függetlenül igaza van... és remélem verik még a port kicsit az nVidia körül és megemberelik magukat és leszoknak erről az üzleti magatartásról.

Aztán persze lehet minden marad így és pofáraesünk (meg elül a zaj), de azért az utóbbi időben most tényleg sokan felkapták a témát. Lehet lesz valami eredménye. -

Haha... tök vicces sokat gondolkodtam már mi lenne a legjobban kifejező dolog mi az AMD baja.

Erre itt egy baromi jó leírás:

Tudom apple, meg bla bla... nem ez a lényeg.

Hanem az AMD pont ezeket a hibákat követi el mindig.

Mindig a technológiára koncentrál és azt próbálja eladni.

Az nVidia meg pont fordítva... pont azt csinálja mit Jobs mond, megmutatja az eredményt (PhysX, Gameworks effektek), sebesség, stb stb. Ez kell neked? Vegyél GTX-et... TITAN-t.

Érdekel milyen directx meg api meg nyavaja? Nem... amit látsz az a fontos, és az élmény amit kapsz a terméktől.Wááá mennyire igaz ez. És ezért tart ott egyik és a másik cég is ahol.

-

-

-

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Új! Targus - USB-C Dual HDMI 4K HUB - 2 HDMI-vel. Saját töltő nélkül 2 monitorral (120Hz)

- Csere-Beszámítás! Olcsó Számítógép PC Játékra! R5 1500X / RX 570 8GB / 16GB DDR4 / 250SSD + 2TB HDD

- Bitcoin Miner Eladó Bitmain Antminer S19 JPro 104 Th 3150 watt

- Bomba ár HP X360 11 G5 - Intel 4020 I 4GB I 128GB SSD I 11,6" HD Touch I Cam I W11 I Garancia!

- Samsung Galaxy S23PLUS 256GB Kártyafüggetlen 1Év Garanciával

Állásajánlatok

Cég: CAMERA-PRO Hungary Kft

Város: Budapest

Cég: Promenade Publishing House Kft.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

. We’ve reached out to both NVIDIA and AMD and will be working with them to get it resolved as soon as possible! Once that’s tackled, we’ll be needing to do more solid testing across a range of hardware with the new fixes. Sadly, we're gonna have to delay its release until some day next week in order to be satisfied with it. It's disappointing to us too and we're sorry for the delay, really thought we’d have it nailed today but we wouldn't want to release ARK DX12 without the care it still needs at this point. Hang in there, and when it's ready for public consumption, it should be worth the wait!"

. We’ve reached out to both NVIDIA and AMD and will be working with them to get it resolved as soon as possible! Once that’s tackled, we’ll be needing to do more solid testing across a range of hardware with the new fixes. Sadly, we're gonna have to delay its release until some day next week in order to be satisfied with it. It's disappointing to us too and we're sorry for the delay, really thought we’d have it nailed today but we wouldn't want to release ARK DX12 without the care it still needs at this point. Hang in there, and when it's ready for public consumption, it should be worth the wait!"