Új hozzászólás Aktív témák

-

-

-

-

-

válasz

bertapet11

#26614

üzenetére

bertapet11

#26614

üzenetére

Mit néztek be, mit kell nézni?

-

-

válasz

FragMaster

#26565

üzenetére

FragMaster

#26565

üzenetére

Az majd a Voltánál lesz... amikor meg lehet majd alázni az AMD-t a saját térfelén is.

-

-

-

-

-

For Honor Benchmarks - 25 GPUs tested at 1080p, 1440p, & 4K!

Egész jól optimalizáltnak tűnik a cucc PC-re is...

-

-

-

Játékfüggő... lehet akármennyi ramod... az első betöltés lehet lassú játék közben is, ami HDD-n jobban megakadhat, még ha a sok ram segít is a utána azzal, hogy újra nem kell betölteni.

Egyre több modern játék egyre jobban használja a streaming/vitruális memóriás moddelleket.

Vagyis ahogy mászkálsz a játékban dinamikusan tölti be az új helyszíneket (és persze egyre nagyobb adathalmazokat is mozgatnak)... ha van hely akkor mindig új helyre, ha nincs akkor meg ugye szépen szipkázza be a rendszermemóriából meg a lemezről... ezért van az hogy egyre több játék megeszi a szabad memóriakapcitásokat is. És ha kevés van akkor hamarabb kezd el dadogni a rendszer, főleg mikor törölni/új adatot kell behozni egyre gyakrabban. No meg ugye bejön a lapozó fájl is windowsban, meg hogy az SSD/HDD-n van e, vagy ki van e kapcsolva eleve... csak fokozza a problémát mindegyik.Ezért egyre jobban számít az egész adattárolási lánc és a buszok sebessége a láncban.

Egyre több rendszer és GPU ram kell, az lesz a jó ha minél több van, illetve az összes láncban felmerülő busz sebessége is minél nagyobb lesz annál jobb lesz.

Ez ma még piciben látszik érzékelhető, de már itt ott látszik... és ahogy haladunk előre időben egyre jobban fog látszani.Ugye első a GPU cache, aztán a GPU ram (GPU sávszél sebességgel), oda a rendszermemóriából másol (PCIE sebessége és a processzor sebessége), majd oda meg az SSD/HDD sebessége.

Ezért van az hogy pár ilyen játék pl az új Skylake/Kabylake platformból is profitál (DDR4 nagyobb sávszél, jöbb/több PCIE kapcsolat, jobb gyorsabb CPU cache, stb) mondjuk egy Haswellhez képest... és a Sanybridge azér szakad le egyre jobban, hiába maga a proci jó, a platform körülőtte elavult. Hiába pl az azonos órajel és az overclock.

Maximalistáknak gyakran ezért nem is a CPU csere lehet előnyös, hanem az hogy körülötte minden nagyságrendekkel jobb lesz.Valószínűleg az AMD lemaradása is egyre nagyobb részben a platform elavulása miatt is van, nem csak az FX procik gyengesége miatt... 5-10% százalékok szépen összeadódnak minden kis bizbasz alrendszer előnyéből/hátrányából.

Részben ezért is lesz érdekes hogy ha az amit pl Abu is mondott meg a Vega-val elvileg jön ez az új memória modell is, pont erre az egész "steaming"/virtuális memória láncra épül, mennyit fog javítani a szitun, vagy mit számít majd... (nyilván ahogy haladunk előre egyre többet és többet... AMD módra ugye megint picit a jövőre van tervezve minden).

Meg majd szépen megjelenik az SSD is a GPU mellett a kártyákon. -

-

Szerintem csak valami fotoshop kokálmány...

-

Fury X mai szemmel (legalábbis egy "vélemény").

Dedikálva hüllőnek...

-

-

-

Van akinek meg a Guru3D nem az...

Szerintem mindegyik lehet hiteles, amíg mondjuk nincs megcáfolva egyértelműen... vagy valami miatt hitelét vesztené egyik.

Mindenhol szoktak mérni fasságokat amugy... a legjobb az, ha megnézel több tesztet és azokból levonsz egy "átlag" következtetést... és akkor kb valahol az igazság körül leszel. Sosem szabad csak egy oldalra alapozni a véleményed.

Ami a konkrét csatornát illeti, két srác kezdte hobbiból, semmi extra... ma már ott tartanak hogy küldik nekik a gyártók a cuccokat, és ezeket csomagolják ki... aka ezért "unboxing" a nevük (nyilván eleinte saját pénzből tolták/kezdték).

Szeretnék én ennyire "nem hiteles" lenni az életben.

És ha egy bejáratott "szaksajtósnak" vagy egy hobbistának kell hinnem... hát néha jobban hinnék egy hobbistának aki bele teszi a szívét lelkét a dologba (és mellesleg értelmes és hasznos dolgokat mér le, ami mondjuk engem is érdekel, nem pedig tucatteszteket készít "copy paste" módra), mint egy "szaksajtósnak", aki lehet már unja a banánt és felületesen méricskél rutinból, no meg olyan semmitmondó méréseket csinál, mint néha itt a PHn...![;]](//cdn.rios.hu/dl/s/v1.gif)

Lásd Kaby Lake diszkrét GPU teszt.

-

AMD vs. Nvidia: All Current Gen GPUs Benchmarked [16 New Games]

Tessék lehet csámcsogni.

(Egy kevésbé mélyenszántó teszt persze, de végre elkészültek vele.

)

) -

Hát szerintem ehhez azért CPU is kell, mert ezek a framerate tartományok, tipikusan úgy csalhatóak elő az újabb játékokban, hogy lentebb kell venned a grafikát és CPU limitesebb lesz az egész, vagy legalábbis arra felé tolja a terhelést. Régebbi játékokban meg azért, mert ugye a GPU lazán viszi, ezért megintcsak a CPU is jobban számít.

Már ha a 120-144+ kell.De tény, hogy GPU is combos kell (sokkal jobban, mint CPU ez igaz), főleg ha ultra-n akar ilyen framrate mellett játszani az ember.

-

-

válasz

Raggie

#25138

üzenetére

Raggie

#25138

üzenetére

Ezt tom elég bénán csinálja, eleve nem lehet i5 felett minden high end...

Ez meg a PC gamer... itt 6600K még a best, vagy mainstream ajánlás... de a high end már a 6800K.

Érdemes e GPU ajánlást is megnézni... [link]

És ez játékosoknak szól, egy alapvetően játékos oldalon.

De még tudnék 2-3 hasonlót linkelni...

-

válasz

Raggie

#25129

üzenetére

Raggie

#25129

üzenetére

A processzor fronton még nem egyértelmű, de mondom, ha olvasgatod rendszeresen a nyugati hw sajtót, érezhető hogy tavaly ezen a téren változás volt. Ahogy jöttek a CPU igényesebb játékok, eltolodott a legtöbb guide is az i7 felé... és ma már ezt tekintik mainstreamnek... néha még van 1-2 hely ahol az 6600K, de sok helyen már 6700K a standard "gamer PC".

A GPU fronton viszont egyértelmű, hogy a 1070 mainstream... szinte az összes ünnepi gépajánlóban ez volt a standard gamer PC. Egyszerűen ez a legjobb vétel.

Mégegyszer mondom én nem a magyar valóságból indulok ki, hanem azokról a piacokról ahova ezeket a termékeket és kategóriákat szánják.

Mellesleg 2017-ben, szerintem már egyértelműen a CPU fronton is megtörténik az eltolódás véglegesen.

Azon meg kár keseregni, hogy de hát régen ez vagy az a "kategória" csak ennyibe meg annyiba került... tudomásul kell venni, hogy ezen a piacon most elég komoly infláció van... évről évre drágább minden hardver. Egyre drágább hobbi... nálunk meg a valuta változások miatt hatványozottan.

Pár évvel ezelőtt kint nyugaton is más árszint volt egy közepes/átlagos gamer PC, mint most. Változnak az idők... aztán vagy alkalmazkodsz vagy megszöksz ugye, és feladod ezt a hobbit. -

-

válasz

keIdor

#25128

üzenetére

keIdor

#25128

üzenetére

Nem váltott semmit, csak nincs konkurencia ami letörje az árakat.

Ez nem stratégia, hanem csak a helyzet kihasználása (legalábbis én nem nemvezném stratégiának)... ezt eljátszották a 600-700 széria körül is, csak akkor még jött a 290/290X válasz rá, így kénytelenek voltak visszacsökkenteni az árakat...

Most sajnos nem jött válasz.

-

válasz

Raggie

#25112

üzenetére

Raggie

#25112

üzenetére

Ha nem is közép... kinek mi ugye.

De tőlunk nyugatabbra, "mainstream" kategória... csakúgy mint az i7, ma már.

Ami annyit tesz, hogy average joe bemegy és megveszi a gamer pc-jébe/-vel. Tehát tök átlagos/normális dolog.

Semmi képp sem csúcs vagy valami durva drága átlagon felüli dolog.Az i5 meg az ilyen GTX 1060/RX480-ak az ma már inkább csak amolyan "budget" kategória.

Ha szűkös a pénz, vagy számít minden garas, akkor az ajánlott.Érdemes felütni a nyugati sajtó 2016 év végi hw ajánlóit.

Aztán mindenki eldöntheti hogy a nyugati színvonalat tekinti mérvadónak, vagy a saját csóró hazai definícióit használja (ami nem lesz igaz csak helyben, nyilván).

Ez van

-

válasz

->Raizen<-

#25082

üzenetére

->Raizen<-

#25082

üzenetére

Majd egyszer előveszed a Dishonored 2-őt és megtudod, hogy mégse...

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

No de nem azt kell nézni mi volt a múltba, hanem hogy milyen lehetőségek vannak a jövőben. Kit érdekel eddig mi volt, ami eddig volt nem működik. Változtatni kell...

A két, két és fél év pedig... hát nem. Ennél sokkal gyorsabban meg lehet ezt oldani, 1 éven belül vagy kevesebb. Sosem ezért várunk, hanem vagy a logikai design kér időt, vagy pedig a gyártástech nincs kész.

A kettő között már gyorsan megy a dolog, ha minden kész van (csak pénz és erőforrások kérdése inkább). Számos példa van rá, már évek óta, ha kell éven belül lehet hozni új termékeket.Persze igen attól is függ az idő mit és milyen formában veszel.

-

Miért kéne egy generációval régebbit licencelni?

Az RTG csak az NV-vel vesenyezne igazából... a többiek meg eldönhetik kell e nekik RTG GPU vagy nem.

Nem mellesleg, ki garantálja hogy verné?

Lásd Apple többet kihozott az ARM-ból, mint bárki más...

Most, ha netán az lenne, amit pletykálnak, hogy intel vesz RTG IP-t, neadjisten komplett GPU-t, és sokkal jobban tudja implementálni, vagy gyártástech miatt jobb lesz, mint az AMD, akkor máris bukik az elméleted.

Őszintén amióta bejelentették hogy RTG és külön válnak amennyre csak lehet én ezt várom és a legesleglogikusabb lépés lenne...

Ettől független ugyanúgy benne van, hogy marad minden mint most... azis lehet még a Zen sikerére/bukására várnak... ha siker marad így, ha bukás, akkor meg a tényleges szétválás nehogy magával rántsa az RTG-t az AMD vergődése. -

válasz

tailor74

#24853

üzenetére

tailor74

#24853

üzenetére

Pedig bajban lévő cégeknél elég gyakori, hogy eladják a jobban menő részeiket, ami még ér valamit.

Amugy az RTG simán átállhat akár amolyan ARM vagy Imagination modellre, hogy IP-t ad és GPU-kat tervez, akinek kell az meg megveszi és beleépíti a saját chipjeibe.

Intel, AMD, Microsoft, Sony... stb. -

-

A Geforce 200 rossz helyen van...

Akkor jelent meg a GTX 260/275/280/285/295 család. Az előtte sikeres 8800/9800 szériát váltotta.

A 260 275 285 tényleg jó cucc volt...

És a végén jött az AMD 5000 széria, ami nagyon jól sikerült, azzal jöttek vissza fel.

Csak sajnos nem tartott ki elég sokáig, meg ugye akkor volt egy időszak amikor gyártással volt valami probléma vagy nem tudom mi (már nem emlékszem pontosan) és alig lehetett beszerezni a kártyákat... szerintem a második visszaesés amitt van ott 2010 elejétől az ez... illetve lehet volt ott egy agresszív NV árcsökkentés is lehet, az AMD meg drágán adta az 5800 szériát. -

-

Vagy kevesebben férnek oda az egyre kisebb fazékhoz lakomázni.

(#24402) gyiku

Az a HD2000 akkora fail volt, hogy utána már sose tudták kiheverni...

No meg kb onnantól jött be ez az integráljuk a CPU mellé, a computing fontosabb, mint a grafika vonal is.

Emlékszem akkor is ment a nagy csodavárás, hogy majd a Shader így meg úgy... meg gyorsabban ugrottak is DX10.1-re a 3870-el... meg is kajáltam akkor, hogy majd jó lesz, persze aztán semmi nem lett belőle és a Geforce 8/9 szarrá verte "butábban" ugyanígy, mint most a Maxwell/Pascal.

Aztán meg a Maxwell lett túl jó, az volt a másik szög. (Pontosabban az hogy az AMD a HBM-el túl sokat tökölt és nem fejlesztett addig semmit sem a termékportfolión.)

NV-nél ugye az egyetlen nagy fail az Geforce 5 / 5xxx széria volt, az látszik is...

A 480 fiaskó után elég gyorsan jött ahhoz az 580, hogy ne legyen nagy visszaesés. Emlékszem az volt az egyik legrövidedd életciklusú termékük (kevesebb, mint 1 éven belül lecserélték)... vagy fordítva sose hoztak még ki olyan gyorsan új terméket. Persze a gyártástech akkor még elég gyorsan fejlődött ehhez. -

-

-

válasz

Malibutomi

#24377

üzenetére

Malibutomi

#24377

üzenetére

Akkor sem összehasonlítható a két szám vagy arány, akárhogy csűröd csavarod.

Persze azok is hibáztak, akik a Steam-ből vezettek le bármiféle eladási jóslatot... nem mondom hogy ők helyesen tették, félreértés ne essék.

Ráadásul nem csak ezeket a kártyákat adták el... szóval nem tudod hogy a 30% market share-en belül mennyi volt a 480 vagy a Fury vagy 390 pl... vagy valami alacsonyabb kategóriájú, mert nincs tételesítve.

Szóval továbbra sem jó.

Ráadásul a GTX már jóval régebb óta fut...

Steam-en egyébként a Vulcan felmérés szekció talán a leghasználhatóbb.

-

válasz

Malibutomi

#24366

üzenetére

Malibutomi

#24366

üzenetére

Az ne is zavarjon ám, hogy a kettő nem ugyanaz.... az egyik egy adott időszakban eladott összeladásszám %-a, a másik meg egy meglévő aktív összesítés egy amolyan "összeladássaal" a kezdetektől. Ilymódon nem összehasonlítható a kettő "piaci részesedés".

Tehát pl egy Őszi (szept-nov) időszakban eladott kártyaszám nem egyenlő a forgalmazás kezdetétől eladottal (amit a Steam mutat).

A Steam amugy játékosbázis felmérésre sokkal jobb, a másik meg tőzsde és gazdasági szempontból fontosabb mutató (NV sokadrangúan leszarja, hogy összesen hány aktív NV kártya van a globális PC használók között, valahol a sor végén van a prioritásokban.)

-

-

Dübörög a Samsung 10nm node... vajh jön e jövőre egy Pascal refresh 10nm-en?

![;]](//cdn.rios.hu/dl/s/v1.gif)

És az NV ezt tesztelte e a korábbi pletykák után?Lesz e 10nm-es Vega... lehet kihagyják a 14-et ezért a csúszás?

Elvileg a GF simán megveheti újra a 10nm licencet. Vagy AMD is mehet akár a Samuhoz.

Végre talán az intel is kap egy kis gyártástech konkurenciát.

-

-

-

-

-

-

-

-

válasz

Locutus

#22201

üzenetére

Locutus

#22201

üzenetére

Nem lesz még jövő tavaszig, ha jól emlékszek évente egyszer szokta a Steam frissíteni a hardverleíró adatbázisát az új nevekkel, addig meg az "other" alatt lesznek az új idei kártyák.

(#22213) Szaby59

Hmm... tényleg, akkor változtattak rajta. Régen nagyon sokáig nem látszott a 980Ti meg az R3xx széria sem.

Pedig nem kevés volt, és aztán jött egy éves frissítés az egészre és utána megjelentek külön.(#22214) Habugi

Jah a DirectX listában benne vannak.

-

-

Csak az investor slide lesz ez...

Abban van "hivatalosan" hogy ugye a VEGA csúcs 1H 2017... aztán vagy nem jön addig tényleg semmi, vagy jön.

Mondjuk szerintem idén már nem jön AMD kártya. Arról már lenne sokkal több info, ha jönne.

Ez van...

-

Így van... AMD oldalon nem CPU kell, hanem Async Compute, hogy kihajcsa...

Különben marad benne jó sok...

(#22146) Keldor papa

Azért várjuk meg a végleges kódot, de jelenleg nem is az a baj amit írsz, hanem az hogy lassabb mindenen a BF1 DX12.

Ez azért elég blama lenne ha így maradna.És ha csak az AMD gyorsul majd, azis blama lesz...

Na de várjuk ki a végét... október végéig még kalapálhatják.

Ha valami olyasmit elérünk hogy DX11 ~ DX12 sebesség kb azonos mindenen, esetleg utóbbi hozza az átlag/minimum fps-t gyengébb CPU mellett is, akkor azt mondom jó munkát végeztek. Ezen felül, ha van + az AMD oldalán a shader intrinsic miatt, az meg okés lesz, elfogadom (sőt, ha nincs, akkor az megintcsak blama).

De ettől még nagyon messze van a mostani kód.

-

válasz

Locutus

#22142

üzenetére

Locutus

#22142

üzenetére

Nem néztem meg igazán, de a képek alapján 50% res scale nézték + ultra + a többi alap... de a 980 az reális értékeket mutat, nálam annyin mozog kb ami ott van.

Lehet te máshol nézed, nem a legrosszabb szituban.

Amugy nem kapcsoltál ki valamit máshol, vagy a control panelben mást "erőltetsz" a játékra?

-

válasz

gainwardgs

#22114

üzenetére

gainwardgs

#22114

üzenetére

Lesz még munka ezzel a DX12 kóddal.

-

válasz

mlinus

#21699

üzenetére

mlinus

#21699

üzenetére

Utóbbi időben túl sok effekt "homályosítja" a képet... szerintem ezért látod így.

Nem is feltétlen szebb, csak valószínűleg tisztább élesebb a kép.... vagy hogy mondjam.

Ez részben a konzol/TV miatt is van, mert ott ezek jobban mutatnak a nagy képen. Monitoron meg nem.Nagyon sok játéknál az AA-t én pont ezek miatt kapcsolom ki, mert az pl hasonló homályosítást végez gyakran, akkor már inkább a zizi meg az a minimál rece ami van.

-

Addigra lehet lesz Deus Ex implant... ki tudja lehet AMD GPU-val.

(#21694) gbors

Akkor biztos én értem félre a "kvázi láthatatlan" szöveged... mindegy. Most sem értünk egyet. Nem új.

Nem is kell, te tudod mit akarsz. No meg végülis szubjektív valóban ki mit lát.

Elromlott az értemező rendszerem, mint mindig.

Igazából akkor nem azt kellet volna írni hogy nem azért veszel 460-at mert Deus Ex mediumra felesleges, hanem nem akarsz többet költeni. Máris érthetőbb a szitu-álláspontod.

-

Én azért látom a különbségeket mediumnál már.

Mellesleg akkor a mostani vas is elég nem?

Minek új?

Meg van más játék is azért...

Mellesleg azért a perf/price görbe nem csak felfelé romlik, hanem lefelé is... szerintem nem érdemes alsóházba invesztálni gamer géppel.

Hacsak nem vagy zsíroskenyéren élő csóródiák... ami meg nem vagy azt hiszem.

-

-

-

válasz

Firestormhun

#21647

üzenetére

Firestormhun

#21647

üzenetére

Más, mert kikapcsoltak dolgokat...

-

-

válasz

#85552128

#21505

üzenetére

#85552128

#21505

üzenetére

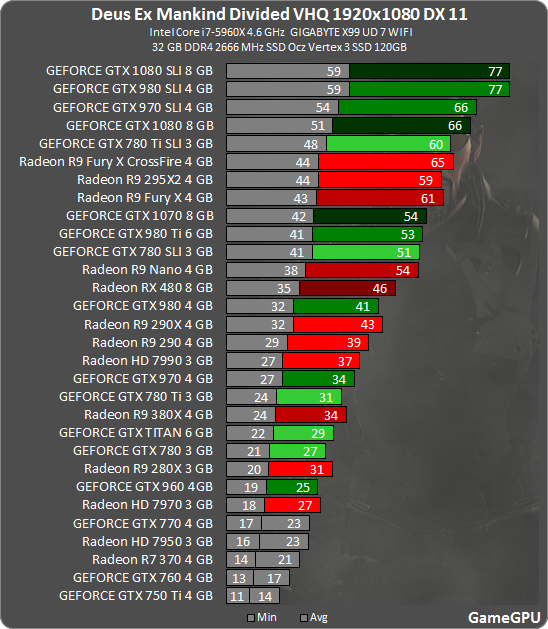

Hát a DX12 nehéz dió... de nem csak nekik... láttál te bárhol eddig normális DX12 játékot?

Amugy a DX11 az nem rossz, ez kb egy reális sebesség a TR után, figyelembe véve hogy a DeXM elvileg sokkal jobb grafikával rendelkezik.

Ahhoz képest ez a mértékű lassulás a kettő között nem nagy.

vs

-

-

-

-

-

válasz

MiklosSaS

#21418

üzenetére

MiklosSaS

#21418

üzenetére

Legalább lesz nekünk valaki aki teszteli... remélem gyiku is vesz egyet. Jól jön majd a minél több tapasztalat.

Énis gondolkodom rajta... (komolyan).

De addig nem váltok amíg nincs róla tiszta kép.

NV-nél most ezt a kört kihagyom, megvárom az optimalizált 16 nanos kártyáikat, ha az a Volta lesz, akkor azt.

De a 490X még lehet jó is.

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

-

-

A szerecsenmosdatás innentől nem érdekel... majd next time erre is figyelnek.

Nyilván senki nem mondta hogy emiatt nem lehet használni megelégedéssel a kártyákat... itt a PH-n is amugyis sokan szénné húznak mindent, ami már önmagában kilép a szabványokból meg a specifikációkból gyakran.

Csak annyi hogy egy referencia kártyánál, ez ciki... minimum. Helyes is hogy vannak következményei.

Meg hogy vannak partnerek akik kimondottan ezzel reklámozzák a termékük, hogy "nézd mi tudunk VRM-et tervezni jól is, szabványokra figyelve", jobb a PCB-nk.

-

Ja igen, csak úgy rémlik hogy így meg a 6PIN-t terhelik szabványon felül... cseberből vederbe.

"You have to wonder why this wasn’t the direction taken by AMD engineers initially. As you will find in our results, the 6-pin connection is definitely drawing more than the 75 watts that it is rated at, but the 6-pin cabling and connectors are actually rated at 8-9A per pin, rather than 5.5A total for the PEG slot. If you are going to draw more power than rated over one of the two options, it’s clear that the over engineered and directly fed 6-pin connection is the way to go. I can only assume it was an oversight on the board team that allowed it to happen. (Also, let’s not forget that using an 8-pin connection and weighting it towards that would have prevented both issues.)"

Amugy igen, érdekes lehet hogy hogy ment át a certifikáción... de az még érdekesebb hogy hogy lehetett ilyet eleve tervezni...

-

-

válasz

killer095

#21286

üzenetére

killer095

#21286

üzenetére

Hát fölösleges is... racionalitás szintjén, de erről most ne nyissunk itt vitát.

Semmiképp sem a specifikációk nem betartása elleni védekezés a cél egy alaplapvásárlásnál... mellesleg az sem lepne meg ha ugyanakkora eséllyel szállna el ezeken is a PCIE busz. Sok a parasztvakítás ezeken a lapokon. Egyetlen valódi előny a masszívabb VRM, az meg vagy kell vagy nem. Meg esetleg egy két plussz szolgáltatás/képesség (több usb, wifi, hang, stb) bár ezeket meg meg lehet olcsóbban is oldani.

-

-

válasz

killer095

#21276

üzenetére

killer095

#21276

üzenetére

Hát, én inkább úgy nevezném, hogy szoftveresen "megkerülték/korlátozták" a problémát (jobb híján), de ez egy "szimpla" fizikai PCB-áramköri kialakítási hiba... nem javítható valójában csak újratervezéssel, de hogy 1 év alatt senkinek nem tűnt fel, szvsz gáz.

Vagy a rosszabbik eset hogy feltűnt, csak pl későn és inkább megpróbálták szőnyeg alá söpörni, csak mégis kiderült...

-

-

Noh... már a végén EU vs nem EU topik lesz ebből...

![;]](//cdn.rios.hu/dl/s/v1.gif)

Engem sokkal jobban érdekel hogy eljön e az olcsó, mégkissebb, méggyorsabb NV kánaán, és tényleg jön a sok sok 14nm samsung NV chip hogy még jobban eldádázza az AMD-t a piacon.

Esetleg nem é Samsung gyártja majd a Volta-t + Samsung HBM2 tesznek rájuk jövőre, ez meg csak egy teszt erre felkészülve... fincsi lesz.

-

-

-

-

-

-

válasz

Malibutomi

#20310

üzenetére

Malibutomi

#20310

üzenetére

Ó ki van ez találva...

+100mm2-t még simán fel tudnak használni (annyival kisebbek a mostaniak pl az előzőeknél).

Az pont elég arra hogy kicsit tovább csiszolgatva kihozzanak megint +25-50%-ot.

-

Engem még nem győztél meg... megvárom a teszteket... már ha valaki rászánja majd magát... (meg ha egyáltalán van rá mód kimérni).

A legutóbbi patch note-ban benne van:

"Adds utilization of DirectX 12 Asynchronous Compute, on AMD GCN 1.1 GPUs and NVIDIA Pascal-based GPUs, for improved GPU performance. "

(Ettől független lehet semmit nem ér...

)

) -

Szerintem a Maxwell már le van kakilva mostantól magasról...

(Aka Kelpler és Fermi is előtte).A Pascal meg ettől már nem szenved igazán... (elvileg).

Pascalra engedélyezve is van már a legtöbb async játékban ez a feature, hozza is azt a +5-10%-ot ami ettől általában várható.Mondjuk a TR-ről egy deka teszt sincs még a neten erről sajnos.

-

válasz

killer095

#20043

üzenetére

killer095

#20043

üzenetére

De ott sem a Vulkan segített sokat, már ha jól értem mit csináltak, hanem az hogy engedtek spéci AMD "gépi kódot" futtatni a szabványon kívül.

Ezt meg lehet csinálni ugye DX11 és DX12 alatt (mellett is), semmi köze az API-khoz... lásd ugye a GPUOpen: Shader Intrinsic Functions-t.Ez kb azonos azzal, mikor ASM gépi kódot futtatsz és programozol egy CPU-ra, mondjuk a magasabb szintű C++ -ba ágyazva.

Ez számomra amugy kb a 3DFx Glide időket idézi... ami ha belegondolunk nem olyan jó irány. De erről már Abu is beszélt.

-

válasz

Petykemano

#20038

üzenetére

Petykemano

#20038

üzenetére

Mármint a bonyulultabb, de rugalmasabb megoldás és ezáltal a kevésbé magas órajel pl?

Á, ez sokkal régebbi dolog... ez a GPGPU irány miatt van AMD oldalon (és amiért anno felvásárolták az ATI-t), meg a heterogén CPU+GPU (APU) integrálás miatt, ami még mindig nem jött el igazán PC fronton (a piaci felosztás/gyártók helyzete miatt), bár a mostani konzolok nagyon közel vannak már, csak ugye az egy elég spéci területre (játék) van jelenleg használva. PC-n ugye ennél egy sokkal szerteágazóbb hasznosításra lenne lehetőség. De meg kell várni sajnos amíg az intel is eljut arra a szintre... az meg nagyon lassan és nyögvenyelősen megy.

Ez az irány megkövetelte az összes dolgot amit beleraktak a hardverbe (preempció, dinamikus erőforrás kiosztás, stb stb), ez gyakorlatilag egy "központi processzor" is kéne egyben legyen... cserébe sajnos azzal járt hogy grafikára már nem annyira hatékony az egész, ezért marad benne (relative) sok/több kihasználatlan képesség és erőforrás. És valószínűleg van pár dolog amit kénytelenek leemulálni is, ezért a driver sem mindegy mit csinál, illetve nem tud olyan hatékony lenni, mint a másik oldalon.

+ az utóbbi években már az AMD "filózófia" szintjén mindigis alultervezte a kimondottan grafikus végrehajtásra való részeket, a compute általános részeket meg felül. Ezért kicsit mindig aránytalan (és kihasználatlan) volt eddig ez a része.A VR és a DX12/Vulkan/Mantle dolog, az már csak egy amolyan "végterméke", ennek az iránynak, félig meddig kényszerből is... ami mellesleg jókor is jött az AMD-nek (nyilván az API-s dolgot meg ők "kényszerítették" ki).

NV meg ugye egy sokkal inkább célhardvert csinált, erős a grafikában, arra van kihegyezve az egész, és az "általános" compute/GPGPU jellegzetességeket sokkal lassabban (szándékosan?) teszi bele. Ezáltal egy jóval egyszerűbb és spórolósabb/hatékonyabb GPU-t tudott a játékospiacra hozni, főleg a Maxwellel, amin szinte alig változtattak (egy két nagyon kötelező dolgot leszámítva, lásd preempció, dinamikus erőforrás kiosztás) a Pascalban.

-

válasz

olymind1

#20030

üzenetére

olymind1

#20030

üzenetére

Bonyolultabb belső felépítés és logikai áramkörök (cserébe rugalmasabb és "többre képes"), plussz jóval kevesebb energiát fektettek már az áramkör elektromos jellemzőinek optimalizálására, összehangolására (kevesebb pénz, idő, erőforrás fordítható erre). Kb ezek lehetnek a fő okok.

Persze lehet a TSMC is jobb minőséget gyárt még/most, mint a GloFo.Az NV elmondta hogy nem kevés energiát fektettek abba hogy a belső jelterjedés, elektromos tulajdonságok, zaj minél jobb paraméterekkel rendelkezzen.

-

-

Nem akarok evidens DX pr szöveget bemásolni ide, mert feleslegesnek érzem. Mellesleg a dx12 mióta hardver közeli?

Lehet hogy közelebb van, de messze nem hardver közeli.

De mondok kettő dolgot, memória menedzsment pl, és mondjuk a feladatok kiosztásának a rugalmassága, meg a multi engine. Stb.

-

válasz

Petykemano

#19952

üzenetére

Petykemano

#19952

üzenetére

Na hát ez az, hogy miért optimalizálnál a mára, ha neked gondolni kell a jövőre is... Mi van ha következő GPUk tök máshogy fognak működni? A szabványosság/"semlegesség" pont azért jó, mert biztosítja azt hogy a programod mindenen futni fog.

Egy konzolnál ez nem probléma, mert a szoftvert kukázod a hardverrel együtt.

PCn ez nem működik, így nem jó behozni... Mindenképp kell egy semleges fallback kód minimum, ami tuti mindenen fut.

Egy tesztnek ezt kell elsősorban bemutatni, hogy egy ilyen kódból mit lehet kihozni.

Ezt ki lehetne egészíteni igen, gyártóspecifikus ezzel azzal, de akkor viszont az már mást mutat és másról szól.

Pont ezért mondom hogy lesznek akiknek lesz erre ideje meg pénze, meg lesznek kiknek nem.

De ha mondjuk te egy Frostbite engine-t terveznél, amire több éves fejlesztéssel, az összes játékodat alapozod mint mondjuk az EA, akkor te behoznád a fenti rizikót egy kis sebesség reményében, vagy a semleges szabvány kódra alapoznád a motor fő komponenseit?

Persze emellett, ha van rá módod, időd meg pénzed, akkor beteheted a nem szabvány optimalizált utad is, de abba benne van hogy kihal és bizonyos szinten felesleges lesz, lásd mondjuk szintén a Frostbite esetén a Mantle... -

Ennyire nem alacsony... Ahhoz. Nem gépi kód ez még... Le vannak ugyanúgy fektetve a szabványba a szabályok.

Szerintem ez elég egyértelmű hogy semmi DX11 kötöttség nincs itt.

Csináltak egy tesztet amivel össze lehet hasonlítani bármilyen DX12 támogatott hardvert, akármilyen is.

Ha AMD meg NV meg Intel... Stb specifikus teszet akarsz, akkor lehet csinálni olyat is, de akkor csak AMD, NV meg Intel kártyákat lehet velük tesztelni... Pl GCN 1 2 3 stb generációkat egymással, hogy az AMD spéci kódot melyik mennyivel gyosabban futtatja.

Nekem nem rémlik, hogy pl CPU fronton olyan rengeteg AMD vagy Intel specifikus X86 kód lenne, pedig lehetne biztos olyan kódokkal tesztelni ami fekszik egyiknek vagy másiknak jobban.

-

-

válasz

Petykemano

#19935

üzenetére

Petykemano

#19935

üzenetére

Nem tudom olvastad e mit írt a Future Mark... vagy láttad e ezt: [link]

Alapvetően a hardver szállítók, a Microsoft és a játékkészítők visszajelzései szerint csináltak egy ésszerű szétosztást a 3D/Grafikai/Direct queue és a Compute, Copy queue között megjósolva egy átlagos jövőbeni PC játékmotor viselkedését... (ahogy DX11 alatt is ez történt anno, ezért többé kevésbé leképezi ott is az erősorrendet és a játékmotor képességeket a Firestrike.)

Nyilván most is és a DX11 alatt is vannak és lesznek ettől jóval eltérő terheléstípust generáló játékmotorok, de átagosan jól szimulálja a "jövőt".A grafikus és egyéb munka is esszerint van szétosztva a queue-k között a Time Spy alatt. Nincs ezzel semmi baj szerintem. És biztos vagyok benne hogy nem úgy nyerhető a legtöbb ki ahogy Abu írta (hogy minden grafika egy queue, és némi egyéb compute mellé)... főleg hogy a compute (akár grafikai effekt, akár más), egyre dominánsabb, tehát ha az összes (akármilyen) feladat van jól szétosztva az optimálisabb lehet.

Azt már a driver és a hardver dönti el, hogy ezeket a queue-kat milyen sorrendben és hogyan dolgozza fel. Ha tud teljesen dinamikusan, akkor úgy, ha csak preemptiven (ahogy az NV megoldását tippelik), akkor úgy... ha meg sehogy (Maxwell), akkor szép sorban. De ez már nem a játék/program feladata, ő beteszi a queue-kba a feladatokat és átadja a driver/hardver részére.

A malmozó részegységek mennyisége ami rendelkezésre áll meg relativ... ha sok pl a grafikai számítás, akkor kevés lesz gyártótól függetlenül. Az AMD azért tud (részben) annyit gyorsulni, mert eddig nem tudta munkára bírni az összes feldolgozóját sok esetben... tehát vannak ilyen üresen járó részek, az angol ugye "bubble"/buboréknak hívja. Az NV meg jóval kevesebb feldolgozót és máshogy használva tervezte a GPU-t, ezért ki tudta hozni belőle jobban a maxot, ezért nem gyorsul annyit, mert nincs annyi felesleges végrehajtó.

De látható pl a DOOM Vulkan alatt is, hogy az NV is tud ettől még gyorsulni, ha jól van megcsinálva az egész.

-

Abu néztétek már az új async TR patch mennyit javít GCN 1.1+ / Pascal GPU-kkal?

-

Új hozzászólás Aktív témák

Hirdetés

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- Honor X7B szép állapotban 6/128GB fekete / 12 hónap jótállással!

- AKCIÓ! HP Victus 16-R1002NF Gamer notebook - i7 14700HX 16GB RAM 1TB SSD RTX 4070 8GB WIN11

- Bomba ár! Dell Latitude 7320 - i5-11GEN I 8GB I 512SSD I HDMI I 13,3" FHD I Cam I W11 I Garancia!

- Apple Macbook Pro 13 2020 - M1 - 8GB/256GB SSD - Touch Bar - 102 Ciklus - 99% Akku - Ezüst - MAGYAR

- NJOY Aster 3K 3000VA/2700W Rack Szünetmentes Táp

Állásajánlatok

Cég: CAMERA-PRO Hungary Kft

Város: Budapest

Cég: Promenade Publishing House Kft.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)