- Milyen okostelefont vegyek?

- iPhone topik

- Motorola Edge 30 Neo - wake up, Jr...

- Samsung Galaxy S9 és S9+ duplateszt

- Redmi Note 13 Pro 5G - nem százas, kétszázas!

- MIUI / HyperOS topik

- Honor Magic6 Pro - kör közepén számok

- Samsung Galaxy S23 és S23+ - ami belül van, az számít igazán

- Poco X3 Pro - hardverfrissítés

- Samsung Galaxy Z Fold5 - toldozás-foldozás

Hirdetés

-

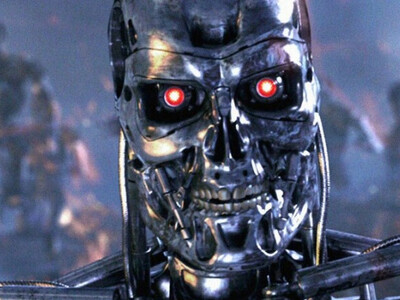

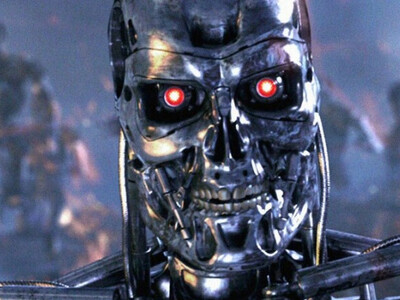

Újabb részleteket kaptunk a Terminator: Survivors című játékról

gp A játékot egyedül, vagy társakkal együtt is játszhatjuk majd elsőként PC-n, később majd konzolokon.

-

Sokat fogyaszt az AI, egyre több az adatközpont, kell az atomenergia

it Az AI-t kiszolgáló adatközpontok olyan nagy energiaigénnyel bírnak, hogy egyre több atomenergiára van szükség.

-

Megbírságolták a Razert a Zephyr maszkok miatt

ph A cég elég olcsón megússza az ügyfelei félrevezetését, de az üdvözlendő, hogy az Egyesült Államok hatóságai nem siklottak el az ügy felett.

-

Mobilarena

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

Alogonomus

őstag

Igen, lényegében ugyanazt tudják UE 5 RT esetén.

Egálra jött fel az AMD, ami komoly változás ahhoz képest, hogy a korábbi játékmotorok esetén az Nvidia kártyák állva hagyják az AMD kártyákat, ha komoly mértékű az RT alkalmazása. Az Nvidia kártyák felárát is ezzel indokolták eddig, és ez az indok üresedett ki kvázi az új játékmotorok megjelenésével.[ Szerkesztve ]

-

válasz

Alogonomus

#60497

üzenetére

Alogonomus

#60497

üzenetére

Az nem az Unreal 5 esetén hanem egy játék esetén...próbáld értelmezni hogy ez nem egy komplett motornak szól hanem egy-egy játéknak.

Nem ugyan azt tudja RT esetén hanem egy játékban.

A cégek eldöntik melyikre optimalizálnak. Az Epyc együtt működik az Nvidiával és AMD-vel Intellel. folyamatosak a bejentések.

Nem az van hogy most az AMD re írnak egy motort hanem PC-n az Nvidia meghatározó ezért fontos nekik hogy az Nvidia kártyákon ne legyen grafikai motorból eredő hátrány.

Unreal ráadásul fontos szerepet tölt be vizualizációban és a CUDA meghatározó szegmens... nem a játék csak a fő szempont az Epycnél...

Egy egy stúdió dönthet úgy hogy egy adott architektúrának kedvez vagy beépít olyan eljárásokat ami egy gyártónak jó de ez egyéni döntés és optimalizációs eljárás nem egy komplett grafikai dizájn és motor...

csak hogy lásd miről beszélek [link] ez a Fortnite Unreal 5 frissítése ahol a 4080 gyorsabb minta 7900XTX nincs semmi előny..[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Mit nevezünk next-gennek? Mert amúgy nem tud kevesebbet az IW9, mint a többi aktuális motor.

#60504 b. : Nem épít be nagyon gyártóspecifikus eljárásokat az Epic. Az UE5 esetében arról van csak szó, hogy magát a motort AMD hardveren tervezték. Egyszerűen tanultak abból a problémából, ami az UE4 kapcsán előjött, hogy voltak teljesítménygondok, majd amikor elkezdték Radeonon tesztelni a rendszert, akkor hirtelen láthatóvá tette a nyomkövető a bugokat, amiket a korábbi teljesítményszámlálós profilozók nem is mutattak. Emiatt hasznosabb alapjaiban Radeonon tervezni manapság a motorokat, mert az alapvetően általános teljesítményproblémák okát több nagyságrenddel egyszerűbb megtalálni. Ez nem az NV ellen megy, ők is előnyt szereznek abból, hogy az AMD fejlesztőeszközeivel meg lehet keresni a motor rejtettebb bugjait.

Eleinte egyébként ez vezethet oda, hogy a kezdeti kód jobban megy Radeonon, mert nyilván nem mindegy, hogy egy évet optimalizáltak valamire, vagy csak egy-két hónapot. De ez idővel kiegyenlítődik, ahogy a többi rendszerbe is belerakják az időt.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Igen, ezt írtam én is hogy nem köteleződnek el motor fejlesztés szintjén.

Nem megy jobban kezdeti időkben sem, ez egyértelműen látszik hogy nincs Unreal 5 ben semmiféle előny abból adódóan hogy az Unreal 5.1.( vannak Lumen és Raytracing tesztek, én is belinkeltem a múltkor már ezekből) Fortnite is mutatja hogy egyszerűen az az érdekük hogy minél szélesebb hardverréteget lefedjenek az Epycnél, de Unity 5 is érdekes lesz az mondjuk ha a Demok szerint mutatott az Nvidia előny megmarad.

Majd gondolom lesznek specifikus stúdiók által alkalmazott kiegészítések amik elbillenhetnek erre vagy arra.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Attól függ csak az előny, hogy miképpen használod a motort. A Radeonok akkor szoktak előnybe kerülni az UE 5-ben, ha sok a rajzolási parancs. De ez valószínűleg nem a motor miatt van így, hanem az AMD-féle D3D12 meghajtó hatékonyságából származik.

A Unity 5 az nem hiszem, hogy érdekes lesz, mert az kb. 7 éves.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

-

Jogos, nem ötöt akartam írni csak az Unreal 5 volt közben bennem .

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

paprobert

senior tag

"Mit nevezünk next-gennek?"

Én ott húznám meg a vonalat, hogy az next-gen motor, ami nem tud futni PS4-en és XBO-on.

Az a motor, aminek van 120 fps módja PS5-ön, az nem igazán használja az új CPU-t új dolgokra, gyakorlatilag PS4 szinten van a CPU igénye, csak dupla-tripla sebességgel fut.[ Szerkesztve ]

640 KB mindenre elég. - Steve Jobs

-

Abu85

HÁZIGAZDA

válasz

paprobert

#60510

üzenetére

paprobert

#60510

üzenetére

Bármelyik motor képes futni PS4-en is Xbox One-on. Ez nem egy technikai kérdés, mert maguk a konzolok képességei megfelelnek egy bizonyos technikai színvonalnak, és tök egyszerű leskálázni rá a terhelést. Nem azért nem csinálják meg, mert lehetetlen, hanem azért, mert anyagilag már nem éri meg a régi gépekkel foglalkozni.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Petykemano

veterán

Úgy értettem, hogy talán tényleg korai volt kiadni a Navi31-et,.de muszáj volt. Az, hogy azzal egyidőben a zen4 is árvágást kapott, szerintem arra utal, hogy túl sok volt a kapacitás, amit valahová tenni kellett.

Ugyanakkor nem is kiabálnám el. Mert nem biztos, higy a navi31 javítható. Lehet, hogy ez már az a méret, ami meghaladja az AMD képességeit. Tudjuk, hogy kevésbé tudnak nagy lapkát csinálni.

Másfelől viszont azzal, hogy az RDNA3-e a hibás, vagy a navi31, azzal talán érdemes megvárni a navi33-32-t.Ezzel viszont az a strigula húzható be, hogy a termék piacravitelével (is) követők.

Találgatunk, aztán majd úgyis kiderül..

-

PuMbA

titán

válasz

Petykemano

#60512

üzenetére

Petykemano

#60512

üzenetére

Kérdés, hogy mikor jönnek az alsóbb kategóriás kártyák. Az NVIDIA előtt kell kijönniük, mert akkor több eladáshoz is jutnak.

[ Szerkesztve ]

-

paprobert

senior tag

Egy olyan játék, ami CPU limitesen 30 fps-sel döcög a 7db Zen2 magon, az soha nem fog a Jaguarokon játszhatóan futni. Ami 60-nal megy limitesen, még az sem.

Technikai értelemben egyébként igazad van, egy UE5 is Switch-kompatibilis papíron, 3 poligonnal a képernyőn, vagy fallback módban.

Én motor és játék koncepció szintjén arról a Venn-diagramról beszélek, amikor nincs metszéspont a régi és új konzol között, mert el lett költve valami értelmesre a kraft. "too big for PS4"

Az eredeti kérdéshez visszatérve, a COD alatti játék logikát jelenleg kiszolgálja a last-gen hardver is. Ezért nem next-gen.[ Szerkesztve ]

640 KB mindenre elég. - Steve Jobs

-

Komplikato

veterán

válasz

paprobert

#60515

üzenetére

paprobert

#60515

üzenetére

Limitált GI-vel (Lumen HW RT nélkűl) meg a Nanite rendszerrel szvsz simán lehetne akár PS4-re, akár Steam Deck-re "nextgen" grafikájú szép játékokat fejleszteni. Ahogy persze lehetne akár mobil cuccokra is, csak hát ugye a Switch SoC már akkor öreg volt, mikor bekerült a konzolba. Egy modern telefonon azért tud pár dolgot az UE5, amit a konkurens engine-ek nem.

"Figyelj arra, aki keresi az igazságot és őrizkedj attól, aki hirdeti: megtalálta." - (André Gide)

-

PuMbA

titán

válasz

Komplikato

#60516

üzenetére

Komplikato

#60516

üzenetére

Lumen és a Nanite csak mostani generációs konzolokon van

Az előző generációs konzolok nem elég gyorsak hozzájuk, hiszen PC-n is egy relatív erősebb hardver kell.

Az előző generációs konzolok nem elég gyorsak hozzájuk, hiszen PC-n is egy relatív erősebb hardver kell.[ Szerkesztve ]

-

Komplikato

veterán

"hiszen PC-n is egy relatív erősebb hardver kell."

Ezt nem értem. A nanite lényege pont, hogy kevesebb erőforrást, ramot és vramot eszik. Más tészta, hogy ha betesznek egy pár több millió poligonos tárgyat és az adott konzol GPU-ja nem tudja kiköhögni még nanite formában sem. De most például a Fornite lassulását okozó 300.000 poligonos fái annyira szükségesek voltak vajon?

Lumen és Nanite még a kőkorszaki Polaris GPU-n is mennek. Szóval azt gondolom nanite-al ugyanolyan részletességgel gyorsabb lenne egy PS4 game, vagy a "szokásos" 30fps módban sokkal több geometriai részletességet kaphatna."Figyelj arra, aki keresi az igazságot és őrizkedj attól, aki hirdeti: megtalálta." - (André Gide)

-

Abu85

HÁZIGAZDA

válasz

paprobert

#60515

üzenetére

paprobert

#60515

üzenetére

Miért ne tudna futni? Az egész csak skálázás kérdése. Ami működik PS5-ön, az leskálázható bármikor PS4-re is. Ezt bármelyik motorral meg lehet tenni. Nem technikai limit, amikor nem teszik meg, hanem egy döntés kérdése. A döntés pedig attól függ, hogy akarnak-e erőforrást fektetni bele, hogy futtatható legyen. Ha igen, akkor még az Unreal Engine 5 is menne PS4-en és Xbox One-on.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

T.Peter

őstag

Nem minden skalazhato. CPU-rol es jateklogikarol volt szo. Lehet UE5-tel last gen konzolra jatekot csinalni, de kozeleben nem lesz annak, ami lehetne current gen-en. Ha az a cel, hogy mindegyik platformon ugyanazt kapja a jatekos, akkor a leggyengebb hardver fog limitalni. Nem teheted meg, hogy a gyengebb hardveren majd kevesebb ai, kisebb rombolhatosag, stb lesz, mert akkor az mar nem ugyanaz a jatek.

-

DudeHUN

senior tag

válasz

T.Peter

#60522

üzenetére

T.Peter

#60522

üzenetére

2K is ezért visz két verziót a sport játékaiból. Az NBA széria nextgen motorja normálisan csak a nextgen gépeken megy és PC-re talán(!) idén már nem a prevgen portot kapjuk majd. Ugye sajnos arányaiban kevesen vannak azok akiknek nextgen szintű hardvere lenne PC-n.

Gamer for Life

-

válasz

DudeHUN

#60523

üzenetére

DudeHUN

#60523

üzenetére

A ps5 egy 2080 / 6650 XT szintjétől elmarad jócskán.

Valahol az RTx 2070/Rx6600 köré tenném.

Tehát ha valakinek van egy RT képes első generációs VGA ja már ps5 szinten játszhat.

Kíváncsi leszek ez változik e azokkal a játékokkal /motorokkal amik Ps5 re jönnek kifejezetten prevgen nélkül....[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

PuMbA

titán

PS5-ben 36 CU van, tehát sima RX6700 szint körüli. Memória alrendszer az érdekesebb, mert ugye nincs Infinity Cache, viszont helyette 320GB/s helyett 448GB/s a sávszélessége. Digital Foundry 2060 Super-t használ a konzol vs. hasonló teljesítményű PC összevetéseihez egy Ryzen 3600 mellett.

[ Szerkesztve ]

-

DudeHUN

senior tag

Series S-en is a nextgen motor fut.

Magyarázd meg a 2K-nek. Ők tolják ezért a prevgen verziót még PC-n, mert a potenciális vásárlók jelentős részének nincsen megfelelő vasa. Ne feledd a játék egy 6/12-es mobil Zen (8/16 csak ugye a játék nem használhatja mindet) és NVMe SSD-s gépre lett fejlesztve. Szvsz nem a GPU a szűk keresztmetszet. De majd meglátjuk az első port gépigényén. Remélem idén már ezt a verziót kapja a PC is.[ Szerkesztve ]

Gamer for Life

-

PuMbA

titán

-

Abu85

HÁZIGAZDA

válasz

T.Peter

#60522

üzenetére

T.Peter

#60522

üzenetére

Mert amúgy manapság a next-gen az AI-ról és a rombolhatóságról híres?

A legfőbb előnyt az új gépek ott adják, hogy jobb lehet az assettek minősége, mert gyorsabb a dekódolásuk. De az assettek skálázhatók, és innentől kezdve előállítható az a minőség, ami pont jó a régi gépeknek.

#60521 Busterftw : Ezért kell skálázni a grafikát.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

S_x96x_S

őstag

válasz

T.Peter

#60529

üzenetére

T.Peter

#60529

üzenetére

> Ki sem jottek meg azok a jatekok amik azt veszik figyelembe

> hogy mit lehet elerni az uj hardware-rel.1.)

még pár nap és GDC és várhatóan sok új játék.

March 20-24, 2023; San Francisco, CAÉs az UE 5.2 és sok más is bejelentésre kerül.

- New Tools for Building Photoreal Worlds in Unreal Engine 5.2

"In this tech talk, we'll take a deep dive into some of the powerful new features and updates in Unreal Engine 5.2. Come learn about new tools that empower artists to quickly and efficiently create large worlds; a paradigm-shifting material authoring system that enables users to focus on how a material is composed, assembled, and layered from slabs of matter to achieve visuals not possible before in real time; and the latest additions to Chaos physics for vehicle and fluid simulation—all showcased in a demo you won't want to miss."

- Battle-testing UE5 Next-Gen Systems with Fortnite

- ...see more:

https://www.unrealengine.com/en-US/events/gdc2023> Ne ragadjunk mar le az eddigi szintnel.

inkább "forward compatibility" ...

Ha ma elkezdenek egy fejlesztést, akkor szükség van a "forward compatibility" -re,

mivel ~2-3-4 év is egy játék kifejlesztése.

https://www.unrealengine.com/en-US/nextgen

"With support for Sony PlayStation 5 and Microsoft Xbox Series X, Unreal Engine is ready for next-gen games. Forward compatibility ensures that even if you start in UE4, you can move everything over to UE5 when you are ready.

Unreal Engine 5 is now available in Early Access, supporting next/current-generation consoles, PC, Mac, iOS, and Android."Mottó: "A verseny jó!"

-

T.Peter

őstag

válasz

S_x96x_S

#60531

üzenetére

S_x96x_S

#60531

üzenetére

A forward compatibility mas. Az csak annyi amennyi oda van irva. En arrol irtam hogy nem lehet mindent leskalazni. Szimulaciok, stb. Ha meg bake-eled az osszeset akkor mar nem az a jatek mint ami lehetne a current gen-en, mert megint minden full statikus lenne. Mar irtam, max nem ebben a topikban, hogy legkorabban ev vegen johetnek olyan jatekok amik teljesen UE5-ben lettek felepitve, akkor is ha a kezdeti szakaszt 4-ben kezdtek. A tobbi mind felemas.

A gdc-rol ne varj uj jatekot. Tavaly sem volt semmi amikor az 5.0-t mutattak be. Nem erre van. A demo-t lehet mondjuk kiadjak megint.

A material system a strata materials. Arrol mar tudjuk hogy micsoda. A chaos uj funkcioirol meg nem tudok semmit. -

PuMbA

titán

válasz

Komplikato

#60533

üzenetére

Komplikato

#60533

üzenetére

Ütősen fog kinézni az biztos, mert az összes kézzel odarakott fényforrás kikerül ebben a módban. Teljesen dinamikus és pontos megvilágítást kap minden egy egységesített megvilágítási rendszerben, semmiféle AO és SSR nem lesz

[ Szerkesztve ]

-

HSM

félisten

-

PuMbA

titán

Cyberpunk (és ennek okán a Witcher 3) esetén nem minden fényforrás számolódik RT-vel jelenleg. Ezt onnan lehet tudni, hogy van jó pár fény, ami előtt elhalad például egy NPC és nincs árnyéka. Metro RT esetén pedig csak a GI (Global Illumination) számolódik RT-vel, tehát csak a nap / holdfény. A lokális fények nem.

A Cyberpunk 2077-be belekerül az RTXDI, ami fut AMD-n is és képes fényforrások tízezreit RT-vel számolni, árnyékokkal együtt.

[ Szerkesztve ]

-

-

Komplikato

veterán

Unreal engine alá már van plug-in NVidia oldalról, megnézve egy tesztet kb. 8x gyorsabban számolja a fényeket, tehát ennyivel gyorsabb egyenlőre a valóságban. Ez elég messze van attól, amit pl. A Two Minutes Papers csatornán állították róla, meg a több ezer fényforrástól is. Viszont végre nem is lesz annyira butítva mint amiket a fenti példában írtál. De ez is várom a GDC bemutatón, hátha lesz igazi játékkal demonstrálva.

"Figyelj arra, aki keresi az igazságot és őrizkedj attól, aki hirdeti: megtalálta." - (André Gide)

-

Abu85

HÁZIGAZDA

Mármint az NVIDIA jelenlegi megoldásaival számolódik csak annyi, de ez nem jelenti azt, hogy ne lennének ennél gyorsabb megoldások, amelyekkel jóval több fényforrás kezelhető. Nem érdemes általánosítani az egész iparra az NVIDIA saját eljárásainak limitjeit.

Az, hogy az NVIDIA ezeket a limiteket úgy oldja meg, hogy inkább eltávolodik a GI-tól, és helyette a DI-t erőltetik, még nem feltétlenül jelenti azt, hogy mindenki így tesz. A DI arra jó, hogy jobban skálázható rendszered legyen, de ennek az ára az, hogy kevésbé lesz jó a minősége, illetve sokkal többet kell vele dolgozni, mint a GI-jal. A valós idejű jelenetszintű GI eljárások fő előnye, hogy nagyjából just works jellegűek. Berakod és egy-két nap alatt működik, míg a DI-on heteket-hónapokat kell dolgozni, mire jó eredményt kapsz mindenhol.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

jaj ne kezd ezt ...Nvidiának GI megoldása is van és DI is, nem ez helyett jött, hanem bármelyik felhasználható.

Eddig azt erőltetted hogy minek az RT mikor sokkal gyorsabban meg lehet oldani hasonló minőgében hagyományos raszterizációval és az kit érdekel ha kicsit rosszabb a minősége , pontatlanabb.

Most meg az ellenkezőjét írod ,ha van gyorsabb RT megoldás de gyengébb a minősége akkor az a jobb.( a la AMD) Nem tudom ki veszi ezt komolyan .

A GI az AMD kártyákat fekteti meg a legjobban nem az Nvidiát ebben rejlik pont a legnagyobb különbség.. Véletlenül bejelentette pár hónapja az AMD hogy jön a GI-1.0 ..[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

válasz

Busterftw

#60541

üzenetére

Busterftw

#60541

üzenetére

A Crytek megoldása azért volt gyors, mert nem kötötte egyetlen DXR limit sem. A mai megoldások nagyrészt azért lassúak, mert maga az API rendkívüli mértékben limitál.

#60542 T.Peter : Biztos lesz olyan, aki egyszerre alkalmaz RTXGI-t és RTXDI-t. Mert ugye épphogy az egyikre van erőforrás az API limitjei miatt. Mindkettő együtt biztos hasznos lesz. Amúgy, ha van jó minőségű GI-od, akkor nincs szükséged DI-ra.

#60543 b. : Az AMD GI megoldása teljesen más algoritmust használ, mint bármi eddig. A mai megoldások legnagyobb limitje, hogy vagy gyorsak, de gyenge minőségűek, vagy lassúak, de jó minőségűek. Ezzel küzd mindenki. Az NV is ezért hozta az RTXDI-t, mert egyszerűen az RTXGI eljárásuk nem elég gyors, viszont az RTXDI az gyors, de nem mentes a leakektől, illetve az RTXGI-jal ellentétben pre-processinget igényel. Az AMD inkább azon dolgozott, hogy megőrizze a GI minőségét, miközben a teljesítményét felhozza használható szintre. Így ők egy olyan eljárást hoznak, ami mentes a leakektől, és nem igényel pre-processinget. Tehát a minősége az RTXGI kaliberű, de újszerű cache-mechanizmust alkalmazva a sebessége kétszer-háromszor jobb. Emiatt az AMD nem is gondolkodik DI alternatíván, mert nekik jóval gyorsabb a saját GI algoritmusuk, így számukra nem kell rosszabb minőségű, nehezebben alkalmazható alternatív technika. Nem lenne értelme, mert nem tudnak annyit nyerni vele, mint az NV, ugyanis már eleve sokkal gyorsabb a saját GI-juk. Az NV-nek ez realitás, mert egy RTXGI-nál kb. háromszor gyorsabb RTXDI-ért megéri sokkal többet dolgozni a program oldalán, de az AMD mennyit nyerne vele? +20%-ot? Annyiért nem éri meg több hónapnyi munka, miközben a saját GI-juk elég jó sebességet ad pár napnyi melóval. Senki sem fog +20%-ért hónapokig gürcölni.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Igen mindjárt gondoltam és nem véletlenül írtam amit írtam, hogy az egész felvezetésed erre lett kihegyezve de ez orbitális tévedés amiért sajnálom azokat az itt jelenlévőket akik ezt elhiszik. . nem is kellett volna leírnod. AMD ezzel nem véletlenül lépett erre az útra , hardveres gyengeséget ellensúlyozva. Minél megterhelőbb egy RT annál inkább szükség van erre. jelenleg AMD-t szabványos GI fekteti meg a legjobban. Annál nagyobb az előnye az Nvidianak minél inkább a GI re épít egy játékban lévő RT és pont ezt kerülte eddig AMD az árnyékolásra szorítkozott RT vel és a visszafogott sugárkövetéssel.

Főleg az Ada kártyák ellen egyszerűen AMD elkerüli azt hogy szabvány GI ben kellejen össze ereszteni a két gyártó kártyáit.

De nincs kedvem belemenni sem az egészbe, mert felesleges lenne téged meggyőzni az ellenkezőjéről sem arról mit jelent a vegyes GI és DI felhasználás, még akkor sem hogy eddig pont az ellenkezője mellett törtél pálcát.NO comment felesleges és lerágott csont ez már.[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Az AMD GI eljárása teljesen szabványos, csak DXR-t használ. Abban különbözik az NV RTXGI eljárásától, hogy bevezet egy olyan gyorsítótár-hierarchiát, ami cache-sel bizonyos adatokat, hogy ezek később felhasználhatók legyenek. De maga a sugárkövetés része az ugyanaz, csak nem olyan brute force megoldás, mint az RTXGI, hanem próbálnak belevinni egy kis észt, hogy sokkal gyorsabb legyen. És ez konkrétan mindenen gyorsabb, mert magából a caching algoritmusból szerzi a sebességet. Emiatt az AMD-nek tök felesleges egy DI alternatíva, mert ők már GI-ból hozzák a sebességet, ugyanis nem rossz hatékonyságú brute force alapon dolgozik a technikájuk.

Várható volt, hogy valaki előáll majd valami hasonlóval, mert a brute force sosem volt kifizetődő. Csak idő kell, amíg az ésszel dolgozó megoldásokat kifejlesztik.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Sajnos tévedésben vagy hogy ezt egy egyszerű brute force eljárásá degradálod.

Pár elvakult hívőn kívül ezt senki nem veszi be és megint lebecsülöd az Nvidiát, már hátrányban látod most egy meg sem jelent AMD eljárással szemben...RTXGI soha nem volt csak egy szimpla brute force, optimalizálja az ejárást az RT részegségekre a DXR keretein belül. Együtt jár egy fejlett szoftveres implementáció a speciális hardveres részegységekkel nem véletlenül skálázható akár RT mag nélküli kártyákra is és az RT részegységekre is. Egy magasan skálázható kifinomult eljárás amit ezer félemódon lehet optimalizálni és butítani az adott hardverekre..

RTXDI is hasonló cipőben jár majd megláthatja mindenki, mennyire lesz rossz minőségű eljárás mert éppen a sebességet nem abból nyeri hogy rossz a minősége, d e ezt te nagyon jól tudod hogy a látható/ nem látható felületeken való számítás mit jelent hatékonyságban...[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Az NV leírása szerint az RTXGI egy probe-alapú adatstruktúrát használ, ami valós időben kezeli a fény- és távolságadatokat. Ennél vannak jobbak is, például a reservoir-alapú újramintavételezési technikák, de ha teljesítményt is akarsz, akkor még jobb kell, és leginkább ott van értelme javítani, ahol ezek a meglévő technikák a brute force miatt csődöt mondanak, leginkább a meglévő adatok újrafelhasználhatóságában.

Az RTXDI az nem is GI technika. Nyilván megközelítőleg sem fog olyan minőséget adni, mint egy globális illumináció. Ha adna, akkor ma senki sem használna GI-t, mert elég lenne a szimpla DI. Ráadásul a DI esetében nem is annyi az egész, hogy berakod a játékba, mert a direkt illumináció miatt rengeteg pre-processinget igényel. Tehát hiába működne jól maga a technika, ha nem szánod rá a több hónapot, hogy minden jelenetben jól beállítsd, akkor nem ér majd semmit. A GI ezért jobb, mert arra nem kell rászánni az időt. Azt csak berakod és működik.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Senki nem mondta hogy az RTX DI egy GI technika.....

Elengedem, értelmetlen veled bármiféle vita bármilyen Nvidia eljárásról összehasonlítva egy AMD vel, mert azt fújod amit az AMD marketing a szádba ad és elfelejted hogy a zöld oldal nem egy faék és egy vaskalapács hanem a vilég egyik legnagyobb GPU gyártó cége sokkal nagyobb koponyákkal megtámogatva mint szerintem te vagy itt bárki...

Egyszerűen hoztak egy eljárást amit a z RTX GI vel kombinálva lehet megfelelően kihasználni, nem történt itt semmi csoda, csak tovább léptek és fejlődnek."RTXDI can be combined with RTXGI for fast and scalable global illumination with many lights. RTXDI provides great results on its own, while amplifying the value of other NVIDIA ray-tracing SDKs.

[ Szerkesztve ]

"A számítógépek hasznavehetetlenek. Csak válaszokat tudnak adni." (Pablo Picasso) "Never underrate your Jensen." (kopite7kimi)

-

Abu85

HÁZIGAZDA

Az NVIDIA sosem volt erős ezekben az effektekben. Lásd Gameworks. Komoly félrefejlesztésük is volt, lásd VXGI. Nem azért ők a legnagyobb GPU-gyártó cég, mert jól tudnak effekteket írni, mert valójában messze ez a leggyengébb képességük. Az Intel is jobban teljesít náluk itt. Viszont a piacon nem ez a döntő tényező.

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

- Milyen okostelefont vegyek?

- Tippmix

- Formula-1

- iPhone topik

- AMD K6-III, és minden ami RETRO - Oldschool tuning

- Motorola Edge 30 Neo - wake up, Jr...

- Kecskemét és környéke adok-veszek-beszélgetek

- Samsung Galaxy S9 és S9+ duplateszt

- Házi barkács, gányolás, tákolás, megdöbbentő gépek!

- Fűnyíró topik

- További aktív témák...

- Újszerű - POWERCOLOR Radeon RX 5500 XT 8GB GDDR6 VGA videókártya

- BESZÁMÍTÁS! GIGABYTE WindForce 2X GTX 960 4GB GDDR5 videokártya garanciával hibátlan működéssel

- Hibátlan - PALIT GTX 1650 StormX 4GB GDDR5 VGA videókártya - tápcsatlakozó nélküli !!!

- Hibátlan - GIGABYTE GTX 1660Ti Windforce OC 6G 6GB GDDR6 VGA videókártya dobozos

- Sapphire NITRO+ RX 580 8G SE

Állásajánlatok

Cég: Ozeki Kft.

Város: Debrecen

Cég: Promenade Publishing House Kft.

Város: Budapest