- Samsung Galaxy S23 Ultra - non plus ultra

- Júniusban Magyarországra érkezik a Tecno, a fejlődő piacok egyik kedvenc márkája

- Android szakmai topik

- Milyen okostelefont vegyek?

- Ilyen lehet a Samsung Galaxy Watch7 Ultra

- Közönségkedvenc Galaxy vált One UI 6.1-re

- Nokia 3210 - felélni az örökséget

- Samsung Galaxy S23 és S23+ - ami belül van, az számít igazán

- Samsung Galaxy Watch5 Pro - kerek, de nem tekerek

- Telekom mobilszolgáltatások

Hirdetés

-

Beszáll a kézikonzolok világába a PC-s házairól elhíresült az Antec

ph Csak éppen nem saját fejlesztésű dizájnnal, hanem korábbi koncepció átnevezésével.

-

Készül a Warhammer 40,000: Mechanicus 2

gp A folytatás PC-re és konzolokra készül, a megjelenési dátum egyelőre nem ismert.

-

Közönségkedvenc Galaxy vált One UI 6.1-re

ma Ezen a héten sem tétlenkedett a Samsung szoftverfejlesztő csapata.

Új hozzászólás Aktív témák

-

Petykemano

veterán

Ez a részvényárfolyam változás annyit jelent, hogy a részvényvásárlóknak mondjuk 5-10%-a azt gondolja, hogy az AI nagyon jó üzlet lesz, sokat lehet rajta majd keresni, tőzsdézők fennmaradó 90-95%-a pedig azt, hogy az AI által keltett tőzsdei hullám lesz nagyon jó üzlet, amin sokat lehet majd keresni.

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

FSR2 és DLSS2 összehasonlítása egy a videoenkódolás minőségét értékélni hivatott szoftver, a VMAF segítségével. Elég érdekes [link]

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

válasz

paprobert

#46667

üzenetére

paprobert

#46667

üzenetére

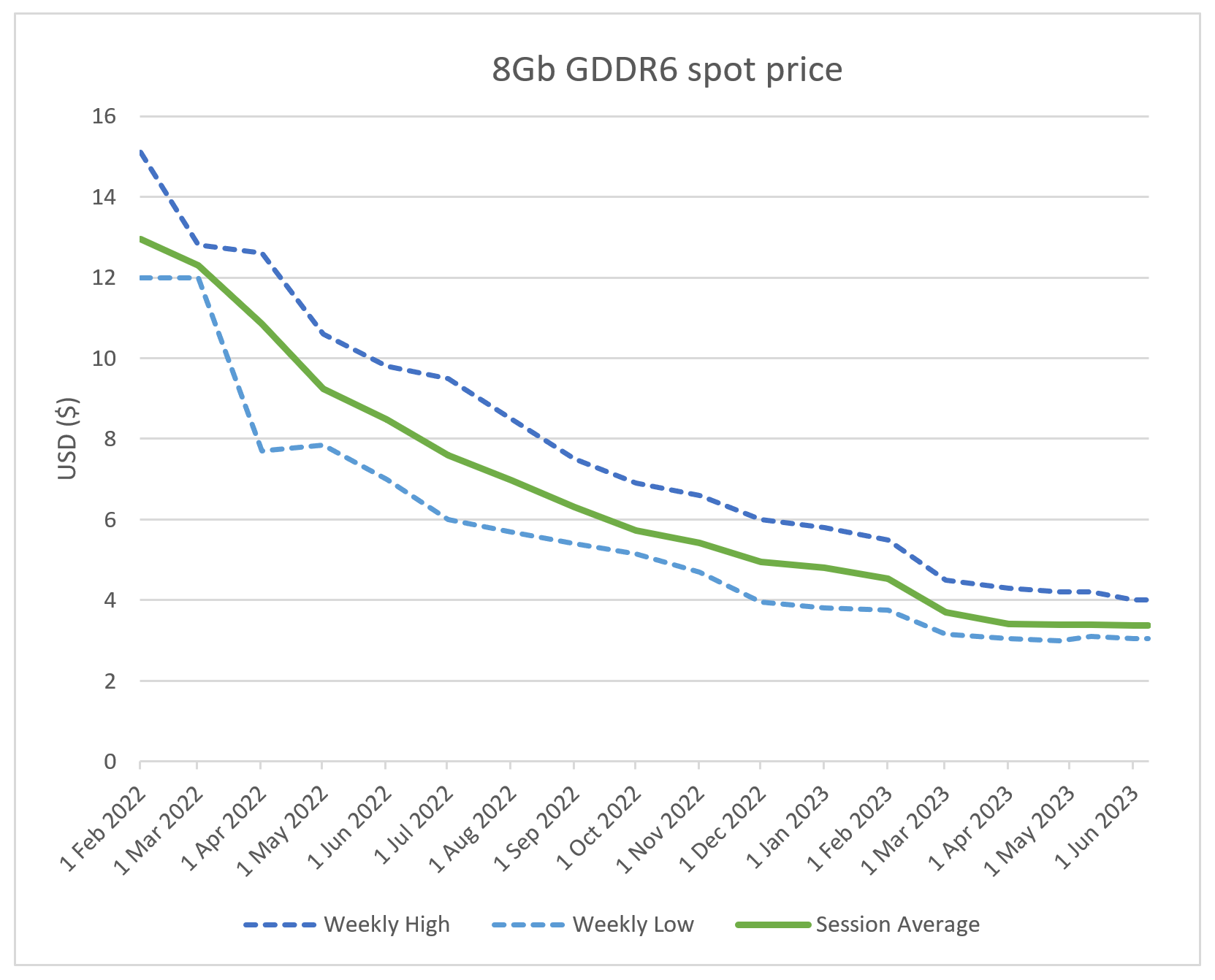

én el tudom képzelni. 2022 elején még azért enyhén leszálló ágban, de azért a csúcs közelébe volt még a bányászat.

Én nem gondolom, hogy az elképesztő GPU árak kizárólag a boltokban kialakult hiány miatt alakult ki. Értem ez alatt azt, hogy a GPU alkatrész gyártók is tervezett mennyiségekkel és árakkal dolgoznak, ha a bolti GPU szűkösség miatt növelni akarják a termelést akkor a tervezetthez képest GDDR6-ból, rézből, alumíniumból is hiány alakulhat ki, ami azok árát is felveri.

Az ábrán a felszálló ág nem látszik, csak a leszálló.Én úgy vélem, hogy az RTX 3000 széria msrp árai nem voltak eleve, tervezetten kamuk. Persze az AIB kártyák ára mindig jellemzően magasabb, de nem annyival, mint amilyen különbség 2020 végétől elkezdett kialakulni. A kialakult extrém kereslet az alkatrész árakra is nyomást gyakorolt, azok árát is felverte és én úgy már tényleg nem fért bele az msrp-be. Nem fogjuk sosem úgy megtalálni, hogy ki járt jól, hogy egyvalakire rá lehet mutatni. Az egész láncban a tervezőtől, félvezetőgyártótól a réz, alumínium szállítótól, összeszelőn át a szállítóig és boltig mindenkinek vastagabban fogott a ceruzája.

Valahol azt is érthetőnek tartom, hogy egy ilyen váratlan és vélhetően nem tartós piaci sokkra nem reagáltak a hivatalos msrp árak folyamatos igazításával.

Úgy fogalmaznék, hogy az akkoriban a hivatalos $329 ellenére $500-600-ért árusított RTX3060-ba valószínűleg tényleg $180 értékben kerülhetett VRAM.

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Bocs, lehet, hogy volt már róla szó...

Azon gondolkodtam el, hogy állítólag a DLSS jobb képminőséget ad, mint az FSR. Nekem semmilyen alapom nincs ezt az állítást kétségbe vonni. Csak elgondolkodtam, hogy vajon ennek mi lehet az oka.

Ez szimplán az alkalmazott algoritmus által eredményezett - szoftveres - különbség? Vagy elképzelhető, hogy lenne mód az AMD számára is, hogy valamilyen olyan módon fejlessze az algoritmust, ami megfelelő - dedikált - hardverelemek megléte esetén jobb képminőséget és/vagy teljesítményt nyújtana, csak épp sem az AMD kártyák nem tartalmaznak ilyen dedikált hardverelemet, és az FSR-ral kapcsolatos policy is az, hogy bármilyen hardveren futhasson, ennélfogva azzal kapcsolatban, hogy milyen trükköket lehetne bevetni a minőség javítása érdekében, limitált.Az RDNA3-mal kapcsolatban korábban volt egy olyan várakozás, hogy az AMD dedikált gyorsítókat épít(het) amitől az FSR amd hardveren futtatva gyorsabb/jobb lesz, de eddig ennek sincs semmi jele.

Viszont ha dedikált hardverelem nélkül, bármilyen GPU-n futó algoritmussal nem lehet a DLSS-nél jobb megoldást kivitelezni, és ennélfogva a vásárlók hozzáállása az, hogy megveszem a jobb felskálázó megoldást biztosító GPU-t, akkor az AMD miért nem csinál valami olyasmit, hogy az FSR bár default minden hardveren megy, de AMD hardveren mégiscsak jobb - és annálfogva a DLSS-szel versenyképesebb?

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Befejezték az Aurora telepítését. [link]

novemberre lesz eredmény, amit 2EFlop/s fölé várnak.Az egyetlen szépséghibája, hogy míg a Frontier 23MW-ot fogyaszt 1.2EFlop/s mellett, és az El Capitan szintén 2 EFlop/s melletti várható fogyasztása 30MW lesz, addig az Aurora 60MW körül lehet.

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

az AMD versenyellenes tevékenységet űz [link] máglyára vele!

[ Szerkesztve ]

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

válasz

bobalazs

#46752

üzenetére

bobalazs

#46752

üzenetére

Azt sajnálom, hogy nem állnak bele, hanem maszatolnak.

Az exkluzivitás jelensége nem ismeretlen a piacon. Pontosan tudjuk, hogy az Nvidia is kínált olyan segítséget, eszközöket, amivel a gyakorlatban exkluzivitást vásárolt. Ha nem pénzben, akkor természetben (munkával, eszközök rendelkezésre bocsájtásával) fizet azért, hogy a saját hardverét helyzetbe hozza.

Hajdanán több technológia is volt különböző effektek megvalósítására. Az NVidia a haj emulációjára a Hairworks-öt kínálta, az AMD-nek meg valami TressFX nevű megoldása volt. Különös, hogy nem emlékszem egyetlen olyan esetre sem, hogy egy Hairworks beépítő játék kapcsán hírverés, patália lett volna abból, hogy az AMD vásárlók számára miért nem építik be egy alternatív, az AMD hardver számára kedvezőbb, jobb eredményt nyújtó technológiát.

Amennyiben az AMD - hasonló módon - tényleg exkluzivitást vásárolt a játékban az FSR-re, akkor abba szerintem bele kellene állnia. Nem igaz az, hogy a DLSS-nek csak előnye, az FSR-nek pedig csak hátránya van: még ha árnyalatnyi különbséget fel is lehet fedezni a DLSS javára, az FSR mellett szól, hogy bármilyen hardveren fut. Ezt egészen nyugodtan lehetne mondani. Abban is biztos vagyok, hogy ha ilyen exkluzivitás létrejött, az nem szól örökre.

Nem megalapozott magánvéleményem az, hogy nem az FSR2-ről lehet szó, hanem az FSR3 első implementációjáról szól és annak szerettek volna megágyazni.

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

válasz

hokuszpk

#46754

üzenetére

hokuszpk

#46754

üzenetére

Ha ezzel arra akarsz utalni, hogy mint felskálázó technológia kizárólag DLSS-t tartalmazó játék is bőven van, akkor azt kell mondjam, látom, nem érted.

Amikor egy játékban csak DLSS van, akkor az nincs is. Ha van, akkor sincs. És ha mégis van, akkor az jól átgondolt, megalapozott és helyes üzleti döntés a fejlesztő/kiadó részéről. Ahhoz az Nvidiának semmi köze. Az Nvidia még örülne is, ha a felhasználók saját szemükkel tudnák összehasonlítani mennyivel jobb a DLSS ugyanabban a játékban. Annyira támogatja és bíztatja a partnereit erre, hogy éppenhogy csak embert nem ad rá, hogy saját maga tegye meg. De a fejlesztők befolyásmentesen önérdekből meghozott saját döntésével nem csak maguknak spórolnak egy csomó időt és energiát, amit a következő játékok jobb minőségére fordíthatnak inkább, hanem valójában azzal, hogy a jobb minőséget építik be, felhasználókat is megkímélik a választás terhétől. A felhasználók pedig értékelik a minőséget és a kényelmet.

De amikor egy játékban csak FSR van, az nyilvánvalóan az AMD bűnös és sötét összeesküvésének, lefizetésének és ravaszkodásának eredménye, amivel a felhasználók érdekeit figyelmen kívül hagyva ellehetetleníteni igyekszik a szegény, ártatlan, és fair Nvidiát. Kifejezetten büntetni akarja a szar, semmirekellő felskálázó technikájával az Nvidia felhasználókat. Ez teljesen nyilvánvaló. Olyan ostobák! A pénzt, amit erre az értelmetlen gátlástalan piacrombolásra fordítanak (ráadásul eredménytelenül), költhetnék inkább arra, hogy jobb hardvert és szoftvert készítsenek. Szánalmas, amit amit csinálnak.

Így már érted?

[ Szerkesztve ]

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

válasz

Yutani

#46848

üzenetére

Yutani

#46848

üzenetére

Szerintem azt ők is érzékelik, hogy a kurrens "big thing" a grafikában a raytracing, a next big thing meg a neural rendering. Jelentsen utóbbi akármit is a gyakorlatban.

De hiába erős a pozíciójuk a konzol piacon, a PC piacon nem ők diktálják a trendet.

A dolog érdekessége, hogy - elvileg - nagyon sok dolgot az AMD (+ a konzol gyártók) dikálnak (az AMD-nek). Szerintem az FSR is valahol egy ilyen dolog. Valahol mintha azt olvastam volna... Nehezemre esne elhinni, hogy ne tudtak volna jobb algoritmust megalkotni - ugye nem egyedül, hanem a MS-tal és/vagy a Sony-val. De vélhetően fontos szempont volt, hogy legyen takarékos az erőforrásokkal.Azon gondolkodtam, el, hogy vajon az AMD tudott-e volna hozni - egy nem a konzol piacról származó, ott be nem vetett - jobb felskálázó megoldást, ami

1.) jobb minőséget biztosít, mint az FSR, aminek persze - mint azt a XeSS esetén láttuk sokszor nagyobb erőforrásszükséglet az ára

2.) A nagyobb erőforrásszükségletet úgy próbálja tompítani, hogy fixfunkciós/FPGA elemeket épít be. (ilyen hardverelemet be lehetne építeni a konzolba is)Szerintem nem lenne lényegesen jobb a helyzet, mint most. Az AMD tulajdonosok - legalábbis a frissebb kártyával rendelkezők - örülnének a jobb minőségnek, amit az új kártyások többletterhelés nélkül élvezhetnek.

De az Nvidia tulajdonosok akkor is vernék a tamtamot, hogy ők nem hajlandók bevállalni sem a rosszabb (hagyományos) FSR minőséget, sem a többletterhelést, ami a jobb minőséggel jár, és amihez nincs megfelelő hardverelemük, hanem igenis a fejlesztő építse be a nekik járó DLSS-t.Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

válasz

Busterftw

#46884

üzenetére

Busterftw

#46884

üzenetére

Az Nvidia próbálkozásának célja valójában nem annyira a gamer piac kímélése volt, hanem hogy a lapkákat úgy értékesíthesse a nyilvánvalóan túlkeresletet eredményező bányászat felé, hogy amikor a bánya beomlik, a kiáramló nagy mennyiségű használt kártya ne döntse be az új - akkor esetleg már újgenerációs lapkákra épített - kártyák piacát.

Ezt a célt szolgálta a dedikált kártya, amin nincs display kimenet és némiképp tweakelve volt a BIOS. De miért venné ezt az újraértékesíthetetlen kártyát a bányász a gamer kártya helyett? Na ezt a kérdést volt hivatott megválaszolni a gamer kártyákra kitalált korlátozás.

Nem tudom pontosan, hogy a lapka, vagy' a dram vagy egyéb alkatrészek jelenthették-e a szűk keresztmetszetet, de abban az időben valószínűleg mindent eladtak, amit le tudtak gyártani. Nincs okunk azt feltételezni, hogy a szűk keresztmetszetet a display kimenetek jelentették volna, ennélfogva biztosak lehetünk benne, hogy a miner kártyák nem valamiféle "kvóta feletti" mennyiségként jelentek meg a piacon.

Az, hogy az nvidia legalább próbálkozott valamivel, valójában egy zöldszemüveges mítosz (kábé olyan, mint hogy az eredményes kormányzati intézkedések hatására csökken az infláció)

Az nvidia ezzel nem a gamer piacot, a gamereket akarta megmenteni, hanem saját magát a később beomló áraktól és eladási mennyiségektől. Ebben nincs mit számonkérni az AMD-n.[ Szerkesztve ]

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Abu tévedhetett is. Félreérthetett valamit, vagy akár neki is hazudhattak. (megjegyzem, emlékeim szerint MLiD is arról számolt be, hogy az AMD RDNA2 készletei alacsonyak)

De megkockáztatom, hogy esetleg nem volt-e - legalább részben - tudatos döntés az, hogy így alakult.Az szerintem nyilvánvaló, hogy az RDNA3 fejlesztési célja leginkább a chipletezés és az a chipletezésből az elszálló wafer árak mellett nyerhető versenyképes költség és kapacitás elérése lehetett.

Azonban a GPU bányászat lecsillapodása, valamint egy általános recesszió beköszönte miatt a wafer árak - különös tekintettel a TSMC N5/N4-re - végülis jelen információink alapján nem szálltak el. Bár nem beszéltek rendkívüli olcsóságról, de az év eleji meglehetősen alacsony N6/N7 kihasználtság alapján azért lehet azt feltételezni, hogy TSMC ajánlhatott kedvezményt az AMD-nek a gyártósorok kihasználtságának fenntartása érdekében.

Mi történt tavaly év végén? A Zen4 elsőre kissé borsos árazása meglepő gyorsasággal esett be. Nem csak a meglehetősen hamar megjelenő X nélküli változatok, hanem néhány hónap elteltével az X változatok is elég kedvezményes árazással mentek.

Ezek alapján szerintem történhetett akár az is, hogy az AMD látva azt, hogy az RDNA3 a kialakult piaci helyzetben (csökkenő gyártósori kihasználtság, stagnáló wafer árak, stb) nem igazán lesz képes kamatoztatni azokat az erősségeket, amilyen céllal készült. A Navi31-et kiadták, mert az ténylegesen nagyobb teljesítményre volt képes, mint az addigi csúsznak számító Navi21, de minden más szinten az RDNA3 architektúra és a chiplet, az N5 wafer használata nem hozott volna kézzelfogható (költség)előnyt, ezért úgy döntöttek, hogy

- inkább tovább gyártják az RDNA2 lapkákat - megkockáztatom - azon a kedvezményes áron, amit esetleg a TSMC ajánlott

- a lefoglalt N5 kapacitásokat pedig Zen4 lapkák gyártására fordítják és a nagyobb gyártási volument olcsóbb áron fogják kínálni, ami ugyan kisebb marzzsal, de összességében nagyobb profit volumennel fog járni.Persze nem tudjuk.

De ebben a szcenárióban fel kell tenni a kérdést: vajon mi változhatott, hogy most (mégis) kiadják.Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Szerintem több szempontból is furcsa ez a specifikáció.

A PS5-ben módosított Zen2 magok vannak. A zen2 2019-ben, a PS5 2020-ban jött ki.A PS5 pro a pletykák szerint 2024 végefelé jön. Ehhez képest a Zen5 2024 elejére várható. Ez alapján lehetne benne akár Zen5 mag is. Persze értem, hogy egyáltalán nem a CPU A legmeghatározóbb része.

Különös az is, hogy a nem kifejezetten jól sikerült RDNA3-at nevezik meg, mint grafikus egység. Főleg amiatt, mert ha jól emlékszem, a konzolok valahol az RDNA1 és RDNA2 között vannak tudásban és képességben. Rossz nyelvek szerint az RDNA2 épp azért lett jó, mert beépítették a konzoloknál kitalált és kipróbált remek elképzeléseket (Persze tudjuk, hogy hermetikusan el vannak zárva egymástól a külsős és belsős csapatok)

Az RDNA2 abban az évben jelent meg, mint a PS5. 2024-ben - elvileg akár - meg is jelenhet az RDNA4. Illogikusnak tűnik RDNA3-ra építeni, vagy RDNA3-nak nevezni azt, amire építik.

Vagy... akár úgy is mondhatnám, hogy ez a specifikáció akkor lenne logikus a PS5 körülményeit alapul véve, ha a PS5 Pro még idén év végén megjelenne.

Ami végülis lehet, hogy nem is olyan elképzelhetetlen figyelembevéve, hogy nemrég volt PS5 árvágás.

(Megkockáztatom, hogy akár az is lehet, hogy az RDNA3 egy sajnálatosan félresikerült tesztága a PS5 Pro-nak)Ami viszont különös az az, hogy miért nincs benne infinity cache egyáltalán?

Monolitikus formában 4/5nm-en ez szerintem olyan 300-350mm2 lehet.

Illetve olvastam egy olyan véleményt, hogy valószínűbb, hogy sima GDDR6, mint GDDR6X, mert fontos, hogy legyen megfelelő verseny és ellátás a beszállítók között.

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Szerintem ez egyszerű és egyértelmű is: 50% perf/w volt a cél ("ígéret") és ezt végül sajnos nem sikerült elérni. Úgy kellett összeválogatni, hogy zen3 vs zen4 rendszerben valahogy ki lehessen mutatni.

Persze nyilván ez relatív. Nyilván az RDNA2-höz képest jobb. A kedvezőtlen megítélés a saját célokhoz és a konkurencia előrelépéséhez viszonyítva alakul ki. Nem rossz, csak elmaradást jelent a várakozáshoz képest és lemaradást a konkurenciához képest.

A Navi33 különösen stagnálás, legfeljebb refresh érzetet kelt. Persze értem, hogy az árazása sokkal kedvezőbb lett, mint a Navi23-é volt, de azért szerintem ez főként a piaci viszonyoknak köszönhető, nem az architektúrának.

Egyébként abban egyetértek, hogy azon a sávon belül van, hogy árazással lehet kedvező pozícióba helyezni, és a nevezékben is kár volt az XTX

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

válasz

huskydog17

#47182

üzenetére

huskydog17

#47182

üzenetére

Nvidia vezet - Nvidia király

AMD vezet - AMD szabotázs!!444!Aham...

Mindazonáltal tényleg értem a kritikát a játék teljesítményével kapcsolatban. De ehhez mégis mi köze van az AMD-nek?

Ráadásul az Nvidia már elismerte, hogy nem volt elegendő erőforrásuk a day0 driver megfelelő elkészítéséhez.

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Szerintem nem az.

És attól, hogy időről időre van egy-egy játék, ami különböző körülmények miatt esetleg jobban fekszik az AMD-nek, attól még nem lesz az. Még ha annak szánták is. Egy fecske nem csinál nyarat.

Persze jó lenne, ha ez az összehasonlítás trendszerűvé válna, (Persze lehetőleg nem amiatt, mert az nvidia elhanyagolja drivert.) de nem tartunk ott.Tudjuk hogy a kártyák látható teljesítményét nem kizárólag a hardver és a driver (most az egyéb szoftvertől tekintsünk is el) adja. Annak része a játékok optimalizációja is. Ezt volt hivatott szolgálni a TWIMTBP, a gameworks. És nyilván ugyanerre apellál az AMD a konzol irányból megközelítve. Ebben az nvidia nagyon jó. (Ebben is)

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

válasz

huskydog17

#47192

üzenetére

huskydog17

#47192

üzenetére

Így fogalmaztál:

"Az AMD mérnökei viszont itt megveregethetik saját vállukat, ugyanis sikerült elérniük, hogy az RX7900XTX gyorsabb, mint az RTX 4090. Igaz, az általános sebessége a játéknak annyira pocsék, hogy még viccnek is rossz. Legalább majd az AMD marketingesei megveregethetik a mellüket, hogy "a mi kártyáink gyorsabbak Starfield-ben, mint a konkurencia".

[...]

A baráti VRAM igény viszont számomra is kellemes meglepetés, itt sokkal rosszabbra számítottam az AMD-től."A megfogalmazásod számomra azt a benyomást kelti, mintha azért ugyan a Bethesdát okolod, hogy minden szempontból ennyire rossz minőségű lett a játék, de azt, hogy az Nvidia kártyák - kivételesen - alulteljesítenek önmagukhoz, a szokásoshoz képest, ezáltal - kivételesen - alulmaradnak az AMD kártyákhoz képest, azért az AMD-t tartod felelősnek.

Abból szűröm ezt le, hogy ebben a két kiemelt bekezdésben 3x jelenik meg felelősségi kontextusban az AMD márkanév és egyszer a Bethesda.Erre lehet mondani, hogy hát ha az AMD emberei ott voltak, akkor bizonyára van közük/kezük abban, hogy olyan lett az optimalizálás, amilyen és hogy lehet benne szándékosság is.

De ha ezt feltételezzük, akkor akkor ugyanez elmondható a számos TWIMTBP és Gameworks játékról is, ahol az Nvidia emberei voltak jelen?

Ha esetleg tévednék, vagyis valótlanul fedeztem fel soraidban cinizmus és valójában tényleg megdícsérted az AMD mérnököket és marketinget, akkor elnézést kérek.

Szerintem az van, hogy ez egy "Hát ez nem történthet meg!!!" típusú felfújt ügy, ami remek alkalmat teremt arra, hogy rossz színben lehessen feltűntetni az AMD-t.

Bocsánat, elnézést, az Nvidia nem ismert el semmit hivatalosan.

Arra nézve, hogy a Starfield megfelelő driver-optimalizációjához nem volt meg a szükséges dedikált erőforrás MLiD a forrásAmi számomra azért hihető, mert az alulfogyasztás miatt láthatóan nem GPU limitbe ütközve teljesítenek alul, így itt meg lehet majd találni idővel a hiányzó teljesítményt.

Esetleg az vetődhetne fel, hogy nem az Abu által sokat emlegetett CPU limitről van-e szó, vagyis hogy az Nvidia drivernek nagyobb a CPU overheadje. Elképzelhető, hogy a driver megfelelő optimalizálása részben arról is szól, hogy miképp lehet a driver feladatait konzisztens módon többszálasítani és ez nem minden játéknál működik egyformán. Tehát lehet, hogy amikor megérkezik az a driver, ami jobban teríti a munkát a CPU szálak között, hirtelen meglesz a kártyák hiányzó teljesítménye is.

Még annyit tennék hozzá, hogy olvastam egy olyan állítást a játékról, hogy nincs benne brightness control. Nem tudom, hogy ez vajon a játék jellegéből fakadóan van-e így, de aki ezt a megjegyzést tette, olyan módon rótta fel, hogy ha még ez sincs beépítve a játékba (nem is beszélve microlagekről és egyéb polírozatlanságokról) akkor nem csoda, hogy a fejlesztőknek nem volt idejük (büdzséjük) az FSR-on kívül más skálázót beépíteni, vagy más GPU-gyártókkal együttműködni a megfelelő optimalizáláson.

[ Szerkesztve ]

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

-

Petykemano

veterán

Korábban voltak olyan magyarázkodások, hogy a cowos vagy más advanced packaging eljárás túl drága, vagy túl kis kapacitással elérhető ahhoz, hogy konzumer termékben alkalmazni lehessen. Főleg most, hogy az AI miatt minden kapacitást felvásárolnak, arra fordítanak.

Vagy legalábbis az AMD részéről szoktak ilyenek jönni.

Aztán mindig jön egy hír, hogy lehetne azt nagyobb volumenben is, megérősen.

Jó, persze az se mindegy, mikor. Tudjuk, hogy az ilyen összeszerelő kapacitádokat nagy erőkkel bővítik és A későbbiekben az AMD is több terméket fog ilyen módon összerakni.

Nekem az nem áll össze, hogy vajon mi indokolja ezt az együttműködést? Az nvidia nem tud CPU-t tervezni? Biztosan tud. Arra gondoltam, hogy talán valami olyasmiről lehet szó, mint a Samsung+AMD esetén, csak az nvidia nem IP-t, hanem a mediatek által készített SOC-hoz köthető lapkát ad. De a hír CPU-ról szól.

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Az Amazonról is kikerült valahogy a mindfactory-hoz hasonló CPU eladási adat.

A minta mintegy 4x nagyobb. Irányait tekintve hasonlítos a mindfactory-hoz, bár kevésbé szélsőségesnek mondható.

[link]Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

válasz

Alogonomus

#47487

üzenetére

Alogonomus

#47487

üzenetére

A Meta terve az, hogy lecseréli robotokra a felhasználóit.

De a viccet félretéve, Rehoboam-ot éppenséggel építhet. Mindenki Facebook tevékenységét logolja, arra egyenként épít egy-egy profilt és ezrével futtatja a szimulációkat, hogy pontosan belője, hogy ki mit fog tenni (kattintani) következőre.Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

válasz

Busterftw

#47558

üzenetére

Busterftw

#47558

üzenetére

Igen volt, de az nem.merült föl,.hogy ez gond lenne, legfeljebb az, hogx ha valaki olcsóbb alaplapot és hütést alkalmaz, nem azt fogja látni,.mint a tesztben. Ami hát talán nem.is annyira szokatlan. Instabilitásról eddig nem számoltak be.

Találgatunk, aztán majd úgyis kiderül..

-

-

Petykemano

veterán

Roppant érdekes teszt és eredmény: az Intel jelenlegi architektúrája esetén nem volna gyakorlati haszna, ha ők is 3D v-cache segítségével bővítenék az L3$ kapacitását. [link]

Találgatunk, aztán majd úgyis kiderül..

-

Petykemano

veterán

Igazad lehet abban, hogy elhamarkodott az ítélet.

Talán ott ment félre, hogy annyira hangsúlyozták, hogy a frekvenciával skálázódik csak.

Ami eleg valószínű, hogy a frekvenciávak kb lineárisan a cache mérettel meg kb logaritmikusan skálázódik.A ryzenek esetén nekem az az emlékszerű megfigyelésem, hogy az 5600X és 5600G közötti kb 10%-os gaming különbségért kb 45-55%-ban felel a frekvencia és 16MB vs 32MB L3$ különbség.

Ebből fakadóan 3-8MB cache különbség a 20-30MB magasságban valóban csupán 1-3%-ot magyarázhatTalálgatunk, aztán majd úgyis kiderül..

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

Megbízhatatlan oldalakat ahol nem mérnek (pl gamegpu) ne linkeljetek.

- ThinkPad (NEM IdeaPad)

- Milyen billentyűzetet vegyek?

- Samsung Galaxy S23 Ultra - non plus ultra

- Milyen TV-t vegyek?

- Luck Dragon: Asszociációs játék. :)

- Vicces képek

- LCD, plazma és projektoros TV-k hibái

- Milyen légkondit a lakásba?

- bambano: Bambanő háza tája

- Debrecen és környéke adok-veszek-beszélgetek

- További aktív témák...

- MSI MAG274QRF-QD QLED Gamer Monitor!27"/2k/165hz/1ms/Freesync-Gsync/Type C/Konzolhoz is/Beszámítás!

- Sennheiser Epos H3 White Gamer Fejhallgató Eladó!

- Hisense 50A6BG 4k Smart TV!50"/4k/DOLBY VISION/10bit/Game Mode/ALLM/Beszámítás!

- Dell S2421HN Full HD Led Monitor! 24"/1920x1080/IPS/75hz/Freesync/Fehér

- Dell S2721DS 2k Monitor!27"/IPS/2560x1440/75hz/Freesync-Gsync/Fehér/Beszámítás

Állásajánlatok

Cég: Alpha Laptopszerviz Kft.

Város: Pécs

Cég: Ozeki Kft.

Város: Debrecen