- iPhone topik

- Poco F3 - a mindenes, de nem mindenkinek

- 700 dolláron kezdhet a Galaxy Watch Ultra

- Honor Magic5 Pro - kamerák bűvöletében

- T Phone 2 Pro - majdnem mindenben jobb

- Milyen okostelefont vegyek?

- Motorola Moto G54 5G Power Edition - nem merül le

- Redmi Note 8 Pro - Redmi, a profi

- Befutottak az első Xperia 1 VII pletykák

- MIUI / HyperOS topik

Hirdetés

-

Végleg elkaszálták a Life by You fejlesztését

gp Többszöri halasztás után végül kiderült, hogy mégsem jelenik meg az életszimulátor.

-

Computex 2024: Új multiportos gyorstöltők is vannak a Ugreen kínálatában

ma A Nexode S széria tagjai között akár 100 wattosat is találni, USB-C és USB-A portokkal, tenyérnyi méretben.

-

Szankciókat kapott az USA-tól a DeepCool

ph A vállalat elvileg tiltott termékeket értékesített Oroszország számára.

Új hozzászólás Aktív témák

-

Abu85

HÁZIGAZDA

válasz

#16939776

#36

üzenetére

#16939776

#36

üzenetére

Nem szükséges változtatni. Az a részlet arra vonatkozik, hogy bizonyos termékek rajtja előtt esetleg nincs annyi idő, hogy hivatalos hitelesítést szerezzen a gyártó rá. Ilyenkor egy belső laborban végzett hitelesítéssel is rárakhatják a PCI Express logót, és utána három hónapon belül a PCI-SIG is hitelesíti a terméket. Ha ez nem történik meg, akkor jönnek a problémák. Ugyanakkor a PCI-SIG a Radeon RX 480-at már hitelesítette a saját laborján belül is. Innentől kezdve az esetleges problémákkal specifikusan kell eljárni, hogy kizárják a mérési hibákat. Ha specifikus hiba volt, akkor ennyi. Ha nem, akkor vizsgálja meg a PCI-SIG, hogy miért megy át az ő tesztjeiken, és máshol miért van baj. Ez magával vonhatja a teszt módosítását is.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Yutani

nagyúr

Egyébként azon felül, hogy többet fogyaszt a kártya a sloton keresztül, okozott ez bárkinek is problémát? Égett le alaplap emiatt?

#51 arn: Nincs agyonterhelve a slot. Bőven specifikáción belül van. A túlterhelés "érzete" a beégett 75W/slot korábbi limit miatt kering a fejekben.

[ Szerkesztve ]

#tarcsad

-

Abu85

HÁZIGAZDA

Ugye itt nem igazán ez a kérdés. Hanem az, hogy többet fogyaszt-e, mert a PCI-SIG legalapvetőbb tesztje az, hogy nem fogyaszthat többet 3,3+12 V kombinált terheléssel huzamos ideig (ugye vannak peakre és toleranciára vonatkozó specifikációk). Tehát ha ott átment a hitelesítésen valami, akkor az tuti nem fogyaszt többet a kelleténél. Ezért vizsgálják a tesztelők rendszereit, mert erős a gyanú, hogy

1. valamit elcsesztek

2. az alaplap ES volt

3. valami átmeneti ellenálláspara a tápban (ez elég gyakori)

4. esetleg ES a táp

5. szimplán nem elég pontosak a mérőműszerek

6. esetleg ES volt a VGA

7. ezek kombinációjaEzeket mind ki kell zárni mielőtt ténylegesen a PCI-SIG tesztjére terelődik a gyanú. Utána jön az a kérdés, hogy mért fogyaszt többet, és aztán a "hogy a fenébe ment át".

[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

-=MrLF=-

senior tag

[ Szerkesztve ]

protonmail.com Secure Email Based in Switzerland . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . startpage.com The world's most private search engine from Netherland

-

#85552128

törölt tag

Az nem lehetséges...

![;]](//cdn.rios.hu/dl/s/v1.gif)

A hardware.fr egy bolti kártyánál is hasonlót figyelt meg.

[ Szerkesztve ]

-

Abu85

HÁZIGAZDA

Azt a PCI-SIG nem engedi meg. Minden revíziót újra kell tesztelni. Ez a lehetőség 100%-ig kizárható. Ha hagynának egy ilyen kiskaput a rendszerben, akkor azt boldog-boldogtalan kihasználná, nap mint nap. Ugye a PCI-SIG tagoknak egyáltalán nem célja az, hogy szétverjék a szabványt. Olyan formában nem éri meg fenntartani sem (a fenntartásba elég sok pénzt raknak bele, dollár tízezres tétel ez évente az AMD-nek, NV-nek, Intelnek, stb.), mert úgyis csak kibújnának a kötelezettségek alól a cégek.

A revíziók újratesztelése egyébként kiadás előtti jellegű, tehát nincs lehetőség még késleltetni sem, mindig up-to-date kell lenni.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

Kansas

addikt

Ha már tesztelőkkel példálózunk, Anand pl nem találkozott a problémával

http://www.anandtech.com/show/10446/the-amd-radeon-rx-480-preview/6De ez még csak az első pillantás, gondolom a hosszabb teszt során direkt figyelni fog erre.

Guru3D-éknél a csúcsfogyasztás(tehát nem az átlag) 166W, de a GeForce 1070 is 161W, ami szintén 150W-os kártya ugyebár - akkor az se szabványos(

![;]](//cdn.rios.hu/dl/s/v1.gif) ): http://www.anandtech.com/show/10446/the-amd-radeon-rx-480-preview/6

): http://www.anandtech.com/show/10446/the-amd-radeon-rx-480-preview/6Mindenki válogathat teszteket ízlés szerint

Egy szó mint száz, szerintem kicsit túl van fújva a sztori, akkor is, ha a probléma esetleg tényleg valósNincs olyan MI, ami képes lenne szimulálni az emberi hülyeséget... ha valaha lesz, annak tuti az emberi hülyeség lesz az oka... A Föld erőforrásai közül a legjobban az ész van elosztva - mindenki meg van róla győződve, hogy több jutott neki, mint másoknak.

-

Abu85

HÁZIGAZDA

válasz

#85552128

#62

üzenetére

#85552128

#62

üzenetére

Nem valószínű, hogy mértek. Inkább teljes fogyasztást, vagy kalkuláltat közölni. Anand akarta bevezetni a multiméteres mérést, de aztán rájött, hogy még számukra sincsenek sem elérhető árban azok a berendezések, amelyek elég pontosak ahhoz, hogy érdemes legyen ezzel foglalkozni. Gyengébb felszereléssel pedig elég nagy lehet a hibaszázalék. Aztán Anand elment, és maradt a régi rendszer.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

-

Abu85

HÁZIGAZDA

Fontos, hogy ne legyen összekeverve az ASIC TDP és a TGP. A 110 watt az ASIC TDP-je, és valóban szerepel a nem publikus specifikációban, de ott azért van benne, mert az nem kerülhet ki. Persze kikerült. A 150 watt a TGP, amit manapság valamiért szokás TDP-nek hívni, de a lényeg az, hogy az a teljes rendszer default limitje. Ebben benne van a 110 watt ASIC, a 20,5 watt memória és a 18,6 wattnyi egyéb komponens. Plusz egy picike kerekítés felfelé.

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

atus72

senior tag

Nem tudtam hogy 2016-ban kisfeszültségen fogyasztást mérni az ekkora probléma

-

Reggie0

félisten

Andantech nem merte a kartya fogyasztasat.

Tevedes. A feszultsegekre +8%-os tolerancia megengedett a pcie csatin, es +5% az ATX csatin. Ez a maximalis aramkorlat mellett a nevleges 150W eseten 159.75W-ot jelent, ha a csatlakozokon mert feszultseg a maximalis toleranciaertekig megno(12V->12.96V, 3V->3.564V, ill atx csatin 12V->12,6V). Tehat a 161W benne lehet a megengedettben, kerdes csak az, hogy mekkora volt a meresi hiba. (Es tfh hogy 6 pines csati volt).

Valamint tegyuk hozza, hogy a meresi kornyezet is sokat szamit, mert nem mindegy mennyit porog a venti. 100% ventivel lenne igazan erdekes a kerdes.

(#72) atus72: *torpefeszultsegen.

[ Szerkesztve ]

-

Petykemano

veterán

Soha egyetlen egyszer sem találkoztam még azzal, hogy a chip fogyasztását megkülönböztették volna a kártya fogyasztásától. Pedig amikor a fiji hbm bejött, nagyon érdekes lett volna. De akkor nem szivárgott ki, nem lehet tudni, vérremenő viták folytak arról, mennyit fogyaszthat a gddr5, Meg mennyit a hbm, még olverdával te is hajba kaptál ezen. Most meg ne keverjük össze?

Találgatunk, aztán majd úgyis kiderül..

-

Reggie0

félisten

válasz

Petykemano

#74

üzenetére

Petykemano

#74

üzenetére

A chip gyartojanak koze sincs ahhoz, hogy mennyit fogyaszt a kartya, az nagyon sok kulso tenyezotol fugg. Nyilvan nem a kartyaet adjak meg.

-

Öőő, és mitől menne fel a PCIe tápfesz

? Ehhez az alaplap biosába kéne csúnyán beletúrnia a karinak, ha egyáltalán "szoftveresen" állíthatók a feszültségek

? Ehhez az alaplap biosába kéne csúnyán beletúrnia a karinak, ha egyáltalán "szoftveresen" állíthatók a feszültségek Az áramerősség persze más kérdés, az "igény" szerint folyik, de ha speckó felettit "kér a fogyasztó" vagy leadja a lap, vagy nem.

Az áramerősség persze más kérdés, az "igény" szerint folyik, de ha speckó felettit "kér a fogyasztó" vagy leadja a lap, vagy nem.[ Szerkesztve ]

30€ Meta store bónusz Quest headset aktiváláshoz, keress priviben :)

-

partxxx

tag

kicsit túl van fújva a téma

A hitelesítő szerveket is hitelesítik, és biztosan nem fognak megkockáztatni egy ilyen "bakit", mert utána lehúzhatnák a rolót.

-

AAAgold

senior tag

érdekes a téma, bár én egyszerű ember vagyok, még mindig nem értem, mi lehet a max felvett teljesítmény a pci-e-on keresztül, illetve a 6tűs csatin keresztül (külön-külön) és miért...

illetve régebbi gépbe téve mi fog történni ha meg van hajtva?

[ Szerkesztve ]

"Miért imádják az aranyat? Nem lehet megenni..."

-

westlake

félisten

Végre, egy valóban érdekes téma! Köszönet érte. A köztudatban tényleg elég sok a hibás adat, amiktől ideje lenne "megszabadulni".

Play nice!

-

Reggie0

félisten

-

R9DEON

senior tag

A Biosbol állítható bizonyos alaplapoknál van rá opció is de általában el van dugva és a Bios írója operálhat vele, PCI-E voltage néven fut és prémium kategóriás lapokban van benne, vagyis mindbe benne van csak nem lehet állítani mert meg sem jelenik az opció.

[ Szerkesztve ]

-

Abu85

HÁZIGAZDA

válasz

Petykemano

#74

üzenetére

Petykemano

#74

üzenetére

Pedig mindig megkülönböztetik, csak azok a specifikációk nem látnak napvilágot.

A GDDR5 memória fogyasztása a felhasznált lapkáktól függ, nem igazán a GB-októl. 8 GB-ot lehet 8 vagy 16 lapkával is csinálni és a fogyasztás közel sem lesz ugyanannyi. A HBM1 lapkánként ~2 wattot eszik.[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

GeryFlash

veterán

Abu, GDDR5 jellemzően mennyit eszik lapkánként?

Hi, i'm new to APHEX TWIN, so i was wondering how much the IQ requirements was to enjoy his stuff. and understand all the underlying themes, because its really complex stuff. I have IQ of 119 but i heard that you need atleast 120 is it true?

-

Gpety

tag

Azért nem hinném, hogy visszahívás lenne, ennyire nem bolondok az AMD-nél sem, biztos vagyok, hogy probléma mentesek lesznek a Rx480-ok ilyen téren. Az már annál inkább gáz, hogy erős csíkszélességváltással is csak ennyire tud takarékos lenni a lapka az előző generációhoz képest. Az Nvidia csikszélesség váltás nélkül nagyobbat lépett a Kepler-Maxwell átálláskor, nem beszélve a 16nm-es Pascal-ról.

Szóval szuper ez a GCN csak a gyakorlatban van tonnányi hátránya és nagyon kevés előnye.Intel Xeon X5650, 12Gb RAM, RX480 8Gb

-

westlake

félisten

Én ezen nem csodálkozom egyáltalán. Az NVIDIA kártyáknak is a BIOS-ába van szabályozva, hogy egy adott csatlakozón mekkora fogyasztás engedhető át.

Egyébként a cikkben is, meg a hozzászólásokban is van nem egy pontatlanság, vagy éppen túlzás. Ha már nem telefonról leszek, akkor majd kifejtem bővebben.

[ Szerkesztve ]

Play nice!

-

Malibutomi

nagyúr

Good point az OCUK forumon.

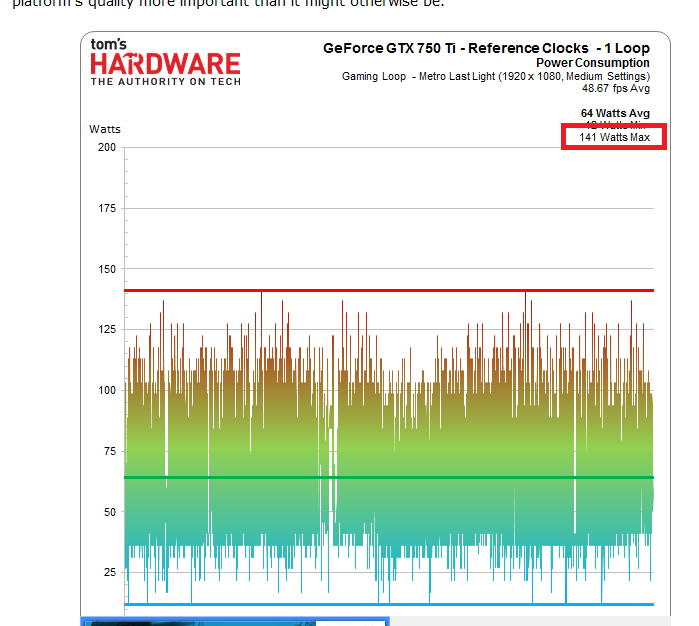

A Tomshardware-t meg ugy senkit miert nem zavart amikor a tapcsati nelkuli 750Ti 100+W-okat rangatott be a PCIE slotbol?

Ott nem voltak ilyen sasszemek meg ugy latszik.

[ Szerkesztve ]

-

#85552128

törölt tag

válasz

Malibutomi

#91

üzenetére

Malibutomi

#91

üzenetére

64 Watts avg. itt sem a tüskéket/peak értéket sokallják...

[ Szerkesztve ]

-

Gpety

tag

Ez az, amit már nem hiszek el sajnos. Igazából az Ashes of the Singulaity az AMD-é és ennyi. Az Rx480 nagy előrelépés a korábbi átnevezés halmozáshoz képest, de nincs meg az átütő erő, meg a fene nagy innováció gyakorlati eredménye. Jó, hogy a nagyon rossz teljesítmény/fogyasztás mutatón javítani tudtak, de a 14nm miatt ettől sokkal többet vártam. Persze az is igaz, hogy az AMD-nek esze ágában nem volt most kiadni ezt a VGA-t, csak az Nvidia Pascal prezentációja után a partnerei döngették az ajtót, hogy felébredjenek többéves álmukból. Ebből adódóan lehet nem így akarták ezt, hanem jobban optimalizálták volna.

Intel Xeon X5650, 12Gb RAM, RX480 8Gb

-

Reggie0

félisten

válasz

Malibutomi

#91

üzenetére

Malibutomi

#91

üzenetére

Miert zavart volna? A csatlakozo melegedeset es igy a megengedett legnagyobb terhelest az atlag hatarozza meg(azaz pontosabban a negyzetes atlag aram negyzetgyoke). Az altalad linkelt abran ez 64W. Viszont itt van az RX480 mert eredmenye, aminel mar az atlag is boven 150W folott van:

De csak peldanak: amikor megfogod a kilincset es megraz, annak a kisulesnek olyan 60000 Watt a csucsteljesitmenye, megsem halsz meg(mert annyira rovid ideig tart).

[ Szerkesztve ]

-

Abu85

HÁZIGAZDA

Nem tudom, hogy az AotS miért az AMD-é, elég sok NV optimalizálás van benne. Azért megy jobban AMD-n, mert nagyon rátervezték az architektúrát az explicit API-k limitjeire, így például a tök szabványos multi-engine és multi-thread kódtól az AMD jobban gyorsul.

Az Aots már csak azért is példás gyártói szemszögből, mert Dan Baker nem fogad el gyártóspecifikus optimalizálást. Ezt csak azért emelem ki, mert például az új Doom Vulkan kódja és az új Deus Ex DX12-es kódja tele lesz GPUOpen shader intrinsic-kel, amelyek nem hogy gyártóspecifikusak, de még az API-kban sincsenek specifikálva. Egyszerűen az AMD kiterjesztett HLSL ext. és SPIR-V fordítóján juttathatók el a kódok kizárólag az AMD GPU-kra. Ha az AotS az AMD-é, akkor ezekre a játékokra mit mondunk?[ Szerkesztve ]

Senki sem dől be a hivatalos szóvivőnek, de mindenki hisz egy meg nem nevezett forrásnak.

-

-

Egon

nagyúr

Ha az AotS az AMD-é, akkor ezekre a játékokra mit mondunk?

Ez attól függ, kit kérdezel. Egy jó pár emberke szerint, ha valamely nV-exkluzív került volna beléjük, akkor "rohattnVmegvetteafejlesztőketkilóra", így viszont "innovatívAMD" mantra jöhet - mintha nem tudnád...

Az MS gondoskodott róla, hogy a PC-s játékpiac a lehető legkisebb veszélyt jelentsen a gagyiboxukra - sajnos "kicsit" túllőttek a célon, és némileg saját magukat is sikerült t*k*n lőniük - mit mondjak, rájuk fért)."Bonyolult kérdésre egyszerű választ keresni helyénvaló, de ritkán célravezető megoldás" (Wayne Chapman)

-

Gpety

tag

Úgy értettem, hogy az AMD-é, hogy ott nyernek a Radeonok, kétségtelenül. A Vulkan-nak nagy jelentőséget én nem tulajdonítok, épp úgy ahogy tudtam, hogy a Mantle se lesz abban az állapotában hosszú életű. Jó ötlet volt a nagyon rossz anyagi körülményektől szenvedő AMD-nek, hogy ingyen kukázta és kiadta külsősnek, így legalább már nem csak GCN-en megy. Viszont a Dx 12 a lényeg. Nem azért mert a Vulkan rossz, hanem mert nem a farok csóválja a kutyát. Épp ezért nem feltétlen rosszak az AMD újításai, de időről időre bebizonyosodik, hogy nem ők a piac mozgató rugói, ha az Nvidia nem azt akarja, amit ők, akkor bizony a játékokban a Radeonok alul maradnak. Ugyan ez igaz a CPU-kra is, az FX-ek akkora bukták a gyenge szálankénti teljesítménnyel, hogy még az AMD sem törte már magát, hogy mondjuk kisebb csíkszéllel kiadja azokat vagy két éve. Nem azért rosszak, mert nem lehetne több szálra masszívan fejleszteni (jó, a Dx10 és 11 ennek nagyon ellene volt), de az Intel a király, ő fog diktálni, márpedig az i5-ök "csak" 4 magosak. GPU-knál pedig az Nvidia sokat számít. Amúgy is sz@r a PC-s szegmens piaci helyzete, olyat nem tehet meg egy kiadó sem, hogy masszívan vagy egyik, vagy másik gyártónak kedvez, legfeljebb érezhetően, látványosan, de Dx12 alatt sem kell félnie az Nvidianak. Sőt, ha a Vega csak annyira lesz jó, mint most a Polaris, akkor az AMD dörzsölheti a fejét.

Intel Xeon X5650, 12Gb RAM, RX480 8Gb

Új hozzászólás Aktív témák

ph Utánajártunk a PCI-SIG-nél, hogy miképp működik egy PCI Express interfészt támogató VGA hitelesítése.

- Kerékpárosok, bringások ide!

- Cyberpunk 2077

- Samsung LCD és LED TV-k

- Milyen videókártyát?

- Telekom otthoni szolgáltatások (TV, internet, telefon)

- Politika

- Milyen CPU léghűtést vegyek?

- ubyegon2: Airfryer XL XXL forrólevegős sütő gyakorlati tanácsok, ötletek, receptek

- Projektor topic

- iPhone topik

- További aktív témák...

![;]](http://cdn.rios.hu/dl/s/v1.gif)

Ja, végülis "csak" 150W-ot szállít a 8pines, szemben a 6-os 75W-jával

Ja, végülis "csak" 150W-ot szállít a 8pines, szemben a 6-os 75W-jával

? Ehhez az alaplap biosába kéne csúnyán beletúrnia a karinak, ha egyáltalán "szoftveresen" állíthatók a feszültségek

? Ehhez az alaplap biosába kéne csúnyán beletúrnia a karinak, ha egyáltalán "szoftveresen" állíthatók a feszültségek Az áramerősség persze más kérdés, az "igény" szerint folyik, de ha speckó felettit "kér a fogyasztó" vagy leadja a lap, vagy nem.

Az áramerősség persze más kérdés, az "igény" szerint folyik, de ha speckó felettit "kér a fogyasztó" vagy leadja a lap, vagy nem.