- Ezek a OnePlus 12 és 12R európai árai

- Fotók, videók mobillal

- Android alkalmazások - szoftver kibeszélő topik

- Megérkezett a Google Pixel 7 és 7 Pro

- iPhone topik

- Mobil flották

- Május végéig befut a Magic OS 8.0 a Honor 90-re és Magic V2-re

- Samsung Galaxy S23 Ultra - non plus ultra

- Xiaomi 11 Lite 5G NE (lisa)

- OnePlus 7 - magabiztos folytatás

Hirdetés

-

NVIDIA: a következő nagy dolog az AI-generálta videó

it Az NVIDIA vezérigazgatója szerint még nagyobb keresletet hoznak majd a chipjeik iránt az AI által generált videók. Pedig nagy baj nincs, legutóbb így is 200 milliárd dollárral nőtt a cég piaci értéke a kedvező tőzsdei hangulat miatt.

-

Retro Kocka Kuckó 2024

lo Megint eltelt egy esztendő, ezért mögyünk retrokockulni Vásárhelyre! Gyere velünk gyereknapon!

-

Ilyen lehet a Samsung Galaxy Watch7 Ultra

ma Renderképek mutatják meg a Samsung júliusban megjelenő új felső kategóriás okosóráját.

Új hozzászólás Aktív témák

-

BeZol

őstag

válasz

Alvin_ti4200

#123

üzenetére

Alvin_ti4200

#123

üzenetére

HA RTX OFF + játékverzió is megegyezne (egyikben sem vagyok biztos), akkor a teaser alapján

+

ebből a 12900K + RTX 3090 Ti benchből kiindulva: [link]+ amit a fentebb linkelt benchvideó alapján leszűrtem az az, hogy 120-130fps környékénél pl. 1080p native-ban 70% körüli a 3090 Ti gpu-kihasználtsága, szóval a Cyberpunk optimalizáltságból kifolyólag "1-szálas teljesítmény-alapú cpu-limit" van ennyi fps-nél, amit a marketinganyag alapján a DLSS 3 meg tud szüntetni, és a 2 alsóbb kép alapján sikerül is neki az extra frame-ek gyártásával 200-210 fps-re feltornászni.

Ugyanakkor a natív 4K RTX OFF RTX 3090 Ti 40-45 fps kontra RTX 4090 50-55 fps az csupán 30-40% előrelépés lenne, amit keveslek, így a hozzászólásom legelső mondatához vissza is kanyarodnék, vagy szimplán elszámoltam vmit.

-

BeZol

őstag

Nem Flight Sim-ezek, de ebben a benchben 50-52fps körül fityeg a 3090 Ti: [link]

A "hivatalos" videóban pedig 65fps körül a 4090, ami így megint +30-40%-ot eredményez DLSS-csodák nélkül.Majd az agyonpixelezett DLSS 3 benchek alapján meglátjuk, van-e értelme, mert engem az eddigi DLSS-ek nem győztek meg, sőőőt, csalásnak érzem

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

BeZol

őstag

válasz

Alvin_ti4200

#476

üzenetére

Alvin_ti4200

#476

üzenetére

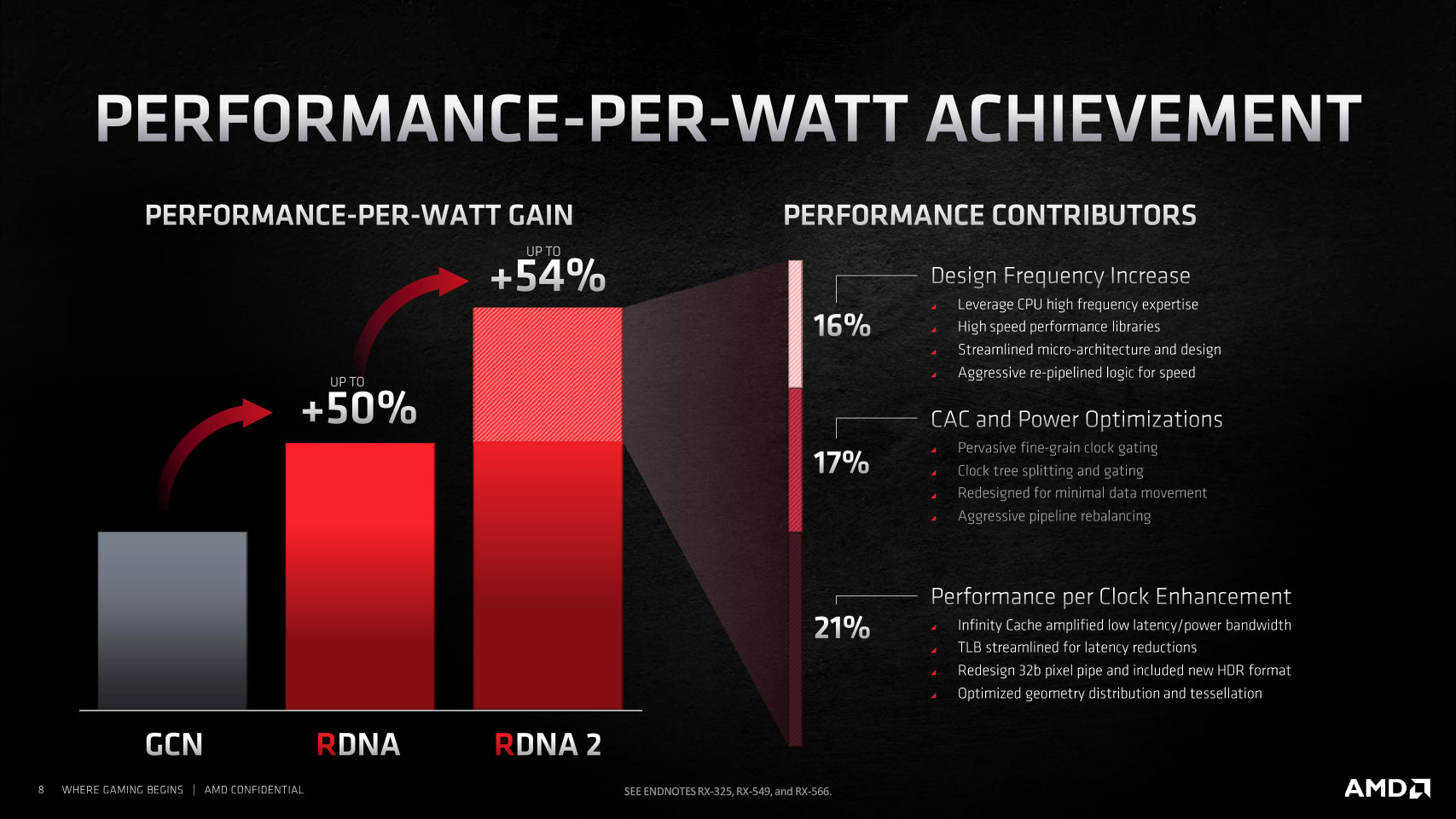

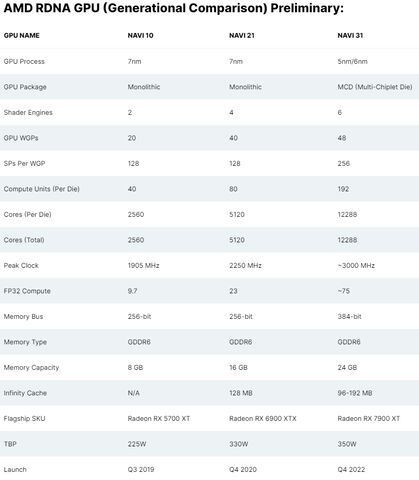

1. AMD RX 6900 XT bemutatója 2020. okt. 28-as videóból: [link]

Itt +65% perf/W-ot claimeltek.2. 2020. dec. 8-adikai review-k hivatalos anyaga már csak +54%,

így lett összességében a korábi RX 5700 XT-hez képest 4K alatt 2xer erősebb

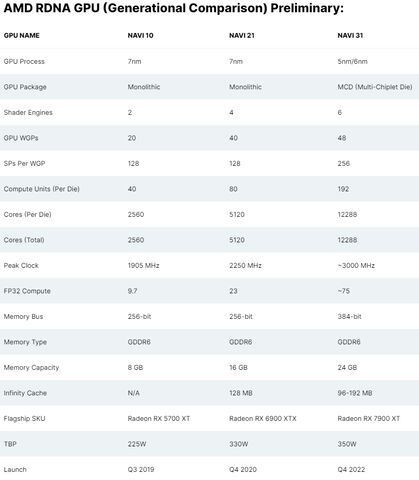

(5700 XT 40cu, 6900 XT 80 cu, szóval gyakorlatilag is 2x annyi anyag van benne):

A fogyasztás 36,5%-kal növekedett, de szépen skáláznak 326W-ig, szóval ez csak gyári korlátozás miatt ennyi. (5700 XT ami ref kártya járt anno nálam, azt kb. 160-180W-ra feszelve tudtam csak használni 10% teljesítménybuktával, egyébként throttlingolt. Ezek tehát gyárilag túl voltak hergelve)

A legutóbbi pletykák alapján most nem 2xer annyi cucc lesz a next gen-jükben, hanem 2,5xer annyi cucc, mellette pedig majdnem 4GHz-re OC-zhatóak (mostaniak stabilan 2550+MHz-re, jobbak 2800MHz környékére, extrém OC-zva 3GHz is megvan), kérdés hova lövik be a TDP-keretet. Tehát lesarkítva legyen 3,5GHz és így +40% órajel, ami mellé 2,5xer annyi cucc. A kettő eredője 3,5x teljesítmény lenne.

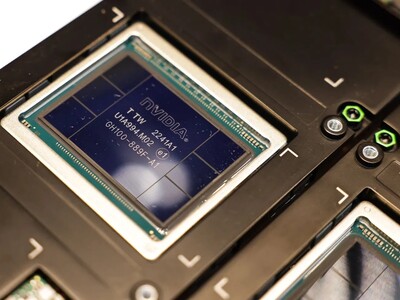

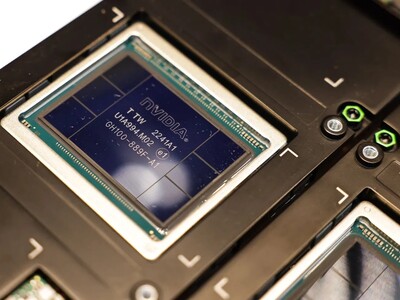

RTX 4090-esnél viszont már tudni, hogy a gyakorlatban 2,8GHz körüli boost-on járnak 450W-ból (sima FE kártya).

Az RTX 3090 Ti (FE-kártya) 1979MHz-et tartja 450W-ból. [link]

Ez +41,4% gpu-órajelben, tehát azonos 10.752 db cuda core-al ennyivel lenne erősebb a 4090.

Az RTX 4090-esben viszont 16.384 db cuda core van, ami további +52,4%-ra adna lehetőséget.

A kettő eredője lenne 2,15x teljesítmény, ami esélyesen 800W körülből lenne meg![;]](//cdn.rios.hu/dl/s/v1.gif)

Szóval sztem megöli a bulit a TDP-keret, ezért is várom nagyon a 600W-os OC-példányokat.Az AMD-nél viszont 3,5x-re jött ki az elméleti matek.

Itt ugyanakkor bemutatnám az RX 6700 XT vs RX 6900 XT esetét:

"Cucc" ügyileg 2560 vs 5120 --> 2x a 6900 XT-nek

Órajelben 1,15x a 6700 XT-nek.

Az eredőjük alapján elméletben +74% a 6900 XT-nek.

És ebből lesz 4k-ban 1,53x [link] a 6900 XT-nek. (1440p-ben 1,39x)

A fogyasztás 221W vs 299W (+41,7%).

Tehát az elméleti matek 2/3-a ha teljesül szérián belül!

Szimplán ez alapján a 3,5x elméleti gyorsulás 2/3-át véve 2,67x-re csorbulunk.

A fogyasztási arányokat nézve olyan kb. +65% áram kellene (2,5xer annyi cucchoz) ehhez a 2,67x-hez, tehát 299W helyett 493W-ról beszélnénk.

A 7nm kontra 5nm előnye az "azonos helyre több fér el" mellett a magasabb órajel és/vagy azonos teljesítmény mellett kisebb fogyasztás, és mivel az órajelet kvázi tudjuk (3,5GHz+), ezért itt kb. ez a gyártási előny nagy része. Itt is a TDP-kereten múlik majd a dolog, de így a fentiekből következtetve ha AMD is elmenne 450W+-ra, akkor egy 2,5x összehozhatónak tűnik, vagy egy 2x 350-400W között.Másik megközelítés +50% perf/W alapján (ami azonos RDNA vs RDNA2-re nézve is, nem csak RDNA 2 vs RDNA 3-ra nézve).

6900 XT tudást 299W helyett 200W-ból kéne tudniuk.

Egy másik review alapján az 5700 XT 210W (és nem 221W), a 6700 XT 221W, és itt 33%-kal erősebb a 6700 XT, szóval sehogy sem jön ki a marketingelt +54% perf/W, hanem ismét csak a 2/3-a!

Ha egy ilyen általános 33%-kal számolunk, akkor 299W-ból 6900 XT *1,33x teljesítményt kéne kapnunk. Innentől marad a TDP-keret kérdése.

6700 XT vs 6900 XT-z néve kb. amennyivel nőtt a fogyi, annyival nőtt a teljesítmény (úgy, hogy közben 2x cucc volt a 6900 XT-ben, na most RDNA 3 esetén 2,5x cucc lesz).

Tehát ha 299W-ről felküldik a next gen AMD-t 450W-ra, akkor 1,33x * 1,5x --> 1,995x teljesítményt kapunk így, kerekítsük 2x teljesítményre

5700 XT vs 6600 XT NVIDIA módra: (ugyanolyan erős a next genjük)

RTX 2080 Ti - 4352 cuda core, 1824MHz average gpu clock, 273W

RTX 3070 - 5888 cuda core, 1882MHz average gpu clock, 220W

--> +35% cuda core, +3% gpu-órajel, 80%-nyi fogyasztással --> 1,35*1,03*0,8 = +11,24% teljesítményt kellene hoznia a 3070-nek 220W-ból, ehelyett egyforma erősek.

(RTX 3090 Ti vs RTX 4090: 1,52*1,41*1 = 2,14x, ezt leosztva 1,1124-el 1,93x-et kapunk)

November végére kiderül mely forgatókönyvek futnak be.3. 2020. okt. 28 és dec. 8 között bő 1 hónap eltelt ÉS alig volt készletük Nvidia-hoz képest.

4. Legutóbbi pletyka alapján a 2022. nov. 3. csak bemutatás mint anno az okt. 28, kapható nov. 20 utántól lehet, DE a lentiekből

nekem az jön le, hogy lesz pár ref kártya, a custom verziókra meg még lehet várni +1 hónapot.

A mostani ref kártyák OC-potenciálja 0% közeli (inkább csak alulfeszelve OC-zható, amit finomhangolásnak neveznék csak), de out of the box teszik a dolgukat mint Nvidia FE kártyái.5. 6800/6800XT/6900XT (ugyanaz a chip) eléggé rendesen coil whine-ol az összes saját tapasztalatok alapján (1db ref 6800, 1db ref 6800 xt, 1db sapphire nitro+ 6800 xt, 1db gigabyte aourus 6800 xt, 2db ref 6900 xt, 2db red devil 6900 xt, 1db red devil ultimate 6900 xt, 3db asrock oc formula 6900 xt). Ugyanez Nvidia oldalról csak Asus TUF és ROG Strix karikkal jött elő nálam (1db TUF 3060 Ti, 4db Strix 3080/3080Ti + 1db White Strix 3080), de 3 kivétel is volt ASUS-on belül (1db TUF 3070 és 2db TUF 3070 Ti), az AMD-nél viszont az összes nyomta a coil whine-t gyártótól függetlenül.

6. Szintén személyes tapasztalat, hogy igazából hiába nyerőbb az AMD játékra ár/teljesítmény alapján, szinte minden ismerős megbánta h AMD-t vett.

A fenti cw is zavaró, de ha épp nem brutál hangos, akkor simán élhető. (rendszerfüggő)

A fő-fő probléma az AMD-kártyákkal a szoftveres helyzet:

- Multi-monitor setupokkal szokott komplikáció lenni már akár sima youtube-ozáskor is.

- Jön egy új WHQL driver, és simán lehet h xy játék onnantől crashelget vagy akadozik..., de egy újabb játék miatt viszont tényleg kellene ez a driver, a régi játék miatt meg a korábbira kéne visszamenni...

- Random driver crashek akár simán netezés közben is.+1 hardveres:

- GPU-hotspot problémás darabok amik gyárilag 100 fok hot-spotot produkálnak, így custom kártya esetén OC-zhatóság kuka, DE 110 fokig AMD-szerint nem probléma és nincs gariztatás. (cserébe RTX 3xxx-eknél meg GDDR6X hőfok-problémák vannak)Én azt mondom a fentiekre, h még ezekkel is együtt lehet élni, DE számomra az igazán nyomós ok arra, h miért nem érdemes AMD-t venni az az, hogy a játékfejlesztők részéről sincsen elég szoftveres támogatás.

Van, akiknek a COD: Warzone a mindene, és egyik patch utántól micro-stutterezett nekik az egész.

Van, aki csak PUBG-zne, és az 1% low fps-ek alapján is be-beakad a játék, ami irritáló ha amúgy bőven megvan az fps.

Most meg épp Apex Legends-el is vannak problémák ahogy olvasom.

Ezek kérem szépen nagyobb AAA játékok amikkel rengetegen játszanak napi szinten, és sokszor hónapokig nincsen megoldás 1-1 problémára!!! Mi lehet a többi játéknál?

--->

Ezek után az AMD csupán 1 okból várós: árverseny miatt.

Elvileg jóval olcsóbb gyártani az AMD-kártyákat (mert kisebbek a chipek és nincs drága GDDR6X memória), erre most a chiplet design rádob majd még1 lapáttal (olcsóság irányába), ugyanakkor a chiplet design miatt én további szoftveres anomáliákat várnék...

(ráadás: az első ryzen procik sem voltak jók játékra )

)Egy szó mint száz, akinek fontos a rendszere stabilitása és nem akar minden héten vmi miatt kiakadni, az jobb ha Intel konfigot dob össze Nvidia videókártyával még akkor is, ha éppen ár/teljesítményben egy AMD konfig adná ki. (+1 a ray-tracing miatt az Nvidia-ra)

Megszűnnek a ráncok, kisimul az arc és rájön az ember, hogy jé, lehet ezt így is?

Lehet!

-

BeZol

őstag

válasz

zebra_hun

#492

üzenetére

zebra_hun

#492

üzenetére

+ Jacek

yagami01:

- 1 hetes sztori: áramszünet után nem indult el a gép csak 10ből 1xer. BIOS-ig sem jutottam, sárga DRAM LED világított.

BIOS flashelés oldotta meg...

- több hónapos sztori: az atomstabil memória tuning 1,5 év alatt már 2 lépcsőnyit degradálódott és most már tényleg csak a 3600MHz-en stabil, holott 3667, előtte pedig 3733MHz is stabil volt... (tudom, mert cpu-bányával ment 0-24 és az fclk zavar be)

8700K és 10900K konfigjaimnál nem voltak ilyenek.

Az pedig, amikor PBO-val eljátszol h lenagyobb boost-jaid legyenek és minden bench stabil, majd windows egyszer csak megfagy, az meg konkrétan szánalmas.

Az egyetlen ok, ami miatt (én) amd-procit (7900X3D v. 7950X3D januárban) veszek a jövőben is az, hogy cpu-bányászatban fényévekkel jobb, márpedig ha azonos összeg lenne mint egy intel konfig, de közben tud értelmesen termelni holtidőben (amikor épp megéri), akkor csakis emiatt AMD, egyébként Intel.Egy 4090 v. 7900 XT-hez pedig már 1440p miatt is kelleni fog egy next gen proci

[ Szerkesztve ]

-

BeZol

őstag

Egy videókártya 1 tápról kell menjen.

Lehetne 2tápos rendszered, de a 2. tápot akkor egy 2. videókártyába lehetne csak dugni.

Helytakarékossági okokból is megérősebb 1 nagy táp, én ezért is vettem 1 éve 1000W-osat, majd mivel egy dual-gpu-benchhez kevés volt, váltottam 1300W-ra.

Ami engem speciell meglepett a korábbi 750W-os tápomhoz képest, hogy az 1000W-os talán még ugyanakkora volt hosszúságra mint a régi 750W-osom, viszont az 1300W-osom az legalább 2 ujjnyival hosszabb, így a gépházam aljára már nem fér el a korábbi venti, ki kellett szerelnem, szóval érdemes nézelődés közben a hosszúságukat is figyelembe venni. -

BeZol

őstag

Amúgy az átalakítóra visszatérve, ott elvileg a 16os pintől indulgat el a "tűz", de ugyanilyenek a 16pinek egy újfajta ATX 3.0 tápon is

Mi a különbség? Sztem semmi...

Szóval ha átalakítóra 30-40 ki/bedugdosásos gari van (és ez is a 16pines rész miatt, nem a 3-4x8pin miatt), akkor a tápokhoz járó kábelen is ennyi ki/bedugdosásos gari lesz?

Tényleg nem tudom hova tenni a dolgot.

Sztem hülyeség az egész úgy ahogy van. -

BeZol

őstag

A 3090 Ti-ok is nagyobb dögök voltak már léghűtésügyileg.

(hosszúság * szélesség * magasság)

TUF 3080:

300 x 127 x 52 mm (2.7 slot)TUF 3090:

300 x 127 x 52 mm (2.7 slot)TUF 3090 Ti:

326 x 140.2 x 63 mm (3.2 slot)TUF 4090:

348.2 x 160 x 72.6 mm (3.65 slot)STRIX 4090:

358 x 149.3 x 70 mm (3.5 slot)Na a TUF 4090 még a nagyobb 3090 Ti hűtésnél is nagyobb lesz

![;]](//cdn.rios.hu/dl/s/v1.gif)

Részemről a TUF lenne a várósabb.

A 3xxx szériánál a TUF-okra lehetett a Strix-hez tartozó XOC BIOS-okat flashelni, így custom loop-ban gondolkodóknak nem muszáj Strix-et vennie (XOC BIOS miatt az is garibuktás lenne sztem).

Volt aki végignyálazta a marketinganyagokat a léghűtésekről?

Jól látom, hogy mindegyik vapor chamberes hűtést kap x mennyiségű hőcsővel?

Gondolom 3slotos verziók kerülendők, csak 3,5" slot körülit szabad "venni"...Olyat mint a Strix, hogy a vapor chamberbe bele van marva a hőcső, tud más gyártó is? Ez pedig akkor 3-5 fok előny talán?

(csak mert kb. az extra rgb és design-eltérésen kívül nem láttam különbséget)Aki egyébként izgulna a hőfokok miatt,

annak összehasonlításképp itt egy

TUF 3090 Ti videó gyári vs XOC BIOS-szal (440W környéke vs 550W környéke)Ventifordulatszám passz, videó elején karattyol venti%-okról, de nem tudom ez mekkora fordulatszám ennél a típusnál.

Szóval a szintén vapor chamberes TUF 3090 Ti tudta ezt a 450W+ hőmennyiséget kezelni, az új TUF 4090 pedig ugyanekkora 450W-os gyári TDP-vel érkezik,

csak mellé:

22 mm-el hosszabb

20 mm-el szélesebb

10 mm-el magasabb -

BeZol

őstag

Összedobtam egy Google sheetet a mai állapotok szerinti tudás alapján a 4090-esre vonatkozóan:

[link]Negatívan az MSI Gaming Trio lepett meg, hogy nincs vapor chambere, míg pl. a "gagyi" inno3d kártyáknak is van, pedig csak 3slotosak, és még a gigabyte-oknak is van.

Zotac Trinity-nek nincs, de ott nem is vártam volna el.

MSI-knél az sincsen, hogy középső venti ellentétesen forogna (kisebb zaj), még a Suprim-nál sem.Ilyen vapor chamberbe belemart hőcsöves sztorit pedig csak a Rog Strix-el kapcsolatosan olvastam, ami a youtube-os videó alapján még a vapor chamberes megoldáshoz képest is hoz további 3-5 fokot.

Szóval sima basic hűtés: x fok

Vapor chamberes hűtés: x - (4-5 fok)

Belemart heatpipe-os vapor chamberes hűtés: x - (4-5 fok) - (3-5 fok) = x - (7-10 fok)Ami még említésre méltó, hogy az MSI-knél 4szögletesek a heatpipe-ok a gpu feletti résznél, nem kör-alakúak.

A Gigabyte-okat pedig 4 év garancia-ára lehet regisztrálni (a sima Windforce-ot asszem nem).

Az átalakítóknál pedig olyat is találtam, ami csak 3x8pin to 1x16pin, szóval nem "alap" dolog, hogy 4x8pin to 1x16pin-es átalakító járjon a kártyához.

#################################################

Zotac Trinity vs AMP Extreme AIRO:

+ vapor chamber

+ több rgb

+ magasabb TDP-keretASUS TUF vs ROG STRIX:

+ hőcső belemarva a vapor chamberbe

+ több rgb

+ magasabb TDP-keretInno3d X3 OC vs iChill X3:

+ több rgbMSI Gaming Trio vs Suprim:

+ 2 extra hőcső (8 vs 10)

+ vapor chamberGigabyte Windforce vs Gaming OC:

+ kicsit nagyobb

+ több rgb

+ 1 extra hőcsőGigabyte Gaming OC vs Aorus Master:

+ kicsit nagyobb

+ több rgb és kijelzőKFA2 vs Palit GameRock: (kb. hasonló méretek)

+ ezerszer szebb design

+ vapor chamber

##################################################A spanyol webshopos sima TUF 4090 a best buy ezek alapján:

nagyobb kártya az átlagnál, vapor chamberje is van, ellentétesen is mozog a középső ventije, Strix BIOS-t később rárakni pedig valszeg lehetséges, úgyhogy vizes alanynak is tökéletes -

BeZol

őstag

válasz

Németh Péter

#690

üzenetére

Németh Péter

#690

üzenetére

Nyugi, a 3 slotos kártya is olyan, hogy fizikailag befér alá a 4. slotba egy 2. videókártya vagy bármiegyéb, de annyira közel lesz annak a hátlapja a legfelső videókártyád ventijeihez, hogy konkrétan elzárja a légáramlást és rongyosra throttlingolja magát!

Én úgy tapasztaltam, hogy legalább 0,5 slotnyi hely legyen ilyenkor köztük, az már akár vállalható hőfokügyileg.

-

BeZol

őstag

válasz

#65537792

#697

üzenetére

#65537792

#697

üzenetére

Intel Arc A770

hmmmm

talán ez a csúcs Intel gpu ami 2022 január végén kellett volna megérkezzen!!!

3070-nél gyengébb, vhol 3060 Ti szint lehet hasonló fogyasztással talán.

Driver-ügyileg évtizedekkel le vannak maradva, főleg directX 11 címek a para.Sok örömet és boldogságot a béta-tesztereknek

Árban pedig használt 3060 Ti-ok árában érkezik...

-

BeZol

őstag

Ha Taiwan-nal történne vmi, az jár jól, aki most veszi meg, mert később nem lesz legalább 2-3 évig semmi sem (se alaplap, se proci, se gpu, se memória).

Ha megvetted a 3090-est launchkor, akkor a bányászat miatt 2020 szept. 19 utántól egészen legalább 2021 decemberig drágábban adhattad el (magyar best buy elvileg 650k-ért ment Alza-n mint Gainward Phoenix GS RTX 3090-es 2020 októberben /egyébként 699k/).

Használt árakat nézve ez az árszint nagyjából talán 2022 májusig 0-ra kihozható lehetett

Ismétlem, bányászat miatt, de 1,5 évig ingyen lehetett videókártya nálad + bánya közben.

Bányászat csúcsán pedig 1misi-ért is mentek ezek.Ha visszatérnek a bányamentes idők (next gen lehet op lesz vmi coin-ra hatékonyságban...), akkor gondolom megint 2 év mire jön az újabb next gen, ezalatt esélyesen főleg az 1. év után lesz árcsökkentés (meg konkurencia érkezésénél), de a lényeg az, hogy ha legelején megveszed "teli árban", akkor 1 éven belül kisebb buktával el kéne tudni adni használtan.

Bármikor néztem régen bányamentes időben használt kártyákat így kb. 1 évvel launch után, mindig ilyen 80%-os ár környékén árulták őket, csak a next gen érkezése előtt fél évvel kezdtek az új árak érdemben lejjebb mászni (csökkentett új árak, és ennek a 2/3-a, tehát újkori ár fele már akár), az igazán durva árzuhanás pedig a next gen érkezése előtti hónaptól indult meg, lásd használt 3090-esek elmúlt 1-2 hónapban (550k -> 350k).

Szóval sztem ha az AMD nem húzza keresztbe az Nvidia árazását (elvileg anno GTX 980 árát lefelezte az AMD akkori új generációja), akkor 1 évig 20%-os buktával el lehet adni ezeket használtan, tehát kb. 400 EUR-nyi bukta, ami legyen 160-170ezer Ft. Ez havi 15ezer Ft. Ennyit megér, HA jók a tippjeim.

A fentiek miatt érdemes lehet még az AMD 7xxx radeonjait kivárni, mert lehet h az Nvidia árkorrekcióra szorul majd, és ezesetben csak ekkortól "szabad/érdemes" megvenni egy 4090-est.

-

BeZol

őstag

Legtöbbször a belső problémákról való elterelés okán (is) alakulnak ki ilyen nemzetközi dolgok, de remélem én is h nem lesz semmi.

Ugyanakkor most h épülnek a chipgyárak a "nyugati" világban, azok pár év múlva működőképesek lesznek (2+ év), és onnantól kezdve Taiwan "jolly joker" kártyája megszűnik, mert a Nyugatnak kvázi nem lesz miért megvédenie, hiszen nélküle is biztosított lesz a chip-ellátás, ami most kvázi hegemónia-ként ott összpontosul Taiwan-ban.Asimov könyvekben az "Alapítvány" helyzete volt ilyesmi.

-

BeZol

őstag

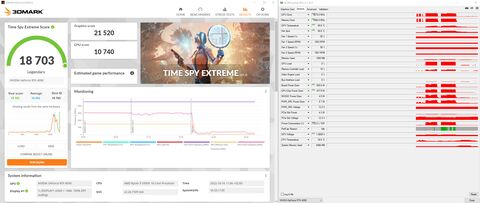

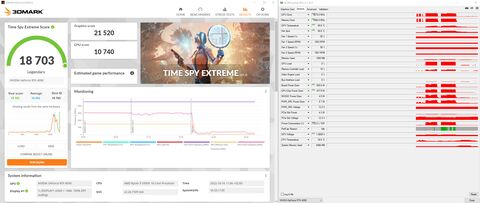

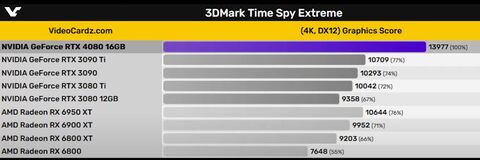

Ne sima Time Spy-hoz mérd, mert az 1440p bench és jó eséllyel cpu-limit lesz már a 4090-esnek benne. (kapásból pl. Graphics Test 1 legvégén)

Time Spy Extreme benchet nyomj és azzal hasonlítsd össze.

Eleve nem 1440p-re való a 4090 így a tesztek alapján, ez 4k-ra való.Egyébként meg lesarkítva 2x 3080 telljesítmény fixen mindenütt megvan ahol nincs cpu-limit (ami legtöbbször a játék sara ugye).

-

BeZol

őstag

Nézni nézheted, csak nem fair az összehasonlítás sima Time Spy alatt.

Nyugi, én sem mértem Time Spy Extreme-eket

Ja, hát így is 2x 3080 teljesítménye jön ki.

DLSS3-mal pedig majd tovább nő a gap.Ez egy olyan 4K kártya most, mint anno a GTX 1080 Ti volt 2017 tavaszán 1080p-re (mai napig szinte tökéletes 1080p-re!).

Árban használt 3080 a best buy 240 körül, újonnan viszont 380-400ezer Ft-tól indulnak.

Ha új kártyaként hasonlítjuk mindkettőt (hiába 2 éves a 3080), akkor a 2x teljesítményért 760-800ezer Ft-ért kéne tudni megvenni a 4090-est, DE

itt 24GB ram van,

van DLSS3,

van next gen Streamer engine AV1 kódolással (akinek fontos),

melóra is fele annyi idő alatt lerenderel dolgokat mint a 3090,

szépen alulkorlátozható RTX 3080 fogyira (és ez még nem is voltage/frequency curve-ös okoskodás),

és tulajdonképpen még a "legolcsóbb" FE kártya hűtése is "tökéletes", nem egy mostani FE 3080/3090 szint, vagy 2 slotos EVGA XC3 kategória, hanem teljesen jó.Szóval simán megér ezek alapján 800ezer Ft-nál többet is, DE csak azoknak, akik 4k-ban játszanak, mert ez már 4k-ban is tud proci-limitbe ütközni(ami egyben játékmotor-limit is ugye).

Ezek után könnyen "levágható", hogy mit tud majd a 4080 12GB (899 USD) és 4080 16GB (1199 USD) a 4090-hez képest (1599 USD), mert az előzetes leakek alapján ár/teljesítményben a 4090-es szintjét hozzák majd

Gyakorlatilag ár/teljesítményben a 3xxx széria 10GB 3080-asa fölé érkezik a fenti 3 kártya annyival drágábban, amennyivel erősebbek, csak egy minimális felár van csupán, annyival pedig tudnak többet.

Csak ennyi, hogy 1440p-re full felesleg a 4090.[ Szerkesztve ]

-

BeZol

őstag

13.977 a leakelt RTX 4080 16GB Time Spy Extreme Graphics Score-ja,

tehát +24%-ot verni fog a 3090 Ti-ra, ami 11.300 GS,

a 3080-ashoz képest (8.909 GS), +57% teljesítmény lesz.A 12GB-os RTX 4080 pedig a CUDA magszámokat arányosítva 11.037 GS-t fog összehozni, tehát sima 3090-est üti majd, a 3090 Ti-t pedig pont nem, DE nem is fogyaszt majd 450W-ot ekkor. Ez pedig +24% teljesítmény 3080-hoz képest.

A 3080 Ti kb. +10%, a 3090 pedig +15% a 3080-hoz képest "nagyjából".Ha a 699 USD 3080-ast nézzük a 899 USD 4080 12GB-hoz, akkor pedig +28,6% felárért kapunk +24% teljesítményt.

Szóval minden marad a régiben, az erősebb kártyák feljebb lettek árazva annyival, amennyivel gyorsabbak.

Sztem teljesen jó minden (csak sok pénz ugye)

[ Szerkesztve ]

-

BeZol

őstag

1450rpm-en ment az FE kártya, nem hinném h hangos lenne, szóval ha csak a halkság miatt kellene a Suprim, akkor totál felesleges (alapvetően ez nálam a legfontosabb).

Ha OC miatt kell a Suprim, akkor megint felesleges, mert +10% teljesítményt tudnak 600W-on a 450W-hoz képest, tehát a skálázódás nem túl jó (optimum tech videóban van OC).

Marad a kártya designja mint vásárlási ok, de ennyi felárat nem ér a Suprim.

Holnap igyekszem TUF 4090-est venni ha nem változik az ára, de ha nem sikerülne, akkor bármelyik 4090-es megteszi, főleg ha azt nézzük, hogy 4K-ra is lehet overkill a kártya bizonyos címekben, és ha 300W-ra bekorlátozod a 450W-ról, akkor buktál 15% teljesítményt kb., na bumm. Simán "oké", bár így akkor elég egy 4080 16GB. -

BeZol

őstag

válasz

abridabri

#1253

üzenetére

abridabri

#1253

üzenetére

Ez procikra is igaz, nálam 5950X all core 4.5-4.7GHz közé belőve 240W fogyi multi-terhelésnél.

Ugyanez 4GHz-en 100-120W, tehát megér +100% fogyasztást a +15% teljesítmény? Alapvetően nem

RX 6900 XT is szépen alulfeszelhető, és a gyári 280W környéke helyett 200W-ra levíve is 1,5xer erősebb a 200W-os 6700 XT-nél Legalábbis ilyesmi rémlik

Legalábbis ilyesmi rémlik -

BeZol

őstag

válasz

Találtgyerek

#1260

üzenetére

Találtgyerek

#1260

üzenetére

Még nem tudom, mert most is mozogtak tegnaphoz képest az árak...

-

BeZol

őstag

Mivel elég future proof-nak tűnnek a 4090-esek, ezért Gigabyte Gaming OC vagy Aourus-t lehetne érdemes nézni 4 év garira regelve. (sima windforce-nál 3év sztem)

Vagy egy Zotac-ot, ha most is él a 3+2 év garancia.

"Overview to the ZOTAC Product type

Graphics Cards (GeForce RTX 30 Series and later)

· Standard Warranty: 3 years

· Extended Warranty: 2 years

· Total Warranty: 5 years total" -

BeZol

őstag

Több tesztet is átrágva azért tud mindegyik RTX 4090 kb. +10% OC-t összehozni, mert a gyári feszlimit 1,05V, és emellett 450W körülnél többet nem fog bekajolni, szóval a gyári 450W-os TDP-keretet hiába tolod 500+W-ra (mondjuk 600W-ra, ha adott típus engedi), akkor is vége a bulinak 450W körülnél, ezért a feszültséget is ki kell tolni!

Der8auer videójában a gyári 450W inkább 430W (1,05V-on), és 480W OC-zva (1,1V-ra tekerve a TDP-feltekerésen túl).

Szóval itt jelenleg 500W körül vége, de ugye kapunk cserébe 9% körüli OC-t, úgyhogy fene tudja mennyire lineárisan skálázódik, de ha jön majd voltage-mod hozzá, hogy 600W-ot ehessen mondjuk 1,2V mellett, akkor "akár" további +20% is meglehetne elméleti síkon persze, aztán fene tudja.

Agyonhűtve 22.702 Graphics Score-t már tudnak Time Spy Extreme-ben

![;]](//cdn.rios.hu/dl/s/v1.gif)

-

BeZol

őstag

válasz

ForRedGlory

#1657

üzenetére

ForRedGlory

#1657

üzenetére

--> tehát ezeknek fixen az van.

Compatibility Eiswolf 2 & ES Block:

- NVIDIA RTX 4090 Graphics Cards in Reference Design

- INNO3D GeForce RTX 4090 iCHILL X3 OC (N40903-246XX-18332989)

- INNO3D GeForce RTX 4090 iCHILL X3 (C40903-246XX-1833VA47)

- INNO3D GeForce RTX 4090 iCHILL Frostbite (C4090-246XX-1833FB)

- INNO3D GeForce RTX 4090 iCHILL Black (C4090-246XX-18330005) -

BeZol

őstag

Gainward Phantom GS RTX 4090 STOCK: (5950X all core 4.6GHz-en)

Time Spy Extreme: 19.370 Graphics Score

Itt már a gyári 1,05V mellett van TDP-limit is (zöld), nem csak voltage limit (kék).

Graphics Test 2 során ez a 2760MHz környéke helyett 2640MHz környékére megy le (ott ahol látni h lejjebb ment a diagramm). -

BeZol

őstag

válasz

Találtgyerek

#1814

üzenetére

Találtgyerek

#1814

üzenetére

Kitámasztót passz, hogy hogyan kéne "rendesen" haszálni, bár nálam olyan sokat nem oszt nem szoroz.

Jacek:

egyelőre TDP-limitelek 495+W-tól (max. 516W), ezért nem tudja tartani a +150-es gpu-clock-offsettel a 2970MHz környékét és lecsorog (+1000-res memória miatt is, hiszen eszi az is a TDP-keretet) 1.0V-ra is, ami mellett 2820MHz-en megy.Kéne neki egy Strix bios

![;]](//cdn.rios.hu/dl/s/v1.gif) , mert hőfokok fix. 50%os ventikkel (1950rpm) is nevetségesek.

, mert hőfokok fix. 50%os ventikkel (1950rpm) is nevetségesek. -

-

BeZol

őstag

válasz

kevike576

#1829

üzenetére

kevike576

#1829

üzenetére

Nagynak nagy ház az biztos

Nekem csalódás, mert nem fér el 420-as víz a tetején (csak bemókolva).

Továbbá fent az alaplap teteje és a gépház tetejének az alja között jobb házakban van extra 2 ujjnyi vastag sáv. Itt nincs. (emiatt ventiből és radiátorból sem fér ide akármi).Szóval ekkora méret mellett ilyen hibákat csinálni, tök gáz, szívem szerint felgyújtottam volna mikor ez kiderült.

-

BeZol

őstag

Ez lett a Time Spy Extreme teteje:

Gainward Phantom GS RTX 4090 OC-zva

510W körül elfogy a TDP-keret (+11% adható a GS-nek, non-GS-nek gondolom semennyi).

Tehát ezzel a kártyával nem feszlimit van egyelőre, hanem TDP-limit.Memória +1400-ig stabil, +1450 már nem.

GPU-nak +260-at adtam, +275 már elhasal.Alapvetően

Grapihcs Test 1-ben: 1.05V - 1.075V

Graphics Test 2-ben (ez durvábban terhel): 1.0V - 1.05V között fityeg a kártya

Tehát ezekhez a feszekhez tartozó max órajelet kell kitapasztalni (majd ha lesz frissebb MSI Afterburner ÉS lehet BIOS-okat flashelni)MSI Afterburnerben a voltage/frequency curve-öt azért nem érdemes állítani, mert a skálázás teteje 3000MHz, a 4090 pedig 3100+MHz-et is tud.

Szóval amint belenyúlsz kézzel, kilapítja a tetejét 3000MHz-en.Na ezért nincs értelme belenyúlni, és ezért lassulnak be ezek a kártyák így ahhoz képest, mintha x mértékű offsetet adnál.

Tehát szükség lenne egy újabb MSI Afterburner-re.

Szükség lenne egy frissebb GPU-Z-re amivel ki lehet menteni a BIOS-t,

és szükség lenne nvflash64-ből olyanra, ami felismeri a videókártyát.Holnap esetleg megnézem linux alatt, hátha úgy mükszik a mostani nvflash64, de mára ennyi.

Másik 2 kolléga hajrá, jöjjenek a TSE benchek, nálatok magasabb a TDP-keret, csak eddig egyikőtök sem emelt a feszültség csúszkán...

-

BeZol

őstag

válasz

Találtgyerek

#1859

üzenetére

Találtgyerek

#1859

üzenetére

Vmiért GPU-Z nem mutatta, de HWINFO64 mutatja, majd holnap rakok be róla képet, ill. majd nekilátok Undervolt-os méréseknek.

-

BeZol

őstag

RTX 3080 vs RTX 4090:

CUDA CORES: 8.704 vs 16.384 --> 1,88x

GPU-CLOCK (valós): 1900MHz környéke vs 2740MHz környéke --> 1,44x---> 1,88 * 1,44 = 2,7x

Mostanra tudjuk, hogy nem 2,7-szer gyorsabb a 4090 a 3080-nál, hanem "csak" 2xer gyorsabb, mindezt 350W helyett 450W-ból.

Tehát a potenciáls gyorsulásnak a 74%-a valósult meg. (2x / 2,7x)

#########################################################

Enermax leak alapján RTX 4090-hez hasonló fogyasztásúak lesznek az AMD-k is:

NVIDIA GeForce RTX 4090 (733W)

NVIDIA GeForce RTX 4080 (600W)

NVIDIA GeForce RTX 4070 (565W)

NVIDIA GeForce RTX 4060 (478W)

AMD Radeon RX 7950 XT (702W)

AMD Radeon RX 7900 XT (610W)

AMD Radeon RX 7800 XT (580W)

AMD Radeon RX 7700 XT (478W)#########################################################

Most már ugye létezik 6950XT is, lehet h az utódja 7950XT lesz, igazából én most 6900XT vs 7900XT-t írok, mert a nyers számok a lényeg.

#########################################################

RX 6900 XT vs RX 7900 XT:

Cores: 5.120 vs 12.288 --> 2,4x

GPU-CLOCK: 2280-2495MHz (ref-től ultimate chipes gyári OC-s ig) vs 4GHz alatt --> számoljunk Nvidia-hoz hasonló 1,44x gyorsulással.--> 2,4 * 1,44 = 3,46x

HA itt is a potenciális gyorsulás 74%-a valósulna meg (Nvidia 8nm-ről ment 4nm-re, AMD 7nm-ről megy 5nm-re, szóval AMD-nél ez az érték kisebb kéne legyen sztem), akkor a jelenlegi csúcs RX 6xxx AMD-videókártyához képest 2,56x gyorsulás várható.

ÉS akkor ez egy optimista becslés részemről, továbbá az eredeti pletykák is 2,5x gyorsulásról szóltak!

Tippre vhol 2x-2,5x között lesz a vége, szóval lehet az RX 6900 XT vagy RX 6950 XT bencheredményeket 2-2,5x-el szorozni, na azt fogja tudni az új csúcs-AMD.130-162 fps?

78-97 fps?

204-255 fps?

Ezek alapján igenis lehet majd létjogosultsága egy RTX 4090 Ti vagy Titan ADA, vagy bármi egyéb lesz is a neve kártyának, ami +20%-kal lesz erősebb a 4090-nél, mert nagyjából oda érkezhet a "csúcs-AMD", ami lehet nem is a csúcs-AMD lesz

AMD-t ismerve hiába lesznek dec. elején kaphatóak, inkább csak papíron lesz úgyis a boltokban.

Multi-chiplet-design miatt sztem lesz gyerekbetegsége is.

Az AMD driverek állapotáról már inkább ne is beszéljünk, mai napig vannak anomáliák 6xxx szériánál, hiába telt el 2 év, bár ez sztem javarészt annak is tudható be, hogy a játékfejlesztők szimplán nem optimalizálják AMD-re is.Ezek után már csak az árazásuk lesz kérdéses, de ugye az új Ryzen procik sem lettek olcsók, szóval árversenyre nem számítanék...

-

BeZol

őstag

válasz

Találtgyerek

#1920

üzenetére

Találtgyerek

#1920

üzenetére

Ez majd még menet közben kiforrja magát.

Egyedi görbét próbálnék első körben kilapított tetővel adott fesztől, ilyenkor pedig power-limithez sem kell nyúlni.Majd igyekszem 350W-ra (3080), 280W-ra (3070 Ti), és 200-250W-ra is megnézni, aztán meglátjuk milyen a skálázódás.

-

BeZol

őstag

válasz

ForRedGlory

#1926

üzenetére

ForRedGlory

#1926

üzenetére

Jaja, a Gainward is cw-zik nálam, ami pont 144fps körültől válik zavaróvá.

Nem ebbe a gépbe terveztem, hanem egy másikba, de az rossz ómen, h a mostaniban alig volt kártya ami cw-zet, amelyik gépbe majd hosszú távra tervezném, na ott még az is cw-zett, ami a mostaniban nem.

Vasárnap kiderül.

Ha amabban a gépben is cw-zik, ez a kártya is megy vissza.Ennyi pénzért ezt nem engedhetik meg. Kész, pont.

-

BeZol

őstag

válasz

nutella1

#1929

üzenetére

nutella1

#1929

üzenetére

EVGA 1300W

és csutka ugyanez a táp van a 2. gépben is, de ahogy fentebb is írtam, eddig minden kártyával fixen hangosabban cw-zett.

Még van 2 elfekvő EVGA 1000W is, vissza downgrade-elhetek, csak francnak sincs kedve tápot ki/beszerelgetni...

Nem a tuningon múlik.

Szimplán nem szereti annyira a gépemben levő komponenseket (valszeg főleg a tápomat).Ilyen ez a popszakma

Addig örülj amíg nálad pont nem csinálja, akkor azt el ne add!Egyébként simán lehet, hogy ha a te gépedbe betennénk bármelyik kártyát, nálad nem is cw-znének

-

BeZol

őstag

válasz

Találtgyerek

#1949

üzenetére

Találtgyerek

#1949

üzenetére

OC-s modellek annyiból érték meg eddig, hogy a jobb hűtés miatt halkabbak voltak (vagy legalábbis kellett volna lenniük).

Ha nagyon lesarkítva nézem, akkor egy átlagos kártya és egy fullos strix / suprim x között OC vs OC +5% ha volt, ami fps-ekre vetítve sem marha sok, cserébe pl. RTX 3080 esetén 370W helyett 440W körül ettek.

A fő probléma viszont nem ez, hanem az, hogy pl. ami járt Nálam Strix 3080 vagy Strix 3080 Ti, mindegyik coil whine-olt mint az állat (TUF-ok is, kivéve 3070 Ti esetén), ÉS mindegyik gyengén volt OC-zható, mert vagy a gpu-chip, vagy a memória mindegyiken gyengén OC-zható volt és limitálta a tuninglehetőségeket.

Konkrétan volt olyan chipes 3080 Ti Strix, ami 440W körül nem tudta azt, mint egy Gigabyte Gaming OC 3080 Ti 370W-ból. Pöppet szánalmas, de hát ilyen az, amikor árulnak egy drága terméket, aminek "óriási" a tuningpotenciálja, de közben nincsen leválogatva benne sem a chip, sem a memória, és a végén egy gyengébb modell is körberöhögheti.Én azóta megtanultam, hogy alapvetően mindig azt a legolcsóbb típust kell venni, aminél már nem kompromisszumos a hűtés, mert pl. egy Gigabyte Turbo, EVGA XC3 hűtés még alulfeszelve is borzalmas tudott lenni, de ezek felett kvázi minden kártya rendben volt már.

Persze lehet veszegetni a prémium modelleket, de akkor biztos addig cserélgetném amíg egy hibátlan darabot nem kapok.

-

BeZol

őstag

MSI Gaming X Trio vs Suprim X

és

Asus Tuf vs Strix

PCB-s fotók: [link]A prémium modell ugyanaz, csak nem spóroltak le modulokat belőle.

-

BeZol

őstag

![;]](//cdn.rios.hu/dl/s/v1.gif)

Time Spy Extreme: 21.520 Graphics Score (world 13.)

Ha minden jól megy ma még faragok hozzá +500 pontot

![;]](//cdn.rios.hu/dl/s/v1.gif) (de esélyes, h nem sikerül)

(de esélyes, h nem sikerül)Amúgy abba hagyhatnátok már az árakon való rugózást, valakinek mindig drága lesz, valakinek meg nem.

Csak köröztök körbe-körbe az árazás témakörön totál feleslegesen, én meg nem győzöm tekergetni a postokat, mert a 3/4-e "szemét".[ Szerkesztve ]

-

BeZol

őstag

válasz

KillerKollar

#2140

üzenetére

KillerKollar

#2140

üzenetére

Igen, ezek alapján a PNY, KFA2 és a Gainward is kaki, mert ugyanott készül esélyesen mindegyik, ahol a Palit.

Ha megnézed, kb. egyformák a kártyák méretei, csak a külső design tér el

Azért azt tegyük hozzá, hogy attól, hogy pl. most a Buildzoid videóban mondták, hogy ezeknek a kártyáknak van a leggagyibb VRM és társai, tulajdonképpen ez nem probléma, mert a legtöbb esetben ennél több csak extrém tuning esetén kell. Értsd: folyékony nitrogénes téma.

Ez majdnem ugyanaz mint az alaplapoknál, ott is simán elég lenne a polc alsó feléről való példány, a végén pedig 24/7 tuning-beállítással esélyesen ugyanott lenne mindkettő, nekem legalábbis semmi különbség nincs ilyen témában egy B550 TUF Gaming-Plus és egy X570 Dark Hero lap között, csak utóbbi 100ezer Ft-tal drágább volt...

Én berendeltem egy Inno3D X3 OC RTX 4090-est is, az pedig csak 3slotos, kíváncsi leszek mit tud majd hőfokügyileg a Gainwardhoz képest. Kis szerencsével péntekre itt lesz, amúgy jövő hét hétfő-kedd

Alapvetően a Gainward-os hőfokokat látva teljesen felesleges ide 3,5 slotos batár kártya.

Tuning-ügyileg pedig inkább feltenném a kérdést, hogy minek is? Még 4K-ban is cpu-limittel lehet találkozni itt-ott.

Még nem finomhangoltam gyári 450W-on a kártyát, de majd megteszem, mert az Inno3D esélyesen csak 450W-ot tud, nem tolható ki a TDP-kerete, és akkor "almát almával" lesz vmennyire az összehasonlítás.Amit pedig nagyon remélek, hogy az már nem fogja coil whine-oltatni a tápomat, mert a Gainward-ot sajnos nem szereti egyik tápom sem

(a tápjaim ciripelnek tőle..., és nem a kártya, szóval lehet ez ilyen EVGA-táp sajátosság, 2db 1300W-os és 2db 1000W-os EVGA-táppal is megnéztem

(a tápjaim ciripelnek tőle..., és nem a kártya, szóval lehet ez ilyen EVGA-táp sajátosság, 2db 1300W-os és 2db 1000W-os EVGA-táppal is megnéztem  )

)Szóval megy majd vissza Alza-nak (esetleg hardverapró

) amint megérkezett az Inno3D-s kártya.

) amint megérkezett az Inno3D-s kártya. -

BeZol

őstag

Nem érnek ezek ennyit.

Délelőtt tudtam volna venni 2199 EUR-ért TUF OC RTX 4090-est, sztem még az is sok érte... (nem is vettem)

Ha lesz BIOS-flashelés, akkor az alap TUF-ot érdemes vadászni 2k EUR környékén.

Az 1960 EUR környéki árakhoz képest 2k EUR környékénél többet max egy Suprim X és Strix esetén adnék ki, de ott is meghúznám a határt 2100-2150 EUR-nál, közben pedig kb. semmivel sem tudnak többet nyújtani teljesítményügyileg.Minden ami efelett van, szimpla rablás.

Ha lesz időm finomhangolok gyári 450W-ra az OC-zott 515W helyett, aztán mindenki látja majd utána, h alig ér vmit az OC (legalábbis ez a feltételezésem).

-

BeZol

őstag

Hát akkor már nem feltétlen annyira megérős a Suprim X,

ha BIOS-ügyileg az

- FE

- TUF OC

- STRIX OC

- Gaming OC

mind 600W-ig húzható. (nemtom mi tudja még)Azt mondjuk nem tudom, hogy a sima TUF és sima Strix (tehát non-OC verziók) is tudják-e a 600W-ot.

Na mindegy, gondolom pár hét és lehet flashelgetni, és ha a Strix bios nem is megy fel minden kártyára (régen legalábbis volt h nem mindegyikre lehetett felrakni), akkor is még ott van 3 másik opció legalább

-

BeZol

őstag

Colorful iGame Neptun 630W BIOS-os.

[link] (lehet lassan tölt be) -

BeZol

őstag

Robit kell rá írni ha annyira kell.

Bő 1,5 éve előre beállítottam mit akarok és max mennyiért, aztán menet közben csipogott a mobilom h hagyjam jóvá a vásárlást (amiről tudtam h fixen csak az lehet amit akartam).

Én egyelőre nem érzem azt, hogy asus webshopos sima TUF-on kívül megérné bármit is robotolni, de lehet pár hét múlva a mostani drágább kártyák árai is barátinak fognak tűnni

(remélem nem így lesz)

Új hozzászólás Aktív témák

- Nem indul és mi a baja a gépemnek topik

- Ezek a OnePlus 12 és 12R európai árai

- Fotók, videók mobillal

- Milyen légkondit a lakásba?

- ASUS routerek

- A fociról könnyedén, egy baráti társaságban

- Android alkalmazások - szoftver kibeszélő topik

- Kínai, és egyéb olcsó órák topikja

- Napelem

- ubyegon2: Airfryer XL XXL forrólevegős sütő gyakorlati tanácsok, ötletek, receptek

- További aktív témák...

- BESZÁMÍTÁS! ÚJ AORUS MASTER / ROG STRIX WHITE RTX 4090 24GB videokártyák számlával 3 év garanciával

- ASUS RTX 4090 TUF GAMING OC 24GB GDDR6X (TUF-RTX4090-O24G-GAMING) - Beszámítás: OK

- RTX 4070(S), 4070 Ti(S) új,bontott,újszerű,használt videókártyák, 36, 21, 12 hó gar, Áfá-s számla

- ASUS ProArt GeForce RTX 4080 SUPER 16GB GDDR6X OC (ASUS-VC-PRO-RT4080S-O16G) Bontatlan új 3 év gar!

- GIGABYTE GeForce RTX 4090 AORUS MASTER 24GB videokártya - garancia: 2028.02.04.

Állásajánlatok

Cég: Alpha Laptopszerviz Kft.

Város: Pécs

Cég: Promenade Publishing House Kft.

Város: Budapest

![;]](http://cdn.rios.hu/dl/s/v1.gif)

)

)

Legalábbis ilyesmi rémlik

Legalábbis ilyesmi rémlik