- iPhone topik

- Samsung Galaxy S23 és S23+ - ami belül van, az számít igazán

- Apple iPhone 15 Pro Max - Attack on Titan

- Nothing Phone (2) - több, mint elsőre látszik

- Fotók, videók mobillal

- Xiaomi Watch S1 - szép az idő

- Google Pixel topik

- Samsung Galaxy Watch6 Classic - tekerd!

- Hivatalosan is bemutatta a Google a Pixel 6a-t

- Redmi Note 8 Pro - Redmi, a profi

Hirdetés

-

Spyra: nagynyomású, akkus, automata vízipuska

lo Type-C port, egy töltéssel 2200 lövés, több, mint 2 kg-os súly, automata víz felszívás... Start the epic! :)

-

Olcsóbb lett a OnePlus Watch 2

ma Csak arra kell figyelni, Watch X néven vásároljuk meg az Oppo kínálatából.

-

Star Wars Jedi: Survivor - Egyre közelebbi a PS4 és Xbox One verziók érkezése?

gp Kíváncsian várjuk, hogy végül megkapjuk-e az előző generációs változatokat.

-

Mobilarena

A legtöbb kérdésre (igen, talán arra is amit éppen feltenni készülsz) már jó eséllyel megtalálható a válasz valahol a topikban. Mielőtt írnál, lapozz vagy tekerj kicsit visszább, és/vagy használd bátran a keresőt a kérdésed kulcsszavaival!

Új hozzászólás Aktív témák

-

HSM

félisten

válasz

Raymond

#60698

üzenetére

Raymond

#60698

üzenetére

"megtalaltad vegre az irast amit linkeltel akkor es el is olvastad, azzal kellett volna az elejen kezdened"

Kiderült belőle néhány friss újdonság (nem követem napi szinten a VR-világot, így pl. a mélységinfóval feljavított 2.0 verziók újak voltak), de semmi olyan, ami lényegesen módosított volna az álláspontomon."Amit en kifogasoltam az a "VR-nal nem fontos a minoseg" kijelentesed"

Határozottan nem volt ilyen kijelentésem, akkor itt értettük félre egymást. Azt írtam, másodlagos, hiszen a rosszullét elkerülése az elsődleges (amihez az kell, hogy időben megérkezzen a kép, amit te is leírtál)."egy edge case-eket is bemutato videobol itelsz meg valamit"

Nem ebből ítélem meg. A videó csak azt szemléltette, hogy bizony előfordulnak hibák, amik nem egyformán zavarnak mindenkit. Engem nagyon, másokat kevésbé.

"amikor a HUB videoban 10% sebessegel (es egyszer raadasul 3%) kell valamit lejatszani hogy megmutassa a "problemat" akkor az a kakan a csomo kereses kategoria szerintem"

Bizonyos szempontból igen, más szempontból nem. Ahogy írtam, nem egyformán zavar ez mindenkit. Folyamatában a monitorodon sokkal feltűnőbb lehet a különbség 120Hz-en is, ha valami rossz helyen/rossz minőségben/helytelenül villan be (ugye a temporális stabilitás vagy annak hiánya), mint egy tömörített videó-streamen, 60Hz-re korlátozva. Szerintem jó az analízisük, aztán mindenki eldöntheti, zavarja-e, kell-e ez neki. Én személy szerint maradok a natívnál.

Én személy szerint maradok a natívnál. -

HSM

félisten

válasz

Petykemano

#60757

üzenetére

Petykemano

#60757

üzenetére

"Érdekes, milyen felkapott lett a kézi konzol AMD alapon."

Elég jó lett hozzá az alap. Jó a perf/watt, stabil a driveres alap. Minden adott, hogy sikeres legyen a kategóriában. Én egy hatmagos Renoir APU-t használok, az is meggyőző, amit 15W-ból produkál, pedig az még csak VEGA IGP-s.

Jó a perf/watt, stabil a driveres alap. Minden adott, hogy sikeres legyen a kategóriában. Én egy hatmagos Renoir APU-t használok, az is meggyőző, amit 15W-ból produkál, pedig az még csak VEGA IGP-s. -

HSM

félisten

válasz

Busterftw

#60772

üzenetére

Busterftw

#60772

üzenetére

"De a DXVK 2018-2019 release" "...hanem arrol hogy a DXVK-hoz az AMD-nek semmi koze"

Ami a Mantle nélkül ma is kb csak egy dia lenne, hogy majd egyszer lesz valami OpenGlNext... Nem lett volna mire megírni a DXVK-t, vagy hasonló rendszert.A BOE példád annyiból nem jó, hogy a BOE egy sima beszállító, ha nem ők, akkor szállítana más kijelzőt. Grafikus API-t viszont nem sokan fejlesztenek...

-

-

HSM

félisten

válasz

Petykemano

#60808

üzenetére

Petykemano

#60808

üzenetére

"a legdrágább művelet (energiában) az adatmozgatás és a legpazarlóbb az adatra várás"

Azért azt se felejtsük el, hogy csipen belül is van ám energiaigénye az adatmozgatásnak. Nyilván kevesebb, mint külső interfészeken, de van úgy is. Egy ilyen ram még így is nagyságrendileg gyorsabb és takarékosabb, mint a GDDR interfészre bízni a dolgokat. Látszik itt is: [link] . Egyedül a latency romlott némileg az RDNA2-höz képest, de még mindig sokkal jobb, mint a memóriából.A javított kiadás szerintem erősen függhet attól, hogy áll a munka az RDNA4-el, és mekkora is valójában az ára teljesítményben a szoftveres javításnak (feltéve, hogy a pletyka igaz).

#60806 Alogonomus : "...és akkor a tesztelők bemutathatták volna..."

Szerintem annak nagyon rossz üzenete lett volna, hogy bemutatják, hogy mennyire bénáznak: jó lenne a cucc, csak nem tudják kiadni működőképesen.

Eladhatóan ezt csak úgy lehetne, hogyha jönne egy ráncfelvvart 50-es verzió belőle, szépen csendben a finomhangolásra hivatkozva a gyorsulással, mint az eddigi 50-es verzióknál...![;]](//cdn.rios.hu/dl/s/v1.gif)

A legjobb persze az lett volna, ha nem a rajt előtt derül ki az egész... -

HSM

félisten

válasz

Alogonomus

#60821

üzenetére

Alogonomus

#60821

üzenetére

"Igazából ezért is kételkedem abban, hogy csak ennyi az ok"

Ez azért komolyabb dolog is lehet, pl. valamiféle logikai bug a cache-rendszerben. Ha jobban hozzá kell emiatt nyúlni az sok-sok hónapos csúszás is lehet, emiatt könnyen lehet, hogy azt mondták, inkább menjen a start ahogy van a szoftveres javítással, főleg, ha már mondjuk legyártottak belőle pár raklapnyit a partnerek...Az 5800X3D dominanciája durva.

-

HSM

félisten

Én ha MOST vennék, a 12GB-on elesne. Plusz egy ilyen pici, olcsón gxártható GPU-ért nem vagyok hajlandó majd 1000€-t a boltban hagyni. Ahogy annak idején ugyanezért fel sem merült, hogy 5700XT-t vegyek, RT nélkül árazták a picit gyengébb RTX-ek fölé, feleakkora GPU-val...

Főleg, amikor van erős alternatíva, a 7900XT, 20GB rammal. -

HSM

félisten

válasz

Alogonomus

#60860

üzenetére

Alogonomus

#60860

üzenetére

"az lesz a megoldás a túl kevés memória esetén, amit az UE4-es Hogwarts Legacy alkalmaz már"

LOL, ezt a megoldást már közel 15 évvel ezelőtt tudta pl. a GTA4. Remek élmény volt, amikor apránként eléd épült a város... [link]

[link]

Normális mennyiségű VRAM-al szerelt kártyát kell venni, ilyen egyszerű... Nem belemenni az előrelátható avulásba... -

HSM

félisten

"Ott azért GDDR6X van benne ... plusz van valami emlegetett memória dekompressziós technika állítólag ... nagyobb L2 az Amperehez nézve. ezek mind valamelyes ellensúlyozzak a dolgokat, főleg az L2 mérete"

A memóriából hiányzó dolgokat semmi nem fogja pótolni. Szépen meg kell várnia a GPU-nak, mire átcsorog a PCIe-en, vagy használni a rosszabb minőségű alternatívákat, amik rendelkezésre állnak. Esetleg a DirectStorage tud ezen talán kicsit segíteni, hogy hamarabb megérkezzen, de a méretet ez sem fogja helyettesíteni, ez borítékolható.

Egyébként a 12GB-ot tartom a kisebb gondnak, a nagy, hogy mennyi pénzt kérnek érte...

Annak idején pl. az RTX3060-on teljesen rendben volt a 192 bites busz + pici GPU + 12GB ram, 330$-ért. Legyen infláció és 500$. De 8-900$?!

[ Szerkesztve ]

-

-

HSM

félisten

"mert a GPU-s dekódolás miatt nem csak a dekódolt textúrákat kell tárolni, hanem a kódoltakat is"

Minek tárolnák azt is? A kódolt csak addig kell, míg ki nem kódolják... Okosan használva ez a technológia szvsz segíthet gyorsabban cserélgetni a VRAM tartalmát, kevésbé okosan használva meg jobban zabálhatja is azt.#60879 b.: Nekik a sok dedikált HW egységgel nem az az érdekük, hogy gyors shader alapú alternatíva legyen.

#60881 bitblueduck : Én is így látom, azért írtam, hogy talán és kicsit segíthet.

[ Szerkesztve ]

-

HSM

félisten

Azt nem mondtam, hogy a minimális potenciális VRAM igény csökkentésnek nem lesz borzalmas ára más tekintetben.

![;]](//cdn.rios.hu/dl/s/v1.gif)

Ezért nem vennék ilyen kártyát ennyi pénzért. Összehasonlíthatatlanul jobb ajánlat a 7900XT 20GB-al. De minimum 16GB-ot elvárnék 2023-ban, 1000$/€ magasságában.

A több, mint két éve megjelent 6800XT-re is tudtak már 16GB-ot rakni, 650$ MSRP-vel.#60884 b.: "Az RT részegységek részben tehermentesítik a shader hardverelemeket, nem helyettesítik azokat, innen ered a sebesség előny."

Captain Obvious...![;]](//cdn.rios.hu/dl/s/v1.gif) És innen ered a nagy hátrányuk is, hogy rugalmatlanok, nem tudsz hatékonyabb működést elérni okos szoftveres megoldásokkal, mert kötött a hardver. Ha pedig mégis, akkor elveszik a kötött célhardver előnye, mert általános algoritmusokban nem tudod kihasználni.

És innen ered a nagy hátrányuk is, hogy rugalmatlanok, nem tudsz hatékonyabb működést elérni okos szoftveres megoldásokkal, mert kötött a hardver. Ha pedig mégis, akkor elveszik a kötött célhardver előnye, mert általános algoritmusokban nem tudod kihasználni.#60885 Abu85 : Láttam, elég durva.

#60889 paprobert : Tudsz ilyenre példát? Engem a lassú játékmenetekben nem nagyon zavar a 30 FPS, de a megnőtt input lag ilyenekben is szörnyű. Ráadásul az esetleges képi hibák is sokkal látványosabbak, ha kevés az FPS. Szvsz sokkal jobb megoldás erre egy LFC vagy újabban FreeSync Premium címkéjű monitor, ami szépen, képhibák nélkül simítja le a megjelenítést. Én ilyenen játszom pl. Witcher 3-at, nagyjából 25-40 FPS kimaxolva RT-vel a 6800XT-men valós 1188P-n, és 30 felett már teljesen jó a képi élmény, 25-30 között elmegy, egyedül Radeon anti-lag kellett rá a körülményekhez képest jó input laghoz. De eszembe nem jutna DLSS2-3-al játszani, a DLSS2 minősége nem tetszett (és az FSR2-é sem), a DLSS3 növelt input lagja pedig elrontaná az egészet, pedig nem egy gyors játék egy pörgős FPS-hez képest.

#60896 Abu85: "egy már kész képkockát csak azért nem kiküldeni a kijelzőre, hogy előbb generálj elé egy kevésbé friss, ráadásul potenciális képi hibákkal tarkított képkockát, a mélypont a rossz ötletek tárházában"

Óriási +1.

"Nem az a durva, hogy van ilyen, hanem az, hogy ezt el is lehet adni..."

+1 erre is. Én egyébként a hagyományos DLSS/FSR-el is így vagyok PC-n, beállítok magas felbontást, hogy aztán alacsonyabb felbontásból összetákolt képet nézzem?

Én egyébként a hagyományos DLSS/FSR-el is így vagyok PC-n, beállítok magas felbontást, hogy aztán alacsonyabb felbontásból összetákolt képet nézzem?

Amíg nem volt ez marketingelve érdekes módon (és helyesen![;]](//cdn.rios.hu/dl/s/v1.gif) ) senkinek eszébe nem jutott volna használni, pedig volt pár játék resolution scale-el, és driverből is lehetett eddig is GPU-s méretezést kérni alacsonyabb felbontáshoz.

) senkinek eszébe nem jutott volna használni, pedig volt pár játék resolution scale-el, és driverből is lehetett eddig is GPU-s méretezést kérni alacsonyabb felbontáshoz.#60898 DudeHUN : Ez itt baj, 60FPS felett már folyamatos a kép enélkül is, akkor meg minek kapcsolnád be? Hogy generáljon be pár tökéletlen képkockát is a valódiak közé?

[ Szerkesztve ]

-

HSM

félisten

válasz

DudeHUN

#60904

üzenetére

DudeHUN

#60904

üzenetére

Engem különösebben sosem zavart, ha mondjuk csak 60-100FPS-el ment a 144Hz monitorom, annyira pedig főleg nem, hogy extra késleltetést és képhibákat is bevállaljak miatta. De akkor úgy tűnik, vannak akiknek van erre igénye így is.

#60905 PuMbA : Hű, de boldog lennék, ha a gyors, gamer 144Hz IPS monitorom csak a közelében lenne a 120Hz AMOLED-nek a mozgáskövető képességéhez, ami a telefonomban van...

A mai átlag monitortechnológiáknál az a gond, hiába gyors, hiába 120 vagy 240Hz, keni a képet mozgásnál akárhány FPS-el hajtod.

A mai átlag monitortechnológiáknál az a gond, hiába gyors, hiába 120 vagy 240Hz, keni a képet mozgásnál akárhány FPS-el hajtod.[ Szerkesztve ]

-

HSM

félisten

válasz

Petykemano

#60923

üzenetére

Petykemano

#60923

üzenetére

60 helyett 70 CU-val megpaprikázva szerintem elég ütős lenne a Navi32.

-

HSM

félisten

válasz

Petykemano

#60926

üzenetére

Petykemano

#60926

üzenetére

Nem tartom elképzelhetetlennek, hogy látva a konkurenciát, hozzácsapjanak 10CU-t, hogy versenyképesebb legyen. Már az első pletykáknál kicsit keveselltem a 60CU-t a beharangozott célokhoz.

Még így is bőven elég pici lenne a gazdaságos gyárthatósághoz. Inkább a csipletelés tűnik problémának, hiszen bonyolítja a gyártást, miközben kellően olcsó lett az 5n, hogy ebben a piaci környezetben túl sok haszna ne legyen. -

HSM

félisten

válasz

S_x96x_S

#60945

üzenetére

S_x96x_S

#60945

üzenetére

"Ott nyilvánvalóan valami probléma van .. "

Minden jel arra utal szvsz, hogy az RDNA3-al lehet(ett) valami gubanc.

Érthető lépés lenne, ha a Navi31-nél felmerült esetleges gondokat már kijavítsák a később érkező változatokban. Főleg, hogy pl. egy mainstream APU, vagy egy mainstream-ebb GPU (Navi32) sokkal szélesebb piaci réteghez jut el. Ezt erősíti, hogy február végén már csökkentett GPU-órajelek szerepeltek a specifikációban... [link] -

HSM

félisten

válasz

Yutani

#60981

üzenetére

Yutani

#60981

üzenetére

"Van egy lila hajú lány is az egyik képen, ahol mindegyik upscaling sz@rul néz ki"

Éppen ez a baj az upscaling-ekkel, a hiányzó részleteket egyik sem tudja elővarázsolni... Egy egyszínű falon meg nyilván egyik sem fog rosszul teljesíteni.

#60980 Petykemano : Azért azt is meg kellene nézni, melyik eljárás mekkora erőforrásigényű. Épp a kézikonzol, stb miatt lehet más az ideális működése pl. az FSR-nek, mint a többinek (energiaigény a célzott hardvereken).

-

HSM

félisten

válasz

Busterftw

#61011

üzenetére

Busterftw

#61011

üzenetére

Szvsz ez már a megjelenésük idején is borítékolható volt, hogy a 3070 és a 3080 is igen szűkös VRAM-ból a teljesítményéhez és árához képest, korrektebb review-ok meg is említették. Nekem ezek miatt fel sem merültek soha. 3080 12GB-on azért volt, hogy elgondolkoztam, de maradt végül a 6800XT.

[ Szerkesztve ]

-

HSM

félisten

válasz

Busterftw

#61013

üzenetére

Busterftw

#61013

üzenetére

Pár példa, marha vicces. Ilyet egészen biztosan nem szeretnék egy 600$-os VGA-tól... [link]

De ez sem valami szép [link] .

De ez sem valami szép [link] .

Aki 1, max 2 évre vett 3070/3080-at annak nem volt baj, de aki kicsit hosszabb távban gondolkozik, annak tökéletes volt a 6800-900-as széria a 16GB-al. Nem túlzó, épp megfelelő. Én több, mint 2 éve vettem a 6800XT-m, és egyáltalán nem bántam meg, hogy ezt választottam. 1440P kimaxolt RT-hez néha 1-2 címhez lehetne kicsit erősebb, ez vele az egyetlen kifogásom, amiért egyáltalán felmerült bennem idén a 3080 12GB, amit aztán gyorsan el is vetettem.

Én több, mint 2 éve vettem a 6800XT-m, és egyáltalán nem bántam meg, hogy ezt választottam. 1440P kimaxolt RT-hez néha 1-2 címhez lehetne kicsit erősebb, ez vele az egyetlen kifogásom, amiért egyáltalán felmerült bennem idén a 3080 12GB, amit aztán gyorsan el is vetettem.

#61016 Busterftw : Sok minden függvénye. Nem mindegy, milyen motor, mekkora textúrák, az RT is elvileg kér, most bejött a DirectStorage, elvileg annak is kell majd...

-

HSM

félisten

A 3080 (Ti) 12GB-nak az ára volt gáz. A 12GB-ra azt mondom, már rendben van, tekintve a kártya korát. A 10GB viszont nagyon gáz volt az elején, még a mai szemmel kedvezőnek ható kezdő 700$ MSRP-ért is.

Nézd, a "lehetne picit erősebb RT ben 1-2 címben" a gyakorlatban azt jelenti, hogy pl. a Witcher 3 RT, ami az egyik legdurvább RT-terhelésű játék, kénytelen voltam levenni 1188P-re, hogy csont maxon FSR és hasonlók nélkül meglegyen bő 30 FPS. Mivel vajsima bő 30 FPS, így Radeon Anti-laggal tökéletesen játszható és élvezhető alacsony input laggal. Ellenben mikor a 10GB kezd kifogyni, akkor sem vajsimaságról nem beszélhetünk, a kimaradozó vagy rossz minőségűekkel helyettesített textúrákról nem is beszélve.

Ezt nem ellensúlyozza, hogy Witcher3-ban lenne mondjuk 30%-al magasabb FPS-em, mert ott épp van RT és ez fekszik a 3080-nak. Jó lesz majd utódnak egy 7900 később, alig kerül többe, mint egy 12GB-os 3080.

Ezt nem ellensúlyozza, hogy Witcher3-ban lenne mondjuk 30%-al magasabb FPS-em, mert ott épp van RT és ez fekszik a 3080-nak. Jó lesz majd utódnak egy 7900 később, alig kerül többe, mint egy 12GB-os 3080."messze elmarad mind RT ben mind felskálázási minőségben az Ampere szériától"

Ezzel a felskálázási minőséggel kábíts kérlek mást, teszteltem Witcher3-ban az FSR-t és a DLSS-t is legmagasabb minőségben (friss verziók voltak benne), ezeket a homályosító csillámporos vackokat inkább meghagyom másoknak, nem vagyok híve a kamu magas felbontásnak. Ami meg az RT-t illeti, egy RTX 3070 sebessége általában megvan vele, így 16GB-al teljesen jó a mindennapokban. A sima 12GB-os OC 3060-amat körbefutotta Witcher3 RT-ben, annyira, hogy az DLSS-el sem érte utol, szóval azért annyira messze nem marad el ebben sem.

Ami meg az RT-t illeti, egy RTX 3070 sebessége általában megvan vele, így 16GB-al teljesen jó a mindennapokban. A sima 12GB-os OC 3060-amat körbefutotta Witcher3 RT-ben, annyira, hogy az DLSS-el sem érte utol, szóval azért annyira messze nem marad el ebben sem.

Pedig hidd el, nagyon tetszett volna, ha a feleannyiba kerülő kártya DLSS-el utolérte volna RT-ben, akkor most az lenne a játékos gépemben, nem a 6800XT.![;]](//cdn.rios.hu/dl/s/v1.gif)

[ Szerkesztve ]

-

HSM

félisten

Elég hasonló FPS-eket tud elvileg RT-vel a CP2077, mint a Witcher3. Persze, a friss Overdrive mód Path Tracing-el nyilván durvább, és elvileg a Portal is az, ha nem tévedek. Egyébként a Portal hardver kihasználása borzalmas rossz, illetve nyilván az Nv-s eszközökkel készült portok az ő technológiájukat fogja előnyben részesíteni. Itt még várnék picit a konklúzió levonásával, kb. mint ahogy a 20+GB-ot fogyasztó játékokat is kizárnám a VRAM témából. Az RDNA2-3 extra RT-s képességeit jelenleg csak a konzolok használják (programozható bejárás), személy szerint ebben is látok némi kihasználatlan lehetőséget.

-

HSM

félisten

"Itt lassan már tényleg az lesz a kérdés, hogy az AMD ne még szarabb kártyákkal jöjjön ki, mint az NVIDIA."

Azért én ennyire nem látom borúsnak a helyzetet.

"mert a Zen 4 rohadtul nem bírja kezelni a hipergyors memóriákat meg szétég a chiplet"

És nem is kell neki, mert mint látható a tesztekből, egy 7800X3D "lassú" 6000Mhz memóriákkal, 8 maggal is fele fogyasztásból lelépi a konkurencia 24 magos csúcsmodelljét, és a sima modellek teljesítménye is több, mint kielégítő. A chiplet szétégése pedig vélhetőleg rengeteg hiba szerencsétlen együttállásának következménye, amit remélhetőleg mihamarabb javítanak majd AGESA/BIOS oldalról. Sajnos az AM5-öt sikerült egy bughalmazként piacra dobni, ahogy az RDNA2-3 szoftveres oldalára is ráférne egy komolyabb rendberakás, pl. egy épkézláb működésű, értelmes módon használható WattMan piszokul kellene. Ez a rengeteg bug, bénázás és szoftveres kiforratlanságok szerintem sokkal több vásárlót riasztanak el, mint a hardvereik teljesítménye, ami alapvetően rendben lenne.

Ez a rengeteg bug, bénázás és szoftveres kiforratlanságok szerintem sokkal több vásárlót riasztanak el, mint a hardvereik teljesítménye, ami alapvetően rendben lenne. -

HSM

félisten

Egy szó: menedzsment.

Mire, és mennyi pénzt költenek. A 7900-ast el kellett volna pár hónappal csúsztatni, javítani a hardvert is, befejezni a drivert, és egy sokkal pozitívabb képpel lehetett volna nyitni vele mondjuk idén februárban.

Mire, és mennyi pénzt költenek. A 7900-ast el kellett volna pár hónappal csúsztatni, javítani a hardvert is, befejezni a drivert, és egy sokkal pozitívabb képpel lehetett volna nyitni vele mondjuk idén februárban.

Az AM5 ugyanez. Azt pletykálják, már megjelenés előtt voltak ilyen leégős esetek, és így kiadták, és hónapokig nem történt semmi... Én azért is maradtam még AM4-en, azért nem fogom kifizetni az AM5 igen vastag felárát, hogy még béta hardver tesztelő is lehessek. Fordítva kéne, nekik kéne nekem fizetniük, hogy kitesztelem a vackukat...

#61093 b.: Ez nem csak a gyártástechnológia volt.

A 6800XT/6900XT-k igen jó energiahatékonyságra lettek volna képesek, ha erre állítják be őket. Sajnos gyárilag csak a sima 6800 volt erre hangolva, látszott is az eredményein, az erős vágás ellenére is igen jó számokat hozott.

A 6800XT/6900XT-k igen jó energiahatékonyságra lettek volna képesek, ha erre állítják be őket. Sajnos gyárilag csak a sima 6800 volt erre hangolva, látszott is az eredményein, az erős vágás ellenére is igen jó számokat hozott.[ Szerkesztve ]

-

HSM

félisten

válasz

S_x96x_S

#61135

üzenetére

S_x96x_S

#61135

üzenetére

Egyébként ha nem a szénné hajtott OC-verziókat nézzük, akkor teljesen versenyképes a perf/watt: [link] .

Persze, azzal a kisbetűs résszel, hogy nyilván a hardveres bejárás miatt az RT energiahatékonyabb (is) lesz az RTX-eken, amíg ehhez van írva a DXR API és a játék is, ez egy átmeneti előnye a zöldek megoldásának.[ Szerkesztve ]

-

HSM

félisten

válasz

huskydog17

#61228

üzenetére

huskydog17

#61228

üzenetére

Csak a zöldeknek valamiért nem felelt meg az egyértelmű "TSMC 5nm" elnevezés, így a félreértések elkerülés végett gyorsan elnevezték "TSMC 4N"-nek.

![;]](//cdn.rios.hu/dl/s/v1.gif)

[ Szerkesztve ]

-

HSM

félisten

válasz

huskydog17

#61230

üzenetére

huskydog17

#61230

üzenetére

Igen. De a TSMC-nél az N4 a 4nm-es node-juk, míg az Nv 4N-je kb. sehonnan nem derül ki teljes biztonsággal, de elvileg egy testreszabott 5nm eljárás.

-

HSM

félisten

válasz

huskydog17

#61234

üzenetére

huskydog17

#61234

üzenetére

A 6nm is a 7nm családva tartozik, mégis látod remélhetőleg a különbséget és egyértelműen jó az elnevezés, senki nem is akarta soha 7nm+-nak hívni. Az Nv N4 viszont egy egyedi igények szerinti 5nm, nem 5nm+ vagy 4nm.

-

HSM

félisten

És tegyünk ide mégegy változót, a "HW RT" is többféle lehet ám. Mert most DXR alatt kétféle van (DXR1.0 és 1.1), de ezek az Nv-féle működéshez vannak szabva, míg a Radeon szoftveres bejárása révén elérhető optimalizációkra így nincs lehetőség. Talán az új Snowdrop motort pletykálták régebben, hogy építeni fog erre az Amd saját RT Api-ján keresztül.

-

HSM

félisten

Az AMD arra apellált, hogy a jelenlegi rendszer meglehetősen korlátozó "black box", és mivel szerintük emiatt ez változni fog, így csak bizonyos részeket csináltak "hardveresen". Számomra ez egyébként szimpatikus, és a gyakorlatban láthatóan a nagyobb GPU-kon elég jól működő megközelítés, főleg RDNA3 esetén, de az RDNA2-es 6800XT-m is bőven megüti a használhatóságot RT-vel.

Ami még számomra rendkívül érdekes, hogy nem is ALU/RT vagy hasonló nyers erőforrások fogynak el bizonyos RT kódok alatt, hanem a regiszterek túlnyomása miatt aggasztóan kevés a párhuzamos munkafolyamat, ami miatt rossz a hardver kihasználtsága... Lásd pl. [link] .

Ezért is leszek igen nagyon kíváncsi, ha valaki esetleg PC-n kijön egy motorral, ami az AMD-féle megoldásra van optimalizálva, ott mit tudnak kihozni a konkurencia RT-s megoldásához képest. Az lesz az igazi tesztje, mennyire is jó valójában az AMD koncepciója.

-

HSM

félisten

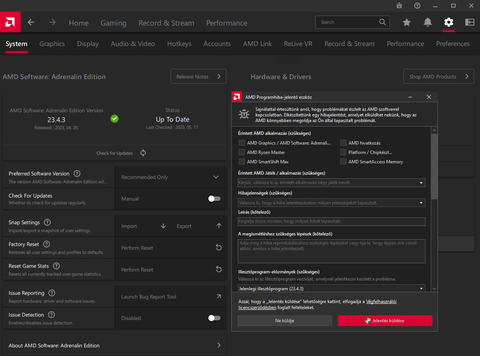

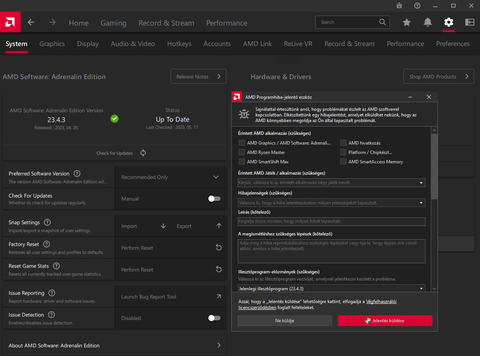

Dehogy javították, hogy is gondolhattam volna, hogy 2 hónap elég nekik erre a végtelenül komplex kihívásra...

Persze, mint írtam, a win10-emben mint alapértelmezett UI nyelv a magyar van beállítva, ugyanakkor azt gondolom, hogy ha angolra állítottam a drivert, akkor annak minden részének illene ezt követnie.... -

HSM

félisten

válasz

kopi72

#61363

üzenetére

kopi72

#61363

üzenetére

Igazából ki és miért venne 200+ W-os, 20 Tflops-os VGA-t, ha 15W-ból, 2Tflops-al is elég lenne tizedannyi pénzből?

Ha a költői kérdés nem elég, nézd meg őket, kipróbálták: [link] . Szóval, medium/low 720P-n egész jól elfut pár hardverigényesebb cím is. Biztosan nagyon jól nézne ki egy 4K monitoron...![;]](//cdn.rios.hu/dl/s/v1.gif)

-

HSM

félisten

Itt megint az a gond, hogy az RT nem csak Ray-triangle intersection vizsgálat... Jól néz ki papíron ez, de a gyakorlati haszna szvsz erősen kérdéses az alapján, amiket eddig láttam RT-s shader elemzések.

Abból is világos lehet, hogy pl. semelyik mai játék semelyik beállításán nem hoz a 3090Ti másfélszeres tempót a 7900XTX-hez képest, és a 4090 is legfeljebb csak dupla tempó, a 4X-esnek a közelében sincs. A 4090 esetén ezt rá lehet fogni az API-ra, a 3090Ti esetén viszont nem, hiszen a mai 1.1 DXR API kb. arra a hardverre íródott. -

HSM

félisten

Ez is pl. arra utal, hogy nem a metszésvizsgálat miatt lassú pl. az RDNA2 RT-je [link] .

A második bekezdésed nem tudom hova tenni, de biztos nem arra reagál, amiről beszéltem.

Azzal teljes mértékben egyetértek, hogy egy épkézláb API nagyon kéne, ami mindkét hardverre elég jó. -

HSM

félisten

Az alulfeszelt 6800XT sem épp túl torkos, a gyári 254W PPT helyett nálam UV-vel olyan 210-230W körül ilyen értékeket mértem konnektorból egy fogyasztási limitjétől megfosztott Ryzen 5600 mellett: [link] . Egy minőségi fogyasztásmérő hasznos egyébként optiálisan beállítani a hardvereket.

Arra kell még vigyázni, a fogyasztási tüskéket a gagyi tápok nem komálják, részben ezért is ajánlanak mellé a kelleténél erősebb tápot.

Arra kell még vigyázni, a fogyasztási tüskéket a gagyi tápok nem komálják, részben ezért is ajánlanak mellé a kelleténél erősebb tápot.[ Szerkesztve ]

-

HSM

félisten

válasz

Alogonomus

#61403

üzenetére

Alogonomus

#61403

üzenetére

Viszont egy minőségi tápnál ráírva az van, ami a tartós terhelhetősége... Pillanatokra annál jóval többet is le illene tudni adniuk. Azért is írtam, fontos, hogy ne gagyi tápról beszéljünk....

-

HSM

félisten

válasz

Alogonomus

#61435

üzenetére

Alogonomus

#61435

üzenetére

Mivel RDNA3, dual issue képességet kapott, ami azonban korlátozottan használható ki. Papíron a 7900 is nagyon erős lett, vagy 60 Tflops, ugyanezen okból.

-

HSM

félisten

"...továbbra sem látom, hogy mit innovál és miben jár saját(!) utat a cég. Örök másodhegedűs..."

Pedig bőven van náluk is, sőt. De valamiért nem tudják ezt megfelelően marketingelni, eladni. A kedvencem a G-sync esete volt, amit gyorsan kiadtak a zöldek, gyakorlatilag egy prototípus szintű megoldással, miközben az AMD azon fáradozott a VESA-n belül, hogy szabványos formában mindenki számára elérhetővé tegyék... Lásd pl. [link]

Új hozzászólás Aktív témák

A topikban az OFF és minden egyéb, nem a témához kapcsolódó hozzászólás gyártása TILOS!

MIELŐTT LINKELNÉL VAGY KÉRDEZNÉL, MINDIG OLVASS KICSIT VISSZA!!

A topik témája:

Az AMD éppen érkező, vagy jövőbeni új grafikus processzorainak kivesézése, lehetőleg minél inkább szakmai keretek között maradva. Architektúra, esélylatolgatás, érdekességek, spekulációk, stb.

Én személy szerint maradok a natívnál.

Én személy szerint maradok a natívnál.

Jó a perf/watt, stabil a driveres alap. Minden adott, hogy sikeres legyen a kategóriában. Én egy hatmagos Renoir APU-t használok, az is meggyőző, amit 15W-ból produkál, pedig az még csak VEGA IGP-s.

Jó a perf/watt, stabil a driveres alap. Minden adott, hogy sikeres legyen a kategóriában. Én egy hatmagos Renoir APU-t használok, az is meggyőző, amit 15W-ból produkál, pedig az még csak VEGA IGP-s.

Anélkül nem tudom, hogyan futna jól modern játék Linuxon....

Anélkül nem tudom, hogyan futna jól modern játék Linuxon.... Szerintem teljesen evidens, hogy sok mindenkinek komoly munkája van abban, hogy most ezek létezhetnek. Ezek közül eléggé kritikus a szoftveres háttér, ennek megvalósítói közül lett néhány kiemelve, köztük az AMD is.

Szerintem teljesen evidens, hogy sok mindenkinek komoly munkája van abban, hogy most ezek létezhetnek. Ezek közül eléggé kritikus a szoftveres háttér, ennek megvalósítói közül lett néhány kiemelve, köztük az AMD is.![;]](http://cdn.rios.hu/dl/s/v1.gif)

Én egyébként a hagyományos DLSS/FSR-el is így vagyok PC-n, beállítok magas felbontást, hogy aztán alacsonyabb felbontásból összetákolt képet nézzem?

Én egyébként a hagyományos DLSS/FSR-el is így vagyok PC-n, beállítok magas felbontást, hogy aztán alacsonyabb felbontásból összetákolt képet nézzem?