- Új Beats fej- és fülhallgatók jelentek meg

- Futott egy Geekbench kört egy új HTC készülék

- Készülőben a Xiaomi 2021-es csúcsmodelljeinek HyperOS frissítése

- Samsung Galaxy S23 és S23+ - ami belül van, az számít igazán

- Redmi Note 9 Pro [joyeuse]

- Május 7-én bulit tart a Huawei

- Samsung Galaxy S24 Ultra - ha működik, ne változtass!

- Milyen okostelefont vegyek?

- Fotók, videók mobillal

- Nothing Phone 2a - semmi nem drága

Hirdetés

-

Agyi chipes gyártóba fektetett a kriptocég

it A Tether 200 millió dollárt fektet a Blackrock Neurotech agyi chipes vállalatba.

-

Lenovo Essential Wireless Combo

lo Lehet-e egy billentyűzet karcsú, elegáns és különleges? A Lenovo bebizonyította, hogy igen, de bosszantó is :)

-

Samsung Univerzum: Így ismerhető meg a Galaxy AI bármilyen telefonon

ma A Try Galaxy webalkalmazás kontrollált környezetben mutatja meg, mit tud a One UI 6.1-es rendszer és a mesterséges intelligencia.

Új hozzászólás Aktív témák

-

S_x96x_S

őstag

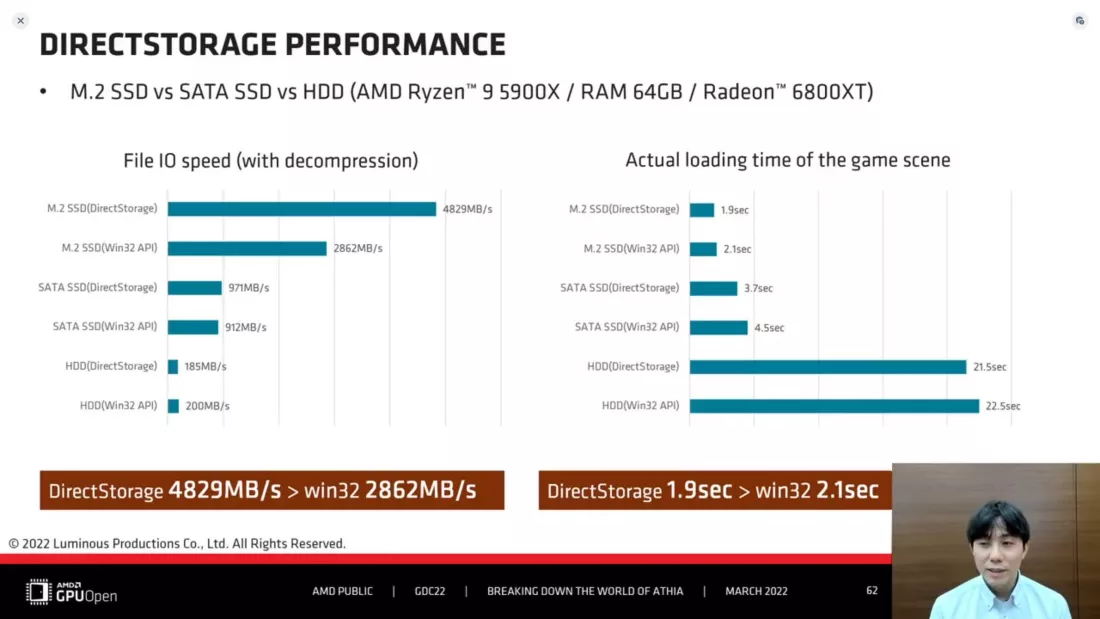

> Ez mind szép és jó, de a DirectStorage-nek jelenleg

én a next-gen -ről beszélek .. következő 3-5 éves időtávról.

a Gen5 a GPU-nál az alacsonyabb késleltetés és a memória koherencia miatt is fontos..a directStorage elég új ..

lényegében még csak pár publikus .. jővőbeli .. cím van .. pl. "Forspoken"

amelyeket ettől függetlenül - ha lassabban is, normál winchesterrel is lehet használni.

Idén várhatóan kikerülnek a játékfejlesztőkhöz az új 7000-res fejlesztői gépek ..

talán idén még lesz hozzá gen5-ös m.2 SSD-is ..

és a jövő évi GDC -n lesz 3-4 játékdemó amivel az RDNA3 + AMD SmartAccess Storage -t demózzák majd..

Mivel elkezdődött a következő konzolgeneráció fejlesztése/tervezése .. az AMD eléggé fogja tolni a témát.> Se PCI-E 5.0-ás VGA, se PCI-E 5.0 SSD nem fog kelleni a belátható jövőben.

ha nem hiszel benne, akkor nem kell adaptálni .. egy merevlemezes winchester is sok mindenre elég manapság ..

de mindig van olyan csoport ..

akik korán adaptálják a technikai újdonságokat

.. és lényegében ők elő-finanszirozzák a fejlesztést ..Mottó: "A verseny jó!"

-

S_x96x_S

őstag

mindenki a pénztárcájával szavaz ..

> DirectStorage

> ... a Microsoft pedig megmondta, hogy egy PCI-E 3 SSD elegendő hozzámint a "minimum gépigény"

azért az "Elegendő"(~minimális) és az "Ideális" között nagyon nagy különbség tud lenni.

amit valamikor nem lehet kimérni ( te ezekre hivatkozol) de valamikor igen és fontos ( én meg ezekre gondolok )pl. Microsoft Flight Simulator

- minimum gépigény : 8GB RAM + (+2GB VRAM )

- ideális gépigény: 32GB RAM + (+8GB VRAM)persze a gyakorlatban még a 32GB-ram se elég .. 64GB kell.

és vajon miért?

mert nincs koherens cache .. és hw-es direktstorage támogatás mint a konzolokban .."The 3090 ships with 24GB VRAM and if you fill it with buffer data or textures, you’ll certainly also duplicate a large amount of the VRAM buffers in RAM, and there you are: with 32GB RAM you probably really don’t have enough room to fit both the buffer data copy in RAM and the game working set!

Conclusion: everyone with a 3090 might really benefit from 64GB and this might even be the minimum recommended amount of RAM to use with a 3090." ( Link )> Értem, de ha jelenleg PC-n a DirectStorage-t csak 1db játékban használják,

> akkor ez mire elterjed lesz 3-5 év…..elég ha az a pár játék támogatja, ami neked fontos ..

amúgy a drága DDR5 árak miatt nagyon gyorsan népszerű lesz ..

és kevesebb GPU memóriával nagyobb teljesítményt lehet elérni.sokaknak már az elég lesz, hogyha a következő Microsoft Flight Simulator támogatni fogja;

A DirectStorage relative elég új ..

viszont a konzolos támogatás kiforrott .. működik ..

szerintem 1-2 év és elterjed ..[ Szerkesztve ]

Mottó: "A verseny jó!"

-

S_x96x_S

őstag

II:

> DirectStorage

> ... a Microsoft pedig megmondta, hogy egy PCI-E 3 SSD elegendő hozzá

a MS azt is megmondta, hogy a Windows 11-hez elegendő

- 4 gigabyte (GB) RAM

- 1 gigahertz (GHz) or faster with 2 or more cores on a compatible 64-bit processor or System on a Chip (SoC).A DirectStorage-hoz: Gen4 / Gen5 SSD az ajánlott.

Persze a Gen4-esből is az újabbak ( amelyek gyorsak )a Gen5 jelentősége még az alacsonyabb a késleltetésben van,

ami a CXL alapkövetelménye is;

és később ( X770E chipset? ) a CXL-nek hála

a ‘Coherent Multi-GPU’ -s korszak is beköszönthet ..

3 évvel ezelőtti hír:

"Intel Hints Towards An Xe ‘Coherent Multi-GPU’ Future With CXL Interconnect"

"If CXL can seamlessly scale GPUs, then the economics of the market would also change completely. People would be able to buy a cheaper GPU first and then simply add another one if they want more power. It would add much more flexibility in buying decisions and even alleviate buyers remorse to some extent for the gaming class. If CXL mode trickles down to the consumer level anytime soon, then we might even see motherboard designs change drastically as multiple sockets and multiple GPUs become a feasible option. Needless to say, it looks like things are going to get pretty exciting in a few years."A CXL+Gen5 sok mindent megváltoztat és földindulás szerű változások várhatóak Desktop fronton is.

szerintem

szerintem

Mottó: "A verseny jó!"

-

S_x96x_S

őstag

> Ez még mindig oké, de sehol sem látom a játékokat,

jövőre a GDC-t figyeld ..

addigra a (játék)fejlesztők upgradelnek Ryzen7000-re, ami alapból

támogatja a "AMD SmartAccess Storage"-t,

( ami + hw-res kitömörítést is támogat a MS Direcstorage-en felül )Az AMD és a Microsoft - (sok pénzzel vagy igérettel ) korrumpál pár játékfejlesztőt

hogy használják ki az új technológia lehetőségeit.

A Game Engine-be is elkezdődik az integráció ( UE5, Unity3D, ..)addigra

- lesznek RDNA3-as GPU-k

- és lesz Gen5-ös M.2 -es SSD.> Jelenlegi tesztekből tudjuk,

A "jelenlegi teszt" mindig a "jelenlegi játékokra" vonatkozik a jelenlegi hardverrel.

És teljesen igazad van, mert annak aki a következő 5 évben is a "jelenlegi" játékokkal játszik,

annak felesleges a költséges upgradelés.A "Jelenlegi" tesztekből néha lehet következtetni a trendre .. de néha nem ..

ráadásul most hiretelen nagyon sok minden változik és a verseny is felgyorsult.

és ebben is van egy kis bizonytalanság.Amúgy a technológia életgörbék gyakran nagyon furcsán alakulnak ..

néha sokáig beragad egy helyen .. aztán hirtelen nagy sebességgel kilő ..ott van pl. a CPU szám .. 3-4 éve még 4 core elég volt mindenre ..

manapság meg legalább 8 core kell .. és talán jövőre már 12 lesz az ajánlott.vagy ott van az AVX-512 ISA ..

ha az AMD képes lesz mobil és desktop szintre benyomni,

akkor egyre több program fogja kihasználni és multiarch-ban AVX2 és AVX512 támogatást adni. ( és talán az Intel-nek is sikerül integrálni az "E" magokba )Sok játék a Zen4-esen már attól is fog gyorsulni, hogy a driverek és a fizikai engine-ek

támogatni fogják az AVX2 és az AVX512 -öt.Lehet, hogy az AMD Zen4-en az AVX-512 -öt a Cinebench új verziója újra engedélyezni fogja,

mert most az Intel ClockDown-os implementációja miatt nincs sok értelme..

"CineBench R23 does not use AVX-512. Maxon has told me that the benefit of using AVX-512 is negated by the clock-down required to keep everything stable, so it isn't used. I'm told this is also why it is disabled in Intel's Embree, (which Cinema4D uses)."

https://twitter.com/iancutress/status/1327358373373898752Az Intel elég sokat optimalizálta az EU5-öt ( SIMD, vectorized instruction .. )

és ha az AMD megtanulta a leckét és rendes AVX-512 implementációt csinált,

akkor a játékfejlesztők a multiarch -os fejlesztésben berakják a Zen4-es AVX512 -es támogatást is a jövőben ..

https://www.intel.com/content/www/us/en/developer/articles/technical/unreal-engines-new-chaos-physics-system-screams-with-in-depth-intel-cpu-optimizations.htmlPersze ez sok-sok "ha" ...

De tényleg sok függ attól, hogy az AMD hogy rakta össze a zen4-et.persz én techno optimista vagyok a Zen4-el kapcsolatban ..

[ Szerkesztve ]

Mottó: "A verseny jó!"

-

Albus_D

aktív tag

"A játékfejlesztők mindig az átlag PC-hez fogják igazítani a játékok gépigényét, mert nem engedhetik meg maguknak, hogy a játékosok többségénél ne fusson a programjuk."

Ez a lényeg. Még ha valóra is válna valami a sci-fi-ből amit S_x96x_S felvázolt, 5 éven belül, az még mindig csak lehetőség lesz, mire követelmény, az még 5 év.

Na ezért felelőtlenség a kijelentései nagy része. -

-

S_x96x_S

őstag

> Mivel a fejlődés elnyújtott és lépcsőzetes szokott lenni, ezért számomra elképzelhetetlen,

> hogy a játékok a mostani adatmennyiséghez képest 10x több adatot fogak igényelni.

> Ilyen hirtelen fejlődés a PC világban nem létezik.miért ne létezne?

Ha van HW-es lehetőség és piac.. akkor a kreativ ipar megoldja ...Még az egyszerű (többezer éves játékok) pl. sakkprogram is elég jól skálázódnak 256 magra vagy még feljebb ..

most nem ritka a 100GB feletti játék, de hamarosan jönnek az 1Terrásak is.

"Microsoft Flight Simulator install size is 127GB, but you’ll be downloading even more"az RDNA3 már képes lesz "true 4K 240Hz" -es felbontásra is,

de ki tud hajtani "8K/60Hz HDR" "16K/60Hz HDR" monitorokat is.

és a 8K gaming sem újdonság ..> ezért számomra elképzelhetetlen,

sok mindent el lehet képzelni .. de a megvalósítás nehezebb .

Xbox 2042 - Imagine the future of gaming

https://www.youtube.com/watch?v=im0QjYpW-x0

"Imagine the future for gaming powered by quantum computing and featuring the world’s first holographic UX. The fastest most powerful gaming experience ever made — capable of 1 exaFLOPS of processing power, 32K video and 240 frames-per-second — yet it’s 90% smaller, a gaming supercomputer you hold in the palms of your hands. Imagine Xbox 2042. Xbox 2042 is built to drive native 32K resolutions in Full Spectrum Color at a base frame rate of 240 FPS (up to 480 FPS) with zero latency. All games are now “instant-on” requiring no loading times whatsoever. Even cloud-based open-world games with worlds so enormous they have their own dedicated data centers load and sync instantly. The all-new holographic user experience is intuitive, extra-sensory and will forever change how you game. The new gaming experience will support a robust games lineup, featuring more than 70 titles available at launch including the cutting-edge first-person shooter, Battlefield 2042. Xbox 2042 also offers full backwards compatibility with the games you know and love, boasting a library of 5000+ titles across four decades of Xbox. Just imagine the possibilities?"Mottó: "A verseny jó!"

-

S_x96x_S

őstag

> AVX-512 szintén nem jó példa, mert a sima AVX sem kötelező gépigény,

> csak pár játéknál. És akkor még ott van az AVX2 is.

> A játékfejlesztők mindig az átlag PC-hez fogják igazítani a játékok gépigényét,a multi-arch lényege .. hogy több opcióra is lefordítják a programot ( ~ több tárhely kell neki )

és a program az adott hardveren mindig a legoptimálisabb kódot használja majd.

és ez nem igényel túl sok fejlesztést.

Persze az "X86-64 generic" alapból támogatva lesz. ( ami no SSE, no AVX, .. )>A játékfejlesztők mindig az átlag PC-hez fogják igazítani a játékok gépigényét,

> mert nem engedhetik meg maguknak, hogy a játékosok többségénél

> ne fusson a programjuk.De miért ne futhatna a régi és az új hw-en egyszerre .. ( RDNA3 és nem RDNA3 )

technikailag megoldható ..másrészt közgazdaságilag erre találták ki a szponzorációt ..

vagyis amikor ezt írtam "Az AMD és a Microsoft - (sok pénzzel vagy igérettel ) korrumpál pár játékfejlesztőt" - akkor ez az jelenti, hogy a játékfejlesztők egy rakat pénzzel mégis racionálisnak látják "csak az új hw-re" fejleszteni

Persze sokszor nem pénzzel hanem fejlesztői/optimalizációs támogatást kapnak a gaming studiók, vagy a megjelenés előtt kapnak az új hw-ből .. ( GPU, CPU, ... )

https://www.amd.com/en/gaming/featured-gamesde amúgy ha nem hiszel nekem ..

(2019)"What does it mean when a game has AMD or Nvidia branding?"

Gaming is big business, and companies are looking for every potential advantage."We've seen in the past (AMD Gaming Evolved, Nvidia The Way It's Meant To Be Played, and Intel Inside), and will certainly see in the future, games that are heavily optimized for a particular GPU and/or CPU architecture. Ideally, this merely provides the best performance possible on one set of hardware without significantly impacting performance on other hardware brands, but it can—and has—result in sometimes questionable performance comparisons."

"Of course, developers and publishers generally want to support as many PCs as possible, so rarely do we see large chunks of older hardware locked out. All the ray tracing and DLSS enabled games so far (Battlefield 5, Metro Exodus, and Shadow of the Tomb Raider) support Nvidia's new RTX GPUs, but they can still run on non-RTX cards without all those fancy extras. I don't expect that to change any time soon, either, but while ray tracing support may not be critical today, in 5-10 years, DirectX Raytracing (DXR) could become the primary API for Windows games. Getting a head start on new technology while receiving some advertising and marketing help for a game? That can be almost too good to pass up."

"Back to the original question, then: What does it mean when a game has branding for a specific hardware company? There's no single clear-cut answer. It could mean marketing and promotional help, with a minor amount of software engineering resources—that's the minimum in most cases. Or it could mean extensive optimizations to make use of new GPU features (eg, ray tracing, DLSS, tessellation, DX12, etc.), or new CPU architectures (more cores/threads, different latencies, etc.)"Mottó: "A verseny jó!"

-

PuMbA

titán

A lényeg, hogy kompromisszum itt is mindig van, mint a való életben mindennél

Egy autó nem lehet egyszerre kis méretű, de nagy csomagtartójú. Egy játékmotornál is el kell dönteni, hogy mi a cél és csak az adott konfiguráció tartományban lesz értékelhető. Az online játékok például egy jó példa: arra mennek, hogy a motor a legoptimálisabb legyen, hogy egy régi gépen is kapj 60-100 fps-t. Például Valorant, League of Legends. A gépemen a játék maximális grafikán, 4x-es MSAA-val megy 400fps-sel, pedig csak egy 5600X, RTX3050-es kombóm van. Mi van ha jobb géped van? Semmi. 400 helyett lesz 800fps-ed, de értelme nem lesz

Egy autó nem lehet egyszerre kis méretű, de nagy csomagtartójú. Egy játékmotornál is el kell dönteni, hogy mi a cél és csak az adott konfiguráció tartományban lesz értékelhető. Az online játékok például egy jó példa: arra mennek, hogy a motor a legoptimálisabb legyen, hogy egy régi gépen is kapj 60-100 fps-t. Például Valorant, League of Legends. A gépemen a játék maximális grafikán, 4x-es MSAA-val megy 400fps-sel, pedig csak egy 5600X, RTX3050-es kombóm van. Mi van ha jobb géped van? Semmi. 400 helyett lesz 800fps-ed, de értelme nem lesz  A motort így írták meg és semmiféle pluszt nem kapsz, hiába van bika géped.

A motort így írták meg és semmiféle pluszt nem kapsz, hiába van bika géped.Dragon3000: Az RT teljesítmény esés miatt van a DLSS, amivel ezt visszahozhatod, még az NVIDIA is együtt "reklámozta" őket YouTube videókban, ha jól tudom. Önmagában az RT nem igazán jó ötlet.

[ Szerkesztve ]

-

Dragon3000

veterán

-

S_x96x_S

őstag

> a gond a megvalósítással van.

a kivitelezésen sok múlik ( meg az időzítésen és a szerencsén is )

és én nem hiszek a lineáris technikai fejlődésben sem.

a jövő kiszámíthatlan

( mind negatív és mind pozitiv irányban is )

De a konzolos trend nagy valószínűséggel előbb utóbb elér a PC/Desktop szintre is.

Vagy az - vagy valami annál is jobb. ha nem most, akkor később..És a technológiai életgörbék néha elég furcsák.

- Nem mindig a jobb technológia terjed el .( lásd VHS vs. Betamax)

- A piacvezetés nem garancia semmire se ( lásd Nokia )

- Ha egy szűk piacon piacvezető vagy és leálsz a fejlesztéssel akkor lehet hogy a sikered áldozata leszel ( ~ Intel )Vagyis a 201x évek lassú Inteles tötyögéséből én nem mernék következtetni a 202x évekre;

mint írtam ( #227) talán jövőre lesz érdemes belépni az AM5 platformba ..

idén csak azoknak akik meg tudják fizetni az opciós felárát a jövőbeli lehetőségeknek.

( ~ korai belépők akinek nem fáj a prémiumos felár )A nagy durranás úgyis a Gen5-re épülő CXL lesz ami miatt sok mindent újra kell gondolni.

meg a XILINX -es FPGA támogatás --> AMD's Artificial Intelligence Engine (AIE)

ami meg csak jövőre jön ... az új APU-kban.A Zen4/Gen5-be most belelépni akkor érdemes,

hogyha a játék mellett mással is meg tudod "racionalizálni".

pl.

- fontos a gyors I/O ( gen5 ssd , AI/ML gen5 GPU)

- vagy az avx-512 -nek hasznát veszed ( mérnöki/matematikai számítások )

- vagy nem tudsz várni a Zen4x3d -re ami 2023Q1-ben jön mert hirtelen most kell gépet venned.Sajnos nincs mindenkire érvényes szabály ..

Szerintem annyira körbejártuk a témát .. és annyira ki lett fejtve minden oldal, hogy részemről lezártam ..

a verseny jó,

és mindenki úgyis a pénztárcájával szavaz ( és viseli a döntése következményeit )

Mottó: "A verseny jó!"

-

Komplikato

veterán

"Jelenlegi tesztekből tudjuk, hogy játékok esetén egy sima 500MB/s-ot tudó SATA SSD és egy PCI-E 4.0 SSD között minimális különbségek vannak."

Ezt mostanában sokat látom, de az általam hitelesnek gondolt érdemi tesztekben PONT NEM ez volt az eredmény.

Fentebb taglalni, hogy a jelnlegei PS5 játékok vagy az első fecske Forspoken mennyire használja ki a Direct Store-t, értelmetlen. Azt, ami miatta játékipar ráugrott, ezek egyike sem tudja még produkálni. Ha lesz játék, ami igen, az meg garantáltan nem fog menni se HDD-n, se SATA SSD-vel normálisan. Folyamatos, állandó streamingről van szó, közvetlen a VRAM-ba. Mivel a nagyobb részletesség végtelen ramot és vramot követelne meg, és csak ezért nem az 1TB ram és teszem azt 96GB vram lesz jövőhéttől az elvárható egy gaming PC-ben. De valamit kezdeni kell a problémával."Figyelj arra, aki keresi az igazságot és őrizkedj attól, aki hirdeti: megtalálta." - (André Gide)

-

makkmarce

őstag

pedig volt, 2d és 3d is.

Ott van a komplett QuakeRT széria is 2004-től.

A quakeRT cpu-n futott, nem GPU-n.

pc-s raytrace cuccok régről a DXR-ig: 15 Years Later: A Historic Look Back at "Quake 3: Ray Traced".

Volt konzol is, itt lentebb linkelték. Volt RT chip-es konzol kártya is, saját 2d-s RT játékhoz.

Voltak hibrid változatok is, ahol mondjuk a karakter és árnyékai realtime rt, a háttér meg statikus.

A gond az, hogy azt hiszitek az RT az, ami most a nextgen játékokban van, de ugyanilyen lépések voltak régebben is, és az RT hol felbukkant, hol eltűnt, épp mi volt a gyorsabb, vagy mivel kísérleteztek.

Az nvidia bemutatója is raytrace volt 2012-ben a kepler megjelenésekor, nem kellett ehhez semmi varázslat.okoskodom, tehát vagyok

-

KisBundi

őstag

Ezt már leírtam én is, hogy az elmélet, a technológia leírása stb már létezik jó régóta, de ezt nem lehet SW-nek nevezni, maximum próbálkozásnak, de amíg nincs olyan cél HW ami elegendő számítási teljesítménnyel bír, érdemi SW-t nem fognak rá írni, azaz tényleges játék vagy végfelhasználói szoftver nem lesz a kezünkben.

-

makkmarce

őstag

elolvastam, és most nézzd meg akkor vagy az nvidiás videót 2012-ből, vagy a nagyon régit, ahol 2d RT volt, és konzolba beépített memóriakártya mellé tettek be egy RT-s chip-et.

"de játékokban valós alkalmazása 2018-ig lehetetlen volt"

nem volt az, lásd nvidia 2012-es RT demót.

Azt, hogy ebből mennyit használtak fel a fejlesztők, az nem a HW baja.

A régi játékok 90%-nál nem volt pl napszak váltás és nem volt túk sok openworld sem. Emiatt az előre kiszámolt lightmap nagyon jól bevált (amit RT-vel számoltak), nem volt nagy szükség realtime rt-re. Persze most is jó lenne perpixel realtimer RT, de az meg most sincs.okoskodom, tehát vagyok

-

PuMbA

titán

Az ilyen demókra való hivatkozás azért nem jó, mert sok olyan dolog van, ami a valóságban sose valósul meg és ott sem mondhatjuk, hogy na de x évvel ezelőtt abban a demóban ment, szóval működik. Igen, de egy demó nem azt jelenti, hogy végül meg fog valósulni az esetleges előre nem látható korlátok miatt. A 2000-res években sok demó készült, amiből meg sose lett semmi. RT-nél szerencsére megvalósult, de az a demó akkor is csak egy fél kész cucc volt, aminek csomó része ma már nem ugyanaz.

[ Szerkesztve ]

-

SindaNarmo

tag

Szerintem olyan szempontból rendben van, hogy ezeken látszik hogy jó lenne gyorsítani hw-sen. Biztos vagyok bele az DXR-ig elég sok motorban megpróbálkoztak valamilyen koncepcióval (amiről nem is tudunk), hátha meg lehet oldani. csak aztán látták hogy még mindig nem igazi a teljesítmény. És kb most ért el oda technológia hogy most már értelme volt egy általánosabb HW-s gyorsításnak is.

Az a baj hogy kb ahogy leírod az nekem úgy hangzik, mintha jött volna egy HW megoldás egy problémára ami nem is létezett és maga HW generálta az egészet problémát, pedig az a demók és korábbi kísérletek eredményei alapján készülhetett. (bár igazából ezek még mindig próbálkozások, csak már széles körben használhatóak is)

[ Szerkesztve ]

-

makkmarce

őstag

ezt a demót azért tettem be, hogy megmutassam, RTX dedikált HW nélkül is vígan volt még GPU-n is raytracing. A GPU-k most értek el arra a szintre, hogy erőből is meg tudnák oldani, persze a dedikált HW-el gyorsabb, de ha megnézed a crytek demót, látod, hogy már kész volt a sima GPU-s raytrace. (emiatt sajnálom is őket, mert valójában befejezték RT-s HW nélkül, csak aztán mindenki közben átment a HW-re). Amikor ez megjelent, akkor még nem volt kint az AMD-nek olyan HW-e, ami gyorsította az RT-t. Ez bőven elég lett volna a játékokba, és ment simán 40-50fps-el 1080p-ben régi 980-as nvidián is, ami már nagyon nem mai gyerek. (én RX480-as AMD-n néztem meg 2 éve, azon is teljesen jól futott).

Tehát nem kellett RTX-es HW az RT-hez, csak sebesség és szakértelem. Ha ma fenn lenne még valahol a QuakeRT RTX mentes változata(az RTX-eset maga az nvidia csinálta meg asszem), azzal is simán lehetne játszani egy modern CPU-n.

A régi játékokban meg pont annyira használták amennyire tudták: realtime radiosity, realtime GI, stb. Lehet, hogy a naplemente fényeit mondjuk 30 másodpercenként számolta ki a játék, és ahogy ment le a nap, szépen RT-ben megvoltak a fények, de olyat nem tudott, hogy minden másodpercben 100x kiszámolja. Ettől még ott volt, része volt az engine-eknek már legalább egy évtizede. Még lehet is állítani a játékmotorokban, hogy mennyi CPU időt vigyen el.

Ezen felül ott voltak a konzolok, dedikált gyorsítókkal. Itt lentebb más is linkelt, és én is linkeltem egy videót ahol konzolhoz készült játék, aminek a memória kártyája mellé tettek egy 2D-s RT gyorsítót, de volt a videóban 3d-s játék is, csak egyesek túl pixelesnek találták, de megjelent hivatalosan, és játszható is volt.[ Szerkesztve ]

okoskodom, tehát vagyok

-

PCProfessor

aktív tag

Vártam, hogy mikor linkeli be valaki ezeket. Igen, elég jó de még mindig drágább és a korai adaptáció miatt nem mindenkinek passzol. Az meg, hogy ő 3200cl16 vagy cl14-es kittel csinálja egy kicsit fura. Arról nem is beszélve, hogy maxolja a grafikát mikor a lehető legkisebben kéne, hogy jól látható legyen mennyi a különbség. Patriot viper kit 4000cl16-on kb.ugyanannyiba fáj mint a ddr5 4800-as és odaveri. Ha pedig jobb ddr5 ram kell az már 50%-al drágább és 20%-al erősebb. Alaplap annyira nem drága de így is többe kerül. Ha valakinek megéri ő tudja.

[ Szerkesztve ]

Ennyit meg annyit tud a kártya(bizonyíték nincs), benchmark meg a Marson! Ettől meg attól JOBB, NAGYOBB TELJESTMÉNYT HOZ. (c) Userbenchmarkot linkelő gyökér| Sír a fogyasztás miatt, mert 300W-t eszik a kártya miközben 20x akkora teljesíténye van mint 10 éve

-

PCProfessor

aktív tag

Persze, hogy van. Ez itt a cél. Ez az első nézőpont így a ddr5-ös verzió jobbnak tűnik ddr4-hez képest. A másik pedig amit én mondok, hogy ha levenné és úgy tesztelné a ddr4 jobbnak tűnne és nagyobb különbség lenne. Amit ugyanannyi ember kihasználna mint a kimaxolt grafikát.

Ennyit meg annyit tud a kártya(bizonyíték nincs), benchmark meg a Marson! Ettől meg attól JOBB, NAGYOBB TELJESTMÉNYT HOZ. (c) Userbenchmarkot linkelő gyökér| Sír a fogyasztás miatt, mert 300W-t eszik a kártya miközben 20x akkora teljesíténye van mint 10 éve

-

PCProfessor

aktív tag

Igen volt, siege meg cs:go. Mindkettő annyira jól van optimalizálva, hogy 1-2% különbség van csak a ramok között. A tesztek 70% high vagy afeletti az említett maradék kettőt meg lowra vette, mert nincs eltérés(ami nem hibahatár). Tudom, hogy rengeteg idő amit beleöl és nem lehet az összes beállítást megnézni. Az adott játékok tesztelve lettek csak nem egységesen. A legvégén pedig fel van tüntetve, hogy 6000cl36 azért, hogy jobbnak tűnjön. Okkal nem a 4800-as értékekett tették oda.

Ennyit meg annyit tud a kártya(bizonyíték nincs), benchmark meg a Marson! Ettől meg attól JOBB, NAGYOBB TELJESTMÉNYT HOZ. (c) Userbenchmarkot linkelő gyökér| Sír a fogyasztás miatt, mert 300W-t eszik a kártya miközben 20x akkora teljesíténye van mint 10 éve

-

PCProfessor

aktív tag

Ezt csak így itt hagyom.

Szomorú, hogy a legtöbb mainstream techtuber terjeszti a fals infót/nem tud rendesen gépet "hangolni" és a nép bedől nekik.

[ Szerkesztve ]

Ennyit meg annyit tud a kártya(bizonyíték nincs), benchmark meg a Marson! Ettől meg attól JOBB, NAGYOBB TELJESTMÉNYT HOZ. (c) Userbenchmarkot linkelő gyökér| Sír a fogyasztás miatt, mert 300W-t eszik a kártya miközben 20x akkora teljesíténye van mint 10 éve

-

PCProfessor

aktív tag

"A HUB nem csak csúcskitet hasonlított"

Pontosan, jobb ddr4 kimaradt.

A videó végén pedig 6400-as értéket odabiggyesztette, mert feltűnőbb. DDr4-ből azért nem rakta oda a jobb kitet, ami olcsóbb mint a ddr5-ös, mert 1-2%-on kívül semmi változás nem lett volna. Akit én linkeltem egységesen tesztelt(sőt a ddr5-ös kitet maxra tuningolta is) és még így is szinte elhanyagolható a differencia, ráadásul sokkal többet kerül.Ennyit meg annyit tud a kártya(bizonyíték nincs), benchmark meg a Marson! Ettől meg attól JOBB, NAGYOBB TELJESTMÉNYT HOZ. (c) Userbenchmarkot linkelő gyökér| Sír a fogyasztás miatt, mert 300W-t eszik a kártya miközben 20x akkora teljesíténye van mint 10 éve

-

PCProfessor

aktív tag

Ha hasonlítunk akkor nem mangot dinnyéhez, hanem 2 egyformát. Az a kisebb probléma, hogy nem egységes, a nagyobb gond az, hogy félreinformálják és promótálják ezt a legnagyobb tuberek.

Ennyit meg annyit tud a kártya(bizonyíték nincs), benchmark meg a Marson! Ettől meg attól JOBB, NAGYOBB TELJESTMÉNYT HOZ. (c) Userbenchmarkot linkelő gyökér| Sír a fogyasztás miatt, mert 300W-t eszik a kártya miközben 20x akkora teljesíténye van mint 10 éve

-

PCProfessor

aktív tag

Nem kell finomhangolni a ddr4 kitet. Xmp bekapcsol és 4400-4000 cl18-16 simán megy a középkategóriás lapokban.

Ennyit meg annyit tud a kártya(bizonyíték nincs), benchmark meg a Marson! Ettől meg attól JOBB, NAGYOBB TELJESTMÉNYT HOZ. (c) Userbenchmarkot linkelő gyökér| Sír a fogyasztás miatt, mert 300W-t eszik a kártya miközben 20x akkora teljesíténye van mint 10 éve

Új hozzászólás Aktív témák

ph A Zen 4 derekas előrelépés lesz, ráadásul biztosan aktív AVX-512-t kínál majd.

- Új Beats fej- és fülhallgatók jelentek meg

- A fociról könnyedén, egy baráti társaságban

- Milyen routert?

- Autóápolás, karbantartás, fényezés

- OLED TV topic

- Folyószámla, bankszámla, bankváltás, külföldi kártyahasználat

- Gmail

- Futott egy Geekbench kört egy új HTC készülék

- Vezeték nélküli fülhallgatók

- Debrecen és környéke adok-veszek-beszélgetek

- További aktív témák...

"

"