Hirdetés

-

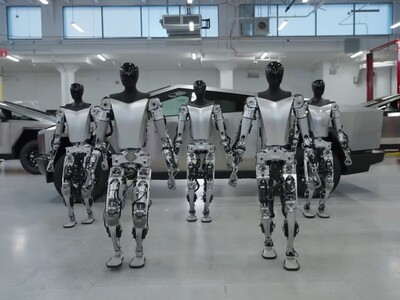

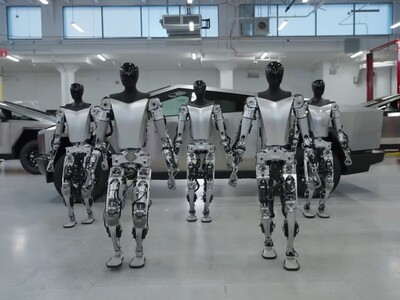

Musk szerint már jövőre itt vannak a Tesla Optimus humanoid robotok

it Musk a befektetőknek arról beszélt, hogy már az idei év végén gyárakban dolgozhatnak a Tesla Optimus robotok, a forgalmazás jövő év végén indulhat.

-

Lenovo Essential Wireless Combo

lo Lehet-e egy billentyűzet karcsú, elegáns és különleges? A Lenovo bebizonyította, hogy igen, de bosszantó is :)

-

Friss előzetesen a Destiny 2: The Final Shape

gp Érkezik az utolsó nagy kiegészítő, azonban a fejlesztők szerint ettől még nem lesz vége a franchise-nak.

Új hozzászólás Aktív témák

-

Ezekiell

veterán

Jaja - és az az érdekes mindkettő feltevésedben, hogy amilyen tempóban fejlődik az akkumulátortechnológia, ez simán meg fog történni pár (lehet jópár) éven belül

Utolsó bekezdéseddel teljesen szó szerint egyetértek.

Aki mibennünk nem bízik, az önmagában sem bízik. Aki mibennünk nem bízik, az a mi fényes békénkben sem bízik. És aki a mi boldog, fényes békénkben nem bízik, az áruló.

-

#54625216

törölt tag

válasz

Ezekiell

#543

üzenetére

Ezekiell

#543

üzenetére

"Az 1 szálas teljesítmény a legfontosabb napjainkban - ahogy erről volt szó is itt a topikban."

"Valamint single core performance max játékoknál elsődleges, bármi produktivitás-centrikus

felhasználásnál a multicore performance lesz a lényeg mindig is, sőt évről évre egyre jobban."Bocsi, nem bírtam kihagyni.

-

Ezekiell

veterán

válasz

#54625216

#552

üzenetére

#54625216

#552

üzenetére

Teljesen jogos, tudtam h jönni fog ez

Consumernél single core, prosumernél/professionalnál multicore a fontosabb (bár függ nyilván az adott alkalmazástól). Pongyolán fogalmaztam a "max játékoknál fontos" dologgal, teljesen jogos a bekérdezés

Aki mibennünk nem bízik, az önmagában sem bízik. Aki mibennünk nem bízik, az a mi fényes békénkben sem bízik. És aki a mi boldog, fényes békénkben nem bízik, az áruló.

-

#54625216

törölt tag

válasz

Ezekiell

#553

üzenetére

Ezekiell

#553

üzenetére

Szerintem consumer vonalon - elméletben - pont nem erős az egyszálas teljesítmény igény.

Windows ökoszisztémában persze igen, mert a consumer szoftvereket próbálják a legminimálisabb hardverkövetelményekhez igazítani, hogy a lehető legnagyobb közönséget érjék el, és ugyebár a legcsirkébb procikban 1 max. 2 mag van, így ahhoz igazítják a szoftvert is. Ezért alakult ki az a tapasztalat a felhasználókban, hogy kétszer annyi GHz többet ér, mint kérszer annyi cpu core, mert az egyszálas teljesítmény növelése azonnal érezhető, a több mag meg nem.

Amúgy már a 80-as évek óta probléma a fejlesztőknél, hogy nem nagyon használják ki a fejlettebb hardvert ha az felülről kompatibilis a gyengébbel, mert úgy nagyobb piacot érnek el akkor is, ha emiatt a szoftver minőségében kell kompromisszumot kötni. Commodore 128-ra pl. szinte semennyi játékot sem fejlesztettek, mert úgyis tudott C64 módban futni. Így viszont szinte mindenki C64 módban futtatta, azaz a fejlettebb hardvert a userek igen nagy százaléka egyszerűen nem használta.Ma ugyanez van PC-n a többmagos CPU-kkal: egy (esetleg két) magot maxra pörget a játék, a többi 3-6-8 pedig tétlenül várakozik, esetleg OS feladatok használják a maradék teljesítmény alig 1-2%-át.

Ezen fejlesztői mentalitás mögött viszont nem technikai, hanem a fent leírt piaci megfontolások vannak, mert pl. a játékok nagyon is ki tudnák használni akár egy 64 cpu-s gép teljesítményét is, hiszen maga a feladat alapvetően párhuzamosítható.Na most Mac-en - mint általában - más a helyzet, mint Windows-on.

Először is pont az ARM-ra váltással megszűnik a "legacy support" probléma, azaz a fejlesztők nem vesztenek piacot azzal, ha a consumer felhasználóknak is többszálú szoftvereket fejlesztenek, így - legalábbis Mac-en - elhárul az üzleti akadály a többszálúsítás elől.

A másik, hogy a Mac nem játék platform, tehát ha a játékfejlesztést visszafogja a PC-s mentalitás (mert nyilván nem fogják a játékok zömét alapjaitól újraírni a Mac kedvéért), az amúgy sem érinti a Mac-es consumer felhasználók zömét.[ Szerkesztve ]

-

dabadab

titán

válasz

Ezekiell

#549

üzenetére

Ezekiell

#549

üzenetére

Igen, tudom, van az a film.

Meg van a valóság, amikor kiderült, hogy a GM EV-1-nél sokkal jobb, használhatóbb és olcsóbb villanyautók se kellettek a kutyának az olajipar ármánykodása nélkül se, mert drágák és nagyon korlátozottan használhatóak voltak, aminek az egyik legfőbb oka az aksitechnológia volt, amit egyébként amúgy is ezerrel fejlesztettek a mindenféle mobilkütyük meg egyebek miatt, de túl nagy áttörés nem volt.

Aztán jött egy kicsi, folyamatosan a csőd szélén táncoló vállalat (amit igazán nem lett volna nagy probléma a hatalmas olajlobbinak a szakadékba löknie), ami elhozta azt a nagy ötletet, hogy drága, de erős hajtáslánc köré nem városi kisautókat, hanem luxusatókat kellene építeni, meg ha nincsenek töltőállomások, akkor építeni kell.

DRM is theft

-

#54625216

törölt tag

válasz

#54625216

#555

üzenetére

#54625216

#555

üzenetére

Update: Unity coming to Apple silicon

-

joey04

titán

válasz

#30786816

#554

üzenetére

#30786816

#554

üzenetére

bizony, erre rá kell még pakolni 30%-ot kb. plusz valamit nagyon forrasztanak a háttérben, mert ez az A12Z olyan szempontból csalódás volt az új iPad-ben, hogy alig fejlődött. Gondolom ezek szerint azért, mert az igazi nagy durranást már majd az év végén piacra lépő arm alapú gépekbe tartogatják. Egyszálas teljesítményben az a12z alig jobb, mint a telefonokban megjelent kistesó a12, ami egy 2018-as cucc. Szóval bő 2 év alatt nagyot fejleszthettek.

"Ha nem vennél a kezedbe gyorsabb telefont, akkor soha nem mondanád meg, hogy mennyivel gyorsabb telefonok vannak jelenleg a piacon."

-

hokuszpk

nagyúr

fiuk en egyaltalan nemvagyok kepben Apple ugyben. ezert majd hulyezzetek le, ha nagyon elvetemult a gondolat.

az x86/64 egyik problemaja a rengeteg 32 bites kod, amit futtatni kell.

Amikor az Apple az Intel osvenyere lepett, akkor mar boven 64 bites cpuk voltak. Szoval a "sima" x86 kod mennyire jellemzo az Alman futo szoftverekben ?

mert ha "eleg lenne az X64 -et gyorsitani", akkor siman elbirom kepzelni, hogy ugyan az Intel nem ad X86 licencet, de az AMDtol megveszik az X64 licencet, ( van az a penz, az AMD anno az NVnek is adott volna, az NV cput allitolag az Intel furta meg ) es azzal mar eleg szepet lehetne alakitani a jelenlegi szoftverek futasan is.[ Szerkesztve ]

Első AMD-m - a 65-ös - a seregben volt...

-

#30786816

törölt tag

válasz

#54625216

#555

üzenetére

#54625216

#555

üzenetére

Azért fontos az egyszálas teljesítmény, mert azt mindenhol érzed, a nem párhuzamosítható és a párhuzamosítható részeket is lineárisan (már ha mhz-re vetített számítási teljesítményről beszélünk, különben az egyszálas-többszálas TB bezavar) megdobja, a magszám viszont csak utóbbit.

Az extra magok határhaszna viszont nem lineáris, ha meg ezt egész jól közelíti - azaz jól párhuzamosítható (rész)feladat - akkor már felmerül a kérdés, hogy ennek nem a gpu-n lenne-e a helye.

Olyan finomságok is komolyan tudnak számítani, hogy például adott processzor milyen hatékonyan vált aközött, hogy minden erőforrásával egy magot pörget, majd az összeset pörgeti, és erről vissza. -

-

#54625216

törölt tag

válasz

Ezekiell

#563

üzenetére

Ezekiell

#563

üzenetére

Kb. ugyanaz: üzleti megfontolásból nem fektetnek időt és pénzt a fejlesztésbe, mert egy szálon a kenyérpirítón is elfut és ugye attól, hogy nem használja ki az összes magot még nem lesz lassabb.

ARM-os Mac-en viszont lassabb lesz, míg ha kihasználják a több magot és az egyéb hardveres gyorsítókat, akkor akár az x86-ot meg tudja előzni, és mivel nincs visszafele kompatibilitási kényszer, így üzleti szempontból is megéri optimalizálni. -

Ezekiell

veterán

válasz

#54625216

#564

üzenetére

#54625216

#564

üzenetére

Ha üzleti szempontból megéri optimalizálni több magra/szálra mostmár az Apple siliconra, akkor meg is fogják lépni. De ez nem olyan egyszerű általában

[ Szerkesztve ]

Aki mibennünk nem bízik, az önmagában sem bízik. Aki mibennünk nem bízik, az a mi fényes békénkben sem bízik. És aki a mi boldog, fényes békénkben nem bízik, az áruló.

-

Tin

veterán

válasz

#54625216

#562

üzenetére

#54625216

#562

üzenetére

Egyszerűen nem hoz annyit, amennyi melóba kerül átírni.

Ami alapból párhuzamosan megy, azok a szerver oldali komponensek. Ott sok hívás van, amik mind külön szálon futnak, az oprendszer párhuzamosít, jól kihasználja az erőforrásokat, és optimálisan működik a dolog. Gyakorlatilag az adatbáziskezeléstől kezdve egymillió dolog van, ami így működik, és jól működik. Itt a fejlesztőnek csak a közös erőforrások párhuzamos kezelésével kell foglalkoznia, a szálak nyugodtan lehetnek szekvenciálisak, úgyis egymás mellett futnak.

Ami még jól párhuzamosítható, azok a hosszú lefutású, egymás mellett, de főképp javarészt egymástól függetlenül futtatható dolgok. Pl. egy képet szétdobhatsz 8 részre, és feldolgozhatod szálanként a nyolcadat, egy játékban számolhatod külön a hátteret és az előteret, vagy a következő X frame-et, egy nagyobb műveletet szétbonthatsz részegységekre, ha azok nem egymásra épülnek, és számolhatod azt.

De a programok logikájának nagy része egymásra épül. Ritka az, amikor megnyomsz egy programban egy gombot, és mondjuk erre fel kell dolgoznia egy adatsort, ezzel párhuzamosan egy másodikat és egy harmadikat, majd az első három eredményen elvégezni egy negyedik feldolgozást. A legtöbbször sorban végzel el műveleteket az adatokon, és az eredmények egymásra épülnek, ezt pedig nem igazán lehet párhuzamosítani. Van, amit igen, de ott sem biztos, hogy nyersz vele, mert egyszerűen sokkal tovább tart párhuzamosítani valamit, ami az esetek 18%-ában, bizonyos lefutások esetén mehet egymás mellett, ezzel nyersz 30%-nyi feldolgozási időt, de beleölsz mondjuk 50 embernapot, de a gyakorlatban nyersz vele 1 mp futási időt. Egyszerűen nincs értelme.

Az igazán számításigényes feladatokat, a nagy terhelést adó műveleteket már rég párhuzamosították. Tudom, a játékok között van, ami csak 4 magot használt eddig, de az új engine-ek már akármennyire skálázódnak, és kész.

A párhuzamos programozás nem olyan, hogy "legyen párhuzamos", ott olyan problémák jönnek elő, amikhez tök más gondolkozásmód kell, pl. közös erőforrások egyszerre történő használata, részfeladatoknál egymás bevárása, szálak összefogása, stb. Ezek jó dolgok, de amíg ekkora fejlesztői hiány van és ilyen szinten fejlődnek a hardverek, ez egyszerűen értelmetlen, leszámítva a szervertermékeket és a valódi, nagy célközönségnek szóló alkalmazásokat, de ott meg már megcsinálták.

-

VirsLee

őstag

Mindenki, aki olyan tevékenységre használja a saját számítógépét, amivel nem a jövedelemszerzés a célja. Tehát, akiknek ez nem munkaeszköz.

(#571) Tin: nem méltatlan lenne, hanem hasznos, ha megosztanád velünk is, hogy szerinted mi az a feladat, amit az átlagfelhasználó végez a gépen és nem párhuzamosítható, de az egy szálas teljesítmény se elég rá. Sok itt az aggódó ember, mert néhányan rémisztgetik őket, hogy lehet lassú lesz, de amúgy se lehet mindent párhuzamosítani, de ez nem x86, de amúgy se lesz elég szoftver... stb.

Holott az igazság az, hogy az átlagfelhasználó igényeit egy 150 grammos mobiltelefon kielégíti. Arról pedig még semmi infó nincs mi kerül a gépbe, csak annyit tudunk, hogy egy 2 évvel ezelőtti proci van benne.

-

Tin

veterán

-

-

Auratech

őstag

Az aktuális tesztek egy A12-re épülő, kimaxolt teljesítményű Soc értékei. Az ősszel megjelenő soc az A13ra épül, aminél lehetett látni, hogy a kétmagos teljesítménye alig gyengébb, mint az A12 négy maggal.

Ha az A13-ra épül egy abból 8 erős+4 spórolós magot felvonultató verzió, akkor az a fejlesztői kitnél szerintem legalább 3x "erősebb" lehet. Ha a tdp engedi, a 4 takarékos mag is bedolgozhat, ahogy néhány régebbi telónál. Az is felér egyel. A vége lehet egy 10e multicore Geekbench 5 érték, ami azért élhető. És már fejlesztik az A15-öt is..Auratech Field Recording

-

dabadab

titán

-

Auratech

őstag

Nem. Az A12Z 4 vortex és 4 tempest magot tartalmaz. A sima A13, amivel az összehasonlítást olvastam az az általad írt 2lighting+4thunder mag felépítésű. Amire ki akartam lukadni, hogy a némileg kisebb órajelű 4 mag az A12Z-ben nem előzi meg jelentősen a fejlettebb és párszáz MHz-zel gyorsabb 2 A13-mas magot, csak kb 40%-kal a cpu teljesítményben. 4700 vs3400 GB5.2 multi pont. 4 maggal az A13 6500 felett teljesíthet(ne). Szóval javul rendesen az új gen.

Az A12Z extra előnye a gpu-ba belepakolt 8 magnak köszönhető, ami persze sokkal inkább kell az iPad pro-ba, mint egy sima telóba.

[A12Z vs A13][ Szerkesztve ]

Auratech Field Recording

-

kalimist

aktív tag

válasz

Auratech

#581

üzenetére

Auratech

#581

üzenetére

Az A13-ban főként a 4 Thunder mag teljesítménye nőtt jelentősen a Tempest-hez képest ezért is annyi a különbség GB-ben amennyit írtál mert az összes mag megy egyszerre nem csak a teljesítmény centrikusak. Összehasonlítva pl. egy Arm A55-tel (elavult őskövület) 3x gyorsabb fele akkora energia fogyasztással.

Az A13 és az A12Z közti órajelkülönbség nem "párszáz Mhz" hanem 2.66 Ghz vs 2.5 Ghz de az A13 Lighning magoknak kicsit megugrott a fogyasztásuk a Vortex-hez képest és szerintem ezért sincs A13X hanem majd 5nm-en A14X lesz. A GPU viszont nagyon komolyat lépett előre az A12/A13 viszonylatában, Qualcomm szégyellheti magát. -

Auratech

őstag

válasz

kalimist

#582

üzenetére

kalimist

#582

üzenetére

Köszönöm a pontosítást. Nem tudtam, hogy megy egyszerre az összes mag. Oké a párszáz az 170. Az egymondatos lényeg, amit írtam volna, hogy az A12Z után következő soc, ami Mac-ba kerül, hozza egy hasonló eszközben lévő intel proci erejét, ha már a mostani se kidobnivaló.

Auratech Field Recording

Új hozzászólás Aktív témák

ph A vállalat külön lapkákat tervezne a Mac gépekbe, illetve leporolják az egyszer már jól bevált Rosettát is.

- Eredeti dizájnnal tér vissza idén a Nokia 225 4G

- EAFC 24

- Háztartási gépek

- sh4d0w: Rebel Moon - Ne nézd meg!

- exHWSW - Értünk mindenhez IS

- Budapest és környéke adok-veszek-beszélgetek

- Vodafone otthoni szolgáltatások (TV, internet, telefon)

- Spórolós topik

- Házi barkács, gányolás, tákolás, megdöbbentő gépek!

- Motorola Edge 40 - jó bőr

- További aktív témák...